基于OverFeat模型的長江口南匯潮灘植被分類

李靜, 韓震,2,*, 王文柳, 崔艷榮

基于OverFeat模型的長江口南匯潮灘植被分類

李靜1, 韓震1,2,*, 王文柳1, 崔艷榮1

1. 上海海洋大學 海洋科學學院, 上海 201306 2. 上海河口海洋測繪工程技術研究中心, 上海 201306

潮灘地帶環境復雜多變, 有些植被之間光譜特性相似, 為了解決植被精細分類精度不高的問題, 利用基于ImageNet預訓練的卷積神經網絡OverFeat模型, 以高分二號(GF-2)衛星遙感影像作為實驗數據, 對長江口南匯潮灘不同生長狀態的植被進行了深度特征提取, 然后將模型訓練好的深度特征輸入到支持向量機(SVM)分類器中, 得到植被分布信息。研究結果表明, 與基于光譜特征的SVM分類方法相比, 文章所用方法的分類精度更高, 總體精度可達96.08%, 證明了使用基于ImageNet數據集的預訓練卷積神經網絡對不同生長狀態的植被可以實現較好的識別。

ImageNet; 卷積神經網絡; OverFeat; 特征提取; 分類

0 前言

海岸帶潮灘地帶是海洋向陸地的過渡帶, 其環境復雜多變, 且植被覆蓋范圍廣, 植被間同物異譜、同譜異物現象較為普遍, 對于植被的精細分類, 基于光譜統計特征的分類方法準確度不高。卷積神經網絡模擬大腦通過多層神經網絡建立學習機制, 從低層向高層逐層提取抽象特征, 在復雜圖像的分類上有一定優勢。近年來, 卷積神經網絡在遙感圖像上的應用日益增多。J. Donahue等[1]提取了基于ImageNet訓練集的預訓練卷積神經網絡的輸出特征, 實現了不同種類圖像的分類識別。Hu等人[2]對現有的深層卷積神經網絡結構進行分析, 并對其各隱含層的輸出進行對比, 提出了使用深度學習對光學遙感影像進行特征提取。張偉等[3]通過預訓練好的AlexNet卷積神經網絡對GF-1多光譜影像進行特征提取, 分析了其地表覆蓋分類, 得到了更高的分類精度。黨宇等[4]使用大量數據微調AlexNet模型, 有效計算了各圖斑的地類隸屬, 實現了自動地表覆蓋分類圖斑量化評價。葛蕓等[5]證明了在ImageNet上訓練好的卷積神經網絡用于遙感圖像檢索是一種有效方法。李冠東等[6]利用基于ImageNet預訓練的卷積神經網絡Inception-v3模型提取了高分影像的特征向量, 并將其輸入到新的全連接層, 經少量帶標簽影像場景數據訓練后得到最終分類結果。綜上所述, 基于ImageNet預訓練的卷積神經網絡不僅可以進行不同種類圖像的分類, 在遙感影像的識別分類上, 如地表覆蓋分類、遙感圖斑地類隸屬、高分場景影像以及遙感圖像檢索方面的識別分類效果也比較好。

OverFeat模型是預訓練卷積神經網絡中比較常用的模型, 其是在AlexNet模型的基礎上改進發展的, 并基于ImageNet訓練集訓練模型參數, 可實現深度特征提取和分類的功能。Marmanis D等[7]將基于ImageNet訓練集的預訓練卷積神經網絡OverFeat模型應用于UC Merced Land數據集的分類, 準確率可達到92.4%。OverFeat模型廣泛應用于圖像識別方向, 而CaffeNet、VGG等卷積神經網絡在遙感圖像的識別上, 由于層數過多會產生過擬合現象, 故本文選取OverFeat模型。

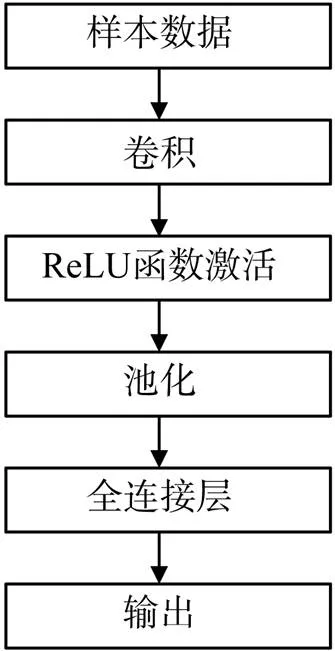

圖1 技術路線

Figure 1 Technical route

本文通過基于ImageNet預訓練的卷積神經網絡OverFeat模型, 將模型的網絡結構和參數應用到遙感圖像上, 以GF-2衛星遙感影像為實驗數據, 對長江口南匯潮灘的植被進行深度特征提取, 技術路線如圖1所示, 結果表明利用OverFeat模型提取的植被深度特征進行分類與基于光譜特征的分類方法相比精度更高。

1 模型方法

1.1 OverFeat模型

OverFeat模型是Sermanet P等提出的一種基于ImageNet數據集的預訓練卷積神經網絡, 可以達到分類、預測、定位的目的, 其充分利用了卷積神經網絡的特征提取功能[8]。 OverFeat模型包括Fast和Accurate兩種網絡結構, Fast模型的運行速度更快, 但是Accurate模型的準確度更高一些, 所以本文選擇使用Accurate模型。Accurate模型分為9層, 其中前6層為卷積層, 后3層為全連接層。OverFeat Accurate模型主要進行的運算有卷積、池化、以及ReLU激活函數的使用, 如圖2所示。

OverFeat模型的卷積過程可以描述為:

F=(F–?W+b) (1)

其中F(1≤≤6)為第層卷積層,?為通過卷積核對第-1層特征進行卷積運算,W表示第層卷積核的權重,b表示第層的偏置, 最終通過激勵函數輸出特征。

池化層一般直接在卷積層之后進行, 用于對特征圖的下采樣, 可以達到降維的目的, 并在一定程度上保持特征的尺度不變。OverFeat模型使用最大值池化函數, 只采用了普通的池化, 其步長為3。模型僅在第1、2、6層卷積層之后使用最大值池化。

OverFeat模型使用ReLU激活函數來有效改善梯度消失和收斂波動。ReLU函數的數學表達式為:

()=max(0,) (2)

是非飽和線性函數, 只要通過一個閾值就可以得到激活值, 所以在隨機梯度下降時的收斂速度比Sigmoid函數快。

圖2 OverFeat Accurate模型基本功能

Figure 2 Basic functions of OverFeat accurate model

模型采用Dropout來抑制過擬合, 在訓練過程中每次輸入數據時, 都會激活不同的隱含網絡結構, 但是由于權重共享, 使得神經元之間的復雜互適應關系明顯降低, 從而有效抑制了過擬合問題, 提高了模型的泛化能力。

模型參數的更新是基于梯度下降算法的, 其中超參數的設置如下: 動量項為0.6, L2權重的衰減系數為10-5, 初始學習率為0.05, 并且在每迭代30、50、60、70、80次后, 學習率每衰減0.5倍, Dropout為0.5。每層的權重服從(,)=(0, 0.01)的高斯分布。

1.2 SVM分類方法

SVM分類的基本思想是通過核函數將輸入向量轉化到高維空間, 根據間隔最大理論尋找最優分類面, 用最優分類面進行分類, 其分類包括2個部分: 訓練SVM分類器和分類。通過給定訓練樣本, 構造并求解凸二次規劃問題, 其求得的解對應的樣本就是支持向量, 以此完成SVM分類器的訓練; 之后構造分劃超平面, 求得決策函數, 將待分類影像中的未知樣本特征帶入到決策函數中, 完成樣本的分類。

2 實驗與結果分析

2.1 研究區域

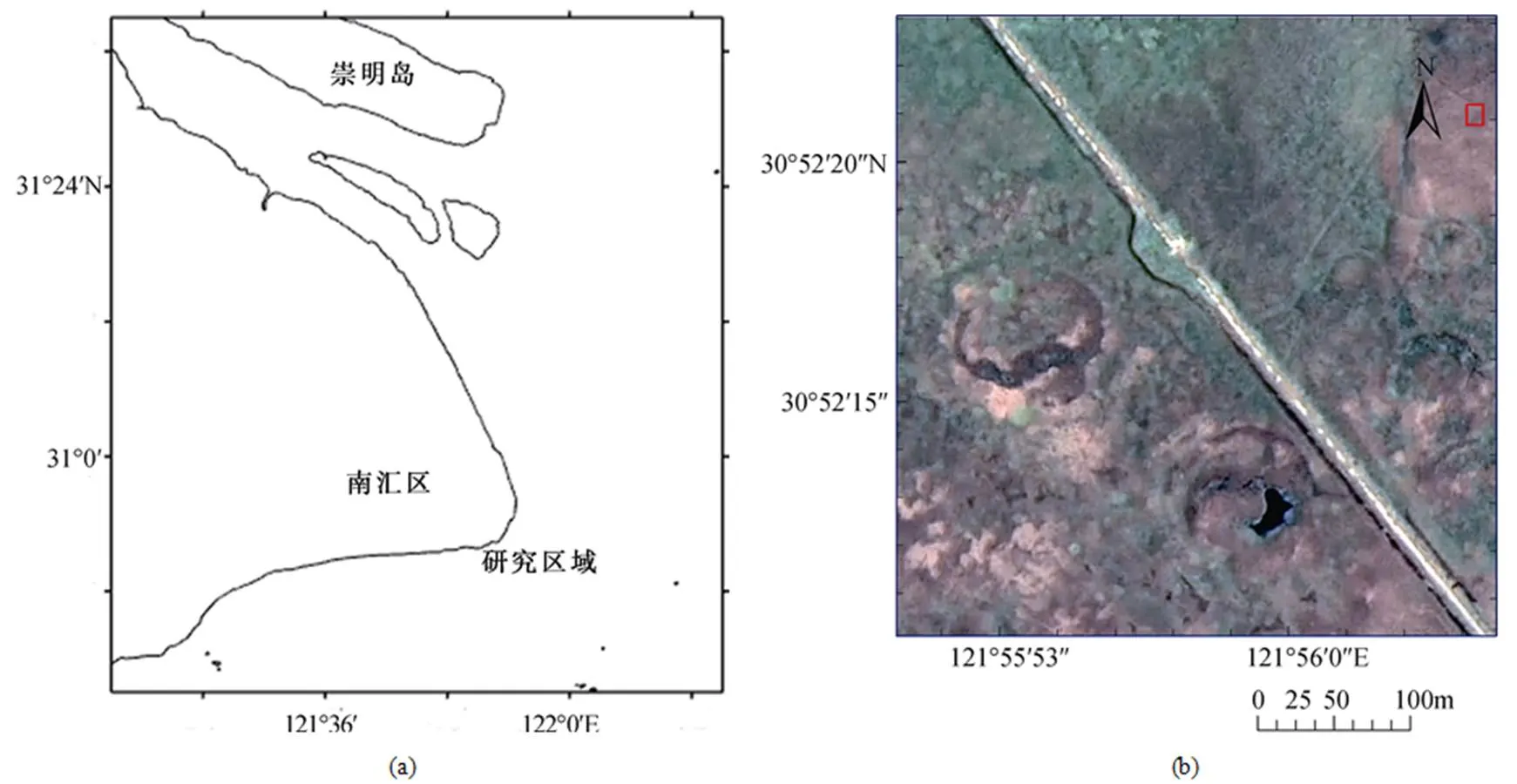

本文選取的研究區域分布在長江口南匯潮灘, 位于30°52′10″N—30°52′23″N, 121°55′50″E—121° 56′33″E, 具體遙感影像如圖3(b)所示, 成像時間為2016年5月4日, 圖像大小為400ⅹ400。研究區域內有大范圍的潮灘植被, 主要的植被類型有蘆葦、一枝黃花。

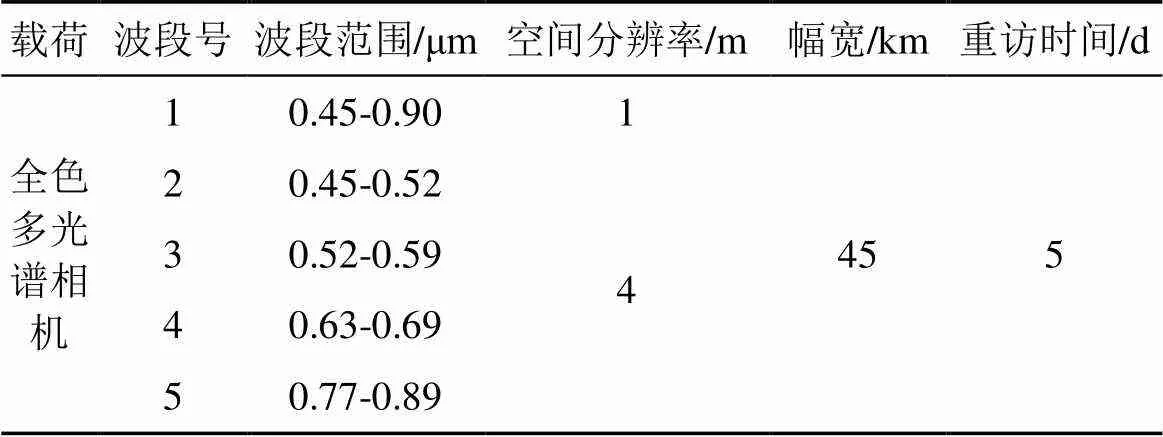

2.2 實驗數據

高分二號(GF-2)衛星于2014年8月19日發射成功, 是我國自主研制的空間分辨率優于1 m的民用光學遙感衛星, 具體的衛星有效載荷技術指標如表1所示[9]。由于研究區域臨近東海岸邊, 5月初氣溫還比較低, 蘆葦雖正屬于生長期, 但其生長狀態不一致, 部分枯黃的蘆葦還保留在原地, 其在圖像上的表現有所差異, 所以將研究區域的蘆葦分為兩類, 其中一種為展葉期蘆葦, 另一種為還保留飄絮的枯黃期蘆葦。一枝黃花也正處于生長期, 長勢有所不同, 其中一種為高植株, 另一種為剛出苗的低植株。本文從圖像中選取了1646個樣本點, 其中蘆葦I(展葉期蘆葦)312個樣本點, 蘆葦II(枯黃期蘆葦)432個樣本點, 一枝黃花I(高植株)324個樣本點, 一枝黃花II(低植株)418個樣本點, 水體78個樣本點, 裸地82個樣本點。實驗選取880個樣本點作為測試數據, 選取766個樣本作為驗證數據。

圖3 研究區域

Figure 3 Research area

2.3 潮灘植被主成分分析特征提取

主成分分析是一種線性變換方法, 可實現圖像增強, 減少計算數據量, 同時可消除特征向量中各特征的相關性, 增強分類信息。本實驗由于之后OverFeat模型的輸入要求為221ⅹ221ⅹ3, 所以取前三個主成分參與分類研究。

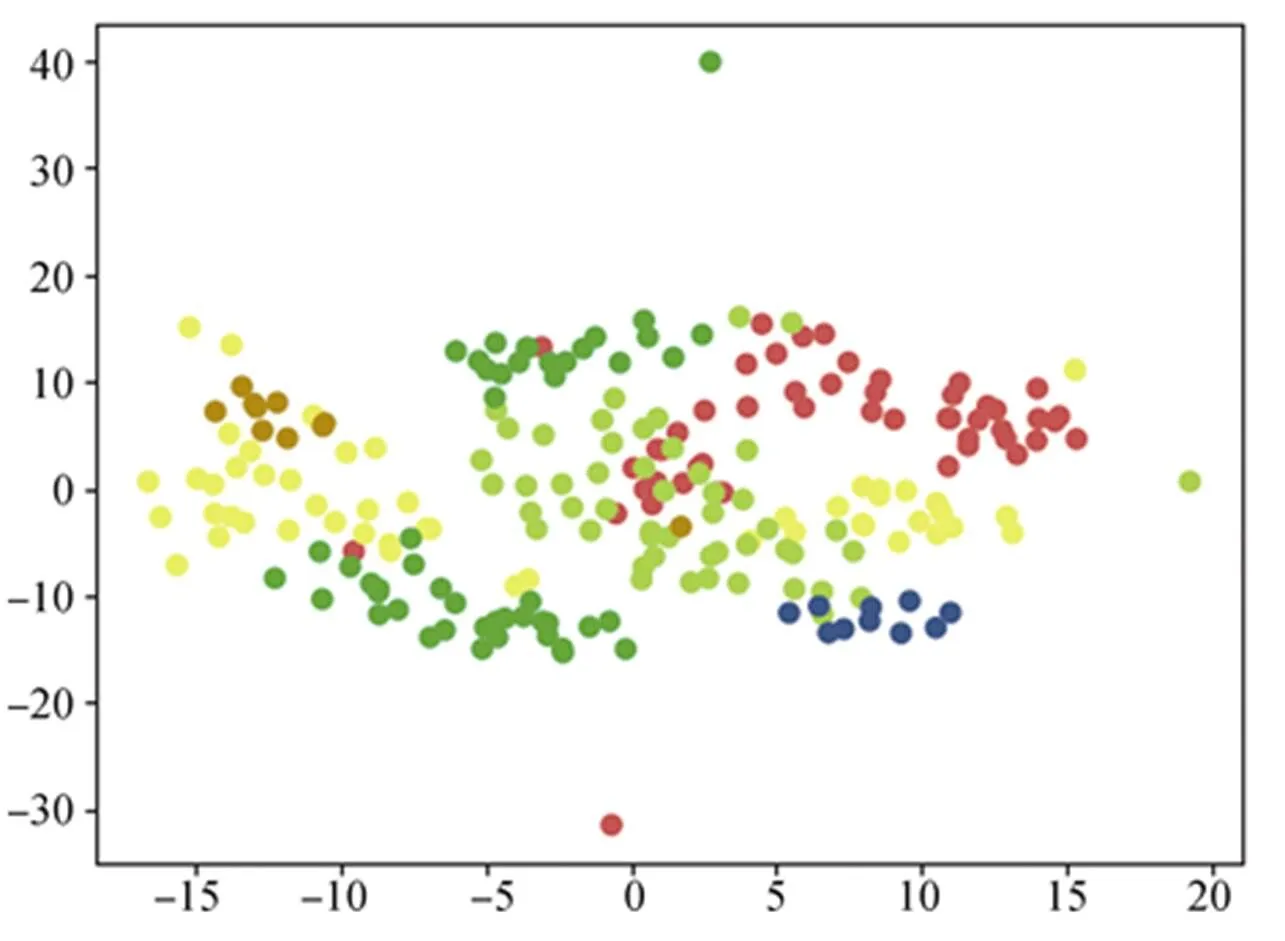

t-SNE算法是Maaten等[10]提出的一種非線性降維的流形學習算法, 其基本原理是通過將數據點之間的歐氏距離轉換為表示相似性的條件概率來將高維空間點對映射到低維空間, 保持點對之間的特性不變。實驗選取220個樣本點進行特征分析, 前三個主成分上樣本的光譜特征經過t-SNE算法得到的結果如圖4所示, 其中蘆葦II與裸地、一枝黃花II樣本點混雜在一起, 兩種一枝黃花和兩種蘆葦也交錯分布, 僅利用地物的光譜特征分類, 在4種植被和裸地之間易存在錯分區域。

表1 GF-2衛星有效載荷技術指標

圖4 長江口南匯潮灘植被光譜特征散點圖

Figure 4 Scatter plot of spectral characteristics of vegetation in Nanhui tidal flat of the Yangtze Estuary

2.4 潮灘植被OverFeat模型深度特征提取

2.4.1 微調OverFeat模型

本實驗采用OverFeat Accurate模型的前7層網絡, 包括6層卷積層、1層全連接層。因為OverFeat模型是基于ImageNet訓練集訓練好的網絡, f8提取的特征語義性更強, 但是也更加符合ImageNet訓練集的分類。而遙感影像不在ImageNet訓練集內, 所以使用f7提取的特征, 分類精度更高。本實驗主要對兩種蘆葦、兩種一枝黃花、水體、裸地6種地物分類, 所以輸出層的通道數為6。

2.4.2 深度特征提取

實驗取研究區域遙感影像前3個主成分上選取的樣本, 使用最近鄰插值法使其鄰域擴充到221× 221的像素。樣本數據輸入到模型第1層之后, 首先使用96個7×7×3的卷積核, 每間隔2個像元對輸入影像進行卷積操作; 其結果經過ReLU函數激活后以3ⅹ3的窗口大小每隔3個像元選取對應最大值進行池化處理。第1層的輸出結果作為第2層的輸入, 再一次進行卷積池化運算, 但卷積的步長縮小為1, 池化層的窗口變為2×2, 步長為2。將第2層的結果經過3次3×3×1的卷積之后, 輸入到第6層中進行3×3×1的卷積運算提取特征, 再經過3×3×3的池化降維, 最終輸入到全連接層中。

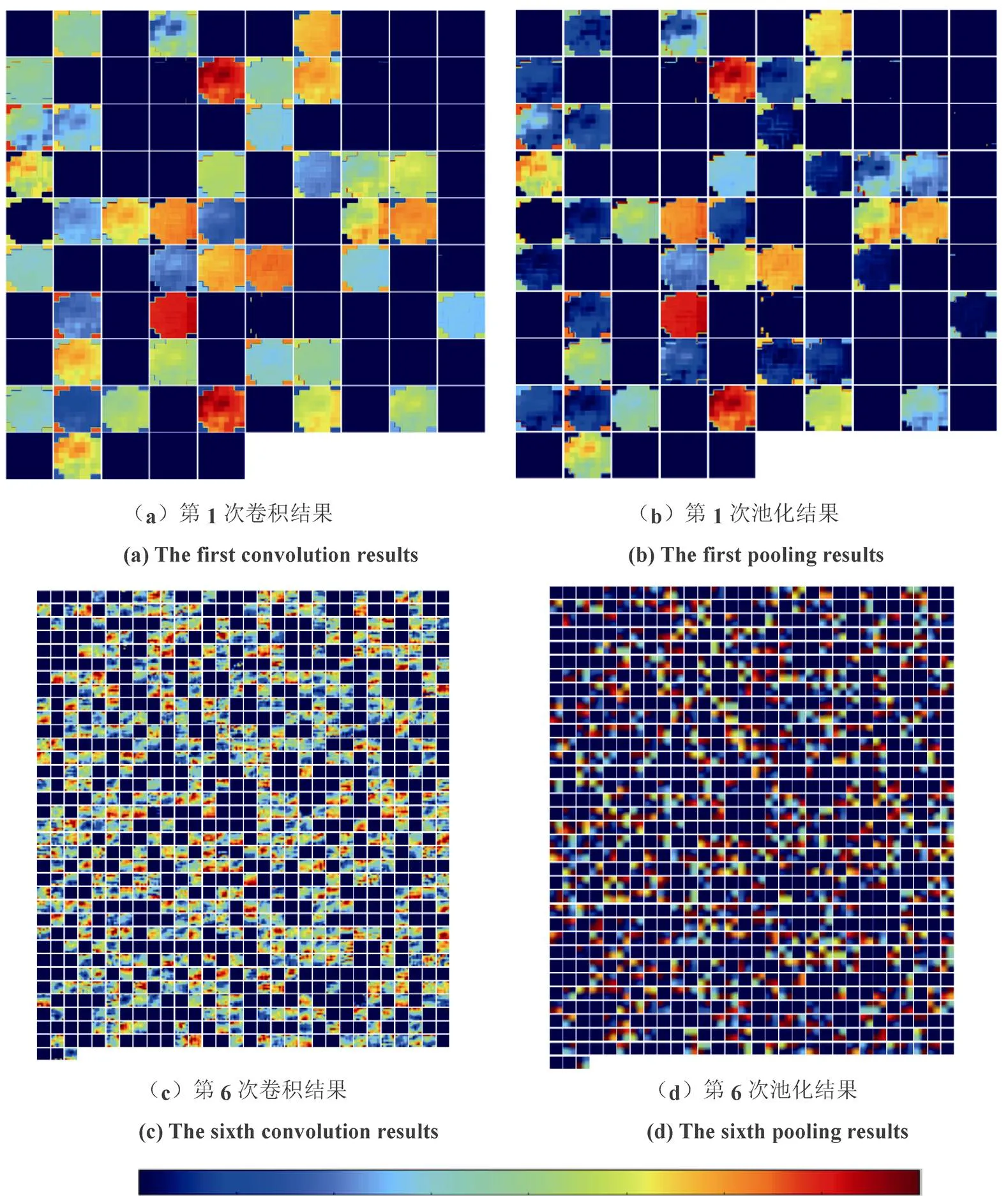

樣本數據輸入到OverFeat模型中進行訓練, 經過模型訓練的部分結果如圖5所示。以研究區域圖3(b)中紅框標注的一幅蘆葦I影像為例, 圖5(a)為96張108ⅹ108的抽象特征圖, 是其經過模型第一個卷積層的輸出, 特征值從藍色到紅色逐漸增大。第一次池化層結果如圖5(b)所示, 為96張36ⅹ36的特征圖, 數據量明顯減少, 達到降維目的。圖5(c)為模型第6次卷積層的輸出, 有1024張7ⅹ7的特征圖, 圖5(d)包括1024張2ⅹ2的特征圖, 是模型第6次池化層的輸出。對比第1次卷積、池化與第6次卷積、池化的結果, 可以發現OverFeat模型經過對輸入影像的多次卷積池化, 使其激活的局部特征得到了有效的離散, 便于分類。

圖5 長江口南匯潮灘蘆葦特征提取結果

Figure 5 Extraction results of reeds in the Nanhui tidal flat of the Yangtze Estuary

OverFeat模型提取的潮灘植被深度特征經t-SNE算法運算后得到圖6, 從圖像中可以發現, 6種不同類別的數據點分別聚成簇, 而且不同簇之間分隔較大, 說明深度特征可以將相似地物之間的細微差別放大, 在對植被細節上的分類更準確。

2.5 潮灘植被SVM分類

實驗將訓練樣本主成分分析后提取的潮灘植被光譜特征和基于OverFeat模型提取的潮灘植被深度特征分別輸入到SVM分類器中進行訓練。由于模型提取的深度特征維數很高, 所以本文選取線性核函數作為SVM分類器的核函數。最后, 對研究區域影像中的未知類別樣本分別進行主成分分析光譜特征提取和OverFeat模型深度特征提取, 并將兩種特征分別輸入到相應訓練好的SVM分類器中, 得到最終的潮灘植被分類圖, 如圖7所示。

圖6 長江口南匯潮灘植被深度特征散點圖

Figure 6 Scatter plot of depth characteristics of vegetation in Nanhui tidal flat of the Yangtze Estuary

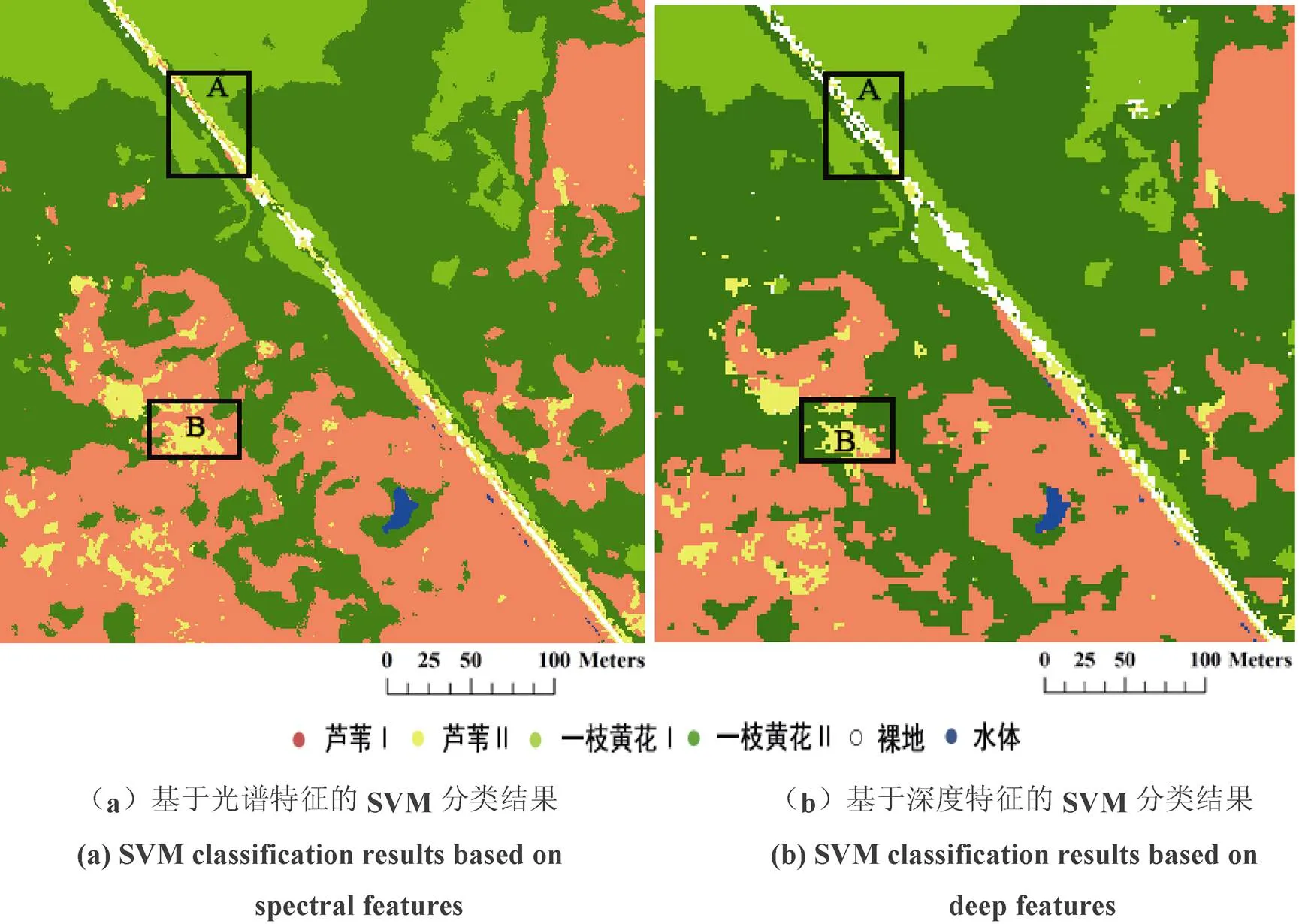

2.6 潮灘植被分類結果

對比基于兩種特征的SVM分類方法的植被分類圖, 基于深度特征的SVM分類圖7(b)比基于光譜特征的SVM分類圖7(a)對不同植被之間的識別更加細致。對比研究區域圖, 本文選取2個區域進行分析, 其中區域A為裸地與一枝黃花的交錯區域; 區域B為蘆葦I、蘆葦II與一枝黃花II的交錯區域。圖7(b)中區域A中的裸地部分被很好的區分出來, 而在圖7(a)中部分裸地被分為蘆葦II, 是由于雖然蘆葦II與裸地都屬于高亮度區域, 但是模型提取的蘆葦II與裸地的深度特征差別較大, 所以基于深度特征的SVM分類更準確。對比研究區域圖, 在圖7(b)中區域B的分布更接近于兩種蘆葦和一枝黃花II的真實分布, 這是因為深度特征可以將兩種相似地物的細微差別放大, 得到更精確的分類結果。

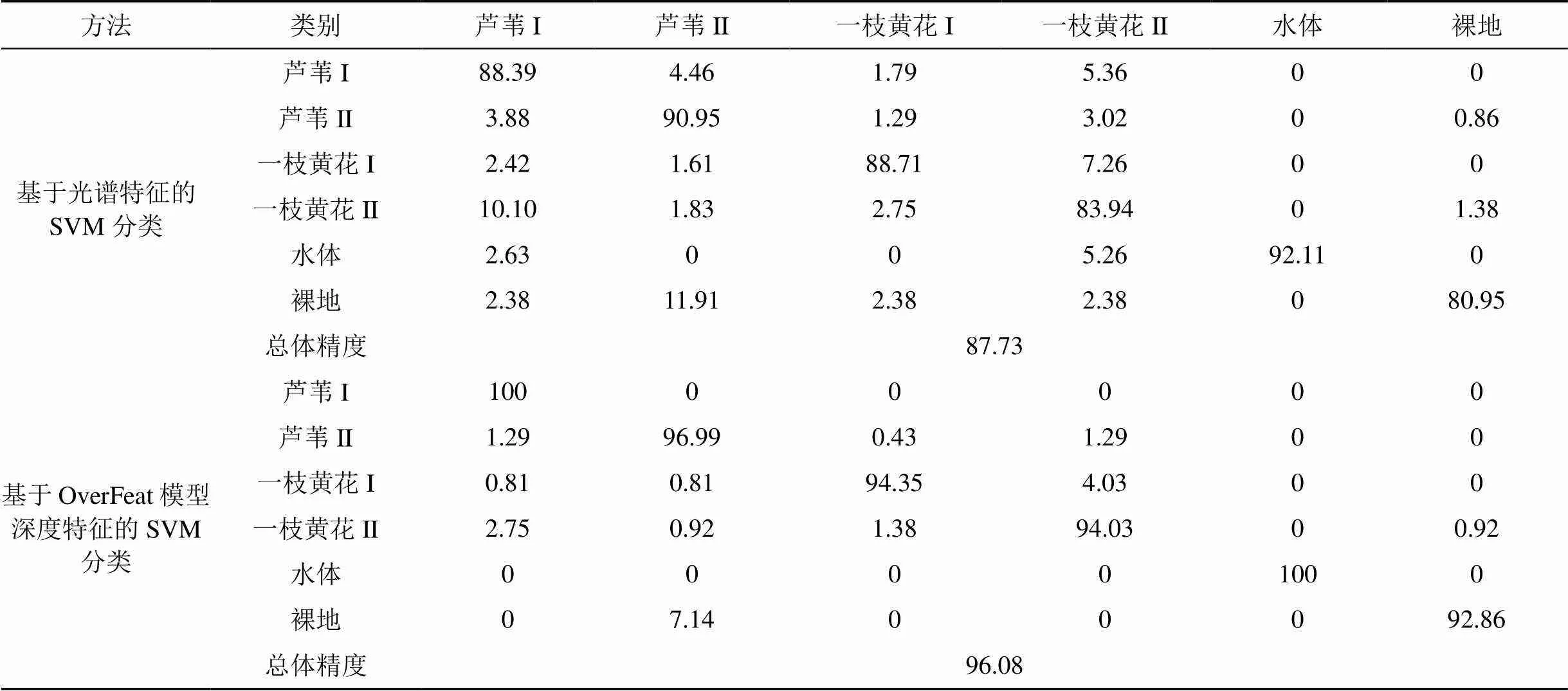

2.7 潮灘植被分類精度

表2為基于OverFeat模型深度特征的SVM分類與傳統SVM分類方法的混淆矩陣, 可以發現基于深度特征的SVM分類對于蘆葦I的分類可以達到100%, 而蘆葦II識別雖有提高, 但仍有一些裸地被分為蘆葦II, 這是因為本文研究區域的裸地是一條兩旁長滿植被的小路, 其寬為1m左右, 而GF-2影像分辨率為1m, 當小路兩旁植被植株過高時會遮擋部分小路, 使得這部分像元有植被特性, 而裸地和蘆葦II都屬于高亮度區域, 所以這部分容易被誤分為蘆葦II。一枝黃花II識別的準確率提高10.09%, 是因為減少了被分為一枝黃花I和蘆葦I的情況, 尤其是在蘆葦I、一枝黃花I與一枝黃花II的交錯地帶, 從圖7也可明顯看出這一結論。本文所用方法的總體精度為96.08%, 分類精度較好。

3 結論

本文將基于ImageNet數據集的預訓練卷積神經網絡OverFeat模型應用于GF-2衛星影像, 通過對長江口南匯潮灘不同植被進行深度特征提取, 并利用深度特征訓練SVM分類器, 得到了較好的植被分類結果。證明了使用基于ImageNet數據集的預訓練卷積神經網絡可以將不同生長狀態的植被細微差別放大, 很好地解決了相似地物難區分的問題。

圖7 長江口南匯潮灘地物分類結果

Figure 7 Classification results of the Nanhui tidal flat in the Yangtze Estuary

表2 基于兩種特征的SVM分類混淆矩陣/%

[1] DONAHUEO J, JIA Y, VINVALS O, et al. DeCAF: A deep convolutional activation feature for generic visual recognition[C]// International Conference on International Conference on Machine Learning. JMLR.org, 2014: I–647.

[2] HU F, XIA G S, HU J, et al. Transferring deep convolutional neural networks for the scene classification of high-resolution remote sensing imagery[J]. Remote Sensing, 2015, 7(11): 14680–14707.

[3] 張偉, 鄭柯, 唐娉, 等. 深度卷積神經網絡特征提取用于地表覆蓋分類初探[J]. 中國圖象圖形學報, 2017, 22(8): 1144–1153.

[4] 黨宇, 張繼賢, 鄧喀中, 等. 基于深度學習AlexNet的遙感影像地表覆蓋分類評價研究[J]. 地球信息科學學報, 2017, 19(11): 1530–1537.

[5] 葛蕓, 江順亮, 葉發茂, 等. 基于ImageNet預訓練卷積神經網絡的遙感圖像檢索[J]. 武漢大學學報(信息科學版), 2018, 43(1): 67–73.

[6] 李冠東, 張春菊, 王銘愷, 等. 卷積神經網絡遷移的高分影像場景分類學習[J]. 測繪科學, 2019, 44(4): 116–123, 174.

[7] MARMANIS D, DATCU M, ESCH T, et al. Deep Learning Earth Observation Classification Using ImageNet Pretrained Networks[J]. IEEE Geoscience & Remote Sensing Letters, 2016, 13(1): 105–109.

[8] SERMANET P, EIGEN D, ZHANG X, et al. OverFeat: Integrated Recognition, Localization and Detection using Convolutional Networks[DB/OL]. 2013, http://arxiv.org/ abs/1312.6229.

[9] 中國資源衛星應用中心. 高分二號[EB/OL]. 2014-10-15 [2018-03-19]. http://www.cresda.com/CN/Satellite/3128.shtml.

[10] MAATEN L, HINTON G. Visualizing data using t-SNE[J]. Journal of Machine Learning Research, 2008, 9: 2579– 2605.

[11] ROMERO A, GATTA C, CAMPS-VALLS G. Unsupervised Deep Feature Extraction for Remote Sensing Image Classification[J]. IEEE Transactions on Geoscience & Remote Sensing, 2016, 54(3): 1349–1362.

[12] 焦計晗, 張帆, 張良. 基于改進AlexNet模型的油菜種植面積遙感估測[J]. 計算機測量與控制, 2018, 26(2): 186– 189.

[13] 劉笑, 王光輝, 楊化超, 等. 全卷積神經網絡遙感影像道路提取方法[J]. 遙感信息, 2018, 33(1): 69–75.

[14] 周秋文, 羅婭, 蘇維詞, 等. 基于多元信息的巖溶區植被類型信息快速提取方法構建[J]. 生態科學, 2015, 34(1): 135–141.

OverFeat Model for vegetation classification in Nanhui tidal flat of the Yangtze Estuary

LI Jing1, HAN Zhen1,2,*, WANG Wenliu1, CUI Yanrong1

1. College of Marine Sciences, Shanghai Ocean University, Shanghai 201306, China 2. Shanghai Engineering Research Center of Estuarine and Oceanographic Mapping, Shanghai 201306, China

The environment of the tidal flat is complex and variable, and the spectral characteristics between some vegetations are similar. In order to solve the problem that the classification accuracy of fine vegetation classification is not high, we use the OverFeat Model, which is the convolutional neural network based on ImageNet pre-training and the GF-2 satellite remote sensing image as experimental data, to extract the depth features of two different growth states of vegetation in Nanhui tidal flat of the Yangtze Estuary. The depth features of model-trained was inputed to the Support Vector Machine (SVM) classification to get information about vegetation. The results show that the classification accuracy of the method used in this paper is higher compared with the SVM classification method which is based on spectral features, and the overall accuracy can reach to 96.08%. It is proved that the pre-training convolutional neural network based on ImageNet data set can achieve better recognition for different growth states of vegetation.

ImageNet; convolutional neural network;OverFeat; feature extraction; classification

10.14108/j.cnki.1008-8873.2019.04.019

TP79

A

1008-8873(2019)04-135-07

2018-07-17;

2018-09-20

國土資源部公益性行業科研專項(201211009)

李靜(1994—), 女, 碩士研究生, 主要從事遙感圖像分類研究, E-mail : 463211189@qq.com

韓震(1969—), 男, 博士、教授, 主要從事海洋信息探測與應用研究, E-mail:zhhan@shou.edu.cn

李靜, 韓震, 王文柳, 等. 基于OverFeat模型的長江口南匯潮灘植被分類[J]. 生態科學, 2019, 38(4): 135-141.

LI Jing, HAN Zhen, WANG Wenliu, et al. OverFeat Model for vegetation classification in Nanhui tidal flat of the Yangtze Estuary[J]. Ecological Science, 2019, 38(4): 135-141.