低對比度條件下聯合收割機導航線提取方法

曾宏偉,雷軍波,陶建峰,張 偉,劉成良

低對比度條件下聯合收割機導航線提取方法

曾宏偉,雷軍波,陶建峰※,張 偉,劉成良

(上海交通大學機械系統與振動國家重點實驗室,上海 200240)

針對強光照下成熟小麥已收割區域和未收割區域對比度低、收割邊界獲取難度大的問題,該文提出了一種基于區域生長算法的聯合收割機導航線精確提取方法。對攝像頭采集的作物收割圖像,利用區域生長算法分割出圖像中未收割區域。生長閾值通過對圖像灰度直方圖高斯多峰擬合進行自適應計算。對分割得到的二值圖像進行形態學處理,獲取作物已收割和未收割區域分界線,然后采用最小二乘法擬合收割機作業導航線。試驗結果表明:在小麥已收割和未收割區域對比度很低的情況下,所提方法能夠精確地提取出小麥收獲邊線,并得到收割機作業導航線,與人工標定導航線夾角平均誤差小于1.21°,可以為聯合收割機的自動導航研究提供參考;處理一張900×1 200像素的圖像時長約0.41 s,基本滿足聯合收割機導航作業的實時性要求。與傳統方法對比發現,該文方法不易受作物生長密度和麥茬的干擾,導航線的提取精度更高,單幅圖像的處理時間略有增加,但基本滿足實時性作業要求。

機械化;機器視覺;導航;聯合收割機;區域生長算法;多峰高斯擬合;最小二乘法

0 引 言

自動導航作為智能農業裝備的關鍵技術之一,廣泛應用于播種、除草、施肥和收獲等作業中[1-2]。在農作物收獲過程中,為避免重割和漏割,駕駛員需根據作物收獲邊界對收割機前進方向及時調整,以保證收割機滿幅工作。這要求駕駛員具有較高的操作技能和熟練度。此外,觀察割臺兩側作物收割邊界會分散駕駛員的注意力,且長時間作業容易疲勞,給農業生產帶來安全隱患。因此,研究聯合收割機自動導航技術對減輕駕駛員勞動強度、提高生產效率具有重要意義。

自動導航的核心是提取作業導航線,如何快速準確地獲取導航線是實現聯合收割機自動導航的關鍵[3]。近年來,國內外關于農機作業導航線檢測的研究主要分為機器視覺[4-6]和激光測距[7-9]導航2大類。由于通過視覺圖像獲取的環境信息更豐富、范圍更廣、目標信息更完整,基于機器視覺的導航方法受到國內外學者的廣泛關注[10]。

對于綠色作物,由于作物和土壤顏色存在較大差異,采用超綠變換能夠有效區分作物和土壤,常在早期管理作業中用于作物行線檢測[11-12]。然而,在收割過程中,成熟作物與土壤顏色對比度較低,超綠法難以適用。針對收割作業導航線提取, Iida等[13]將水稻收割圖像灰度值按列累加,定義累加曲線最大梯度處為水稻收割邊緣分界點;Cho等[14]對水稻收割圖像進行逆透視投影變換,再利用邊緣檢測算法獲取水稻收割邊界;梁習卉子等[15]通過對顏色分量分析,提出了玉米收割機導航路徑和田端檢測算法;李景彬等[16]提出了一種采棉機視覺導航路線檢測方法,利用顏色分量差提取棉花已收獲區和未收獲區邊界點;丁幼春等[17]通過旋轉投影算法處理小麥收割圖像再提取小麥收割邊界;吳剛等[18]利用統計分析和邊緣檢測分析小麥收割圖像獲取導航線候選點,并改進了Hough變換來計算導航線;張成濤等[19]采用圖像紋理特征區分小麥未收獲和已收獲區域,進而提取收獲邊界;趙騰等[20]利用閾值法分割已收獲與待收獲區域,再采用互相關函數法檢測小麥收割分界點。

上述方法大多基于作物收割圖像灰度不連續特性,只有當分界線相對周圍環境有較大差異或已收割和未收割區域對比度較大時才能取得較理想的效果。此外,收割后的殘留麥茬和未收割的小麥顏色基本一致,容易對收割邊界線提取產生干擾。當分界處不存在陰影及光照較強時,小麥已收割區域和未收割區域對比度很低,此類方法難以精確提取小麥收割分界線。

針對現有方法存在的問題,本文提出了一種基于區域生長算法的收割機導航線快速精確提取方法。采用區域生長算法精確地分割出小麥圖像中未收割區域,生長閾值根據圖像直方圖自適應計算,檢測出小麥收割邊界,通過最小二乘法對邊界進行擬合,最終得到收割機導航線。

1 收割機導航線提取方法

在聯合收割機作業過程中,要求收割機滿幅工作,且不發生漏割和重割。因此,快速而準確地識別作物已收割和未收割區域邊界是實現收割機自動導航的關鍵步驟。通過對大量的小麥收割現場圖像分析發現,已收割和未收割區域具有顏色差異小、對比度低的特點,但未收割區域圖像紋理更加平滑,像素值具有良好的均勻性和相似性,已收割區域由于存在殘留的麥茬,像素值空間分布不均。區域生長算法[21]是一種常用的圖像分割算法,通過比較種子與周圍像素的相似性來決定是否合并種子,能夠有效地將具有相似像素的連通區域分割出來,在醫學[22-23]、農業[24]以及遙感圖像處理[25]等領域得到了廣泛應用。

因此,本文提出了一種基于區域生長算法的聯合收割機導航線快速精確提取方法,具體流程如圖1所示。

圖1 收割機導航線提取流程

首先,通過安裝在聯合收割機上的攝像頭獲取小麥收割圖像,對獲取的圖像進行預處理。采用區域生長算法分割出圖像中未收割小麥區域,并對分割后的二值圖進行形態學運算,以消除因噪聲造成的空洞,平滑小麥收割邊界,然后檢測作物已收割和未收割區域分界線,最后采用最小二乘法擬合出收割機作業導航線。

1.1 圖像預處理

本文采用海康威視生產的MV-CA013-20UC型號彩色相機獲取小麥收割圖像,分辨率為1 024×1 280像素。由于土壤和成熟小麥均呈黃色,麥田已收割區域和未收割區域顏色十分相近。圖2a為攝像頭采集的原始彩色圖像,圖2b為圖2a中實線所在像素行的RGB分量值。由圖2可知,已收割和未收割區域的RGB分量值差距均很小,即使轉換到不同顏色空間,已收割區域和未收割區域對比度仍很低,難以通過顏色特征區分已收割和未收割區域。

在RGB分量均相近的情況下,顏色信息顯得冗余。為減少數據量,將彩色圖像轉換成灰度圖像,以提高后續算法處理速度,保證算法的實時性。彩色圖像轉換成灰度圖的公式為[26]

式中為轉換后的灰度值,、和分別表示RGB通道中紅、綠、藍分量值。將彩色圖像灰度化后,采用5×5的高斯核對灰度圖像進行高斯濾波,消除圖像中的隨機噪聲。圖3為原始圖像經灰度化及高斯濾波后的圖像。

圖2 原始圖像及RGB分量曲線

圖3 預處理后的灰度圖像

1.2 基于區域生長算法的圖像分割

為檢測小麥收割邊界,先將圖像分割成已收割和未收割區域。灰度圖像分割算法通常基于灰度值的不連續性或相似性。前者是指以灰度突變為基礎進行分割,如圖像的邊緣。后者是利用一定的相似準則將圖像分割為相似的區域,常用的有閾值分割法、區域生長以及區域分裂算法等[26]。

觀察小麥收割灰度圖發現,已收割和未收割區域灰度值差異較小,但未收割區域圖像灰度值更加均勻一致,而已收割區域圖像中存在麥茬和裸露的土壤,紋理復雜度高。由于已收割和未收割區域灰度值無明顯突變,利用灰度值不連續性分割圖像難以達到理想效果。最常用的基于灰度相似性的圖像分割方法為閾值法,當圖像直方圖存在分離的波峰時有較好的分割效果,但小麥收割圖像直方圖往往無法滿足該條件。此外,由于已收割區域中的麥茬與未收割小麥灰度值幾乎相等,閾值法分割往往將兩者歸為一類,麥茬與土壤的分界線會對后續收割邊界提取產生嚴重干擾。區域生長算法則彌補了閾值分割法未考慮像素空間連通性的不足,利用相鄰像素的相似性將像素或子區域組合成更大的區域,最終得到一個相似度高的連通區域。因此,區域生長算法更適合于小麥收割圖像分割。

1.2.1 區域生長算法

區域生長是一種從單個像素開始逐漸向周圍鄰域生長的算法,選擇初始種子后,逐個訪問種子的鄰域像素,若鄰域像素與種子足夠相似,則將其添加到種子區域,更新種子區域后繼續向新的鄰域生長,直至無新的像素可添加,則從該初始種子開始的區域生長結束。接著從另一個種子點開始生長新的區域,直至將整個圖像分割成不同的區域。

區域生長需解決2個關鍵問題:種子點的選取以及生長準則[27]。在本文中,為保證分割效果,種子的選擇需滿足以下要求:

1)種子點應從未收割區域中選取,因為未收割小麥區域具有較高的相似性,適合區域生長;

2)種子點與周圍像素高度相似,即灰度值相近;

3)種子點能較好地代表未收割區域,應從小麥像素區域選取,避免從陰影區域選擇。

在傳統區域生長算法中,種子點通常以人機交互的方法進行選取。然而,在實際收割過程中,人機交互的方式無法滿足應用要求,算法應能夠逐幀自動選取種子點。在實際收獲過程中,收割機最常用的行進路線為右旋法和四邊收獲法,以順時針方向圍繞麥田進行收割[28]。因此,待檢測的收割邊界位于聯合收割機左前方,未收割區域則靠圖像的右側。為保證種子點來自小麥未收割區域,先初步確定未收割區域大致位置。對灰度圖每一列前行的灰度值累加,繪制出在每列前行中灰度值之和的變化曲線,最低點所在列數可以初步定為遠端小麥收割邊界點在圖像坐標系中的橫坐標值。根據攝像頭采集的圖像分辨率進行取值,當累加曲線出現明顯波谷時較合適,本文中取20。由于存在透視現象,在圖像坐標系中遠端小麥收割邊界點以右的像素區域均為未收割小麥區域。將該區域設為初始種子點的選擇區域,并對其灰度值分布情況進行統計。出現頻率最高的像素值往往最能代表本區域圖像的整體信息,因此將該區域內出現頻率最高的像素值對應的所有像素點標示為初始種子點集,從而實現種子點的自動選取。

生長規則包括相似性判斷準則及生長結束條件。對于灰度圖,通常根據待生長像素灰度值與種子區域平均灰度值之差是否小于設定閾值來判斷是否相似[27]。設(,) 為輸入灰度圖陣列;(,) 表示種子陣列,其尺寸與相同,種子點位置處表示為1,其他位置處為0;堆棧用于存放待訪問鄰域像素點;G表示種子區域平均灰度值;為生長閾值。對于像素點(x,y)∈,其生長規則可表示為

小麥未收割區域分割算法流程為:

1)根據上述種子點自動選取方法選擇初始種子點集,并將其壓入堆棧;

2)判斷堆棧是否有元素,若有則退棧取出棧頂元素(x,y),若為空則生長結束;

3)逐個訪問(x,y)的4鄰域像素點,對尚未被標記為種子的像素點按式(2)原則判斷是否與種子相似,若相似則將該鄰域像素點壓入堆棧,同時更改種子陣列對應位置的值,更新G。若不相似則訪問下一鄰域像素。訪問結束后返回步驟2)。

生長結束后,種子陣列中元素為1的區域即為生長得到的區域。

1.2.2 生長閾值自適應選取

在上述算法中,通過比較鄰域像素灰度值與種子區域平均灰度值來判斷該鄰域像素是否與種子區域相似。生長的條件是兩者灰度值之差小于某一閾值。該閾值決定了分割準確度,若閾值過大,則易產生欠分割,將不屬于未收割區域的像素劃分為未收割區域;若閾值過小,則會產生過分割,最終生成的區域無法完整地包含未收割區域。

該閾值的選擇是區域生長算法的難點,目前尚未有普適的可行方法,通常根據經驗選取[26]。固定的閾值只適用于相同的場景圖像中,在小麥收割過程中,光照變化、場景變換均會影響該閾值的選擇。因此,為提高算法魯棒性,使其適應不同光照條件和場景,生長閾值應根據圖像自適應選取。

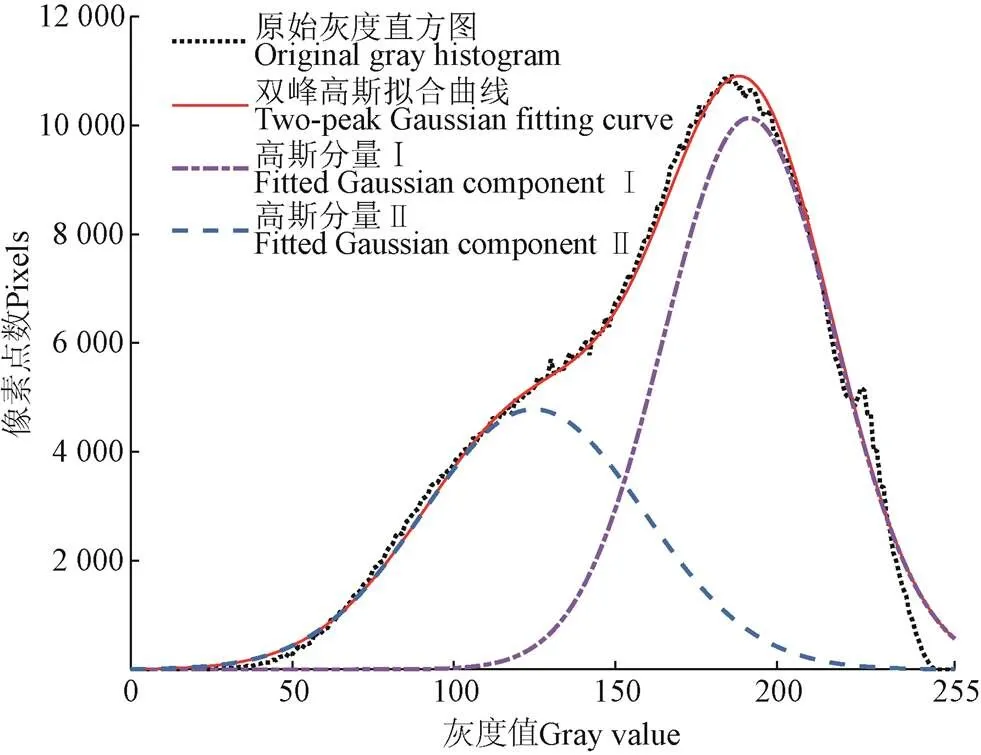

圖像灰度直方圖統計了整個圖像中各灰度值的像素個數,體現了圖像中灰度值分布信息。圖4為圖3對應的灰度直方圖,從圖中可以發現,峰值出現在灰度值180附近,說明圖像中該灰度值的像素點最多。結合圖像可知,小麥在圖像中占據的像素點最多,灰度值180附近對應小麥的灰度值,而在灰度值120附近存在另一峰值,該灰度值附近的像素對應為土壤。

圖4 圖像灰度直方圖

由于小麥和土壤灰度值十分接近,分布存在重合,直方圖中并未出現明顯的峰底。現假設小麥和土壤不同灰度值占據的像素數量均呈高斯分布,對灰度直方圖進行雙峰高斯擬合。令()表示擬合的函數,則其形式為

式中為灰度值;a表示高斯分量系數;b為高斯分量分布中心;c為高斯分量分布方差(=1,2);為圖像中像素點總數。令()表示圖像中灰度值為的像素個數。采用非線性最小二乘法對灰度直方圖進行高斯雙峰擬合,使得擬合數據與實際數據之間誤差的平方和最小,則優化目標為

目標函數中有5個未知數,對于非線性最小二乘問題,可以采用信賴域方法進行數值求解。本文直接使用MATLAB擬合工具箱中fit函數進行計算求解。擬合得到高斯模型后,生長閾值取2個高斯分量均值之差的一半,即

采用式(3)中函數對圖4所示直方圖進行擬合,結果如圖5所示。可以看出,高斯雙峰曲線對灰度直方圖擬合較好,其擬合優度指標判定系數為0.994 4。

圖5 直方圖擬合結果

根據上述擬合結果按式(5)計算閾值,然后采用1.2.1節算法對小麥收割圖像進行分割,分割結果如圖6所示。圖6a為分割后的二值圖,其中白色區域為通過區域生長分割出的未收割區域,黑色區域為背景。為更好地觀察分割效果,將生長的區域通過掩膜疊加于原圖,如圖6b所示。可以看出,在小麥已收割和未收割邊界處分割效果很好,但在未收割區域內部存在未生長的孤立區域,這從圖6a中也可以發現。這些孤立區域主要是小麥植株間隙造成的陰影,其灰度值與小麥差異較大而未能被生長。

為填充未收割區域內細小孔洞,對二值圖進行3次膨脹操作,然后進行3次腐蝕操作恢復原始尺寸。圖7為形態學處理后的二值圖像,處理后的未收割區域消除了大部分噪點和細小孔洞,并較完整地保留了分割邊界。

圖6 區域生長結果

圖7 形態學處理后的二值圖

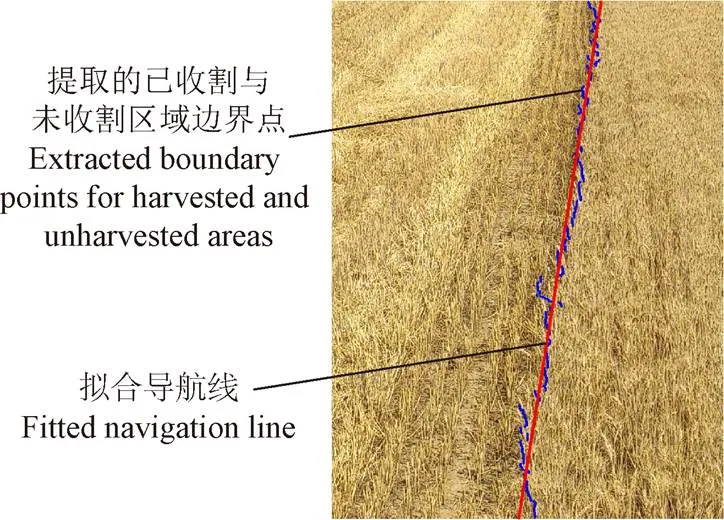

1.3 收割機導航線提取

為提取收割導航線,需要提取小麥收割的邊界。直接采用邊緣檢測方法會引入未收割區域中噪點和孤立區域的邊界,為后續導航線提取帶來干擾。觀察圖7可知,左側背景區域無噪點和孔洞,左側黑色背景區域與右側白色前景區域的交界線即為小麥已收割和未收割區域的分界線。對二值圖逐行從左向右掃描,記錄每行第一個像素值跳變點為小麥收割邊界點。對獲得的邊界點進行最小二乘法直線擬合,即可得到小麥收割的導航線。圖8為邊界點檢測及導航線擬合結果。從圖中可以看出,在對比度很低的情況下,本文方法得到的導航線與小麥的收割邊界基本重合,具有較高的準確度,邊界點擬合優度為0.973 2。

圖8 導航線提取結果

2 驗證試驗

為驗證所提方法的有效性,在小麥收獲現場采集用于試驗驗證的小麥收割圖像。使用彩色工業相機進行圖像采集,型號為海康威視MV-CA013-20UC,分辨率為1 024×1 280像素,以RGB顏色空間保存為JPG格式。裁切后的圖像大小為900×1 200像素,圖像處理在計算機平臺上完成,處理器為Intel Core i7-6700,主頻3.4 GHz,內存大小為8 G,圖像處理軟件為MATLAB 2018b。

圖像采集地點為北京市昌平區國家精準農業示范基地,聯合收割機型號為雷沃重工股份有限公司的GK120試驗樣機,收割行進路線為右旋法,待檢測收割邊界位于聯合收割機左側。因此,將攝像頭安裝在駕駛艙頂部偏左側位置,相機光軸與水平線夾角約30°,離地高度約3 m,此時未收割區域始終位于采集的圖像右側。小麥品種為農大211,收割時作物自然高度為84 cm,割茬高度為8.5 cm。麥田無積水,土壤較干燥,在陽光下土壤顏色呈淺黃色,與小麥顏色相近。小麥收割后產生的秸稈經粉碎后從聯合收割機尾部排放,由于割臺寬于機身,從機身兩側到割臺兩端的區域內并無秸稈排放,因此麥田中和未收割區域相鄰的已收割區域地表秸稈量較少,攝像頭視野中從左至右依次為秸稈覆蓋的地表、麥茬和裸露地表以及未收割小麥區。

光照是影響視覺導航精度的重要因素,聯合收割機在田間作業時,所受自然光照是不可控的。因此,基于視覺的導航線提取方法應能適應不同的光照條件。為驗證所提方法在不同作業環境下的適用性,采集了不同光照強度下的小麥收割圖像,以及在麥田田壟邊界處的圖像,利用本文方法進行了導航線提取,并與人工標定的導航線進行比較,將算法提取的導航線與人工標定的導航線之間的夾角作為精度評價指標。圖9a為不同條件下采集的原始圖像,圖9b為對應的未收割小麥區域分割結果,圖9c則為導航線提取結果,其中紅色實線為本文方法獲得的結果,天藍色實線為通過人工標定的導航線。圖9中從左至右依次為:較弱光照下小麥收割邊界圖像、較強光照下小麥收割邊界圖像、麥田田壟邊界圖像;分別拍攝于2019年6月18日中午12點,多云;2019年6月22日中午12點,晴;2019年6月22日13點,晴。拍攝時間段均為中午,此時陽光直射地面,小麥已收割和未收割交界處無明顯陰影,收割分界線相對周圍環境不明顯,導航線提取難度更大。

第一幅圖像拍攝于陰天,光照強度較晴天弱,圖像總體偏暗,亮度相對較低。由于小麥生長較稀疏,未收割區域存在作物行間隙,圖像分割過程中未收割區域產生較多孤立小區域,但在收割邊界處分割效果較好,較準確和完整地保留了邊界信息。從圖9c導航線檢測結果來看,本文方法具有較高的精度,提取的導航線與人工標定的基準導航線基本一致,角度誤差約為1.18°。由此可見,在植株生長較稀疏的情況下,所提方法仍能取得較好的效果。第二幅圖像拍攝于晴天光照最強的時候,亮度較高,小麥和土壤的顏色更加難以區分。從圖 9b中圖像分割的結果可以看出,區域生長算法較準確地分割出了小麥未收割區域。從圖9c來看,導航線提取結果與人工標定的基準線基本重合,檢測誤差約為 0.78°。第三幅圖像為田壟邊界處圖像,由于田壟上長有綠色雜草,與周圍小麥和土壤對比明顯,小麥和田壟的邊界線較清晰。相比前2幅圖像,此處小麥生長更加密集,未收割區域像素更加均一,分割得到的未收割小麥區域噪點較少。圖9c檢測結果表明,提取的導航線和人工標定的結果基本吻合,誤差約為1.21°。

注:圖中紅色實線為通過本文方法提取的導航線;藍色實線為手工標定的導航線。

Note: The red solid line in the figure is the navigation line extracted by the method in this paper; the blue solid line is manually calibrated navigation line.

c. 導航線提取結果

c. Navigation line extraction results

圖9 不同場景下收割機導航線提取結果

Fig.9 Extraction results of harvester navigation line under different scenes

綜上可知,在不同光照、不同作物生長密度條件下,以及在分界線較明顯(如小麥和綠色雜草分界線)的情況下,本文方法均能精確地分割出未收割小麥區域,并較完整地保留小麥收割邊界信息。同時,本文方法獲取的導航線與人工標定的導航線基本一致,平均夾角誤差在1.21°以內。由此可見,本文算法能夠精確地檢測小麥收割邊界并提取導航線,且對不同的作業場景具有較好的適應性。

在時效性方面,由于區域生長過程通過逐個訪問種子鄰域像素完成,因此圖像分割過程在本方法中耗時占比最大。算法耗時長短和最終生成的區域面積大小有關,未收割區域像素點數量越多耗時越長。對于一張大小為900×1 200像素的小麥收割圖像,本文方法平均耗時約為0.4 s。考慮到聯合收割機正常作業速度在1.5 m/s左右,而相機前視距離約為8 m,因此0.4 s的處理時長基本能夠滿足聯合收割機作業的實時作業要求。

傳統的作物收割邊界檢測方法中,最常用的是將灰度值或者不同顏色通道下像素值按列累加,根據累加曲線尋找已收割和未收割區域邊界點,然后通過邊界點提取導航線[13,15-16]。對采集的圖像每10行劃分為一個處理區域,在該區域內將每一列的灰度值進行累加得到灰度值累加曲線,尋找曲線的最大梯度處作為邊界點,然后通過最小二乘法獲得導航線。以圖3中的小麥收割圖像為例,采用傳統方法對小麥已收割和未收割區域邊界點進行檢測,檢測結果如圖10所示。從圖中可以看出,當已收割和未收割區域對比度較低時,傳統方法在檢測已收割和未收割區域邊界點時易受到殘留麥茬以及生長稀疏作物區域的干擾。

圖10 傳統方法收割邊界點提取結果

由于傳統方法是通過沿水平方向尋找像素值累加曲線的階躍值所在位置作為邊界點,在單個處理區域內水平方向像素值出現跳變的位置都有可能被識別為邊界點。因此,當已收割和未收割區域對比度低、收割邊界不明顯時,該方法容易將因作物生長稀疏以及殘留麥茬造成的陰影區域錯誤地識別為邊界點,影響后續導航線提取的精度。本文采用區域生長算法進行圖像分割,利用相鄰像素的相似性將像素或子區域組合成更大的區域,保證了分割區域的連通性。當作物生長稀疏時,陰影區域只會造成分割的未收割區域內存在孤立的區域,如圖6a中所示,但未收割區域內部的孤立區域并不影響后續已收割和未收割區域邊界點以及導航線的提取。此外,在進行圖像分割時,區域生長算法在遇到已收割和未收割區域邊界時即停止生長,能夠較好地保留收割邊界信息,而不易受到殘留麥茬的干擾。

為對比本文方法與傳統收割機導航線檢測方法,隨機選取20幅不同的小麥收割圖像,分別采用本文方法和傳統方法進行導航線提取,并將檢測結果分別與人工標定的導航線進行比較,將兩者的夾角以及最大像素誤差作為評價指標,同時統計了單張圖像的處理時間,試驗結果如表1所示。

表1 本文方法與傳統導航線檢測方法的性能對比

由表1可知,本文方法在導航線檢測精度上更具優勢,平均角度誤差以及平均最大像素誤差均小于傳統方法,且在不同的作物生長密度下均表現出較好的效果。而傳統方法在作物生長較稀疏的情況下,導航線檢測精度明顯下降,誤差遠超過本文所提方法。在時效性方面,由于區域生長算法耗時較長,本文方法計算時間略微增加,平均處理一幀圖片的時間約為0.41 s。考慮到聯合收割機正常作業速度在1.5 m/s左右,而相機前視距離約為8 m,因此約0.41 s的處理時長基本滿足聯合收割機作業的實時作業要求。

3 結 論

為解決強光照條件下成熟小麥已收割與未收割區域對比度低、收割邊界模糊以及導航線提取難度大的難題,本文提出了一種基于區域生長算法的聯合收割機導航線提取方法。試驗結果表明,在小麥已收割和未收割區域對比度很低的條件下,所提方法能夠精確地檢測出小麥收割分界線,并提取出收割機作業導航線。在不同光照強度、不同作物生長密度等不同的作業場景下,本文方法均能準確分割出小麥已收割和未收割區域,提取的導航線與人工標定的導航線平均角度誤差小于1.21°,能夠為聯合收割機自動導航提供參考。在時效性方面,處理一張900×1 200像素的圖像耗時約0.41 s,基本滿足聯合收割機正常作業速度下的實時性要求。

[1]姬長英,周俊. 農業機械導航技術發展分析[J]. 農業機械學報,2014,45(9):44-54. Ji Changying, Zhou Jun. Current situation of navigation technologies for agricultural machinery[J]. Transactions of the Chinese Society for Agricultural Machinery, 2014, 45(9): 44-54. (in Chinesewith English abstract)

[2]胡靜濤,高雷,白曉平,等. 農業機械自動化導航技術研究進展[J]. 農業工程學報,2015,31(10):1-10. Hu Jingtao, Gao Lei, Bai Xiaoping, et al. Review of research on automatic guidance of agricultural vehicles[J]. Transactions of the Chinese Society of Agricultural Engineering (Transactions of the CSAE),2015, 31(10): 1-10. (in Chinesewith English abstract)

[3]Shalal N, Low T, Mccarthy C, et al. A review of autonomous navigation systems in agricultural environments[C]// Engineers Australia, 2013.

[4]蔡道清,李彥明,覃程錦,等. 水田田埂邊界支持向量機檢測方法[J]. 農業機械學報,2019,50(6):22-27,109. Cai Daoqing, Li Yanming, Qin Chengjin, et al. Research and experiment on boundary detection of paddy fields based on support vector machine[J]. Transactions of the Chinese Society for Agricultural Machinery, 2019, 50(6): 22-27, 109. (in Chinesewith English abstract)

[5]孟慶寬,何潔,仇瑞承,等. 基于機器視覺的自然環境下作物行識別與導航線提取[J]. 光學學報,2014,34(7):180-186. Meng Qingkuan, He Jie, Qiu Ruicheng, et al. Crop recognition and navigation line detection in natural environment based on machine vision[J]. Acta Optica Sinica, 2014, 34(7): 180-186. (in Chinesewith English abstract)

[6]Meng Q, Qiu R, He J, et al. Development of agricultural implement system based on machine vision and fuzzy control[J]. Computers and Electronics in Agriculture, 2015, 112: 128-138.

[7]偉利國,張小超,汪鳳珠,等. 聯合收割機稻麥收獲邊界激光在線識別系統設計與試驗[J]. 農業工程學報,2017,33(增刊1):30-35. Wei Liguo, Zhang Xiaochao, Wang Fengzhu, et al. Design and experiment of harvest boundaryonline recognition system for rice and wheat combine harvester based on laser detection[J]. Transactions of the Chinese Society of Agricultural Engineering (Transactions of the CSAE), 2017, 33(Supp. 1): 30-35. (in Chinese with English abstract)

[8]趙騰. 基于激光掃描的聯合收割機自動導航方法研究[D]. 楊凌:西北農林科技大學,2017. Zhao Teng. Development of Automatic Navigation Method for Combine Harvester Based on Laser Scanner[D]. Yangling: Northwest A&F University, 2017. (in Chinese with English abstract)

[9]Choi J, Yin X, Yang L, et al. Development of a laser scanner-based navigation system for a combine harvester[J]. Engineering in Agriculture, Environment and Food, 2014, 7(1): 7-13.

[10]Bonadies S, Gadsden S A. An overview of autonomous crop row navigation strategies for unmanned ground vehicles[J]. Engineering in Agriculture, Environment and Food, 2019, 12(1): 24-31.

[11]Zhang X, Li X, Zhang B, et al. Automated robust crop-row detection in maize fields based on position clustering algorithm and shortest path method[J]. Computers and Electronics in Agriculture, 2018, 154: 165-175.

[12]姜國權,楊小亞,王志衡,等. 基于圖像特征點粒子群聚類算法的麥田作物行檢測[J]. 農業工程學報,2017,33(11):165-170. Jiang Guoquan, Yang Xiaoya, Wang Zhiheng, et al. Crop rows detection based on image characteristic point and particleswarm optimization-clustering algorithm[J]. Transactions of the Chinese Society of Agricultural Engineering (Transactions of the CSAE), 2017, 33(11): 165-170. (in Chinese with English abstract)

[13]Iida M, Yu I, Suguri M, et al. Cut-edge and stubble detection for auto-steering system of combine harvester using machine vision[J]. Ifac Proceedings Volumes, 2010, 43(26): 145-150.

[14]Cho W, Iida M, Suguri M, et al. Vision-based uncut crop edge detection for automated guidance of head-feeding combine[J]. Engineering in Agriculture, Environment and Food, 2014, 7(2): 97-102.

[15]梁習卉子,陳兵旗,姜秋慧,等. 基于圖像處理的玉米收割機導航路線檢測方法[J]. 農業工程學報,2016,32(22):43-49. Liangxi Huizi, Chen Bingqi, Jiang Qiuhui, et al. Detection method of navigation route of corn harvester based on image processing[J]. Transactions of the Chinese Society of Agricultural Engineering (Transactions of the CSAE), 2016, 32(22): 43-49. (in Chinese with English abstract)

[16]李景彬,陳兵旗,劉陽,等. 采棉機視覺導航路線圖像檢測方法[J]. 農業工程學報,2013,29(11):11-19. Li Jingbin, Chen Bingqi, Liu Yang, et al. Detection for navigation route for cotton harvester based on machine vision[J]. Transactions of the Chinese Society of Agricultural Engineering (Transactions of the CSAE), 2013, 29(11): 11-19. (in Chinese with English abstract)

[17]丁幼春,王書茂,陳度. 基于圖像旋轉投影的導航路徑檢測算法[J]. 農業機械學報,2009,40(8):155-160. Ding Youchun, Wang Shumao, Chen Du. Navigation line detection arithmetic based on image rotation and projection[J]. Transactions of the Chinese Society for Agricultural Machinery, 2009, 40(8): 155-160. (in Chinese with English abstract)

[18]吳剛,譚彧,鄭永軍,等. 基于改進Hough變換的收獲機器人行走目標直線檢測[J]. 農業機械學報,2010,41(2):176-179. Wu Gang, Tan Yu, Zheng Yongjun, et al. Walking goal line detection based on improved hough transform on harvesting robot[J]. Transactions of the Chinese Society for Agricultural Machinery, 2010, 41(2): 176-179. (in Chinese with English abstract)

[19]張成濤,譚彧,吳剛,等. 基于達芬奇平臺的聯合收獲機視覺導航系統路徑識別[J]. 農業機械學報,2012,43(S1):271-276. Zhang Chengtao, Tan Yu, Wu Gang, et al. Visual Navigation system path recognition algorithm based on DaVinci platform for combine harvester[J]. Transactions of the Chinese Society for Agricultural Machinery, 2012, 43(Supp. 1): 271-276. (in Chinese with English abstract)

[20]趙騰,野口伸,楊亮亮,等. 基于視覺識別的小麥收獲作業線快速獲取方法[J]. 農業機械學報,2016,47(11):37-42. Zhao Teng, Noboru Noguchi, Yang Liangliang, et al. Fast edge detection method for wheat field based on visual recognition[J]. Transactions of the Chinese Society for Agricultural Machinery, 2016, 47(11): 37-42. (in Chinese with English abstract)

[21]Adams R, Bischof L. Seeded region growing[J]. IEEE Transactions on Pattern Analysis and Machine Intelligence, 1994, 16(6): 641-647.

[22]程明,黃曉陽,黃紹輝,等. 定向區域生長算法及其在血管分割中的應用[J]. 中國圖象圖形學報,2011,16(1):44-49. Cheng Ming, Huang Xiaoyang, Huang Shaohui, et al. Directional region growing algorithm and its applications in vessel segmentation[J]. Journal of Image and Graphics, 2011, 16(1): 44-49. (in Chinese with English abstract)

[23]Gambino O, Vitabile S, Re G L, et al. Automatic volumetric liver segmentation using texture based region growing[C]// 2010 International Conference on Complex, Intelligent and Software Intensive Systems. IEEE, 2010.

[24]Pang J, Bai Z Y, Lai J C, et al. Automatic segmentation of crop leaf spot disease images by integrating local threshold and seeded region growing[C]// International Conference on Image Analysis & Signal Processing. 2011.

[25]閆東陽,明冬萍. 基于自動多種子區域生長的遙感影像面向對象分割方法[J]. 工程科學學報,2017,39(11):1735-1742. Yan Dongyang, Ming Dongping. Object-oriented remote sensing image segmentation based on automatic multispeed region growing algorithm[J]. Chinese Journal of Engineering, 2017, 39(11): 1735-1742. (in Chinese with English abstract)

[26]John C. Russ. 數字圖像處理(第六版)[M]. 余翔宇等譯. 北京:電子工業出版社,2014.

[27]Preetha M M S J, Suresh L P, Bosco M J. Image segmentation using seeded region growing[C]// International Conference on Computing. IEEE, 2012.

[28]倪長安,李心平,王顯仁. 谷物收獲機械有問必答[M]. 北京:電子工業出版社,2008.

Navigation line extraction method for combine harvester under low contrast conditions

Zeng Hongwei, Lei Junbo, Tao Jianfeng※, Zhang Wei, Liu Chengliang

(,,200240,)

In grain harvesting , the combine harvester’s header need to guide along the harvest boundary in time to ensure the harvester is working in full widt, which requires the operator has high operational skills. In addition, with the long-time operation the driver is prone to fatigue, which brings safety hazards to agricultural production. Therefore, it is of great significance to study the automatic navigation technology of combine harvester to reduce the labor intensity of drivers and improve production efficiency. The key of automatic navigation is the extraction of navigation line. Due to richer environmental information, wider detection range and more complete information, visual-based navigation methods have attracted extensive attention. However, the contrast between cut and uncut areas of mature wheat in the image is extremely low under strong illumination, which leads that the harvest boundary of crop is quite blurred. To solve the problem that the cut edge is difficult to extract under low contrast conditions, a fast and accurate navigation line extraction method of combine harvester based on region growing algorithm is presented in this paper. Firstly, the color images of harvesting scene collected by camera was converted into the gray scale image, and the Gaussian filtering was applied to remove the image noise. Then, the region growing algorithm was used to segment the image. Initial seed was selected based on some criteria and then the uncut wheat area was segmented by region growing process. The gray value of each 4-neighboring pixel was compared with the mean gray value of the seed region, if their difference was smaller than the threshold the corresponding pixel was added to the seed region. This procedure was repeated until no pixel could be grouped in the region. To improve the robustness of the region growing algorithm, an adaptive threshold selection method based on gray histogram was proposed. The multi-peak Gaussian fitting of the gray histogram was performed and half of the absolute value of the difference between mean values of the two Gaussian components was taken as the threshold of region growing, then the segmented binary image was processed by the morphological operations to fill the small holes in the segmented region which made the harvest boundary of wheat smoother. Finally, the harvest boundary of crop was detected and the harvester navigation line was acquired by fitting the harvest boundary with the least squares method. The experimental results showed that even though the contrast of cut and uncut wheat areas was extremely low, the proposed method could accurately detect the wheat harvest boundary and extract the harvester navigation line. Under different operating conditions such as different light intensity and different crop growth density, the average angle error between the navigation line extracted by the proposed method and the manually calibrated navigation line was less than 1.21 °, processing a 900×1 200 pixels image took about 0.41 s, which basically meets the real-time requirements of the combine harvester navigation. The results can provide a reference for the automatic navigation of the combine harvester.

mechanization; machine vision; navigation; combine harvester;region growing algorithm; multi-peak Gaussian fitting; least squares

曾宏偉,雷軍波,陶建峰,張 偉,劉成良. 低對比度條件下聯合收割機導航線提取方法[J]. 農業工程學報,2020,36(4):18-25. doi:10.11975/j.issn.1002-6819.2020.04.003 http://www.tcsae.org

Zeng Hongwei, Lei Junbo, Tao Jianfeng, Zhang Wei, Liu Chengliang. Navigation line extraction method for combine harvester under low contrast conditions[J]. Transactions of the Chinese Society of Agricultural Engineering (Transactions of the CSAE), 2020, 36(4): 18-25. (in Chinese with English abstract) doi:10.11975/j.issn.1002-6819.2020.04.003 http://www.tcsae.org

2019-09-19

2019-11-01

國家重點研發計劃(2016YFD0700105,2016YFD0702001);新進教師啟動計劃項目(18X100040003)。

曾宏偉,博士生,研究方向:智能化農機裝備。Email:zenghw@sjtu.edu.cn

陶建峰,副教授,博士生導師,博士,主要從事智能液壓傳動與控制技術研究。Email:jftao@sjtu.edu.cn

10.11975/j.issn.1002-6819.2020.04.003

S225.3;TP29

A

1002-6819(2020)-04-0018-08