基于深度學習的紡織品圖案智能輔助設計

王曉龍 王穎

摘? 要:為了實現基于深度學習的紡織品圖案智能輔助設計系統,將分形圖案與深度學習風格遷移算法相結合,利用深度學習框架Tensorflow,首先生成基于Mandelbrot集合的分形圖案,接著從圖像轉換網絡結構、感知損失函數等幾個方面改進了已有的神經網絡風格遷移算法,對分形圖案進行風格化設計,使生成的創意圖案更符合紡織品圖案邊界要求高、保持圖案細節完整的特點,更加符合紡織品打印要求。

關鍵詞:深度學習;分形圖案;風格遷移;卷積神經網絡;紡織品圖案

中圖分類號:TP391.4? ? ? 文獻標識碼:A 文章編號:2096-4706(2020)02-0131-03

Abstract:In order to realize the intelligent aided design system of textile pattern based on deep learning,the fractal pattern is combined with the algorithm of deep learning style transfer. Using Tensorflow,the fractal pattern based on Mandelbrot set is generated firstly. Then,the existing neural network style transfer algorithm is improved from the aspects of image conversion network structure and perceptual loss function,the fractal pattern is stylized to make the creative pattern meet the requirements of textile pattern boundary,keep the pattern details complete and meet the textile printing requirements.

Keywords:deep learning;fractal pattern;style migration;convolution neural network;textile pattern

0? 引? 言

本文介紹基于深度學習的紡織品圖案的自動化生成技術。使用深度學習架構和技術來生成紡織品圖案(以及其他藝術內容)是近年來借助科學可視化方法形成的一個藝術與科學相結合的研究領域,其特點主要表現在:既允許自動化藝術品的生產,又擴展了創造性表達的領域,因此為圖案設計者開辟了新的天地。

1? 深度學習

深度學習已經成為一個快速發展的領域,目前經常用于分類和預測任務,如圖像和語音識別以及翻譯。自2006年開始,深度學習體系結構在圖像分類任務上顯著優于使用手工特征的標準技術。深度學習的成功以及人工神經網絡的架構和技術再現,主要有以下幾個原因:

(1)技術的進步,如:預訓練(從而解決了多層神經網絡預訓練的低效性)、卷積(提供主題平移不變性)、LSTM(長短期記憶,解決了循環神經網絡訓練的低效性)。

(2)大數據的可用性。

(3)高效和廉價的計算能力,特別得益于圖形處理單元GPU,GPU最初是為視頻游戲設計的,現在已經成為深度學習應用的最大市場之一。

因此,在大數據日益發展的今天,隨著越來越多的大型紡織品圖案數據庫的出現,基于深度學習的智能紡織品圖案生成系統將能夠自動從數據庫中學習圖案設計風格并產生新的圖案內容。

2? 生成分形圖案

分形圖是一種以數學理論作為基礎,通過調整迭代函數、變化規則及顏色參數等數據進行編程設計,實現程序代碼的可視化,將枯燥的數據轉化為絢麗的圖形或圖像。由于分形圖的生成原理,其具有極精細的結構,若沒有源代碼,分形圖將不易復制和拷貝。這種分形圖實現了分形幾何學與計算機圖形學的完美聯合,同時也是科學與藝術的融合,另外分形圖的美是不可估量的,為紡織圖案設計增添了新元素[1]。本文主要利用Tensorflow計算復平面上分形圖,通過改變迭代函數形式和參數而生成變化分形圖,并將其保存為圖片形式,方便后期進行紡織品圖案的風格化設計。

在TensorFlow中,我們定義如下的計算步驟:

xs = tf.constant(Z.astype(np.complex64))zs = tf. Variable(xs)ns = tf.Variable(tf.zeros_like(xs, tf.float32)) with tf.Session(): tf.global_variables_initializer().run() zs_ = tf.where(tf.abs(zs) < R, zs**2 + xs, zs) not_diverged = tf.abs(zs_) < R step = tf.group( zs.assign(zs_), ns.assign_add(tf.cast(not_diverged, tf.float32)) for i in range(ITER_NUM): step.run() final_step = ns.eval() final_z = zs_.eval()

其中,zs對應式(1)中的z,而xs對應式(1)中的c。方便起見,只要計算時數值的絕對值大于一個事先指定的值R,就認為其發散。每次計算使用tf.where只對還未發散的值進行計算。結合ns和zs_就可以計算顏色,得到經典的Mandelbrot圖像。

3? 分形圖案實時風格化

3.1? 深度學習網絡結構

本文設計的深度學習網絡結構由兩部分組成,如圖1所示,一是學習風格圖片到內容圖片遷移的圖像轉換網絡fw,其中,w(weights)是fw所有神經元的最優權值;二是采用由牛津大學視覺幾何組(Visual Geometry Group,VGG)開發的卷積神經網絡結構VGG-16網絡模型,用于計算損失函數的損失網絡φ。該網絡結構通過卷積層提取不同層的卷積特征(Feature Map),可以表達人類對圖像的視覺感知情況。利用卷積特征計算分形圖案和風格圖片的視覺感知對比損失情況,根據不同卷積層的特征圖可以定義一系列的損失函數l1,l2,……,lk。假設一幅分形圖案x通過深層卷積神經網絡fw計算得到創意圖案y,則定義y=fw(x),每個損失函數計算一個標量值li(y,yi),衡量輸出的y和目標圖像yi之間的差距,損失函數可以從紋理、光照、直方圖等多方面考慮。因此fw的求解過程就轉化為利用式(2)進行梯度下降求最優解,其中λi為每個損失函數i的權重比例。

3.2? 圖像轉換網絡

圖像轉換網絡結構如表1所示。3個卷積層后緊接著5個殘差塊,然后兩個上池化層,最后一個卷積層,第一層和最后一層的卷積核都是9×9,其余均為3×3。每個殘差塊中包含兩層卷積。我們的網絡結構中把Batch Normalization用Instance Normalization[2]來替換,所有在生成器網絡中的Batch-Normalization都這樣替換。這樣做能阻止實例特定的均值和協方差簡化學習的過程,提高風格遷移速度同時使生成的圖像效果更好。同時,deconvolution(transposed convolution)也全部換成了resize convolution,可以防止棋盤格紋理的產生。再者,為了更適應紡織品圖案邊界要求高的特點,通常的Zero-Padding被Reflect-Padding取代,減少了邊界效應。

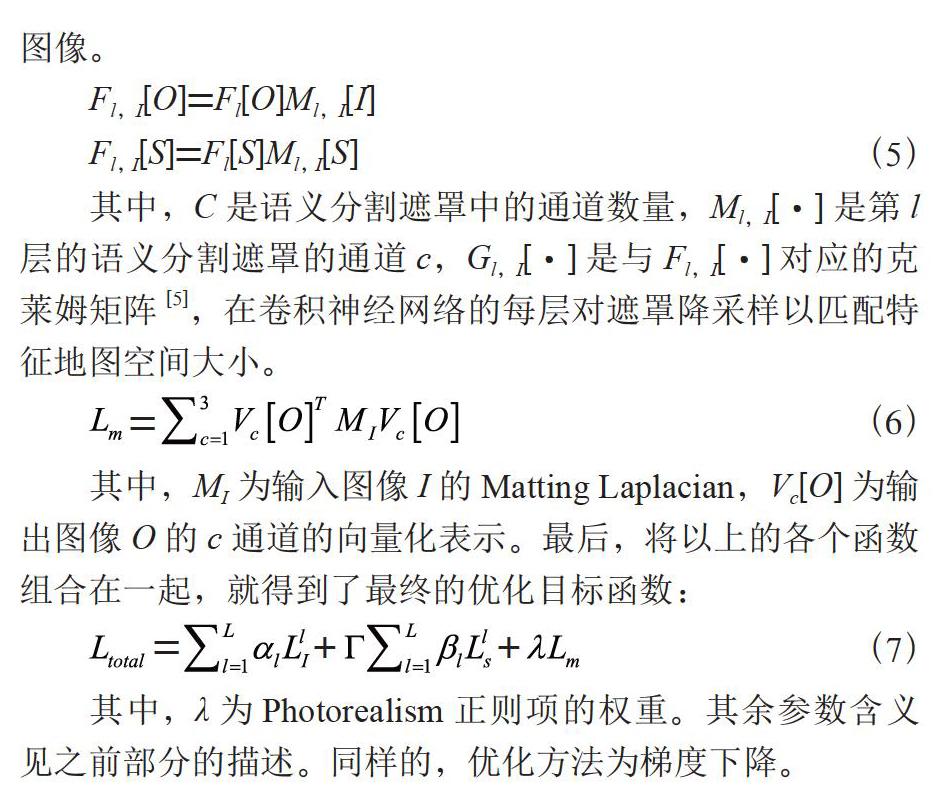

3.3? 感知損失函數

由于生成的分形圖案多數是一些純色背景的圖像,如果直接對其進行風格化,風格化后圖像的邊緣會呈現出對物體顏色的延伸,邊界將會變得不平整,為了在創意圖案生成過程中,不丟失分形圖案本身的細節,使其更符合紡織品圖案打印需求,在損失函數的定義中我們采用了兩種策略:其一,對分形圖案進行語義分割[3],將分割模版同時作為分形圖案的增廣一同輸入到神經網絡中,從而保證優化過程中只處理我們感興趣的內容。其二,在分形圖案與最終輸出圖像創意圖案之間建立一種在顏色空間中的局部仿射變換[4],即創意圖案的每一個顏色通道中的每個像素值,都可以由分形圖案的局部區域像素的線性組合得到。通過建立這一關系,就達到了通過分形圖案來約束創意圖案的目的,從而不丟失分形圖案的細節。

4? 實驗及分析

本文采用預先訓練的VGG-16作為特征提取器。選擇conv3_3作為內容表示,conv1_2,conv2_2,conv3_3,conv4_3作為風格表示。考慮到紡織品圖案對紋理及邊緣要求的特殊性,我們對于生成的分形圖案,分別采用不同的風格圖片進行了風格化比較:對于油畫及畫面顏色豐富的風格圖片生成的創意圖案邊界效果略失真;如果風格圖片顏色單一或與分形圖案顏色相近,則生成的創意圖案紋理和邊界都非常清晰,基本符合紡織品圖案的打印需要。

5? 結? 論

基于深度學習的紡織品圖案設計技術,其特點主要表現在,它能將一些原應屬于不可視的信息轉化成圖形或圖像展示在我們面前,其圖形圖像形態離奇,風格獨特,非人腦所能想象,可以成為一種取之不盡的創作源泉。此外,因為這是一種將非線性科學與計算機圖形圖像技術結合的產物,所以,其圖案是一種數字化的信息,具有生成快,操作簡便的特征,非常適合在敏捷產品制造系統中使用。

參考文獻:

[1] 王淑緩,楊旭紅.復平面上分形圖的生成及在紡織品上的應用 [J].絲綢,2017,54(8):56-61.

[2] ULYANOV D,VEDALDI A,LEMPITSKY V.Instance Normalization:The Missing Ingredient for Fast Stylization [J/OL].arXiv:1607.08022[cs.CV](2016-07-27).https://arxiv.org/abs/1607.08022.

[3] CHEN L C,PAPANDREOU G,KOKKINOS I,et al. DeepLab:Semantic Image Segmentation with Deep Convolutional Nets,Atrous Convolution,and Fully Connected CRFs [J]. IEEE Transactions on Pattern Analysis & Machine Intelligence,2016,40(4):834-848.

[4] LUAN F,PARIS S,SHECHTMAN E,et al. Deep Photo Style Transfer [C]//2017 IEEE Conference on Computer Vision and Pattern Recognition (CVPR). Honolulu,HI,USA,2017(1):6997-7005.

[5] WEISSTEIN E W. Gram Matrix [EB/OL].(2019-11-01).Wolfram MathWorld. http://mathworld.wolfram.com/GramMatrix.html.

作者簡介:王曉龍(1997-),男,漢族,吉林長春人,本科在讀,研究方向:輕化工程;通訊作者:王穎(1975-),女,回族,河北張家口人,教師,講師,碩士研究生,研究方向:計算機應用技術。