基于Cascade R-CNN改進的花色布匹瑕疵智能識別方法

摘 ?要:花色布匹在生產的過程中,其相比于單色布匹的生產需要引入更多的加工工序,比如印花、后整理等工序,經常導致花色布匹產生更多的瑕疵類別。為了實現花色布匹瑕疵的智能識別與檢測,文章給出一種基于Cascade R-CNN改進的花色布匹瑕疵智能識別與檢測方法,實驗結果表明,相比同類算法,文章提出的方法在花色布匹瑕疵數據集上識別的準確率提升了2.39%,mAP評估指標提高了3.83%的顯著效果。

關鍵詞:花色布匹瑕疵;目標識別;缺陷檢測;深度學習;卷積神經網絡

中圖分類號:TP391.41;TS107 ? ? ?文獻標識碼:A 文章編號:2096-4706(2020)23-0020-05

Improved Intelligent Recognition Method of Pattern and Color Fabric Defects

Based on Cascade R-CNN

LU Guijia

(Guangdong University of Technology,Guangzhou ?510006,China)

Abstract:In the process of patterned and color fabric production,it needs to introduce more processing procedures than the production of monochrome fabric,such as printing and finishing,etc,which often leads to more defect categories in the pattern and color fabric. In order to realize the intelligent recognition and detection of the defects of the pattern and color fabric,this paper presents an improved method of intelligent recognition and detection of the pattern and color fabric defects based on Cascade R-CNN. The experimental results show that compared with similar algorithms,the method proposed in this paper improves the accuracy of recognition on the pattern and color fabric defect data set by 2.39%,and the mAP evaluation index is improved by 3.83%.

Keywords:pattern and color fabric defect;target recognition;defect detection;deep learning;convolutional neural network

0 ?引 ?言

眾所周知,工業產品的表面缺陷問題嚴重地影響著其美觀和質量,對于紡織工業的布匹產品,其表面的缺陷一般被人們稱為布匹瑕疵,其可能會產生于布匹生產工藝流程上各個環節,布匹產品的瑕疵問題會導致布匹產品滯銷和經濟損失[1]。目前在我國的紡織企業中布匹瑕疵識別絕大多數還是依靠人工檢測,人工檢測有效率低,成本高,會導致誤檢和漏檢等問題,且人工檢測布匹瑕疵檢出率約為70%[2],對于追求高質量紡織品和提高生產效率的布匹生產企業,這無疑是個比較嚴重的阻礙。

近年來,隨著人工智能技術的快速發展與應用,基于深度學習的方法使得布匹瑕疵智能識別與檢測的效果又邁進了一大步。吳志洋等[3]為了解決單色布匹瑕疵的快速檢測,基于AlexNet[4]提出了一種雙網絡并行的OurNet方法,在單色布匹瑕疵識別準確率和速度上有顯著的提升,該模型均衡了檢測速度和性能,但是對于分辨率高,瑕疵區域小的布匹圖像,卻難以檢測。車翔玖等[5]針對高分辨率,瑕疵區域小的布匹圖像不易于檢測的問題,基于FastRCNN[6]改進提出一種多分類任務概率合成的方法,能夠有效識別高分辨率,小目標瑕疵的布匹圖像的瑕疵,不過在識別和檢測速度上并不夠理想。

上述方法均是基于深度學習算法對布匹瑕疵檢測進行相關研究,不過研究的對象都是易于檢測的單色布匹和紋理布匹瑕疵種類,而對于花色布匹,其瑕疵種類更為繁多,背景紋理圖案復雜,瑕疵形狀與背景花紋相似的布匹圖像條件下卻難以發揮出其相應的性能,同時花色布匹瑕疵識別在國內外卻鮮有研究。基于此,本文在布匹瑕疵檢測相關研究的基礎上,引入花色布匹模板圖像,提出了基于花色布匹圖像模板的花色布匹瑕疵智能識別與檢測方法。該方法首先使用圖像處理技術對采集到的花色布匹瑕疵圖像進行預處理,進一步將圖像輸入卷積神經網絡進行特征提取;其次,引入花色布匹模板圖像的特征層,基于特征金字塔網絡(FPN)搭建一種新的特征融合網絡(TeFPN)來進行有效特征融合;最后,提出一種基于花色布匹圖像模板的回歸框抑制方法(Te-NDS)來提高最終的花色布匹瑕疵識別效果。

1 ?花色布匹瑕疵問題描述

通過對花色布匹瑕疵進行觀察,發現有一些花色布匹的瑕疵特征與花色背景紋理十分相似,還有一些瑕疵類別之間的特征也十分相似,部分各類花色布匹瑕疵如圖1所示,若依靠人工去檢查很難通過人眼去觀察并把它們尋找出來,而且人工檢測花色布匹瑕疵是十分困難且低效率的,所以本文擬采用一種基于深度學習的智能方法來研究花色布匹瑕疵的識別與檢測。

通過對花色布匹數據庫進行分類統計,可以發現花色布匹瑕疵各個類別在分布上具有顯著的不平衡特性。其中,最多的是玷污類瑕疵,總共有5 233個,占瑕疵總體的34.7%,瑕疵數目最少的類別是破洞類,有368個,約占總體的2.5%,這樣的數據分布顯然不利于用學習的方法進行模型訓練并推理預測。同時,本文還對各類瑕疵的形狀尺寸進行統計分析,發現各類瑕疵存在類內瑕疵尺寸差異較大,類間瑕疵尺寸差異顯著的特點。

2 ?花色布匹瑕疵檢測模型構建

2.1 ?基于Cascade R-CNN改進的花色布匹瑕疵識別方法

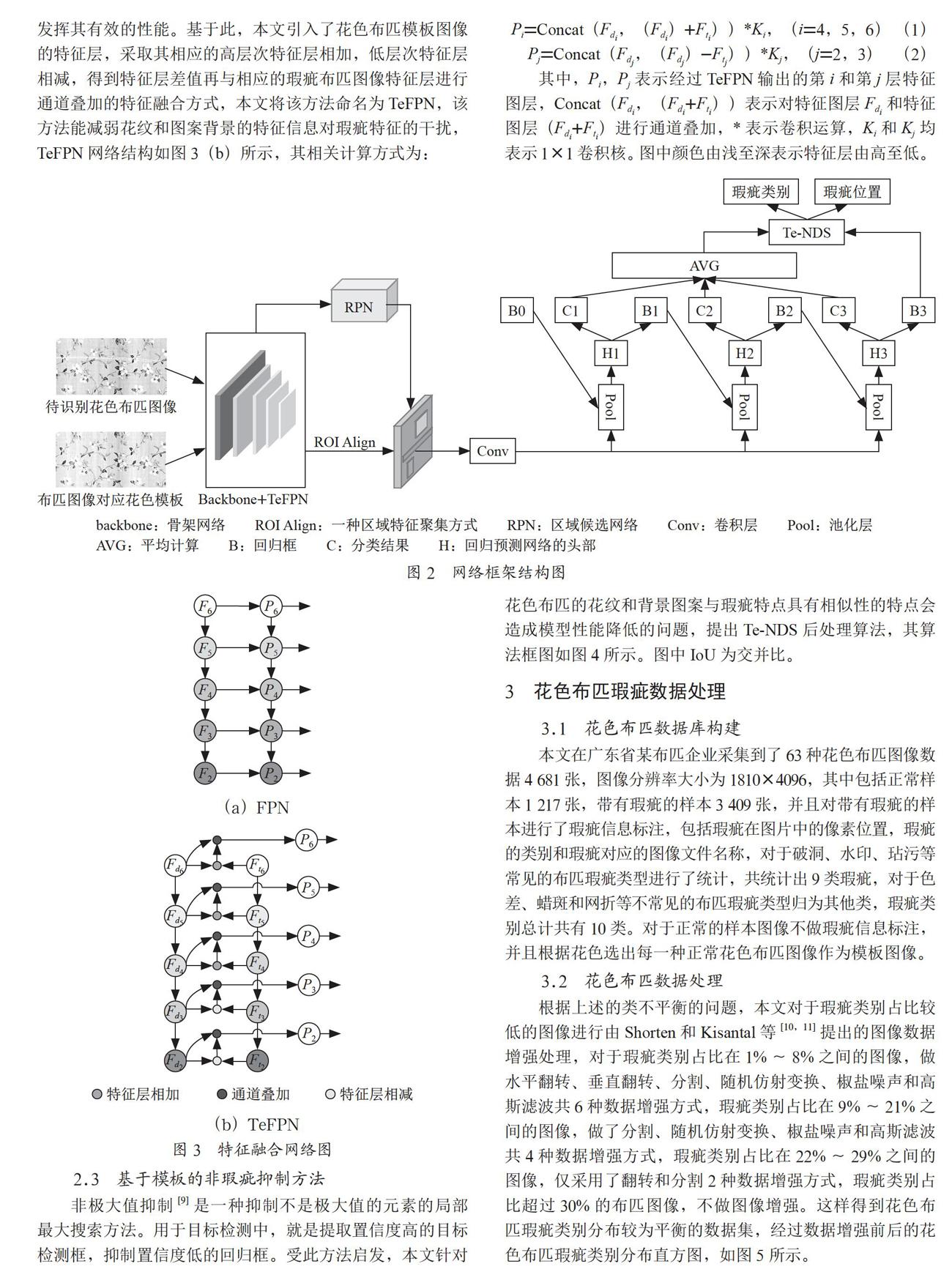

為了更能適應對于花色布匹瑕疵的檢測與分類,本文采用Cascade R-CNN[7]網絡結構作為花色布匹瑕疵識別的基本模型,并且在此模型結構上做了部分有效的改進,網絡框架結構如圖2所示。首先,本文基于特征金字塔網絡[8],引入正常花色布匹圖像作為模板進行特征提取,然后和待檢測花色布匹圖像提取的特征層進行有效的融合。其次,本文采用K-means聚類分析方法,針對花色布匹瑕疵尺寸進行聚類分析,然后在網絡模型結構中的區域候選網絡中對anchor的比例和尺寸大小進行重新設定。最后,本文在瑕疵分類和定位回歸處理上結合了花色布匹模板圖像進行非極大值抑制處理,提高了花色布匹瑕疵檢測定位的效果。

2.2 ?基于FPN改進的特征融合網絡

FPN是通過利用卷積神經網絡提取輸入圖像的特征圖層進行了橫向連接和自頂向下連接的特征融合方式,這種方法能夠有效地融合輸入圖像中各個維度的特征,可以使下層輸出的特征圖層融合上層的語義信息,實驗表明,該特征表達的語義信息更為有效。FPN網絡結構如圖3(a)所示,其中Fl(l=2,…,6)表示經過CNN提取原始圖像的第2~6層金字塔型特征圖層,從第6層特征圖層F6開始,每個特征圖層在水平方向以3×3的卷積核進行卷積運算,再從最頂層P6從頂向下進行2倍的上采樣運算后與對應水平卷積運算后的特征圖層逐元素相加,獲得最終特征圖層Pk(k=2,…,5)。

由于花色布匹瑕疵的特點與花色布匹的背景花紋圖案具有相似性,FPN會融合花色布匹圖像的冗余特征信息,難以發揮其有效的性能。基于此,本文引入了花色布匹模板圖像的特征層,采取其相應的高層次特征層相加,低層次特征層相減,得到特征層差值再與相應的瑕疵布匹圖像特征層進行通道疊加的特征融合方式,本文將該方法命名為TeFPN,該方法能減弱花紋和圖案背景的特征信息對瑕疵特征的干擾,TeFPN網絡結構如圖3(b)所示,其相關計算方式為:

Pi=Concat(Fdi,(Fdi)+Fti))*Ki,(i=4,5,6) (1)

Pj=Concat(Fdj,(Fdj)-Ftj))*Kj,(j=2,3) ? (2)

其中,Pi,Pj表示經過TeFPN輸出的第i和第j層特征圖層,Concat(Fdi,(Fdi+Fti))表示對特征圖層Fdi和特征圖層(Fdi+Fti)進行通道疊加,*表示卷積運算,Ki和Kj均表示1×1卷積核。圖中顏色由淺至深表示特征層由高至低。

2.3 ?基于模板的非瑕疵抑制方法

非極大值抑制[9]是一種抑制不是極大值的元素的局部最大搜索方法。用于目標檢測中,就是提取置信度高的目標檢測框,抑制置信度低的回歸框。受此方法啟發,本文針對花色布匹的花紋和背景圖案與瑕疵特點具有相似性的特點會造成模型性能降低的問題,提出Te-NDS后處理算法,其算法框圖如圖4所示。圖中IoU為交并比。

3 ?花色布匹瑕疵數據處理

3.1 ?花色布匹數據庫構建

本文在廣東省某布匹企業采集到了63種花色布匹圖像數據4 681張,圖像分辨率大小為1810×4096,其中包括正常樣本1 217張,帶有瑕疵的樣本3 409張,并且對帶有瑕疵的樣本進行了瑕疵信息標注,包括瑕疵在圖片中的像素位置,瑕疵的類別和瑕疵對應的圖像文件名稱,對于破洞、水印、玷污等常見的布匹瑕疵類型進行了統計,共統計出9類瑕疵,對于色差、蠟斑和網折等不常見的布匹瑕疵類型歸為其他類,瑕疵類別總計共有10類。對于正常的樣本圖像不做瑕疵信息標注,并且根據花色選出每一種正常花色布匹圖像作為模板圖像。

3.2 ?花色布匹數據處理

根據上述的類不平衡的問題,本文對于瑕疵類別占比較低的圖像進行由Shorten和Kisantal等[10,11]提出的圖像數據增強處理,對于瑕疵類別占比在1%~8%之間的圖像,做水平翻轉、垂直翻轉、分割、隨機仿射變換、椒鹽噪聲和高斯濾波共6種數據增強方式,瑕疵類別占比在9%~21%之間的圖像,做了分割、隨機仿射變換、椒鹽噪聲和高斯濾波共4種數據增強方式,瑕疵類別占比在22%~29%之間的圖像,僅采用了翻轉和分割2種數據增強方式,瑕疵類別占比超過30%的布匹圖像,不做圖像增強。這樣得到花色布匹瑕疵類別分布較為平衡的數據集,經過數據增強前后的花色布匹瑕疵類別分布直方圖,如圖5所示。

4 ?實驗結果與分析

4.1 ?實驗環境與細節

本文的實驗環境是采用配置為Intel(R)Xeon(R)E5-2650 v4 @ 2.20 GHz CPU和NVIDIA GeForce GTX 1080Ti GPU

的服務器進行實驗,服務器的操作系統為Ubuntu 16.04,同時基于PyTorch框架進行模型的搭建與改進,用到ImageNet[12]中的預訓練權重。此外,使用了OHEM采樣方法進行采樣、多尺度訓練、隨機翻轉等訓練技巧和Focal Loss損失函數,使用隨機梯度下降算法進行優化訓練過程不會引起梯度爆炸。

4.2 ?評估指標

識別的準確率(Acc)為識別正確的花色布匹圖像數量與測試集所有樣本數量的比值,其計算公式見式(3):

(3)

其中,TP為預測實際瑕疵為瑕疵,TN為預測實際正常花色布匹為正常(無瑕疵),M為測試集所有樣本數量。

另外,為了測量模型在10類不同瑕疵中的總體檢測性能,本文采用mAP性能指標進行評估模型的性能,mAP的定義公式為式(4):

(4)

其中Pn(Rn)表示第n類的PR曲線,N表示實際的總類別數目。識別的速度以每秒識別幀數(FPS)來評估,一幀表示一幅花色布匹圖像,FPS值越高表明識別速度越快。

4.3 ?模型的性能實驗結果

本文實驗用到含有28種花色,926張分辨率為2 048 ×915的花色布匹圖像的測試集進行花色布匹瑕疵智能識別實驗,表1是本文方法和同類方法的實驗結果比較。Faster RCNN在不同的骨架網絡上的性能表現相差不大,隨著卷積網絡層數的加深,其準確率和mAP都有小幅度提升,準確率提高了0.55%,mAP提升了1.41%,由此可以推斷,卷積網絡深度的加深可以提取更到更多的特征信息,提升模型的檢測性能。一方面,在相同的骨架網絡下Cascade R-CNN與Faster RCNN相比,Cascade R-CNN的性能表現更好。另一方面,Cascade R-CNN在同一特征提取骨架網絡下,特征融合網絡中TeFPN的準確率相比FPN提高了1.07%,mAP提升了2.07%,因此TeFPN有效地融合瑕疵的特征,過濾掉部分花紋和背景圖案等非瑕疵特征信息。同時,Te-NDS的引入也使得模型的識別準確率再提高了1.32%,mAP又提升了1.76%,驗證了本文提出的Te-NDS方法能有效地抑制模型對背景紋理信息對瑕疵特征的干擾。另外,經過參數整定實驗,當設定Te-NDS的閾值Nt=0.32時,模型性能在測試集上取得最好的效果。這說明,對比于原始的Cascade R-CNN方法,本文的改進方法在花色布匹瑕疵數據集上的準確率和mAP性能指標均有大幅提升,不過在識別的速度上略有減緩。

5 ?結 ?論

本文針對花色布匹具有花紋和復雜圖案等條件下進行瑕疵分類與檢測,提出了一種基于Cascade R-CNN改進的智能識別方法。該方法通過在特征融合網絡引入花色布匹圖像的模板特征層與待測花色布匹圖像特征層進行有效融合,同時在模型識別過程中采用了一種基于花色布匹模板的非瑕疵抑制的后處理方法。經過實驗驗證,本文提出的方法能夠提升花色布匹瑕疵的識別效果,可應用于花色布匹瑕疵的識別與檢測。

參考文獻:

[1] HENRY Y.T. NGAN A,Grantham K.H,etc. Automated fabric defect detection—A review [J].Image and Vision Computing,2011,29 (7):442-458.

[2] CHAN C H,PANG G K H. Fabric defect detection by Fourier analysis [J].IEEE Transactions on Industry Applications,2000,36(5):1267.

[3] 吳志洋,卓勇,李軍,等.基于卷積神經網絡的單色布匹瑕疵快速檢測算法 [J].計算機輔助設計與圖形學學報,2018,30(12):2262-2270.

[4] KRIZHEVSKY A,SUTSKEVER I,HINTON G. ImageNet classification with deep convolutional neural networks [J].Communications of the ACM,2017,60(6):84-90.

[5] 車翔玖,劉華羅,邵慶彬.基于Fast RCNN改進的布匹瑕疵識別算法 [J].吉林大學學報 (工學版),2019,49(6):2038-2044.

[6] GIRSHICK R. Fast R-CNN [C]//2015 IEEE International Conference on Computer Vision (ICCV).Santiago:IEEE,2015:1440-1448.

[7] CAI Z W,VASCONCELOS N. Cascade R-CNN:Delving Into High Quality Object Detection [C]//2018 IEEE/CVF Conference on Computer Vision and Pattern Recognition:IEEE,2018.

[8] LIN T Y,DOLLAR P,HE K,et al. Feature Pyramid Networks for Object Detection [C]//2017 IEEE Conference on Computer Vision and Pattern Recognition (CVPR):IEEE,2017.

[9] NEUBECK A,GOOL L J V. Efficient Non-Maximum Suppression [C]//International Conference on Pattern Recognition:IEEE,2006.

[10] SHORTEN C,KHOSHGOFTAAR T M. A survey on Image Data Augmentation for Deep Learning [J].Journal of Big Data,2019,6(1):1-48.

[11] KISANTAL M,WOJNA Z,MURAWSK J,et al. Augmentation for small object detection [C]//9th International Conference on Advances in Computing and Information Technolog:Aircc Publishing Corporation,2019.

[12] DENG J,DONG W,SOCHER R,et al. ImageNet:A large-scale hierarchical image database [C]//IEEE Conference on Computer Vision & Pattern Recognition.Miami:IEEE,2009:248-255.

作者簡介:陸貴家(1996—),男,壯族,廣東廣州人,碩士研究生在讀,主要研究方向:深度學習,計算機視覺,目標檢測。