基于s-LTP和相似度匹配的人臉識(shí)別算法

黃濤 鄧燕妮

摘 ?要:針對(duì)傳統(tǒng)的LTP算子計(jì)算過程復(fù)雜、不能反映圖像局部與整體的關(guān)系的不足,提出了一種帶符號(hào)局部三值模式(s-LTP)算子,首先利用2,1,0三值編碼計(jì)算出像素塊的LTP特征值,再通過比較該像素塊中心點(diǎn)像素值與圖像平均像素值的大小對(duì)LTP特征值賦正負(fù)號(hào),得到s-LTP特征值。然后提出了一種基于皮爾遜相關(guān)系數(shù)的相似度匹配方法,通過大量實(shí)驗(yàn)得到最佳皮爾遜相關(guān)系數(shù)閾值和相似度閾值,最后通過計(jì)算待測(cè)樣本圖像和模板圖像的相似度對(duì)待測(cè)樣本圖像進(jìn)行分類識(shí)別。在Jaffe、ORL、Yale和一個(gè)自建的人臉數(shù)據(jù)庫上進(jìn)行實(shí)驗(yàn),和其他人臉識(shí)別方法相比發(fā)現(xiàn)該算法識(shí)別率更高、所需識(shí)別時(shí)間更少。

關(guān)鍵詞:人臉識(shí)別;s-LTP算子;相似度匹配;皮爾遜相關(guān)系數(shù)

中圖分類號(hào):TP391.41 ? ? ?文獻(xiàn)標(biāo)志碼:A ? ? ? ? 文章編號(hào):2095-2945(2020)25-0017-03

Abstract: In view of the fact that the calculation process of the traditional LTP operator is complex and can not reflect the relationship between the part and the whole of the image, a signed local ternary pattern (s-LTP) operator is proposed. Firstly, the LTP eigenvalue of the pixel block is calculated using 2, 1, 0 ternary coding, and then the LTP eigenvalue is assigned a positive or negative sign to the LTP eigenvalue by comparing the center pixel value of the pixel block with the average pixel value of the image, and the s-LTP eigenvalue is obtained. Then a similarity matching method based on Pearson correlation coefficient is proposed, and the best Pearson correlation coefficient threshold and similarity threshold are obtained through a large number of experiments. Finally, the sample images are classified and identified by calculating the similarity between the sample image and the template image. Experiments are carried out on Jaffe, ORL, Yale and a self-built face database. Compared with other face recognition methods, it is found that this algorithm has a higher recognition rate and less recognition time.

Keywords: face recognition; s-LTP operator; similarity matching; Pearson correlation coefficient

人臉識(shí)別技術(shù)是鑒別個(gè)人身份信息的重要手段,各種各樣的人臉識(shí)別算法層出不窮,各有優(yōu)劣。其中,局部二值模式(LBP)因?yàn)槠鋬?yōu)秀的圖像紋理分析與描述能力而被廣泛應(yīng)用于各種人臉識(shí)別算法中。傳統(tǒng)的LBP算子計(jì)算過程簡(jiǎn)單、效果較好,但容易受人臉圖像背景環(huán)境以及光照等不可控因素的影響而產(chǎn)生較大的誤差,從而增加錯(cuò)誤識(shí)別的概率。

為了減小背景環(huán)境和外界光照等因素對(duì)人臉圖像識(shí)別率的影響,提取更豐富的局部特征,有學(xué)者在LBP算子的基礎(chǔ)上提出了局部三值模式(LTP)。李偉生等[1]提出了一種基于LTP 自適應(yīng)閾值的人臉識(shí)別方法,通過自定義的閾值編碼對(duì)LBP 算子擴(kuò)展,采用-1,0,1三值,分別統(tǒng)計(jì)正、負(fù)模式層特征的直方圖,并根據(jù)概率分布計(jì)算各層信息熵權(quán)重,最后使用最近鄰分類器識(shí)別人臉圖像樣本。唐紅梅等[2]提出了一種中心對(duì)稱三值模式(CSTP)算法,首先對(duì)人臉表情圖像進(jìn)行分塊處理,結(jié)合每一子塊的CSTP特征的直方圖統(tǒng)計(jì)和對(duì)應(yīng)的信息熵,構(gòu)造自適應(yīng)加權(quán)系數(shù),最后利用支持向量機(jī)(SVM)進(jìn)行表情分類。上述兩種針對(duì)LBP算子的改進(jìn)方法從圖像的局部紋理特征入手,使處理結(jié)果受像素灰度差異變化的影響變小,抗干擾能力變強(qiáng)。但是忽略了圖像局部與整體之間的關(guān)系,且大量的數(shù)據(jù)和復(fù)雜的計(jì)算方法為后續(xù)的數(shù)據(jù)處理和識(shí)別分類增加了難度。

本文中提出了一種基于s-LTP算子和相似度匹配的人臉識(shí)別算法。該算法針對(duì)以上兩種方法的不足之處,利用2,1,0三值和正負(fù)號(hào),通過自定義的編碼形式將預(yù)處理好的人臉圖像轉(zhuǎn)換成一個(gè)特征值矩陣。同時(shí)還以皮爾遜相關(guān)系數(shù)為基礎(chǔ)依據(jù),提出了矩陣相似度的概念。通過計(jì)算模板圖像和待測(cè)樣本圖像的特征值矩陣的相似度,并以實(shí)驗(yàn)得出的最佳皮爾遜相關(guān)系數(shù)閾值和相似度閾值為依據(jù)完成人臉圖像的分類識(shí)別。該算法兼顧了圖像的局部與局部、局部與整體的關(guān)系,數(shù)據(jù)量小,計(jì)算方法簡(jiǎn)單,分類依據(jù)可靠。和其他人臉識(shí)別方法的對(duì)比實(shí)驗(yàn)表明該方法在不增加識(shí)別時(shí)間的前提下能有效提高識(shí)別率。

1 相關(guān)算子描述

1.1 LTP算子描述

傳統(tǒng)的LTP算子采用-1,0,1三值編碼[3],在由編碼轉(zhuǎn)換成特征值的過程中需要對(duì)正負(fù)值編碼分開處理,過程繁瑣,數(shù)據(jù)量大,程序的時(shí)間復(fù)雜度和空間復(fù)雜度都較高。本文中的LTP算子為避免產(chǎn)生負(fù)值編碼而采用了2,1,0三值編碼,可大大簡(jiǎn)化計(jì)算過程。LTP算子特征值計(jì)算過程如下:

1.2 s-LTP算子描述

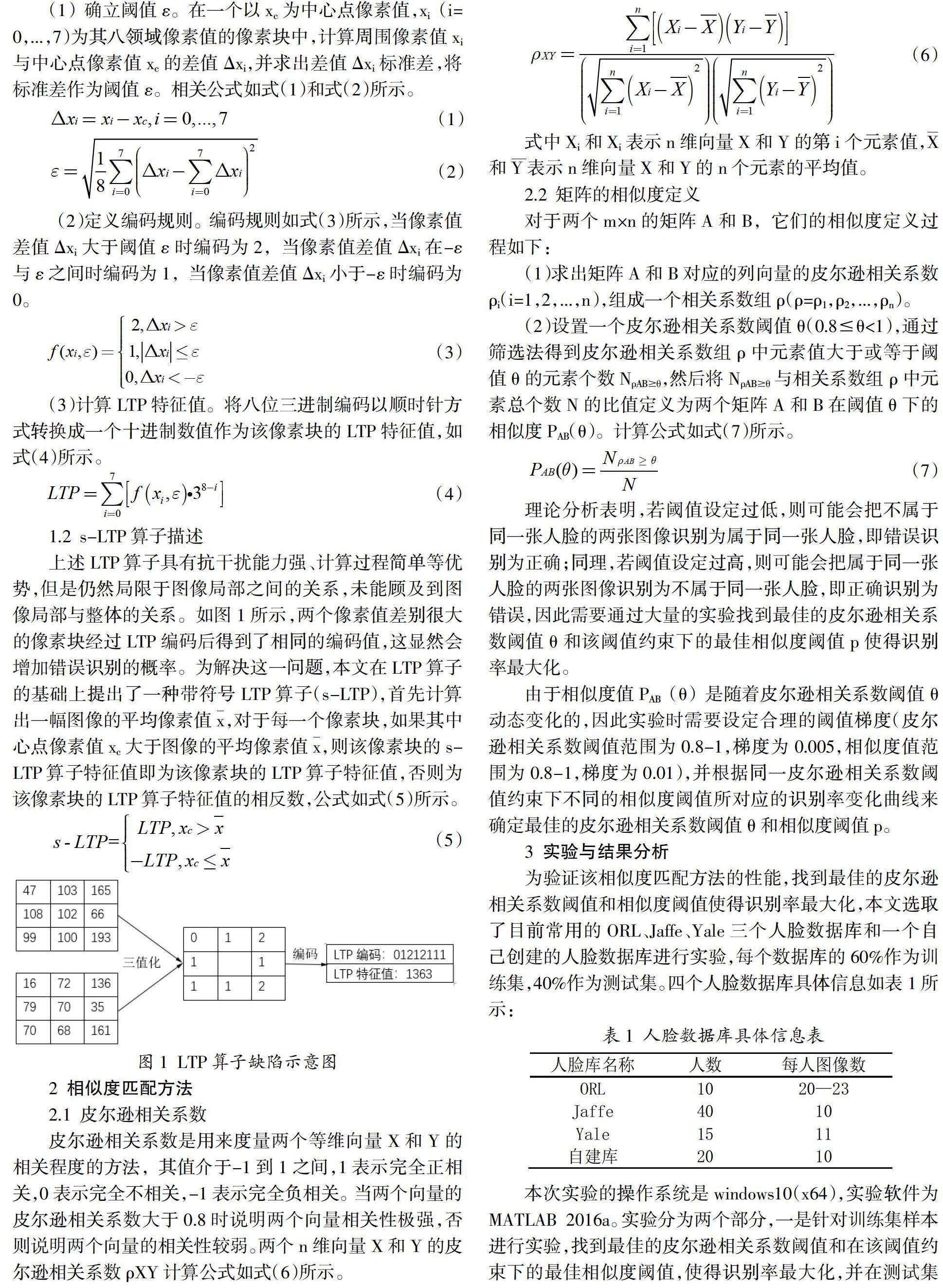

上述LTP算子具有抗干擾能力強(qiáng)、計(jì)算過程簡(jiǎn)單等優(yōu)勢(shì),但是仍然局限于圖像局部之間的關(guān)系,未能顧及到圖像局部與整體的關(guān)系。如圖1所示,兩個(gè)像素值差別很大的像素塊經(jīng)過LTP編碼后得到了相同的編碼值,這顯然會(huì)增加錯(cuò)誤識(shí)別的概率。為解決這一問題,本文在LTP算子的基礎(chǔ)上提出了一種帶符號(hào)LTP算子(s-LTP),首先計(jì)算出一幅圖像的平均像素值x,對(duì)于每一個(gè)像素塊,如果其中心點(diǎn)像素值xc大于圖像的平均像素值x,則該像素塊的s-LTP算子特征值即為該像素塊的LTP算子特征值,否則為該像素塊的LTP算子特征值的相反數(shù),公式如式(5)所示。

2 相似度匹配方法

2.1 皮爾遜相關(guān)系數(shù)

皮爾遜相關(guān)系數(shù)是用來度量?jī)蓚€(gè)等維向量X和Y的相關(guān)程度的方法,其值介于-1到1之間,1表示完全正相關(guān),0表示完全不相關(guān),-1表示完全負(fù)相關(guān)。當(dāng)兩個(gè)向量的皮爾遜相關(guān)系數(shù)大于0.8時(shí)說明兩個(gè)向量相關(guān)性極強(qiáng),否則說明兩個(gè)向量的相關(guān)性較弱。兩個(gè)n維向量X和Y的皮爾遜相關(guān)系數(shù)XY計(jì)算公式如式(6)所示。

式中Xi和Xi表示n維向量X和Y的第i個(gè)元素值,X和Y表示n維向量X和Y的n個(gè)元素的平均值。

2.2 矩陣的相似度定義

對(duì)于兩個(gè)m×n的矩陣A和B, 它們的相似度定義過程如下:

(1)求出矩陣A和B對(duì)應(yīng)的列向量的皮爾遜相關(guān)系數(shù)i(i=1,2,...,n),組成一個(gè)相關(guān)系數(shù)組(=1,2,...,n)。

(2)設(shè)置一個(gè)皮爾遜相關(guān)系數(shù)閾值(0.8<1),通過篩選法得到皮爾遜相關(guān)系數(shù)組中元素值大于或等于閾值的元素個(gè)數(shù)NAB,然后將NAB與相關(guān)系數(shù)組中元素總個(gè)數(shù)N的比值定義為兩個(gè)矩陣A和B在閾值下的相似度PAB()。計(jì)算公式如式(7)所示。

理論分析表明,若閾值設(shè)定過低,則可能會(huì)把不屬于同一張人臉的兩張圖像識(shí)別為屬于同一張人臉,即錯(cuò)誤識(shí)別為正確;同理,若閾值設(shè)定過高,則可能會(huì)把屬于同一張人臉的兩張圖像識(shí)別為不屬于同一張人臉,即正確識(shí)別為錯(cuò)誤,因此需要通過大量的實(shí)驗(yàn)找到最佳的皮爾遜相關(guān)系數(shù)閾值和該閾值約束下的最佳相似度閾值p使得識(shí)別率最大化。

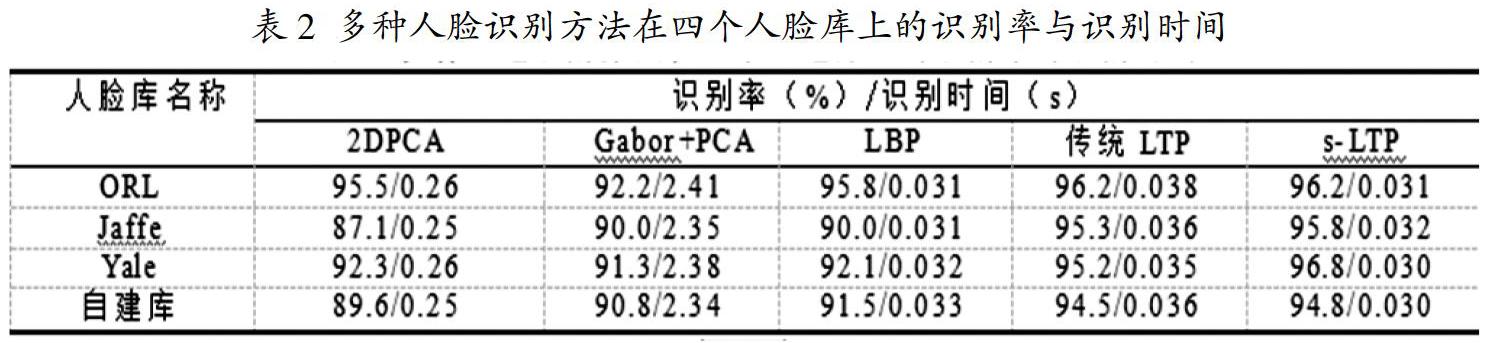

由于相似度值PAB()是隨著皮爾遜相關(guān)系數(shù)閾值動(dòng)態(tài)變化的,因此實(shí)驗(yàn)時(shí)需要設(shè)定合理的閾值梯度(皮爾遜相關(guān)系數(shù)閾值范圍為0.8-1,梯度為0.005,相似度值范圍為0.8-1,梯度為0.01),并根據(jù)同一皮爾遜相關(guān)系數(shù)閾值約束下不同的相似度閾值所對(duì)應(yīng)的識(shí)別率變化曲線來確定最佳的皮爾遜相關(guān)系數(shù)閾值和相似度閾值p。

3 實(shí)驗(yàn)與結(jié)果分析

為驗(yàn)證該相似度匹配方法的性能,找到最佳的皮爾遜相關(guān)系數(shù)閾值和相似度閾值使得識(shí)別率最大化,本文選取了目前常用的ORL、Jaffe、Yale三個(gè)人臉數(shù)據(jù)庫和一個(gè)自己創(chuàng)建的人臉數(shù)據(jù)庫進(jìn)行實(shí)驗(yàn),每個(gè)數(shù)據(jù)庫的60%作為訓(xùn)練集,40%作為測(cè)試集。四個(gè)人臉數(shù)據(jù)庫具體信息如表1所示:

本次實(shí)驗(yàn)的操作系統(tǒng)是windows10(x64),實(shí)驗(yàn)軟件為MATLAB 2016a。實(shí)驗(yàn)分為兩個(gè)部分,一是針對(duì)訓(xùn)練集樣本進(jìn)行實(shí)驗(yàn),找到最佳的皮爾遜相關(guān)系數(shù)閾值和在該閾值約束下的最佳相似度閾值,使得識(shí)別率最大化,并在測(cè)試集上進(jìn)行驗(yàn)證。二是不同的人臉識(shí)別方法的識(shí)別率和識(shí)別時(shí)間的對(duì)比實(shí)驗(yàn)。

3.1 最佳閾值的確定

本實(shí)驗(yàn)中,皮爾遜相關(guān)系數(shù)閾值范圍為0.8-1,梯度為0.005,在每一個(gè)皮爾遜相關(guān)系數(shù)閾值約束下,繪制不同的相似度閾值及其所對(duì)應(yīng)的識(shí)別率變化曲線。實(shí)驗(yàn)結(jié)果如圖2所示,該圖詳細(xì)描繪了在同一皮爾遜相關(guān)系數(shù)閾值約束下的相似度閾值p和識(shí)別率的變化曲線。由圖2可以得出以下結(jié)論:

(1)皮爾遜相關(guān)系數(shù)閾值過高或過低都會(huì)導(dǎo)致最大識(shí)別率降低。

(2)在同一皮爾遜相關(guān)系數(shù)閾值約束下,相似度閾值過高或過低都會(huì)降低識(shí)別率。

(3)當(dāng)皮爾遜相關(guān)系數(shù)閾值設(shè)定為0.88,相似度閾值設(shè)定為0.885時(shí),識(shí)別率可達(dá)到最大值96.8%。

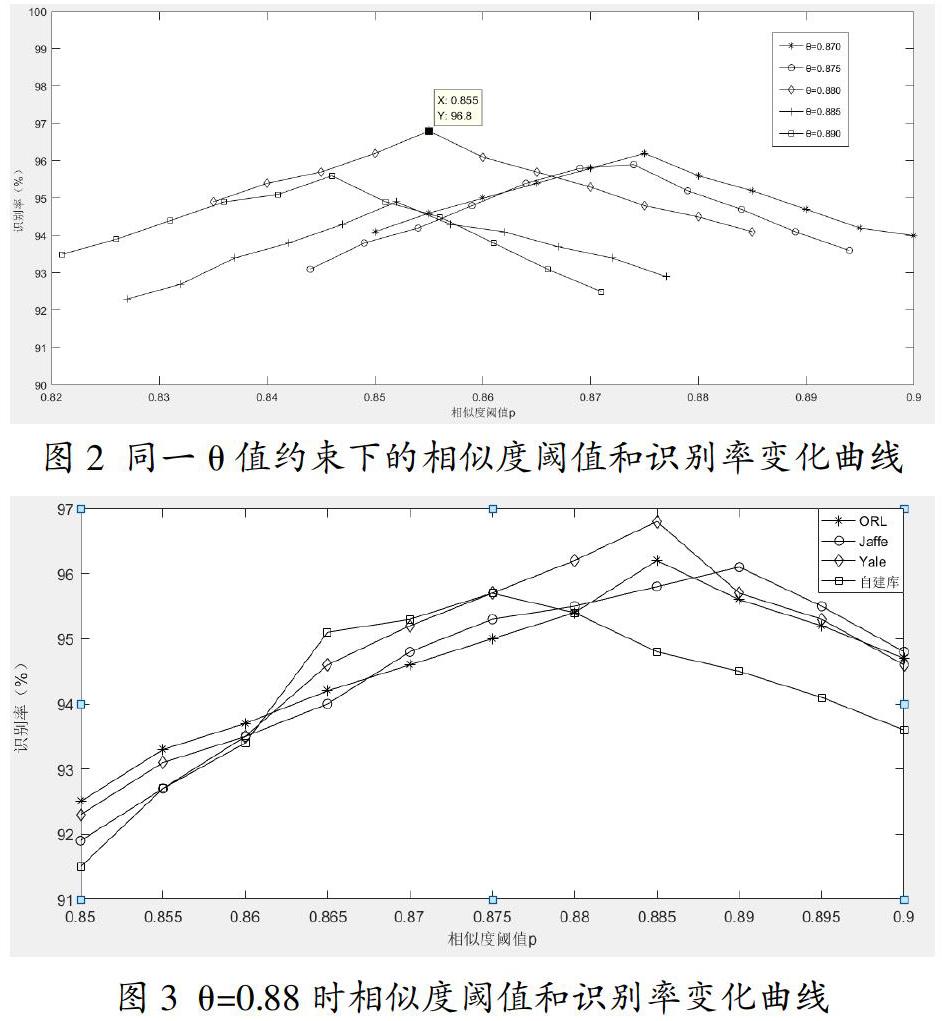

當(dāng)皮爾遜相關(guān)系數(shù)閾值設(shè)定為0.88時(shí),再將相似度閾值的范圍定為0.85-0.90,梯度為0.005,針對(duì)ORL、Jaffe、Yale和自建庫四個(gè)人臉數(shù)據(jù)庫40%的測(cè)試集數(shù)據(jù)進(jìn)行實(shí)驗(yàn),繪制出四個(gè)數(shù)據(jù)庫中相似度閾值與識(shí)別率的變化曲線,該實(shí)驗(yàn)旨在驗(yàn)證最佳相似度閾值設(shè)定為0.885的合理性。實(shí)驗(yàn)結(jié)果如圖3所示。由圖3可以看出當(dāng)皮爾遜相關(guān)系數(shù)閾值設(shè)定為0.88時(shí),相似度閾值設(shè)定為0.885時(shí),可以使得識(shí)別率最大化。

3.2 不同方法的對(duì)比實(shí)驗(yàn)

為驗(yàn)證本文中提出的人臉識(shí)別方法的有效性,該實(shí)驗(yàn)環(huán)節(jié)對(duì)四個(gè)人臉數(shù)據(jù)庫還采用了2DPCA, Gabor+PCA, LBP,傳統(tǒng)LTP這四種方法進(jìn)行實(shí)驗(yàn),得出識(shí)別率與識(shí)別時(shí)間的數(shù)據(jù),并與本文中提出s-LTP方法作比較,實(shí)驗(yàn)結(jié)果如表2所示。該實(shí)驗(yàn)結(jié)果表明,本文中提出的基于s-LTP和相似度匹配的人臉識(shí)別算法相較于其他算法,在不增加識(shí)別時(shí)間的條件下能有效提高識(shí)別率。

4 結(jié)束語

本文中提出的s-LTP算子能兼顧圖像局部與局部、局部與整體的關(guān)系,更加清晰地反映圖像的紋理特征,大大降低了實(shí)驗(yàn)程序的時(shí)間和空間復(fù)雜度。文中創(chuàng)造性的提出了相似度的概念,通過實(shí)驗(yàn)確定最佳的皮爾遜相關(guān)系數(shù)閾值和相似度閾值。對(duì)比實(shí)驗(yàn)的結(jié)果表明,本文中提出的人臉識(shí)別算法在不增加識(shí)別時(shí)間的前提下,能夠極大地提高圖像的識(shí)別率。

同時(shí),本文中也存在一些有待改進(jìn)的地方,例如,在確定兩個(gè)最佳閾值的實(shí)驗(yàn)中,首先通過實(shí)驗(yàn)結(jié)果縮小最佳閾值的區(qū)間,然后在該區(qū)間內(nèi)減小閾值梯度值,進(jìn)一步壓縮區(qū)間。這樣才能得出更加精準(zhǔn)的閾值,進(jìn)一步提高識(shí)別率。

參考文獻(xiàn):

[1]李偉生,王立逗,周麗芳.一種基于LTP自適應(yīng)閾值的人臉識(shí)別方法[J].小型微型計(jì)算機(jī)系統(tǒng),2014,35(09):2099-2103.

[2]唐紅梅,喬帆帆,郭迎春,等.基于改進(jìn)的LTP人臉表情識(shí)別算法[J].電視技術(shù),2016,40(02):127-131.

[3]石京力.基于局部三值模式與極限學(xué)習(xí)機(jī)的微表情識(shí)別[D].河北工業(yè)大學(xué),2015.

[4]鄧燕妮,褚四勇,涂林麗,等.基于均勻k均值和高維局部二值模式的人臉識(shí)別算法[J].控制與決策,2017,32(06):1128-1132.

[5]閆河,王樸,劉婕,等.自適應(yīng)加權(quán)多尺度LTP的人臉識(shí)別[J].計(jì)算機(jī)工程與設(shè)計(jì),2016,37(04):1027-1031.

[6]孫新領(lǐng),張皓,趙麗.結(jié)合LTP紋理特征和改進(jìn)Mean-Shift的視頻目標(biāo)跟蹤方法[J].重慶理工大學(xué)學(xué)報(bào)(自然科學(xué)),2019,33(12):176-183.

[7]張雨.改進(jìn)LBP/LTP算法研究及應(yīng)用[D].西南交通大學(xué),2019.

[8]王睿,馬丹,劉鵬,等.改進(jìn)單演中心對(duì)稱LTP的表情識(shí)別算法[J].計(jì)算機(jī)仿真,2019,36(09):304-308.

[9]張廣世,葛廣英,朱榮華,等.結(jié)合LBP特征和深度學(xué)習(xí)的人臉表情識(shí)別[J].計(jì)算機(jī)測(cè)量與控制,2020,28(02):174-178.