基于改進(jìn)的深度學(xué)習(xí)網(wǎng)絡(luò)的SAR圖像瞬時(shí)海岸線自動(dòng)提取算法

王 彬, 王國(guó)宇

(1.中國(guó)海洋大學(xué)信息科學(xué)與工程學(xué)院, 山東 青島 266100; 2.青島科技大學(xué)信息科學(xué)技術(shù)學(xué)院, 山東 青島 266061)

0 引 言

海岸線同時(shí)受到自然因素和人為因素的影響,具有高度的動(dòng)態(tài)性[1-2]。合成孔徑雷達(dá)(synthetic aperture radar, SAR)是一種主動(dòng)式成像雷達(dá),具有能對(duì)目標(biāo)進(jìn)行全天時(shí)、全天候觀測(cè)的優(yōu)點(diǎn)[3],已經(jīng)成功應(yīng)用于很多領(lǐng)域,例如軍事、農(nóng)業(yè)、地球科學(xué)、海洋資源利用等[4],并且SAR數(shù)據(jù)很適合進(jìn)行海岸線的動(dòng)態(tài)檢測(cè)。《海道測(cè)量規(guī)范》[5]中規(guī)定,海岸線為大潮高潮時(shí)水陸分界的平均痕跡線。SAR圖像中的海岸線為拍攝時(shí)的瞬時(shí)水邊線,無(wú)法保證此水邊線為海岸線,因此本文主要研究SAR圖像瞬時(shí)水邊線的提取。

瞬時(shí)水邊線的提取是海岸線提取的關(guān)鍵一步[6],目前使用較多的方法有閾值分割方法、邊緣檢測(cè)算子方法與數(shù)據(jù)挖掘方法。閾值分割方法[7-9]簡(jiǎn)單有效,但是面對(duì)復(fù)雜的陸地背景時(shí)效果欠佳。邊緣檢測(cè)算子[10-11]對(duì)噪聲敏感,連續(xù)性較差。數(shù)據(jù)挖掘方法[12-14]則是利用了人工神經(jīng)網(wǎng)絡(luò)、聚類分析技術(shù)、支持向量機(jī)等數(shù)據(jù)挖掘的方法自動(dòng)提取海岸線,但是需要一定的人工干預(yù),并不能實(shí)現(xiàn)完全的自動(dòng)提取,且當(dāng)存在陰影或者其他水體時(shí)有一定的虛警。

目前深度學(xué)習(xí)方法在光學(xué)圖像的目標(biāo)檢測(cè)[15-16]、圖像分割[17-18]中取得了巨大成功,但深度學(xué)習(xí)在海岸線提取方面的應(yīng)用較少,而SAR圖像瞬時(shí)水邊線的提取本質(zhì)上是一個(gè)二分類問(wèn)題[1],本文引入深度學(xué)習(xí)分類方法進(jìn)行SAR圖像瞬時(shí)水邊線的端到端自動(dòng)提取。

Long等[19]將傳統(tǒng)的分類網(wǎng)絡(luò)修改為全卷積網(wǎng)絡(luò)(fully convolutional network, FCN),以此實(shí)現(xiàn)對(duì)輸入圖像的端對(duì)端密集分類。FCN的提出極大地推動(dòng)了密集分類的發(fā)展,但存在分類精度不高、對(duì)目標(biāo)邊緣等細(xì)節(jié)信息提取較差的問(wèn)題。后續(xù)提出的網(wǎng)絡(luò)在FCN的基礎(chǔ)上做了許多改變,提高了分類的正確率。文獻(xiàn)[20-21]利用條件隨機(jī)場(chǎng)對(duì)分類結(jié)果進(jìn)行處理,通常作為后處理,或是加入網(wǎng)絡(luò)中進(jìn)行端對(duì)端訓(xùn)練。文獻(xiàn)[20,22]利用空洞卷積提取高分辨的特征圖,減小特征圖中采樣過(guò)程細(xì)節(jié)信息的丟失。文獻(xiàn)[23-24]利用編碼解碼網(wǎng)絡(luò)實(shí)現(xiàn)高分辨率的結(jié)果預(yù)測(cè),編碼網(wǎng)絡(luò)用來(lái)提取圖像的中層與高層特征,解碼網(wǎng)絡(luò)則對(duì)編碼網(wǎng)絡(luò)提取的高層與中層特征進(jìn)行融合與再提取,最終輸出預(yù)測(cè)圖。

本文首先用增強(qiáng)型Lee濾波[25]降低SAR圖像的相干斑噪聲,進(jìn)而用殘差網(wǎng)絡(luò)[26](residual network, ResNet)的升級(jí)版本提取SAR圖像中的目標(biāo)特征;再利用全局卷積網(wǎng)絡(luò)(global convolutional network, GCN)[24]、密集連接網(wǎng)絡(luò)(densely connected network,DenseNet)[27]進(jìn)一步提取目標(biāo)本質(zhì)特征,將水體區(qū)域分割出來(lái);最后再用Sobel算子[28]將邊緣提取出來(lái)得到瞬時(shí)海岸線結(jié)果。

1 基于深度學(xué)習(xí)的海岸線提取算法

1.1 升級(jí)的殘差網(wǎng)絡(luò)

一般而言,在圖像分類中表現(xiàn)很好的網(wǎng)絡(luò)在圖像密集分類中也能具有較高的分類精度,例如FCN中所用的視覺(jué)幾何群(visual geometry group,VGG)網(wǎng)絡(luò)[29-30]以及目前很多編碼解碼網(wǎng)絡(luò)中所用的ResNet[31]等。

在傳統(tǒng)的卷積神經(jīng)網(wǎng)絡(luò)中,網(wǎng)絡(luò)是一層層簡(jiǎn)單堆疊構(gòu)成。He等[31]觀測(cè)到,通過(guò)簡(jiǎn)單地堆疊層并不能提高網(wǎng)絡(luò)性能,層數(shù)過(guò)深時(shí)網(wǎng)絡(luò)性能反而下降,于是提出ResNet,使得卷積神經(jīng)網(wǎng)絡(luò)突破了之前的層數(shù)限制,在深層時(shí)可以獲得更好的表達(dá)能力。與VGG網(wǎng)絡(luò)相比,ResNet的參數(shù)少得多,因?yàn)閂GG網(wǎng)絡(luò)有3個(gè)全連接層,這需要大量的參數(shù),而ResNet用平均池化代替全連接,節(jié)省了大量參數(shù)。

2017年,Xie等[26]提出了ResNet的升級(jí)版本ResNeXt以代替ResNet,取得了更好的分類效果。因此,本文的主干網(wǎng)絡(luò)采用了ResNeXt。該網(wǎng)絡(luò)的主要特點(diǎn)是:網(wǎng)絡(luò)結(jié)構(gòu)簡(jiǎn)明,模塊化;需要手動(dòng)調(diào)節(jié)的超參數(shù)很少;與ResNet相比,相同的參數(shù)個(gè)數(shù),結(jié)果更優(yōu),一個(gè)101層的ResNeXt,和200層的ResNet準(zhǔn)確度差不多,但是計(jì)算量只有后者一半。

1.2 密集連接

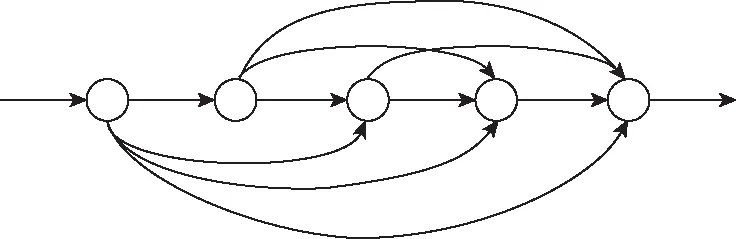

DenseNet[27]是在ResNet的基礎(chǔ)上進(jìn)一步發(fā)展了短連接的思想,在層與層之間引入更多的連接,如圖1所示。DenseNet進(jìn)一步減輕了梯度消失的問(wèn)題,加強(qiáng)了特征的傳播,使得各個(gè)層級(jí)的特征得到充分的利用,從而提高最后分類的精度。

圖1 DenseNet框架

1.3 基于深度學(xué)習(xí)的海岸線提取算法

本文采用分割的方法對(duì)SAR圖像的海水區(qū)域進(jìn)行提取,其中海水分為一類,其他區(qū)域歸為背景一類。將海水分割出來(lái)后,再分離海岸線。首先利用增強(qiáng)Lee濾波對(duì)輸入圖像進(jìn)行預(yù)處理,降低相干斑噪聲影響;然后將預(yù)處理后的圖片輸入到搭建的編碼解碼網(wǎng)絡(luò)中進(jìn)行密集分類,得到最終海水和背景的二值分類圖;進(jìn)而利用Sobel算子分離出海岸線。算法的整體框架如圖2所示。

1.3.1 增強(qiáng)Lee濾波預(yù)處理

為了降低SAR圖像相干斑噪聲對(duì)海岸線提取的影響,本文采用增強(qiáng)Lee濾波抑制噪聲,同時(shí)保證其紋理信息不受破壞。

1.3.2 深度學(xué)習(xí)分類網(wǎng)絡(luò)

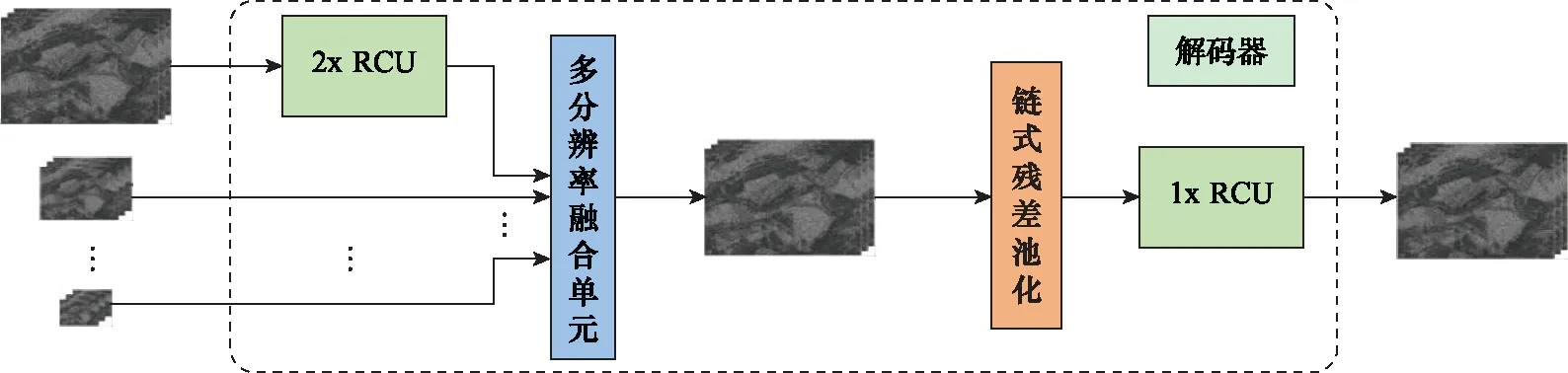

本文所提出的網(wǎng)絡(luò)框架包含編碼網(wǎng)絡(luò)和解碼網(wǎng)絡(luò),具體如圖2所示。

圖2 網(wǎng)絡(luò)的整體框架

(1)編碼網(wǎng)絡(luò)

由ResNeXt主干網(wǎng)絡(luò)構(gòu)成,包括4個(gè)部分:Encoder_1、Encoder_2、Encoder_3和Encoder_4。編碼器通過(guò)編碼網(wǎng)絡(luò)提取輸入圖像的特征,包括從中間層的細(xì)粒度特征到高層的低分辨率語(yǔ)義特征。編碼網(wǎng)絡(luò)以級(jí)聯(lián)的方式搭建。其中,Encoder_x(x=1,2,3)的輸出連接到Encoder_(x+1)(x=1,2,3),編碼塊之間從上往下首尾相連,Encoder_x(x=1,2,3)提取圖像的中低層特征,Encoder_4提取高層特征,且將模塊Encoder_x的輸出連接到模塊Decoder_x的輸入。

(2)解碼網(wǎng)絡(luò)

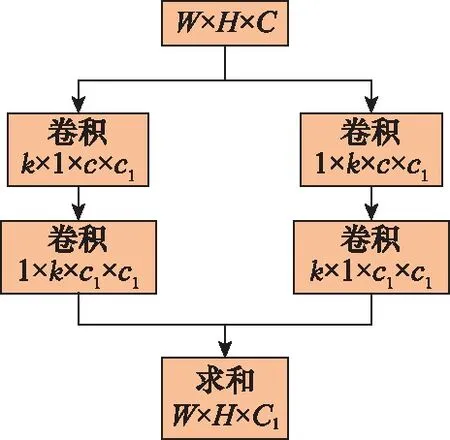

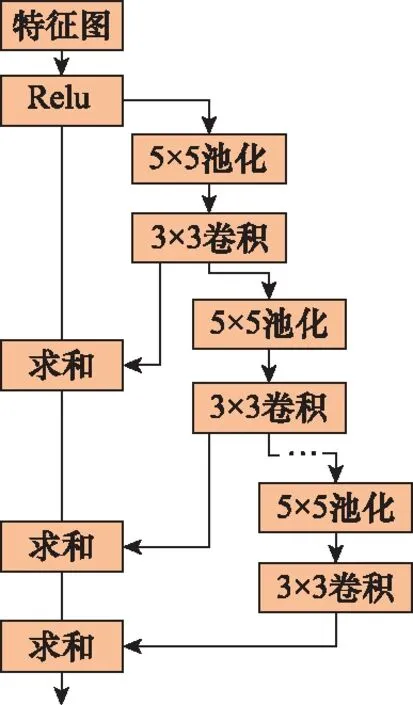

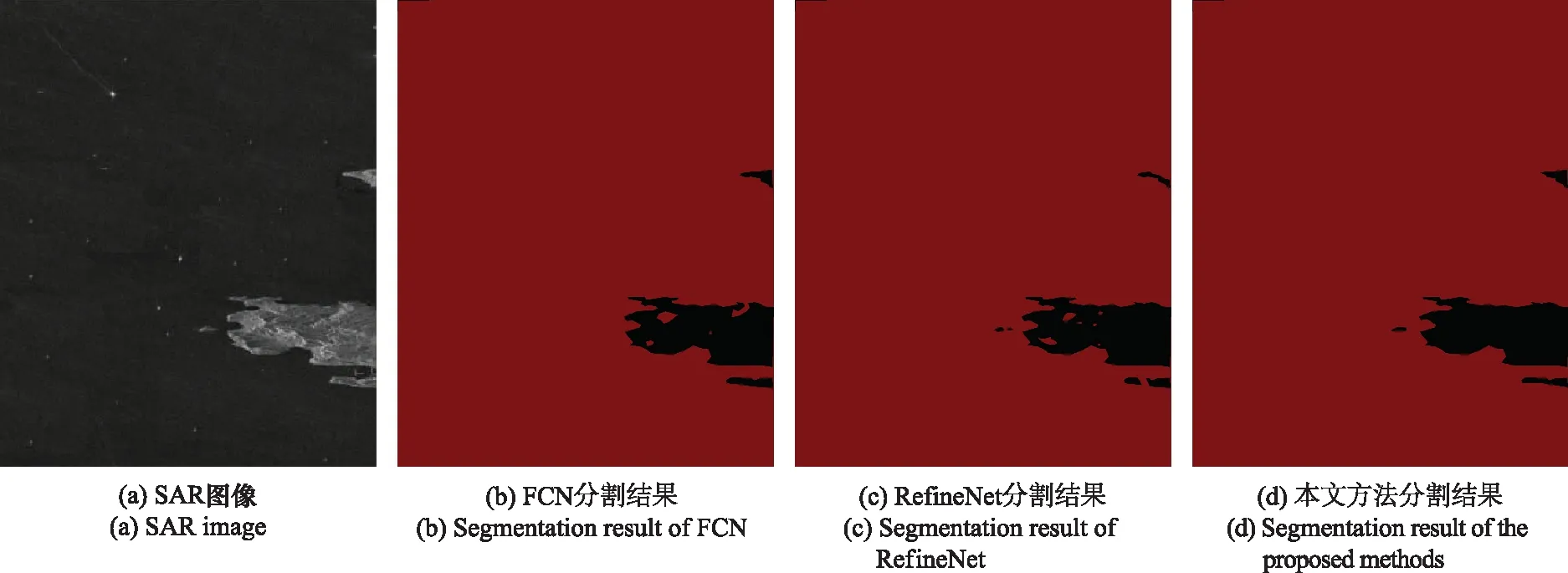

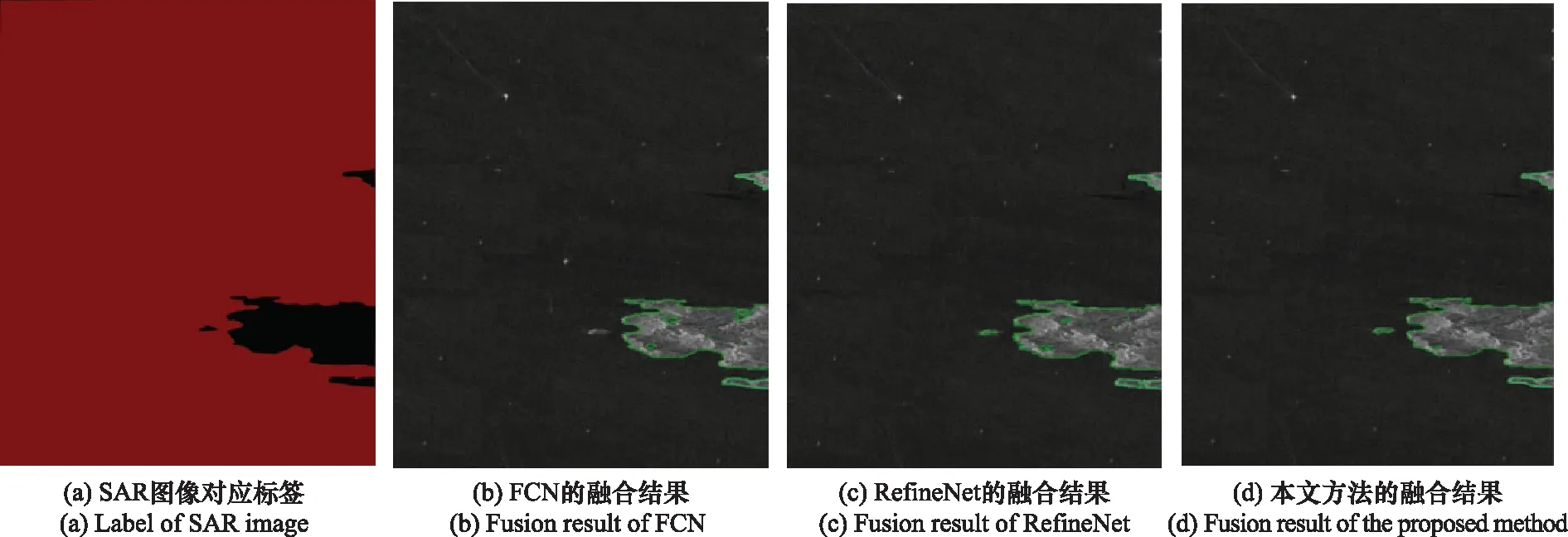

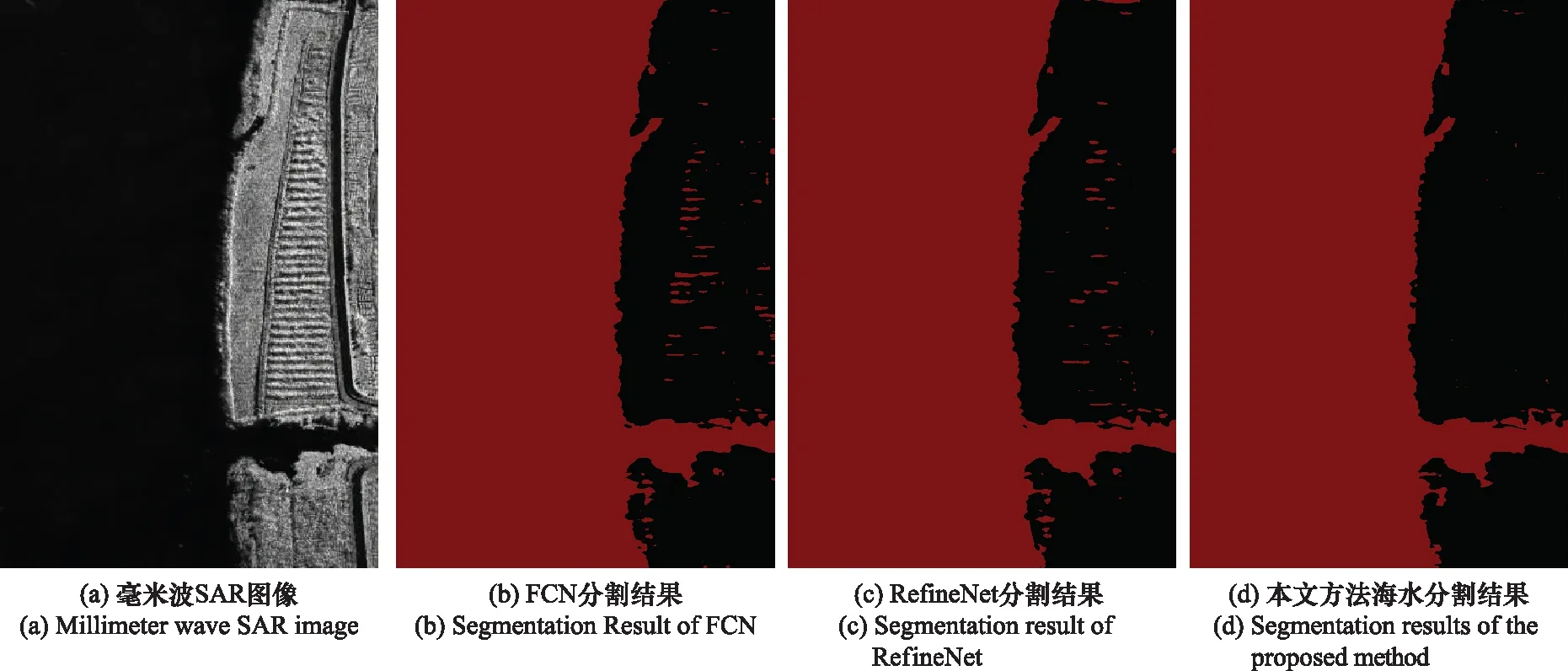

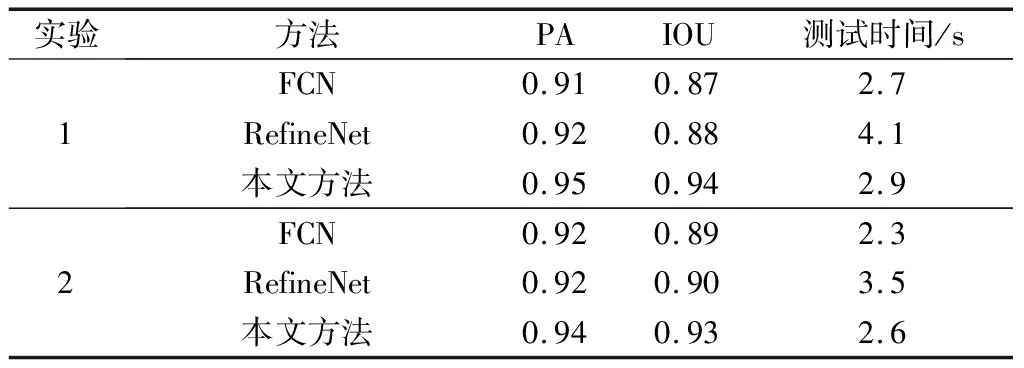

解碼器包括4個(gè)主要的部分:Decoder_1、Decoder_2、Decoder_3和Decoder_4。將每一個(gè)Decoder_x(x=2,3,4)的輸出連接到每一個(gè)模塊Decoder_y(y 解碼模塊的內(nèi)部結(jié)構(gòu)如圖3所示[22]。整個(gè)解碼網(wǎng)絡(luò)由3部分組成:GCN[30]、解碼模塊Decoder_x和密集連接模塊。 圖3 解碼器內(nèi)部結(jié)構(gòu) 全局卷積網(wǎng)絡(luò)由1×k+k×1和k×1+1×k兩個(gè)分離卷積[32]組成。GCN可以在輸入特征圖的一個(gè)k×k大區(qū)域中實(shí)現(xiàn)密集連接,且與普通的k×k卷積核相比,GCN只有O(2/k)的計(jì)算量和參數(shù)數(shù)量。GCN在網(wǎng)絡(luò)中實(shí)現(xiàn)大感受野中的密集連接,可以提高分類結(jié)果的精度,也具有維度匹配的功能。具體結(jié)果如圖4所示。 圖4 GCN內(nèi)部結(jié)構(gòu)示意圖 解碼模塊Decoder_x具有相同的內(nèi)部結(jié)構(gòu),但具有各自獨(dú)立的參數(shù)。模塊由3部分組成:殘差卷積單元(residual convolutional unit, RCU)、多分辨率融合單元和鏈?zhǔn)綒埐畛鼗?chained residual pooling, CRP)。解碼模塊具有多個(gè)輸入,包括編碼網(wǎng)絡(luò)輸出的高分辨率特征圖和之前解碼模塊輸出的低分辨率語(yǔ)義特征,編碼網(wǎng)絡(luò)輸入的特征經(jīng)過(guò)兩個(gè)RCU單元進(jìn)行調(diào)整后與直接輸入的低分辨率語(yǔ)義特征進(jìn)行融合,再經(jīng)過(guò)CRP提取新的語(yǔ)義特征,經(jīng)過(guò)一個(gè)RCU單元調(diào)整后輸入下一個(gè)解碼器或者進(jìn)行最后預(yù)測(cè),其中Decoder_4只有一個(gè)輸入,其他的輸入個(gè)數(shù)分別為2,3,4。 RCU由去除批量歸一化(batch normalization, BN)層之后的RCU組成,主要作用是微調(diào)預(yù)訓(xùn)練的ResNet模型權(quán)重,同時(shí)也可以對(duì)輸入特征進(jìn)行調(diào)整并用于下一步的處理。具體如圖5所示,RCU由兩個(gè)Relu激活函數(shù)和兩個(gè)3×3卷積交叉串聯(lián)搭建,RCU操作后對(duì)輸入特征圖的大小和維度沒(méi)有改變。 圖5 RCU內(nèi)部結(jié)構(gòu) 多分辨率融合單元是解碼模塊第2個(gè)階段,作用是融合編碼器經(jīng)過(guò)調(diào)整的特征和之前解碼器輸出的特征。假設(shè)H×W×C為輸入特征圖的高、寬和通道數(shù),在進(jìn)行不同分辨率特征融合之前,必須保證H、W和C三者的一致。先將編碼器和前一個(gè)解碼器輸入的特征經(jīng)過(guò)一個(gè)3×3卷積實(shí)現(xiàn)通道C的統(tǒng)一,若有密集連接輸入則通過(guò)GCN進(jìn)行維度匹配;然后將所有輸入的低分辨率特征圖使用雙線性插值進(jìn)行上采樣至高分辨率特征圖大小,實(shí)現(xiàn)H×W的統(tǒng)一。 級(jí)聯(lián)池化是解碼模塊的第3個(gè)階段。CRP最早用于在大的圖像區(qū)域中提取背景上下文信息。CRP最大的優(yōu)點(diǎn)是可以對(duì)輸入特征圖進(jìn)行連續(xù)的池化,這樣就可以用一個(gè)5×5的窗口來(lái)獲取大范圍的上下文信息。具體結(jié)構(gòu)如圖6所示,CRP的具體結(jié)構(gòu)由一連串的池化模塊組成,每一個(gè)模塊包含一個(gè)卷積層和一個(gè)最大池化層,后一個(gè)池化層以前一個(gè)池化層的輸出結(jié)果作為輸入,因此后續(xù)的池化層能夠用一個(gè)不大的池化窗口來(lái)處理更大區(qū)域的圖像特征。 圖6 CRP內(nèi)部結(jié)構(gòu) 密集連接模塊是指圖2中解碼器Decoder_x的輸出為每一個(gè)解碼器Decoder_y的輸入,其中x>y。這使得每一個(gè)解碼器可以使用所有之前的高層語(yǔ)義特征,特征得到重復(fù)利用,從某種程度上可以修正之前編碼器出現(xiàn)的錯(cuò)誤。密集連接模塊可以有效地融合不同分辨率的特征,同時(shí)通過(guò)密集連接,使梯度可以在訓(xùn)練時(shí)在各個(gè)解碼模塊間得到有效地傳遞,緩解梯度消失的問(wèn)題。 本文數(shù)據(jù)集使用了兩種數(shù)據(jù),一種是Sentinel-1 SAR圖像,分辨率為5 m×20 m,一共有7張大小為10 000×13 000的圖像;另一種數(shù)據(jù)是分辨率為0.1 m的毫米波數(shù)據(jù),一共選用了10 240×13 050的大場(chǎng)景影像9張。使用Matlab軟件中的Image Labeler進(jìn)行標(biāo)注,共分為背景和海水兩類。將大圖切割成500×500大小的圖像做成數(shù)據(jù)集,一共4 500張切片,訓(xùn)練和驗(yàn)證的比例為4∶1。 圖7展示的是部分Sentinel-1 SAR影像和毫米波影像。由圖7可以看出,毫米波影像的分辨率非常高,細(xì)節(jié)信息得到了體現(xiàn)。 圖7 SAR圖像數(shù)據(jù)集示例 圖8為數(shù)據(jù)集中原圖與標(biāo)簽的示例,其中紅色為海水區(qū)域,黑色為背景區(qū)域。 圖8 數(shù)據(jù)集示例 網(wǎng)絡(luò)訓(xùn)練過(guò)程中,學(xué)習(xí)率和權(quán)重衰減分別設(shè)置為e-5和0.995。編碼與解碼網(wǎng)絡(luò)之間用于維度變換的GCN模塊中,卷積核的尺寸設(shè)置為k=9,c1分別為64、64、64、128。訓(xùn)練過(guò)程中使用500×500的窗口進(jìn)行隨機(jī)滑窗剪裁。 為驗(yàn)證本文方法的有效性,對(duì)本文提出的算法和兩種分割效果很好且應(yīng)用非常廣泛的深度學(xué)習(xí)網(wǎng)絡(luò)進(jìn)行了實(shí)驗(yàn)對(duì)比,這兩種網(wǎng)絡(luò)為FCN[15]和細(xì)化網(wǎng)絡(luò)(refinement network, RefineNet)[23]。分別對(duì)一張Sentinel-1 SAR圖像和一張毫米波SAR圖像進(jìn)行海岸線的提取實(shí)驗(yàn)。測(cè)試的圖片來(lái)源于在訓(xùn)練中未使用的區(qū)域,Sentinel-1的SAR圖片大小為2 058像素×2 556像素,毫米波的SAR圖像為1 191像素×2 464像素。測(cè)試時(shí)先使用幾種算法訓(xùn)練產(chǎn)生的模型對(duì)SAR圖像處理產(chǎn)生海水和背景的分割圖,再對(duì)各自的分割圖采用相同的Sobel算子參數(shù)進(jìn)行邊界分離。 Sentinel-1 SAR圖像的實(shí)驗(yàn)結(jié)果如圖9和圖10所示,圖9為SAR圖像海水分割的結(jié)果,可以發(fā)現(xiàn),FCN網(wǎng)絡(luò)分割的結(jié)果中有很多海水的虛警區(qū)域,尤其是在陸地上有很多陰影區(qū)域也被分成了海水,并且該算法還漏掉了左下角的一小塊陸地。RefineNet網(wǎng)絡(luò)分割的海水區(qū)域虛警相較FCN有所減少,FCN中漏掉的陸地區(qū)域也被分割出來(lái),但仍有不少虛警。而本文算法結(jié)果顯示,陸地上的陰影區(qū)都沒(méi)有被分為海水,沒(méi)有出現(xiàn)虛警,且漏掉的陸地區(qū)域也被找到。海岸線分離后與SAR圖像的融合結(jié)果如圖10所示,可以清楚地看到本文算法在海岸線提取上比另外兩種網(wǎng)絡(luò)性能更優(yōu)。 圖9 Sentinel-1的SAR圖像分割實(shí)驗(yàn)結(jié)果 圖10 Sentinel-1的SAR圖像海岸線提取實(shí)驗(yàn)結(jié)果 高分辨率毫米波SAR圖像的實(shí)驗(yàn)結(jié)果如圖11和圖12所示。從圖11可以發(fā)現(xiàn),FCN網(wǎng)絡(luò)和RefineNet網(wǎng)絡(luò)在進(jìn)行海水分割時(shí)都將陸地上很多小的陰影判定為海水區(qū)域,出現(xiàn)了很多海水虛警。而本文提出的方法則基本上消除了這些虛警區(qū)域,只出現(xiàn)了非常少的零星虛警區(qū)域。圖12(a)為SAR圖像對(duì)應(yīng)的海水標(biāo)簽。將圖11中的分割結(jié)果利用Sobel算子進(jìn)行海岸線分離后,發(fā)現(xiàn)本文方法不但虛警非常少,在海岸線的提取中精度也更高,與實(shí)際海岸線更加吻合。通過(guò)這兩個(gè)實(shí)驗(yàn),可以看到,FCN的處理結(jié)果較粗糙,RefineNet和本文算法可以取得更好的效果,本文算法效果則比RefineNet稍好。FCN存在小塊陰影區(qū)域誤分類為海水,還存在對(duì)小塊陸地的忽視處理。邊緣的粗糙和小目標(biāo)的忽視是因?yàn)镕CN的網(wǎng)絡(luò)結(jié)構(gòu)中缺乏對(duì)中級(jí)特征的利用,如果只利用經(jīng)過(guò)數(shù)次池化后的高級(jí)特征就容易導(dǎo)致丟失小目標(biāo)和邊緣信息。誤分類是因?yàn)镕CN對(duì)特征的上采樣過(guò)程中缺乏對(duì)上下文信息和全局信息的提取。RefineNet和本文算法與FCN的差別在于解碼網(wǎng)絡(luò)的設(shè)計(jì),RefineNet采用逐層將編碼網(wǎng)絡(luò)低層中級(jí)特征融入高層語(yǔ)義特征,同時(shí)提取上下文信息。這是一個(gè)逐層修正分類結(jié)果并且同時(shí)補(bǔ)充細(xì)節(jié)信息的過(guò)程,故RefineNet和本文算法能取得更好的分類結(jié)果。本文算法進(jìn)一步引入密集連接和GCN,能得到更好的訓(xùn)練效果并獲取更多的上下文信息,故能在不同數(shù)據(jù)中取得更好的分類結(jié)果。 圖11 毫米波的SAR圖像分割實(shí)驗(yàn)結(jié)果 圖12 毫米波的SAR圖像海岸線提取實(shí)驗(yàn)結(jié)果 為對(duì)實(shí)驗(yàn)結(jié)果進(jìn)行定量分析,表1給出了兩個(gè)實(shí)驗(yàn)的水體分割像素精度(pixel accuracy, PA)和交并比(intersection over union, IOU),為了評(píng)定本文提出方法的高效性,還給出了圖片測(cè)試時(shí)間對(duì)比。由表1可知,兩個(gè)實(shí)驗(yàn)中PA都可以達(dá)到90%以上,從提取圖中也可以發(fā)現(xiàn),絕大部分水域都能較好地提取出來(lái)。且本文方法比FCN和RefineNet兩個(gè)方法精度更高,水體區(qū)域都能更好地檢測(cè)出來(lái)。兩個(gè)算法的IOU都比本文方法低3至4個(gè)百分點(diǎn),由圖12可以發(fā)現(xiàn),這是因?yàn)槌霈F(xiàn)了很多虛警水體的原因,而本文方法則虛警很少,這也進(jìn)一步驗(yàn)證了本文方法的有效性。 表1 不同方法性能比較 此外,從測(cè)試時(shí)間來(lái)看,FCN的網(wǎng)絡(luò)效率最高,RefineNet花費(fèi)時(shí)間最長(zhǎng),本文網(wǎng)絡(luò)比FCN稍慢,但比RefineNet快很多。本文網(wǎng)絡(luò)和FCN的測(cè)試時(shí)間有0.1 s左右的差距,FCN作為目前分割網(wǎng)絡(luò)的鼻祖,其網(wǎng)絡(luò)結(jié)構(gòu)本身就較為簡(jiǎn)單,因此訓(xùn)練模型參數(shù)較少,測(cè)試時(shí)間最短。RefineNet的測(cè)試時(shí)間是最長(zhǎng)的,由此可以看出,改進(jìn)后的網(wǎng)絡(luò)不僅能對(duì)海岸線進(jìn)行高精度提取,還縮短了圖片處理時(shí)間,真正實(shí)現(xiàn)了高分辨率SAR圖像中海岸線的快速提取。 針對(duì)SAR圖像中海岸線自動(dòng)高精度提取問(wèn)題,本文提出了一種基于深度學(xué)習(xí)的新型網(wǎng)絡(luò)。該網(wǎng)絡(luò)首先用增強(qiáng)Lee濾波來(lái)降低相干斑噪聲;進(jìn)而利用ResNeXt主干網(wǎng)絡(luò)來(lái)提取特征;再結(jié)合GCN、密集連接和分層特征融合進(jìn)一步提取本質(zhì)特征,從而獲取海水分割結(jié)果;最后利用Sobel算子進(jìn)行海岸線分離。通過(guò)對(duì)Sentinel-1和高分辨率毫米波SAR圖像進(jìn)行海岸線提取實(shí)驗(yàn)。結(jié)果表明,本文提出的方法在海岸線提取上比FCN和RefineNet性能更優(yōu),虛警和漏警大大降低;也充分證明了本文方法對(duì)于不同分辨率和不同波段的SAR圖像在海岸線提取中的有效性。

2 實(shí)驗(yàn)結(jié)果與分析

2.1 數(shù)據(jù)集介紹

2.2 實(shí)驗(yàn)參數(shù)設(shè)置

2.3 實(shí)驗(yàn)結(jié)果分析

3 結(jié) 論