基于時(shí)空注意力的社交網(wǎng)絡(luò)信息級(jí)聯(lián)預(yù)測(cè)模型

劉 超,韓 銳,劉小洋,黃賢英

(重慶理工大學(xué) 計(jì)算機(jī)科學(xué)與工程學(xué)院,重慶 400054)

0 引言

微博、微信、Facebook等在線社交平臺(tái)的出現(xiàn),為信息的傳遞與共享提供了巨大的便利,從而促進(jìn)了信息的快速傳播,并因此產(chǎn)生了信息級(jí)聯(lián)現(xiàn)象。這種現(xiàn)象普遍存在于: 論文與博客引用[1-2],電子郵件轉(zhuǎn)發(fā)[3],以及各種社交平臺(tái)推文的轉(zhuǎn)發(fā)(如新浪微博[4]和Twitter[5])中。信息級(jí)聯(lián)預(yù)測(cè)能夠預(yù)測(cè)信息級(jí)聯(lián)的大小和廣度,并可以控制(或加速)各種場(chǎng)景中的信息傳播,可應(yīng)用于企業(yè)的病毒式營(yíng)銷(xiāo)[6]、社交網(wǎng)絡(luò)影響力最大化[7]、媒體定點(diǎn)投放廣告[8]和虛假新聞檢測(cè)[9-10]等領(lǐng)域。因此,信息級(jí)聯(lián)預(yù)測(cè)已成為社交網(wǎng)絡(luò)分析領(lǐng)域的研究熱點(diǎn)。

目前信息級(jí)聯(lián)預(yù)測(cè)方法可歸納為四類(lèi): 基于擴(kuò)散的方法[11-12],基于特征的方法[13],基于生成建模的方法[4]和基于深度學(xué)習(xí)的方法[5,14]。基于深度學(xué)習(xí)的方法是目前預(yù)測(cè)最高效的方法,該方法通常將數(shù)據(jù)通過(guò)嵌入表示學(xué)習(xí)提取節(jié)點(diǎn)的特征,再利用神經(jīng)網(wǎng)絡(luò)自動(dòng)學(xué)習(xí)節(jié)點(diǎn)的特征,最后進(jìn)行預(yù)測(cè)輸出。DeepCas[5]是第一個(gè)基于深度學(xué)習(xí)的信息級(jí)聯(lián)模型,通過(guò)隨機(jī)游走將級(jí)聯(lián)圖轉(zhuǎn)換為節(jié)點(diǎn)序列,并自動(dòng)學(xué)習(xí)各個(gè)圖的表示,然后使用循環(huán)神經(jīng)網(wǎng)絡(luò)學(xué)習(xí)級(jí)聯(lián)的時(shí)序信息。DeepHawkes[4]將級(jí)聯(lián)圖轉(zhuǎn)換為擴(kuò)散路徑,然后使用Hawkes過(guò)程學(xué)習(xí)級(jí)聯(lián)特征,使模型具有高度可解釋性。Topo-LSTM[15]利用動(dòng)態(tài)有向無(wú)環(huán)圖DAG以及每個(gè)節(jié)點(diǎn)生成拓?fù)涓兄那度雭?lái)進(jìn)行預(yù)測(cè)。CasCN[14]模型利用圖卷積[16]網(wǎng)絡(luò)嵌入級(jí)聯(lián)子圖的空間結(jié)構(gòu)信息,再使用循環(huán)神經(jīng)網(wǎng)絡(luò)提取時(shí)序信息,再進(jìn)行輸出預(yù)測(cè)。

雖然上述模型能夠預(yù)測(cè)信息級(jí)聯(lián),但是這些模型對(duì)級(jí)聯(lián)數(shù)據(jù)時(shí)序特征和空間拓?fù)浣Y(jié)構(gòu)利用不全面。文獻(xiàn)[4-5]利用了信息級(jí)聯(lián)的時(shí)序特征,忽略了空間特征;文獻(xiàn)[15]考慮了信息級(jí)聯(lián)的空間拓?fù)浣Y(jié)構(gòu),但卻忽略了時(shí)序信息。文獻(xiàn)[14]因考慮了信息級(jí)聯(lián)的時(shí)序信息和空間拓?fù)浣Y(jié)構(gòu),故實(shí)驗(yàn)效果優(yōu)于文獻(xiàn)[4-5,15],但在捕獲時(shí)序信息時(shí)會(huì)丟失部分空間拓?fù)浣Y(jié)構(gòu),因而對(duì)最終的預(yù)測(cè)精度產(chǎn)生影響。由此可見(jiàn),現(xiàn)有預(yù)測(cè)模型沒(méi)有實(shí)現(xiàn)時(shí)序信息與空間拓?fù)浣Y(jié)構(gòu)的有效耦合,制約了模型的預(yù)測(cè)效果。

針對(duì)以上不足,本文提出一個(gè)端到端的深度學(xué)習(xí)模型,為了有效地捕獲級(jí)聯(lián)信息的時(shí)序和空間拓?fù)浣Y(jié)構(gòu)特征,先捕獲信息級(jí)聯(lián)的空間拓?fù)浣Y(jié)構(gòu),然后在時(shí)序信息的傳播過(guò)程中同時(shí)演變空間拓?fù)浣Y(jié)構(gòu),最后利用注意力機(jī)制將時(shí)序信息和空間結(jié)構(gòu)信息輸出的特征進(jìn)行耦合。因?yàn)榧?jí)聯(lián)圖的大小不同,容易忽略一些邊緣信息,而且各個(gè)邊緣的權(quán)重不一致,導(dǎo)致對(duì)全局結(jié)構(gòu)的嵌入不全面,采用注意力機(jī)制實(shí)現(xiàn)特征耦合,有偏重地提取邊緣特征信息。

本文主要貢獻(xiàn)如下:

(1) 引入了時(shí)空注意力機(jī)制,實(shí)現(xiàn)了級(jí)聯(lián)圖的時(shí)序信息與空間結(jié)構(gòu)信息捕獲后的耦合,使模型適用于不同的圖結(jié)構(gòu)、時(shí)序信息。

(2) 在利用雙向循環(huán)神經(jīng)網(wǎng)絡(luò)捕獲時(shí)序信息的同時(shí),采用圖卷積網(wǎng)絡(luò)捕獲級(jí)聯(lián)信息的空間結(jié)構(gòu)信息,能更好地捕獲時(shí)序特征和空間結(jié)構(gòu)特征。

(3) 提出一種新的面向社交網(wǎng)絡(luò)的信息級(jí)聯(lián)預(yù)測(cè)模型,與傳統(tǒng)基于循環(huán)網(wǎng)絡(luò)的信息級(jí)聯(lián)預(yù)測(cè)模型相比,ICP模型的級(jí)聯(lián)預(yù)測(cè)精度更高。

1 相關(guān)工作

1.1 圖卷積網(wǎng)絡(luò)

圖卷積網(wǎng)絡(luò)(GCN[16])通過(guò)計(jì)算圖的拉普拉斯特征分解,從節(jié)點(diǎn)間的信息傳遞或等效的某些鄰域聚合功能中提取高級(jí)特征再進(jìn)行傅立葉域中的卷積運(yùn)算,提升各種圖任務(wù)的執(zhí)行效果。隨著圖卷積網(wǎng)絡(luò)的發(fā)展,先前的一些工作將圖卷積網(wǎng)絡(luò)應(yīng)用于信息級(jí)聯(lián),利用其特性挖掘級(jí)聯(lián)信息的空間拓?fù)浣Y(jié)構(gòu)信息。在文獻(xiàn)[14,17]中,利用圖卷積網(wǎng)絡(luò)提取級(jí)聯(lián)信息的空間拓?fù)湫畔ⅲ糜陬A(yù)測(cè)信息級(jí)聯(lián)。

1.2 注意力機(jī)制

注意力機(jī)制在許多機(jī)器學(xué)習(xí)任務(wù)中都展示了顯著的效果,如圖像字幕[18]、視頻字幕[19]和機(jī)器翻譯[20]。注意力機(jī)制對(duì)重點(diǎn)關(guān)注鄰域分配更多的注意力資源以獲取更多所需要的特征信息,抑制其他的無(wú)用信息,從而取得更好的效果。文獻(xiàn)[5]中,采用注意力機(jī)制計(jì)算級(jí)聯(lián)序列的權(quán)重,更準(zhǔn)確地預(yù)測(cè)級(jí)聯(lián)信息。文獻(xiàn)[21]采用注意力機(jī)制探索用戶(hù)與用戶(hù)間隱式的級(jí)聯(lián)擴(kuò)散,從而實(shí)現(xiàn)預(yù)測(cè)級(jí)聯(lián)信息。注意力的關(guān)鍵思想是學(xué)習(xí)一組分配注意權(quán)重(將總和求歸一化): 較高(較低)的權(quán)重表示相應(yīng)的功能對(duì)于最終任務(wù)提供較多(較少)的信息。

2 模型介紹

本文提出一個(gè)端到端的深度學(xué)習(xí)面向社交網(wǎng)絡(luò)的ICP模型,采用級(jí)聯(lián)子圖Ci(t)作為輸入,預(yù)測(cè)推文pi在Δt時(shí)間內(nèi)傳播的增量ΔSi。ICP模型由4個(gè)組件組成,首先,從級(jí)聯(lián)圖中對(duì)子圖節(jié)點(diǎn)進(jìn)行采樣并生成鄰接矩陣序列;然后,將觀察時(shí)間窗口內(nèi)的鄰接矩陣序列和級(jí)聯(lián)圖的結(jié)構(gòu)信息輸入到Bi-LSTM網(wǎng)絡(luò);再將Bi-LSTM得到的表示輸入到注意力機(jī)制,耦合時(shí)間序列和空間結(jié)構(gòu)特征,再輸入衰減函數(shù),得到符合時(shí)間衰減效應(yīng)的特征表示;最后,使用全連接層輸出進(jìn)行預(yù)測(cè)。

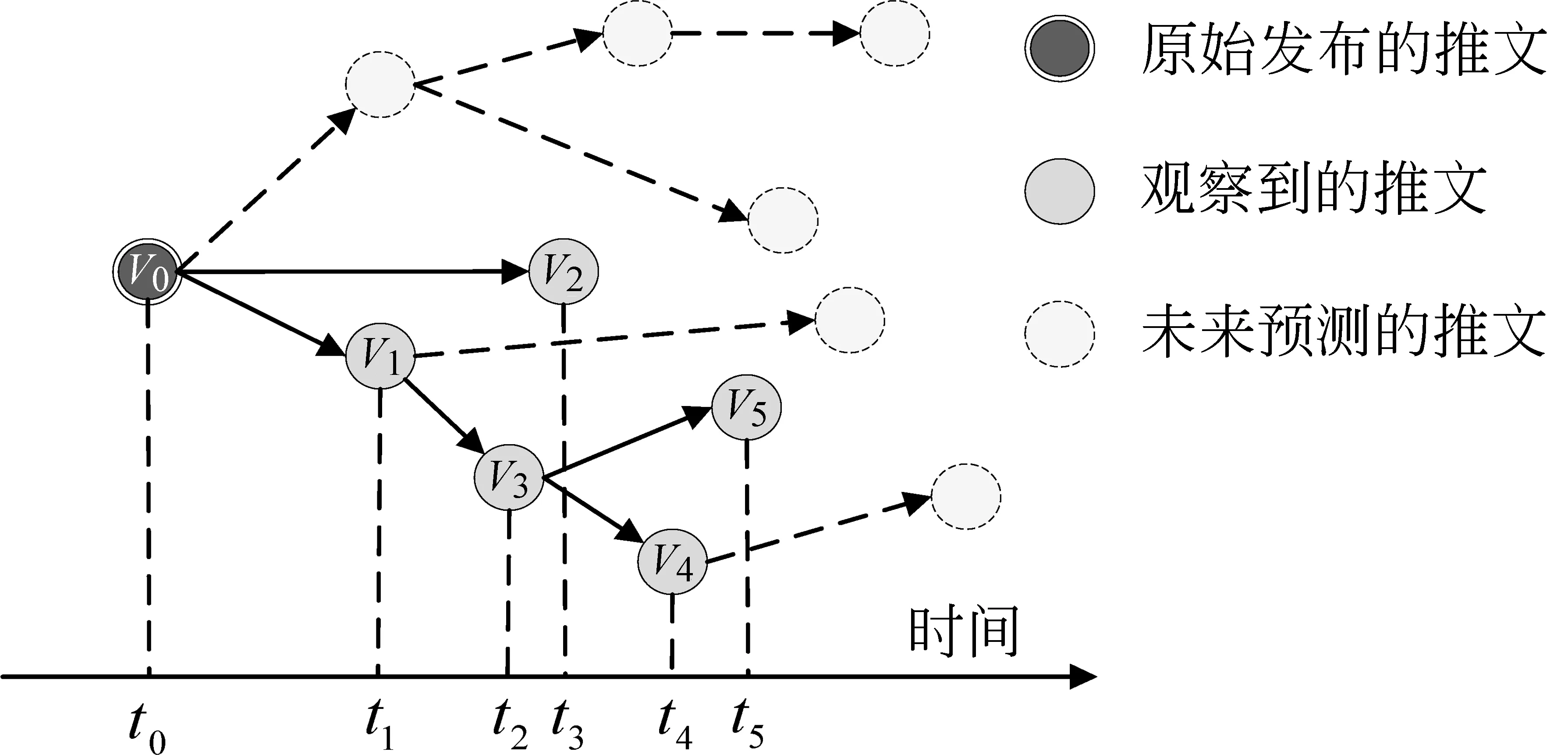

2.1 問(wèn)題定義

圖1 級(jí)聯(lián)圖

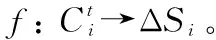

表1 符號(hào)定義表

2.2 節(jié)點(diǎn)嵌入層

推文pi觀察到的級(jí)聯(lián)圖Ci(t),將其表示為鄰接矩陣形式,并為每個(gè)節(jié)點(diǎn)加入自環(huán),如圖2所示。然后根據(jù)級(jí)聯(lián)圖Ci(t)中每個(gè)節(jié)點(diǎn)的到達(dá)時(shí)刻進(jìn)行獨(dú)熱編碼(One-Hot Code)表示節(jié)點(diǎn)特征。將觀察窗口[0,T)劃分為l個(gè)不相交的細(xì)粒度時(shí)間間隔{[t0=0,t1),[t1,t2),…,[tl-1,tl=T)},然后再對(duì)每個(gè)時(shí)間間隔進(jìn)行編碼。

圖2 級(jí)聯(lián)子圖序列的采樣表示

(1)

為了捕獲級(jí)聯(lián)信息在傳播過(guò)程中的空間結(jié)構(gòu)信息,采用圖卷積網(wǎng)絡(luò)來(lái)學(xué)習(xí)嵌入[22]。信息擴(kuò)散過(guò)程類(lèi)似于馬爾科夫過(guò)程,即經(jīng)擴(kuò)散一段時(shí)間后會(huì)收斂于一個(gè)穩(wěn)定的分布,類(lèi)似于分布[23]。因此,設(shè)級(jí)聯(lián)的拉普拉斯矩陣Δc,符合級(jí)聯(lián)圖的隨機(jī)游走特征,設(shè)馬爾科夫狀態(tài)轉(zhuǎn)移概率矩陣P=D-1A,且存在φi={φ1,φ2,…,φn}滿足φTP=φT。根據(jù)圖卷積網(wǎng)絡(luò)[16]公式:

(2)

可得拉普拉斯矩陣Δc:

(3)

其中,D表示級(jí)聯(lián)圖的度矩陣,K表示捕獲的鄰域?qū)訑?shù),

2.3 圖卷積與雙向循環(huán)神經(jīng)網(wǎng)絡(luò)層

圖3 模型框架圖

(6)

(7)

(8)

2.4 注意力機(jī)制

(11)

2.5 輸出預(yù)測(cè)層

先前研究發(fā)現(xiàn),信息級(jí)聯(lián)存在著時(shí)間衰減效應(yīng),即一個(gè)節(jié)點(diǎn)對(duì)其他節(jié)點(diǎn)的影響會(huì)隨著時(shí)間的推移而減小[24]。本文采用非參數(shù)化時(shí)間衰減函數(shù)λf(T-ti),根據(jù)文獻(xiàn)[4]得:

(12)

ICP模型最后一部分是由全連接層(MLP)組成。根據(jù)前面計(jì)算得到的h′t,可計(jì)算出ΔSi,如式(13)所示。

ΔSi=MLP(h′t)

(13)

最終任務(wù)是預(yù)測(cè)指定時(shí)間間隔內(nèi)信息傳播的增量,引入均方對(duì)數(shù)誤差(Mean Square Log-Transformed Error, MSLE),即:

(14)

作為損失函數(shù)loss,使用Adam優(yōu)化器優(yōu)化loss值,使其達(dá)到最優(yōu)(最小)。

算法1 ICP算法

2: repeat3: for鄰接矩陣序列ATi和對(duì)應(yīng)的拉普拉斯矩陣Δci do4: 根據(jù)式(6) ~ 式(8)得ht←Bi-LSTM(*G(ATi,Δci))5: 根據(jù)式(9) ~ 式(11)得hat←Attention(ht)6: 根據(jù)式(12)得h't←Aggregate(λf(T-tji)hat)7: 根據(jù)式(13)得ΔSi←MLP(h't)8: 根據(jù)式(14)得使用Adam優(yōu)化器對(duì)參數(shù)進(jìn)行優(yōu)化9: end for10: until convergence;

3 實(shí)驗(yàn)

3.1 數(shù)據(jù)集

為了評(píng)估ICP模型在信息級(jí)聯(lián)預(yù)測(cè)中的有效性和擴(kuò)展性,本文使用公開(kāi)數(shù)據(jù)集進(jìn)行實(shí)驗(yàn)并與先前的研究進(jìn)行比較。數(shù)據(jù)集的數(shù)據(jù)信息統(tǒng)計(jì)見(jiàn)表2。

表2 數(shù)據(jù)集信息統(tǒng)計(jì)表

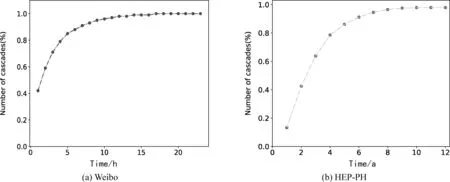

Weibo[4]: 此數(shù)據(jù)集是選取新浪微博在2016年6月1日生成的所有原始帖子,并跟蹤接下來(lái)24小時(shí)內(nèi)每個(gè)帖子的所有轉(zhuǎn)發(fā),總共包括119 313條貼文。圖4(a)顯示了級(jí)聯(lián)大小的分布情況;圖5(a)展示了級(jí)聯(lián)的流行情況,顯示24h后,流行達(dá)到飽和。本文遵循與CasCN[14]相似的設(shè)置,即觀察時(shí)間窗口T=1, 2, 3h。最后,根據(jù)預(yù)處理后的層疊時(shí)間對(duì)層疊進(jìn)行排序,并為層疊選擇前70%的層疊為訓(xùn)練集,剩下的平均分為驗(yàn)證集和測(cè)試集。

HEP-PH[25]: HEP-PH數(shù)據(jù)集(高能物理現(xiàn)象學(xué)數(shù)據(jù)集)來(lái)自電子版arXiv論文引用網(wǎng)絡(luò),數(shù)據(jù)涵蓋了1993年1月至2003年4月(124個(gè)月)期間的論文,其中有34 546篇論文的所有引文。如果論文i引用論文j,則論文引用圖包含從i到j(luò)的有向邊。如果論文引用了數(shù)據(jù)集之外的論文或被其引用,則該圖將不包含有關(guān)此信息。圖4(b)顯示了級(jí)聯(lián)大小的分布情況,圖5(b)展示了級(jí)聯(lián)的流行情況。對(duì)于觀察窗口,選擇T=3, 5, 7a,分別對(duì)應(yīng)流行度達(dá)到最終規(guī)模的50%,60%和70%,如圖5(b)所示。然后,收集70%的級(jí)聯(lián)用于訓(xùn)練,其余平均拆分為驗(yàn)證集和測(cè)試集。

圖4 級(jí)聯(lián)尺寸分布圖X軸為級(jí)聯(lián)大小,Y軸表示不同級(jí)聯(lián)大小對(duì)應(yīng)的數(shù)量

圖5 時(shí)間和級(jí)聯(lián)數(shù)之間的百分比分布

3.2 實(shí)驗(yàn)環(huán)境和參數(shù)設(shè)置

本文所有實(shí)驗(yàn)在Ubuntu 16操作系統(tǒng),Intel Core I9-9980XE CPU,128GB內(nèi)存和NVIDIA TiTan RTX(24GB)顯卡上進(jìn)行。

對(duì)于DeepCas、DeepHawkes、Topo-LSTM和CasCN,參照DeepCas[5]設(shè)置用戶(hù)的嵌入維度是50,循環(huán)神經(jīng)網(wǎng)絡(luò)每層的隱藏單元數(shù)是32,全連接層的隱藏單元數(shù)分別是32和16,用戶(hù)學(xué)習(xí)率為5×10-4,其他學(xué)習(xí)率為5×10-3。每次迭代的批處理大小為32,當(dāng)連續(xù)50次迭代,驗(yàn)證集的loss沒(méi)有下降,模型訓(xùn)練過(guò)程將停止。Weibo數(shù)據(jù)集的時(shí)間間隔設(shè)置為10min,HEP-PH的時(shí)間間隔設(shè)置為2個(gè)月。

本文采用Tensorflow來(lái)實(shí)現(xiàn)ICP模型,并使用Adam優(yōu)化器通過(guò)梯度下降來(lái)優(yōu)化參數(shù)。除圖表示學(xué)習(xí)的嵌入鄰域?qū)硬捎肒=2外,其余模型參數(shù)設(shè)置與上述模型保持一致。

3.3 評(píng)估指標(biāo)

根據(jù)現(xiàn)有的工作,在實(shí)驗(yàn)中選擇標(biāo)準(zhǔn)評(píng)估指標(biāo)——MSLE[見(jiàn)式(14)]來(lái)評(píng)估鏈接準(zhǔn)確性。請(qǐng)注意,MSLE越小,其預(yù)測(cè)性能越好。

3.4 模型對(duì)比

3.4.1 基準(zhǔn)版性能對(duì)比

將用本文所提出ICP模型的基準(zhǔn)版,在真實(shí)的數(shù)據(jù)集上與先前級(jí)聯(lián)預(yù)測(cè)模型進(jìn)行實(shí)驗(yàn)對(duì)比。

DeepCas[5]是第一個(gè)用于信息級(jí)聯(lián)預(yù)測(cè)的深度學(xué)習(xí)體系結(jié)構(gòu),其表示級(jí)聯(lián)圖為一組隨機(jī)行走路徑,并通過(guò)雙向GRU神經(jīng)網(wǎng)絡(luò)通過(guò)管道傳輸,并帶有注意力機(jī)制來(lái)預(yù)測(cè)級(jí)聯(lián)的大小。它主要利用結(jié)構(gòu)和節(jié)點(diǎn)身份的信息進(jìn)行預(yù)測(cè)。

DeepHawkes[4]模型將端到端深度學(xué)習(xí)的預(yù)測(cè)能力集成到Hawkes過(guò)程的可解釋因素中,以進(jìn)行流行度預(yù)測(cè)。深度學(xué)習(xí)方法與級(jí)聯(lián)動(dòng)力學(xué)建模過(guò)程之間的結(jié)合彌合了信息級(jí)聯(lián)預(yù)測(cè)和理解之間的鴻溝。該方法既屬于生成方法又屬于基于深度學(xué)習(xí)的方法。

Topo-LSTM[15]是有向無(wú)環(huán)圖結(jié)構(gòu)(DAG結(jié)構(gòu))RNN,將動(dòng)態(tài)DAG作為輸入,并為DAG中的每個(gè)節(jié)點(diǎn)生成拓?fù)涓兄那度胱鳛檩敵觯瑥亩A(yù)測(cè)下一個(gè)節(jié)點(diǎn)。

CasCN[14]模型結(jié)合了結(jié)構(gòu)和時(shí)間的深度學(xué)習(xí)框架,利用圖卷積網(wǎng)絡(luò)捕獲網(wǎng)絡(luò)空間結(jié)構(gòu)信息,通過(guò)循環(huán)神經(jīng)網(wǎng)絡(luò)合并了時(shí)間衰減函數(shù)實(shí)現(xiàn)時(shí)間信息的更有效利用。該模型是一種深度學(xué)習(xí)的方法。

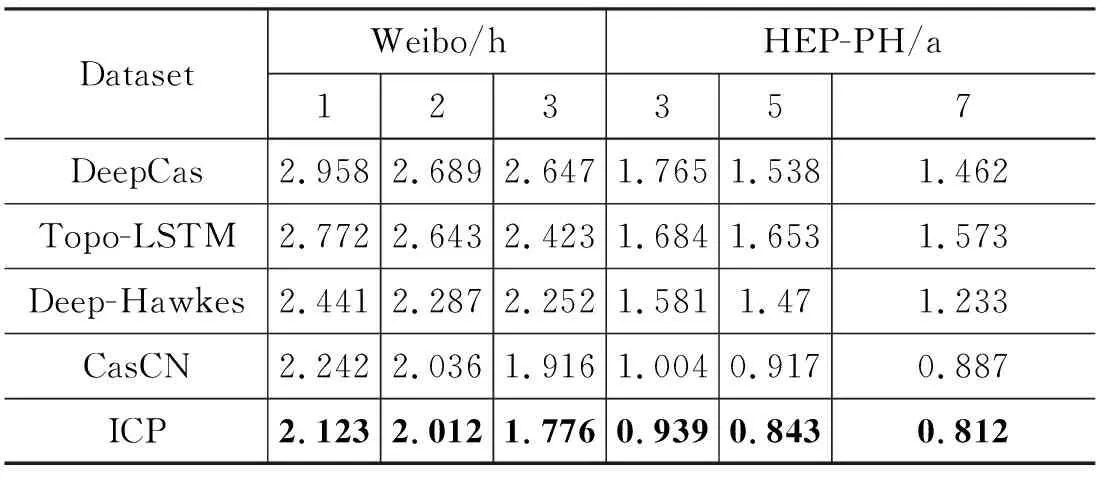

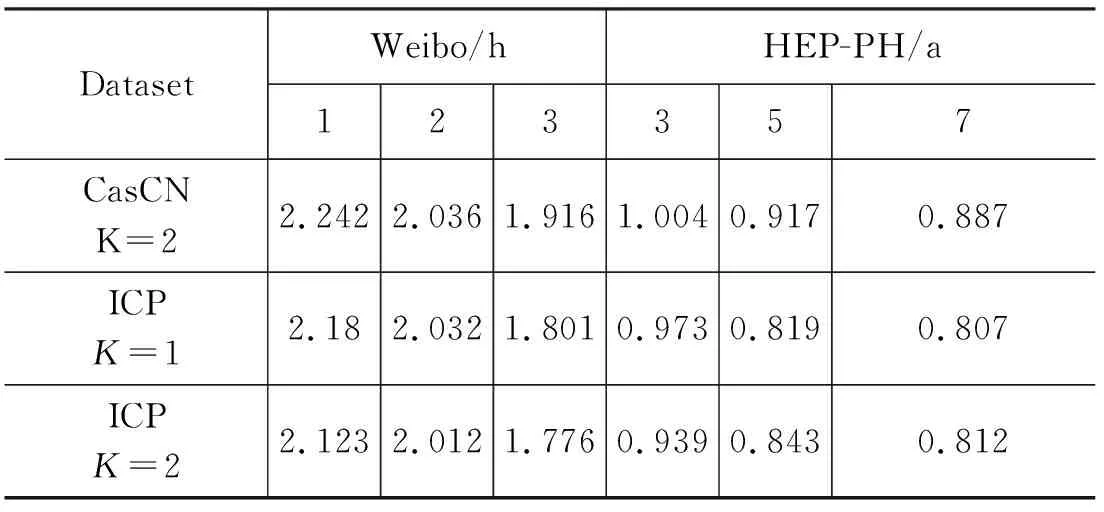

表3總結(jié)了Weibo和HEP-PH數(shù)據(jù)集上ICP模型和其他模型基準(zhǔn)版之間的性能比較。ICP模型與DeepCas對(duì)比,證明僅嵌入節(jié)點(diǎn)作為圖表示是不夠的,不能將圖表示為一組隨機(jī)路徑。因DeepCas未能考慮時(shí)序信息和級(jí)聯(lián)圖的拓?fù)浣Y(jié)構(gòu),導(dǎo)致其性能比其他基于深度學(xué)習(xí)方法要差。Topo-LSTM也缺乏對(duì)時(shí)序信息的處理,導(dǎo)致其性能也較差。DeepHawkes雖然以生成方式對(duì)級(jí)聯(lián)進(jìn)行建模,但由于其學(xué)習(xí)結(jié)構(gòu)信息的能力較弱,因此無(wú)法發(fā)揮最佳性能。CasCN考慮了時(shí)序信息與空間拓?fù)浣Y(jié)構(gòu),但忽略了二者特征之間的融合。最后,本文提出的ICP模型在兩個(gè)數(shù)據(jù)集上的信息級(jí)聯(lián)預(yù)測(cè)(推文轉(zhuǎn)發(fā)和論文引用),效果明顯優(yōu)于其他模型。如在Weibo數(shù)據(jù)集中觀察1、2、3h,MSLE值分別為2.123,2.012,1.776;在HEP-PH數(shù)據(jù)集中觀察3、5、7a,MSLE值分別為0.939, 0.843, 0.812,取得了較好的預(yù)測(cè)效果。與CasCN相比,本文提出的ICP模型預(yù)測(cè)誤差分別降低了5.31%,1.18%,7.31%和6.47%,8.07%,8.46%,從而證實(shí)了模型的有效性。

表3 性能對(duì)比表(MSLE)

3.4.2 時(shí)空注意力對(duì)信息級(jí)聯(lián)的影響

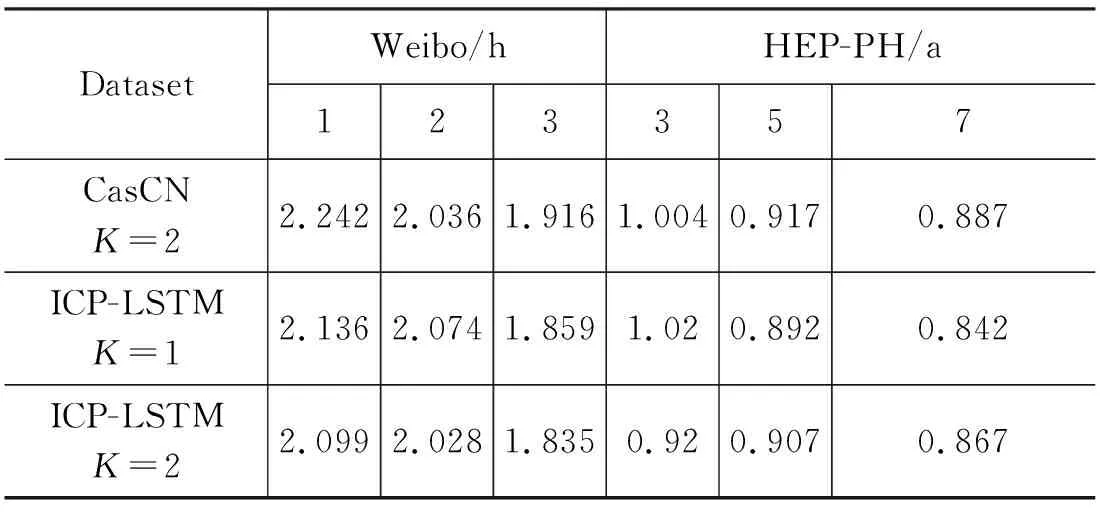

首先驗(yàn)證注意力機(jī)制的有效性,設(shè)計(jì)消融實(shí)驗(yàn)。構(gòu)建一個(gè)ICP的刪減版ICP-LSTM,即將基準(zhǔn)版中的Bi-LSTM替換為L(zhǎng)STM,然后與CasCN進(jìn)行比較,等價(jià)于ICP-LSTM是在CasCN模型的基礎(chǔ)上添加了注意力機(jī)制。在實(shí)驗(yàn)過(guò)程中,二者參數(shù)一致,驗(yàn)證采樣的鄰域?qū)訑?shù)K=1,2時(shí)的實(shí)驗(yàn)效果如表4所示。

表4 注意力機(jī)制影響級(jí)聯(lián)預(yù)測(cè)性能對(duì)比表(MSLE)

表4中給出了嵌入層K=1,2與CasCN模型K=2的性能對(duì)比。根據(jù)表4可以看出,當(dāng)K=2時(shí),本文提出的ICP模型優(yōu)于CasCN模型,這是因?yàn)樘砑恿俗⒁饬C(jī)制,能夠耦合時(shí)序信息與空間結(jié)構(gòu)信息。當(dāng)K=1時(shí),在Weibo中觀察2h,ICP-LSTM的MSLE大于CasCN,是由于K=1,采取的空間結(jié)構(gòu)信息不足,導(dǎo)致結(jié)果略低。

然后,驗(yàn)證時(shí)序信息對(duì)級(jí)聯(lián)預(yù)測(cè)的影響,將ICP的變體ICP-BiLSTM與CasCN進(jìn)行對(duì)比分析(ICP-BiLSTM為本文提出的ICP模型去掉注意力機(jī)制,也等價(jià)于將CasCN模型中LSTM網(wǎng)絡(luò)替換為BiLSTM網(wǎng)絡(luò)所產(chǎn)生的模型)。通過(guò)表5數(shù)據(jù)可以看出,當(dāng)K=2時(shí),Weibo觀察3h的MSLE=1.783和HEP-PH觀察7a的MSLE=0.84,優(yōu)于CasCN的MSLE,從而證實(shí)時(shí)序信息在信息級(jí)聯(lián)中的重要性。

表5 時(shí)序網(wǎng)絡(luò)影響級(jí)聯(lián)預(yù)測(cè)性能對(duì)比表(MSLE)

最后,驗(yàn)證時(shí)序信息和空間信息對(duì)級(jí)聯(lián)預(yù)測(cè)的影響,在CasCN的基礎(chǔ)上使用Bi-LSTM并添加注意力機(jī)制,再調(diào)整嵌入的鄰域?qū)訑?shù)K分別與CasCN進(jìn)行比較。通過(guò)表6的數(shù)據(jù)可以看出,在Weibo和HEP-PH數(shù)據(jù)集上K=1,2時(shí),MSLE值均小于CasCN的MSLE值,表明本文提出的模型優(yōu)于CasCN,對(duì)時(shí)序信息和空間拓?fù)湫畔⒌牟东@更全面,從而提升了模型的效率,降低了損失率。

表6 時(shí)序空間影響級(jí)聯(lián)預(yù)測(cè)性能對(duì)比表(MSLE)

上述實(shí)驗(yàn)表明,時(shí)序信息和空間結(jié)構(gòu)信息對(duì)信息級(jí)聯(lián)預(yù)測(cè)效果有重要影響。二者結(jié)合,能更好地保證預(yù)測(cè)的準(zhǔn)確率。使用注意力機(jī)制耦合二者數(shù)據(jù),使模型對(duì)時(shí)序信息和空間結(jié)構(gòu)信息的捕獲更加全面,也使模型更具有泛化力。

3.5 模型優(yōu)化

本文注意力機(jī)制的主要思想源自于自注意力機(jī)制,可采用比自注意力機(jī)制耦合效果更優(yōu)的方法。例如,可以采用多頭注意力機(jī)制來(lái)替換文中的注意力機(jī)制,提出了ICP的變體ICP-Mhead。表7給出了在相同參數(shù)下CasCN、ICP與ICP-Mhead實(shí)驗(yàn)對(duì)比結(jié)果。可以得出,ICP-MHead模型的MSLE值均小于CasCN模型和ICP模型的MSLE值,表明使用多頭注意力的效果明顯優(yōu)于CasCN模型。因?yàn)槎囝^注意力機(jī)制采用多個(gè)頭部去捕獲特征信息,從而可以捕獲更多的邊緣信息(被忽略的時(shí)序信息和空間拓?fù)浣Y(jié)構(gòu)),使得提取的特征更加全面,故ICP-MHead模型優(yōu)于ICP模型。

表7 多頭注意力機(jī)制影響級(jí)聯(lián)預(yù)測(cè)性能對(duì)比表(MSLE)

3.6 模型收斂性

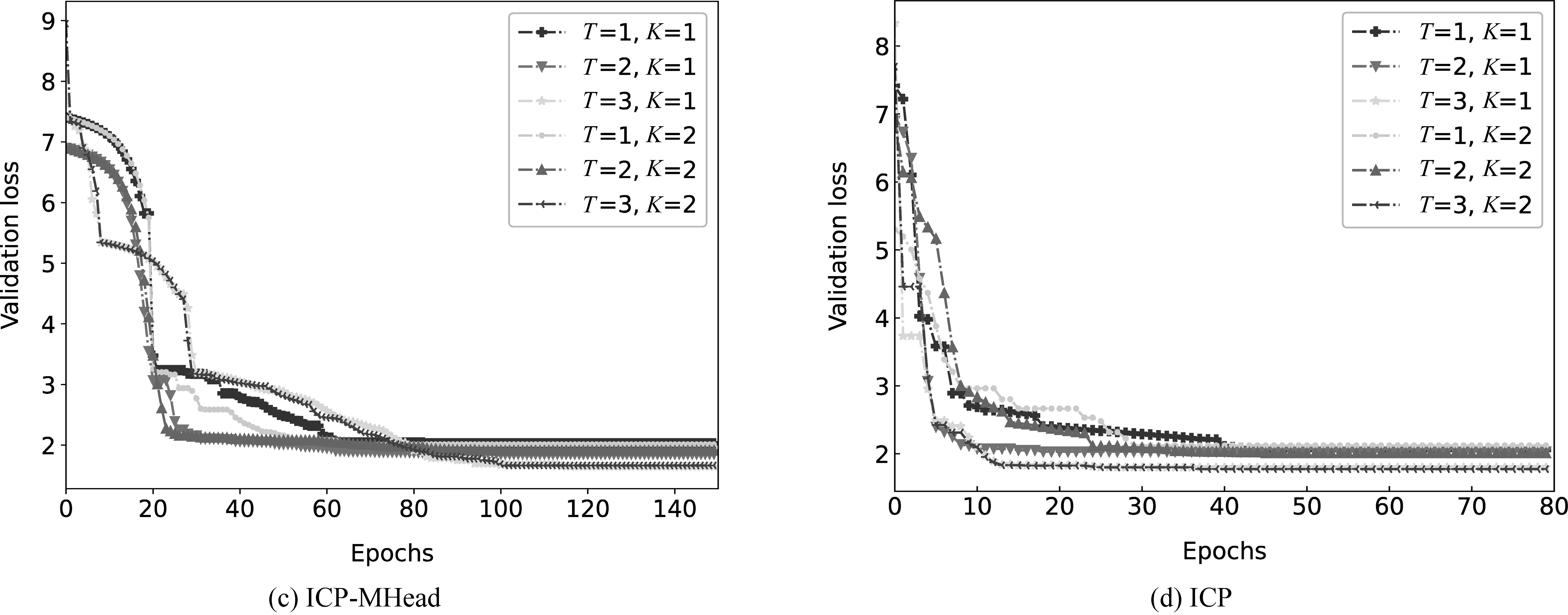

本節(jié)對(duì)ICP-LSTM,ICP-BiLSTM,ICP-MHead與ICP的收斂性進(jìn)行分析,實(shí)驗(yàn)結(jié)果如圖6所示。

圖6中,可以看出,ICP-LSTM經(jīng)過(guò)100輪迭代之后基本擬合,平均用時(shí)約7h;ICP-BiLSTM經(jīng)過(guò)80次迭代之后基本擬合,平均用時(shí)約8h;ICP-MHead經(jīng)過(guò)120輪迭代之后基本擬合,平均用時(shí)約12h。ICP經(jīng)過(guò)50輪迭代之后基本擬合,平均用時(shí)約9h。ICP-MHead與ICP所采用Bi-LSTM和注意力機(jī)制導(dǎo)致訓(xùn)練時(shí)間較長(zhǎng),但模型的預(yù)測(cè)指標(biāo)更高且訓(xùn)練時(shí)間在可接受范圍內(nèi)。

圖6 ICP模型驗(yàn)證集Loss

圖6 (續(xù))

4 總結(jié)

本文提出端到端的深度學(xué)習(xí)ICP模型實(shí)現(xiàn)信息級(jí)聯(lián)預(yù)測(cè)。在深度學(xué)習(xí)框架下,首先利用圖卷積網(wǎng)絡(luò)提取級(jí)聯(lián)信息的空間結(jié)構(gòu)特征,再利用雙向循環(huán)神經(jīng)網(wǎng)絡(luò)提取時(shí)序特征,然后使用注意力機(jī)制耦合空間結(jié)構(gòu)特征和時(shí)序特征,最后,在結(jié)合級(jí)聯(lián)的時(shí)間衰減效應(yīng)進(jìn)一步提高模型的預(yù)測(cè)準(zhǔn)確性。本文在兩個(gè)公開(kāi)數(shù)據(jù)集上進(jìn)行實(shí)驗(yàn),結(jié)果表明,本文提出的基于時(shí)空注意力的社交網(wǎng)絡(luò)ICP模型預(yù)測(cè)精度高于先前的方法。

下一步在空間結(jié)構(gòu)與時(shí)序信息相結(jié)合的基礎(chǔ)上,引入點(diǎn)過(guò)程建模,使得模型更具有可解釋性,提高模型的預(yù)測(cè)能力。