結合注意力機制的多策略漢語語義角色標注

朱 傲,萬福成,*,馬 寧,車郭怡

(1.西北民族大學中國民族語言文字信息技術教育部重點實驗室,甘肅 蘭州 730030;2.西北民族大學甘肅省民族語言智能處理重點實驗室,甘肅 蘭州 730030)

語義角色標注(semantic role labeling,SRL)的目的是識別出句子序列中與核心成分相關的所有論元,例如施事、受事等;為后期進行深層次語義分析的研究提供幫助,同時在自然語言處理的多種應用領域具有廣泛的實用價值.

SRL問題依賴于句法解析,根據句法解析的方式不同,可以分為基于短語結構和基于依存句法的SRL.其中,在依存句法分析中,謂語是核心成分,這點和SRL在一定程度上是相通的,同時依存句法可以表達詞語間的依賴關系,所以相比于短語結構句法分析,依存句法可以為SRL提供更加豐富的語言學信息.2004年,Hacioglu[1]最先基于依存句法對漢語SRL問題進行研究,并且在公共數據集的評測中取得優秀成績.但是當時句法解析精度較低,嚴重限制了模型的標注性能.針對這個問題,Jin等[2]提出只利用高質量的句法分析結果進行漢語SRL的方法,取得一定效果,但是并沒有完全解決SRL對句法解析精度依賴的問題;與此同時,國內學者也基于依存句法分析對SRL展開研究[3-5].雖然取得一定進步,但是并不能滿足當前需求,因此也有許多學者嘗試將更多語言學的線索用于提升SRL的性能.邵艷秋等[6]基于北京大學的漢語語義詞典(CSD),引入了配價數、主客體語義類等詞匯語義特征來進行SRL研究,所有角色標注的總體評價F1值比單純使用句法特征的上升了1.11%;李國臣等[7]將基于同義詞詞林語義資源庫構建新的特征加入條件隨機場(CRF)模型中,新構建的詞林信息特征顯著提高了SRL的性能.上述基于統計機器學習的研究方法,盡管對于特征融合的研究具有深刻的借鑒意義,但均為人工抽取特征,工作繁瑣沉重,抽取出的特征稀疏、模型復雜且易過擬合.

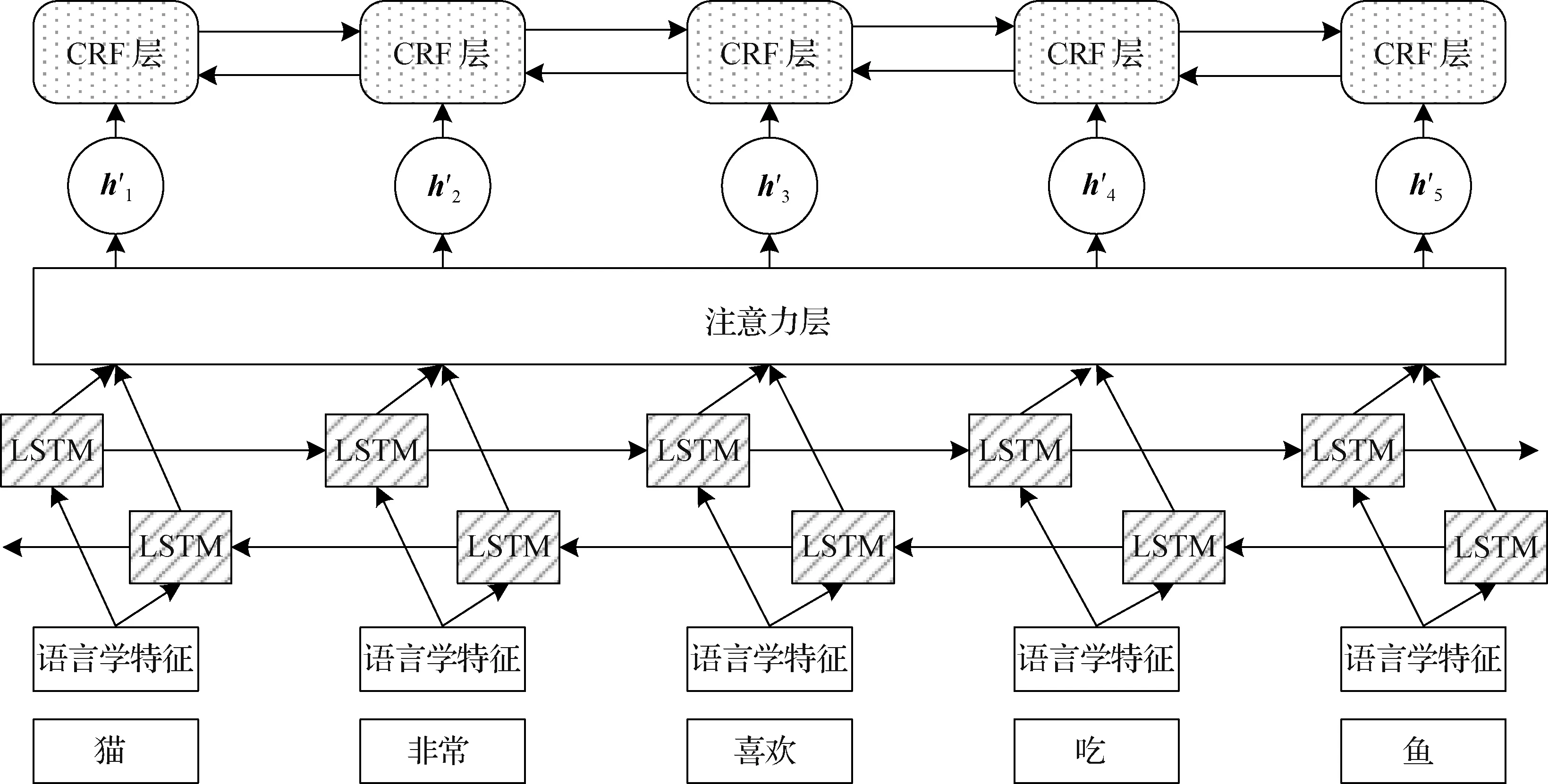

為融合句子中所有詞語相關性的隱藏狀態.圖1 融合注意力機制的SRL模型結構Fig.1 SRL model structure incorporating attention mechanism

隨著深度學習技術的發展以及計算機計算能力的提升,借助神經網絡模型的超強非線性擬合能力,可實現特征信息句子的自動提取,同時模型可以處理更長距離的語義依賴,較好地兼顧上下文信息.利用深度學習方法進行SRL時,通常將其視作序列的標簽分類任務.2008年,Collobert等[8]首次運用簡單的神經網絡進行SRL,隨后,Socher等[9]采用神經網絡單元與樹結構編碼器相結合的方式,Yin等[10]采用卷積神經網絡進行SRL.但上述方法無法解決網絡層數增加所帶來的梯度爆炸現象,而且模型不能很好地理解長句的語義信息.長短時記憶(LSTM)的出現,基本解決了上述問題.Wang等[11]使用雙向LSTM(BiLSTM)模型,在不引入任何其他資源的情況下,取得了當時最好的結果;張苗苗等[12]引入門控機制對詞向量進行調整,同時擴展BiLSTM的深度以獲取更深層次的語義信息,最終F1值可以達到79.53%.但對于SRL任務,相鄰標簽之間具有約束關系,BiLSTM無法學到該關系,不合理標簽被大量預測的現象限制了模型性能的進一步提升.針對這種情況,Huang等[13]提出將BiLSTM和CRF結合,在CRF層引入標簽轉移概率矩陣,專門學習標簽間的約束關系.

近些年,取得較好成績的漢語SRL系統大部分基于BiLSTM-CRF序列標注模型.受到機器翻譯模型中注意力機制的啟發,本文嘗試在BiLSTM-CRF模型中融入注意力機制,模型中添加注意力機制層計算序列中所有詞語的關聯程度,為進一步提升序列標注模型性能,并提出將詞性、依存句法和短語結構句法等多種語言學特征同時融入模型.

1 模型構建

本文模型構建的工作從以下兩點展開:1) 使用自然語言工具包對實驗語料進行語言學特征的擴充;2) 搭建實驗需要的模型.

1.1 特征提取

本文特征提取從基于依存關系和短語結構兩方面入手.對于依存關系特征,借助開源工具包LTP(http:∥www.ltp-cloud.com/)[14]對實驗語料進行依存句法分析,最終解析出16種依存關系.對于短語句法分析,借助開源工具包Berkeley Parser(http:∥code.google.com/p/berkeleyparser/)對實驗使用的原始語料進行成分句法分析,共解析出24種成分句法關系.

1.2 模型結構

本文選取如圖1所示的模型結構作為SRL模型,記為BiLSTM-attention-CRF模型.首先將句子中的詞及其附加特征映射成詞向量送入BiLSTM網絡中;BiLSTM從已標注完成的語料中進行特征提取;然后通過注意力機制融合句中所有詞語信息,生成新的融合全局信息的特征;最后使用CRF,消除非法標簽被預測的現象,提高預測準確率.

1.2.1 輸入層

本文采取預訓練詞向量,在SRL模型訓練的同時對預訓練的詞向量進行微調.首先選取訓練詞向量的語料,訓練語料來源于人民日報;其次根據人民日報語料的特點(數據量較小),選取連續詞袋(CBOW)模型訓練詞向量,詞向量維度為300維;再次根據CPB(Chinese Prop Bank)實驗語料選取出現頻率不低于3次的詞作為CPB詞表.最后根據訓練好的人民日報詞向量,制作CPB詞表,對于在CPB詞表中出現,但不在人民日報詞表中出現的詞,隨機賦予符合正態分布的值.

將句子中的詞以及附加的語言學特征轉換成的詞向量表示拼接送入下一層.

1.2.2 BiLSTM層

(1)

1.2.3 注意力層

注意力層可以生成新的特征,這個特征融合了句子序列中所有詞語的信息,并且根據句子中不同詞語之間的關聯程度不同,分配不同的注意力系數.其訓練過程可以理解為BiLSTM層輸出的隱藏層狀態{h0,h1,…,hn-1}經過注意力層的轉換,生成融合句子中所有詞語相關性的新的隱藏層狀態{h′0,h′1,…,h′n-1},然后將新的隱藏層狀態輸入CRF層.

1.2.4 CRF層

本文實驗語料通過BIOES(beginning-inside-outside-end-singleton)標記方法表達SRL中相鄰標簽之間的聯系,B代表語義角色的開始,I代表語義角色的中間部分,E代表語義角色的結束,S代表單獨一個語義角色,O代表非語義角色部分.例如在本文標注體系中,標簽I-ARG2之前只能是B-ARG2或I-ARG2,而標簽B-ARG2之后只能是I-ARG2、O、B-X或者S-X,其余的標簽都是不應該被預測的.針對這種情況,CRF層通過引入概率轉移矩陣的方式學習到相鄰詞語之間的標簽聯系,提升模型標注性能.即CRF層對句子序列中各標簽的之間的轉移概率進行建模,然后在所有的標簽序列中,選取一條得分最高的路徑作為最優標簽序列.最優標簽序列的得分公式為

(2)

其中,Aij表示標簽i轉移到標簽j的概率,Pij代表句子序列中第i個詞被預測為第j個語義角色的概率,θ是模型中可學習的參數,x是句子序列,y是句子序列對應的標簽序列.對于非法標簽之間的轉移概率初值設為-10 000,表示該路徑不被預測.

2 實 驗

本文實驗以公開的CPB語料集為基礎,對其篩選剔除,建立SRL語料庫作為本文實驗的原始語料;搭建3組模型:BiLSTM、BiLSTM-CRF以及BiLSTM-attention-CRF;在模型訓練階段,依次向語料中添加新特征,逐步對基礎模型進行優化訓練,并進行模型測評,分析對比得到相關實驗結論.

2.1 實驗語料及參數設置

本文實驗采用的CPB數據集,訓練集共有17 821 句,測試集共有1 115句.對實驗語料中句子長度構成進行簡單分析統計,其中組成句子詞語個數大于20個的稱為長句,約占78%;小于20個但大于10個的稱為中長句,約占18%,小于10個詞語的稱為短句,約占4%.實驗模型使用的超參數詞向量維度設為300,隱藏層維度設為200,失活率設為0.5,學習率設為0.001.

2.2 實驗對比

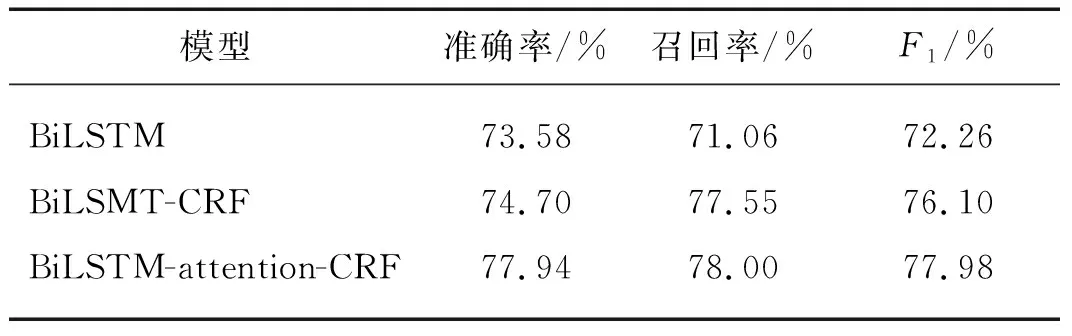

實驗1:測試對比經過基礎語料訓練的3組模型性能.本次實驗使用的語料是在原始語料中添加詞性特征組成的基礎語料.詞性可以幫助模型識別語義角色,例如,名詞在句中大概率作為施事或者受事出現,動詞通常作為核心成分.實驗1的測試結果如表1所示.

表1 基礎語料中3組模型性能的測試對比Tab.1 Comparison of performance test of three groups of models in basic corpus

從表1可以看出,BiLSTM-attention-CRF模型的各項指標均為最優,相對于BiLSTM其準確率、召回率和F1值分別提高了4.36,6.94和5.72個百分點.兩種模型性能有明顯差距.表2為例句“去年實現進出口總值達一千零九十美元”的標注結果.可見,未加入CRF預測標簽時,“去年”的標注結果出錯,而加入CRF預測標簽后,例句的標注結果與正確標簽一致,因此本文接下來的實驗使用加入CRF預測標簽的BiLSTM-CRF和BiLSTM-attention-CRF兩種模型進行對比.

表2 是否加入CRF的標注結果Tab.2 Result with and without CRF annotation

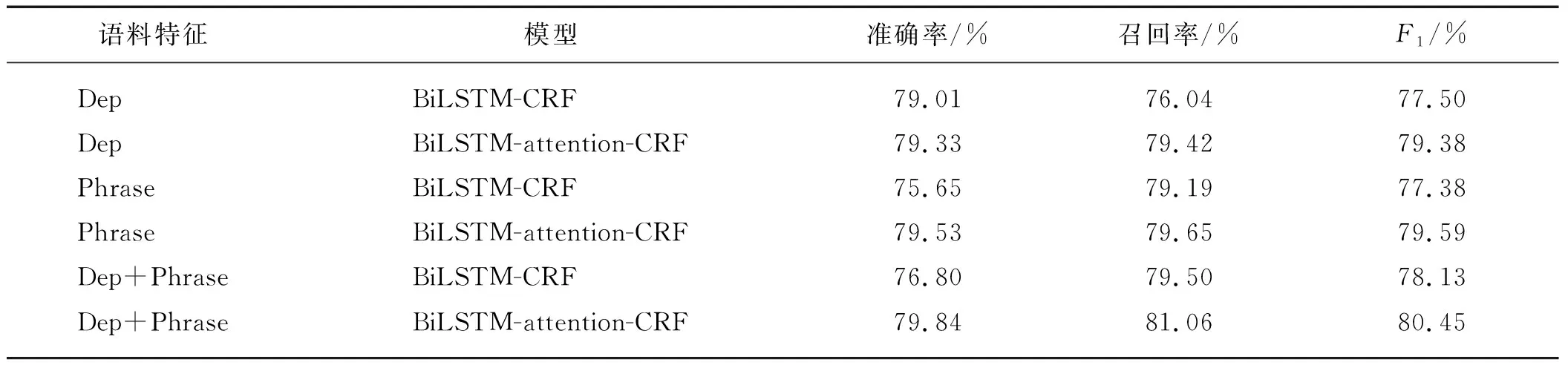

實驗2:在基礎語料中分別添加依存句法特征、短語結構句法特征、依存句法特征+短語句法特征,組成3組訓練語料,測試對比不同的句法結構對模型性能的影響.測試結果如表3所示,其中將依存句法特征簡寫為Dep,短語結構句法特征簡寫為Phrase.

表3 添加不同句法特征的模型性能對比Tab.3 Performance comparison of models with different syntactic features

單獨采用準確率或召回率作為評價指標不能客觀反應模型的綜合性能,F1值同時結合準確率和召回率,能較為客觀地反應模型綜合性能,故本實驗主要通過對測試結果的F1值進行對比分析.分析結果發現,融合3種特征的模型F1值都出現了顯著提升.其中只融合依存句法特征和只融合短語句法結構特征對標注模型的綜合性能提升幅度類似;相比于只融合其中一種特征的模型,融合了依存句法特征+短語句法結構特征的模型F1值提升最大.但是融合兩種特征的模型綜合性能提升幅度放緩,并沒有明顯高于只融合一種句法特征的模型性能.分析可能原因是過多的語言學線索,雖然為模型提供充足的語義信息,同時也降低了模型的收斂能力,訓練難度增加,沒有起到一加一大于二的實驗效果.

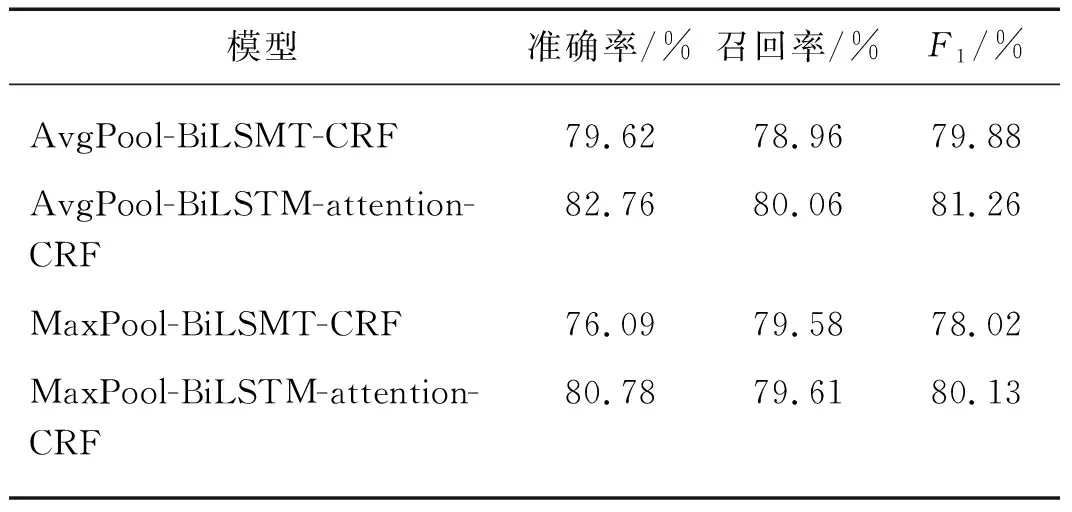

實驗3:為驗證“融合兩種特征的模型綜合性能提升幅度放緩,可能是因過多的語言學線索,增加模型收斂難度”的想法.實驗探索池化后的多特征組是否可以進一步提升模型性能.分別采取平均池化(average pooing,AvgPool)和最大池化(max pooling,MaxPool)對附加的語言學特征組采樣提取,其中池化域大小設為3.表4是不同池化技術對模型性能提升的對比結果.

表4 不同池化技術對模型性能提升對比Tab.4 Comparison of model performance with different pool technologies

實驗結果表明:與表3的結果相比,經過MaxPool采樣提取模型的F1值沒有得到提升,反而略有下降.經過AvgPool采樣提取的模型F1值得到提升.因為相比于MaxPool選取池化域中最大特征,AvgPool對池化域內所有特征求和取平均可以保留更多語言學信息,同時還能減少訓練參數,進一步提升模型性能.另外從F1值來看,該結果比文獻[12]的79.53%高出了1.73個百分點.

3 結 論

本文在基于BiLSTM-attention-CRF模型進行漢語SRL時,嘗試在訓練語料中融入詞性、依存句法特征以及短語結構句法特征,同時嘗試采取池化手段對多特征組采樣.實驗結果表明,模型中融入注意力機制可以顯著提升模型效果,同時通過針對性的添加新特征,還能進一步提升標注準確率.在未來的研究工作當中,將重點探究對詞向量選取的進一步優化以及在模型中融入新的特征.