面向智慧課堂的三位一體化輔助學(xué)習(xí)平臺(tái)

肖 正,朱靖宇,宋 超,劉孝炎,魏鵬程

(湖南大學(xué)信息科學(xué)與工程學(xué)院,湖南 長(zhǎng)沙 410082)

0 引言

隨著互聯(lián)網(wǎng)的迅速發(fā)展和人工智能、大數(shù)據(jù)、云計(jì)算等技術(shù)迅速發(fā)展,傳統(tǒng)課堂教學(xué)已無(wú)法滿(mǎn)足當(dāng)代師生的需求。于是探索信息技術(shù)與教育的深度融合,實(shí)施信息化教學(xué)[1]。學(xué)生上課產(chǎn)生的疑惑不僅僅與學(xué)生的課堂專(zhuān)注度相關(guān),教師的授課水平與知識(shí)點(diǎn)的難易程度也會(huì)影響學(xué)生。因此學(xué)生專(zhuān)注度、教師授課水平和知識(shí)點(diǎn)難易程度三者密切相關(guān)。由于知識(shí)點(diǎn)之間相互聯(lián)系,若學(xué)生困惑知識(shí)無(wú)法被及時(shí)解答,則會(huì)導(dǎo)致其難以聽(tīng)懂授課內(nèi)容。在教學(xué)過(guò)程中,會(huì)產(chǎn)生許多數(shù)據(jù),獲取和分析課堂教學(xué)數(shù)據(jù),可精準(zhǔn)掌握教師授課情況,并且,教師可針對(duì)性地修改授課形式與教學(xué)計(jì)劃。因此,面對(duì)豐富的課堂學(xué)情數(shù)據(jù),如何有效利用和分析數(shù)據(jù)至關(guān)重要。

由于互聯(lián)網(wǎng)學(xué)習(xí)資源繁雜冗余,學(xué)生往往需要花費(fèi)大量時(shí)間尋找針對(duì)性的學(xué)習(xí)資料,降低了學(xué)習(xí)效率。部分教學(xué)資源缺乏趣味性,導(dǎo)致學(xué)生學(xué)習(xí)興趣降低,閱讀積極性不高。面對(duì)海量互聯(lián)網(wǎng)學(xué)習(xí)資源,如何針對(duì)性為學(xué)生推薦風(fēng)格化的學(xué)習(xí)資源,提高學(xué)生學(xué)習(xí)興趣和積極性也是急需解決的問(wèn)題。

1 相關(guān)工作

國(guó)內(nèi)很多高校在課堂教學(xué)方面仍然延續(xù)著傳統(tǒng)教學(xué)手段,課堂智能信息化程度不高。智能技術(shù)的迅速發(fā)展為智慧課堂提供了便利,將傳統(tǒng)課堂改造為智能教學(xué)課堂,應(yīng)用智能化技術(shù)賦能,支持教師精準(zhǔn)化教學(xué),滿(mǎn)足學(xué)生個(gè)性化學(xué)習(xí)。智能教學(xué)課堂可利用人工智能技術(shù)分析課堂的行為狀態(tài);其次基于大數(shù)據(jù)分析學(xué)生聽(tīng)課效率和教師授課效果,以全面了解課堂情況,提高課堂學(xué)情數(shù)據(jù)的利用率;最后利用大量互聯(lián)網(wǎng)學(xué)習(xí)課程,為學(xué)生提供豐富的學(xué)習(xí)資源。

孫曙光等[2]利用微服務(wù)器、云計(jì)算等技術(shù)手段,依據(jù)學(xué)生行為構(gòu)建動(dòng)態(tài)學(xué)習(xí)數(shù)據(jù)分析和云端應(yīng)用智慧課堂信息環(huán)境,實(shí)現(xiàn)教與學(xué)的有效互動(dòng)。劉邦奇[3]通過(guò)創(chuàng)設(shè)智慧型學(xué)習(xí)環(huán)境、基于動(dòng)態(tài)學(xué)習(xí)數(shù)據(jù)的收集和分析,以數(shù)據(jù)化方式呈現(xiàn)學(xué)生學(xué)習(xí)的全過(guò)程及效果,使教學(xué)過(guò)程從依賴(lài)教師的教學(xué)經(jīng)驗(yàn)轉(zhuǎn)向客觀數(shù)據(jù),依靠數(shù)據(jù)精準(zhǔn)掌握學(xué)情,提高教學(xué)過(guò)程中的數(shù)據(jù)分析及資源推送能力。同時(shí),作為科技行業(yè)巨頭的騰訊、百度、科大訊飛等公司對(duì)智慧教育提出了新的解決方案。百度智慧課堂[4]通過(guò)教育大數(shù)據(jù)實(shí)現(xiàn)校園數(shù)據(jù)互通、資源多端同步、學(xué)情智能分析等功能,為師生提供智能化的課堂解決方案。雖然智慧課堂在教學(xué)應(yīng)用中取得了一定的效果,但經(jīng)過(guò)分析調(diào)研表明,還有許多改進(jìn)空間,主要體現(xiàn)在以下2 點(diǎn):

(1)孫曙光等[2-3]缺乏對(duì)學(xué)生、教師授課水平、知識(shí)點(diǎn)難度的綜合分析。學(xué)生對(duì)課堂知識(shí)的掌握情況與教師授課水平和知識(shí)點(diǎn)的難易程度具有關(guān)聯(lián)性,課堂數(shù)據(jù)分析不夠深入,可能會(huì)導(dǎo)致學(xué)習(xí)診斷不準(zhǔn)確。

(2)百度智慧課堂[4]等所包含的互聯(lián)網(wǎng)資源繁雜,缺少針對(duì)性的知識(shí)點(diǎn)和資源推薦,然而提供的學(xué)習(xí)資源與學(xué)生自身需求缺乏相關(guān)性,部分資源枯燥乏味,導(dǎo)致學(xué)生課后學(xué)習(xí)興趣與積極性不高。

基于以上考慮,本文設(shè)計(jì)了基于智慧課堂的三位一體化輔助學(xué)習(xí)平臺(tái),通過(guò)人工智能技術(shù)與課堂結(jié)合,采集和分析整個(gè)教學(xué)過(guò)程的數(shù)據(jù),全面展示課堂授課情況,同時(shí)推薦滿(mǎn)足學(xué)生個(gè)性化需求的學(xué)習(xí)資源,及時(shí)為學(xué)生提供針對(duì)性的答疑解惑。本文的主要工作如下:

(1)考慮到學(xué)生對(duì)知識(shí)點(diǎn)的疑惑程度不僅與自身專(zhuān)注度和教師授課水平有關(guān),而且與課堂知識(shí)點(diǎn)的難易程度具有關(guān)聯(lián)性。通過(guò)基于多任務(wù)卷積神經(jīng)網(wǎng)絡(luò)(Multi-task Convolutional Neural Network,MTCNN)[5]技術(shù)將檢測(cè)的人臉進(jìn)行靜態(tài)表情識(shí)別[6],然后與人眼張合度相結(jié)合判斷學(xué)生上課的專(zhuān)注度。對(duì)于教師生動(dòng)程度的判斷,基于Openpose 模型[7]檢測(cè)教師姿態(tài),通過(guò)教師授課身體擺動(dòng)的幅度對(duì)生動(dòng)度進(jìn)行判斷。最后,在文字識(shí)別中應(yīng)用注意力機(jī)制,精準(zhǔn)識(shí)別教師所述內(nèi)容,準(zhǔn)確無(wú)誤地提取知識(shí)點(diǎn)信息。

(2)由于知識(shí)點(diǎn)之間是相互聯(lián)系的,如果知識(shí)點(diǎn)不能被及時(shí)解答,疑惑知識(shí)堆積,學(xué)生聽(tīng)課難度上升,就會(huì)導(dǎo)致上課效率降低。因此本文基于準(zhǔn)確的學(xué)情分析,為學(xué)生推薦針對(duì)性的學(xué)習(xí)資源,并及時(shí)解答學(xué)生的疑問(wèn)。

(3)基于TextRank[8]算法將學(xué)習(xí)資源內(nèi)容風(fēng)格化,根據(jù)學(xué)生學(xué)習(xí)習(xí)慣、興趣愛(ài)好及場(chǎng)景,生成學(xué)生喜聞樂(lè)見(jiàn)的風(fēng)格化學(xué)習(xí)資源。例如:知識(shí)的摘要生成、圖文并茂、符合學(xué)者文學(xué)風(fēng)格的閱讀內(nèi)容等學(xué)習(xí)資源。

最后,通過(guò)湖南大學(xué)大學(xué)物理課程實(shí)踐調(diào)研表明:模型人臉識(shí)別準(zhǔn)確率達(dá)到99%;文字識(shí)別準(zhǔn)確率達(dá)到92%;學(xué)生的4 個(gè)評(píng)估指標(biāo)中,非常滿(mǎn)意平均占比為31.4%,滿(mǎn)意平均占比為51.9%。學(xué)生普遍認(rèn)為三位一體化的輔助學(xué)習(xí)平臺(tái)效果顯著,針對(duì)性的學(xué)習(xí)資源推薦能夠?yàn)樗麄兲峁W(xué)習(xí)指導(dǎo),減少疑惑知識(shí)點(diǎn),提高聽(tīng)課效率。而且風(fēng)格化學(xué)習(xí)資源能讓學(xué)生輕松愉快的學(xué)習(xí),提高學(xué)習(xí)興趣與積極性。

2 三位一體輔助學(xué)習(xí)平臺(tái)框架

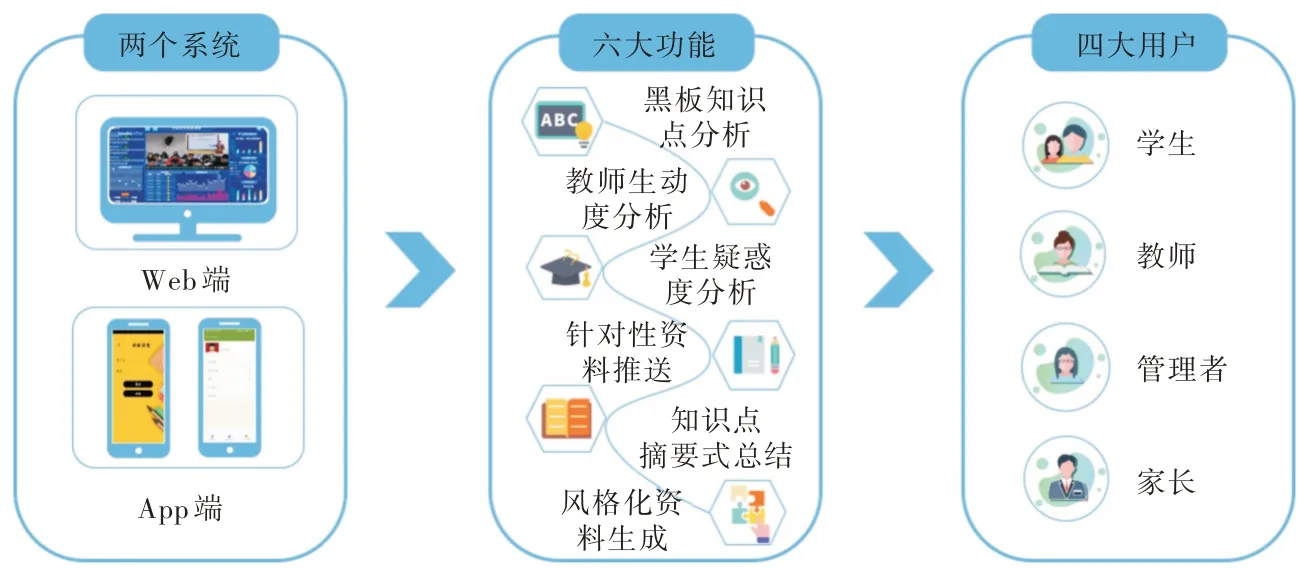

本文中展示了兩大系統(tǒng)智慧課堂系統(tǒng)、APP 資源推薦端和六大功能。其中,包括學(xué)生專(zhuān)注度分析、教師生動(dòng)度分析、黑板紙知識(shí)點(diǎn)提取、針對(duì)性資源推薦、知識(shí)點(diǎn)摘要生成、風(fēng)格化資源生成以及學(xué)生、教師、家長(zhǎng)、管理者四大用戶(hù)。平臺(tái)框架如圖1 所示,具體介紹如下:

(1)學(xué)生專(zhuān)注度分析通過(guò)捕捉學(xué)生表情及人眼張合度分析學(xué)生課堂專(zhuān)注情況。

(2)教師生動(dòng)度分析主要根據(jù)教師鼻子、眼睛、手肘、肩膀等關(guān)鍵點(diǎn)位置擺動(dòng)的幅度進(jìn)行分析判斷。此外結(jié)合多模態(tài)技術(shù),添加姿態(tài)、表情和聲音數(shù)據(jù),以準(zhǔn)確判斷教師生動(dòng)度。

(3)黑板知識(shí)點(diǎn)提取通過(guò)準(zhǔn)確識(shí)別黑板上的文字并結(jié)合知識(shí)庫(kù)提取知識(shí)點(diǎn),并分析知識(shí)點(diǎn)的難易程度。

(4)針對(duì)性資料推送基于課堂三要素作出全面的學(xué)情診斷,然后針對(duì)學(xué)生疑問(wèn),基于知識(shí)圖譜知識(shí)點(diǎn)匹配和推薦,為學(xué)生推薦符合需求的學(xué)習(xí)資源。

(5)知識(shí)點(diǎn)摘要式總結(jié)是風(fēng)格化學(xué)習(xí)資源的一部分,主要將冗余、過(guò)長(zhǎng)的學(xué)習(xí)內(nèi)容,處理成簡(jiǎn)潔明了的摘要文檔供學(xué)生閱讀。

(6)風(fēng)格化學(xué)習(xí)資源生成要考慮學(xué)生的學(xué)習(xí)習(xí)慣、興趣愛(ài)好及所處場(chǎng)景,為學(xué)生生成樂(lè)于接受,符合學(xué)生需求的個(gè)性化學(xué)習(xí)資源。

Fig.1 Framework of learning assistant platform integrating three key elements圖1 三位一體輔助學(xué)習(xí)平臺(tái)框架

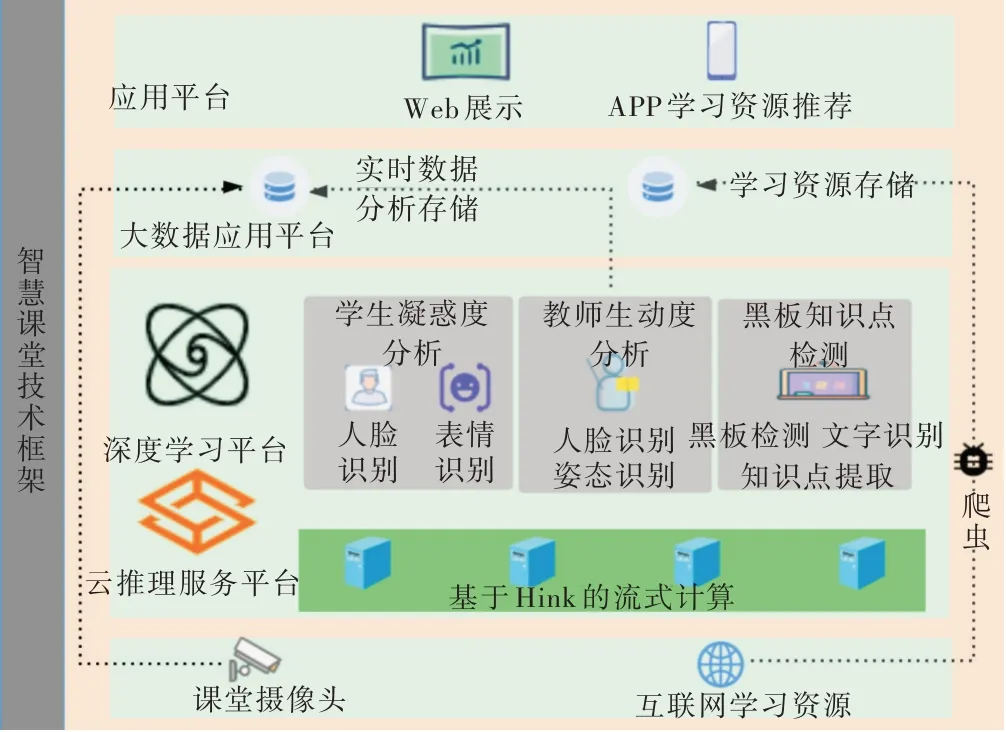

本文所提出的基于智慧課堂的三位一體化輔助學(xué)習(xí)平臺(tái)框架如圖2 所示。該平臺(tái)分為數(shù)據(jù)分析與數(shù)據(jù)服務(wù)兩部分。數(shù)據(jù)分析部分,基于深度學(xué)習(xí)平臺(tái)與InsightFace[9]模型的人臉識(shí)別和基于MTCNN 的靜態(tài)表情識(shí)別模型,結(jié)合改進(jìn)后的文字識(shí)別技術(shù)對(duì)黑板板書(shū)內(nèi)容進(jìn)行識(shí)別及知識(shí)匹配,分析課堂數(shù)據(jù)。同時(shí)基于Flink 流處理引擎加速深度學(xué)習(xí)平臺(tái)的實(shí)時(shí)處理,通過(guò)Web 端動(dòng)態(tài)展示課堂教學(xué)情況。數(shù)據(jù)服務(wù)基于全面的課堂數(shù)據(jù)分析,結(jié)合多標(biāo)簽分類(lèi)、知識(shí)圖譜、推薦算法等技術(shù)為學(xué)生推薦針對(duì)性的風(fēng)格化學(xué)習(xí)資源。

Fig.2 Technology framework of Smart Class圖2 智慧課堂技術(shù)框架

2.1 深度學(xué)習(xí)平臺(tái)

為滿(mǎn)足本文學(xué)生人臉識(shí)別、表情識(shí)別、教師姿態(tài)識(shí)別、黑板板書(shū)內(nèi)容識(shí)別等需求,本文搭載了多個(gè)深度學(xué)習(xí)框架,包括Tensorflow、Caffe、MXNet、Keras、Torch、Pytorch 等及用于人臉識(shí)別的InsightFace 模型、基于MTCNN 的靜態(tài)表情識(shí)別模型、用于教師姿態(tài)識(shí)別的Openpose 模型、基于YOLOV3[10]的黑板檢測(cè)和基于AOA[11](Attention on Attention)注意力機(jī)制的文字識(shí)別模型。提供了從模型開(kāi)發(fā)、訓(xùn)練、部署的完整流程和工具,支持高性能GPU 和分布式訓(xùn)練功能,同時(shí)配備良好的深度學(xué)習(xí)硬件平臺(tái),全面提高AI 應(yīng)用開(kāi)發(fā),滿(mǎn)足開(kāi)發(fā)者對(duì)各模型搭建的需求,為快速融入后續(xù)模型接口提供便利。通過(guò)AI 賦能課堂,分析學(xué)生上課的專(zhuān)注度、教師授課生動(dòng)度和黑板知識(shí)點(diǎn)提取所組成的三要素課堂數(shù)據(jù),產(chǎn)生一體化學(xué)情數(shù)據(jù),為應(yīng)用平臺(tái)提供海量數(shù)據(jù)支撐。

2.2 云推理服務(wù)平臺(tái)

為提高效率,需要對(duì)上課教學(xué)視頻進(jìn)行加速處理,能否實(shí)時(shí)、快速對(duì)學(xué)生進(jìn)行表情識(shí)別、教師姿態(tài)識(shí)別和黑板板書(shū)內(nèi)容識(shí)別則格外重要。但經(jīng)過(guò)深度學(xué)習(xí)訓(xùn)練后模型網(wǎng)絡(luò)結(jié)構(gòu)較深,體積較大,處理數(shù)據(jù)所需時(shí)間較長(zhǎng)。因此,如何快速、準(zhǔn)確處理視頻數(shù)據(jù),縮短處理時(shí)間則成為目前亟待解決的問(wèn)題。選擇使用基于流處理的推理服務(wù)平臺(tái),在智慧課堂中主要負(fù)責(zé)2 方面:①基于Flink 流處理引擎,配合深度學(xué)習(xí)模型緩存和模型劃分、放置策略,綜合降低視頻幀處理延遲;②平臺(tái)負(fù)責(zé)維護(hù)、管理和更新智慧課堂所使用的深度學(xué)習(xí)模型,包括人臉識(shí)別模型、人體姿態(tài)識(shí)別模型、文字識(shí)別模型等,為用戶(hù)提供一體化服務(wù)。本文使用Flink 作為計(jì)算引擎,計(jì)算效率更高,方便系統(tǒng)部署、管理和維護(hù),有效降低了推理延遲。

2.3 大數(shù)據(jù)應(yīng)用平臺(tái)

平臺(tái)通過(guò)融合多標(biāo)簽分類(lèi)與知識(shí)點(diǎn)圖譜技術(shù),實(shí)現(xiàn)學(xué)習(xí)資源分類(lèi),減少人力標(biāo)注成本,提升推薦資料實(shí)用性和相關(guān)性。針對(duì)知識(shí)點(diǎn)在爬取相關(guān)網(wǎng)絡(luò)學(xué)習(xí)資源時(shí),由于知識(shí)點(diǎn)之間具有層級(jí)關(guān)系,學(xué)習(xí)資源分類(lèi)問(wèn)題難以解決,例如物理中“電學(xué)—電流—電荷”三個(gè)標(biāo)簽具有層級(jí)關(guān)系,在為學(xué)生推薦學(xué)習(xí)資源時(shí),如何提高推薦資源實(shí)用性及相關(guān)性則至關(guān)重要。

文本多標(biāo)簽分類(lèi)技術(shù)在智慧課堂系統(tǒng)中應(yīng)用于各學(xué)科學(xué)習(xí)資源的分類(lèi)。首先,構(gòu)建多學(xué)科知識(shí)庫(kù),將各學(xué)科知識(shí)點(diǎn)按照樹(shù)狀結(jié)構(gòu)組合,確定知識(shí)點(diǎn)間的關(guān)系。隨后,將文本形式的學(xué)習(xí)資源歸類(lèi)為樹(shù)狀知識(shí)點(diǎn)結(jié)構(gòu),實(shí)現(xiàn)學(xué)習(xí)資源分類(lèi),減少人力標(biāo)注成本。

對(duì)于知識(shí)圖譜應(yīng)用,旨在通過(guò)建立知識(shí)點(diǎn)數(shù)據(jù)間的關(guān)聯(lián)性形式知識(shí)庫(kù),讓數(shù)據(jù)更容易被人和機(jī)器理解和處理,便于課堂知識(shí)點(diǎn)匹配。同時(shí),構(gòu)建課程知識(shí)之間的關(guān)聯(lián)性圖譜幫助梳理整個(gè)學(xué)科的知識(shí)脈絡(luò),為學(xué)生推薦實(shí)用和相關(guān)性更強(qiáng)的學(xué)習(xí)資源。

3 智慧課堂關(guān)鍵技術(shù)

項(xiàng)目的關(guān)鍵是需要可行性較高的技術(shù)分析課堂三要素。隨著人臉表情識(shí)別、姿態(tài)識(shí)別、文字識(shí)別等研究和深度學(xué)習(xí)模型愈發(fā)成熟,為項(xiàng)目提供了一定的理論基礎(chǔ)和技術(shù)支持。對(duì)于檢測(cè)學(xué)生專(zhuān)注度,首先基于人臉表情識(shí)別模型檢測(cè)學(xué)生基本表情,然后輔助眼睛和鼻子的張合度進(jìn)行矯正;對(duì)于教師生動(dòng)度,基于Openpose 模型以及多模態(tài)技術(shù)分析教師的生動(dòng)度;黑板知識(shí)點(diǎn)基于知識(shí)圖譜匹配知識(shí)點(diǎn);學(xué)習(xí)資源風(fēng)格化則基于TextRank 算法生成簡(jiǎn)潔明了的短文摘要。

3.1 學(xué)生專(zhuān)注度分析

分析學(xué)生上課的專(zhuān)注度,為學(xué)生推薦針對(duì)性的學(xué)習(xí)資源及與該知識(shí)點(diǎn)相關(guān)的學(xué)習(xí)資源,讓學(xué)生多角度、深層次進(jìn)行學(xué)習(xí),減少疑惑知識(shí)點(diǎn)堆積。教師可及時(shí)了解本堂課學(xué)生的上課效率及對(duì)于各知識(shí)點(diǎn)的理解情況,便于教師及時(shí)修改教學(xué)計(jì)劃,提高教學(xué)質(zhì)量。

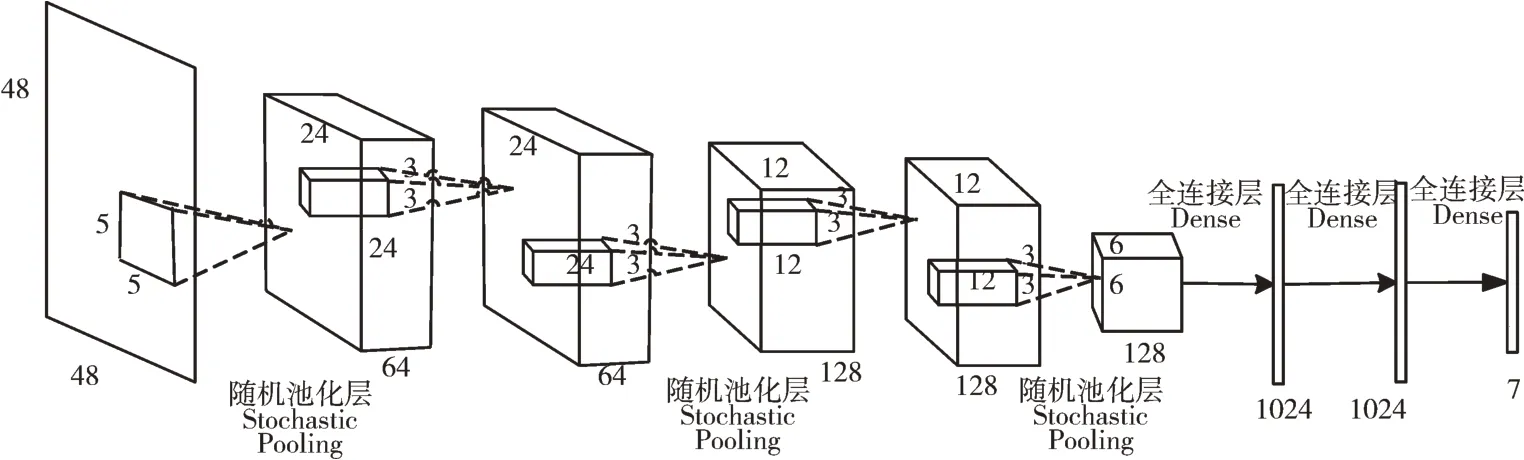

學(xué)生表情識(shí)別使用了Lopes 團(tuán)隊(duì)基于卷積神經(jīng)網(wǎng)絡(luò)的面部表情識(shí)別分類(lèi)器[6],該模型的基本結(jié)構(gòu)如圖3 所示。其中包含了5 個(gè)卷積層,6 個(gè)隨機(jī)池層和6 個(gè)完全連接層,級(jí)聯(lián)了6 個(gè)state-of-the-art 人臉檢測(cè)算法,從而保證人臉檢測(cè)的正確性。此處自適應(yīng)地為每個(gè)網(wǎng)絡(luò)分配不同權(quán)重,即學(xué)習(xí)集合權(quán)重設(shè)置為w。獨(dú)立訓(xùn)練多個(gè)不同初始化的CNN并輸出訓(xùn)練響應(yīng)。在加權(quán)的集合響應(yīng)上定義了訓(xùn)練損失,通過(guò)w優(yōu)化以最小化該損失。在測(cè)試中,學(xué)習(xí)的w也被用以計(jì)算整體測(cè)試響應(yīng),架構(gòu)最后有P 個(gè)Dense,通過(guò)P 個(gè)擾動(dòng)樣本輸出結(jié)果,作為圖像的預(yù)測(cè)值。在本文模型中,為了能在一定程度上實(shí)現(xiàn)數(shù)據(jù)增強(qiáng),將圖像尺寸歸一化、直方圖均衡化并去均值除方差。

Fig.3 Static facial expression recognition model圖3 靜態(tài)表情識(shí)別模型

在課堂環(huán)境下,由于學(xué)生眼睛的張合度與其上課狀態(tài)密切相關(guān),如果僅通過(guò)基本表情評(píng)判學(xué)生專(zhuān)注度分析結(jié)果,準(zhǔn)確度不高,可將人眼張合度納入學(xué)生專(zhuān)注度狀態(tài)評(píng)價(jià)指標(biāo)之一。由于人眼呈現(xiàn)橢圓狀,為了方便圖形處理將眼睛面積視為長(zhǎng)方形,張合度為人眼長(zhǎng)方形中寬度和長(zhǎng)度的比值,比值越大則表示越專(zhuān)注。但在實(shí)際訓(xùn)練中,課堂學(xué)生較為密集,單張人臉?lè)直媛瘦^低,人眼面積更小,故考慮使用雙眼和鼻子3 個(gè)關(guān)鍵點(diǎn)的角度關(guān)系代替眼睛張合度評(píng)價(jià)指標(biāo)。

經(jīng)過(guò)數(shù)據(jù)處理發(fā)現(xiàn)可知,鼻子的位置相對(duì)固定。在攝像頭位置不變的情況下,學(xué)生抬頭、低頭、側(cè)身等動(dòng)作都會(huì)影響實(shí)際截取人臉中雙眼和鼻子的角度關(guān)系。例如若學(xué)生低頭,則監(jiān)控?cái)z像截取人眼面積較小,鼻子位置相對(duì)較高,造成夾角C 相對(duì)較大;若學(xué)生抬頭,攝像頭截取人眼面積仍然較小,鼻子位置相對(duì)不變,夾角C 也會(huì)變大;若學(xué)生側(cè)臉,則某一只眼睛和鼻子的距離就會(huì)變小,從而導(dǎo)致夾角C 變大。如圖4 所示,采取三點(diǎn)檢測(cè)法可大幅度降低計(jì)算量,并提升系統(tǒng)疑惑度分析的準(zhǔn)確度。

通過(guò)分析已有數(shù)據(jù),將角度C 的閾值設(shè)置為66°最為適合,則夾角余弦的閾值為0.41,大于0.41 則可判定為專(zhuān)注狀態(tài),否則為不專(zhuān)注狀態(tài)。

最后本模塊結(jié)合專(zhuān)注度評(píng)判準(zhǔn)則修正最基本的靜態(tài)表情判斷。若情緒判斷為疑惑狀態(tài)且眼鼻關(guān)鍵點(diǎn)角度正常,則修正為正常狀態(tài);若眼鼻關(guān)鍵點(diǎn)異常,則仍然為疑惑。若情緒判斷為正常且眼鼻關(guān)鍵點(diǎn)角度正常,則為專(zhuān)注,否則為正常態(tài)。最終的結(jié)果以正常、專(zhuān)注、疑惑三種狀態(tài)呈現(xiàn)。

Fig.4 Eye and nose angle evaluation圖4 人眼鼻子角度評(píng)價(jià)

3.2 教師生動(dòng)度分析

在課堂上,教師的行為狀態(tài)包含了許多信息,例如從教師的授課語(yǔ)氣、授課姿態(tài)變化中,可反應(yīng)當(dāng)前所講知識(shí)點(diǎn)的重要程度,這些信息可用來(lái)輔助智慧課堂的建設(shè)。

如圖5 所示,OpenPose[7]人體姿態(tài)識(shí)別是美國(guó)卡耐基梅隆大學(xué)基于卷積神經(jīng)網(wǎng)絡(luò)和監(jiān)督學(xué)習(xí)并以caffe 框架開(kāi)發(fā)的開(kāi)源庫(kù)。可實(shí)現(xiàn)人體動(dòng)作、面部表情、手指運(yùn)動(dòng)等姿態(tài)估計(jì),適用性廣泛,具有極高的魯棒性。針對(duì)教師姿態(tài),采用OpenPose 模型能滿(mǎn)足項(xiàng)目的基本需求,對(duì)教師鼻子、眼睛、肩膀、耳朵等關(guān)鍵點(diǎn)進(jìn)行檢測(cè)識(shí)別,根據(jù)每一幀關(guān)鍵點(diǎn)的位置,采用歐氏距離計(jì)算相似度以計(jì)算教師授課的生動(dòng)度。

Fig.5 Openpose model structure diagram圖5 Openpose 模型結(jié)構(gòu)

計(jì)算教師動(dòng)作相似度方法參考KNN[12]分類(lèi)算法,使用類(lèi)似于基于距離圖像相似性度量方法進(jìn)行分類(lèi)或匹配。由于輸入視頻幀的大小不一致,視頻幀中人的大小也不一致,因此需要?dú)w一化處理不同大小視頻幀中大小不一人的相似度計(jì)算值。之后,針對(duì)教師姿態(tài)、表情及上課語(yǔ)音,利用多模態(tài)技術(shù)對(duì)三者數(shù)據(jù)進(jìn)行模態(tài)融合,對(duì)最終結(jié)果進(jìn)行判斷從而輔助建設(shè)智慧課堂。

3.3 黑板知識(shí)點(diǎn)提取

知識(shí)點(diǎn)的難易程度因人而異,難度越大的知識(shí)點(diǎn),學(xué)生的疑問(wèn)也隨之越多。因此,需要針對(duì)疑問(wèn)知識(shí)點(diǎn)為學(xué)生推薦學(xué)習(xí)資源。目前考慮基于深度學(xué)習(xí)技術(shù)提取黑板的板書(shū)內(nèi)容,接著對(duì)數(shù)據(jù)進(jìn)行清洗、切詞和去停用詞操作,對(duì)比分析處理后的數(shù)據(jù)與已有知識(shí)點(diǎn),生成詞頻矩陣。最后,計(jì)算二者的余弦相似度,將余弦值大于一定閾值且與原知識(shí)點(diǎn)庫(kù)對(duì)比后不存在的知識(shí)點(diǎn)插入知識(shí)點(diǎn)庫(kù)中。

CTPN[13](Connectionist Text Proposal Network)是 一 種將CNN 和LSTM(Long Short-Term Memory,LSTM)結(jié)合的深度神經(jīng)網(wǎng)絡(luò),能有效檢測(cè)復(fù)雜場(chǎng)景中橫向分布的文字。但課堂環(huán)境特殊,受到光照、中文字符較多、識(shí)別圖像的分辨率等因素影響,導(dǎo)致CTPN 在課堂環(huán)境下檢測(cè)效果一般,識(shí)別率不高。同時(shí),由于注意機(jī)制廣泛應(yīng)用于編碼、解碼器框架中,在每個(gè)時(shí)間步長(zhǎng)生成編碼向量加權(quán)平均值以指導(dǎo)解碼過(guò)程。但解碼器幾乎無(wú)法查詢(xún)向量與輸入向量是否相關(guān),因此可能會(huì)使解碼器產(chǎn)生誤導(dǎo)。為了解決上述問(wèn)題,通過(guò)引入“Attention on Attention”(AoA)模塊擴(kuò)展常規(guī)的注意力機(jī)制,以確保注意力結(jié)果和查詢(xún)之間的相關(guān)性。

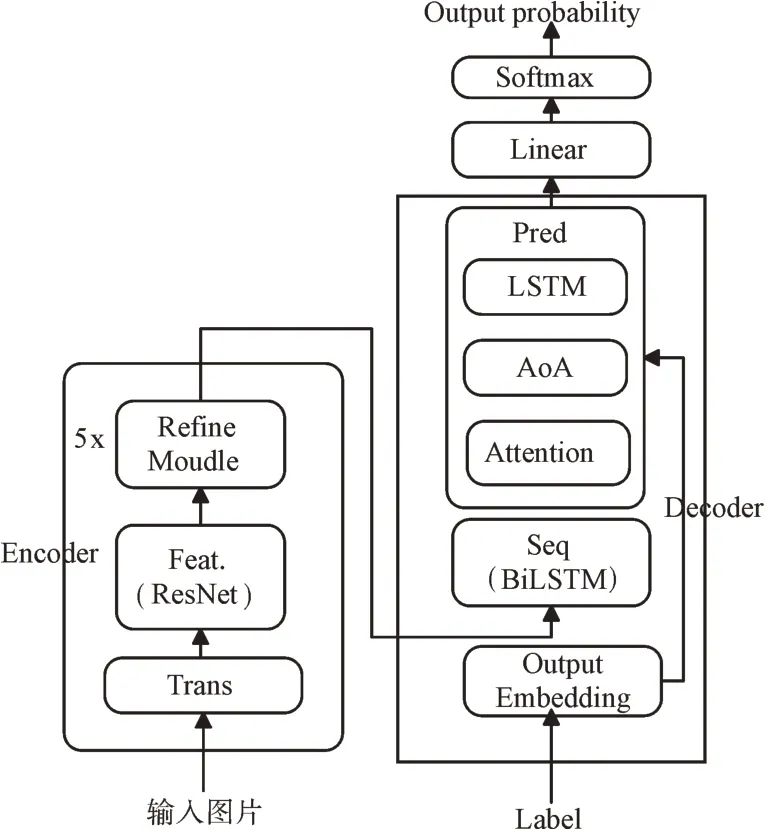

本模塊提出了端到端的基于編碼器—解碼器架構(gòu)的文本識(shí)別模型解決場(chǎng)景文本識(shí)別中存在的問(wèn)題,模型由轉(zhuǎn)換(Trans)、特征提取(Feat)、優(yōu)化模塊、序列建模(Seq)、預(yù)測(cè)(Pred)五部分組成,模型的結(jié)構(gòu)如圖6 所示。

(1)將圖片作為輸入,首先使用空間轉(zhuǎn)換器網(wǎng)絡(luò)標(biāo)準(zhǔn)化輸入文本圖像,將原始彎曲或者傾斜的圖像進(jìn)行標(biāo)準(zhǔn)化,簡(jiǎn)化下游任務(wù),使下游特征提取階段不需要學(xué)習(xí)圖像文本的幾何形狀不變性表示。

(2)將標(biāo)準(zhǔn)化文本圖像通過(guò)CNN 進(jìn)行特征提取,重點(diǎn)關(guān)注與字符識(shí)別相關(guān)的屬性,抑制圖像中不相關(guān)的特征,比如字體、大小、顏色和背景。

(3)優(yōu)化模塊中,使用AoA 優(yōu)化模塊提取特征。通過(guò)多頭注意力機(jī)制對(duì)特征向量進(jìn)行建模,構(gòu)建圖像中字符間的關(guān)系,然后應(yīng)用AoA 確定其關(guān)聯(lián)程度。

(4)將優(yōu)化后的特征向量送入序列建模階段,該模塊基于BiLSTM 通過(guò)捕捉下一階段字符序列的上下文信息,從而更穩(wěn)健地預(yù)測(cè)每個(gè)字符。

(5)最后,使用AoA 模塊預(yù)測(cè)結(jié)果輸出。通過(guò)注意力機(jī)制幫助特征對(duì)齊,自動(dòng)捕獲輸入序列內(nèi)的信息流以預(yù)測(cè)輸出序列。其中,擴(kuò)展注意力機(jī)制模塊可過(guò)濾無(wú)關(guān)或誤導(dǎo)的注意力結(jié)果,僅保留有用信息。

Fig.6 Text recognition model圖6 文字識(shí)別模型

3.4 學(xué)習(xí)資源風(fēng)格化

為了滿(mǎn)足不同學(xué)生的學(xué)習(xí)興趣,體現(xiàn)學(xué)習(xí)的個(gè)性化,通過(guò)處理推送的互聯(lián)網(wǎng)學(xué)習(xí)資源,將學(xué)習(xí)資源生成摘要式文本。TextRank 算法[8]是一種基于圖的文本排序算法,基本思想來(lái)源于谷歌的PageRank[14]算法,通過(guò)把文本分割成若干組成單元(單詞、句子)后建立圖模型,利用投票機(jī)制對(duì)文本的重要成分進(jìn)行排序,僅利用單篇文檔本身的信息即可實(shí)現(xiàn)關(guān)鍵詞提取、文摘。TextRank 簡(jiǎn)潔有效,無(wú)需事先對(duì)多篇文檔進(jìn)行學(xué)習(xí)訓(xùn)練,通過(guò)使用TextRank 算法進(jìn)一步處理互聯(lián)網(wǎng)獲取的學(xué)習(xí)資源,可為學(xué)生生成簡(jiǎn)潔明了的學(xué)生資源,便于閱讀。這是風(fēng)格化學(xué)習(xí)資源的一部分,此外還考慮了結(jié)合學(xué)生的興趣愛(ài)好、閱讀習(xí)慣,將學(xué)習(xí)內(nèi)容進(jìn)一步處理成為學(xué)生喜歡閱讀的方式。

4 輔助學(xué)習(xí)平臺(tái)的實(shí)踐

將平臺(tái)分為4 個(gè)部分進(jìn)行介紹,依次為硬件平臺(tái)配置、系統(tǒng)實(shí)現(xiàn)效果圖、實(shí)驗(yàn)結(jié)果分析和實(shí)踐效果。基于湖南大學(xué)信息科學(xué)與工程學(xué)院三個(gè)班級(jí)大學(xué)物理課程進(jìn)行實(shí)踐。此外,以問(wèn)卷調(diào)查的形式獲取學(xué)生反饋并作出簡(jiǎn)要的分析。

4.1 硬件平臺(tái)配置

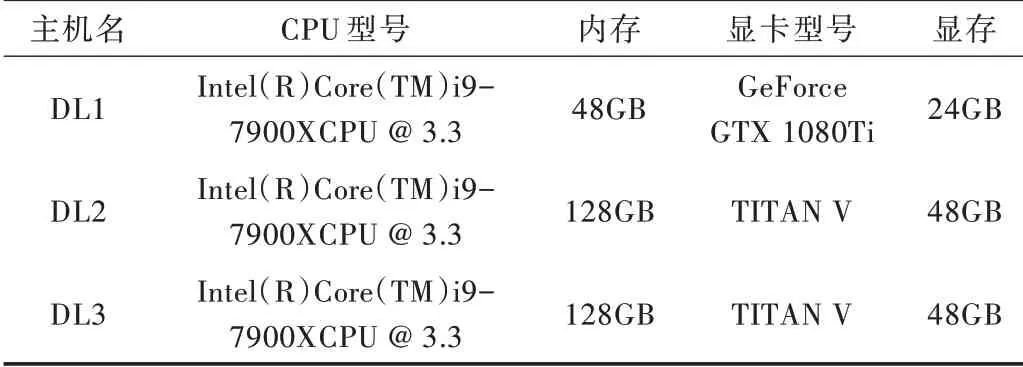

硬件平臺(tái)主要分為深度學(xué)習(xí)硬件平臺(tái)和大數(shù)據(jù)硬件平臺(tái)配置,深度學(xué)習(xí)的機(jī)器配置為:GeForce GTX1080 顯卡和48GB 內(nèi)存,以及兩臺(tái)配備N(xiāo)VIDIA TITAN V 和128GB 內(nèi)存的服務(wù)器構(gòu)成,配置如表1 所示。

Table 1 Deep learning hardware configuration表1 深度學(xué)習(xí)硬件配置

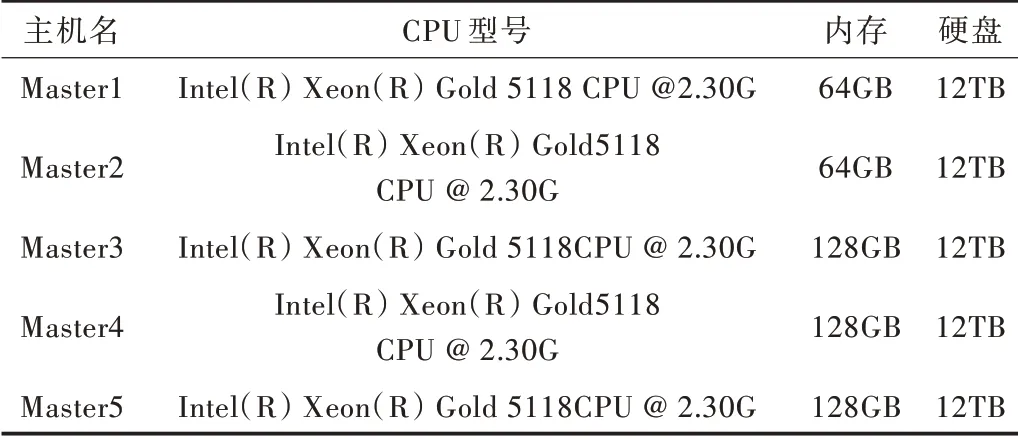

通過(guò)集成Caffe、Tensor-Flow、PyTorch、Keras 等主流深度學(xué)習(xí)框架作為技術(shù)支持,全力加速深度學(xué)習(xí)領(lǐng)域的人工智能開(kāi)發(fā)。大數(shù)據(jù)硬件平臺(tái)主要存儲(chǔ)教學(xué)視頻的流式數(shù)據(jù)和互聯(lián)網(wǎng)爬取的學(xué)習(xí)資源與課堂數(shù)據(jù)分析結(jié)果。通過(guò)5臺(tái)曙光服務(wù)器進(jìn)行試驗(yàn)測(cè)試,配置如表2 所示。

Table 2 Big data storage platform configuration表2 大數(shù)據(jù)存儲(chǔ)平臺(tái)配置

4.2 系統(tǒng)實(shí)現(xiàn)效果

Web 端和APP 端均有相應(yīng)的技術(shù)人員進(jìn)行開(kāi)發(fā)和維護(hù)。如圖7 所示,首先在Web 端展示課堂(學(xué)生、教師和黑板知識(shí)點(diǎn))三要素的學(xué)情分析結(jié)果。通過(guò)動(dòng)態(tài)展示學(xué)生上課專(zhuān)注度、教師授課生動(dòng)度情況、黑板板書(shū)內(nèi)容,學(xué)生能及時(shí)了解自己對(duì)知識(shí)點(diǎn)的疑惑程度,教師和管理者也能全面了解課堂的整體學(xué)情,并根據(jù)反饋信息及時(shí)修改教學(xué)方案。

接下來(lái),介紹為學(xué)生推薦個(gè)性化學(xué)習(xí)資源的App 端。其中,第一部分為針對(duì)疑惑知識(shí)點(diǎn)的學(xué)習(xí)資源推送(含有百度百科、博客、PPT、視頻等);第二部分為趣味學(xué)習(xí)資源。通過(guò)對(duì)知識(shí)點(diǎn)資料的內(nèi)容凝煉,實(shí)現(xiàn)了知識(shí)點(diǎn)摘要生成功能,但這僅屬于實(shí)現(xiàn)風(fēng)格化生成的開(kāi)始。相信隨著技術(shù)發(fā)展,風(fēng)格化學(xué)習(xí)資源的生成功能會(huì)越來(lái)越完善,可滿(mǎn)足不同學(xué)習(xí)者的需求。

4.3 實(shí)驗(yàn)結(jié)果分析

4.3.1 實(shí)驗(yàn)分析

Deng 等[9]所提出的InsightFace 模型與Yu 等[6]所提出的靜態(tài)表情識(shí)別模型對(duì)人臉和表情進(jìn)行識(shí)別。通過(guò)實(shí)驗(yàn)證明:人臉識(shí)別準(zhǔn)確率達(dá)到95%,基本能夠滿(mǎn)足項(xiàng)目的需求;表情識(shí)別只有61.29%,有待改進(jìn)。下一步,將研究新的模型以更精確識(shí)別學(xué)生的表情特征。

Fig.7 Smart Class platform圖7 智慧課堂數(shù)據(jù)展示平臺(tái)

4.3.2 改進(jìn)后的模型實(shí)驗(yàn)分析

(1)黑板檢測(cè)

①數(shù)據(jù)集

此方面工作較少,缺乏標(biāo)注完整的數(shù)據(jù)集,因此通過(guò)網(wǎng)絡(luò)采集、現(xiàn)場(chǎng)拍攝、同學(xué)收集等形式共制作300 張圖片。選取的標(biāo)準(zhǔn)為圖片中清晰、完整的黑板,并且黑板的大小至少占據(jù)圖片的四分之一,黑板的位置在圖片的中部或者兩側(cè)。在收集完畢之后,利用LabelImg 軟件標(biāo)注圖片。最終,將300 張圖片隨機(jī)分為train.txt、val.txt、test.txt,數(shù)量分別為240,30,30。在訓(xùn)練過(guò)程中,首先利用開(kāi)源的ImageNet 數(shù)據(jù)集進(jìn)行預(yù)訓(xùn)練,然后利用標(biāo)注好的數(shù)據(jù)集進(jìn)行訓(xùn)練。

②黑板檢測(cè)實(shí)驗(yàn)分析

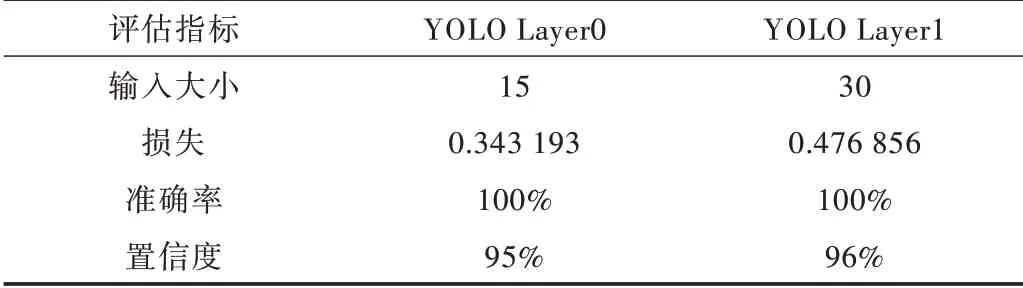

由于要應(yīng)對(duì)課堂這一特殊環(huán)境,需要對(duì)YOLOv3 網(wǎng)絡(luò)模型進(jìn)行修改。原因有以下3 點(diǎn):黑板目標(biāo)具有位置相對(duì)單一、類(lèi)別相對(duì)固定的特點(diǎn),檢測(cè)難度不高;針對(duì)課堂黑板中單一的目標(biāo)檢測(cè),可通過(guò)壓縮網(wǎng)絡(luò),去除復(fù)雜的殘差層,進(jìn)一步提升訓(xùn)練效率和檢測(cè)速度;課堂黑板一般位于視頻中央或中央偏兩側(cè)位置,因此黑板會(huì)占據(jù)整體視頻圖像中較大的面積,可以暫時(shí)忽略檢測(cè)到的小物體。

Table 3 Blackboard detection experimental results表3 黑板檢測(cè)實(shí)驗(yàn)結(jié)果

實(shí)驗(yàn)結(jié)果如表3 所示:當(dāng)Grid_size 為15 時(shí),損失為0.34,判斷物體種類(lèi)準(zhǔn)確率為100%,置信度準(zhǔn)確度為0.947;當(dāng)Gird_size 為30 時(shí),損失為0.48,判斷物體種類(lèi)準(zhǔn)確率為100%,置信度準(zhǔn)確度為0.959,總體準(zhǔn)確率達(dá)到95%,能夠精準(zhǔn)檢測(cè)黑板位置,基本能夠滿(mǎn)足項(xiàng)目需求。

(2)文字識(shí)別

①數(shù)據(jù)集

通過(guò)使用人工合成的數(shù)據(jù)集,包括SynthText(ST)和MJSynth(MJ)兩個(gè)主流的人工合成文本識(shí)別數(shù)據(jù)集,分別從中取5 500 000 張和8 900 000 張圖片用于實(shí)驗(yàn)。對(duì)于測(cè)試集而言,使用了3 個(gè)真實(shí)場(chǎng)景數(shù)據(jù)。其中,SVT 數(shù)據(jù)集包含了647 張圖片,圖片來(lái)自于Google 街景采集的戶(hù)外街道,包含了一些低分辨率、模糊的圖像;IC03 數(shù)據(jù)集包含了867張圖片,來(lái)自于ICDAR 2003 健壯閱讀比賽中用閱讀相機(jī)捕捉的場(chǎng)景文本;IC13 數(shù)據(jù)集包含了1015 張圖片,在繼承IC03 的大多數(shù)圖像的基礎(chǔ)上了擴(kuò)充了來(lái)自于ICDAR 2013健壯閱讀比賽捕捉的圖片。

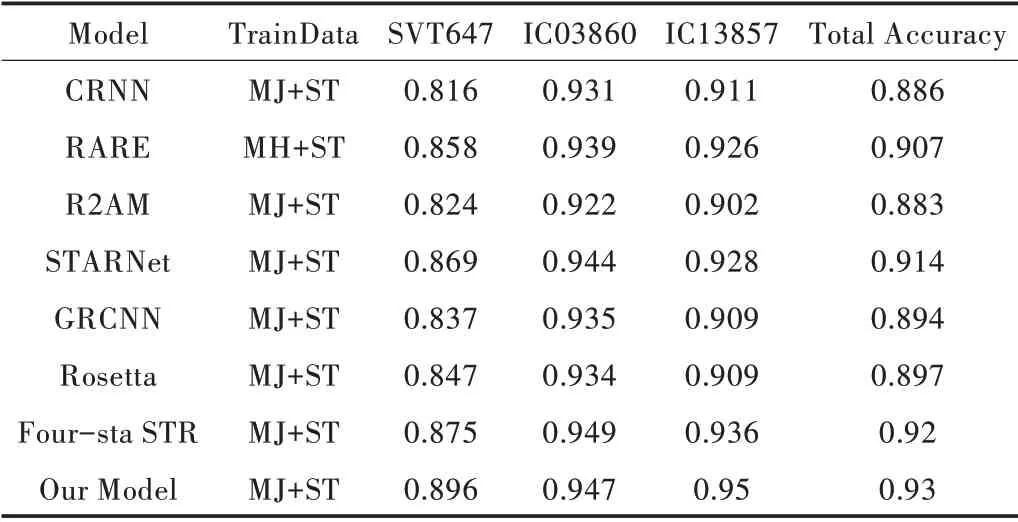

②實(shí)驗(yàn)分析

本文所提出的文字識(shí)別模型與現(xiàn)有模型進(jìn)行對(duì)比,使用相同的訓(xùn)練集訓(xùn)練,在不同的數(shù)據(jù)集上測(cè)試,結(jié)果如表4所示。其中,本文提出的模型在不同數(shù)據(jù)集上均具有良好的性能,在多個(gè)數(shù)據(jù)集上總體準(zhǔn)確率為93%,針對(duì)性能上的提升,分析原因如下:通過(guò)引入AoA 模塊擴(kuò)展了常規(guī)的注意力機(jī)制,以確定注意力結(jié)果和查詢(xún)之間的相關(guān)性。構(gòu)建了基于編碼器-解碼器架構(gòu)的模型以解決文本識(shí)別中存在的問(wèn)題;在編碼器階段,通過(guò)CNN 提取圖片特征之后,未直接將其送入解碼器中,而是構(gòu)建了一個(gè)包含AoA 的模塊優(yōu)化網(wǎng)絡(luò),有助于更好地建模圖像中不同字符之間的關(guān)系,優(yōu)化特征表示;在解碼器階段,應(yīng)用AoA 過(guò)濾無(wú)關(guān)的注意力結(jié)果,只保留有用信息。

從表4 可見(jiàn),本文提出的模型相比現(xiàn)有模型,在文字識(shí)別準(zhǔn)確率方面有著一定的提升,在課堂中取得了很好的效果。

Table 4 Text recognition experimental results表4 文字識(shí)別實(shí)驗(yàn)結(jié)果

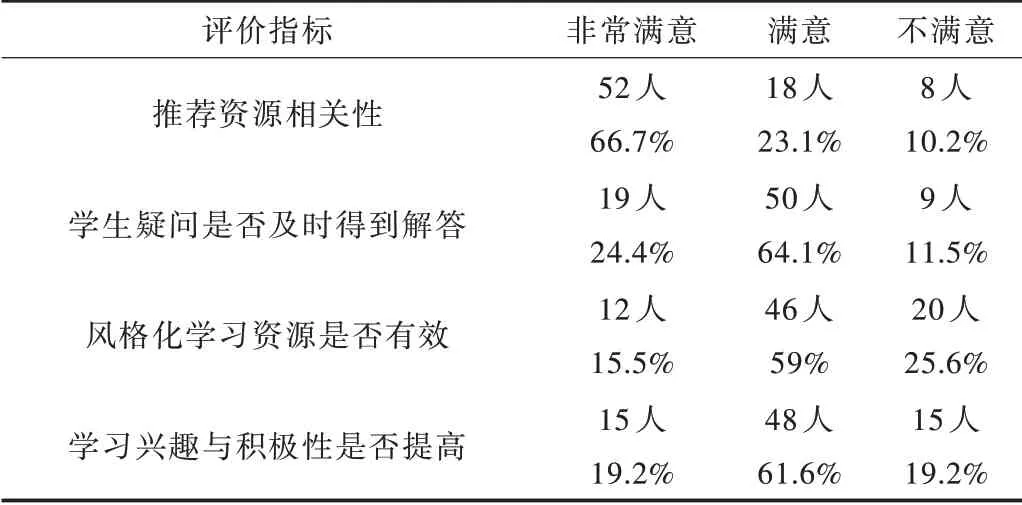

4.4 輔助學(xué)習(xí)平臺(tái)實(shí)踐效果

在2020 年度下學(xué)期的教學(xué)實(shí)踐中,對(duì)湖南大學(xué)信息科學(xué)與工程學(xué)院計(jì)算機(jī)專(zhuān)業(yè)學(xué)生的物理課程(3 個(gè)班級(jí))采用了基于智慧課堂的三位一體輔助學(xué)習(xí)平臺(tái)。通過(guò)問(wèn)卷調(diào)查(78 份有效問(wèn)卷)包括3 個(gè)班級(jí)的78 名學(xué)生獲取反饋信息,問(wèn)卷調(diào)查數(shù)據(jù)統(tǒng)計(jì)如表5 所示。

Table 5 Results of student questionnaire survey表5 學(xué)生問(wèn)卷調(diào)查結(jié)果

在這四個(gè)評(píng)估指標(biāo)中滿(mǎn)意度取平均值,學(xué)生非常滿(mǎn)意率為31.5%、滿(mǎn)意率為51.9%、不滿(mǎn)意率為16.6%。從統(tǒng)計(jì)數(shù)據(jù)可見(jiàn),絕大多數(shù)學(xué)生認(rèn)為個(gè)性化輔助學(xué)習(xí)平臺(tái)能夠?yàn)閷W(xué)生及時(shí)答疑解惑,提供針對(duì)性的學(xué)習(xí)資源,并且學(xué)習(xí)內(nèi)容豐富,趣味性強(qiáng),滿(mǎn)足學(xué)生并的學(xué)習(xí)需求。不僅提高了學(xué)生學(xué)習(xí)的效率和積極性,而且明顯改善了當(dāng)前教學(xué)效果。當(dāng)然,也有少部分學(xué)生存在不滿(mǎn)意的情況,證明平臺(tái)仍有待完善和改進(jìn)。一方面,需加強(qiáng)學(xué)習(xí)資源風(fēng)格化技術(shù)的研究,滿(mǎn)足不同學(xué)生的個(gè)性化學(xué)習(xí)需求以及提高對(duì)于學(xué)生專(zhuān)注度、教師生動(dòng)度等關(guān)鍵部分評(píng)判的準(zhǔn)確性;另一方面,加強(qiáng)學(xué)生在課堂中的實(shí)踐性與互動(dòng)性,提高學(xué)生解決問(wèn)題的能力和創(chuàng)新能力。隨著科學(xué)技術(shù)的迅速發(fā)展,后期將持續(xù)對(duì)平臺(tái)進(jìn)行升級(jí),為師生提供更優(yōu)質(zhì)的課堂服務(wù)。

5 結(jié)論

本文提出的面向智慧課堂的三位一體化輔助學(xué)習(xí)平臺(tái),通過(guò)實(shí)時(shí)智能分析課堂三要素,從多維角度產(chǎn)生一體化學(xué)情數(shù)據(jù),及時(shí)為學(xué)生答疑解惑,并考慮知識(shí)點(diǎn)之間的關(guān)聯(lián)性,讓學(xué)生查缺補(bǔ)漏。提供針對(duì)性的風(fēng)格化學(xué)習(xí)資源,充分調(diào)動(dòng)了學(xué)生學(xué)習(xí)興趣與積極性,提高學(xué)生課后學(xué)習(xí)的主動(dòng)性和效率。主要工作和創(chuàng)新點(diǎn)如下:

(1)本文提出了一種新理念,綜合考慮學(xué)生對(duì)于知識(shí)點(diǎn)的理解與學(xué)生自身專(zhuān)注度、教師授課水平以及知識(shí)點(diǎn)的難易程度三者息息相關(guān),從多維角度產(chǎn)生一體化學(xué)情數(shù)據(jù),使課堂分析更加全面,為學(xué)生推薦更加準(zhǔn)確的學(xué)習(xí)資源。

(2)利用人工智能技術(shù)賦能課堂,結(jié)合云推理服務(wù)、大數(shù)據(jù)技術(shù),初步實(shí)現(xiàn)了面向智慧課堂的三位一體化輔助學(xué)習(xí)平臺(tái)。

(3)在實(shí)際應(yīng)用過(guò)程中,研究了黑板檢測(cè)和文字識(shí)別,通過(guò)實(shí)驗(yàn)證明測(cè)試的準(zhǔn)確率分別為95%與93%,能基本滿(mǎn)足項(xiàng)目需求。

同時(shí)該平臺(tái)也存在一些不足,要繼續(xù)深入研究關(guān)鍵技術(shù),提高模型精度。今后將持續(xù)豐富和完善平臺(tái)的各項(xiàng)功能,真正為學(xué)生和教師提供便利,提高學(xué)習(xí)效率和教學(xué)質(zhì)量。