一種基于顏色模型的火災識別系統

劉洲岐,王雷,劉聰,黃晉,王振

(山東理工大學 計算機科學與技術學院, 山東 淄博 255049)

隨著生活水平的提高,人們工作及生活中的日常需求不斷增長,對各種燃料的應用也隨之增加,同時每年發生火災的頻率逐年增長,并造成了嚴重的損失。據不完全統計,平均每天都會有一萬多起的火災事故發生,產生的傷亡人數也有數百人之多。根據我國消防部門的數據顯示,在2020年1月到10月期間,我國接到19.6萬起火災報案,共計造成了一千多人的傷亡,財產損失達到二十五億元之多[1]。因此,對于火災檢測技術的研究和升級刻不容緩。通過對火災的實時監測及防控,不僅能夠有效地防患于未然,避免各種慘劇的發生,同時也能很大程度上保障人民的生命財產安全。

傳統的火災檢測技術,往往是使用基于物理硬件的傳感設備,實現對火災產生的關鍵參數的實時監測[2]。目前,被廣泛使用的火災報警器大多基于溫度檢測和煙霧檢測[3]。常見的溫感報警器大致可以劃分為兩種,第一種是以基爾霍夫定律為準則的接觸式傳感器,利用被測環境周圍物體的熱輻射信號檢測實際溫度;而第二種是非接觸式傳感器,為了使被測物體的溫度能用溫度計表示,主要通過對流傳熱達到熱平衡來實現[4]。光電感煙式和離子感煙式是兩種經常使用的煙感報警器。光電感煙式探測器主要利用光的傳播可以被火災現場產生的煙霧而改變這一基本原理。而離子感煙式探測器利用煙霧粒子與電離化區域的離子相聯系減弱其中的導電性,當低于一定數值時,就會發出檢測信號[5]。這兩類傳感器分別檢測空氣中的煙霧濃度和溫度數值,通過內部轉換將其轉換為電信號,并使用單片機檢測煙霧濃度和溫度是否高出預警值,如果超標就會發出火災警告[6]。

上述兩種火災檢測方法都具有較高的靈敏度,一旦發生火情,周圍環境中的某些環境參數(如溫度等)會相應地產生不同程度的變化,通過對這些火災參數進行有效地觀測及分析,進而對火災發生與否做出相應的判斷。但是這些基于傳感器的火災檢測設備同時也存在相應的弊端,容易受到空氣流通、光線變化等環境因素的干擾,產生誤報和漏報現象[7]。同時,這些設備對環境的適應性較差而且使用壽命短,很難實現對火情的及時監控和預警。

因此,隨著計算機視覺、模式識別等技術不斷地發展, 為了更有效地對火災進行檢測,基于視頻監控的火災識別技術得到了廣泛認可。相較于傳統以傳感器為主的火災識別技術,圖像檢測方法更為精確,不僅使火災識別的準確率大幅提升,減少不必要的漏報;同時該系統基本不受外界環境的影響,整體性能相對穩定。針對現有的監控系統,該技術可以將火災監控加入其中,具有靈敏、準確、便捷等優點,并且使用成本低。

1 基于顏色模型的火災識別系統

本文設計的可視化的界面如圖1所示,實現了基本的視頻監控和拍照功能,同時以火災檢測算法為核心,將疑似火焰區域標記并輸出到視頻中。本設計通過高清攝像頭獲取圖像﹐并傳輸至計算機中,通過對視頻圖像的讀取及預處理將圖像轉化為灰度圖像,便于后期分析。利用運動目標檢測算法提取圖像中的前景區域,然后基于顏色檢測,判斷疑似火災區域,并進行標注。

圖1 系統界面

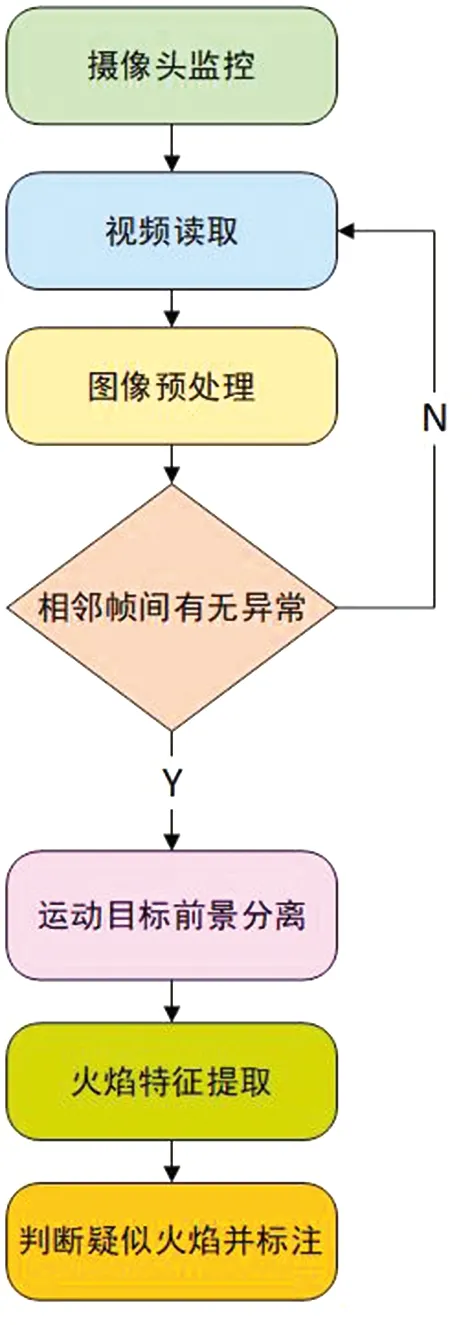

本系統的重點在于對火災檢測算法的研究,具體流程如圖2所示。在火災檢測流程中,首先要通過攝像頭的視頻監控獲取圖像信息并傳輸到計算機端,然后對圖像進行預處理﹐在檢測過程中﹐圖像背景的選取很重要,這直接決定了目標檢測的準確性。本文采用幀間差分法和高斯混合模型背景建模相結合的方法,從視頻圖像中分離運動的目標前景不但計算簡單﹐工作量少,同時也減少了計算機資源的占用。

圖2 基于顏色模型的火災檢測流程

2 視頻預處理及運動目標檢測

從攝像頭的實時監控中讀取視頻,圖像會因為設備、環境等各種因素的干擾,致使后期分析處理時性能下降;所以通過對收集的圖像做預處理操作,從眾多圖像信息中提取有用的特征信息。

2.1 視頻圖像灰度變換

由于高清攝像頭拍攝的RGB格式的圖像,一方面占用的計算機存儲空間相對大,另一方面在處理時CPU占比也不小[8]。因此對采集的圖像進行灰度處理操作,灰度處理后的視頻圖像僅保存亮度數據。如圖3所示,對彩色圖像進行灰度處理后,僅保留了亮度數據,方便對圖像進行后續處理。

圖3 視頻圖像做灰度化處理前后的結果對比

2.2 視頻圖像平滑濾波

采集后的視頻圖像如果沒經過處理會存在很多干擾噪聲,比如常見的高斯白噪聲和椒鹽噪聲等,要進行圖像檢測則必須過濾掉這些干擾噪聲,便于后續步驟對目標圖像的特征提取。對圖像進行平滑處理使用的濾波器有中值濾波和鄰域平滑濾波等。通過對濾波器的分析,本系統主要采用了Sobel算子和中值濾波對圖像進行平滑處理。在圖4中,對采集到的視頻圖像先通過Sobel算子求取圖像邊緣并濾除高斯噪聲,然后通過中值濾波器過濾掉噪聲,平滑圖像。

圖4 視頻圖像平滑濾波前后結果對比

Sobel算子作為一種用于檢測邊緣的算子,主要通過離散微分方法求取圖像邊緣,其中借鑒了高斯濾波的思想,邊緣檢測效果較好。使用Sobel邊緣檢測算子提取圖像邊緣,首先要分別獲得X方向和Y方向的邊緣信息,然后整合這兩個方向上的邊緣數據求出完整的圖像邊緣。

中值濾波的基本實現原理是為了使每個像素周圍點的值更容易向真實的值靠攏,用其鄰域灰度值的中值來替換,以此來有效抑制噪聲[9]。這種方法不僅可以去除噪聲,而且也解決了線性濾波導致的一些圖像細節的模糊問題。

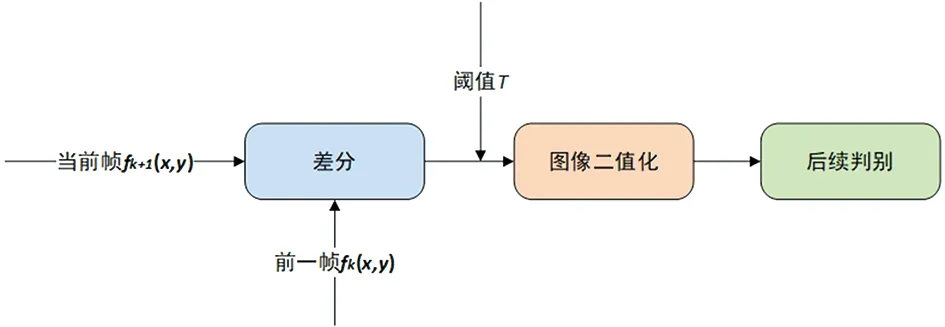

2.3 幀間差分法

幀間差分法的實現原理是對圖像序列中鄰近的每兩幀作差分,當連續的圖像中出現移動的物體,兩幀之間就會有顯著差別,要確定其中有無運動物體,首先將兩幀相減,然后比較圖像像素差的絕對值和設定的閾值二者大小,以此來檢測運動目標[10]。

最常用的幀差法是二幀差分法,將視頻流中的前后兩幀圖像轉換為灰度圖像,再經過高斯模糊消除噪聲干擾,然后將兩幀圖像進行相減操作得到之間的差異區域,再對差異圖像進行二值分割,把差異區域作為前景、不變區域作為背景,并且進行開運算操作消除一些微小干擾。這樣,得到了兩幀圖像中明顯不同的區域,也就是運動的目標物體。假設圖像中相鄰的兩幀為第k幀和第k+1幀,用D(x,y)表示兩幀圖像fk(x,y)和f(k+1)(x,y)之間的變化,公式為

(1)

式中T為差分圖像二值化閾值,該二值圖像中用0表示前后未變化的背景區域,用1表示變化的運動區域。流程如圖5所示。

圖5 幀間差分法流程

幀差法的顯著特點是在動態環境中的自適應性較好,運算敏捷,實現簡單。但缺點是對微小運動物體的檢測能力比較差,如果在兩幀圖像之間變化太小,就很難被檢測出來。而且二幀差分法對于噪聲、光照等都非常敏感,在檢測過程中容易因為環境因素的影響而出現孔洞和重影現象,導致運動目標提取信息不完整,進而引發誤檢測的問題。

2.4 自適應高斯混合背景建模

高斯混合模型簡稱為MOG,其原理是以圖像中一段時間內的像素樣本的概率密度等信息來體現背景,對目標像素位置使用統計差分的方法進行判別,能夠對一些豐富的動態背景建模。在序列圖像中,每個像素點的變化可以認為是不停地生成像素值的隨機過程,即每個像素點的顏色展現規律可以用高斯分布來描述。假設在處理彩色圖像時,像素點R、G、B三個顏色的通道有相同且獨立的方差。隨機變量X的觀察數據集合{x1,x2,…,xN},xt=(rt,gt,bt)是t時刻的像素樣本,單一采樣點xt服從的高斯分布概率密度函數為

(2)

η(xt,μi,t,τi,t)=

(3)

(4)

式中:k是分布模式的總數;η(xt,μi,t,τi,t)表示t時刻的第i個高斯分布;μi,t是均值;τi,t是協方差矩陣;δi,t表示方差;I是三維單位矩陣;wi,t表示t時刻的第i個高斯分布的權重。

MOG2作為MOG的升級算法,在前景連續性及運行時間上具有明顯的優勢。它一個顯著特征是,為每個像素點選擇合適的高斯分布,進而適應各種環境中的亮度變化。該算法可以相對較好地適應背景的變化,如光照的明暗影響等,但對于慢速的移動物體不容易檢測出來。

2.5 基于自適應高斯混合背景建模的幀差法

為了提高幀差法的魯棒性和穩定性,同時改善MOG對檢測緩慢移動物體的靈敏度,將二者結合提出了基于自適應高斯混合背景建模的幀差法,這個方法主要有高斯混合模型和幀差法這兩個重要組成部分[11]。其具體算法流程如下:

1)首先通過幀間差分法對圖像進行移動物體檢測,并對識別到的運動區域進行圖像預處理操作。

2)用高斯混合模型進行背景建模獲得背景,對視頻圖像進行背景減除法,初步獲得其中的前景圖像。

3)對前兩步提取的運動區域執行圖像邏輯或操作,得到相對完整的運動區域,并對此進行腐蝕膨脹處理,然后使用孔洞填充增強目標區域的完整性。

該方法可以提高對微小運動物體的檢測能力,同時增強對噪聲、光照等因素的抗干擾能力,最終能夠比較完整地檢測出火焰的運動狀態。對視頻監控中的火焰使用三種方法分別進行運動目標區域識別的效果如圖6所示。從圖6中3組實驗明顯看出,基于幀間差分法顯示的動態火焰輪廓不明顯;基于高斯混合背景模型的方法不易檢測出火焰的細微變化;而基于自適應高斯混合背景建模的幀差法在很大程度上彌補了以上兩者的缺點,并且檢測實時性也有了較大提高。

(a) 幀間差分法

3 基于顏色模型的火災特征提取

一般來說,RGB顏色模型是肉眼可見的,對于火焰顏色來說,R(紅色比重)和G(綠色比重)比較大,并且G大于B(藍色比重)。HIS模型主要依靠色度(H)、亮度(I) 和飽和度(S)來表示顏色特征[12]。

受溫度、燃燒的物質和氧氣濃度的影響,大多數的火焰顏色介于紅黃之間,其中火焰的中心部分一般呈現為亮白色[13]。顏色隨著溫度的升高而傾向于冷色,隨著溫度的降低而傾向于暖色,燃燒溫度的高低也會影響火焰顏色飽和度和亮度的變化。因為火焰燃燒的顏色特征相當明顯,所以一般通過HIS判據和RGB判據,設置特定的閾值條件,檢測疑似火焰區域,把圖像二值化,再對其進行平滑濾波等圖像處理。詳細條件為:

(i)R>RT,

(ii)R≥G≥B,

(iii)S≥(255-R)×ST/RT,

S=(1-3.0×min(R,G,B)),

其中:飽和度的閾值為ST;紅色比重的閾值用RT表示,火焰像素大部分依賴于紅色的飽和度和色度。如果滿足上述條件,就可以認為該區域為疑似火焰的像素,將其設置成白色,不然設置成黑色[14]。針對紅黃色的火焰,其色度H在近紅黃范圍內變化,火焰由內到外,顏色是逐漸由亮白色到黃色到紅色,所以飽和度由內到外逐漸增大,而強度由內到外逐漸降低[15]。

最后,把通過RGB、HIS雙判據分割的區域進行二值化,然后對其進行預處理操作,剔除異常并找到遺漏的點。由于一些火焰的顏色并非僅限于紅色和黃色兩種顏色之間,沒辦法被識別,需要實現區域間的相互連通,因此對二值圖像進行數學形態學的操作,對圖像執行膨脹運算操作[16]。圖7為實時檢測的視頻圖像中畫面的截取,為了表示基于顏色模型識別的火焰區域,將其用綠色矩形框標記,不難看出火焰的整體區域都在框內,所選擇的閾值檢測效果良好。

圖7 顏色特征提取及輪廓標記

4 實驗結果與分析

為了驗證本文系統的整體性能,分別在不同場景、光照、空氣流通等環境下進行了15組火焰識別的對照實驗。在實驗中通過高清攝像頭監控場景里的火焰燃燒,并在本系統識別的基礎上進行錄制視頻,后期對實驗結果進行逐幀分析并采集了相關圖像數據,如圖8所示。

圖8 部分檢測實驗結果

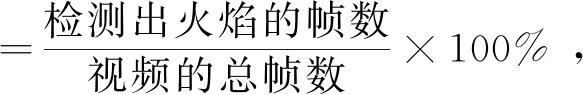

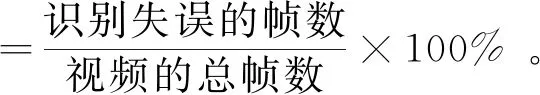

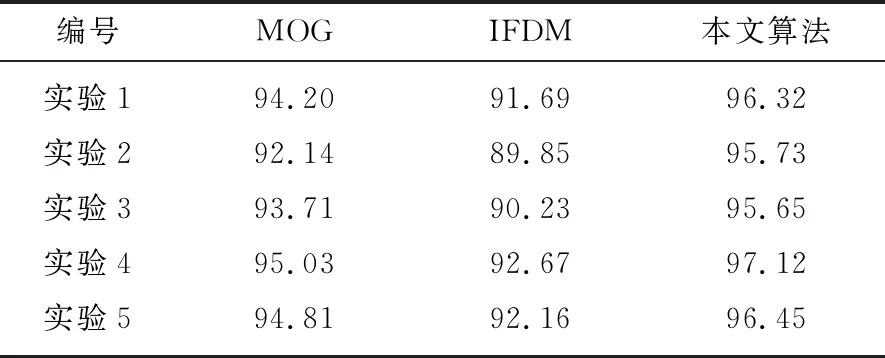

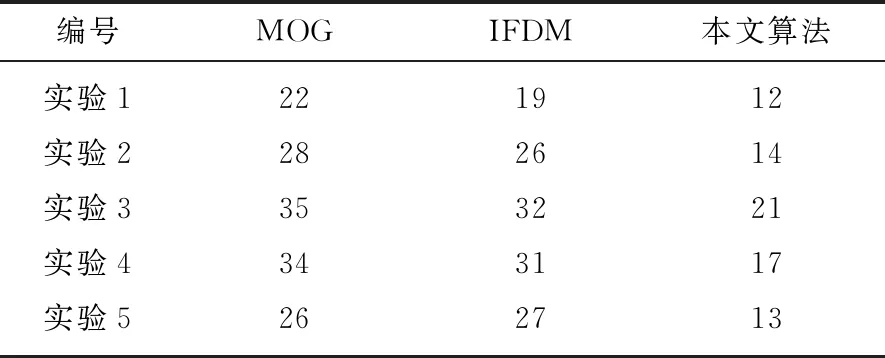

從圖8可看出,在不同條件下,本文系統都準確識別了火焰區域。結合實驗結果,從準確率、識別靈敏度和誤報率三個方面評估系統的火焰檢測性能[17],其中準確率和誤報率的公式為:

(5)

(6)

在保證高精度的同時,視頻監控對突發火災檢測的反應時間也是十分重要的。識別靈敏度通過計算檢測出火焰的第一幀位置與起火的第一幀位置的差值來判斷反應時間的大小。檢測系統對起火的反應直接決定了該系統的性能。識別靈敏度越小,可以認為該系統性能越好[18]。

表1—表3,基于混合高斯模型MOG和基于幀間差分法IFDM的火焰識別算法,與本文的算法在準確率、靈敏度和誤報率做了對比。分析表中數據可知,本文算法檢測火焰的平均準確率在96%以上,遠高于MOG和IFDM,與此對應的誤報率也是三者之中最低的;從識別靈敏度可以看出對起火的反應時間也是最快的。這驗證了本文系統能夠降低基于傳統火焰識別算法的視頻監控檢測火災的漏報和延遲現象,同時具有良好的可靠性和實用性。

表1 火焰識別準確率

表2 火焰識別靈敏度

表3 火焰識別誤報率

5 結束語

本文設計并實現了一種基于顏色模型的火災識別系統,并通過實驗驗證該系統可以明顯識別火焰,而且火災檢測速度遠遠高于以往的視頻監控火災報警系統。該系統能夠充分利用室內原有的視頻監控設備,有效彌補了現有火災報警系統的不足[19],是火災識別系統發展的主流趨勢,具有較廣闊的應用前景。未來,將繼續優化系統結構和識別過程,完善識別算法性能,例如引入深度學習模型,將此系統應用與監控視頻大數據分析結合,以利于更高效、準確地識別火災。