基于特征提取極限學習的臥姿壓力圖像識別

袁先啟,蔣永翔,夏紅超

(天津職業(yè)技術師范大學機器人及智能裝備研究院,天津 300222)

人的一生中有1/3 時間在睡眠中度過,睡眠質量直接影響人的身體健康。臥姿作為評判睡眠質量和預防突發(fā)疾病的指標之一,其識別一直都是學者研究的熱門課題。日常的臥姿主要包括仰臥、俯臥、左側臥和右側臥4 種。Baranowski 等[1]提出臥姿對睡眠呼吸障礙有著重要的影響。這4 種臥姿的識別不僅可以輔助診斷心血管病、肥胖癥、糖尿病等疾病[2],還可為評價睡眠質量和診斷睡眠呼吸障礙提供依據(jù)[3]。目前,人體姿態(tài)識別研究方法主要分為4 種:①肌信號提取肌電信號[4]和肌音信號[5]的方法[A1]。采用支持向量機對肌信號中的時域、頻域等特征進行分析,識別人體姿態(tài)特征,由于這種識別方法無法實現(xiàn)精細動作的識別,因此分類精度有待提高。②計算機視覺采集的方法,包括3D 相機[6]和視頻記錄等[A2]。利用3D 相機對人體動作進行記錄,再利用隱馬爾科夫模型(HMM)[7]對人體動作等進行建模和識別,這種方法只有在訓練集較少的情況下才能展示出很好的效果,對大規(guī)模的數(shù)據(jù)集訓練易出現(xiàn)過度擬合。③可穿戴傳感器采集法。主要包括加速度計和陀螺儀傳感器等[8-9],通過傳感器采集人體信號,提取相應的特征值,運用隨機深林法、支持向量機算法、K-最近鄰的方法進行特征識別[10],最終實現(xiàn)人體姿態(tài)識別,這種具有侵入性穿戴式的傳感器極易給人們造成不舒適。④壓力傳感器圖像采集法。利用壓力傳感器進行人體壓力圖像的采集,通過圖像分析對人體臥姿進行識別。耿讀艷等[11]通過壓電薄膜傳感器采集心沖擊(BCG)信號,并進行局部特征提取,利用支持向量機實現(xiàn)臥姿識別。該方法由于BCG 波形受到個體差異和環(huán)境的影響,支持向量機算法出現(xiàn)了極大的誤差。根據(jù)以上方法,本文提出利用壓力傳感器采集人體背部壓力圖像的方法,通過極限學習算法識別臥姿,實現(xiàn)疾病的診斷。

1 極限學習模式(ELM)算法

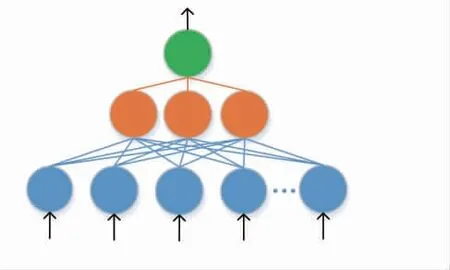

ELM 是以神經(jīng)網(wǎng)絡為單隱藏分層學習方法的重要工具,在ELM 中輸入層的權重隨機分配計算[12],極限學習算法的結構模型如圖1 所示。

圖1 極限學習算法的結構模型

本研究ELM 借助神經(jīng)網(wǎng)絡,具有較快的學習能力。ELM 選擇隱藏權重神經(jīng)元,與一些經(jīng)典算法相比,模型結構選擇的總體計算時間及實際訓練時間較短[13]。ELM 具有很高的性能且對分類精度隱藏層起始參數(shù)(鏈接權重、偏移值、節(jié)點等)影響很大[14]。

結合圖1 極限學習模型,人工神經(jīng)網(wǎng)絡的輸出ELM數(shù)學模型可描述為

式中:n 為訓練樣本;x1…n為輸入向量;y1…n為輸出向量;β1…m為輸出層權重;w1…n,1…m為輸入層和輸入層之間的權重隱藏層;b1…m為閾值函數(shù);輸出函數(shù)g(*)為激活功能。

對于給定的輸入輸出樣本,利用隱藏層輸出矩陣H 和隱藏層輸出層權重b,ELM 計算輸出

H 為ELM 隱藏層的輸出矩陣,H 的第i 列是第i個隱藏節(jié)點的輸出。在ELM 中,可以根據(jù)訓練集隱藏層輸入層權重和隱藏層輸出層權重的隨機參數(shù)(wi,bi)得到H。ELM 的輸出重量β 計算式為

式中:H*為矩陣H 的廣義逆矩陣。

n 個訓練樣本,x1,x2,…,xi為訓練集,i =1,…,n,隱層輸出函數(shù)g(*),隱藏節(jié)點的數(shù)目n 作為輸入。ELM算法步驟:①隨機分配輸入權重w 和輸出權重B,w=[w1,w2,…,wn],B = [b1,b2,…,bn];②計算隱層輸出矩陣H;③計算輸出重量β,β=H*×y。

2 人體壓力特征提取實驗

2.1 實驗要求及設備安裝

選取80 名健康實驗者(男性和女性各40 名)參與實驗。實驗者年齡為20~27 歲,身高為160~180 cm,體重為45~80 kg。所有實驗者參與實驗過程中需穿著單薄上衣,以免衣物過厚對采集的壓力信息造成干擾。

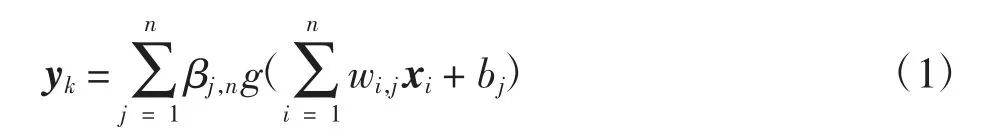

本次實驗使用日本東海橡膠公司生產的SR 智能壓力傳感氣墊,簡稱SR 傳感器。SR 傳感器由16×16 個壓力傳感器陣列組成,測量面積為450 mm×450 mm。SR壓力傳感器陣列是電極與布線共同印刷成型的,使用USB 與采集系統(tǒng)接口相連,實驗者躺在測定區(qū)域測定背部的壓力分布。測定結果在上位機上顯示分布壓力圖像和壓力數(shù)值。壓力傳感器的安裝方式如圖2 所示。

圖2 壓力傳感器安裝示意圖

2.2 數(shù)據(jù)采集

為了訓練更多特征參數(shù),提高極限學習算法的穩(wěn)定性,需要采集每位實驗者的4 種臥姿,一種臥姿需要重復采集4 張壓力圖片,80 位實驗者共采集1 280張圖片。為避免實驗者對實驗環(huán)境與臥姿不適應而造成的干擾,要求實驗者每次躺下平靜30 s 后再開始采集信息,信息采集數(shù)據(jù)傳輸至上位機并顯示,記錄壓力分布。

3 極限學習臥姿的識別

3.1 典型臥姿選擇及臥姿圖像采集

選擇4 種臥姿作為本次研究的主要模型,如圖3所示。這4 種臥姿是人們在臥床過程中的常見姿勢,也是影響睡眠舒適度的重要姿態(tài)[15]。臥姿作為評估人體睡眠質量的關鍵因變量,是睡眠質量評價的主要方法[16]。以實驗者1 為例,用50×50 的壓力傳感器陣列采集了4 種臥姿的背部壓力圖。

圖3 4 種臥姿

3.2 壓力圖像特征提取和處理

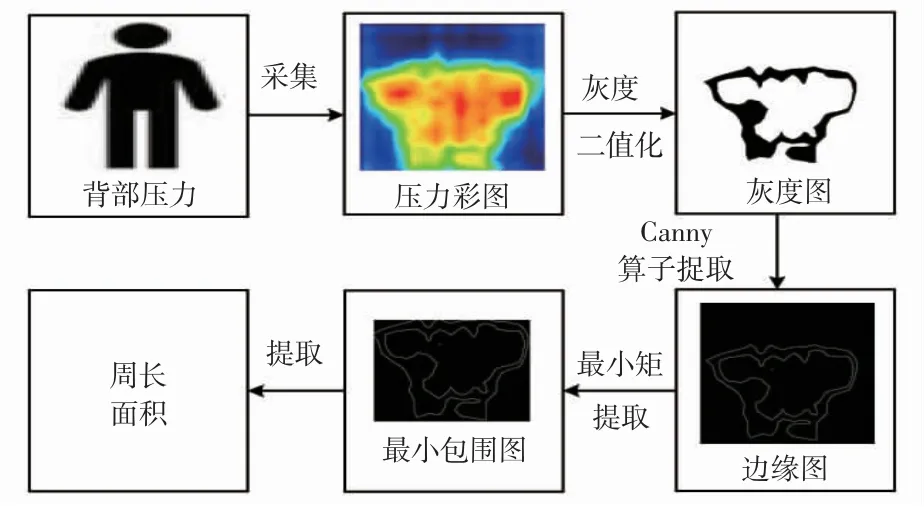

首先采用Matlab 軟件將采集到的背部壓力圖像進行灰度二值化處理、邊緣算子提取等操作,最終得到周長、面積等幾何特征。幾何特征提取流程如圖4 所示。

圖4 幾何特征提取流程

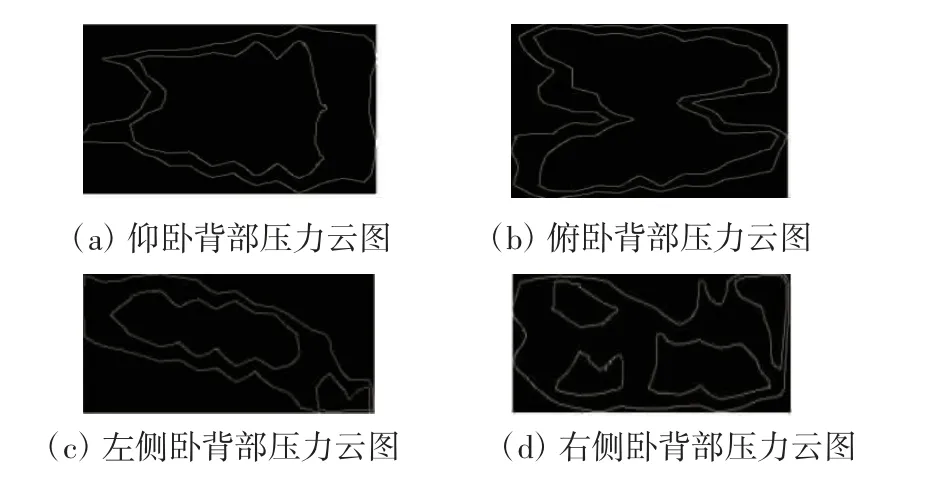

對壓力圖像進行中值濾波降噪、灰度處理,將灰度圖像轉換成二值圖像,再用Canny 算子對二值圖像進行邊緣輪廓的提取,Canny 算子的閾值為200,得到邊緣輪廓圖像,通過提取邊緣輪廓,可以清晰地看出壓力圖像的外部邊緣輪廓,根據(jù)圖像的最外層邊緣,提取最小包圍矩形,提取后的最小包圍矩如圖5所示。

圖5 最小包圍矩

3.3 特征參數(shù)選取和計算

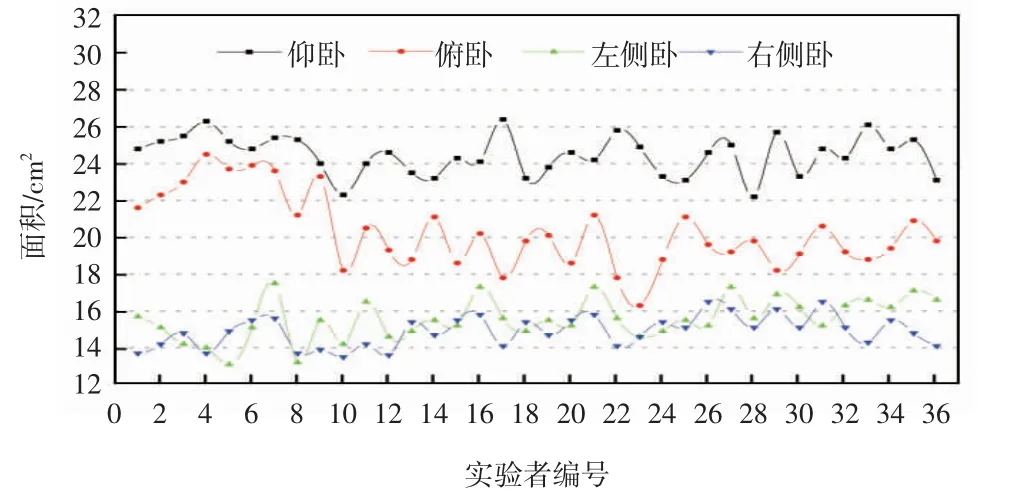

從壓力分布圖像中提取3 類16 個特征參數(shù):最小包圍矩形計算的幾何特征參數(shù)包括周長、面積、Hu1-Hu7;提取40 名男性實驗者的壓力分布最小包圍矩,求取最小包圍矩的周長和面積平均值,去掉周長和面積平均值的最大和最小值,從剩余的數(shù)據(jù)中更能體現(xiàn)出臥姿數(shù)據(jù)的真實性,包圍矩形周長分布曲線和面積分布曲線分別如圖6 和圖7 所示。

圖6 包圍矩形周長分布曲線

圖7 包圍矩形面積分布曲線

從圖6 和圖7 可以看出,在包圍矩的周長和面積分布曲線中,同一人的仰臥和俯臥包圍矩的周長和面積均大于側臥的周長和面積。

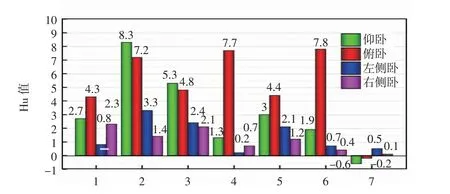

Hu 矩是利用二階和三階中心距提取圖像的位置、大小等特征構造出7 個不變矩,其具有識別穩(wěn)定,縮放、平移、旋轉不變等優(yōu)點[17]。Hu 矩圖如圖8 所示。

圖8 Hu 矩圖

從Hu 矩的幾何特征參數(shù)可以看出,仰臥俯臥的Hu1-Hu6 均大于側臥的Hu1-Hu6,仰臥俯臥的Hu7均為負,側臥的Hu7 均為正。俯臥的Hu 矩值相對較高,雖然仰臥俯臥的Hu 值與側臥的區(qū)分比較明顯,但是仰臥和俯臥的Hu 值區(qū)分比較模糊,左側臥和右側臥同樣難以區(qū)分。

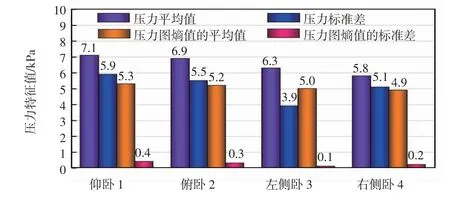

本實驗采集80 人的壓力分布圖和壓力值,用采集的壓力值計算壓力平均值、壓力標準差,再用采集的壓力分布圖計算圖片信息熵平均值、熵標準差,最后把壓力平均值、壓力標準差、壓力圖熵平均值和熵標準差分別取均值,壓力信息能量特征圖如圖9所示。

圖9 壓力信息能量特征圖

根據(jù)壓力信息能量特征圖的顯示,做出如下分析。

(1)仰臥、俯臥狀態(tài)下的壓力平均值和壓力標準差均大于側臥的平均值和標準差,仰臥的壓力平均值和壓力標準差最大,左側臥的壓力平均值和壓力標準差最小。

(2)仰臥、俯臥的壓力圖熵平均值和壓力圖熵標準差均大于側臥圖熵平均值和圖熵標準差。

(3)仰臥、俯臥的壓力圖熵平均值和左側臥、右側臥的壓力圖熵標準差均難以區(qū)分。

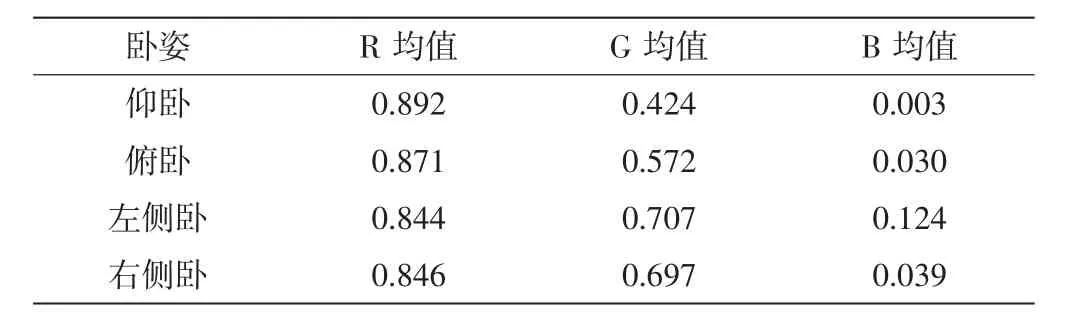

由于傳感器測量得到不同臥姿壓力云圖,通過提取壓力圖中RGB 顏色均值進行特征分析,RGB 均值如表1 所示。

表1 顏色特征值的提取

通過RGB 顏色特征值的提取可知,仰臥俯臥狀態(tài)下的R 均值大于側臥的均值,由于均值相差不大,并不能有效地對臥姿進行評判,因此需要對數(shù)據(jù)進行整合分析。獲得16 個特征參數(shù)后,采用式(6)對數(shù)據(jù)進行歸一化處理

式中:Qi為上述16 個特征參數(shù);Qi*為歸一化特征值。

通過對數(shù)據(jù)歸一化融合處理,引入極限學習算法對臥姿進行識別。其中,驗證極限學習算法對臥姿識別的有效性和數(shù)據(jù)歸一化處理均是在Matlab 軟件中實現(xiàn)。

4 基于極限學習的臥姿識別精度評估

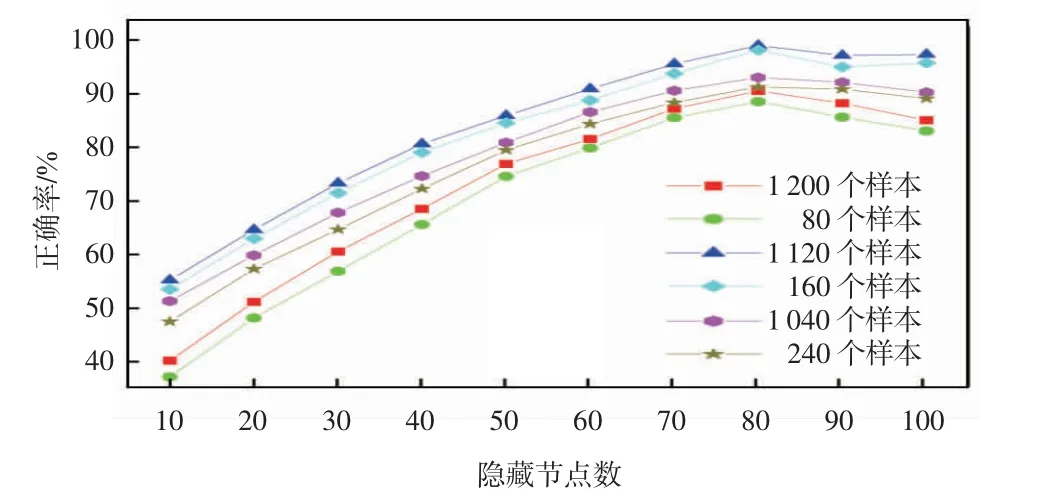

為了評估ELM 的準確性,選擇訓練樣本大小和隱藏節(jié)點對4 種臥姿進行監(jiān)測。選取了80 名實驗者,對4 種臥姿每人各選取4 組數(shù)據(jù),共獲得1 280 組數(shù)據(jù)。通過上文特征參數(shù)的提取與分析,對16 個參數(shù)特征進行訓練,以sig 為激活函數(shù),隨機抽取80、160、240、320 個樣本測試集。同時,將隱藏節(jié)點數(shù)從10 個增加到100 個,每10 個節(jié)點增加1 個。不同樣本大小和隱藏節(jié)點的ELM結果如圖10所示。

圖10 不同樣本大小和隱藏節(jié)點的ELM 結果

隨著隱藏節(jié)點從10 增加到80 時,訓練集正確率迅速增加。當隱藏節(jié)點在80~100 范圍內時,訓練集雖顯示出相當高的精度,但是正確率均呈下降趨勢。由不同樣本測試集可知,樣本訓練數(shù)量從960 個增加到1 120 個時,其訓練集正確率迅速增加。樣本訓練數(shù)量從1 120 個增加到1 200 個時,正確率開始下降。在固定的1 120 個樣本訓練集中隱藏節(jié)點大小為80 更為合理,因為該選擇同時考慮了計算的精度和速度。

在選取隱藏節(jié)點為80 的情況下,分別選取4 種臥姿的40 組特征數(shù)據(jù)作為臥姿識別的測試集,160 個測試樣本預測圖如圖11 所示。

這4 種臥姿在模擬訓練時已標注,1 為仰臥,2 為俯臥,3 為左側臥,4 為右側臥。利用3 類特征值16 個特征參數(shù)建立預測模型。模擬結果顯示,4 種臥姿識別精度達到了98.75%。因此,通過極限學習算法識別臥姿的方法滿足了分類精度要求。

5 結 語

臥姿識別是評判不同疾病群體臥床時采用不當臥姿帶來身體壓迫導致疾病發(fā)生的重要依據(jù)。本文通過選用SR 柔性壓力氣墊對不同臥姿的實驗者進行了背部壓力圖像采集,對采集到的壓力圖像進行灰度二值化、最小包圍矩形的處理,處理后提取灰度圖像的幾何特征參數(shù)(周長和面積),提取壓力值和壓力圖的能量特征參數(shù)、顏色特征參數(shù)。采用極限學習算法對16 種特征參數(shù)進行訓練,識別了4 種常見臥姿,臥姿識別的正確率達到98.75%。相比傳統(tǒng)單一的提取特征值識別臥姿,該方法綜合考慮了全局和局部特征參數(shù)的提取,有效地提高了臥姿識別的精度,為無束縛睡眠監(jiān)測和疾病的預防提供了依據(jù)。