基于視覺語義關聯的卷煙零售終端文字識別

韋泰丞,譚穎韜

(1.廣西中煙工業有限責任公司,廣西 南寧 530001;2.中國科學院自動化研究所,北京 100190)

0 引言

隨著互聯網技術的發展以及具備拍照功能的移動終端的普及,各種終端所拍攝自然場景的圖片往往包含一定的文字內容。不同于一般的視覺元素,文字直接承載了豐富而準確的高層語義信息,有著極強的場景表達力。因此,自動檢測和識別圖片中的文字具有很廣泛的應用場景,例如店招識別、車牌識別和單據閱讀等。光學字符識別(Optical Character Recognition,OCR)和場景文字識別(Scene Text Recognition,STR)技術,即從圖像中檢測與識別文字信息,已成為計算機視覺、文檔分析等領域的熱點研究方向,得到了來自學術界與工業界的強烈關注。

在煙草行業,零售終端店招名稱以及煙草專賣零售許可證的文字信息是店鋪信息采集的重要內容。傳統的信息采集多以人工為主,耗時費力,并且容易出現差錯,亟需建立智能化的終端文字信息采集系統。然而,傳統的OCR技術無法解決復雜場景下的文字識別問題。針對實際場景中的文字識別難點,本文提出了一種基于視覺語義關聯的文字識別網絡,有效地提高了文字識別性能。

1 問題分析

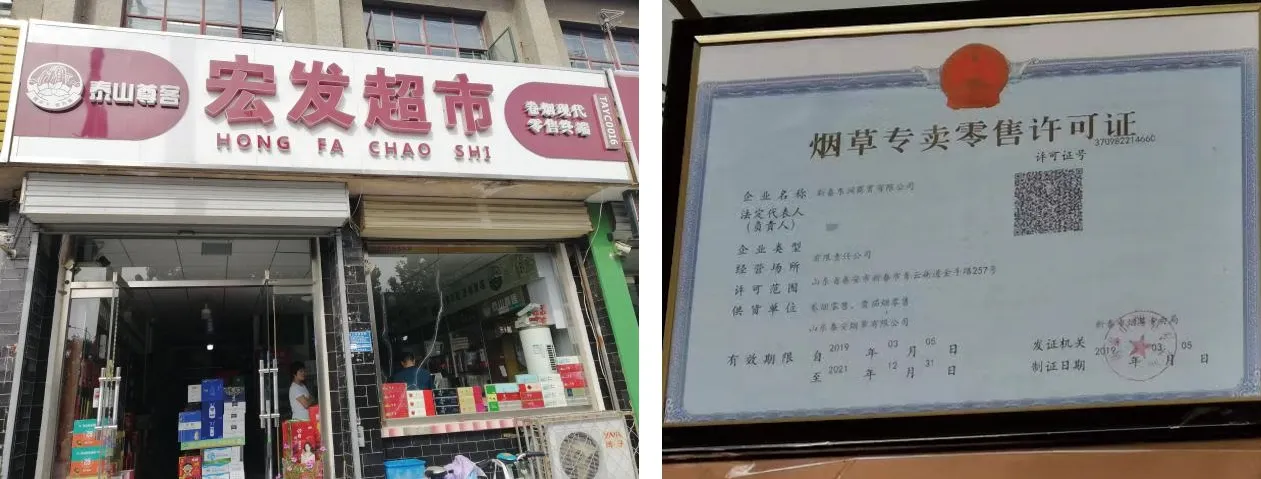

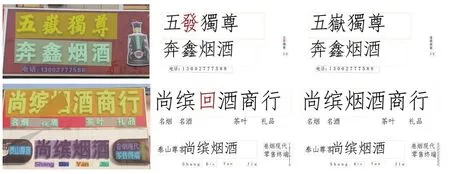

零售終端店招文字識別以及終端許可證識別分別屬于場景文本[1]和文檔文本[2],如圖1所示。終端店招文字處于真實的復雜場景之中,具有目標尺度變化大,字體種類、風格多樣,背景較為復雜的主要特點。許可證文字處于紙質文檔之中,此類圖片有圖像質量較低、文字不清晰、尺度小、文字密度較大的特點。

圖1 圖片樣例Fig.1 Examples of picture

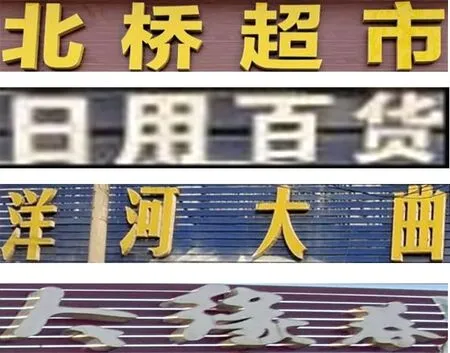

文字檢測和文字識別通常以串聯的結構組成系統,文字識別作用于文字檢測分支檢測出的文字區域。由于本文重點是文字識別部分,故不對文字檢測部分進行過多敘述,直接采用文字檢測器輸出的文字區域圖像作為文字識別系統的目標圖像,如圖2所示。

(a) 店招文字

近年來,隨著深度學習的發展,基于卷積神經網絡的文字識別方法以其優越的性能逐漸成為文字識別領域的主導方法。文獻[3-4]使用循環神經網絡(Recurrent Neural Network,RNN)深入建模像素之間的序列關系,增強文字上下文之間的理解,經過CTC翻譯算法計算每個字符的概率,將RNN層的輸出轉化為一個字符串,作為最終結果。文獻[5-7]使用一種自回歸的方式,利用RNN結合空間注意力機制,逐個識別每個字符,獲得了比CTC轉譯更好的性能。近年來,表達能力更強的自注意力模塊[8]逐漸被使用在場景文字識別任務上,文獻[9-10]使用自注意力機制獲得更魯棒的特征表示,取得了目前最佳的識別性能,并且逐漸將文字的語言模型引入以輔助識別任務,將其從簡單的視覺分類建模為更全面的視覺和語言相結合的模型。由于其結合了語言的語義關系,在圖像不清晰、有干擾的情況下仍能取得較好的結果。

本文為了針對性、魯棒性地處理實際卷煙零售終端中出現的場景復雜和圖像質量低等影響文字識別準確率的問題,設計了一種基于視覺語義關聯的文字識別網絡,在實際零售終端的多場景環境中均得到較好的效果,包括以下特點:

① 提升網絡長跨度感受野。文本圖像與一般的分類任務圖像不同,其擁有極大的寬高比并且輸出結果是不固定長度的序列。直接沿用分類卷積網絡的方形卷積操作難以提升有效感受野,無法獲取文本行各個字符之間的空間長跨度聯系。本文使用自注意力機制增強橫向文本的文字感知性能,有效提升文字識別準確率。

② 結合中文語義,融合圖像和語言雙模態特征獲取更魯棒的識別結果。本文提出了一種全局語義聯系模塊,利用中文的語義信息,有效地處理實際拍攝過程中產生的圖像干擾等傳統視覺模型無法解決的問題,降低圖像識別中字體的多樣性、光照不均勻、顏色變化及尺度不一等干擾。

③ 采用Focal Loss作為最終的損失函數降低中文樣本不均衡分布的影響。由于實際場景樣本中文字類別分布極度不均勻,在訓練中使用Focal Loss提升網絡對于出現頻率較低文字的識別準確性,進一步提升網絡的總體識別性能。

2 算法設計

基于視覺語義關聯的文字識別網絡是一種根據場景文字中的文字信息具有語言邏輯性的任務特點來設計的文字識別網絡結構,本節對其網絡細節進行重點闡述。

2.1 算法概述

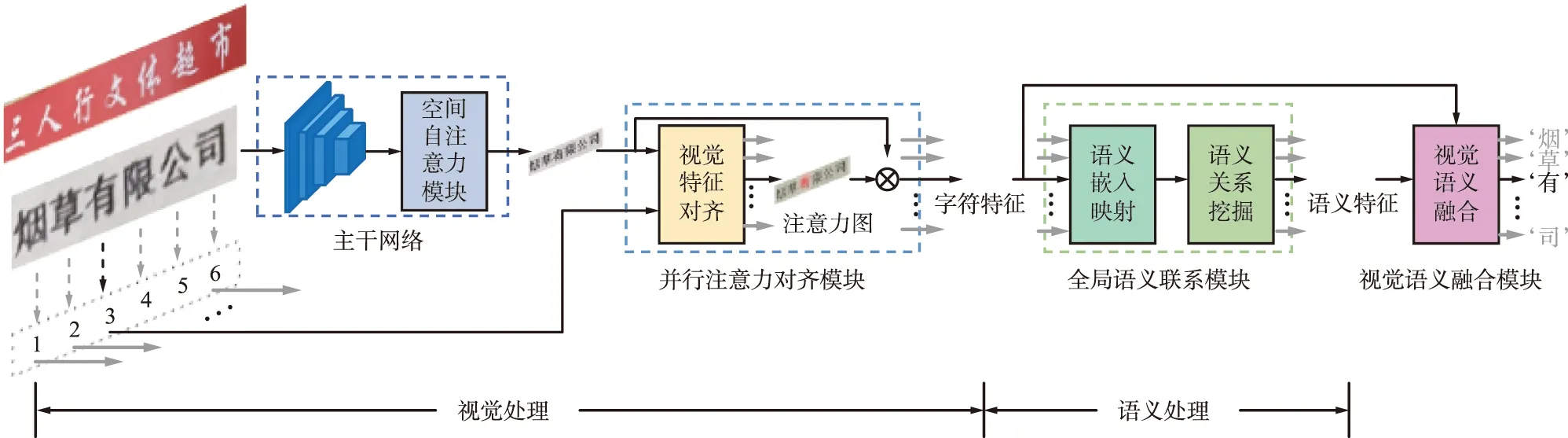

提出的基于視覺語義關聯的文字識別網絡結構如圖3所示。一方面,摒棄現有低效的RNN解碼方式,通過高效并行的注意力模塊定位文字字符的準確位置,加快多條目文本的識別速度;另一方面,利用transformer模塊深層次挖掘中文文本的語義內容含義,對識別結果進行糾正,使識別結果具有語言邏輯性。對由于圖像噪音等圖像低質量問題造成的錯誤識別具有一定的糾錯能力,實現高精度的文字定位和識別。

圖3 基于視覺語義關聯的文字識別網絡結構Fig.3 Configuration of the proposed text recognition network

提出的文字識別網絡包含4個主要模塊:

(1) 主干網絡

采用卷積神經網絡和自注意力機制相結合的主干網絡,卷積神經網絡使用目前性能優越的殘差連接網絡。使用特征金字塔網絡結合不同尺寸的特征圖,一方面,為了更好地捕獲中文的筆畫細節;另一方面,為了增強網絡對于不同細粒度文字特征提取的魯棒性。此外,在特征提取器基礎上,使用基于transformer的長跨度自注意力進一步增強特征的全局聯系性。

(2) 并行注意力對齊模塊

提出一種高效的并行視覺注意力策略。傳統的字符串識別方法執行網絡前向過程僅識別一個字符,識別整串需要執行多次前向,處理許可證版面的長文本十分費時。因此,提出并行注意力機制,一次前向過程識別文本行中所有字符,速度提升10倍以上。另外,由于店招文字以及許可證文本每行文字分布均勻,網絡可以輕易學習出字符的位置信息,高效準確地對文字進行捕捉。

(3) 全局語義聯系模塊

中文文字具有強烈的語義特征,通常的文字識別方法中將語義分析作為后處理操作,無法與識別網絡進行端到端訓練。本文提出全局語義聯系模塊,單獨挖掘語義信息并隨網絡端到端訓練。使用長跨度序列注意力模型,將識別出的文字結果進行語義級別的矯正,使輸出結果具備語言邏輯性。

(4) 視覺—語義融合模塊

綜合并行注意力對齊模塊以及全局語義聯系模塊的視覺和語義識別結果,進行文字逐位比較,使用注意力機制權衡視覺以及語義識別結果的置信度獲得最終視覺—語義關聯的識別結果。

2.2 算法模塊分析

(1) 主干網絡

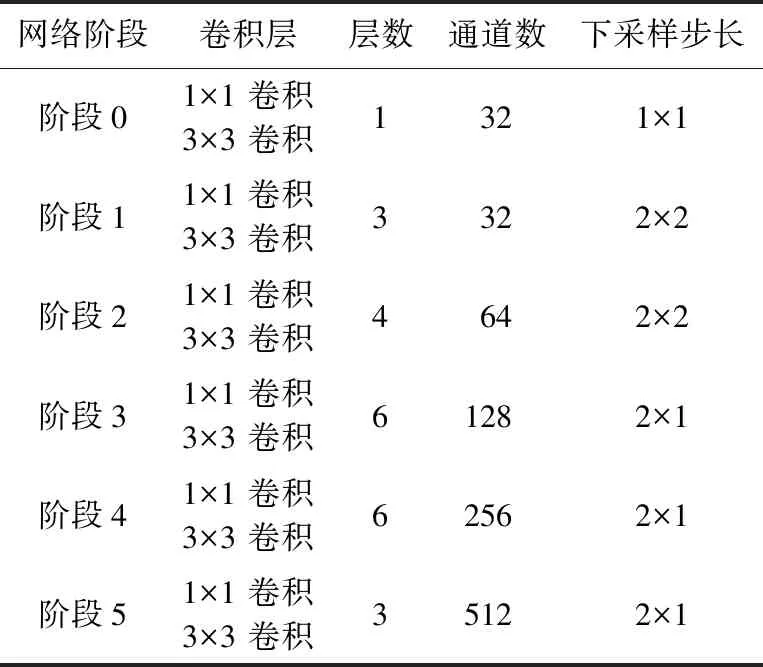

本文采用了殘差神經網絡[11]結合自注意力機制的主干網絡,其中,殘差神經網絡參考文獻[3]提出的45層輕量級網絡的結構設計。每個殘差模塊單元包含一個空間尺寸為3的卷積層用于收集上下文信息,擴大網絡的感受野;一個尺寸為1的卷積核減少參數量并且增強特征表達,具體的主干網絡配置如表1所示。由于文字圖像長寬比例的特殊性,更改了原始等比例下采樣的策略,在第3階段之后采用縱向下采樣、特征圖寬度不變的策略以保持文字的橫向排列特性。

表1 主干網絡配置Tab.1 Backbone network configuration

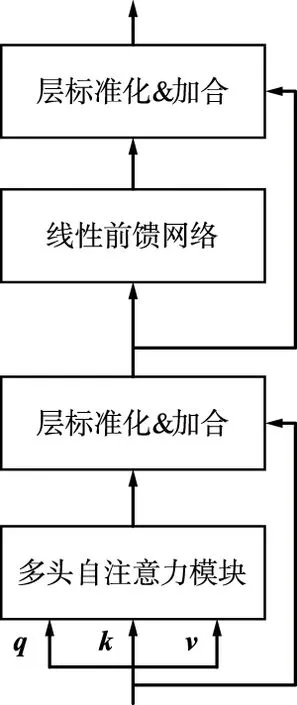

近年來,基于自注意力機制的主干網絡在計算機視覺領域取得了很大的成功[12-13]。自注意力模塊和卷積神經網絡相結合的混合模型[14-16]更是取得了優異的效果。卷積神經網絡擁有出色的歸納偏置,對通用特征的提取起到了極大的幫助,而自注意力模塊以數據為驅動深度挖掘特征之間的關聯,并且改進卷積操作感受野的局限性,二者相得益彰。transformer結構如圖4所示。本文將基于標準transformer的空間長跨度自注意力模塊置于卷積網絡之后,其具體結構如圖4(a)所示。

(a) transformer模塊組成結構

在自注意力模塊[8]中,查詢向量q為輸入序列中某個元素,鍵向量k和值向量v構成

(1)

式中,Q∈Rn×dk;K∈Rn×dk;V∈Rn×dv。本文中自注意力模塊的輸入q=k=v=F。F∈Rn×C為卷積神經網絡的輸出特征,n=H×W為序列長度,C,dv,dk為特征通道數。

由于transformer模塊結構無法感應輸入數據的相對次序,通常為輸入特征額外復合代表位置關系的位置編碼[12-13],為了適應圖像特征的2維位置關系,使用了自學習2維位置編碼提升圖像的自注意力機制識別效果。表達如下:

(2)

式中,PEi,j∈Rn×dk為自學習位置編碼向量,i,j分別代表空間的行列位置,以使transformer模塊感知空間的特征關系。位置編碼只作用于查詢向量q以及鍵向量k,建立自注意力空間位置關系,而不改變值向量v,以保證圖像判別性特征不被改變。

自注意力是一種關注輸入序列內部元素間關系的注意力機制。自注意力機制的中心思想是計算輸入序列中每個元素與其他所有元素間的相互關系權重,自主學習序列中元素的編碼表示,該編碼表示同時包含元素本身的信息和輸入序列中其他元素與該元素的關系,即所有的文字信息。如圖4(a)所示,加入了殘差連接和層歸一化計算方式,處理深度學習模型的退化難題。增加全連接層構成的前饋網絡,增強每個元素的特征表示。

終端店招文字識別具有內容長的特點,使用空間長跨度自注意力模塊可以高效、準確地解析所有字符。

(2) 并行注意力對齊模塊

基于空間注意力的文字識別解碼[4,17]通常通過自回歸的方式從左至右依次定位圖像中各個文字的位置,并且識別為相應字符。其最大弊端是每次解碼字符均需要執行一次前向過程,當文字序列過長時計算效率過于低下。為此,使用了并行注意力解碼方式,一次前向過程解碼所有字符。計算如下:

(3)

式中,K=V=G為圖像視覺特征;Qd為次序編碼,形式上為一個自學習矩陣Qd∈Rn×dk。最終,得到Fv為各個字符的視覺特征。

(3) 全局語義聯系模塊

全局語義聯系模塊由語義嵌入映射和語義關系挖掘2個子模塊構成。語義嵌入映射模塊利用詞嵌入 (Embedding)操作,將視覺特征Fv的字符分類結果映射至高維語義特征,這些特征通過語義關系挖掘模塊深入探索語言的語義關聯性。

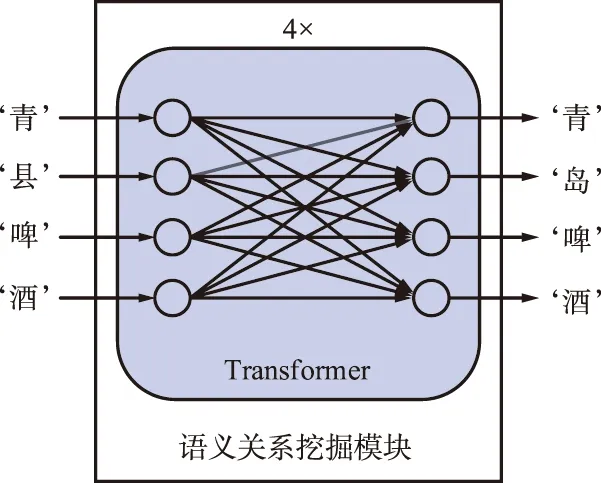

全局語義關系模塊如圖5所示,其基本結構為4層相連的transformer模塊。利用transformer中自注意力模塊的全局交互,文字序列中的每一個文字之間深層語言信息被挖掘,建立文本串的語言邏輯知識。

圖5 全局語義關系模塊Fig.5 Global semantic association module

采用圖4(a)的transformer結構,輸入q=k=v是視覺并行注意力對齊模塊的解碼結果相應的嵌入結果并且復合位置編碼以表明文字的相對前后關系[8]。利用自注意力模塊的計算能力深度挖掘各個文字之間的關系,建模文本行的語義知識。對于模糊、檢測缺失和遮擋污漬等視覺干擾,純粹利用卷積神經網絡的視覺建模無法解碼正確字符,但是利用上下文的整體語義信息可以對結果進行彌補。遮擋圖像示例如圖6所示,其視覺識別結果為“青縣啤酒”,使用語義上下文建模,理解中文語言語境,糾正結果為“青島啤酒”。

圖6 遮擋圖像示例Fig.6 Occlusion image example

由于全局語義聯系模塊基于視覺識別網絡的識別結果,僅作用于中文語言空間而與圖像特征無直接關系,故此模塊可以獨立于文字識別模型進行中文語義的預訓練。參考文獻[18]的預訓練方式,本文在大量中文語料中預訓練,并在終端店招和零售許可證圖像中分別微調此模塊。預訓練策略為隨機掩碼,對于輸入的中文文字嵌入信息,隨機掩碼輸入序列中的若干文字,并最終預測這些被替換的文字,以此學習文字間的語言關系。其中,EM∈RC為所述掩碼,其本身無意義,在訓練中隨機替換文字的嵌入信息。

在微調階段,對于視覺模型的輸出結果,其識別置信度往往和其字符識別準確率高度正相關。對于錯誤識別的字符,其識別準確率p往往較低,為了不使錯誤的識別結果干擾語義聯系模塊的識別,本文以字符識別準確率p作為置信度權值復合文字嵌入代表最終的輸入:

Ein=p×E+PE,

(4)

式中,E為中文文字的嵌入信息;PE為可學習位置編碼。隨著置信度p的作用,錯誤的文字信息不會被帶入全局語義聯系模塊干擾上下文的學習;另一方面,其輸入文字信息被掩碼后信息缺失,只能通過上下文的文字語言知識進行推斷,與預訓練的動機更加貼合。

(4) 視覺—語義融合模塊

如上所述,視覺處理中的視覺識別特征Fv以及語言建模后的語義特征Fs分別代表各個字符的視覺信息和語言信息,使用一個門控機制進行視覺—語義方面的權衡,最終的特征D表達為:

D=σFv+(1-σ)Fs,

(5)

σ=Wg([Fv;Fs]),

(6)

式中,門控單元σ自適應地由視覺和語義特征得到;Wg為自學習向量用于調控視覺和語言特征的比重。對于視覺信息較弱的受干擾文字,語言特征Fs的作用尤為突出,而對于純數字等無意義文字,視覺特征Fv更加關鍵。門控機制針對這一問題進行了建模,自適應地權衡融合特征比重。

最終網絡的優化目標包含3個部分:視覺識別結果的損失、語言糾正結果的損失以及視覺—語義相關聯的結果損失。三者的損失函數均使用Focal Loss[19]并且有相同的標簽。由于中文文字識別具有分布不均勻的特性,尤其在終端場景中,“煙草”“超市”等文字出現更為頻繁,故使用處理分布不均勻的Focal Loss對視覺特征Fv、語義特征Fs以及融合特征D進行多損失聯合優化:

L=λvLv+λsLs+λDLD,

(7)

式中,Lv,Ls,LD為Focal Loss:

l=-α(1-pt)γln(pt)。

(8)

3 應用效果

3.1 實驗設計

輸入圖像的高度歸一化至32 pixel,寬度通過保持長寬比的方式動態調節。先等比例縮放圖像,保證圖像高度為32 pixel,寬度不足32 pixel的部分補0,超過的部分寬度縮放至32 pixel。對于并行注意力對齊模塊,其次序編碼個數對于店招文字和許可證文字分別為20,50,以針對圖中最大長度的文字限制,在前向測試中根據圖像的長寬比進行動態調整以提升計算效率。網絡中的每個卷積層默認緊跟一個批歸一化層和一個非線性整流激活函數(ReLU)。使用的網絡自注意力模塊和并行注意力對齊模塊維度均為512,其中,多頭注意力的頭部數量為8。使用Adam[20]優化器進行訓練,默認學習率為10-3,損失函數中λv=λs=λD=1,Focal Loss超參數α=0.25,γ=2 。

使用預訓練和微調的整體訓練策略。對于視覺識別模型,采用大量真實樣本和生成樣本訓練本文提出的模型。使用公開真實文字識別數據集,例如LSVT,RCTW-17,MTWI2018和CCPD以及生成文字圖像等總計4 000 000的文本數據,大量的文本圖像預訓練提升網絡的通用識別性能。對于全局語義關聯模塊,使用中文維基百科EXT等500 000 000個中文文本數據預訓練。

在微調的過程中使用實際場景的數據訓練整體網絡,其中,視覺識別模型和全局語義關聯模塊經由預訓練得到,二者微調時學習率為10-4。店招圖像的圖像數9 285,許可證條目圖像數92 200。測試集中,店招條目圖像數1 034,許可證條目圖像數10 213。遵循場景文字識別的標準評判準則,圖像正確的依據為字符串中所有文字全部正確。網絡使用4塊12 GB 顯存的NVIDIA TITAN Xp GPU進行訓練,總共訓練250個epoch。

在性能評測時,遵循行內全部文字正確識別代表該文本圖像正確識別,準確率指標計算如下:

準確率=(正確識別文本圖像數目/文本圖像數目)×

100%。

(9)

3.2 實驗結果

(1) 準確率分析

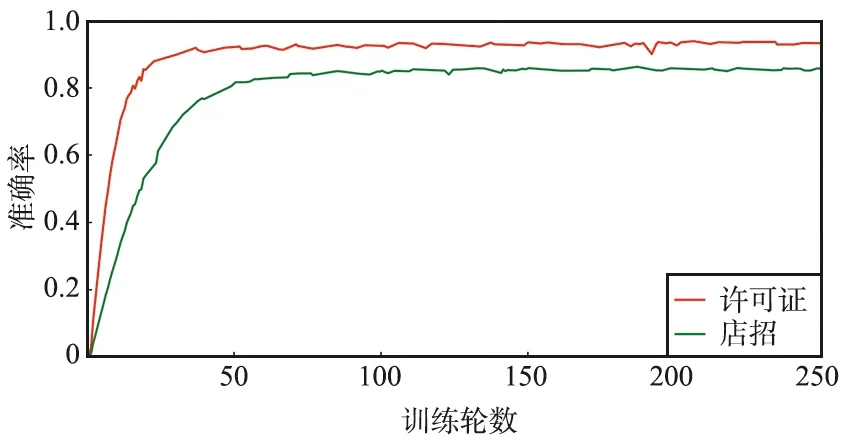

使用本文提出的結構訓練神經網絡,店招文字的識別準確率達到86.4%,許可證文字的識別準確率為94.1%。平均的GPU前向推理時間為0.073 4 s,即13.62幀/秒。訓練準確率曲線如圖7所示。

圖7 訓練準確率曲線Fig.7 Illustration of training accuracy

由圖7可以看出,訓練在50個epoch之后呈現穩定趨勢,在50~150個epoch上由于數據增強的存在,準確率微弱上升。由于許可證文字多為白底黑字,排列規整,其準確率更高、收斂速度更快。店招文字由于其多變的字體和復雜的背景,識別準確率稍低。

(2) 模型結構對比分析

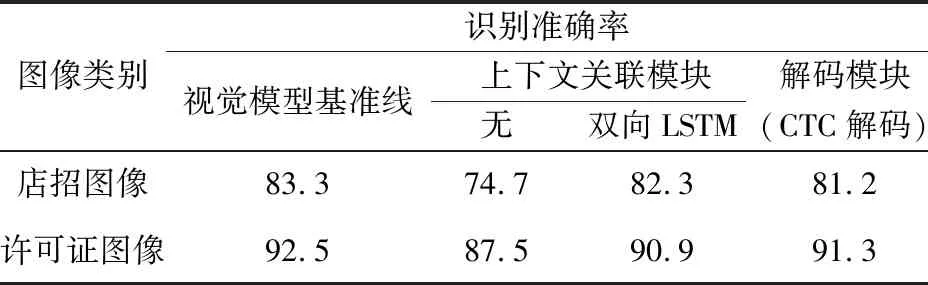

為了證明所使用方法的有效性,分別對視覺模型和語言模型的性能進行詳細比較。在視覺模型中,使用了基于自注意力模塊transformer的上下文建模和基于并行注意力機制的解碼方式作為視覺模型基準線的設置。相比于傳統方法中同等作用的CTC解碼和基于雙向LSTM的上下文建模,本文采用的方法具有最佳的識別準確率,結果如表2所示。

表2 視覺模型模塊對比實驗Tab.2 Ablation study of visual model 單位:%

上下文關聯模塊和解碼模塊分別為transformer和并行注意力解碼,在各實驗中僅替換相應模塊以達到公平比較。可以看到,使用的視覺模型相比其他算法有一定優勢,相比于傳統的雙層雙向LSTM的上下文關聯算法,使用的transformer模塊分別在店招圖像和許可證圖像識別準確率上有1.0%和1.6%的提升,說明了自注意力模塊的優越性;另一方面,使用的基于注意力的解碼模塊相比CTC解碼模塊有著2.1%和1.2%的性能增長。CTC模塊因其簡單、高速的特點,廣泛使用于文字識別的解碼中,但是由于其訓練指導性較弱,近年來逐步被訓練區域定位更精確的空間注意力機制超越。在許可證文字識別中,CTC解碼的性能相對較高,這是由于許可證文字是打印文字,其排列規律均勻,有利于CTC的解碼,但是在店招的復雜場景中,本文采用的解碼方式更能體現出優勢。

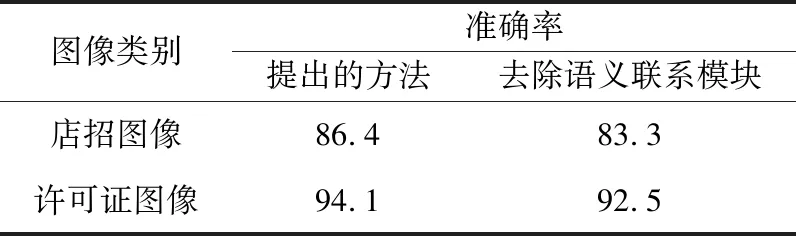

為了進一步探究語義聯系模塊在中文文字識別中起到的補充輔助作用,進行模型在沒有該模塊時的性能對比,結果如表3所示。在去除語義聯系模塊的模型中,店招文字和許可證文字識別準確率分別有3.1%,1.6%的下降,體現語義聯系模塊的重要性。其中,店招文字存在遮擋和藝術字體等原因導致純粹的視覺模型難以十分準確地識別,利用中文語言語境的關系進行識別結果的修正顯得更加重要。

表3 語義聯系模塊的比對實驗Tab.3 Ablation study of semantic association module 單位:%

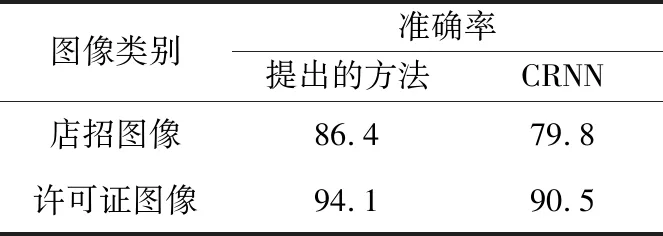

(3) 與其他方法比較

在同樣的訓練條件下和目前在中文文字識別中廣泛使用的CRNN算法進行比較,結果如表4所示。由表4可以看出,提出的網絡有更優越的性能。相比于CRNN算法,提出的方法分別有6.6%,3.6%的性能提升。由于店招圖像場景更為復雜,該方法取得了更大的提升。在規則的水平文字場景,即許可證圖像文字識別中,該方法仍然遠優于CRNN,證明了所提方法的魯棒性。

表4 和其他方法性能對比Tab.4 Comparison of performance with other methods 單位:%

部分可視化識別結果如圖8所示。圖片第一列是圖像區域的文字檢測結果,不同的文字條目檢測結果由不同的顏色區分。為了公平對比提出的方法和CRNN的差異,使用相同的文字檢測結果。文字區域執行不同的文字識別算法,其中第二列是CRNN的文字識別結果,第三列為提出的方法的識別結果,其中錯誤識別的文字用紅色字體標出。

店招文字識別結果如圖8(a)所示,可以看到店招文字由于字體的多樣性和復雜場景的干擾,對識別結果產生了較大的干擾。“嶽”在大規模訓練中是出現很少的文字,單純的圖像視覺難以正確識別,但是提出的語義關聯模型針對該場景的中文語料將其糾正為正確的識別結果。同樣,在圖中“煙”字被復雜場景遮蓋,純粹的識別模型無法直接識別,但是受到上下文的語義糾正捕捉到“煙酒商行”這一短語。

(a) 店招圖像區域識別結果展示

許可證文字的識別結果如圖8(b)所示,相比于店招文字,許可證文字排列簡單而且字體單一,但是其由于文字較小常常分辨率較低,模糊的文字干擾識別,通過語義補充可以一定程度上彌補這一不足。如圖中“雪茄”識別為“雪范”,雖然圖像的模糊對視覺識別造成困難,但是在該場景的上下文語料中能夠輕易糾正為“雪茄煙零售”。圖中“擂”字同樣很少出現在訓練的圖像中,故CRNN識別錯誤為“播”,通過結合上下文的“擂鼓”仍能給予糾正,由此體現了提出的語義信息補充在文字識別中起到了關鍵性的作用。

(4) 在公開數據集中的比對

為了證明本文提出的方法具有魯棒性,在中文公開數據集中進行對照實驗,實驗結果如表5所示。由表5可以看出,提出的方法相比于CRNN[3],SRN[9]具有更高的識別準確率。收集RCTW,ReCTS和LSVT等中文公開數據集作為本節實驗數據,其中訓練數據集包括500 000個中文字符串訓練數據,測試數據集包括60 000個。

表5 在公開數據集中和其他方法性能對比Tab.5 Comparison of performance with other methods on benchmarks

相比于傳統的純視覺模型CRNN,本文提出的方法考慮了文字的語義關系有明顯的性能提升;相較于語義關聯網絡SRN,本文使用的模塊設計以及新的損失函數等策略改變帶來了很大收益,能夠在中文數據上展示出更強的識別性能。全局語義關聯模塊采用基于雙向感知的結構,相比于SRN中使用的前向語義以及反向語義2個網絡的實現,本文提出的結構具有更少的參數量以及計算消耗。

4 結束語

本文將中文語言的語義關系融合至卷煙零售終端店招文字和許可證文字識別的模型當中,取得了良好的識別效果。其中,利用自注意力機制在視覺模型和語言模型中均取得了較大的成功:一方面,提升了識別的準確率;另一方面,減少了由于RNN帶來的耗時以及注意力機制偏差。語言模型的加入很大程度上解決了真實終端拍攝圖片存在的問題,緩解純視覺模型的固有缺陷。在未來的工作中,將著重關注模型的預訓練方式,因為對于文字識別,通用的文字識別是最終的目標,不應該有場景的區分。場景的真實樣本數量相比于公開的通用識別數據和生成圖像數據少之又少,因此,在預訓練模型的基礎上,利用少量真實場景圖像進行微調,即可提升模型在各個場景的通用性和泛化性。