基于對話者語句交互圖神經(jīng)網(wǎng)絡(luò)的對話情感分析

楊璐嫻,何 慶

(貴州大學大數(shù)據(jù)與信息工程學院,貴陽 550025)

0 引 言

隨著大數(shù)據(jù)時代的到來,以互聯(lián)網(wǎng)為基礎(chǔ)的智能化設(shè)備逐漸進入人類日常生活中的各個領(lǐng)域,用戶對于人機交互的需求日益增多,解決人機交互困境成為研究熱點。 同時,互聯(lián)網(wǎng)的發(fā)展極大地提高了人類通信交流的效率,降低了溝通成本,豐富了互聯(lián)網(wǎng)用戶通信方式和溝通渠道。 人類社交方式逐漸多元化,社交平臺的迅速崛起為人類提供便利,也為人工智能技術(shù)的發(fā)展提供了海量的研究數(shù)據(jù),對話場景下的情感分析研究應(yīng)運而生[1]。

對話情感分析作為自然語言處理的新研究方向[2],由于其廣泛的應(yīng)用場景而受到研究人員的廣泛關(guān)注,該任務(wù)旨在通過理解人類在對話中表達情緒的方式,結(jié)合對話內(nèi)容及對話者信息,識別對話中的每一個語句的情感分類[3],對提升人機交互系統(tǒng)的用戶體驗具有重要的研究意義,也是人工智能領(lǐng)域的一個重要研究方向。 對話情感分析不僅在各種社交媒體上具有極高的應(yīng)用價值,在輿情分析[4]、虛假信息檢測[5]、對話系統(tǒng)[6]和智能客服[7]等領(lǐng)域也得到了廣泛的應(yīng)用。 對話是人類最基本的交流方式,具有明顯的不連貫性和弱邏輯性,區(qū)別于篇章級的文本情感分析,對話文本的信息往往語言不連續(xù)且存在較大的跳躍性。 對話情感分析與其余的文本情感分析任務(wù)本質(zhì)上的區(qū)別在于信息的交互性。 對話信息的獲取依賴于對話語句發(fā)生的時序性、對話中的歷史信息,對于多方多輪次的對話文本,對話信息還依賴于對話者信息及其對應(yīng)語句發(fā)生的輪次等。 因此,在對話的交互過程中,需要建模對話中的語句上下文語境,改變了情感分析模型的基本建模框架,給情感分析任務(wù)帶來了極大的挑戰(zhàn)[8]。

對話場景下的語句情感判定具有復雜性。 對話示例如圖1 所示,該對話是在2019年公開的數(shù)據(jù)集MELD[9]中選取的一個3 方6 輪對話文本。 對話者Chandler 的第二句話“真孩子氣”在一般情況下會被判定為“憤怒”,但是在該場景中這句話實際上表達了對話者“悲傷”的情緒。 由此可見,在不同對話場景下語句所表達的情感是復雜且多樣的,與對話內(nèi)容的歷史信息、上下文語境、對話者情感狀態(tài)及情緒變化等信息有極高的關(guān)聯(lián)度。 因此,如何準確地捕捉對話過程中的上下文信息、語句情感信息以及與之相關(guān)聯(lián)的對話者信息是本文的研究重點。

圖1 對話示例Fig. 1 Examples of conversation

在目前的對話情感分析任務(wù)模型中,主流研究模型幾乎都需要對對話的上下文依賴信息進行建模,之前的工作已經(jīng)提出了許多模型用于對上下文依賴信息建模,包括記憶網(wǎng)絡(luò)[10]、遞歸神經(jīng)網(wǎng)絡(luò)[11]等模型,這些實驗都取得了令人滿意的效果,但是由于受到網(wǎng)絡(luò)存儲容量限制,導致遠距離上下文信息丟失,難以有效傳入當前對話中。 此外,人類情緒具有惰性和干擾性兩種特性。 其中,情緒惰性是指在沒有外界干擾的情況下,對話者自身的情緒會長期保持在同一個狀態(tài)下;情緒的干擾性是指對話者保持在一個情緒狀態(tài)時,由于其他對話人的話語刺激,激發(fā)了對話者的情緒變化。 因此,還需要充分考慮對話者信息以便建模對話者之間的情緒交互。

針對上述問題,本文提出了一種基于對話者語句交互圖神經(jīng)網(wǎng)絡(luò)的對話情感分析模型。

(1)通過微調(diào)RoBERTa 預訓練語言模型提取語句特征,引入Bi-GRU 建模對話文本序列上下文特征。

(2)通過圖神經(jīng)網(wǎng)絡(luò)建模對話上下文,并引入不同類型的有向邊和對話者節(jié)點建模對話者及其語句交互信息。

(3)在MELD 公開數(shù)據(jù)集上進行大量實驗,驗證了本文方法的有效性。

1 相關(guān)工作

對話場景下的文本情感分析作為一個具體問題場景,其研究歷史較之其他文本情感分析問題的研究較短。 目前,對話情感分析的方法主要采用基于深度學習和基于圖神經(jīng)網(wǎng)絡(luò)的方法。 對話情感分析任務(wù)在前期側(cè)重于先建模對話中語句的上下文依賴關(guān)系,Poria 等學者[12]提出了一種基于LSTM 的上下文信息提取模型,用于視頻模態(tài)的情感識別任務(wù)。Zahiri 等學者[13]提出一種用于對話文本的序列的卷積神經(jīng)網(wǎng)絡(luò)模型。 Hazarika 等學者[10]引入對話記憶網(wǎng)絡(luò),將每一位對話者的歷史語句信息融入記憶網(wǎng)絡(luò),建模對話者之間的交互關(guān)系。 Majumder 等學者[14]利用GRU 建模對話序列信息、對話者和傾聽者的情緒交互狀態(tài),再引入注意力機制捕捉長距離歷史信息。 由于近幾年圖神經(jīng)網(wǎng)絡(luò)方法在建模結(jié)構(gòu)化數(shù)據(jù)中取得的巨大進展,將圖神經(jīng)網(wǎng)絡(luò)方法應(yīng)用于對話場景下的情感分析任務(wù)也逐漸成為研究熱點。 Zhang 等學者[15]通過連接語句節(jié)點之間無向邊和對話者語句間的無向邊建模上下文依賴和對話者情感依賴信息,提出多方對話中的情感分析方法。Hu 等學者[16]利用圖卷積神經(jīng)網(wǎng)絡(luò)融合對話者內(nèi)部信息和多模態(tài)對話數(shù)據(jù),并取得較好的效果。

綜上,雖然基于深度學習方法在對于對話語言順序建模上有較好的適應(yīng)能力。 但是,對于參與者較多、對話篇幅較長的多方多輪對話中,深度學習方法的網(wǎng)絡(luò)結(jié)構(gòu)變得復雜,難以保留遠距離歷史信息。利用圖神經(jīng)網(wǎng)絡(luò)對多輪對話進行建模具有更強的可解釋性,可以更好地解決這一問題。

2 基于對話者語句交互圖神經(jīng)網(wǎng)絡(luò)的對話情感分析模型

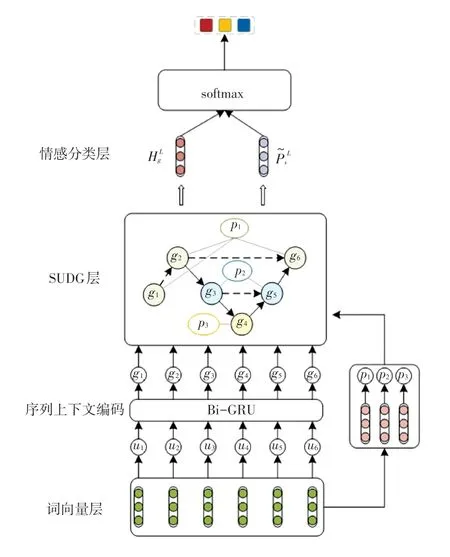

一個完整的對話由多個語句組成,在對話情感分析任務(wù)中,給定的對話文本U =u1,u2,…,un,其中ui表示對話U中的第i句話,n表示語句個數(shù)。 對于多方對話文本,每個語句所對應(yīng)的說話人表示為p(ui) ∈P,P =p1,p2,…,pm,m表示說話人個數(shù)。對話文本的情感分析任務(wù)目的在于預測對話中每個獨立語句ui的情緒標簽。 參見圖1 的簡單對話示例,對話中的第6 句話:“真是膽小鬼!”,僅關(guān)注句子本身很難識別說話人真實的情緒,對話情感分析依賴于對話發(fā)生的順序、對話上下文語境以及對話者人信息等。 本文模型框架如圖2 所示。

圖2 模型框架Fig. 2 Framework of the model

2.1 對話特征提取

對于對話語句的特征表示,本文通過微調(diào)RoBERTa 預訓練語言模型將對話文本序列轉(zhuǎn)換為詞向量形式。 為便于訓練和微調(diào),本文將對話語句ui定義為“[CLS],”作為模型中對話語句的輸入。 數(shù)學表達式如下所示:

對于對話者特征表示,本文將訓練集中一個對話者所說的所有語句特征的平均值設(shè)為該對話者的特征表示。 在進行實驗時,若某對話者只出現(xiàn)在測試集中,則將測試集中該對話者所說的所有語句特征平均值設(shè)置為該對話者特征表示。

2.2 序列上下文層級編碼

對話的進行是連續(xù)且有序的,上下文信息會根據(jù)對話順序流動,所以對話的語句順序上下文信息是對話中的重要特征。 GRU 是RNN 的一種變體,相較于RNN,保留了長期序列信息,并且減少了梯度消失的問題,但由于GRU 無法編碼從后往前的依賴信息,造成對話信息缺失,因此引入Bi-GRU 來生成文本的序列上下文特征,其數(shù)學模型如下:

2.3 對話者語句交互有向圖模型SUDG

2.3.1 對話圖構(gòu)建

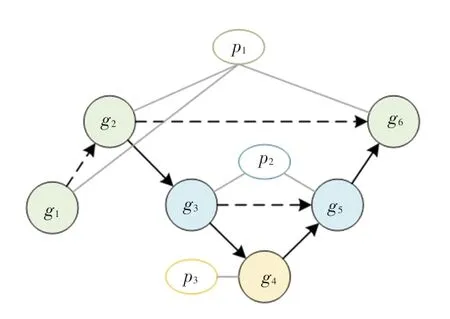

本文,將對話圖定義為G ={Vg,Vs,ε,R},其中Vg ={g1,g2,…,gn} 表示對話中的語句節(jié)點,Vs ={p1,p2,…,pm} 表示對話者節(jié)點,ε表示連接這些節(jié)點和邊的信息集合,R ={r1,r2,r3} 表示邊的關(guān)系類型。 考慮到多方對話中多名不同對話者之間的情緒交互影響,本文將邊關(guān)系類型定為3 種:

(1)同一對話者說出的不同語句節(jié)點間的邊為r1;

(2)不同對話者說出的語句節(jié)點之間的邊為r2;

(3)每個語句節(jié)點與其對應(yīng)的對話者節(jié)點之間的邊為r3。

由于對話的進行具有時序性,對話中已發(fā)生的語句可以對對話者的情緒產(chǎn)生影響,繼而影響即將發(fā)生的語句情感,反之,未發(fā)生的語句卻不能影響已發(fā)生的語句情感。 因此,r1和r2是有向邊,根據(jù)對話發(fā)生順序模擬對話中的時間關(guān)系。r3為無向邊,用于傳遞整個對話中語句與其對應(yīng)的對話者信息。

圖3 是根據(jù)圖1 構(gòu)建的對話者語句交互圖示例。對話中有6 個語句{g1,g2,…,g6},3 個對話者{p1,p2,p3},其中g(shù)1、g2、g6來自對話者p1,g3、g5來自對話者p2,g4來自對話者p3。 圖3 中的有向虛線、即r1,有向?qū)嵕€、即r2,無向?qū)嵕€、即r3。

圖3 對話者語句交互圖示例Fig. 3 Sample of Speaker utterance interaction graph

2.3.2 SUDG 層

SUDG 模型是一個異構(gòu)有向圖神經(jīng)網(wǎng)絡(luò),有2種不同的節(jié)點,因此需要2 種不同的信息傳播方法。對于語句節(jié)點Vg需要考慮對話序列上下文信息和對話者信息,而對于對話者節(jié)點Vs只需要考慮其對應(yīng)的語句。 因此鄰接矩陣A也需要分為不同模塊:

其中,A∈R(n+m)?(n+m);Ag表示語句之間的邊;As表示對話者節(jié)點與其語句之間的邊;O是0 矩陣。 同時,定義語句節(jié)點的特征矩陣為,對話者節(jié)點的特征矩陣為。

對話信息根據(jù)語句順序傳遞,語句節(jié)點要聚合相鄰節(jié)點信息和邊關(guān)系類型信息,而SUDG 構(gòu)建的對話圖是多關(guān)系圖,語句節(jié)點間的邊關(guān)系類型有r1和r2兩種,因此本文引入基于不同關(guān)系的圖注意力機制計算注意力權(quán)重。 對于節(jié)點Vgi通過節(jié)點在l層的隱層特征和邊關(guān)系特征計算得到注意力權(quán)重,數(shù)學模型如下:

語句節(jié)點在l +1 層的最終表示如式(8)所示:

給定對話者的所有語句的聚合特征可以通過鄰接矩陣As計算:

融合對話者信息的對話語句的特征表示如下:

2.3.3 情感分類

本文將所有圖網(wǎng)絡(luò)層的對話語句隱藏層狀態(tài)拼接作為對話語句的最終表示,通過一個全連接層和softmax層即可預測對話語句的情緒標簽,數(shù)學模型如下:

其中,S表示情緒標簽合集。

本文使用標準交叉熵作為損失函數(shù):

3 實驗與結(jié)果分析

3.1 實驗數(shù)據(jù)集

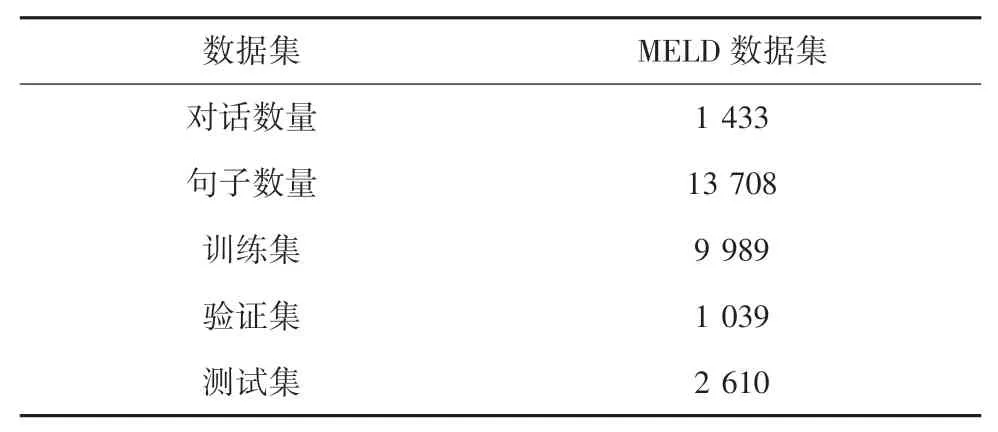

本文使用的是2019年公開的英文數(shù)據(jù)集MELD[9]。 MELD 來自于美劇《老友記》部分內(nèi)容片段,包含1 433 段對話,超過13 000 句話,每句話都被標注了情緒標簽,標簽分為中性、憤怒、厭惡、高興、恐懼、悲傷和驚訝7 種情緒分類。 MELD 是一個包含多名對話者的多模態(tài)數(shù)據(jù)集,本文只關(guān)注于文本模態(tài)數(shù)據(jù),數(shù)據(jù)集具體內(nèi)容見表1。

表1 數(shù)據(jù)集參數(shù)Tab. 1 Parameters of datasets

在驗證實驗中,為了衡量模型對所有標簽的分類精確度和有效性,本文使用宏平均F1分數(shù)作為評價指標。

3.2 實驗設(shè)置

本文實驗在型號為NVIDA GTX 3090 的GPU服務(wù)器上進行,使用Intel(R) Core(TM) i5-7500 處理器,內(nèi)存大小為8 GB,選用版本號為Ubuntu 18.04.3 LTS 的Linux 操作系統(tǒng),模型是基于PyTorch 深度學習框架搭建。 模型在訓練的過程中采用Adam優(yōu)化器來優(yōu)化模型參數(shù),通過驗證集調(diào)整超參數(shù),學習率為1×10-5,丟失率為0.3,批量大小為32。

3.3 與基準模型比較

本文選用以下模型進行對比分析:

(1)KET[17]:使用一個外部知識網(wǎng)絡(luò)增強語句信息,再結(jié)合上下文感知情感圖注意力機制動態(tài)的增強上下文信息,以增強情感分類的性能。

(2)DialogueRNN[14]:使用GRU 建模對話者狀態(tài)和全局上下文信息,聚合對話者的情緒狀態(tài),建模對話者間的關(guān)系,可應(yīng)用于多方對話場景。

(3)DialogueGCN[18]:使用GCN 增強上下文信息,以句子為節(jié)點,對話圖中基于固定上下文窗口連接不同關(guān)系節(jié)點,提出句子和對話者之間的有8 種關(guān)系類型,同時考慮歷史信息和未來信息。

(4)DAG-ERC[19]:通過有向無環(huán)圖建模對話上下文,對話圖以邊關(guān)系類型建模對話者與句子關(guān)系,只關(guān)注歷史信息。

(5)RGAT[20]:對不同對話者關(guān)系位置編碼建模對話結(jié)構(gòu),使用圖注意力網(wǎng)絡(luò)更新節(jié)點,同時考慮歷史信息和未來信息。

(6)ICON[21]:使用記憶網(wǎng)絡(luò)儲存對話者情感信息和全局狀態(tài)信息,是一個多模態(tài)情感檢測框架。

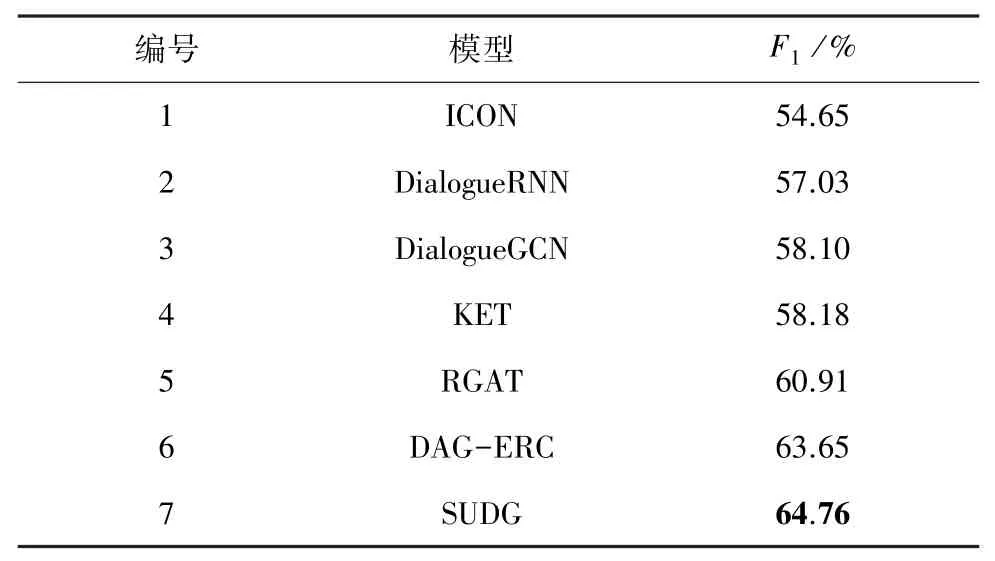

在MELD 數(shù)據(jù)集上的情感分析實驗結(jié)果見表2。

表2 不同模型結(jié)果對比Tab. 2 Comparison with others model

根據(jù)表2 可知,在MELD 數(shù)據(jù)集上,SUDG 與ICON 模型相比F1值提高了10.11%,提升效果最佳,說明SUDG 更適用于文本特征任務(wù)。 與使用RNN 和GCN 的模型相比F1值分別提高了7.73%和6.66%,說明在多方多輪對話語境中,過于復雜的模型反而會因為計算量龐大,導致上下文信息部分丟失,影響分類效果。 與KET 模型和RGAT 模型相比,F(xiàn)1值提高了6.58%和3.85%,說明基于圖網(wǎng)絡(luò)的方法能更好地建模對話上下文信息,高效的傳遞對話歷史信息。 與DAG-ERC 模型相比,F(xiàn)1值提高了1.11%,說明加入語句對話者信息能豐富對話中的上下文語境信息,同時證明了本文在圖網(wǎng)絡(luò)中加入語句對話者節(jié)點構(gòu)圖策略的有效性。

3.4 消融實驗

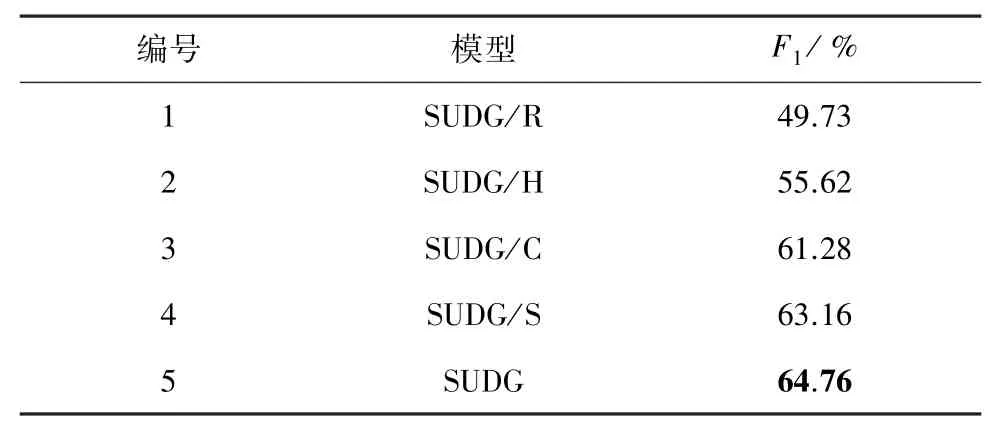

為了驗證各個組件對模型的影響,本文進行了消融實驗,具體內(nèi)容如下:

(1)SUDG/R:移除序列上下文編碼部分和對話者交互有向圖模型。

(2)SUDG/C:僅移除序列上下文編碼部分,其他層保持不變。

(3)SUDG/H:僅移除對話者交互有向圖模型,其他層保持不變。

(4)SUDG/S:移除對話者交互有向圖模型中所有的對話者節(jié)點,引入一個隨機初始化的全局節(jié)點代替原始對話者節(jié)點的位置,同時全局節(jié)點連接所有語句節(jié)點,用以驗證融合對話者與對應(yīng)語句關(guān)系信息的有效性,其他層保持不變。

消融實驗結(jié)果對比見表3。 根據(jù)表3 可知,相比于只使用了RoBERTa 語言模型的SUDG /R 而言,SUDG /H 和SUDG /C 的F1值分別提高了5.89%和11.55%,說明在多輪對話中語句情感對上下文信息依賴性強,將對話上下文信息進行順序建模可以大幅度提高模型情感分類效果,并且基于圖神經(jīng)網(wǎng)絡(luò)的方法能更有效地傳遞對話歷史信息。 相比于將對話者節(jié)點全部替換為全局節(jié)點的SUDG/S模型,SUDG 的F1值提高了1.60%,說明對話者節(jié)點與其對應(yīng)語句連接可以有效提升模型對語句信息的提取,降低引入冗余信息的概率,提高模型情感分類準確率。 SUDG 整體性能表現(xiàn)最佳,表現(xiàn)出全方位性能的顯著提升,展示不同模型間的協(xié)同互補。

表3 消融實驗結(jié)果對比Tab. 3 Results of ablation experiments

4 結(jié)束語

本文提出一種基于對話者交互圖神經(jīng)網(wǎng)絡(luò)的對話情感分析模型(SUDG)。 利用RoBERTa 預訓練語言模型提取文本特征;針對多輪多方對話文本中語句情感對語句序列的高依賴性,結(jié)合Bi-GRU 將對話語句進行序列上下文編碼;通過圖結(jié)構(gòu)建模對話上下文依賴關(guān)系,引入對話者信息節(jié)點,連接對話者節(jié)點及其對應(yīng)語句,以提高對話情感分析中的上下文信息理解能力,傳遞遠距離歷史信息,減少冗余信息的引入,提高模型情感分類準確率。 實驗結(jié)果表明了SUDG 模型的有效性,在MELD 數(shù)據(jù)集上與其他模型相比,該模型在對話情感分析中表現(xiàn)出良好的分類效果。 本文關(guān)注了對話者信息對語句情感的增強作用,未來將探索如何引入外部知識庫增強語句情感信息。