基于深度學習的相機與激光雷達融合標定算法

摘要:在自動駕駛技術飛速發展的今天,實現精準多目標感知已成為該領域的關鍵挑戰。提出一種基于深度學習的相機與激光雷達融合標定算法,旨在通過整合2種傳感器的優勢,實現在三維空間中對目標的高效跟蹤。通過系列試驗驗證,發現該算法的總準確率達到88.54%,檢測時間為0.03 s,顯示其性能優越。此外,該算法針對目標跟蹤計算,其X軸和Y軸的誤差分別控制在4.48像素和1.81像素之內,使得整體處理時間僅為0.084 s,由此進一步證明了該算法在實時性與精度上的平衡優勢。

關鍵詞:自動駕駛;深度學習;相機;激光雷達;融合技術

0 前言

隨著自動駕駛技術的迅猛發展,提升駕駛體驗的舒適度與安全性已成為研究的新焦點。深度學習技術的引入,為自動駕駛性能的提升提供了無限可能,同時也為多目標檢測領域帶來了創新的視角[1]。本文提出了一種基于深度學習的相機與激光雷達的融合標定算法,該算法結合了單目相機與激光雷達的優勢,實現了2者的融合標定與目標檢測。該方法不僅有效克服了單一數據源在目標檢測中可能遇到的局限,而且顯著提升了自動駕駛技術在自動跟蹤方面的精度與可靠性。通過這種融合策略,能夠更全面地捕捉和理解車輛周圍的環境,為自動駕駛系統的決策提供更加豐富和精確的數據支持。

1 融合標定算法

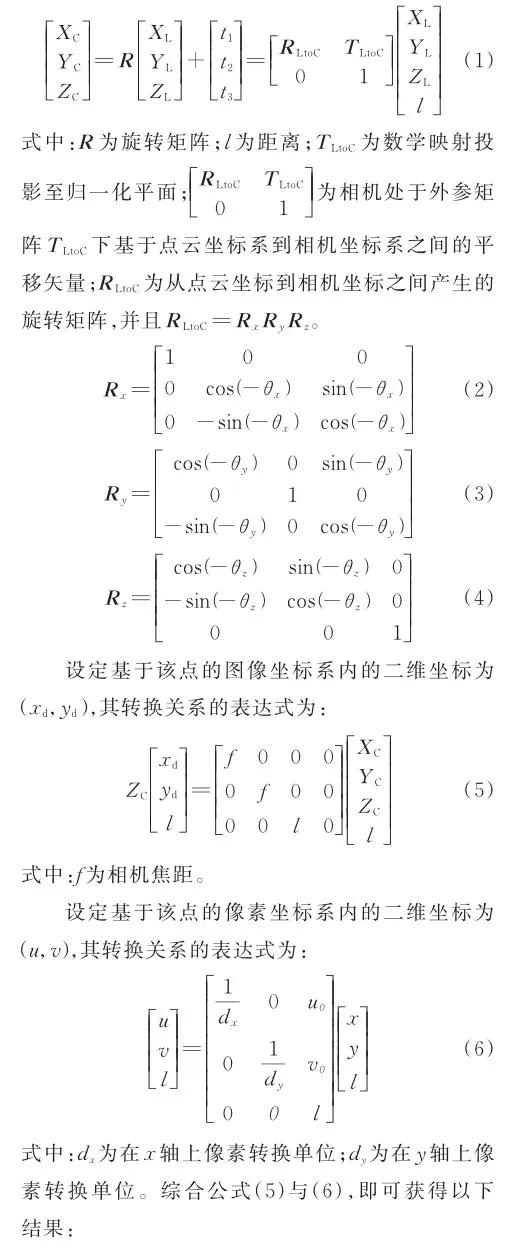

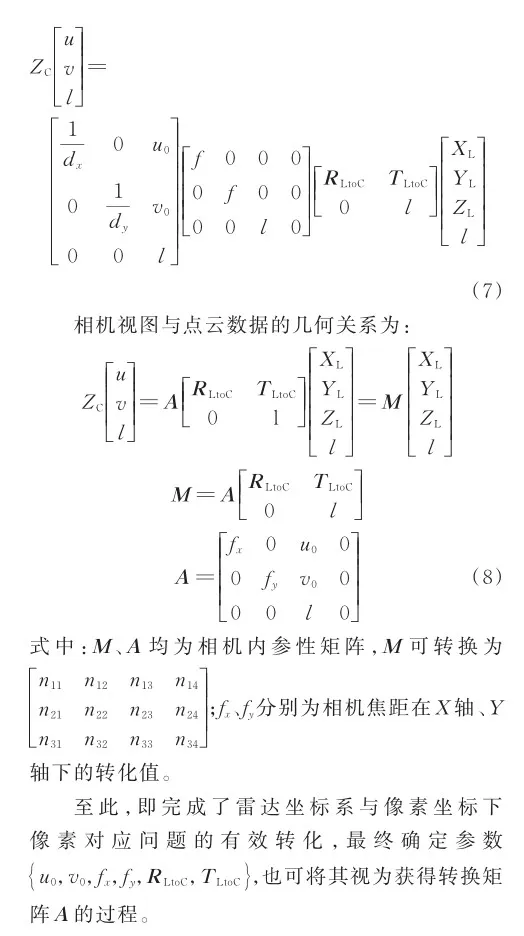

在三維坐標系內,二維平面內的像素與激光點云坐標系之間呈現出幾何關聯度。該模型參數的推導過程,實際上就組成了相機與激光雷達融合標定的具體過程。為此,標定參數求解可通過一組方程來進行[2]。

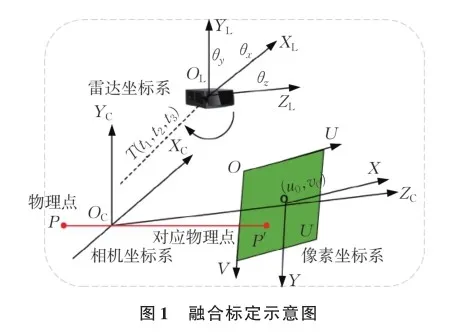

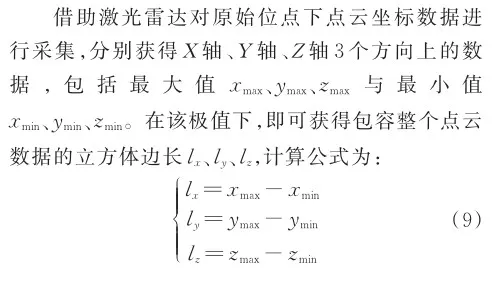

圖1展現了相機與激光雷達融合標定的原理和架構。基于該設定,激光雷達坐標系被設定為OL、XL、YL、ZL。其中在像素坐標系內,分別為原點O,以及X軸和Y軸,而在相機坐標系內,分別為原點O,以及U軸和V軸;θx、θy、θz表示相機在X、Y、Z軸上的旋轉角度,T(t1,t2,t3)表示雷達坐標系平移向量,(u0,v0)則表示像素坐標系內圖像原點所投射的坐標。

設定基于三維空間中的某物理點P,在3D激光雷達坐標系中的坐標為( XL,YL,ZL),而在相機坐標系的坐標為( XC,YC,ZC)。這2個不同的坐標系均屬于三維空間坐標系,兩者之間轉換過程的表達式為:

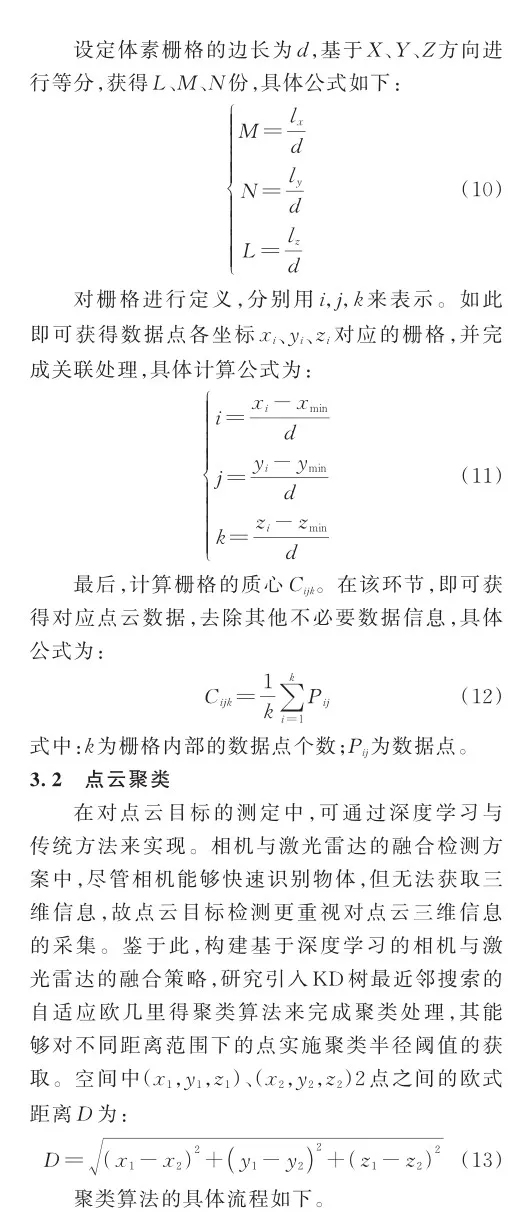

2 基于機器人操作系統(ROS)的實時傳輸圖像和點云

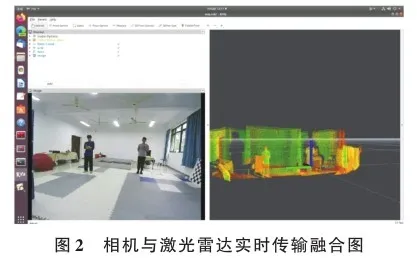

本次所構建的基于深度學習的相機與激光雷達融合技術需要從現實世界中獲取圖像和點云相關信息,為此,通過ROS庫中訂閱器、發布器來實現通信,隨后再利用回調函數,基于幀率實現圖像數據和云數據的傳遞。通過ROC完成python程序中節點的編寫處理。基于該節點,即可實現相機與激光雷達數據的有機對接,并完成相關轉換和處理。融合標定的外參數據通過將USB相機數據和RSLidar M1激光雷達進行坐標轉換,以確保它們能夠在相同坐標下對齊。在該點上,經由ROS的發布者即可達成數據融合,并使其存放于話題下,確保其他節點能夠共享。基于ROC消息傳輸機制即可促使融合數據傳輸到對應節點,保證節點能夠遵循相應頻率完成數據發表,以更好地滿足實時信息傳遞的需求。相機與激光雷達實時傳輸生成的融合圖片如圖2所示。

3 基于深度學習的相機與激光雷達的融合技術的目標檢測

3. 1 點云降采樣

激光雷達有著優越的性能,具備極高的距離分辨率、角度分辨率,其測距精度能夠達到厘米級,但獲得的數據通常伴隨有離群點、噪聲、不規則密度等問題。這些問題需在后續的點云數據處理中予以解決,以保障點云信息提取、匹配等相關要求。點云濾波是點云處理的第一步,其主要目的是促使數據量下降。過多的點云數據必然會給后續融合工作造成極大困難。盡管隨機采樣的效率更高,但卻會導致點云微觀結構遭受破壞。而采用體素濾波則能夠在保障效率的同時,不對數據造成影響。

步驟1:獲取空間內的某點pi,運用KD樹完成鄰近區域搜索,確定最近n個點并完成其與點pi之間的距離計算,將距離小于閾值的r點納入集合Q內。

步驟2:基于集合Q,檢索pi之外的其他點,將距離小于閾值標準的r點再次納入集合Q;持續實施迭代處理,直至集合Q內點數不再發生改變。

步驟3:基于集合Q中的每個點做出相應操作,針對任意的pi∈Q,即可獲取一個聚類點云簇。完成聚類之后即可設定限定尺寸標準,保留最小與最大的聚類點閾值之間的障礙物。

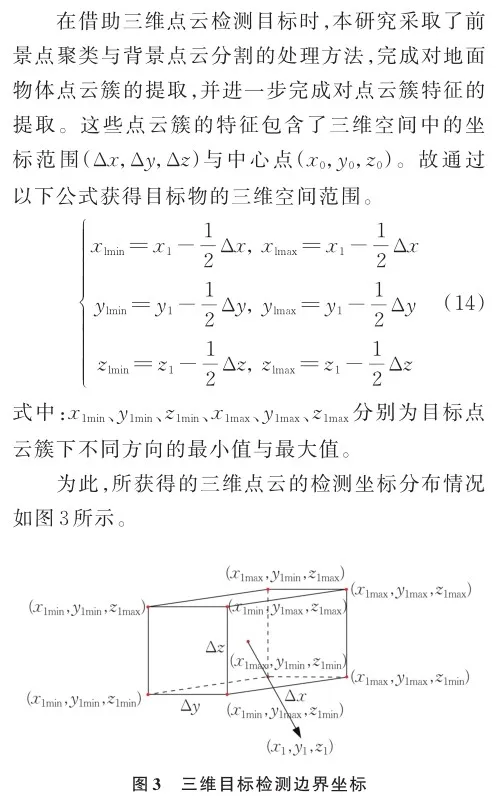

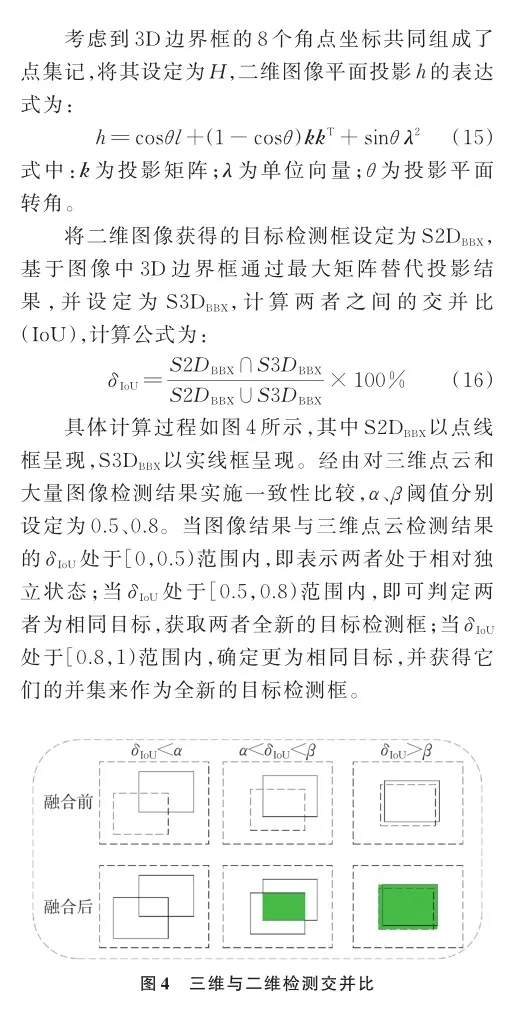

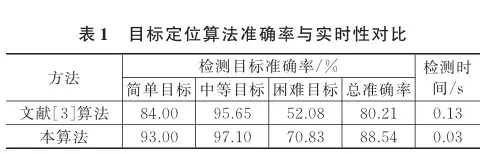

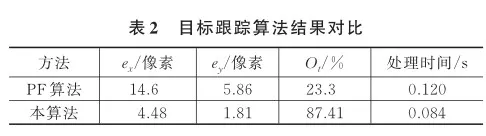

本研究結合不同距離的目標提出了不同的閾值范圍,具體為:0 3. 3 相機與激光雷達的融合 4 試驗結果與分析 4. 1 算法的準確率與實時性驗證 為驗證本算法的整體可靠性,隨機獲取100張Kitti數據集中的點云和對應圖像,通過手動標記的確定192個識別框,經由激光雷達點云篩選獲得對比結果,判定其準確率。以崔善堯等[3]研究結果為對照,具體見表1。 由表1可知,與文獻[3]結果對比,本算法面對簡單、中等、困難目標的準確率均有不同程度提升,總準確率有明顯提升,同時檢測時間也顯著縮短。 4. 2 算法效果 為驗證所提算法的跟蹤效果,將其與粒子濾波(PF)算法進行對比,通過定量分析觀察不同算法下跟蹤結果,并通過ex、ey表示X軸、Y軸上的誤差,同時獲取平均區域重疊率Ot,見表2。 由表2可知,本次算法基于鄰近兩幀檢測目標和時間間隔來確定目標移動速度,并通過圖像檢測框與速度來完成中心坐標融合處理,取得了較好的跟蹤效果。與PF算法對比,本次算法具有較好的擬合真實性,在X軸與Y軸上的偏差均更低,并且平均區域重疊率更高,每幀耗費的時長更短。 5 結語 針對高速發展的自動駕駛技術,本研究基于深度學習提出了相機與雷達激光融合算法。根據本次研究目標,首先完成了融合標定算法的架設,并基于ROS明確了實時傳輸圖像和點云技術,結合深度融合目標檢測提出了點云降采樣策略,引入KD樹最近鄰搜索的自適應歐幾里得聚類算法進行點云聚類,最終通過三維空間完成相機與激光雷達的融合。通過對比分析,證實本次算法具有較高準確率和實時性,并且目標跟蹤效果較為理想。 參考文獻 [1] 齊繼超,何麗,袁亮,等.基于單目相機與激光雷達融合的SLAM方法[J].電光與控制, 2022,29(2):99-102,112. [2] 吳瓊,時利,謝欣燕,等.基于視覺標記板的自動駕駛車輛激光雷達與相機在線標定研究[J].汽車技術,2020(4):40-44. [3] 崔善堯,賈述斌,黃勁松.圖像與激光點云融合的實時目標定位算法[J].導航定位學報, 2023,11(2):99-105.