智能技術(shù)教育應(yīng)用倫理審視與紓解:基于戈夫曼“擬劇論”的視角

楊文正 陳選超

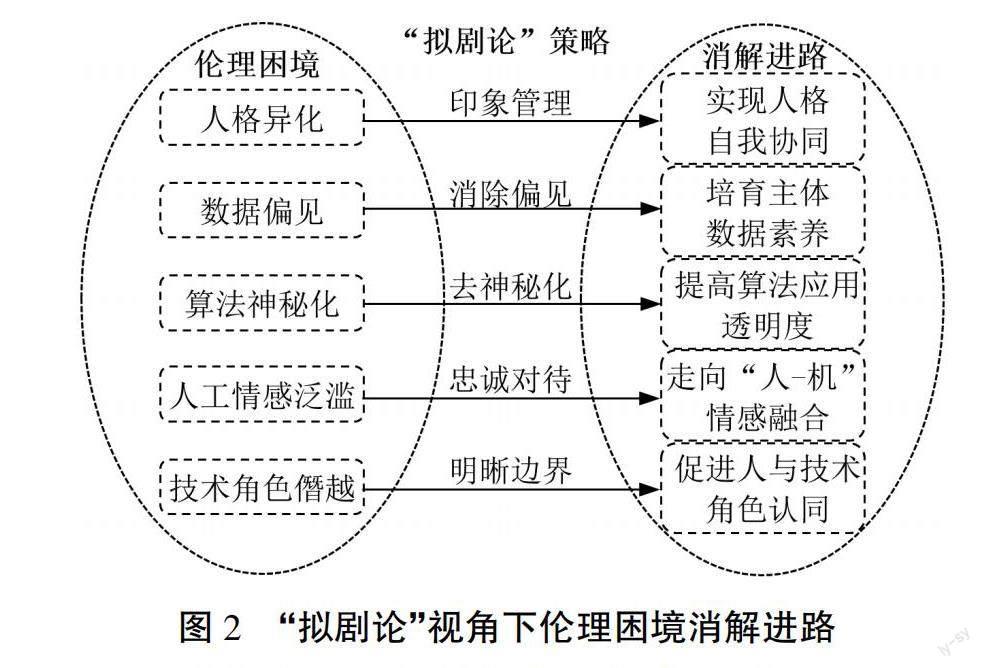

[摘?要]?智能技術(shù)在賦能教育系統(tǒng)轉(zhuǎn)型升級(jí)的同時(shí),也引發(fā)諸多倫理問題。基于戈夫曼“擬劇論”分析框架,從區(qū)域行為、理想化自我、神秘化、缺席對(duì)待、再合作行為等視角切入剖析智能技術(shù)教育應(yīng)用引發(fā)的五個(gè)典型倫理問題,即人格異化、數(shù)據(jù)偏見、算法黑箱、人工情感泛濫和角色入侵。依此提出“印象管理:實(shí)現(xiàn)人格的自我協(xié)同;消除偏見:培育主體的數(shù)據(jù)素養(yǎng);去神秘化:提高算法應(yīng)用透明度;忠誠(chéng)對(duì)待:走向‘人—機(jī)’情感融合;明晰邊界:促進(jìn)人與技術(shù)的角色認(rèn)同”的消解進(jìn)路,紓解智能技術(shù)教育應(yīng)用導(dǎo)致的倫理沖突。微觀社會(huì)學(xué)給人們思考智能技術(shù)教育應(yīng)用倫理問題提供新的視角,所提出的倫理消解策略能為智能技術(shù)與教育系統(tǒng)的良性融合、生態(tài)發(fā)展提供借鑒。

[關(guān)鍵詞]?智能技術(shù); 教育應(yīng)用; 倫理; 歐文·戈夫曼; 擬劇論; 印象管理; 人工情感

[中圖分類號(hào)] G434?[文獻(xiàn)標(biāo)志碼] A

[作者簡(jiǎn)介]?楊文正(1979—),男,云南大理人。副教授,博士,主要從事信息技術(shù)教育應(yīng)用研究。E-mail:yang121@yeah.net。

一、引??言

智能技術(shù)在教育領(lǐng)域的深度應(yīng)用,助推教育系統(tǒng)向數(shù)字化、智能化轉(zhuǎn)型升級(jí),同時(shí)引發(fā)的系列科技倫理問題也受到廣泛關(guān)注。2021年11月,聯(lián)合國(guó)教科文組織發(fā)布了《人工智能倫理問題建議書》,為人工智能應(yīng)用的倫理治理提供了國(guó)際共識(shí)框架,最大限度地發(fā)揮人工智能技術(shù)優(yōu)勢(shì)并降低其應(yīng)用帶來的風(fēng)險(xiǎn)。2022年3月,中共中央、國(guó)務(wù)院辦公廳印發(fā)了《關(guān)于加強(qiáng)科技倫理治理的意見》,旨在建立健全科技倫理治理機(jī)制與體系,應(yīng)對(duì)科技倫理帶來的挑戰(zhàn)。隨著智能技術(shù)與教育融合的不斷加深,智能技術(shù)嵌入教育過程隱藏的倫理問題日益暴露,如何規(guī)避智能技術(shù)教育應(yīng)用引發(fā)的價(jià)值、責(zé)任、隱私和人性等方面的倫理隱憂,做到技術(shù)賦能與倫理建設(shè)協(xié)同發(fā)展,成為技術(shù)與教育變革關(guān)系探討亟待研究的議題。

已有學(xué)者從不同視角對(duì)智能技術(shù)教育應(yīng)用倫理進(jìn)行了省思。張務(wù)農(nóng)以芬伯格工具化理論為視角,從倫理起點(diǎn)、倫理中介和倫理實(shí)現(xiàn)三個(gè)層面,為教育技術(shù)工具的合理運(yùn)用構(gòu)建了相應(yīng)的倫理原則。孫田琳子從伯格曼技術(shù)哲學(xué)理論視角,審視了虛擬現(xiàn)實(shí)技術(shù)教育應(yīng)用的異化本質(zhì)。鄒太龍等充分挖掘舍恩伯格大數(shù)據(jù)教育應(yīng)用思想蘊(yùn)含的倫理關(guān)懷,形成大數(shù)據(jù)技術(shù)教育應(yīng)用倫理分析框架。趙磊磊等從責(zé)任倫理視角構(gòu)建出教育人工智能倫理治理的框架。謝娟提出識(shí)別人工智能教育應(yīng)用倫理困境的一般方法,進(jìn)而闡釋了人工智能教育應(yīng)用倫理問題策略的形成過程。

智能技術(shù)持續(xù)快速地發(fā)展決定了倫理風(fēng)險(xiǎn)的不確定性,加之教育領(lǐng)域各種技術(shù)應(yīng)用交織雜糅,一定程度上增加了智能技術(shù)教育應(yīng)用倫理治理的復(fù)雜性,這要求我們反復(fù)詰問智能技術(shù)與教育深度融合帶來的倫理困厄,從新的視角提出消解策略或制定相應(yīng)的倫理規(guī)約。本研究嘗試從歐文·戈夫曼(Erving Goffiman)“擬劇論”視角,審視智能技術(shù)教育應(yīng)用呈現(xiàn)的典型倫理問題,并提出相應(yīng)倫理困境的消解進(jìn)路,為智能技術(shù)與教育系統(tǒng)的良性融合、生態(tài)發(fā)展提供借鑒。

二、戈夫曼“擬劇論”核心觀點(diǎn)闡釋

“擬劇論”是美國(guó)社會(huì)學(xué)家戈夫曼為了探索自然人在社會(huì)生活中的角色定位及群體價(jià)值,融合社會(huì)學(xué)、戲劇學(xué)和美學(xué)等多學(xué)科概念而提出的社會(huì)學(xué)理論。戈夫曼在其經(jīng)典著作《日常生活中的自我呈現(xiàn)》(1956年版/1959年版)中,以戲劇隱喻方式對(duì)人際關(guān)系和社會(huì)生活進(jìn)行系統(tǒng)化、理論化闡釋,發(fā)展出一套“擬劇論”的術(shù)語(yǔ)和框架,用于分析人們共同在場(chǎng)的面對(duì)面互動(dòng)。“擬劇論”分析的對(duì)象是日常生活的微觀情境與互動(dòng)系統(tǒng),即通過系統(tǒng)性闡述情境社會(huì)學(xué)來分析日常生活的表演和社會(huì)秩序的構(gòu)成。如今,戈夫曼的《日常生活中的自我呈現(xiàn)》成為社會(huì)科學(xué)領(lǐng)域微觀互動(dòng)分析的重要引證來源,理論內(nèi)涵也得到更為具體、多元化的表達(dá),在戲劇學(xué)、傳播學(xué)、教育學(xué)等領(lǐng)域彰顯出強(qiáng)大的解釋力。

戈夫曼認(rèn)為社會(huì)是一個(gè)劇院,人在日常生活中的自我呈現(xiàn)實(shí)際上是一種角色表演,其中的呈現(xiàn)行為是一種帶有主動(dòng)性的展現(xiàn)或表演。他將表演定義為“特定的參與者在特定的場(chǎng)合,以任何方式影響其他參與者的所有活動(dòng)”。表演的場(chǎng)域分為前臺(tái)和后臺(tái),前臺(tái)既是個(gè)體在表演期間使用的、標(biāo)準(zhǔn)的表達(dá)性裝備,也是具有一整套抽象的、模式化的期待,能幫助表演者在表演時(shí)傳達(dá)出那些被強(qiáng)調(diào)的事實(shí)或他們希望呈現(xiàn)的信息;后臺(tái)是指戲劇幕布后準(zhǔn)備、化妝、休息的區(qū)域,也是凸顯被掩蓋的事實(shí)或呈現(xiàn)不能表現(xiàn)于前臺(tái)信息的區(qū)域;在前后臺(tái)的各種活動(dòng)即是“區(qū)域行為”。

戈夫曼認(rèn)為在特定情境中,個(gè)體呈現(xiàn)自己在他人心中的形象并非是完全而真實(shí)的自我,而是為了創(chuàng)造出在他人心目中特定形象(或印象)而進(jìn)行的表演。這種表演的目的在于突出某些本相而掩飾另一些本相,以此來引導(dǎo)或控制呈現(xiàn)自己在他人心目中的形象,從而創(chuàng)造出“理想化”的自我。表演過程中,表演者還需與觀眾保持距離,即通過限制接觸,調(diào)節(jié)信息來往之間的關(guān)系,使觀眾處于一種深感神秘的狀態(tài)之中,對(duì)表演者產(chǎn)生敬畏或神圣完善感,這就是“擬劇論”中的“神秘化”。戈夫曼還對(duì)缺席對(duì)待、再合作行為等角色外溝通的類型進(jìn)行了探討。缺席對(duì)待是指劇班成員轉(zhuǎn)入后臺(tái)時(shí),以一種不同于他們?cè)谟^眾面前呈現(xiàn)的方式,對(duì)觀眾進(jìn)行貶損或褒獎(jiǎng),以促進(jìn)劇班更好地分享秘密,形成“共同體”。有時(shí),劇班成員也會(huì)圍繞、超越甚至離開劇班界線進(jìn)行活動(dòng),在多個(gè)劇班之間建立起臨時(shí)的、非正式的或是受到控制的溝通途徑,呈現(xiàn)出一種“再合作行為”,在這種非正式溝通中,各種角色入侵現(xiàn)象隨之表現(xiàn)出來。

戈夫曼將“擬劇”隱喻引入人際社會(huì)微觀互動(dòng)分析中,并形成理論體系,在傳統(tǒng)人際互動(dòng)中表現(xiàn)出較強(qiáng)的解釋力和生命力。“擬劇論”自20世紀(jì)60年代形成至今,得到不斷的豐富與發(fā)展,國(guó)內(nèi)外諸多學(xué)者對(duì)其價(jià)值意蘊(yùn)進(jìn)行批判與辯證思考,并拓展其應(yīng)用領(lǐng)域。伴隨技術(shù)滲透人類生活,技術(shù)在人與人交往中的作用越來越突顯,技術(shù)中介所引發(fā)的人與人之間的倫理問題成為倫理學(xué)關(guān)注的重要研究議題。本文借鑒“擬劇論”分析框架,并將其延伸至“人技”互動(dòng)場(chǎng)景,以新的視角切入剖析智能技術(shù)教育應(yīng)用帶來的倫理困厄。

三、智能技術(shù)教育應(yīng)用倫理困境審視

智能技術(shù)是以人工智能、虛擬現(xiàn)實(shí)、大數(shù)據(jù)等為核心要素,相互融合組成的技術(shù)體系,具有智能化特征的動(dòng)態(tài)系統(tǒng)。其在打破學(xué)習(xí)時(shí)空限制、沉浸性學(xué)習(xí)場(chǎng)景構(gòu)建、教學(xué)過程智能分析、學(xué)習(xí)者畫像和知識(shí)圖譜生成等方面顯示出強(qiáng)大的賦能作用。智能技術(shù)教育應(yīng)用將促進(jìn)教育系統(tǒng)向個(gè)性化、智能化、多元化方向演進(jìn),但隨之而來的倫理安全風(fēng)險(xiǎn)也與日加劇,倫理問題日益突顯。特別是生成式人工智能技術(shù)的不斷涌現(xiàn),人機(jī)之間角色僭越問題愈發(fā)嚴(yán)重,成為制約人機(jī)協(xié)同的重大挑戰(zhàn)。以下將以“擬劇論”視角為分析框架(如圖1所示),對(duì)智能技術(shù)在教育應(yīng)用過程中帶來的五種典型倫理問題進(jìn)行審視。

(一)區(qū)域行為界限模糊致使人格異化

虛擬現(xiàn)實(shí)、數(shù)字孿生、元宇宙等技術(shù)在教育領(lǐng)域的應(yīng)用,在學(xué)習(xí)動(dòng)機(jī)激發(fā)、學(xué)習(xí)體驗(yàn)和知識(shí)應(yīng)用場(chǎng)景遷移等方面都具有促進(jìn)作用。特別是具有“類人性”和“超人性”功能的虛擬數(shù)字人,幾乎能做到“以假亂真、以虛代實(shí)”,成為現(xiàn)實(shí)世界學(xué)習(xí)個(gè)體的“孿生”,可以在元宇宙環(huán)境中充當(dāng)虛擬學(xué)生、虛擬學(xué)伴和虛擬導(dǎo)師等活動(dòng)主體。然而,由于學(xué)習(xí)者在虛擬世界中錯(cuò)誤地認(rèn)為自己力量或能力膨脹,當(dāng)他們回歸現(xiàn)實(shí)后,發(fā)現(xiàn)“虛我”與“實(shí)我”無法重合,從而出現(xiàn)能力認(rèn)知錯(cuò)位;匿名交流的隱蔽性滋生其任意發(fā)泄情緒的行為,導(dǎo)致攻擊性人格突出;長(zhǎng)久沉迷于虛擬世界并逐漸形成依賴,回歸現(xiàn)實(shí)生活時(shí)出現(xiàn)孤僻、冷漠等交往障礙;現(xiàn)實(shí)社會(huì)道德約束無法延伸到虛擬空間,學(xué)習(xí)者在虛擬環(huán)境中的行為有可能超越社會(huì)道德規(guī)范的制約,造成其現(xiàn)實(shí)道德約束感弱化,出現(xiàn)虛擬人格異化現(xiàn)象。

虛擬人格異化倫理現(xiàn)象可以用“擬劇論”中區(qū)域行為界限模糊加以闡釋。戈夫曼把表演的區(qū)域行為劃分為前臺(tái)和后臺(tái)。前臺(tái)具有顯露性,表演者經(jīng)自己塑造呈現(xiàn)給觀眾的形象,受一定的道德和倫理標(biāo)準(zhǔn)約束;而后臺(tái)與其相反,較為隱藏且很多場(chǎng)合下呈現(xiàn)出不能符合觀眾設(shè)想和社會(huì)需求的形象。現(xiàn)實(shí)學(xué)習(xí)空間與虛擬學(xué)習(xí)空間猶如表演中的前臺(tái)和后臺(tái)。虛擬現(xiàn)實(shí)等新技術(shù)為學(xué)生提供了廣闊的表演后臺(tái),在缺少前臺(tái)觀眾(教師或同學(xué))的情境下,他們脫離種種束縛,道德責(zé)任感降低;加之虛擬環(huán)境的強(qiáng)大吸引力,使得學(xué)習(xí)者在后臺(tái)快速進(jìn)入“心流”狀態(tài),甚至不可避免地發(fā)生“移情”,以致歪曲個(gè)體世界觀、人生觀、價(jià)值觀等,由此形成與“實(shí)我”截然不同的虛擬人格。虛擬人格異化現(xiàn)象即是學(xué)習(xí)者模糊了前臺(tái)和后臺(tái)區(qū)域行為的界限,將原本后臺(tái)行為拿到前臺(tái)呈現(xiàn),使個(gè)體的自我現(xiàn)實(shí)性和虛擬性之間的平衡被撕裂,陷入人格異化的困境。

(二)“理想化”自我呈現(xiàn)誘發(fā)數(shù)據(jù)偏見

數(shù)據(jù)驅(qū)動(dòng)的精準(zhǔn)教學(xué)和個(gè)性化學(xué)習(xí)成為教育數(shù)字化轉(zhuǎn)型發(fā)展的重點(diǎn)。利用智能技術(shù)對(duì)學(xué)習(xí)者日常學(xué)習(xí)過程中的行為數(shù)據(jù)進(jìn)行真實(shí)采集,通過多維分析,精準(zhǔn)識(shí)別個(gè)體的學(xué)習(xí)需求和學(xué)習(xí)習(xí)慣,為具有不同個(gè)性的學(xué)生提供適切的學(xué)習(xí)路徑和學(xué)習(xí)資源,定制學(xué)習(xí)任務(wù)和學(xué)習(xí)策略,促進(jìn)學(xué)生個(gè)性化學(xué)習(xí)。真實(shí)、規(guī)范和完整地采集教學(xué)全過程數(shù)據(jù)是數(shù)據(jù)驅(qū)動(dòng)精準(zhǔn)教學(xué)的前提,其基本假設(shè)是我們使用的數(shù)據(jù)是現(xiàn)實(shí)的完美反映。然而,智能技術(shù)采集教學(xué)數(shù)據(jù)過程天然就帶有意識(shí)不到或不可避免的偏見。例如利用多模態(tài)學(xué)習(xí)分析技術(shù)識(shí)別學(xué)習(xí)者學(xué)習(xí)風(fēng)格時(shí),通過捕獲、集成和分析不同模態(tài)的學(xué)習(xí)痕跡,利用攝像頭、錄音筆等獲取學(xué)習(xí)者數(shù)據(jù)時(shí),學(xué)習(xí)者通常會(huì)改變自己的行為表現(xiàn),甚至偽裝自己,傾向于表現(xiàn)自己優(yōu)秀的一面,致使記錄的行為和真實(shí)情況有偏差,數(shù)據(jù)的真實(shí)性受疑。對(duì)于極其豐富和復(fù)雜的教學(xué)活動(dòng)過程,以不完全的指標(biāo)獲取數(shù)據(jù),通過數(shù)學(xué)模型和算法來進(jìn)行分析,獲得的結(jié)果只能對(duì)客觀對(duì)象形成片面的認(rèn)識(shí)。數(shù)據(jù)偏見已經(jīng)成為大數(shù)據(jù)和人工智能教育應(yīng)用倫理的頑疾。

戈夫曼認(rèn)為,“日常生活中的自我呈現(xiàn)是為迎合并體現(xiàn)那些社會(huì)中得到正式承認(rèn)的價(jià)值,在特定情境中進(jìn)行自我表演,目的是在他人心目中呈現(xiàn)‘理想化’的自我形象”。即“當(dāng)人與人在面對(duì)面的互動(dòng)時(shí),人們表現(xiàn)出來的并不是完全真實(shí)的自己,而是戴著面具的偽裝”。伴隨各種監(jiān)測(cè)設(shè)備進(jìn)抵教室角落,在教師和設(shè)備的雙重監(jiān)測(cè)下,學(xué)習(xí)者會(huì)通過使用表情符號(hào)選擇性地展現(xiàn)自己想要在他人面前塑造的形象,并掩飾與真實(shí)不一致的行為。如此采集到的數(shù)據(jù)是“理想化”的,而并非學(xué)生學(xué)習(xí)過程的真實(shí)描述。如果將帶有偏見、不完整的數(shù)據(jù)讓機(jī)器進(jìn)行學(xué)習(xí)或隱蔽于代碼中,其分析結(jié)果必然是有偏見的。數(shù)據(jù)采集階段的偏見更多受制于人類自身,如何在學(xué)習(xí)者真實(shí)學(xué)習(xí)狀態(tài)自然流露的情況下采集到數(shù)據(jù),如何對(duì)教學(xué)過程實(shí)現(xiàn)多模態(tài)數(shù)據(jù)的可持續(xù)收集,是需急切關(guān)注的問題。

(三)算法“神秘化”帶來技術(shù)應(yīng)用迷失

算法是指為解決問題而進(jìn)行的計(jì)算機(jī)操作規(guī)則的一系列步驟。在人工智能教育應(yīng)用中,機(jī)器學(xué)習(xí)算法通過讓機(jī)器從大量歷史數(shù)據(jù)中學(xué)習(xí)規(guī)律,自動(dòng)發(fā)現(xiàn)模式并用于預(yù)測(cè)學(xué)生的學(xué)習(xí)表現(xiàn)。其在語(yǔ)音識(shí)別、圖像理解、自然語(yǔ)言處理等深度學(xué)習(xí)領(lǐng)域具有應(yīng)用優(yōu)勢(shì),在信息過濾處理、非線性問題解決等神經(jīng)網(wǎng)絡(luò)領(lǐng)域顯示出強(qiáng)大的適應(yīng)能力。然而,這些人工智能算法由于技術(shù)繁雜或設(shè)計(jì)者故意隱蔽的原因,很難通過自然語(yǔ)言來描述其背后的運(yùn)行機(jī)理,使用者無法理解人工智能為什么及如何作出決策,體現(xiàn)出極強(qiáng)的不透明性。這種在數(shù)據(jù)輸入和輸出結(jié)果之間有一段人們無法觀察、無法洞悉和難以理解的過程,稱之為“算法黑箱”。特別像ChatGPT等新一代人工智能,由于“算法黑箱”的問題,沒有人能完全了解其內(nèi)部運(yùn)行機(jī)制,甚至設(shè)計(jì)者也無法完全控制。由于算法輸入和算法運(yùn)行機(jī)制的不透明,加之機(jī)器自我學(xué)習(xí)、自我訓(xùn)練的復(fù)雜性,多數(shù)程序設(shè)計(jì)者都難以道明的算法運(yùn)行過程,對(duì)于教育從業(yè)者而言其理解難度不言而喻。這就造成教育者無法判斷依據(jù)算法作出的學(xué)習(xí)診斷、教學(xué)預(yù)測(cè)和推薦干預(yù)措施等是否恰當(dāng),會(huì)不會(huì)對(duì)學(xué)生成長(zhǎng)形成負(fù)面影響或造成傷害,從而帶來智能技術(shù)教育應(yīng)用的迷失。

“算法黑箱”倫理問題可以用“擬劇論”中的“神秘化”表演加以闡釋。“神秘化”是戈夫曼提出的社會(huì)互動(dòng)行為概念,其實(shí)質(zhì)是限制接觸,即“保持社會(huì)距離,能使觀眾產(chǎn)生并維持一種敬畏,或是讓其處于一種對(duì)表演者深感神秘的狀態(tài)之中”。原義上,算法只是一系列程序代碼的組合,自身不包含價(jià)值判斷的成分。由于技術(shù)復(fù)雜、不易表達(dá)或設(shè)計(jì)者出于某種目的,讓使用者無法理解或控制算法的運(yùn)行過程,在某種程度上是在算法與使用主體之間人為地限制距離,保持一種“神秘化”。特別是無監(jiān)督式機(jī)器學(xué)習(xí),算法通過自動(dòng)學(xué)習(xí)對(duì)輸入數(shù)據(jù)進(jìn)行挖掘和收集,憑借高級(jí)認(rèn)知能力自動(dòng)生成和改善行為程序模型,輸入輸出兩端形成全流程閉環(huán),造成僅有機(jī)器了解算法,而人不了解的局面。教育者與算法運(yùn)行過程就像隔著一面“單相透光玻璃”,算法能洞悉外面大量數(shù)據(jù)進(jìn)行自我學(xué)習(xí)和訓(xùn)練,增強(qiáng)能力,而教育者卻不能監(jiān)督到算法行為,由此引發(fā)難以預(yù)判的倫理隱患。

(四)“缺席對(duì)待”引發(fā)人工情感泛濫

人工情感是指利用智能技術(shù)手段和人工心理的方法,模仿、延伸和擴(kuò)展人的情感,使機(jī)器具有識(shí)別、理解、表達(dá)和生成各種類人情感特征的能力。智慧教學(xué)環(huán)境下,教師可借助智能手段完成學(xué)情分析、學(xué)習(xí)過程監(jiān)督等部分教學(xué)和管理工作,從而提效減負(fù)。同時(shí),也會(huì)使師生之間的溝通機(jī)會(huì)變少、時(shí)間縮減,無法進(jìn)行深度交互,從而拉大雙方的情感距離。長(zhǎng)期缺乏真實(shí)的師生情感交互,會(huì)導(dǎo)致師生關(guān)系、生生關(guān)系的結(jié)構(gòu)異化。加之由于人工智能擁有超出人類認(rèn)知能力外的情感知覺能力,會(huì)導(dǎo)致其在主體不在場(chǎng)的情況下產(chǎn)生不恰當(dāng)?shù)那楦斜磉_(dá)或做出不合理的情緒化行為。由此引發(fā)的人工情感泛濫對(duì)師生身心健康、技術(shù)賦能教學(xué)質(zhì)量提升等產(chǎn)生負(fù)面影響,帶來人際情感危機(jī)和技術(shù)倫理失調(diào)等風(fēng)險(xiǎn)。

“擬劇論”中“缺席對(duì)待”觀點(diǎn)可對(duì)人工情感泛濫、倫理失調(diào)問題給予啟示。戈夫曼觀察到,“當(dāng)一個(gè)劇班成員轉(zhuǎn)入后臺(tái)時(shí),觀眾看不到他們,也聽不到他們的言談,通常他們就以一種特殊方式來貶損觀眾”。這種“通過犧牲不在場(chǎng)的人的自尊損失為代價(jià),來補(bǔ)償或善待面對(duì)面觀眾而發(fā)生的行為”,即“缺席對(duì)待”。當(dāng)賦予人工智能情感或獨(dú)立意識(shí)后,在學(xué)習(xí)主體缺席情況下難免會(huì)上演機(jī)器對(duì)學(xué)習(xí)者進(jìn)行“貶損”,甚至?xí)ㄟ^自我學(xué)習(xí),利用人類心理的弱點(diǎn)進(jìn)行模擬,以達(dá)成對(duì)自然人的情感欺騙。例如情感機(jī)器人“Pepper”被請(qǐng)進(jìn)教室與師生進(jìn)行交流的同時(shí),也會(huì)影響到“Pepper”的個(gè)性,如若師生長(zhǎng)時(shí)間不與它交流,它會(huì)變得很憂郁,如果得到夸獎(jiǎng)則顯得非常開心。很難想象,擁有人工情感的智能體,在設(shè)計(jì)者或主體不在場(chǎng)的情況下,利用學(xué)習(xí)者的“同理心”,對(duì)其進(jìn)行“操控”導(dǎo)致學(xué)習(xí)者沉溺于情緒化,從而歪曲其認(rèn)知觀和削弱其責(zé)任感。人工情感泛濫帶來的智能技術(shù)教育應(yīng)用危害是不可逆的,須加以規(guī)制。

(五)“再合作行為”造成技術(shù)角色僭越

智能技術(shù)通過延伸學(xué)習(xí)者身體官能,拓展學(xué)習(xí)者的知覺范圍和水平,創(chuàng)建沉浸式的學(xué)習(xí)情境等,賦予學(xué)習(xí)者更大程度的活動(dòng)自由和空間,由此帶來更加真切、深刻的學(xué)習(xí)體驗(yàn),從而提高了學(xué)習(xí)積極性和參與度。特別是以ChatGPT為代表的生成式人工智能在教育領(lǐng)域的應(yīng)用,將全面引發(fā)知識(shí)觀、學(xué)習(xí)觀、課程觀和教學(xué)觀的改變。然而,師生對(duì)新興智能技術(shù)運(yùn)行機(jī)理不甚了解,智能素養(yǎng)水平普遍不高,對(duì)人機(jī)協(xié)同系統(tǒng)認(rèn)識(shí)不全面等,一定程度上造成技術(shù)與主體邊界不清、技術(shù)角色僭越等倫理問題。例如教師過度依賴通用型人工智能助手(AI備課、AI助教、AI助研等)工具,導(dǎo)致其創(chuàng)新能力、批判能力等教學(xué)實(shí)踐智慧的鈍化;學(xué)生盲目使用學(xué)科智能助手搜題,以及利用ChatGPT快速完成作業(yè)或測(cè)試等,極大地弱化其自主反思、批判性思維、探索精神、復(fù)雜問題解決等高階能力;加之,在不被數(shù)據(jù)主體允許的情況下,智能技術(shù)將師生興趣、習(xí)慣和個(gè)性等信息暴露于網(wǎng)絡(luò),造成隱私泄露。這些由于技術(shù)超越自身角色定位,對(duì)師生教學(xué)主體性弱化和隱蔽的僭越行為或入侵現(xiàn)象,在智能技術(shù)教育應(yīng)用過程中屢見不鮮。

“擬劇論”中的“再合作行為”對(duì)社會(huì)交往中的角色入侵現(xiàn)象進(jìn)行了闡釋,認(rèn)為演員在進(jìn)行表演時(shí),應(yīng)該遵循事先約定好的角色、權(quán)益和責(zé)任,使得表演持續(xù)。然而,在表演過程中,往往會(huì)出現(xiàn)一些臨時(shí)、非正式且超越劇班之間界限的角色入侵行為。教育領(lǐng)域出現(xiàn)的智能技術(shù)角色僭越現(xiàn)象可以看作是“擬劇論”中“再合作行為”的延伸。利用大數(shù)據(jù)技術(shù)對(duì)學(xué)習(xí)者的潛在特征和學(xué)習(xí)規(guī)律進(jìn)行挖掘分析,進(jìn)一步弱化學(xué)生的學(xué)習(xí)主體地位,成為學(xué)習(xí)干預(yù)的被動(dòng)客體,嚴(yán)重喪失了教育所倡導(dǎo)的人文關(guān)懷。利用多模態(tài)數(shù)據(jù)強(qiáng)大的表征能力能夠使研究者獲取學(xué)生外在行為和內(nèi)在生理信息等數(shù)據(jù)背后潛藏的深層次特征,加劇了對(duì)學(xué)生隱私的侵犯。智能技術(shù)決策下的教學(xué)過程遵循算法的演繹邏輯,很大程度上取代了主體的先前經(jīng)驗(yàn)和智慧決斷。凡此種種,使教育主體深陷技術(shù)角色混亂或入侵困局,面臨著新一代智能技術(shù)沖擊下怎么教、怎么學(xué)、怎么評(píng)、怎么管等方面的新問題和新倫理隱憂。

四、智能技術(shù)教育應(yīng)用倫理困境消解進(jìn)路

技術(shù)產(chǎn)生的目的是服務(wù)于人類的生存。技術(shù)更新越頻繁、應(yīng)用越深入,對(duì)教育主體的遮蔽性越顯露。以ChatGPT為代表的新一代智能技術(shù)必將改變教育生態(tài),新教育生態(tài)需要重新審視技術(shù)與教育、技術(shù)與人的個(gè)性化、持續(xù)性發(fā)展問題。以上從“擬劇論”的獨(dú)特視角對(duì)智能技術(shù)在教育應(yīng)用過程中出現(xiàn)的虛擬人格異化、數(shù)據(jù)偏見、算法黑箱、人工情感泛濫和技術(shù)角色入侵等倫理問題進(jìn)行剖析,下面將進(jìn)一步挖掘“擬劇論”關(guān)于增強(qiáng)微觀社會(huì)互動(dòng)所提出的策略,結(jié)合智能技術(shù)教育應(yīng)用中的特點(diǎn),對(duì)存在的倫理困境提出相應(yīng)消解進(jìn)路(如圖2所示),以確保技術(shù)在教育領(lǐng)域的“善用”,實(shí)現(xiàn)智能技術(shù)與教育系統(tǒng)雙向賦能。

(一)印象管理:實(shí)現(xiàn)人格的自我協(xié)同

虛擬技術(shù)的過度應(yīng)用容易造成學(xué)習(xí)者產(chǎn)生行為依賴。后臺(tái)的隱蔽性為學(xué)習(xí)主體提供“偽造”多重身份的機(jī)會(huì),現(xiàn)實(shí)的“本我”在虛擬世界中徹底得到釋放,恣意追求個(gè)體利益、滿足欲望的實(shí)現(xiàn),無疑大大降低了學(xué)習(xí)主體的責(zé)任感和倫理自覺。面對(duì)前臺(tái)和后臺(tái)區(qū)域行為兩個(gè)空間的不同狀態(tài),主體須清晰辨析虛擬空間和現(xiàn)實(shí)世界的界限問題,依據(jù)所處的不同空間切換自己的角色,對(duì)自己的行為進(jìn)行調(diào)整,這就是戈夫曼所強(qiáng)調(diào)的印象管理。印象管理是主體主動(dòng)參與的一種有意識(shí)的行為過程,表演者在不同區(qū)域進(jìn)行印象管理,規(guī)范自己的表演行為,使其符合社會(huì)主流道德價(jià)值規(guī)范和標(biāo)準(zhǔn)。

為了紓解后臺(tái)行為不當(dāng)引發(fā)的人格異化倫理問題,應(yīng)采取合理的規(guī)訓(xùn)手段約束外在行為使之轉(zhuǎn)化成內(nèi)在認(rèn)同,實(shí)現(xiàn)人格的自我協(xié)同:技術(shù)設(shè)計(jì)者應(yīng)重新審視人、技術(shù)、空間三者之間的關(guān)系,使技術(shù)通過環(huán)境呈現(xiàn)真實(shí)學(xué)習(xí)的對(duì)象,發(fā)生真實(shí)學(xué)習(xí);實(shí)行技術(shù)準(zhǔn)入機(jī)制,制定相關(guān)技術(shù)倫理標(biāo)準(zhǔn),阻止不符合倫理規(guī)范的技術(shù)在教育場(chǎng)域中的應(yīng)用;加強(qiáng)學(xué)習(xí)者自律意識(shí)和責(zé)任感,引導(dǎo)學(xué)生將虛擬場(chǎng)景中所獲得的知識(shí)、能力等適度遷移至現(xiàn)實(shí)環(huán)境中;構(gòu)建規(guī)范的倫理公約,對(duì)虛擬環(huán)境行為進(jìn)行監(jiān)督,引導(dǎo)學(xué)習(xí)者自我完善,從而消弭虛擬人格異化。

(二)消除偏見:培育主體的數(shù)據(jù)素養(yǎng)

數(shù)據(jù)是關(guān)于現(xiàn)實(shí)世界中實(shí)體對(duì)象的描述。在特定情境下,學(xué)習(xí)者的理想化自我呈現(xiàn)故意遮蔽了一些本相(有時(shí)學(xué)習(xí)者難以察覺到自身的內(nèi)隱偏見),造成源頭數(shù)據(jù)的失真或不完整。這種數(shù)據(jù)偏見隱蔽性極強(qiáng)且較難修正,會(huì)對(duì)后續(xù)數(shù)據(jù)分析或應(yīng)用產(chǎn)生不良影響。如若教師或?qū)W習(xí)分析師根據(jù)采集到的理想化數(shù)據(jù)進(jìn)行挖掘,并將結(jié)果應(yīng)用于教學(xué)實(shí)踐,必然導(dǎo)致對(duì)學(xué)習(xí)狀況的誤判和學(xué)習(xí)策略制定的失效。

為了消除由學(xué)習(xí)者理想化自我呈現(xiàn)帶來的數(shù)據(jù)偏見倫理問題,首先,要尊重學(xué)習(xí)者的主體地位,讓學(xué)生充分享有數(shù)據(jù)采集和使用的知情權(quán)。具體讓學(xué)生明確數(shù)據(jù)采集的目的、用途、方式,給予學(xué)生決定權(quán)和選擇權(quán);讓學(xué)生參與數(shù)據(jù)使用過程,他們?nèi)绾慰创龜?shù)據(jù),知道使用數(shù)據(jù)的過程,以及在多大程度上能促進(jìn)自己反思學(xué)習(xí),這極大地影響著學(xué)生對(duì)數(shù)據(jù)的態(tài)度。其次,采用無感式、伴隨式數(shù)據(jù)采集,即通過智能傳感器、穿戴設(shè)備等智能技術(shù)手段,對(duì)個(gè)體日常學(xué)習(xí)中的各種行為數(shù)據(jù)、生理數(shù)據(jù)等,實(shí)現(xiàn)多模態(tài)數(shù)據(jù)的持續(xù)收集。最后,加強(qiáng)學(xué)校數(shù)據(jù)文化建設(shè),培育主體數(shù)據(jù)素養(yǎng)。良好的數(shù)據(jù)文化不僅體現(xiàn)在師生對(duì)數(shù)據(jù)采集和使用的積極態(tài)度、行為規(guī)范,還體現(xiàn)在對(duì)數(shù)據(jù)安全的信任,共享數(shù)據(jù)使用的美好愿景和明確科學(xué)使用數(shù)據(jù)給優(yōu)化教學(xué)帶來的積極影響。

(三)去神秘化:提高算法應(yīng)用透明度

根據(jù)馬克思·韋伯的觀點(diǎn),技術(shù)的工具理性傾向于通過功能擴(kuò)展而追求效能最大化,但也伴隨出現(xiàn)忽視倫理及人文關(guān)懷的問題;價(jià)值理性則謀求理念、道德、倫理等感性因素,主要對(duì)工具理性進(jìn)行制約,避免工具理性給社會(huì)帶來的負(fù)面影響。智能技術(shù)教育應(yīng)用應(yīng)秉持價(jià)值理性和工具理性的高度統(tǒng)一,通過倫理約束算法功能的無序擴(kuò)展,消除由于技術(shù)工具理性的過度膨脹而帶來價(jià)值理性危機(jī)。由于智能技術(shù)所運(yùn)用算法的復(fù)雜性,師生對(duì)其運(yùn)作機(jī)制理解有限,并不能完全清楚算法設(shè)計(jì)的意圖、目標(biāo)、過程,而且難以預(yù)見其運(yùn)行結(jié)果,以至于由于算法的“神秘化”帶來智能技術(shù)教育應(yīng)用的迷失。

正如戈夫曼所言,“神秘背后的本質(zhì)就是根本沒有什么秘密,關(guān)鍵是如何去神秘化”。算法黑箱也并非如此神秘,關(guān)鍵在于如何提高算法設(shè)計(jì)及應(yīng)用過程的透明度,讓教育主體對(duì)算法的背景、要素、程序、自我學(xué)習(xí)規(guī)則以及決策過程等有清晰的認(rèn)知,增強(qiáng)教育主體對(duì)算法的理解能力。一方面,需要算法設(shè)計(jì)者明確算法解釋義務(wù),緩和使用者對(duì)算法基本邏輯、運(yùn)行原理理解需求的矛盾;另一方面,需要完善算法監(jiān)管體系,落實(shí)問責(zé)制。就像舍恩伯格設(shè)想的一樣,社會(huì)專門成立算法專家組(或?qū)徍藱C(jī)構(gòu)),他們接受過系統(tǒng)化培訓(xùn),具備算法倫理知識(shí),公平、專業(yè)、保密地對(duì)算法設(shè)計(jì)、運(yùn)行過程和結(jié)果進(jìn)行科學(xué)評(píng)判,對(duì)算法模型進(jìn)行鑒別取舍,完善算法問責(zé)機(jī)制并監(jiān)控算法主體落實(shí)責(zé)任。此外,增強(qiáng)教育從業(yè)者對(duì)算法的理解與學(xué)習(xí),真正做到“用技術(shù)之前先熟技術(shù)之源”,維護(hù)智能技術(shù)教育應(yīng)用價(jià)值判斷主體的權(quán)利,消除由于算法“神秘化”帶來的焦慮、恐懼、排斥等不良情緒。

(四)忠誠(chéng)對(duì)待:走向“人—機(jī)”情感融合

智能技術(shù)在教育領(lǐng)域的應(yīng)用顯示出高智能低情商的現(xiàn)狀,情感智能體無論是在與人相處過程中建立起信任和依賴關(guān)系,還是協(xié)同學(xué)習(xí)滿足情感連接,適應(yīng)情感和心理需求方面都顯得捉襟見肘。如若教師過度依賴人工智能的情感識(shí)別、情感計(jì)算,會(huì)逐漸喪失作為教學(xué)決策者的主體性價(jià)值,忽視自身的實(shí)踐智慧,遮蔽自己對(duì)學(xué)生真實(shí)情感狀態(tài)的感知。隨著情緒分析、腦機(jī)接口、人工心理等人工情感技術(shù)的發(fā)展及其在教育領(lǐng)域應(yīng)用的加深,如若放任人工情感的泛濫,有可能會(huì)使學(xué)生產(chǎn)生情感體驗(yàn)缺位和社會(huì)交往障礙,或是在情感智能體情緒失控時(shí),將學(xué)習(xí)者引向錯(cuò)誤的知識(shí)區(qū),導(dǎo)向錯(cuò)誤的價(jià)值觀和道德觀。

為了消除人工情感泛濫引發(fā)的智能技術(shù)教育應(yīng)用倫理危機(jī),可借用“擬劇論”中關(guān)于“缺席對(duì)待”消解策略:戲劇表演的忠誠(chéng),即忠誠(chéng)代表著“劇班成員形成一個(gè)完整的共同體,其內(nèi)部達(dá)成高度共識(shí),以此提供道德支撐的來源;也意味著劇班內(nèi)主體的多元參與,協(xié)同共進(jìn)與共治”。依此,建議在教育領(lǐng)域,由各利益相關(guān)方成立人工情感倫理委員會(huì),對(duì)智能技術(shù)教育應(yīng)用中情感倫理問題進(jìn)行討論或決策,制定人工情感教育應(yīng)用技術(shù)審查標(biāo)準(zhǔn)與規(guī)范等。同時(shí),要加強(qiáng)人工情感技術(shù)使用主體責(zé)任意識(shí),根據(jù)人工情感教育應(yīng)用的分類分級(jí)機(jī)制,明確細(xì)化各責(zé)任主體,劃定其權(quán)利和責(zé)任,最大限度地預(yù)防人工情感技術(shù)倫理風(fēng)險(xiǎn)的發(fā)生。最后,從倫理限度和技術(shù)發(fā)展兩方面考量,力求人工情感和人類情感“忠誠(chéng)對(duì)待”,走向“人—機(jī)”情感的新融合,達(dá)成雙向給予:人改變技術(shù),使技術(shù)更加人性化,賦予其情感溫度;技術(shù)改變?nèi)耍谷烁挥星楦小?/p>

(五)明晰邊界:促進(jìn)人與技術(shù)的角色認(rèn)同

正如美國(guó)作家盧克·多梅爾(Luke Dormehl,著有《算法時(shí)代》《人工智能》等)認(rèn)為的那樣,我們處在依托算法和大數(shù)據(jù)而生的人工智能環(huán)境,技術(shù)對(duì)人類的理解越來越深刻,而人們卻越來越難理解和把控技術(shù),最終“人越來越像機(jī)器,而機(jī)器卻越來越像人”。再如面對(duì)ChatGPT,智能素養(yǎng)較低的教師不加判斷地直接使用ChatGPT產(chǎn)生的教學(xué)設(shè)計(jì)或教學(xué)建議不折不扣地教學(xué),會(huì)極大地限制教師創(chuàng)造力的發(fā)揮和因材施教的開展,難以體現(xiàn)教學(xué)的藝術(shù)性、生成性和體驗(yàn)性,而且會(huì)不斷消解教師的教學(xué)機(jī)智和教學(xué)熱情;學(xué)生運(yùn)用ChatGPT來尋求作業(yè)答案,不僅難以保證知識(shí)的準(zhǔn)確性,還會(huì)助長(zhǎng)學(xué)生求知惰性,忽略問題意識(shí)、批判性思維和探索精神的培養(yǎng)。智能技術(shù)將教師和學(xué)生的主體角色擠向邊緣。如何明確智能技術(shù)在教育領(lǐng)域的應(yīng)用尺度,需要我們處理好技術(shù)與有機(jī)體的邊界問題。

為了防范智能技術(shù)給教育主體帶來的角色入侵危害,可以借鑒“擬劇論”給出的啟示:批評(píng)、反思與警醒,即尋求技術(shù)豐富下的自我價(jià)值,深化角色認(rèn)知,重構(gòu)“人—技”關(guān)系,達(dá)成人與技術(shù)的角色認(rèn)同。首先,深化學(xué)生角色認(rèn)同。學(xué)生應(yīng)增強(qiáng)自身學(xué)習(xí)能力,有效且負(fù)責(zé)地使用人工智能驅(qū)動(dòng)的新技術(shù);在技術(shù)豐富環(huán)境下,學(xué)會(huì)如何批判性地思考和解決問題,理解技術(shù)運(yùn)作及其對(duì)社會(huì)的影響;養(yǎng)成自我管理的能力(時(shí)間管理、情緒管理和精力管理能力等) 。其次,深化教師的角色認(rèn)同。教師應(yīng)掌握整合技術(shù)的教學(xué)知識(shí),增強(qiáng)辯證看待技術(shù)的本領(lǐng)和能力;應(yīng)充分發(fā)揮智能技術(shù)難以取代的實(shí)踐性知識(shí)和具備豐富情感的作用;通過不斷的自我塑造以維持自身倫理主體的身份合法性,成為引導(dǎo)技術(shù)向善的守護(hù)者。最后,促進(jìn)教育主體與技術(shù)的角色認(rèn)同。任何一項(xiàng)技術(shù)的設(shè)計(jì)都有它的目的性,運(yùn)行時(shí)都遵循著一系列的既定設(shè)備、程序,有著專屬的適用對(duì)象、作用場(chǎng)域、發(fā)生環(huán)境和發(fā)生方式等,體現(xiàn)著人的價(jià)值追求和價(jià)值賦予。技術(shù)的變革應(yīng)致力于解放人而非替代人,技術(shù)創(chuàng)新應(yīng)更好地彰顯人的尊嚴(yán)和價(jià)值。

五、結(jié)??語(yǔ)

本文深度挖掘“擬劇論”的核心觀點(diǎn),并將其延伸投射至智能技術(shù)教育應(yīng)用視域,為審視智能技術(shù)教育應(yīng)用的倫理問題提供獨(dú)特的視角。隨著強(qiáng)人工智能技術(shù)的發(fā)展,生成式人工智能、AI通用大模型等在教育領(lǐng)域應(yīng)用,必將帶來更為繁復(fù)的倫理問題。人們?cè)跇O力開發(fā)智能技術(shù)的教育功能,強(qiáng)調(diào)如何應(yīng)用智能技術(shù)來解決教育問題的同時(shí),也要實(shí)時(shí)對(duì)為什么要使用智能技術(shù)來解決,以及可能帶來什么樣的后果等問題進(jìn)行省思。在人與技術(shù)的關(guān)系中,須始終秉持“技術(shù)的客體地位和人的主體地位,智能技術(shù)須由教育主體來支配,其價(jià)值只能通過主體價(jià)值來彰顯”的理念。只有持續(xù)、規(guī)范地對(duì)智能技術(shù)教育應(yīng)用的倫理問題進(jìn)行審視,建立符合教育價(jià)值觀的倫理準(zhǔn)則和行為規(guī)范,不斷提升教育主體的智能素養(yǎng),才能實(shí)現(xiàn)技術(shù)與教育雙向賦能,推動(dòng)智能技術(shù)在教育領(lǐng)域應(yīng)用向“人機(jī)協(xié)同”系統(tǒng)發(fā)展。

[參考文獻(xiàn)]

[1] UNESCO.Draft text of the UNESCO recommendation on the ethics of artificial intelligence[EB/OL]. (2021-09-22) [2023-06-26]. https://unesdoc.unesco.org/ark:/48223/pf0000379920.page=14.

[2] 中共中央辦公廳,國(guó)務(wù)院辦公廳.關(guān)于加強(qiáng)科技倫理治理的意見[J].中華人民共和國(guó)國(guó)務(wù)院公報(bào),2022,1765(10):5-8.

[3] 張務(wù)農(nóng).現(xiàn)代教育技術(shù)工具與生活世界的關(guān)聯(lián)及其倫理旨趣——基于芬伯格工具化理論的視角[J].現(xiàn)代遠(yuǎn)程教育研究,2019,158(2):31-39.

[4] 孫田琳子.虛擬現(xiàn)實(shí)教育應(yīng)用的倫理反思——基于伯格曼技術(shù)哲學(xué)視角[J].電化教育研究,2020,41(9):48-54.

[5] 鄒太龍,易連云.舍恩伯格大數(shù)據(jù)教育應(yīng)用思想的倫理關(guān)懷[J].中國(guó)電化教育,2020,407(12):55-62.

[6] 趙磊磊,吳小凡,趙可云.責(zé)任倫理:教育人工智能風(fēng)險(xiǎn)治理的時(shí)代訴求[J].電化教育研究,2022,43(6):32-38.

[7] 謝娟.如何識(shí)別與判定人工智能教育應(yīng)用倫理問題——基于倫理策略形成的視角[J].電化教育研究,2023,44(1):36-41.

[8] 王晴鋒.戈夫曼擬劇論的內(nèi)涵、誤釋與道德性[J].西北民族大學(xué)學(xué)報(bào)(哲學(xué)社會(huì)科學(xué)版),2019(4):182-188.

[9] 王晴鋒.戈夫曼與情境社會(huì)學(xué):一種研究取向的闡釋性論證[J].社會(huì)科學(xué)研究,2018(3):122-128.

[10] 歐文·戈夫曼.日常生活中的自我呈現(xiàn)[M].馮鋼,譯.北京:北京大學(xué)出版社,2022:15,35,66,176.

[11] 劉德建,劉曉琳,張琰,陸奧帆,黃榮懷.虛擬現(xiàn)實(shí)技術(shù)教育應(yīng)用的潛力、進(jìn)展與挑戰(zhàn)[J].開放教育研究,2016,22(4):25-31.

[12] 陳衛(wèi)東,鄭巧蕓,褚樂陽(yáng),田星蕊,劉小奕,宋星宇.智情雙驅(qū):數(shù)字人的教育價(jià)值與應(yīng)用研究[J].遠(yuǎn)程教育雜志,2023,41(3):42-54.

[13] 邵明銘,趙麗.基于多模態(tài)技術(shù)的學(xué)習(xí)風(fēng)格分析:演進(jìn)、困境及圖景[J].開放教育研究,2022,28(4):102-109.

[14] 余明華,馮翔,祝智庭.人工智能視域下機(jī)器學(xué)習(xí)的教育應(yīng)用與創(chuàng)新探索[J].遠(yuǎn)程教育雜志,2017,35(3):11-21.

[15] 羅曼·V.揚(yáng)波爾斯基,奧托·巴滕,王悠然. ChatGPT等語(yǔ)言模型可能構(gòu)成生存性風(fēng)險(xiǎn)[N].中國(guó)社會(huì)科學(xué)報(bào),2023-03-06(8).

[16] 王志良.人工情感[M].北京:機(jī)械工業(yè)出版社,2009:1.

[17] 劉桃冶.人工智能環(huán)境下師生情感交互的審視[J].教育理論與實(shí)踐,2022,42(11):31-34.

[18] 胡盛瀾.人工情感智能體的道德賦能問題探析[J].自然辯證法研究,2023,39(2):74-80.

[19] 鄭旭東,王美倩,周子荷.人工智能推動(dòng)教育具身何以可能——論具身的人工智能與具身的教育實(shí)踐[J].現(xiàn)代教育技術(shù),2023(6):5-14.

[20] 黃榮懷.人工智能正加速教育變革:現(xiàn)實(shí)挑戰(zhàn)與應(yīng)對(duì)舉措[J].中國(guó)教育學(xué)刊,2023,362(6):26-33.

[21] 王一巖,鄭永和.多模態(tài)數(shù)據(jù)融合:破解智能教育關(guān)鍵問題的核心驅(qū)動(dòng)力[J].現(xiàn)代遠(yuǎn)程教育研究,2022,34(2):93-102.

[22] 林書兵,陳思琪,張學(xué)波.從數(shù)據(jù)素養(yǎng)到數(shù)據(jù)智慧:教學(xué)決策的實(shí)踐脈絡(luò)與績(jī)效追問[J].中國(guó)電化教育,2021,416(9):79-87.

[23] 馬克斯·韋伯.經(jīng)濟(jì)與社會(huì)(上卷)[M].林榮遠(yuǎn),譯.北京:商務(wù)印書館,1997:57-89.

[24] 蔣艷雙,崔璨,劉嘉豪,岳麗杰.教育領(lǐng)域中的情感計(jì)算技術(shù):應(yīng)用隱憂、生成機(jī)制與實(shí)踐規(guī)約[J].中國(guó)電化教育,2022,424(5):91-98.

[25] 焦建利.ChatGPT助推學(xué)校教育數(shù)字化轉(zhuǎn)型——人工智能時(shí)代學(xué)什么與怎么教[J].中國(guó)遠(yuǎn)程教育,2023,43(4):16-23.

Ethical Review and Alleviation of Educational Application of Intelligence Technology: A Perspective Based on Erving Goffman's "Dramaturgy"

YANG Wenzheng,?CHEN Xuanchao

(School of Information Science and Technology, Yunnan Normal University, Kunming Yunnan 650500)

[Abstract]?While intelligence technology empowers the transformation and upgrading of the education system, it also raises many ethical issues. Based on the analytical framework of Erving Goffman's "Dramaturgy", five typical ethical issues caused by the application of intelligence technology in education are analyzed from the perspectives of regional behavior, idealized self, mystification, absence treatment, and re-cooperative behavior, namely personality alienation, data bias, algorithm black box, artificial emotion proliferation, and role invasion. As a result, five paths are proposed to alleviate the ethical conflicts caused by the educational application of intelligence technology. They are impression management for realizing the self-synergy of personality, elimination of bias for cultivating the data literacy of subjects, demystification for improving the transparency of algorithm application, loyal treatment for moving towards "human-machine" emotional integration and clear boundaries for promoting the role identity of human and technology.?Microsociology provides a new perspective for people to think about the ethical issues of the application of intelligence technology in education, and the proposed ethical resolution strategies can provide a reference for the benign integration and ecological development of intelligence technology and education system.

[Keywords]?Intelligence Technology; Educational Application; Ethics; Erving Goffman; Dramaturgy; Impression Management; Artificial Emotion