融合注意力機制的CNN-GRU-LSTM 電力系統(tǒng)短期負(fù)荷混合預(yù)測模型

王玉林, 戚樂樂

(遼寧工程技術(shù)大學(xué)電氣與控制工程學(xué)院, 遼寧 葫蘆島 125105)

0 引言

負(fù)荷預(yù)測的準(zhǔn)確性是電力調(diào)度計劃制定的重要依據(jù),關(guān)系到電力供應(yīng)的穩(wěn)定性和可靠性[1]。如何對電力系統(tǒng)短期負(fù)荷進行精準(zhǔn)預(yù)測,降低能源損耗并提升經(jīng)濟效益,是目前研究領(lǐng)域的重點[2]。

目前,國內(nèi)外負(fù)荷預(yù)測方法主要分為三類:傳統(tǒng)預(yù)測方法、基于機器學(xué)習(xí)的方法和基于深度學(xué)習(xí)的方法。傳統(tǒng)的負(fù)荷預(yù)測方法主要有指數(shù)平滑、回歸分析和灰色預(yù)測等多種模型方法[3]。基于機器學(xué)習(xí)的方法以支持向量機[4](SVM)、BP 神經(jīng)網(wǎng)絡(luò)[5]等為代表,這些方法在處理和學(xué)習(xí)高維、數(shù)據(jù)量大的負(fù)荷數(shù)據(jù)時效果較差,預(yù)測耗時且精度較低。

近年來,深度學(xué)習(xí)模型如循環(huán)神經(jīng)網(wǎng)絡(luò)(RNN)及其變體[6],卷積神經(jīng)網(wǎng)絡(luò)[7](CNN)在高維特征學(xué)習(xí)、時序處理、大規(guī)模并行計算以及強大的泛化能力等方面具有明顯優(yōu)勢,在電力系統(tǒng)負(fù)荷預(yù)測領(lǐng)域得到廣泛應(yīng)用。其中,CNN 是一種較為熱門的模型,具有優(yōu)秀的數(shù)據(jù)特征挖掘能力。長短期記憶網(wǎng)絡(luò)(LSTM)和門控循環(huán)單元(GRU)是RNN 的變體,LSTM能夠較好地捕捉長期依賴性關(guān)系。GRU 模型構(gòu)造更簡單、參數(shù)更少,在資源受限的情況下更受歡迎。

目前,尚未有將CNN、GRU 和LSTM 算法結(jié)合應(yīng)用于短期電力負(fù)荷預(yù)測的研究。對此,本文提出一種基于CNN-GRU-LSTM的混合預(yù)測模型,并引入注意力機制[8],以增強模型對關(guān)鍵特征的關(guān)注度。

1 研究方法

本文通過卷積神經(jīng)網(wǎng)絡(luò)的卷積層和池化層,對天氣數(shù)據(jù)和歷史負(fù)荷數(shù)據(jù)進行局部特征的提取。然后,利用GRU 元和LSTM對特征序列進行建模,學(xué)習(xí)和捕捉特征序列中的長期依賴關(guān)系。同時,鑒于GRU 和LSTM在處理長序列時易受長期記憶損失和信息遺忘的影響,本文提出引入注意機制,以增強二者在序列數(shù)據(jù)中建模長期依賴關(guān)系的能力,解決捕捉關(guān)鍵長期依賴信息時精度下降的問題。

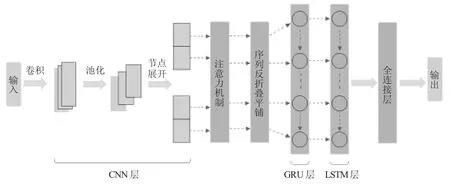

1.1 CNN-GRU-LSTM模型原理

該模型首先利用卷積神經(jīng)網(wǎng)絡(luò)的卷積層和池化層對時間序列數(shù)據(jù)進行層級性特征提取。經(jīng)卷積、池化操作的數(shù)據(jù),通過全連接層整合特征,輸入到注意力機制層。第一個注意力機制層用于將全局特征進行調(diào)整,增強重要通道的權(quán)重。其輸出端設(shè)置第二層注意力機制(點乘注意力機制),對序列的每個位置與全連接層輸出權(quán)重進行點乘操作,調(diào)整不同位置的權(quán)重,使模型可以自適應(yīng)地關(guān)注序列中不同位置的重要信息。經(jīng)過權(quán)重調(diào)整的數(shù)據(jù)進行序列反折疊平鋪,輸入到GRU、LSTM層建模。之后,通過全連接層輸出預(yù)測結(jié)果。模型構(gòu)造如圖1 所示。

圖1 CNN-GRU-LSTM-Attention 預(yù)測模型

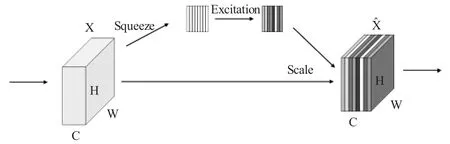

1.2 優(yōu)化選型

本文選用引入兩種注意機制,增強GRU 和LSTM在序列數(shù)據(jù)處理中對長期依賴關(guān)系的建模能力。SE注意力機制(Squeeze-and-Excitation Networks)的核心是在通道維度增加注意力機制,關(guān)鍵操作是Squeeze和Excitation。首先,通過全局平均池化層進行Squeeze操作,將輸入特征的通道維度求平均值,得到一個全局的通道權(quán)重向量。接著,通過兩個全連接層和激活層實現(xiàn)Excitation 操作,學(xué)習(xí)到通道的重要性權(quán)重。通過Sigmoid 層將這些權(quán)重歸一化到[0,1]的范圍。之后,再引入點乘注意力機制,作用于全連接層的輸出與序列反折疊層的輸入之間,將全連接層的輸出和序列反折疊層的輸入進行點乘操作,從而增強模型對序列中不同位置的信息的關(guān)注。SE 注意力機制的原理圖如圖2 所示。

圖2 SE 注意力機制原理

1.3 數(shù)據(jù)集的選取和預(yù)處理方法

本文選取福建省泉州市某地區(qū)2016 年1 月1日—3 月25 日的電力負(fù)荷數(shù)據(jù)作為樣本,共8 105 組數(shù)據(jù),采樣周期為15 min,每天包含96 個采樣點,包括歷史負(fù)荷數(shù)據(jù)、溫度、濕度和降雨量。

對于數(shù)據(jù)中出現(xiàn)的缺失值,選用相鄰時間段的平均值來填充。針對電力負(fù)荷數(shù)據(jù)集中,不同的特征向量存在量綱的差異。本文采用mapminmax 函數(shù)對原始數(shù)據(jù)進行歸一化[9],將數(shù)據(jù)映射到[0,1]區(qū)間內(nèi),去除量綱影響。計算過程如下:

式中:x為原始數(shù)據(jù);xn為歸一化后的數(shù)據(jù);xmax為原始數(shù)據(jù)最大值;xmin為原始數(shù)據(jù)最小值。

2 實驗設(shè)計與結(jié)果分析

2.1 實驗設(shè)置

本文選取的8 105 組,訓(xùn)練集占比95%,即7 700組負(fù)荷數(shù)據(jù)作為訓(xùn)練集,其余為測試集。實驗平臺為Windows11 X64 操作系統(tǒng)、Inter i5-11400 CPU,提出的預(yù)測模型使用Matlab 語言編程實現(xiàn)。

CNN 網(wǎng)絡(luò)中設(shè)置有2 層卷積層與1 層池化層,其中,第一層卷積層中設(shè)置10 個卷積核,第二層卷積層中設(shè)置64 個卷積核,第一層LSTM層包含100 個隱藏單元,第二層LSTM層包含64 個隱藏單元,GRU層也包含100 個隱藏單元。初始學(xué)習(xí)率設(shè)置為0.005,學(xué)習(xí)率衰減周期為25,學(xué)習(xí)率下降因子為0.2,正則化系數(shù)為0.01,迭代次數(shù)為50。

2.2 預(yù)測模型對比

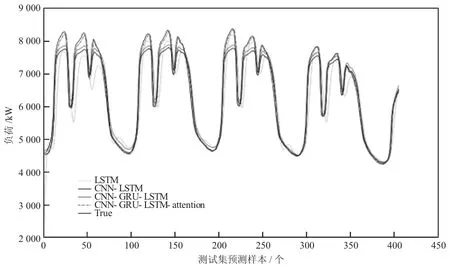

為檢驗最終效果,采用LSTM、CNN-LSTM、CNN-GRU-LSTM網(wǎng)絡(luò)模型和本文所用方法分別進行負(fù)荷預(yù)測,最終預(yù)測曲線如圖3 所示。不難看出,本文模型預(yù)測精度最高。

圖3 預(yù)測結(jié)果對比

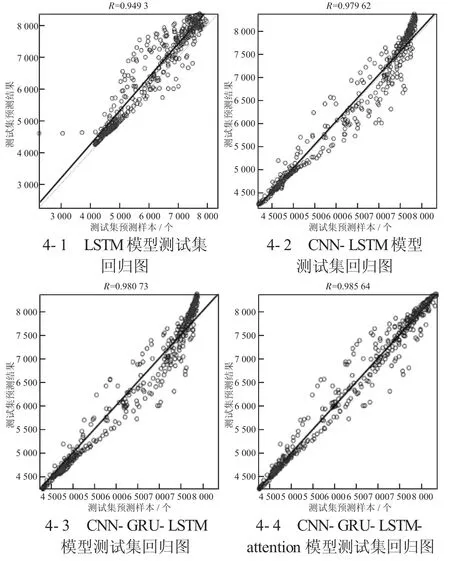

為了直觀展現(xiàn)CNN-GRU-LSTM-attention 模型的性能,選用線性回歸對模型在預(yù)測任務(wù)中的性能表現(xiàn)進行可視化。

由圖4 可知,CNN-GRU-LSTM-attention 模型擬合程度最高,其相關(guān)系數(shù)為0.985 64。CNN-LSTM 以及CNN-GRU-LSTM模型在后期預(yù)測效果變差,可能是由于數(shù)據(jù)在后期階段存在更復(fù)雜的模式或變化,兩種模型未能有效捕獲這些特征。而本文模型通過引入attention 機制,提高了模型在預(yù)測過程中對重要關(guān)系序列的關(guān)注度,整體的預(yù)測精度都有了較大提升。

圖4 線性回歸圖

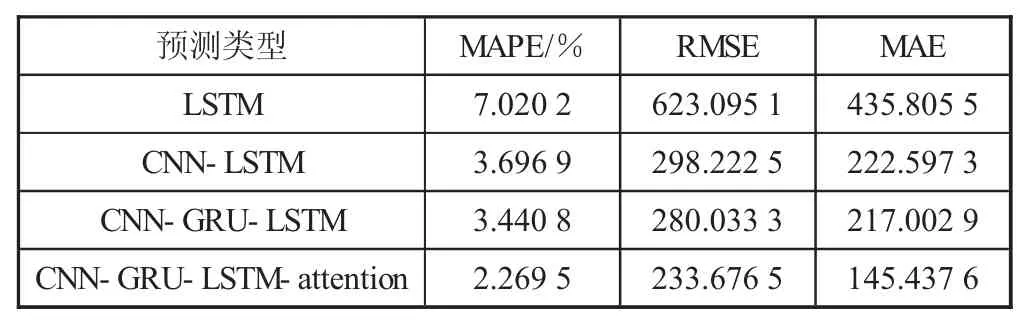

為了進一步驗證模型的性能,本文選用均百分比誤差(MAPE)、均方根誤差(RMSE)和平均絕對誤差(MAE)等誤差評價指標(biāo)[10]對各個模型進行對比。三種誤差評價指標(biāo)的表達式為:

式中:n為數(shù)據(jù)集個數(shù);yi和分別為第i個數(shù)據(jù)的真實值和預(yù)測值。其中MAPE、RMSE 和MAE 的值越小,則說明模型預(yù)測精度越高。所有預(yù)測模型均輸入相同負(fù)荷序列數(shù)據(jù),保證對比試驗的有效性。本文方法與其他3 種模型分別進行時間序列負(fù)荷預(yù)測,預(yù)測誤差結(jié)果如表1 所示。

表1 預(yù)測誤差對比

由表1 可知,CNN-GRU-LSTM-attention、CNNGRU-LSTM和CNN-LSTM均提高了預(yù)測精度,其中,CNN-GRU-LSTM-attention 的預(yù)測精度最高,驗證了本文提出的模型的有效性。

2.3 實驗結(jié)果分析

CNN-GRU-LSTM-attention 模型綜合了多個模型的優(yōu)勢,能夠很好地捕捉電力系統(tǒng)非線性關(guān)系和復(fù)雜的負(fù)荷變化趨勢,預(yù)測精度較高。但需要注意的是,該模型也存在一些局限性。例如,注意力機制的引入會增加模型的計算復(fù)雜性和訓(xùn)練時間,并且參數(shù)的增加使模型存在過擬合風(fēng)險。此外,模型有多個超參數(shù),過高或過低的超參數(shù)值都可能導(dǎo)致模型性能下降,這增加了模型調(diào)整難度。

3 結(jié)語

本文針對傳統(tǒng)單一電力負(fù)荷預(yù)測模型無法完全捕捉復(fù)雜電力系統(tǒng)中的變化和非線性關(guān)系,導(dǎo)致預(yù)測精度較低的問題,提出了CNN-GRU-LSTM-attention混合模型。通過對比分析實驗驗證,表明本文提出的模型能夠有效處理復(fù)雜非線性電力負(fù)荷數(shù)據(jù),具有較高的預(yù)測精度,可為復(fù)雜電力系統(tǒng)提供準(zhǔn)確的負(fù)荷預(yù)測數(shù)據(jù),為電力系統(tǒng)的安全穩(wěn)定運行提供有力支持。