基于雙向Transformer的降水臨近預報模型

摘 要:精準的降水臨近預報對日常生活至關重要,但現行預報模型的準確度有待進一步提升。為此,提出一種新的預報模型BTPN。該模型引入雙向Transformer,從時空序列的正逆方向提取特征,捕獲關鍵信息,減少時空特征丟失;使用卷積Transformer模塊結合卷積的局部編碼和Transformer的全局編碼特性,強化時空信息提取和關聯性,緩解時空長時序信息丟失問題;結合細節提取模塊,有助于減少局部細節的損失,并緩解高值區域消散問題。在HKO-7數據集上的評估顯示,BTPN模型在MAE、SSIM及CSI指標上超越了其他先進模型,并在大面積降水和臺風極端天氣情境中顯示出優異的預測能力。實驗表明BTPN模型具備更高的預報精確性,具備較好的應用前景。

關鍵詞:降水臨近預報; 時空序列; 雙向Transformer; 卷積

中圖分類號:TP183;P457.6 文獻標志碼:A

文章編號:1001-3695(2024)08-029-2455-06

doi:10.19734/j.issn.1001-3695.2023.12.0613

Bidirectional Transformer-based precipitation nowcasting model

Pan Long, Wu Xi

(School of Computer Science, Chengdu University of Information Technology, Chengdu 610225, China)

Abstract:Accurate precipitation nowcasting is crucial for daily life, but the current forecasting models need further improvement in terms of accuracy. This paper proposed an innovative forecasting model called BTPN to address this issue. The model introduced bidirectional Transformer to extract features from both the forward and backward directions of spatiotemporal sequences, capturing key information and reducing spatiotemporal feature loss. It combined the convolutional Transformer block with the local encoding of convolution and the global encoding of Transformer to enhance spatiotemporal information extraction and correlation, alleviating the problem of long-term spatiotemporal information loss. The model also incorporated a detail extraction module to reduce the loss of local details and mitigate the issue of dissipation in high-value areas. Evaluation on the HKO-7 dataset shows that the BTPN model surpasses other advanced models in terms of MAE, SSIM, and CSI metrics, demonstrating excellent predictive capability in large-scale precipitation and extreme weather scenarios. The experiments demonstrate that the BTPN model possesses higher forecasting accuracy and promising applications.

Key words:precipitation nowcasting; spatiotemporal sequences; bidirectional Transformer; convolution

0 引言

天氣預報在當代社會扮演著不可或缺的角色,對多個關鍵性行業提供了支撐,包括農業、航海和災害響應等,并對日常生活及生產活動產生深遠影響[1,2]。然而,實現高精度、寬范圍、高解析度的實時降水預報依然是個突出挑戰。在這些挑戰中,尤其是短期降水預測,在氣象學中占有特殊地位。這一任務的核心在于使用歷史的氣象數據來預測未來零至一小時的降水變化,以便有效預測并應對潛在的強對流天氣事件,并確保實時氣象預報的準確性。

數值天氣預報(NWP)[3]是當今天氣預測領域的主要技術手段。這種方法本質上是數據驅動型的,需綜合考量一系列大氣物理屬性,包括但不限于風速、氣壓和溫度等關鍵氣象參數,并依托這些變量構建模型框架。NWP模型在操作過程中需對高度復雜的數學方程組進行求解,因此對計算資源的需求極其巨大,隨之而來的是顯著的計算成本。此外,鑒于其對大量輸入數據的依賴性,該技術在處理短時間尺度預報的預測準確率尚有待提高[4]。

因現代社會對快速且準確的短期天氣預報的迫切需求,數值天氣預報(NWP)技術表現出了其局限性[5,6]。目前,在短期臨近預報的實踐中,外推法成為了主要選擇。

傳統的外推方法包括單質心法、互相關法和光流法[7,8]。單質心法通過識別和跟蹤對流單體,提供基于單體合并和分裂的運動和演變信息,但當對流回波發生融合和分裂時預報精度會迅速下降[9]。互相關方法通過計算兩個臨近時刻的雷達回波之間的空間優化相關系數來建立擬合關系,有效跟蹤層狀云和降雨系統,但對于回波變化迅速的強對流系統,其跟蹤精度明顯降低[7]。當前應用較多的光流法,如ROVER(雷達回波的實時光流變分方法)[10],通過計算雷達回波圖像序列中的光流場來代替雷達回波運動矢量場,進而實現臨近投射,但計算過程中存在累積誤差問題。

傳統氣象預報方法常借助最新的幾幅雷達回波圖像來預測未來回波的位置,無視了雷達回波中對流系統的非線性動態。這種做法就導致了對歷史雷達數據的應用不充分和預測時間跨度的限制[11]兩個主要局限性。

隨著人工智能技術,尤其是深度學習的飛速進步,這些技術已在目標檢測、圖像分割、自然語言處理等多個領域得到成功應用。在氣象學領域,特別是關鍵的降水臨近預報研究領域,研究人員已經開始探索人工智能的潛力,并取得了突破性的成果[1,12,13]。

Shi等人[14]提出的卷積長短時記憶網絡(ConvLSTM)在氣象預報領域標志著一項重大的技術突破。與標準的全連接LSTM相比,ConvLSTM借助卷積操作有效地挖掘了空間特征,大幅提升了降水臨近預報的準確性,優于傳統的全連接LSTM及光流技術。繼此創新之后,Shi等人[15]進一步開發了TrajGRU模型,該模型整合了時間卷積網絡對時空屬性的高度敏感性以及光流技術模擬云運動的能力,進一步增強了對云自然運動的模擬,從而提升了預報性能。

在此之后,Wang等人[16]開發了PredRNN模型,該模型的核心創新在于融入了時空長短時記憶網絡(spatio-temporal LSTM),通過這種設計,模型可以有效地捕捉時間序列數據中的空間和時間依賴性,顯著提高了對復雜天氣系統動態預測的準確性。進一步地,Wang等人[17]提出了PredRNN++,利用Causal LSTM進一步提升了信息流和梯度傳播的效率,同時引入了創新的梯度高速公路機制,有效提升了深度時空網絡在訓練階段面臨的穩定性。最終,Wang等人[18]推出了PredRNNv2,該模型不僅在PredRNN++的基礎上進行了擴展,而且通過整合具備記憶解耦功能的時空記憶流,結合使用反向傳播計劃抽樣訓練與記憶解耦損失,極大地強化了模型對時間和空間多維長期依賴的捕獲能力,為臨近降水預報技術帶來了革新性的進展。

Guen等人[19]提出的PhyDNet模型,巧妙地融合了物理學原理與前沿深度學習技術。該架構通過集成新穎的物理循環單元(PhyCell),這一單元受到數據同化技術的啟發,在隱空間中施加偏微分方程(PDE)的約束以進行預測,不僅提高了模型在預測任務中的準確性和可解釋性,還確保了其預測過程遵循物理定律。

在降水臨近預報的研究領域,卷積神經網絡(CNN)已經成為一個不可或缺的工具。CNN憑借其卓越的圖像特征提取能力,通過將這些特征有效映射到標簽圖像上,已廣泛應用于多種預測任務中。在這一系列的網絡架構中,U-Net[20]作為一個經典的全卷積網絡結構,因其廣闊的適用性而受到科研界的高度重視[21]。例如,Han等人[22]提出的基于U-Net的降水預測模型,在預測性能上優于傳統的外推方法。此外,文獻[13]推出的SmaAt-UNet模型運用了深度可分離卷積[23]和卷積塊注意力模塊(CBAM)[24],在大幅減少參數量(僅為原始U-Net的四分之一)的同時,仍保持了接近原始U-Net的精確預測能力。Gao等人[21]提出的SimVP模型在視頻預測任務中取得了卓越的成果,這一成就不僅凸顯了全卷積網絡在比拼RNN網絡時展現出的潛力,也在時空序列預測方面實現了更優表現。繼續在這一方向深入探索,Han等人[5]將SimVP模型成功遷移到短臨預報的任務中,并展現了同樣優異的性能。

由于降水本身具有高度非線性、隨機性和復雜性,其時間變化較快、空間分布不均勻,同時還具有短期突發性和不可預見性等特點,降水臨近預報精度還有較大提升空間。在降水臨近預報領域,循環神經網絡(RNN)模型,如PredRNN系列,在傳遞長時間序列信息的能力上表現出色。然而,它們在捕捉和分析空間特征方面存在局限。此外,RNN模型逐步預測的特性也限制了訓練和推理效率,并且具有高計算成本[22]。相比之下,卷積神經網絡(CNN)模型在空間特征提取方面具有強大的優勢,計算量小且結構簡單。然而,當處理時間序列數據時,CNN模型面臨信息流失的問題,尤其在進行長時間序列預測時更為嚴重[22,25]。CNN和RNN模型都無法獲取全局變化信息,這對于降水臨近預報是一個瓶頸,因為局部降水受到全局降水變化的影響,而局部感受野無法準確理解和把握全局變化。在當前模型中,對于降水預報中更關心的高強降水區域的預測,仍存在高值區域易消散的情況,整體預報準確性仍有待提升[5,7]。

針對以上問題,本文提出了一種基于雙向Transformer的降水臨近預報模型(BTPN)。模型的主體架構采用了SimVP模型,利用空間特征和時空特征分離處理的方式,緩解一定的時空信息流失問題[21]。為了獲取全局狀態信息,本文設計了一種雙向Transformer(bi-directional Transformer,BiT)。與傳統的Transformer相比,BiT可以同時從時空序列的順序和逆序中高效地提取特征,從而有效捕捉那些在順向信息流中易被忽略的關鍵細節,并且保留更多特征信息,減輕了時空信息流失問題。與以BERT語言模型[26] 為代表的使用掩碼機制(masked language model,MLM)實現深度雙向Transformer不同,本文雙向Transformer在注意力階段通過雙向的Q和K對時空特征進行加權,這種方法更加簡單易行且適用于時空序列問題。BiT具備了Transformer[27,28] 的核心優勢,即全局注意力機制,可以在整個序列范圍內捕獲相關信息,從而提升了模型處理長期依賴關系信息的能力,其優秀的注意力機制也能很好地關注高值區域的變化。與卷積提供的局部特征編碼相結合,BiT的全局編碼能力使本文設計的CT-block能夠輕量高效地提取時空信息,同時其殘差結構緩解了模型深層特征的損失。在模型的編碼器和解碼器階段,本文引入了D-block結構,這種基于殘差[29]的設計思路有效地減少了在維度轉換過程中低維細節特征的丟失,緩解了高值區域消散問題。在公認的HKO-7數據集[15] 上進行的一系列對比實驗中,實驗結果充分證明了BTPN模型在降水臨近預報任務上的卓越表現,相比其他模型展現了更高的預測準確率。

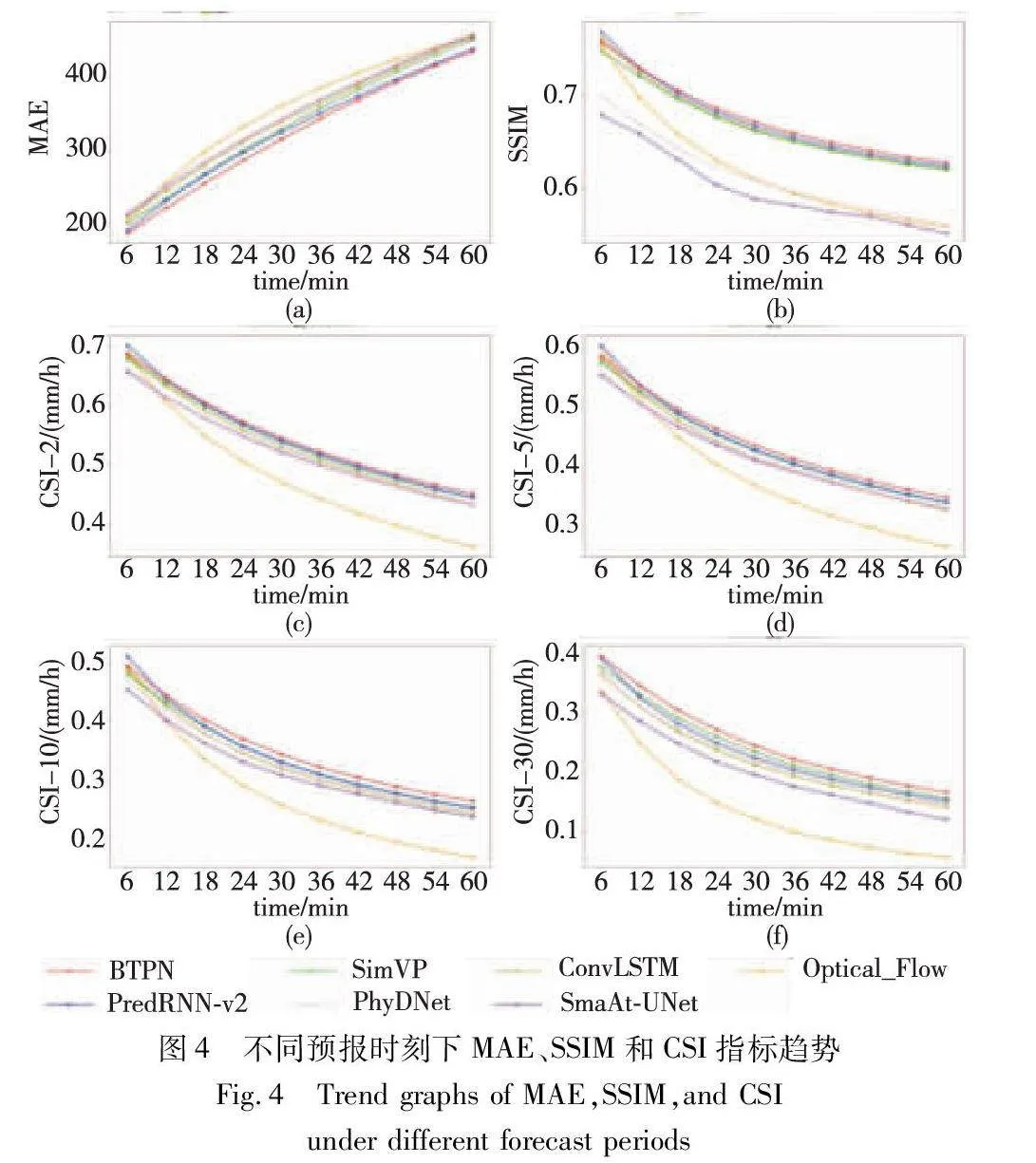

1 BTPN模型

降水臨近預報任務本質是時空序列預測問題,需要同時考慮時間維度和空間維度。為了進一步提升降水臨近預報準確性,設計了BTPN模型,如圖1所示。該模型由encoder、translator和decoder三種結構組成,encoder用于提取歷史幀的空間特征,translator用于學習時空演化與傳遞,decoder用于集成和預測未來幀的空間特征。這種空間特征和時空特征融合分離的結構使得CNN模型也能具備更高的時空特征傳遞性能[21]。

a)encoder。在編碼器設計中,采取了創新的堆疊策略,將CGS與D-block模塊相結合。編碼器由Ns個CGS(Conv-GroupNorm-SiLU)和D-block的復合結構組成。在處理編碼器輸入數據時,本文將輸入數據的形狀從(B,T,C,H,W)改組合為(B×T,C,H,W),即將批次維度B和時間維度T合并,該策略使得模型能更集中于提取空間特征。在這一過程中,每組的CGS-D-block-CGS結構中,CGS和D-block采用步長為1的卷積,保證特征提取的精細化,而每組結構末尾的CGS則采用步長為2的卷積操作,以實現下采樣。在傳統模型中,過度依賴CGS模塊的堆疊往往會導致空間細節信息的大量損失,而通過在CGS堆疊中穿插D-block模塊的策略,既強化了深層特征的提取,同時也有效減輕了淺層細節信息的丟失,從而實現了優化模型對空間特征把控的能力,加強了對高值區域預報的準確性。

b)translator。設計采用了Nt個卷積Transformer模塊(CT-block)來學習和處理時空域特征,有效緩解了CNN模型存在的時空長時序信息丟失的問題,還實現了對全局和局部信息的綜合利用。輸入特征的形狀由(B,T,C,H,W)轉換為(B,T×C,H,W),合并了時間維度T和通道維度C,使其能夠同時處理時空特征的動態變化。CT-block結構內嵌了雙向Transformer(BiT)機制,它的工作過程開始于一個1×1大小的卷積層,用于擴充特征的通道數。接著,采用殘差連接結構[29]進行特征學習,其中首先通過一個3×3的卷積層來捕捉局部時空特征,然后使用1×1的逐點卷積(pointwise convolution)對特征通道進行線性組合并將其映射至一個更高維的空間,以此來增強特征的表達能力。BiT用于全局時空信息的學習,它允許模型捕捉和整合跨越整個輸入的長范圍依賴信息。最后,輸入特征和BiT的輸出通過一個3×3的卷積層進行合并和融合,這樣不僅利用了BiT提供的全局信息,還保留了局部特征的細節,能夠學習局部降水和全局降水之間的相互影響關系。

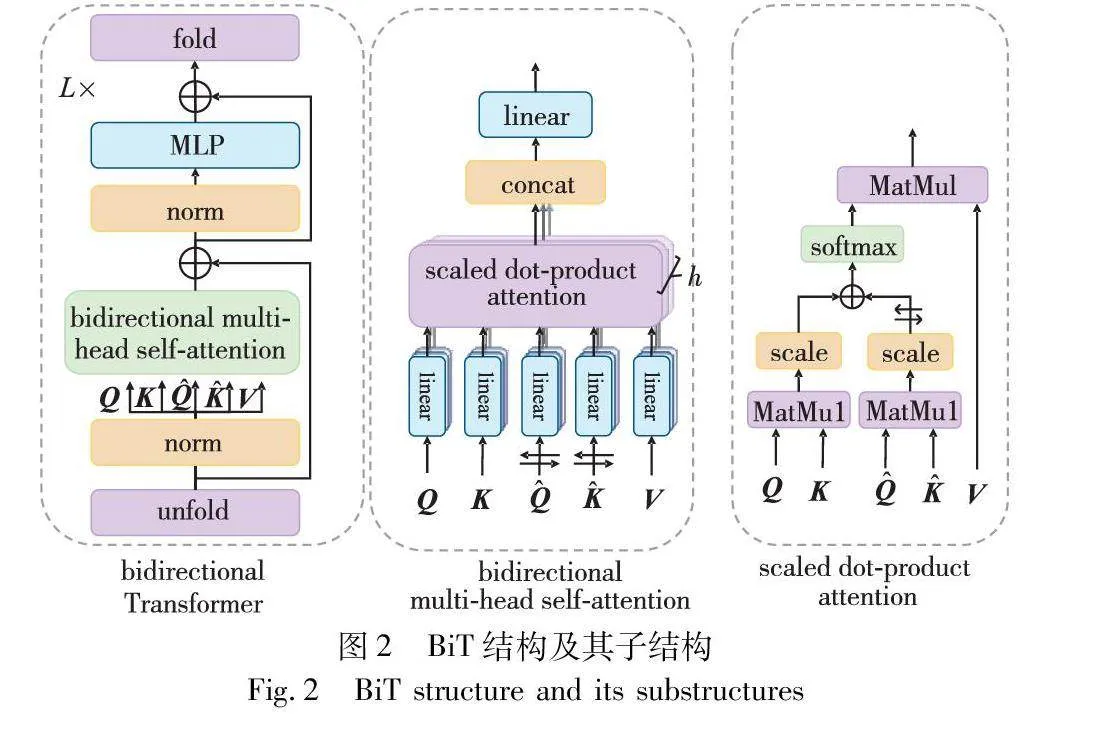

c)BiT。如圖2所示,常規雙向Transformer主要應用于自然語言處理(NLP)領域,以BERT語言模型[26]為代表,主要使用掩碼操作實現上下文雙向理解,本文的雙向Transformer(BiT)是通過設計的雙向多頭自注意力(BMA)機制來實現雙向操作,增強對動態時空數據序列的正向和逆向處理能力,具備更優的時空信息提取能力,緩解了時空信息流失的問題,其雙向的注意力也可以更好地5U/3pKoaOc0uqSiFdgxaaw==捕獲高值區域的變化,更適用于時空序列問題。該機制對捕獲復雜的動態場景中變化迅速的特征至關重要。通過在已有的查詢(Q)和鍵(K)向量的基礎上增添它們的反向對應(和),BMA使得模型能夠從數據的兩個方向同步地提取關鍵特征,使用逆序的和從逆序特征中揪出容易遺漏的重要信息,進而增強了模型使用順序的Q和K進行特征篩選的能力。BiT通過雙向多頭自我注意力單元和多層感知機(MLP)塊的串聯搭建而成,這些模塊的協同工作用于合成和精煉時空特征,以及施行高階非線性特征轉換。每個注意力和MLP模塊前采用層歸一化(LN),以規范化輸入,這樣的預處理對提升模型的訓練穩定性和加速收斂進程格外有益。BiT模型設計中缺少對空間位置的內在偏置,影響了空間特征的感知能力。汲取MobileViT[30]中數據空間重新排列的方法,強化了BiT對空間特征的感知。通過unfold操作,將標準輸入維度(B,D,H,W)重新排列為(B,N,P,D),其中P=wh表示一個圖像patch中的像素數,N=(HW)/P代表圖像中patch的總數。在實驗中,本文選擇了(2,2)大小的patch。隨后,fold操作使得變換后的數據能夠輕松地恢復為其原始維度(B,D,H,W)。BiT操作流程如下:

z′i=BMSA(LN(zi-1))+zi-1 i=1,…,L(1)

zi=MLP(LN(z′i))+z′i i=1,…,L(2)

雙向多頭自注意力依賴于縮放的點積注意,對順序查詢Q、順序鍵K、逆序查詢、逆序鍵和值V進行操作:

attention(Q,K,,,V)=softmax(QKT+Tdk)V(3)

headi=attention(QWQi,KWKi,Wi,Wi,VWVi)(4)

MultiHead(Q,K,,,V)=concati(headi)WO(5)

其中:dk是關鍵維度;Wi和WO為權重矩陣。值得注意的是,在計算逆序控制和時需要先對特征在通道維度進行逆序操作,當完成T運算后在通道維度再次進行逆序操作,即還原為順序結構,如圖2所示,其中符號即代表通道逆序操作。

d)decoder。解碼器采用Ns層TCGS+D-block+CGS復合結構的疊加策略來逐漸構建對未來幀的預測。在這個過程中,轉置卷積操作扮演了上采樣的角色,旨在將深層的特征空間有效恢復至與原始輸入匹配的分辨率,此操作的采樣步長設為2。而D-block和CGS層則通過步長為1的卷積過程細致地處理特征信息,以確保輸出的細節質量。通過decoder模塊的跳躍連接,可以利用淺層歷史輸入數據來恢復預報結果中的淺層細節。整個解碼器的架構設計與編碼器(encoder)形成了一種對稱關系。

2 實驗

2.1 HKO-7數據集

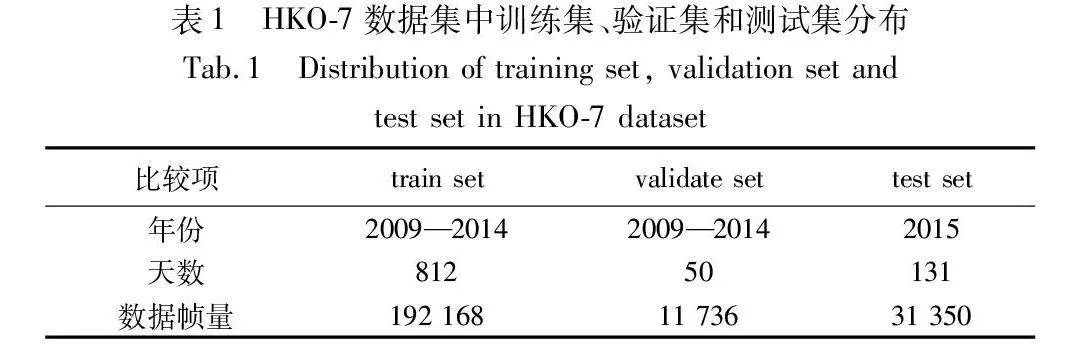

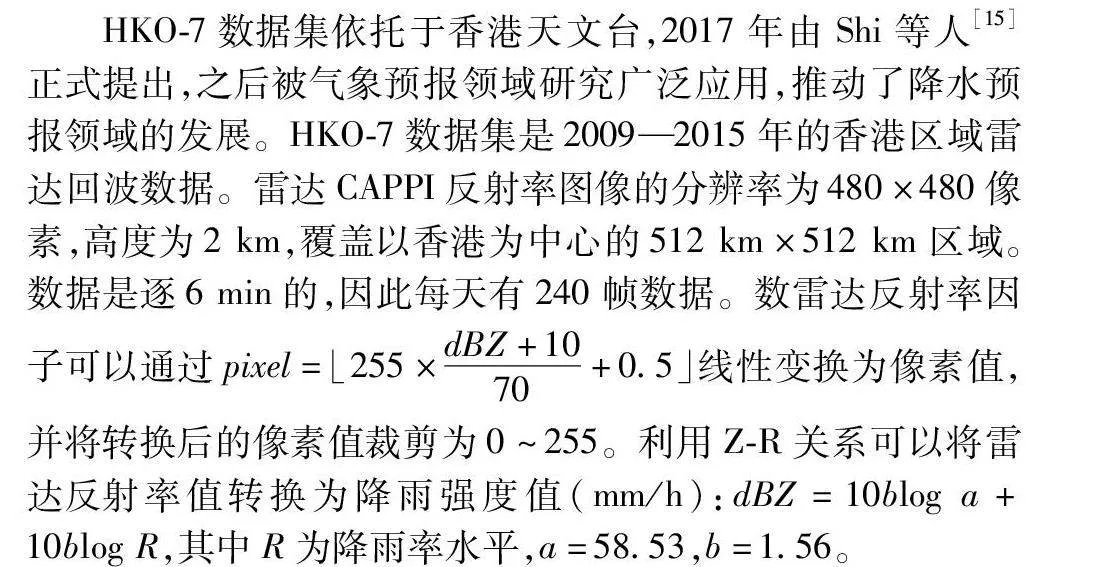

HKO-7數據集依托于香港天文臺,2017年由Shi等人[15]正式提出,之后被氣象預報領域研究廣泛應用,推動了降水預報領域的發展。HKO-7數據集是2009—2015年的香港區域雷達回波數據。雷達CAPPI反射率圖像的分辨率為480×480像素,高度為2 km,覆蓋以香港為中心的512 km×512 km區域。數據是逐6 min的,因此每天有240幀數據。數雷達反射率因子可以通過pixel= 255×dBZ+1070+0.5」線性變換為像素值,并將轉換后的像素值裁剪為0~255。利用Z-R關系可以將雷達反射率值轉換為降雨強度值(mm/h):dBZ=10blog a+10blog R,其中R為降雨率水平,a=58.53,b=1.56。

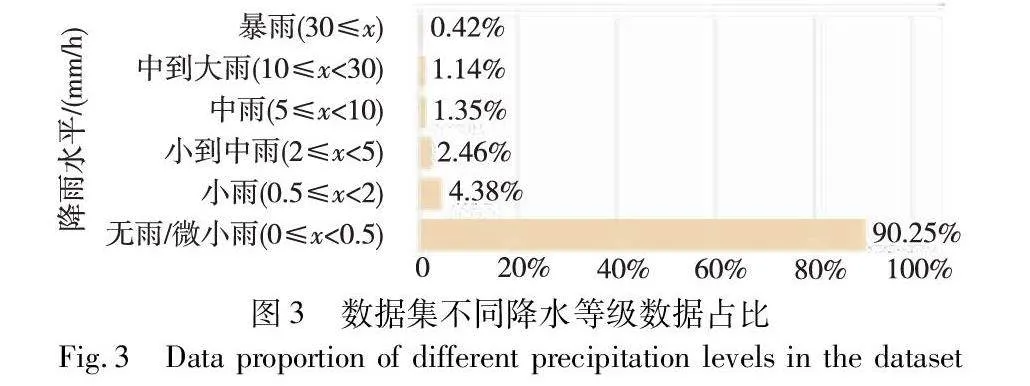

如圖3所示,由于降雨事件很少發生,所以根據雨量信息選擇下雨天來形成最終的數據集,如表1所示,該數據集有812天用于訓練,50天用于驗證,131天用于測試。本文對HKO-7數據進行了降采樣,由480×480處理為112×112大小。

2.2 實驗設置

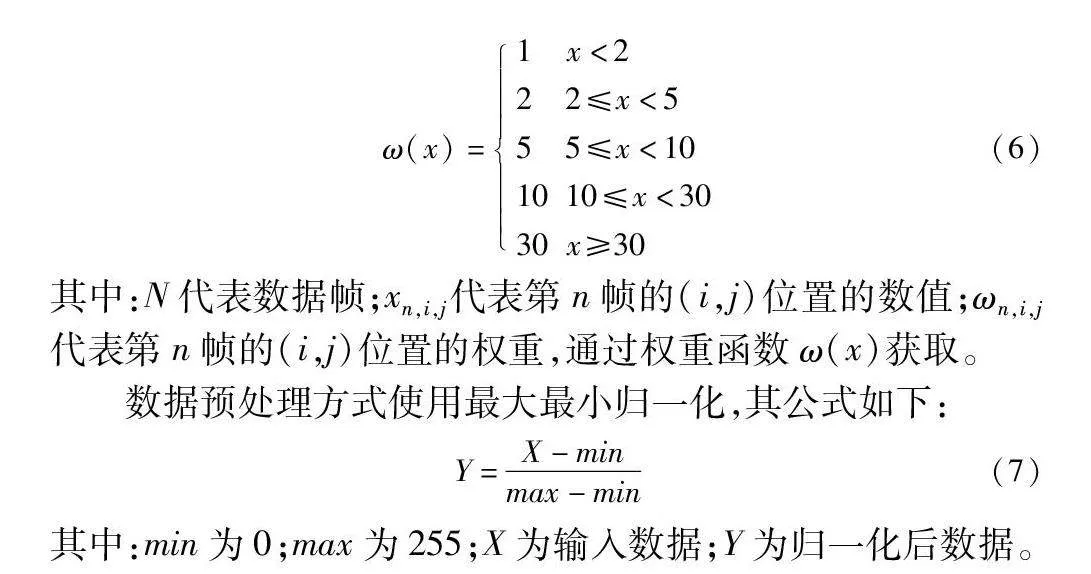

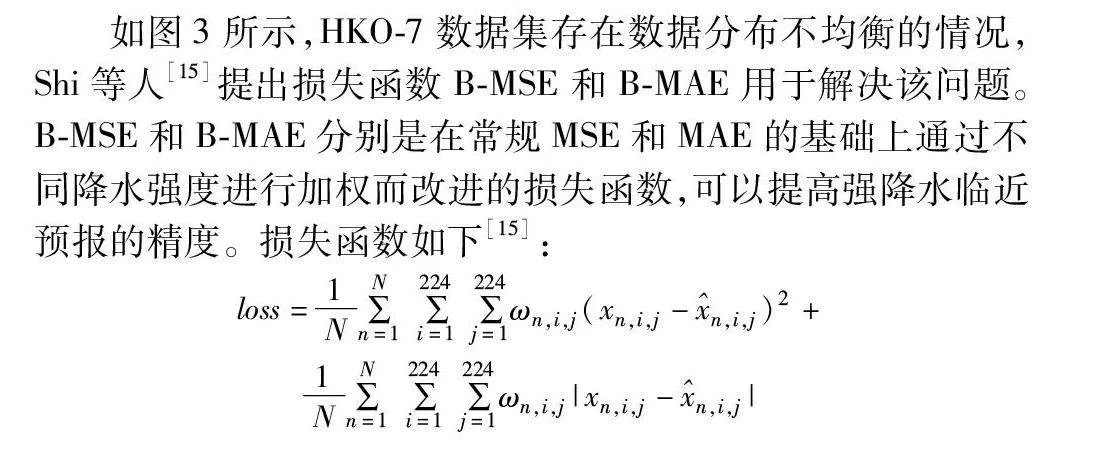

如圖3所示,HKO-7數據集存在數據分布不均衡的情況,Shi等人[15]提出損失函數B-MSE和B-MAE用于解決該問題。B-MSE和B-MAE分別是在常規MSE和MAE的基礎上通過不同降水強度進行加權而改進的損失函數,可以提高強降水臨近預報的精度。損失函數如下[15]:

loss=1N∑Nn=1∑224i=1∑224j=1ωn,i,j(xn,i,j-n,i,j)2+

1N∑Nn=1∑224i=1∑224j=1ωn,i,j|xn,i,j-n,i,j|

ω(x)=1 x<222≤x<555≤x<101010≤x<3030x≥30(6)

其中:N代表數據幀;xn,i,j代表第n幀的(i,j)位置的數值;ωn,i,j代表第n幀的(i,j)位置的權重,通過權重函數ω(x)獲取。

數據預處理方式使用最大最小歸一化,其公式如下:

Y=X-minmax-min(7)

其中:min為0;max為255;X為輸入數據;Y為歸一化后數據。

BTPN模型設置encoder和decoder模塊的Ns為2;其中GroupNorm的group數量為2。translator模塊的Nt設置為3,其中GroupNorm的group數量為8。BiT模塊的雙向自注意力設置為4頭。

其他對比模型的和官方開源代碼參數一致。在本文中所有模型的基礎訓練設置保持一致,本文使用Adam優化器[31],學習率設置為10-4,進行100 000次采樣訓練,batch_size設置為2,輸入歷史1 h數據(10幀)預測未來1 h(10幀)變化。本文使用RTX 2080顯卡進行訓練,12 GB顯存,CPU為Intel CoreTM i7-7700K CPU,4.20 GHz,PyTorch版本為1.10.1。

2.3 實驗指標

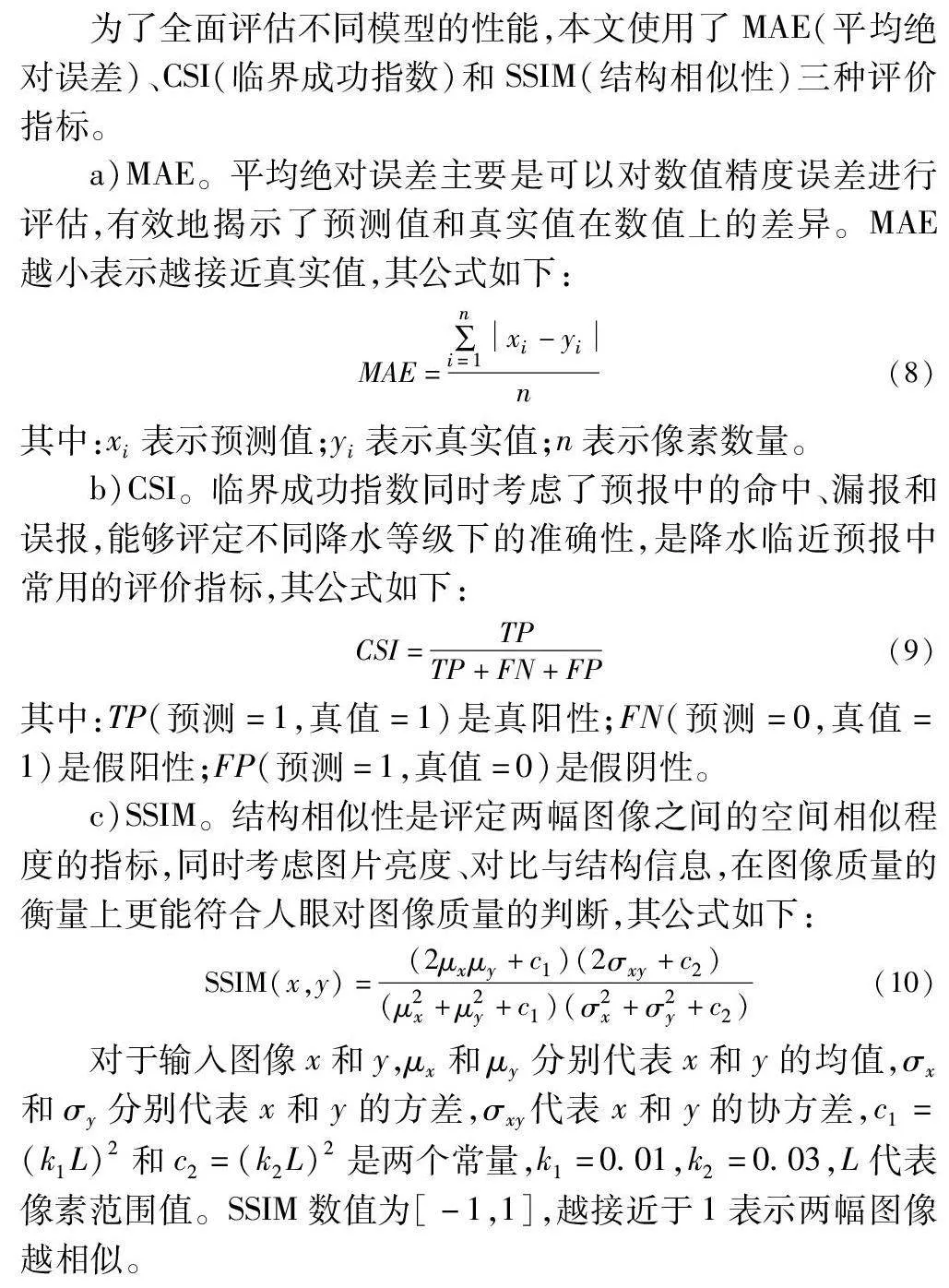

為了全面評估不同模型的性能,本文使用了MAE(平均絕對誤差)、CSI(臨界成功指數)和SSIM(結構相似性)三種評價指標。

a)MAE。平均絕對誤差主要是可以對數值精度誤差進行評估,有效地揭示了預測值和真實值在數值上的差異。MAE越小表示越接近真實值,其公式如下:

MAE=∑ni=1xi-yin(8)

其中:xi表示預測值;yi表示真實值;n表示像素數量。

b)CSI。臨界成功指數同時考慮了預報中的命中、漏報和誤報,能夠評定不同降水等級下的準確性,是降水臨近預報中常用的評價指標,其公式如下:

CSI=TPTP+FN+FP(9)

其中:TP(預測=1,真值=1)是真陽性;FN(預測=0,真值=1)是假陽性;FP(預測=1,真值=0)是假陰性。

c)SSIM。結構相似性是評定兩幅圖像之間的空間相似程度的指標,同時考慮圖片亮度、對比與結構信息,在圖像質量的衡量上更能符合人眼對圖像質量的判斷,其公式如下:

SSIM(x,y)=(2μxμy+c1)(2σxy+c2)(μ2x+μ2y+c1)(σ2x+σ2y+c2)(10)

對于輸入圖像x和y,μx和μy分別代表x和y的均值,σx和σy分別代表x和y的方差,σxy代表x和y的協方差,c1=(k1L)2和c2=(k2L)2是兩個常量,k1=0.01,k2=0.03,L代表像素范圍值。SSIM數值為[-1,1],越接近于1表示兩幅圖像越相似。

2.4 實驗結果與分析

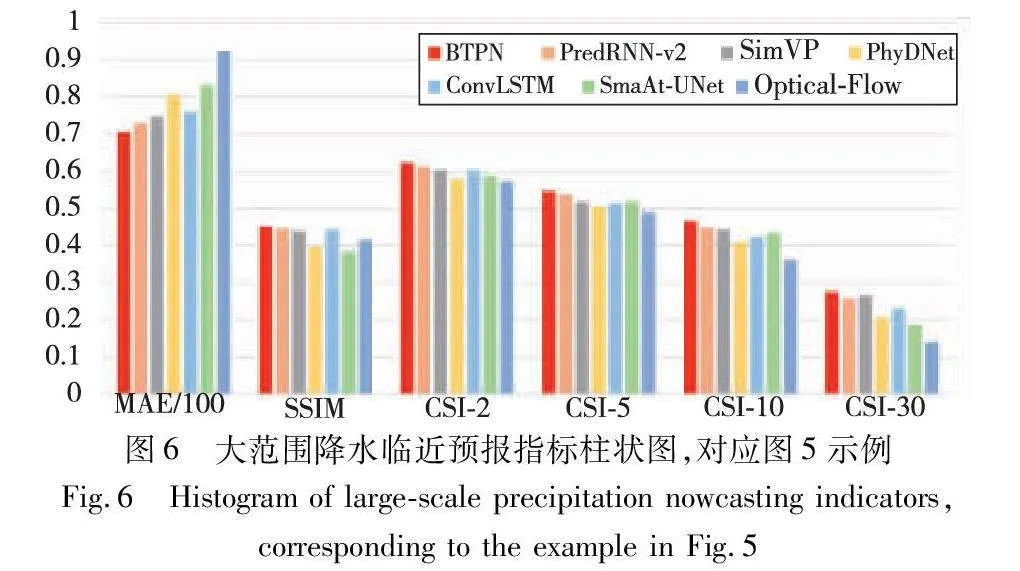

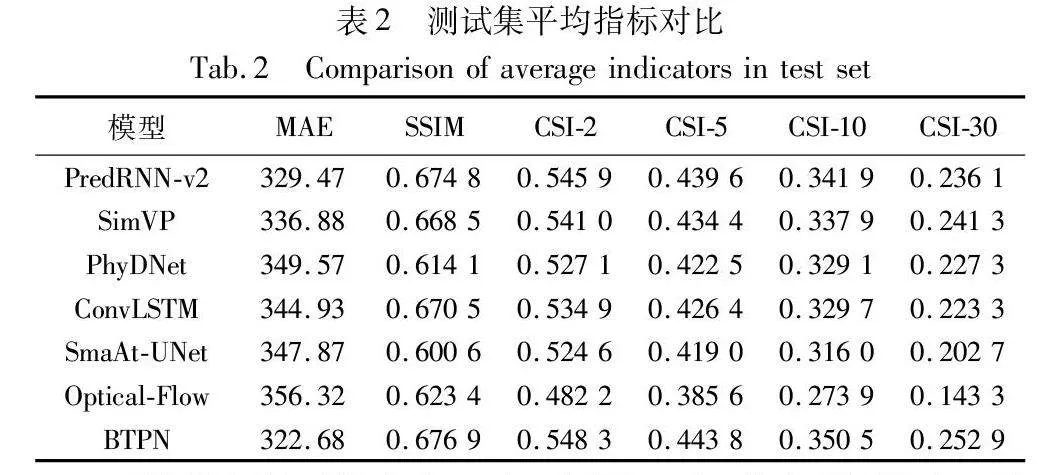

不同模型在測試集上的MAE、SSIM和CSI指標如表2所示,其中CSI指標選取了2、5、10和30 mm/h四種降水閾值,以評估模型對于從小雨到暴雨不同降水強度的預報準確度。從表2可以看出,BTPN模型在所有指標上均超越了其他模型,與較優的PredRNN-v2模型相比,MAE和SSIM分別提升了2.06%和3.11%,在2、5、10和30 mm/h閾值下的CSI指標分別提升了0.44%、1%、2.51%和7.11%。由此可以看出,BTPN模型整體上具有較高的預報精度,特別是在關注度更高的高降水量區域表現出更為顯著的精度提升,這對于短臨預報具有重要的意義。

平均指標并不能完全反映不同模型在不同時間維度上的預報準確度,因此本文繪制了各模型在不同預報時刻的精度趨勢圖,如圖4所示。從圖中可以直觀地看出,BTPN模型在不同預報時刻同樣保持著超越其他模型的精度,并維持了較低的誤差累積,體現了BTPN模型在降水臨近預報上的有效性和優秀性能。

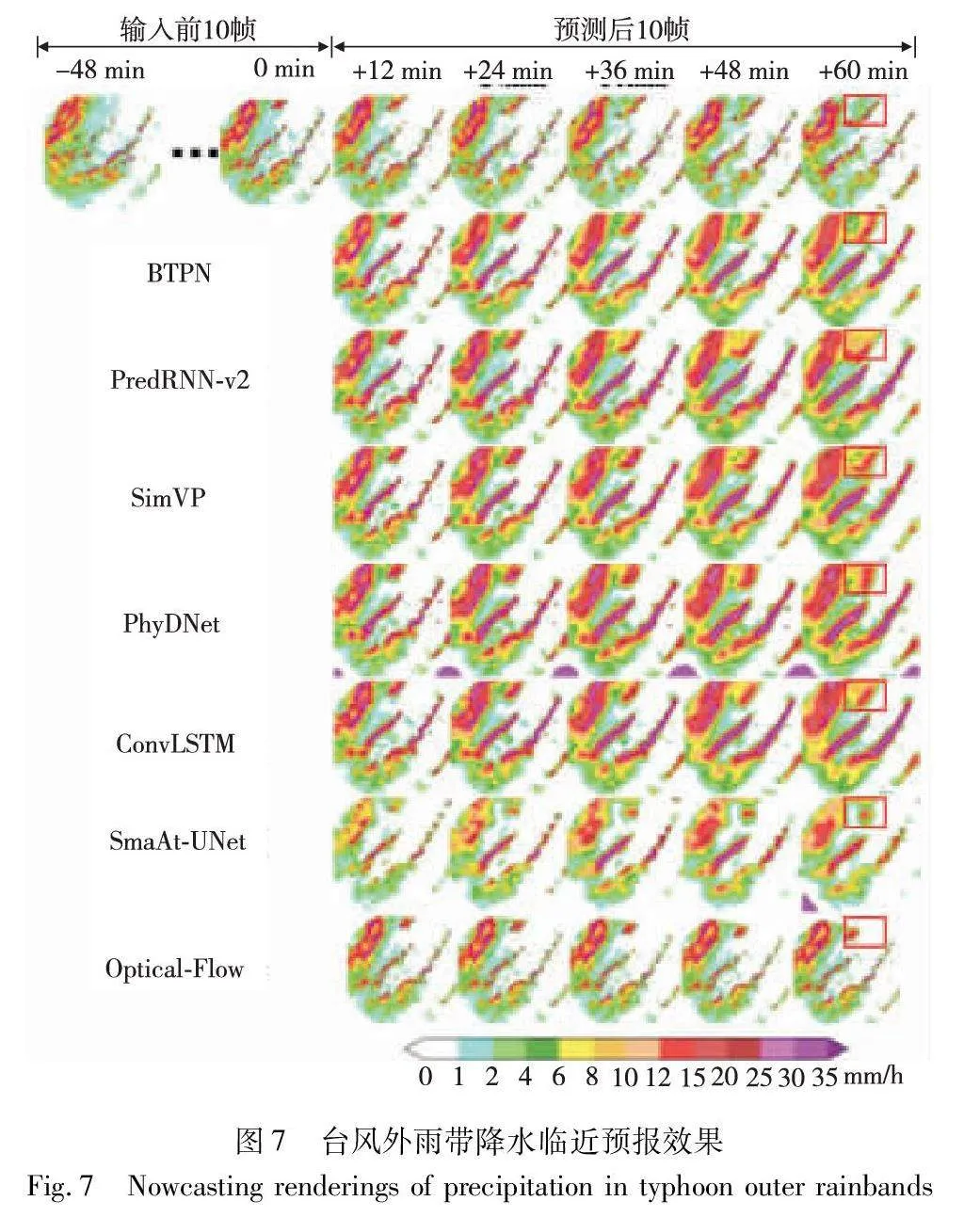

為客觀評估不同模型的性能,本文挑選了兩種代表性的降水情景進行了詳細分析:a)普遍的大面積降水事件;b)強度更為嚴峻的臺風天氣。大面積降水事件包括了一系列不同的降水強度,能夠全面測試各模型在常見降水氣候下的預報準確性。在極端氣象事件如臺風的預報中,準確性尤為關鍵。由于臺風導致的降水變化具有較高的不可預測性,這對于預報模型來說是一個顯著的挑戰,極端天氣預報的準確性能夠有效地驗證模型的綜合性能表現。

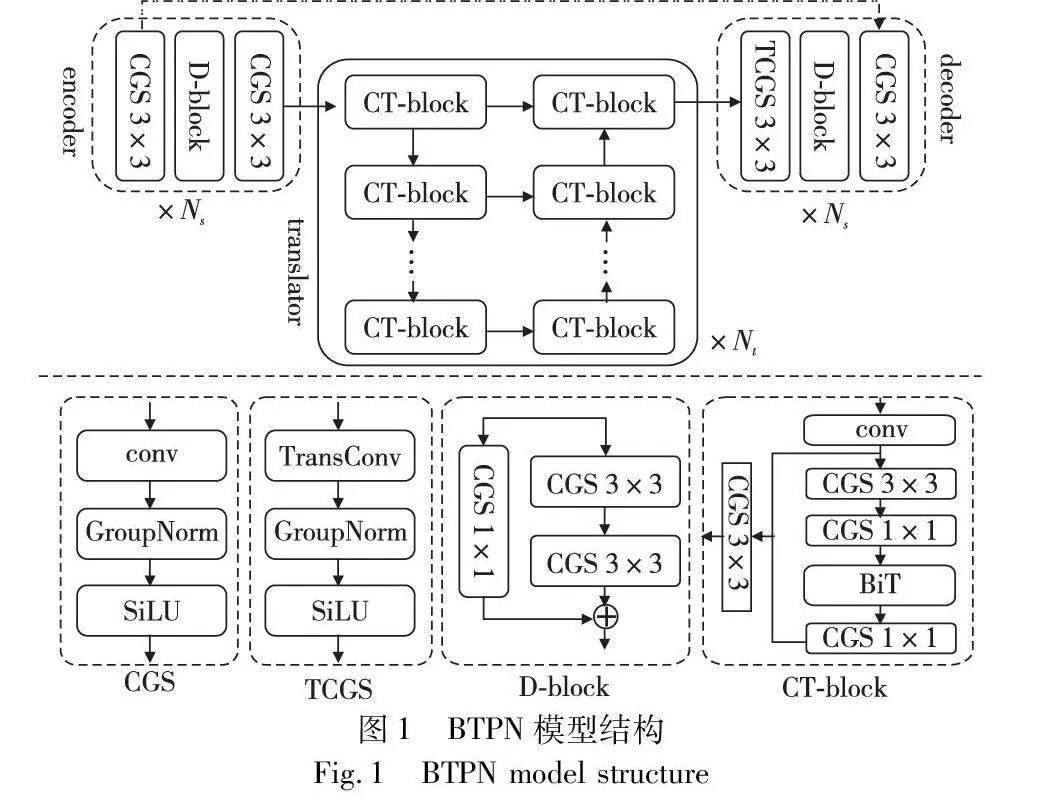

圖5中矩形框標識的部分清晰地揭示了BTPN模型預報結果與實際觀測的吻合程度較高。相比之下,其他模型在預測高降水率區域時顯現了明顯的消散現象,光流法無法預測雨區的生消變換,未能精確捕捉到實際的降水區域。圖6展示的性能指標柱狀圖進一步印證了BTPN模型在大范圍降水事件預報上的卓越準確性。

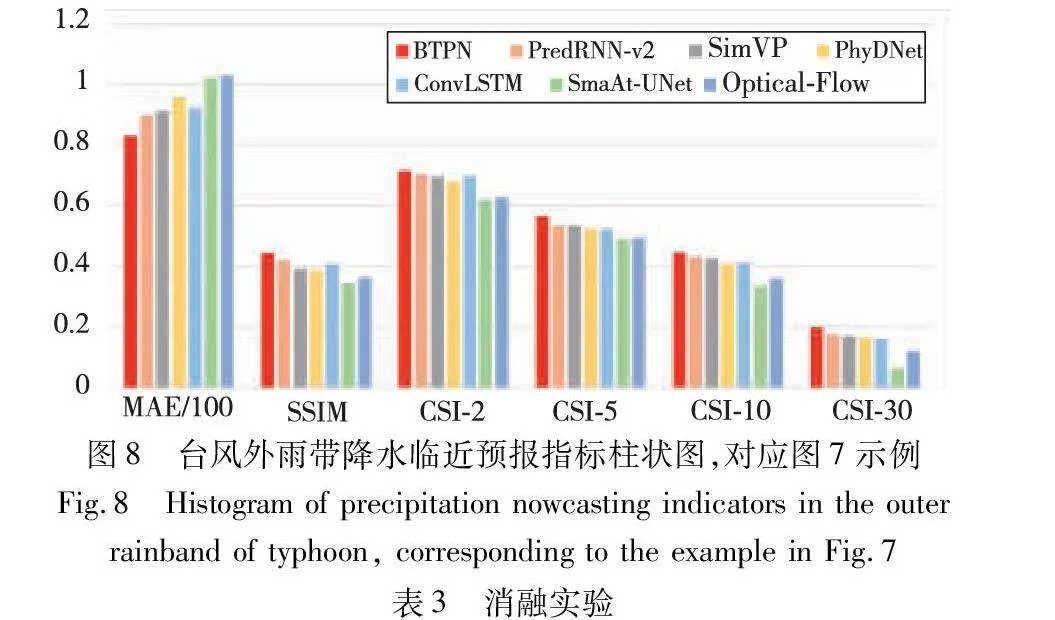

在臺風條件下,BTPN模型繼續展現出其優異的預測精度。圖7中的矩形框清楚地表明,BTPN模型能較為確切地預測低值和高值區域的分布,展現了其優秀的時空信息傳遞和提取能力,而其他模型在這方面表現則不佳,產生了較多的誤報問題,光流法更是出現了嚴重的形變現象。對圖6、8中的指標圖進行比較可見,在臺風引起的降水中,各模型的臨近降水預報準確度普遍低于普通降水事件的預報準確度,這反映出臺風對降水預報準確性所造成的負面影響顯著,增加了降水落區預測的不確定性。然而,即便如此,BTPN模型在各項指標上依舊保持了一定的優勢,并顯示出較高的穩健性。

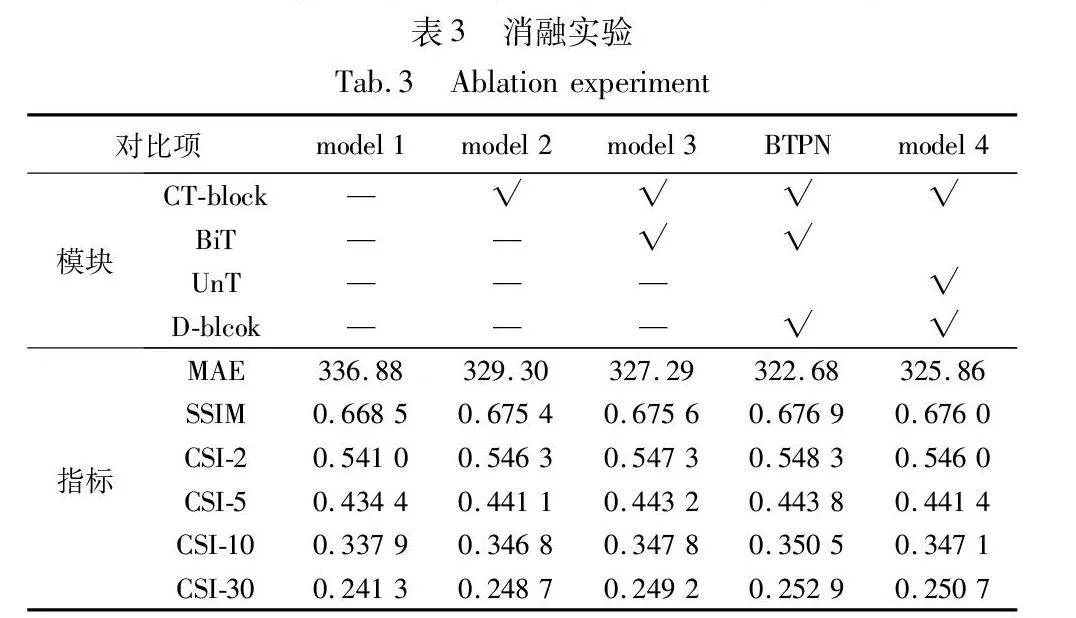

2.5 消融實驗

消融實驗是評價和解析模型各構成部分作用的重要實驗方法。該方法通過刪減或修改模型的特定部分,研究這些變動如何影響模型的整體表現。

如表3所示,本文對BTPN模型進行了一系列消融實驗,主要針對模型中的CT-block、BiT和D-block三個關鍵模塊。消融實驗的初始條件是基礎的SimVP模型,即model 1。在model 1的基礎上,將inception模塊替換為內含常規Transformer的CT-block構建出model 2。實驗結果表明,該變動帶來了模型性能的整體提升,由此證明了CT-block的有效性。接下來,model 3是在model 2的基礎上,通過采用BiT替代CT-block中的Transformer結構,模型性能再次得到提高,這驗證了雙向Transformer在時空序列特征提取方面的有效性。BTPN模型是在model 3的基礎上加入了D-block細節模塊,減少了編解碼過程中可能出現的特征丟失,從而實現了性能的進一步提升。model 4是在BTPN基礎上,使用單向Transformer(UnT)替換雙向Transformer(BiT),UnT也就是對BiT中的逆序和使用常規順序特征,發現精度下降,尤其是高值區域,說明單純地增加和并未帶來性能提升,因此逆序操作是有效的,模型可以從逆序特征中學習到更多的信息。

消融實驗的結果清楚地表明,本文為降水臨近預報專門設計的三個模塊不僅具有實際效能,而且在提升模型整體性能方面發揮了關鍵作用。

3 結束語

本文提出了一種創新的降水臨近預報模型BTPN,設計的雙向Transformer結構有效地捕捉了數據在時間和空間上的關聯性。與此同時,結合 CT-block,融合Transformer全局信息和卷積局部特征的優勢。此外,使用D-block增強編解碼過程中的特征抽取能力,并緩解細節信息的損失,從而實現了更高的預報準確度。

在HKO-7數據集上的實驗結果驗證了BTPN模型在降水臨近預報領域的先進性。實驗結果直觀地展示了BTPN模型在時空信息的傳遞和提取方面優于其他模型,進一步提升了對降水高值區域的預報準確性。無論是在定量指標上還是定性指標上,BTPN模型都展現出較優的性能,證明了模型設計的有效性。這為降水預報問題提供了一種新的思路,對未來的研究有著一定的啟示作用。未來,本文將探究多源數據融合的預報方法,通過結合溫度場、風場等對降水預測有著密切關聯的因子,以期進一步提高預報的精度。

參考文獻:

[1]Gao Zhihan, Shi Xingjian, Wang Hao, et al. Deep learning and the weather forecasting problem: precipitation nowcasting[M]//Camps-Valls G, Tuia D, Zhu X X, et al. Deep Learning for the Earth Sciences: A Comprehensive Approach to Remote Sensing, Climate Science, and Geosciences.[S.l.]: Wiley, 2021: 218-239.

[2]羅健文, 鄒茂揚, 楊昊, 等. 面向降雨預報的雷達回波預測序列外推方法[J]. 計算機應用研究, 2024, 41(4): 1138-1142. (Luo Jianwen, Zou Maoyang, Yang Hao, et al. Research on extrapolation of radar echo prediction sequence for rainfall prediction[J]. Application Research of Computers, 2024, 41(4): 1138-1142.)

[3]Bauer P, Thorpe A, Brunet G. The quiet revolution of numerical weather prediction[J]. Nature, 2015, 525(7567): 47-55.

[4]Ayzel G, Scheffer T, Heistermann M. RainNet v1.0: a convolutional neural network for radar-based precipitation nowcasting[J]. Geoscientific Model Development, 2020, 13(6): 2631-2644.

[5]Han D, Choo M, Im J, et al. Precipitation nowcasting using ground radar data and simpler yet better video prediction deep learning[J]. GIScience & Remote Sensing, 2023, 60(1): 2203363.

[6]Ko J, Lee K, Hwang H, et al. Effective training strategies for deep-learning-based precipitation nowcasting and estimation[J]. Compu-ters & Geosciences, 2022, 161: 105072.

[7]孔德璇. 基于深度學習的貴州地區分鐘級臨近降水預報研究[D]. 南京: 南京信息工程大學, 2023. (Kong Dexuan. Research on minute-level near-term precipitation forecast in Guizhou based on deep learning[D]. Nanjing: Nanjing University of Information Science & Technology, 2023.)

[8]吳曉鋒, 唐曉文, 王元, 等. 基于單多普勒雷達的光流法改進技術[J]. 氣象科學, 2020,40(4): 497-504. (Wu Xiaofeng, Tang Xiaowen, Wang Yuan, et al. Improved optical flow method based on single-Doppler radar[J]. Meteorological Science, 2020, 40(4): 497-504.)

[9]Johnson J, Mackeen P L, Witt A, et al. The storm cell identification and tracking algorithm: an enhanced WSR-88D algorithm[J]. Weather and Forecasting, 1998, 13(2): 263-276.

[10]Woo W C, Wong W K. Operational application of optical flow techniques to rainfall nowcasting[J]. Atmosphere, 2017, 8(3): 48.

[11]Gultepe I, Sharman R, Williams P D, et al. A review of high impact weather for aviation meteorology[J]. Pure and Applied Geophy-sics, 2019, 176: 1869-1921.

[12]徐成鵬, 曹勇, 張恒德, 等. U-Net模型在京津冀臨近降水預報中的應用和檢驗評估[J]. 氣象科學, 2022, 42(6): 781-792. (Xu Chengpeng, Cao Yong, Zhang Hengde, et al. Application and evaluation of U-Net model in near-term precipitation forecast in Beijing-Tianjin-Hebei region[J]. Meteorological Science, 2022, 42(6): 781-792.)

[13]Trebing K, Staczyk T, Mehrkanoon S. SmaAt-UNet: precipitation nowcasting using a small attention-UNet architecture[J]. Pattern Recognition Letters, 2021, 145: 178-186.

[14]Shi Xingjian, Chen Zhourong, Wang Hao, et al. Convolutional LSTM network: a machine learning approach for precipitation nowcasting[C]//Proc of the 28th International Conference on Neural Information Processing Systems. Cambridge, MA: MIT Press, 2015: 802-810.

[15]Shi Xingjian, Gao Zhihan, Lausen L, et al. Deep learning for precipitation nowcasting: a benchmark and a new model[C]//Proc of the 31st Conference on Neural Information Processing Systems. Red Hook, NY: Curran Associates Inc., 2017: 5622-5632.

[16]Wang Yunbo, Long Mingsheng, Wang Jianmin, et al. PredRNN: recurrent neural networks for predictive learning using spatiotemporal LSTMs[C]//Proc of the 31st Conference on Neural Information Processing Systems. Red Hook, NY: Curran Associates Inc., 2017, 879-888.

[17]Wang Yunbo, Gao Zhifeng, Long Mingsheng, et al. PredRNN++: towards a resolution of the deep-in-time dilemma in spatiotemporal predictive learning[C]//Proc of the 35th International Conference on Machine Learning.[S.l.]: PMLR, 2018: 5123-5132.

[18]Wang Yunbo, Wu Haixu, Zhang Jianjin, et al. PredRNN: a recurrent neural network for spatiotemporal predictive learning[J]. IEEE Trans on Pattern Analysis and Machine Intelligence, 2023, 45(2): 2208-2225.

[19]Guen V L, Thome N. Disentangling physical dynamics from unknown factors for unsupervised video prediction[C]//Proc of IEEE/CVF Conference on Computer Vision and Pattern Recognition. Piscataway, NJ: IEEE Press, 2020: 11474-11484.

[20]Ronneberger O, Fischer P, Brox T. U-Net: convolutional networks for biomedical image segmentation[M]//Navab N, Hornegger J, Wells W, et al. Medical Image Computing and Computer-Assisted Intervention. Berlin: Springer, 2015: 234-241.

[21]Gao Zhangyang, Tan Cheng, Wu Lirong, et al. SimVP: simpler yet better video prediction[C]//Proc of IEEE/CVF Conference on Computer Vision and Pattern Recognition. Piscataway, NJ: IEEE Press, 2022: 3160-3170.

[22]Han Lei, Liang He, Chen Haonan, et al. Convective precipitation nowcasting using U-Net model[J]. IEEE Trans on Geoscience and Remote Sensing, 2022, 60: 1-8.

[23]Chollet F. Xception: deep learning with depthwise separable convolutions[C]//Proc of IEEE Conference on Computer Vision and Pattern Recognition. Piscataway, NJ: IEEE Press, 2017: 1800-1807.

[24]Woo S, Park J, Lee J Y, et al. CBAM: convolutional block attention module[C]//Proc of European Conference on Computer Vision. Berlin: Springer, 2018: 3-19.

[25]Reichstein M, Camps-Valls G, Stevens B, et al. Deep learning and process understanding for data-driven earth system science[J]. Nature, 2019, 566(7743): 195-204.

[26]Devlin J, Chang M W, Lee K, et al. BERT: pre-training of deep bidirectional transformers for language understanding[EB/OL]. (2019-05-24). https://arxiv.org/abs/1810.04805.

[27]Vaswani A, Shazeer N, Parmar N, et al. Attention is all you need[EB/OL]. (2023-08-02). https://arxiv.org/abs/1706.03762.

[28]Dosovitskiy A, Beyer L, Kolesnikov A, et al. An image is worth 16×16 words: Transformers for image recognition at scale[EB/OL]. (2021-06-03). https://arxiv.org/abs/2010.11929.

[29]He Kaiming, Zhang Xiangyu, Ren Shaoqing, et al. Deep residual learning for image recognition[C]//Proc of IEEE Conference on Computer Vision and Pattern Recognition. Piscataway, NJ: IEEE Press, 2016: 770-778.

[30]Mehta S, Rastegari M. MobileViT: light-weight, general-purpose, and mobile-friendly vision Transformer[EB/OL]. (2021-10-05). https://arxiv.org/abs/2110.02178.

[31]Kingma D P, Ba J. Adam: a method for stochastic optimization[EB/OL]. (2017-01-30). https://arxiv.org/abs/1412.6980.