尺度適應性感受野的船舶目標檢測方法

摘 要:

現有船舶目標檢測算法大部分只是基于傳統目標檢測算法的優化改進,沒有考慮船舶具有尺度長寬比例的外觀特性,在多尺度目標檢測中出現漏檢誤檢問題。為了解決此問題,在YOLOXs基礎上,提出一種尺度適應性感受野的船舶檢測方法(SAF-YOLOX)。首先,對主干網絡提取的不同特征層通過構建雙向特征金字塔進行特征融合,增強每個尺度下的特征描述力;同時,設計自適應特征強化模塊,抑制不同尺度的特征融合引入的冗余信息,弱化背景信息;然后在預測時,采用多路并行感受野的檢測頭,利用具有適應目標大小以及比例的感受野提取目標尺度適應性特征信息進行預測;最后,采用先篩選再分配的收斂感知策略,根據網絡的收斂狀態動態地分配樣本,保證檢測速度的同時提高檢測精度。實驗結果顯示,所提方法在大型海事監控數據集SeaShips和MCShips上的平均檢測精度分別達到93.21%和92.34%,與傳統YOLOXs相比,分別提高了1.01%和1.09 %。實驗結果證明,所提方法利用尺度適應性感受野能實現多尺度船舶目標的高精度檢測。

關鍵詞:船舶目標檢測;YOLOX;尺度自適應;特征強化;分配策略

中圖分類號:TP391.41 文獻標志碼:A 文章編號:1001-3695(2024)08-039-2521-07

doi: 10.19734/j.issn.1001-3695.2023.10.0558

Ship object detection based on scale-adaptive receptive field

Luo Fang1, Li Jiawei1, He Daosen2

(1.College of Computer Science & Artificial Intelligence, Wuhan University of Technology, Wuhan 430063, China; 2. Dept. of Supply Chain & Information Management, Hang Seng University of Hong Kong, Hong Kong 999077, China)

Abstract:

The existing ship object detection algorithms mostly rely on optimized improvements based on traditional object detection algorithms, without considering the scale and aspect ratio characteristics of ships, leading to issues such as missed detections and false detections in multi-scale object detection. To address this, the paper proposed a scale-adaptive receptive field ship detection method(SAF-YOLOX) based on YOLOXs. Firstly, it extracted different feature layers by the backbone network, which were fused by constructing a bidirectional feature pyramid, improving feature representation at various scales. Simultaneously, it designed an adaptive feature enhancement module to suppress redundant information introduced by the fusion of features at different scales, thereby attenuating background information. During the prediction phase, it employed a multi-branch parallel receptive field detection head, utilizing receptive fields adapted to target sizes and proportions for extracting scale-adaptive feature information. Additionally, it implemented a convergence-aware strategy, dynamically selecting and allocating samples based on the network’s convergence state. This strategy ensured improved detection accuracy while maintaining detection speed. Experimental results demonstrate that the proposed method achieves an average detection accuracy of 93.21% on the SeaShips dataset and 92.34% on the MCShips dataset. When compared to traditional YOLOXs, the method exhibits an improvement of 1.01% and 1.09%, respectively. The experimental results confirm that the proposed method, utilizing scale-adaptive receptive fields, can achieve high-precision detection of multi-scale ship targets.

Key words:ship object detection; YOLOX; scale adaptation; feature enhancement; assign policies

0 引言

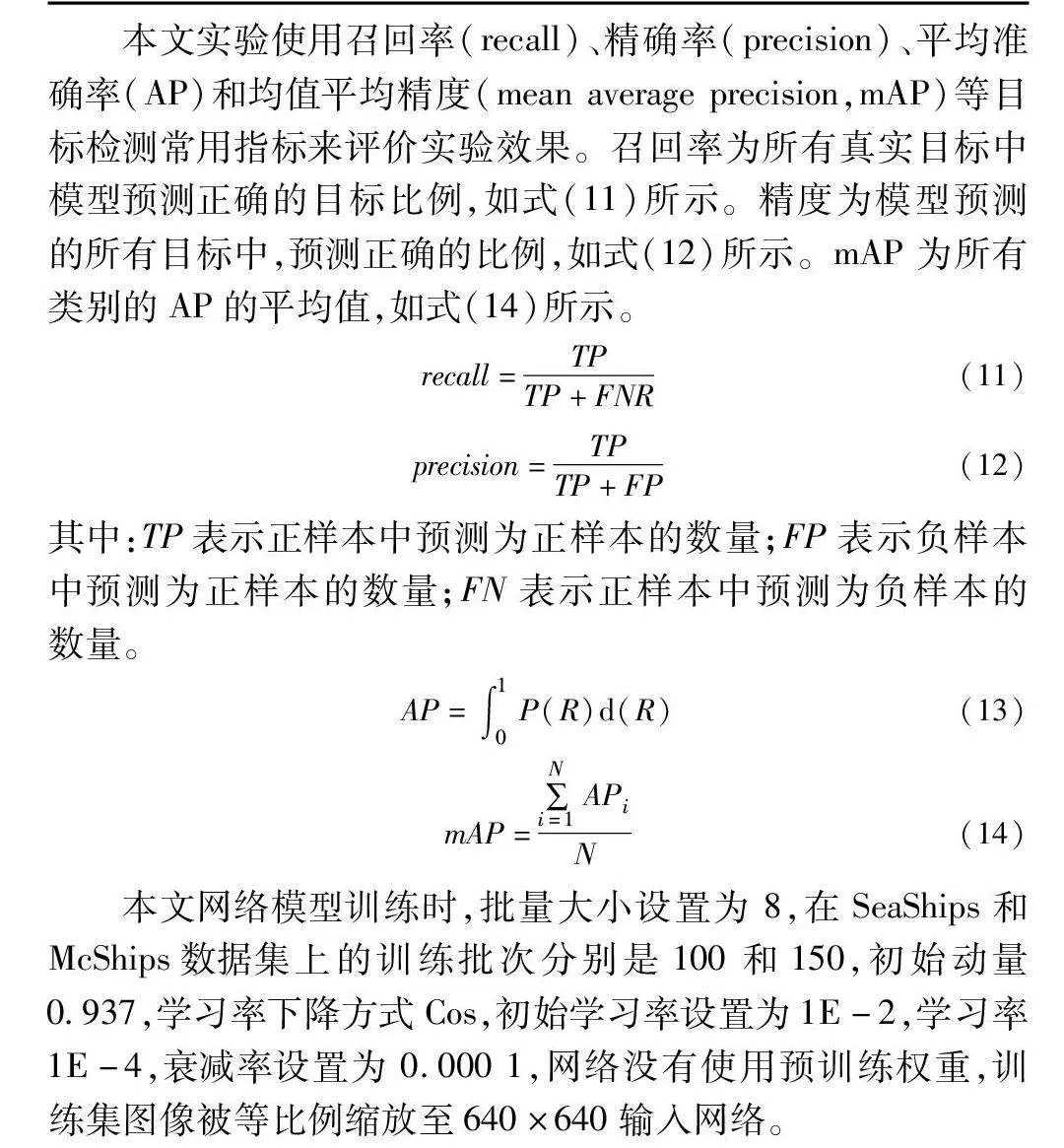

經過近十年的發展,基于深度學習的目標檢測日趨成熟,但是多尺度目標檢測仍面臨著挑戰,近年來諸多研究模擬人類視覺的感受野[1]來提升多尺度目標檢測性能。Liu等人[2]在inception的基礎上加入了空洞卷積,通過具有不同空洞率的卷積核得到不同大小的感受野,以提取具有更多上下文信息的目標特征; Zhao等人[3]設計金字塔池化模塊(pyramid pooling module,PPM),利用全局平均池化將不同感受野的特征進行融合,增強了有效感受野的大小; Dai等人[4]根據當前需要識別的目標進行感受野動態調整,提出可變形卷積以獲得更準確的感受野;彭晏飛等人[5]利用不同大小、不同尺度的感受野來捕捉目標的上下文信息,豐富目標的特征信息,強化小目標檢測;李坤亞等人[6]利用不同感受野與注意力機制結合來融合目標全局特征信息,建立通道與全局特征圖各像素間的全局依賴關系,以抑制冗余信息的干擾。上述研究利用不同大小感受野的特征進行特征融合,提取更多的全局信息有助于多尺度目標的檢測。但對于多尺度船舶目標檢測而言,不同類別的船舶因其外觀形狀大多是細長型,而不同特征層下其感受野大多是長方形,因此這些方法不能很好地匹配船舶外型尺寸,并且對小目標而言會引入更多背景信息,造成檢測效果不好。例如,從圖1(圖中黃色標注是矩形整數感受野,紅色標注非整數感受野)不同特征圖下目標的感受野中可以看出,圖1(a)20×20特征圖中船舶目標①、②、③的感受野大小分別是6×5、 6×2、4×2,在圖1(b)10×10特征圖中船舶目標①、②、③的感受野大小分別是3×3、3×2、2×1,利用正方形卷積核獲取的感受野與實際船舶目標外型存在偏差;再者,如果固定用長方形整數卷積核生成的感受野可能不能完全匹配船舶目標尺寸,導致提取的特征包含過多的干擾信息,例如在圖1(b)10×10特征圖下黃色標注區域中目標船舶①、②、③的整數感受野包含了多余的背景冗余信息,其目標前景的真正有效區域是紅色標注區域,即非整數感受野。另外,同一尺度目標的感受野具有明顯的變化,如果只利用一個固定感受野的檢測頭處理特征層,無法適應目標的比例變化,例如在圖1(a)20×20特征圖中,目標船舶①、②感受野大小分別是6×5、6×2,用一個感受野6×5的檢測頭處理該特征層,對于船舶目標①能夠較好地提取特征并預測,但是對于目標船舶②則會引入過多的背景信息,不利于目標的預測。

為了提升多尺度船舶目標檢測性能,使檢測頭中感受野與船舶目標的外型及尺度大小相適應,本文構建了一個尺度適應性感受野的船舶目標檢測網絡,以解決傳統的目標檢測網絡采用固定感受野無法有效捕捉不同尺度的船舶目標,而導致的目標漏檢問題。為此,設計一個多路并行感受野的檢測頭,通過引入多路并行感受野,利用與目標大小尺度更匹配的感受野來提取目標特征信息,提高船舶目標檢測精度。為了避免特征融合后帶來的沖突信息和背景信息對多路并行感受野的檢測頭造成干擾,本文設計了自適應特征強化模塊,利用通道和空間自適應融合的機制,抑制沖突信息,使得前景信息得到強化,同時減弱背景信息的影響,從而提高目標檢測的準確性。

此外,引入多路并行感受野的檢測頭有助于更好地捕捉不同大小目標的特征信息,但同時可能增加了網絡的復雜性。因此本文設計了收斂感知分配策略,根據網絡復雜性和收斂程度自適應地計算和分配正樣本個數,以優化網絡的訓練過程,解決復雜性問題并加速網絡的收斂。

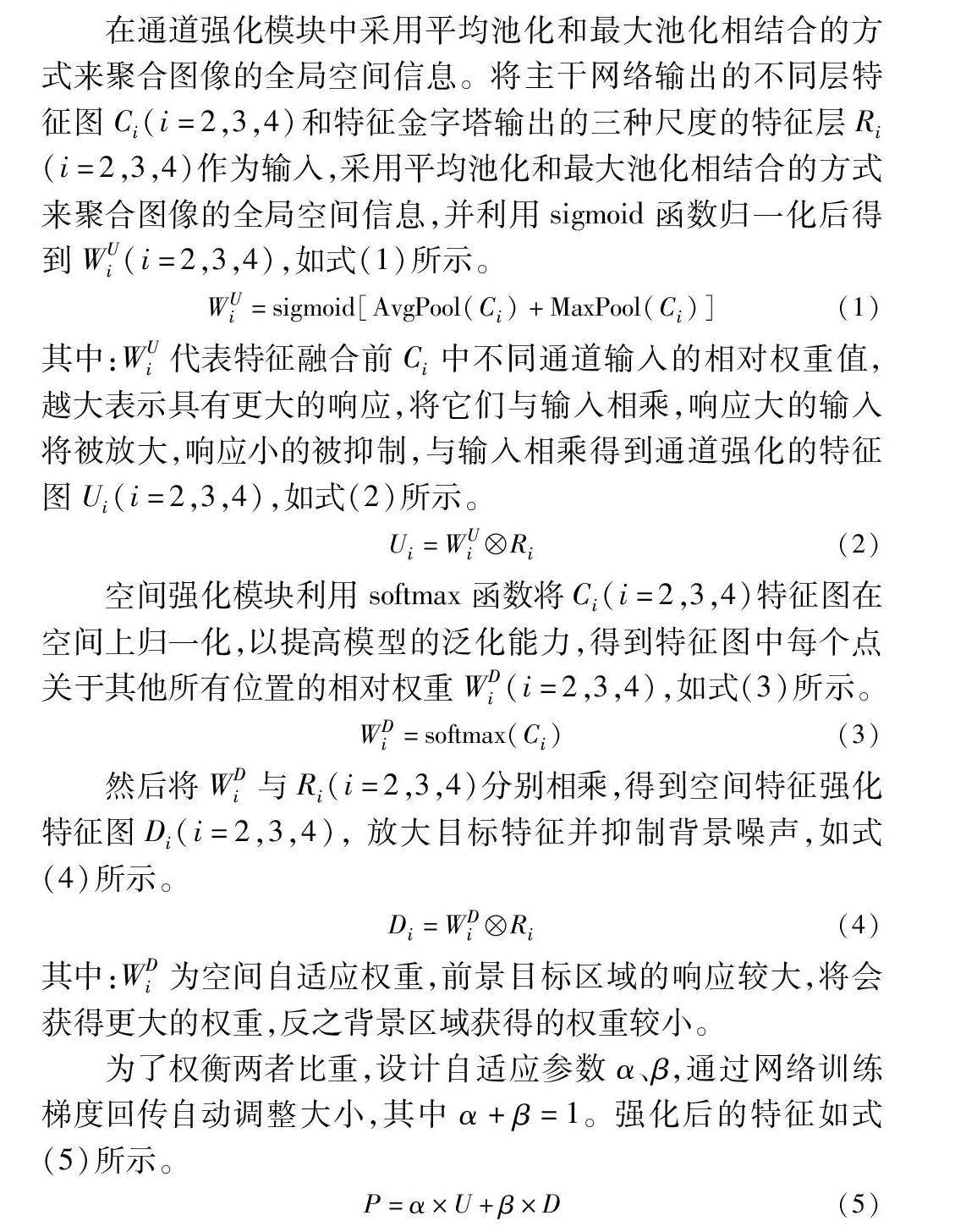

1 本文方法

本文基于YOLOXs[7]構建尺度適應性船舶檢測網絡,如圖2所示。首先,為了增強每個尺度下的特征描述力,對主干網絡提取的不同特征層通過構建雙向特征金字塔進行特征融合[8];接著,為抑制不同尺度的特征融合引入的冗余信息,提出自適應特征強化模塊,以弱化背景信息;然后在預測時,采用多路并行感受野的檢測頭,利用具有適應目標大小以及比例的感受野的卷積核對特征層P2~P4進行解耦處理,利用目標尺度適應性特征信息進行預測;另外,多路并行感受野的檢測頭增加了網絡的復雜性,為了保證檢測速度的同時提高檢測精度,采用先篩選再分配的收斂感知策略,根據網絡的收斂狀態動態地分配樣本。

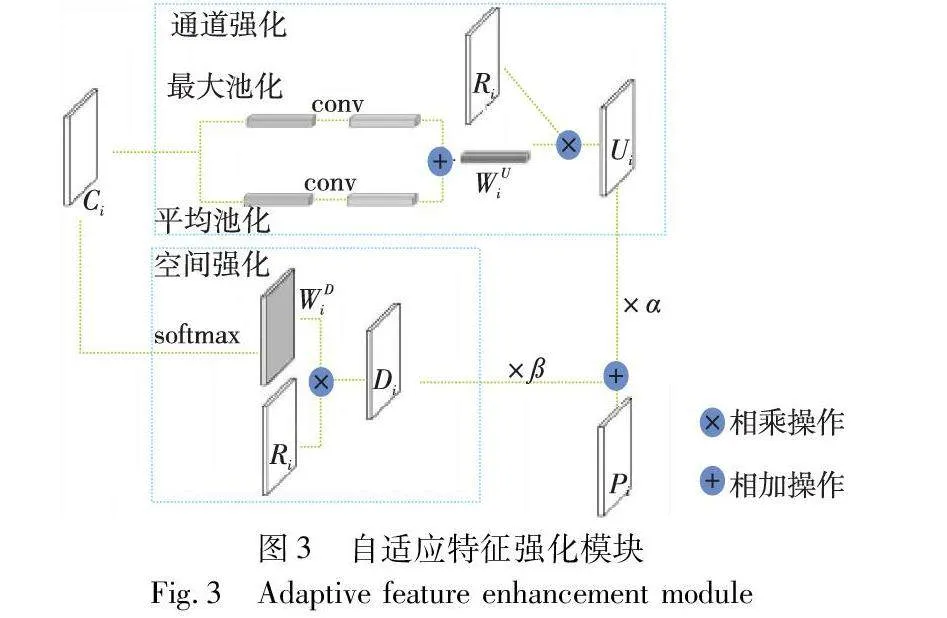

1.1 自適應特征強化

特征金字塔[9]用于融合不同尺度大小的特征,然而不同尺度的特征具有不可忽視的語義差異,將不同尺度的特征直接融合可能引入大量的冗余信息、沖突信息,這樣會造成目標前景弱化,降低多尺度表達的能力。為了抑制不同尺度冗余信息、沖突信息,同時強化前景信息、弱化背景信息,獲得包含更多目標前景信息的特征圖,以便于后續檢測,本文設計自適應特征強化模塊,利用主干網絡特征來指導融合后的特征層進行特征強化,分別通過通道強化和空間強化得到特征圖U和D,如圖3所示。

在通道強化模塊中采用平均池化和最大池化相結合的方式來聚合圖像的全局空間信息。將主干網絡輸出的不同層特征圖Ci(i=2,3,4)和特征金字塔輸出的三種尺度的特征層Ri(i=2,3,4)作為輸入,采用平均池化和最大池化相結合的方式來聚合圖像的全局空間信息,并利用sigmoid函數歸一化后得到WUi(i=2,3,4),如式(1)所示。

WUi=sigmoid[AvgPool(Ci)+MaxPool(Ci)](1)

其中:WU i代表特征融合前Ci中不同通道輸入的相對權重值,越大表示具有更大的響應,將它們與輸入相乘,響應大的輸入將被放大,響應小的被抑制,與輸入相乘得到通道強化的特征圖Ui(i=2,3,4),如式(2)所示。

Ui=WUiRi(2)

空間強化模塊利用 softmax 函數將Ci (i=2,3,4)特征圖在空間上歸一化,以提高模型的泛化能力,得到特征圖中每個點關于其他所有位置的相對權重WDi(i=2,3,4),如式(3)所示。

WDi=softmax(Ci)(3)

然后將WDi與Ri(i=2,3,4)分別相乘,得到空間特征強化特征圖Di(i=2,3,4), 放大目標特征并抑制背景噪聲,如式(4)所示。

Di=WDiRi(4)

其中:WDi為空間自適應權重,前景目標區域的響應較大,將會獲得更大的權重,反之背景區域獲得的權重較小。

為了權衡兩者比重,設計自適應參數α、β,通過網絡訓練梯度回傳自動調整大小,其中α+β=1。強化后的特征如式(5)所示。

P=α×U+β×D(5)

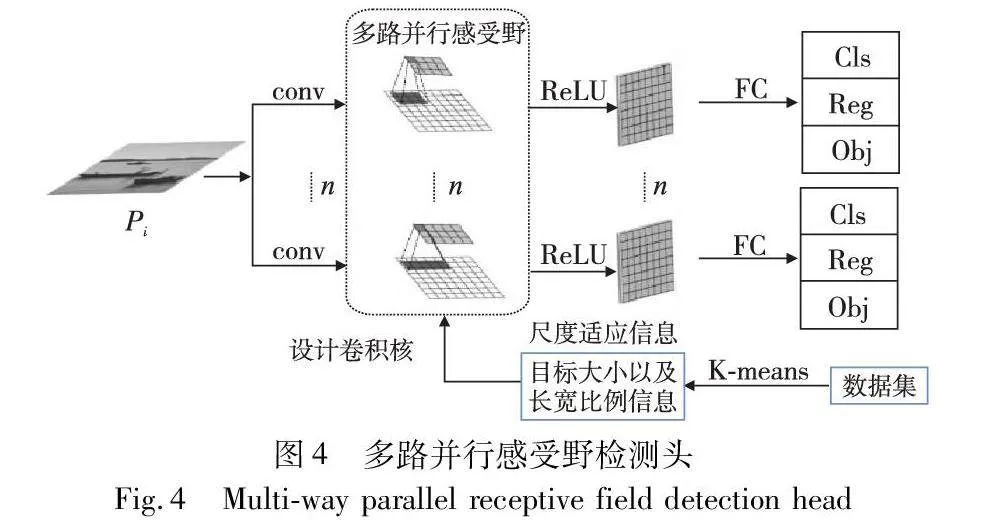

1.2 檢測頭優化

目前,在檢測頭中通常采用1×1、3×3卷積核,或者是全連接神經網絡,這種方式獲得的感受野大小是固定的,不一定與檢測目標的尺寸匹配。目標檢測時,預測所用的感受野大小取決于網絡最后一層,即由檢測頭中卷積核感受野的大小決定,為了獲取匹配目標尺寸的感受野,本文對檢測頭進行了優化,如圖4所示,設計多路并行感受野的檢測頭,利用多路并行的尺度適應性感受野分別對特征層進行特征提取并預測。

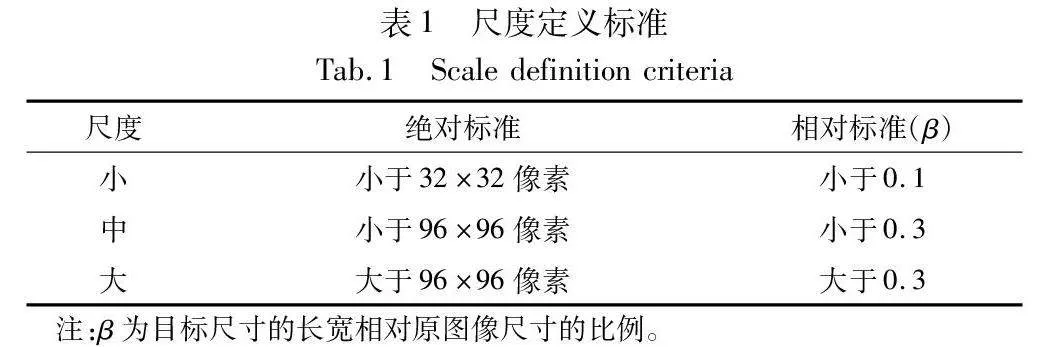

該模塊在同一特征層下,利用n條并行支路分別進行預測,其中每一路設置具有不同尺度適應性感受野的卷積,再利用激活函數得到具有適應目標尺度的特征圖,最后利用全連接層輸出該特征層下目標的預測結果。關于每一支路尺度適應性感受野的確定,本文借鑒基于Anchor[10]的目標檢測算法中的Anchor選取方式。首先統計數據大中小目標的數量,其中大中小目標的定義如表1,同時考慮基于相對尺度和基于絕對尺度兩個標準,然后根據統計數量確定大中小目標數量比值約數來作為聚類的類別個數,利用K-means[11]分別對大目標、中目標、小目標進行聚類。由于網絡輸入的尺度為640×640,本文將數據集圖片resize成640×640,然后將resize后的真實框信息進行聚類,最后根據聚類結果確定不同尺度感受野的大小。

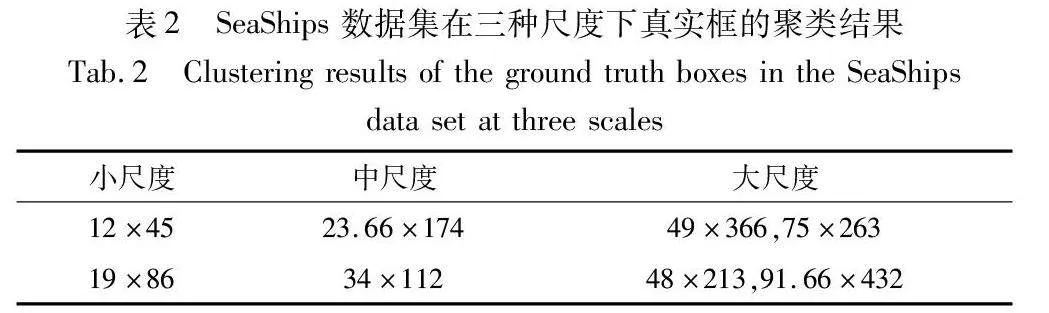

以SeaShips數據集為例,大中小目標的數量比值約為4∶2∶2,即在大中小尺度下n值分別為4、2、2,表2是三種尺度下真實框的聚類結果,可以得出在不同尺度下和同一尺度下都有明顯的長寬比例變化,由此可見利用尺度適應性感受野來提取目標特征更有利于預測。

根據不同尺度的真實聚類框,按照特征層相較于原圖的縮放比例計算得到尺度適應性感受野。以小尺度下目標的真實聚類框大小12×45、19×86為例,按照縮放比例8計算在小尺度特征層上對應框的大小為1.5×5.63、2.4×10.75,本文將這個計算結果作為處理小尺度特征層中多路感受野的并行檢測頭中感受野的大小。

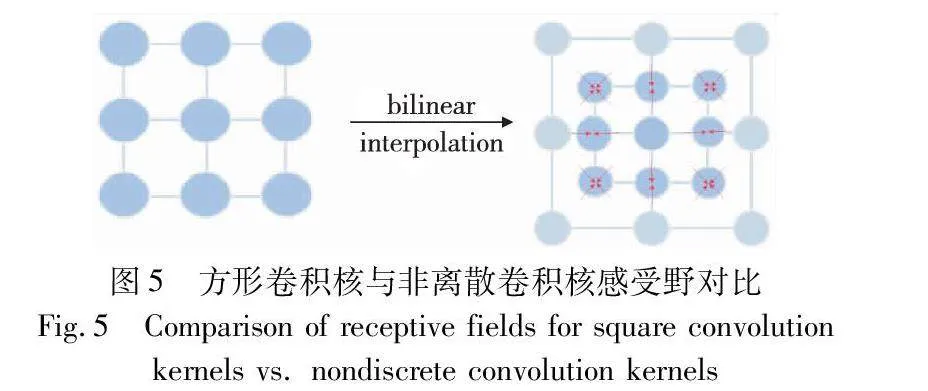

由此本文提出了非離散卷積核實現尺度適應性感受野,對特征點采用雙線性插值進行逼近,并利用相應的變換矩陣進行非整數卷積的實現。與整數矩形內核的對應CNN相比,訓練需要大約相等的計算量。

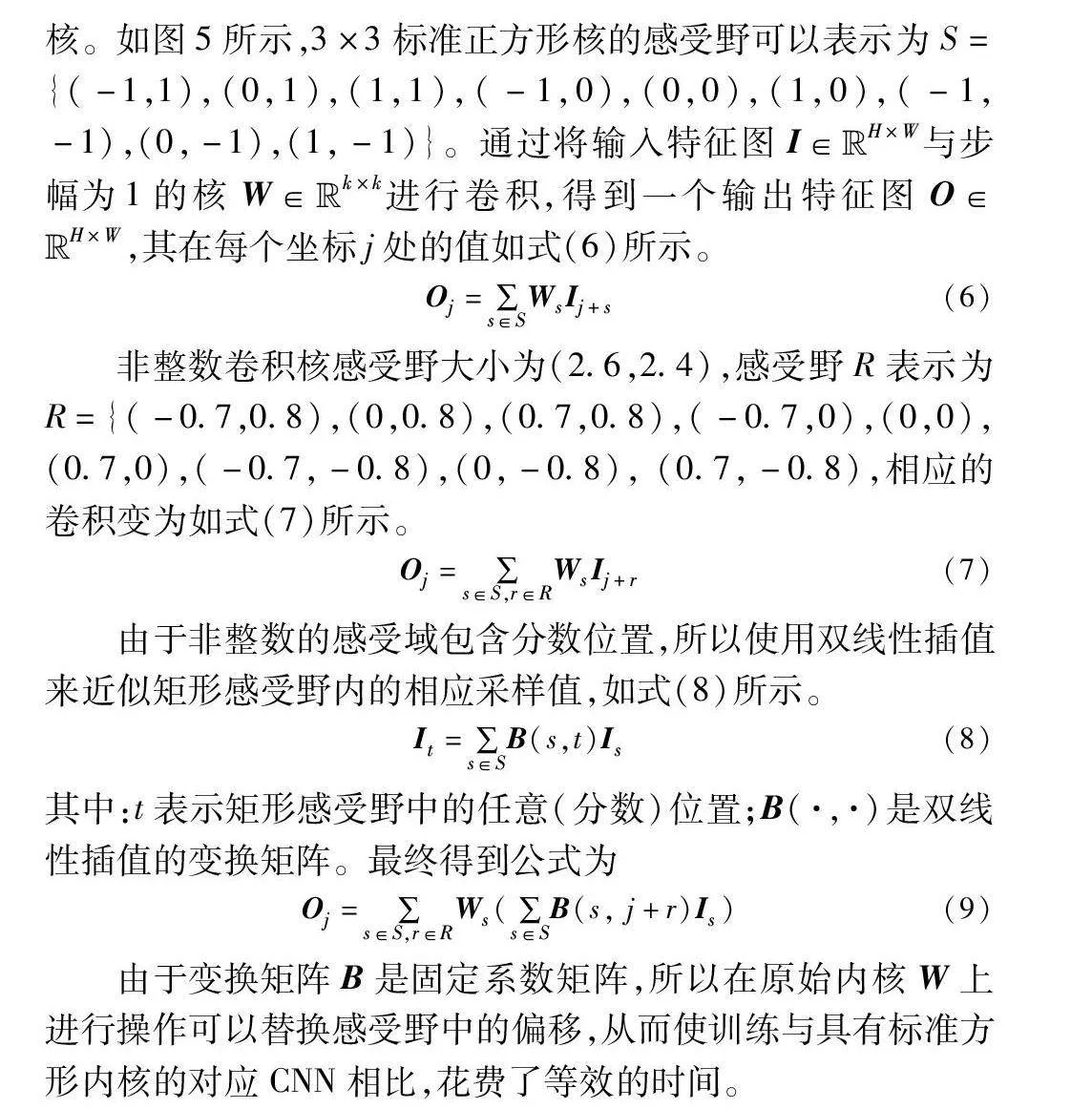

以感受野大小為(2.6,2.4)卷積核為例介紹非整數卷積核。如圖5所示,3×3標準正方形核的感受野可以表示為S={(-1,1),(0,1),(1,1),(-1,0),(0,0),(1,0),(-1,-1),(0,-1),(1,-1)}。通過將輸入特征圖I∈Euclid ExtraaBpH×W與步幅為1的核W∈Euclid ExtraaBpk×k進行卷積,得到一個輸出特征圖O∈Euclid ExtraaBpH×W,其在每個坐標j處的值如式(6)所示。

Oj=∑s∈SWsIj+s(6)

非整數卷積核感受野大小為(2.6,2.4),感受野R表示為 R={(-0.7,0.8),(0,0.8),(0.7,0.8),(-0.7,0),(0,0),(0.7,0),(-0.7,-0.8),(0,-0.8), (0.7,-0.8),相應的卷積變為如式(7)所示。

Oj=∑s∈S,r∈RWsIj+r(7)

由于非整數的感受域包含分數位置,所以使用雙線性插值來近似矩形感受野內的相應采樣值,如式(8)所示。

It=∑s∈SB(s,t)Is(8)

其中:t表示矩形感受野中的任意(分數)位置;B(·,·)是雙線性插值的變換矩陣。最終得到公式為

Oj=∑s∈S,r∈RWs(∑s∈SB(s, j+r)Is)(9)

由于變換矩陣B是固定系數矩陣,所以在原始內核W上進行操作可以替換感受野中的偏移,從而使訓練與具有標準方形內核的對應CNN相比,花費了等效的時間。

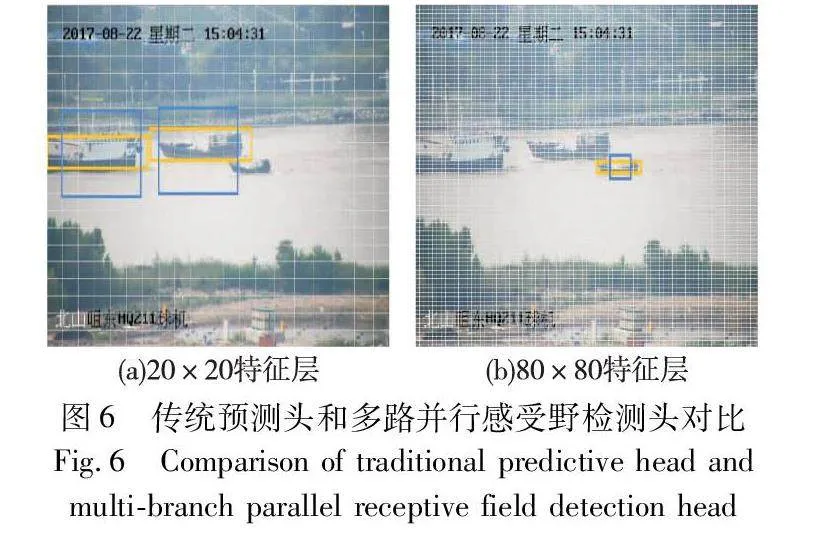

本文提出的尺度適應性感受野與傳統檢測頭中感受野大小相比,都能較好地適應目標的大小,提取的前景目標信息占比更多,更好地進行目標的檢測。 如圖6所示,藍色框表示傳統檢測頭感受野,黃色框表示本文多路并行感受野檢測頭感受野(參見電子版),針對80×80和20×20特征層中的三個船舶目標,其中大目標船舶在20×20特征層中檢測,小目標船舶在80×80特征層中檢測,傳統檢測頭的感受野(YOLOXs中5×5,藍色標注)與本文設計的尺度適應性感受野的適應性進行對比,其中尺度適應性感受野(黃色標注)大小在圖6(a)(b)中分別是(1.5×6.65)、(2.4×10.75)。

1.3 分配策略優化

由于多路并行感受野的檢測頭使預測分支增加,導致預測網絡復雜性增加,造成網絡預測框成倍輸出,樣本分配過程中的計算量增加。為了解決上述問題,本文采用初篩-再分配策略,首先對輸出的預測框按照置信度進行初步篩選,選擇置信度較高的1/3數量的預測框作為分配候選框,然后利用分配策略對分配候選框進行正樣本分配,該方式不僅保證了分配過程的計算量,在一定程度上也保證了預測框的質量,篩選更好的樣本進行網絡的訓練,然后進行再分配策略。

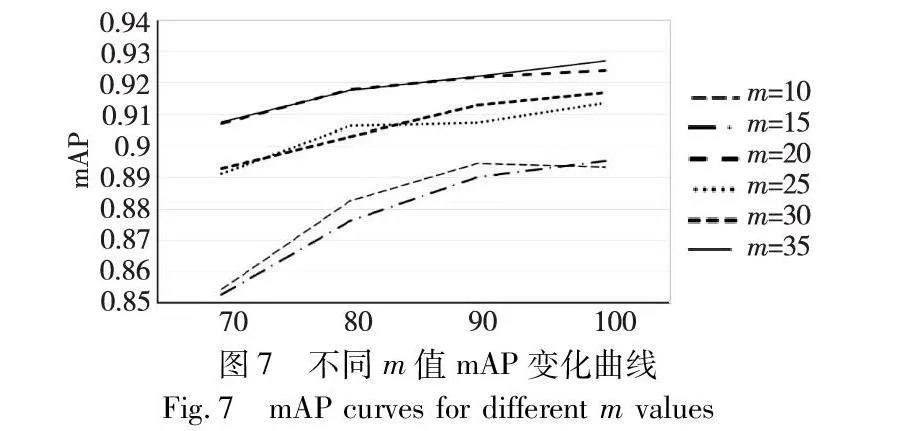

在分配策略中,simOTA[7]通過top-k策略為每個真實框分配正樣本,避免了OTA[12]使用Sinkhorn-Knopp算法求解最優傳輸問題帶來的25%額外的訓練時間開銷,但是simOTA中top-k策略中的m值是固定的,沒有根據網絡收斂情況和網絡復雜性進行動態調整,其中m值表示與真實框的IoU值的前m個預選框,k表示這m個IoU值之和,并向下取整。通過實驗發現m值的大小會影響訓練結果,不同的網絡復雜度對不同m值反應不同,且simOTA策略在訓練前期的動態k值大多為1,只有一個正樣本參與訓練,導致訓練速度緩慢。為了保障網絡每個分支都能得到很好的訓練,應該提高標簽的正樣本個數。

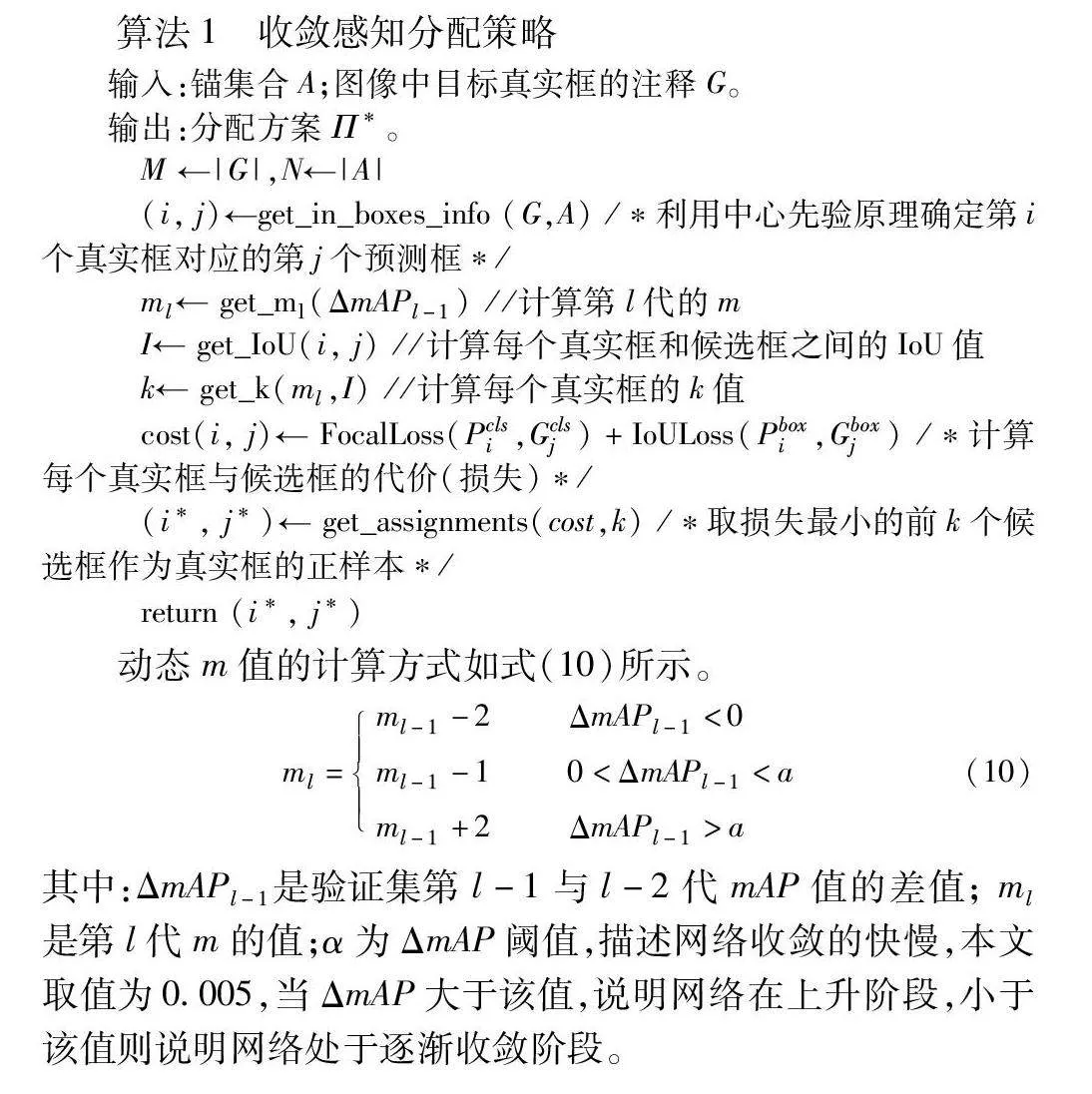

考慮上述問題,本文設計收斂感知分配策略,在m值計算過程中考慮網絡的復雜性以及收斂性信息,進一步實現正樣本數量的動態調整。其中關于動態m值的確定,以mAP反映網絡收斂程度,mAP的變化曲線一般是快上升,慢收斂。在網絡收斂性快速上升階段,通過增加m值增加樣本數量,自適應地快速提升網絡能力,在網絡的收斂速度下降時,網絡進入收斂階段,為了避免網絡振蕩,應該減少樣本數量以保證樣本質量。

網絡的復雜性決定m值的上界和下界,m值在(min、max)變化,初始m值較小,min、max可以根據網絡分支(復雜性)的多少決定,本文選用m初始值為10,min值為10,max為40。

算法1 收斂感知分配策略

輸入:錨集合A;圖像中目標真實框的注釋G。

輸出:分配方案Π*。

M ←|G|,N←|A|

(i, j)←get_in_boxes_info (G,A) /*利用中心先驗原理確定第i個真實框對應的第j個預測框*/

ml← get_ml(ΔmAPl-1) //計算第l代的m

I← get_IoU(i, j) //計算每個真實框和候選框之間的IoU值

k← get_k(ml,I) //計算每個真實框的k值

cost(i, j)← FocalLoss(Pclsi,Gclsj)+IoULoss(Pboxi,Gboxj) /*計算每個真實框與候選框的代價(損失)*/

(i*, j*)← get_assignments(cost,k) /*取損失最小的前k個候選框作為真實框的正樣本*/

return (i*, j*)

動態m值的計算方式如式(10)所示。

ml=ml-1-2 ΔmAPl-1<0

ml-1-10<ΔmAPl-1<a

ml-1+2ΔmAPl-1>a (10)

其中:ΔmAPl-1是驗證集第l-1與l-2代mAP值的差值; ml是第l代m的值;α為ΔmAP閾值,描述網絡收斂的快慢,本文取值為0.005,當ΔmAP大于該值,說明網絡在上升階段,小于該值則說明網絡處于逐漸收斂階段。

2 實驗設置及結果分析

本文實驗基于PyTorch深度學習框架,硬件設備為Intel i7-12700K處理器,12核20線程,主頻3.6 GHz,GPU RTX 3080Ti的工作站。

2.1 實驗配置設置和評價指標

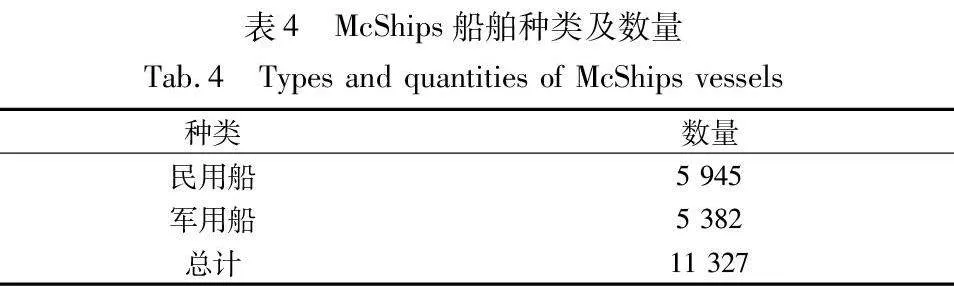

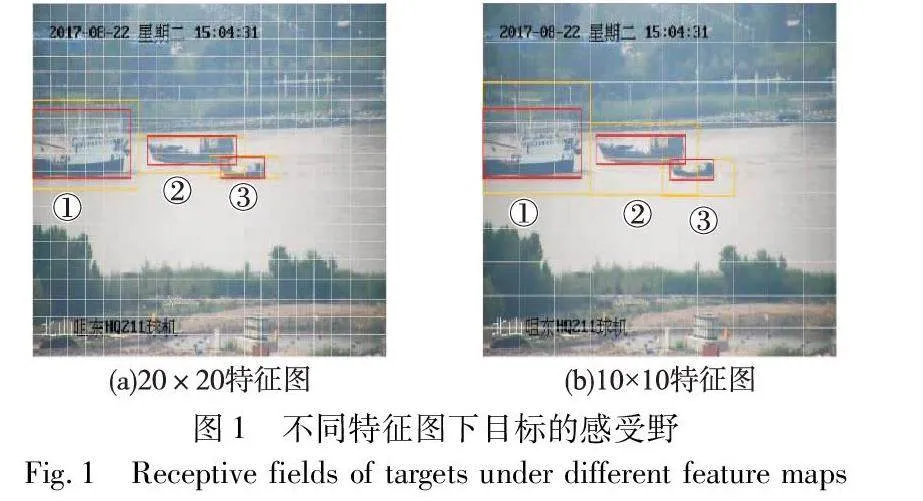

本文選用大型海事監控數據集SeaShips[13]以及McShips[14]進行實驗以評估方法性能。SeaShips如表3所示,六種不同種類的船舶具有不同的尺寸大小。為了進一步驗證模型的適用性,本文還選取西北工業大學公開用于船舶檢測的McShips數據集,如表4所示。與SeaShips相比, McShips包含軍用類型的船舶,并且具有同一類別尺度變化、不同類別尺度變化等特點。

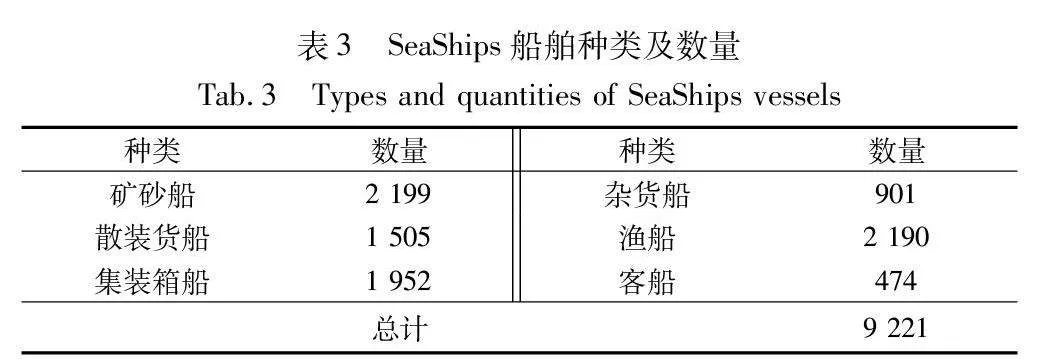

本文實驗使用召回率(recall)、精確率(precision)、平均準確率(AP)和均值平均精度(mean average precision,mAP)等目標檢測常用指標來評價實驗效果。召回率為所有真實目標中模型預測正確的目標比例,如式(11)所示。精度為模型預測的所有目標中,預測正確的比例,如式(12)所示。mAP 為所有類別的AP的平均值,如式(14)所示。

recall=TPTP+FNR(11)

precision=TPTP+FP(12)

其中:TP表示正樣本中預測為正樣本的數量;FP表示負樣本中預測為正樣本的數量;FN表示正樣本中預測為負樣本的數量。

AP=∫10P(R)d(R)(13)

mAP=∑Ni=1 APiN(14)

本文網絡模型訓練時,批量大小設置為 8,在SeaShips和McShips數據集上的訓練批次分別是100和150,初始動量0.937,學習率下降方式Cos,初始學習率設置為1E-2,學習率1E-4,衰減率設置為 0.000 1,網絡沒有使用預訓練權重,訓練集圖像被等比例縮放至640×640輸入網絡。

2.2 驗證實驗結果分析

2.2.1 非離散卷積合理性驗證

為了驗證本文提出的尺度適應性船舶目標檢測的效果,基于SeaShips數據集設置不同形狀以及尺寸的卷積核進行實驗。實驗結果如表5所示,較大的方形卷積核檢測的準確度較高,采用不同比例的矩形卷積核提高檢測精度的效果更明顯,并且大小為3×7卷積核相較于3×3、5×5、7×7的卷積核具有更明顯的提升效果,初步驗證矩形卷積核對船舶檢測的有效性。本文的非離散卷積雖然在散裝貨船和雜貨船的預測上稍遜色于3×7的卷積核,但是在其他類別的船舶檢測上都有明顯優勢,進一步說明非離散卷積能夠更好地適應船舶尺寸以及長寬比例,更好地進行船舶的預測。

2.2.2 收斂感知分配策略有效性驗證

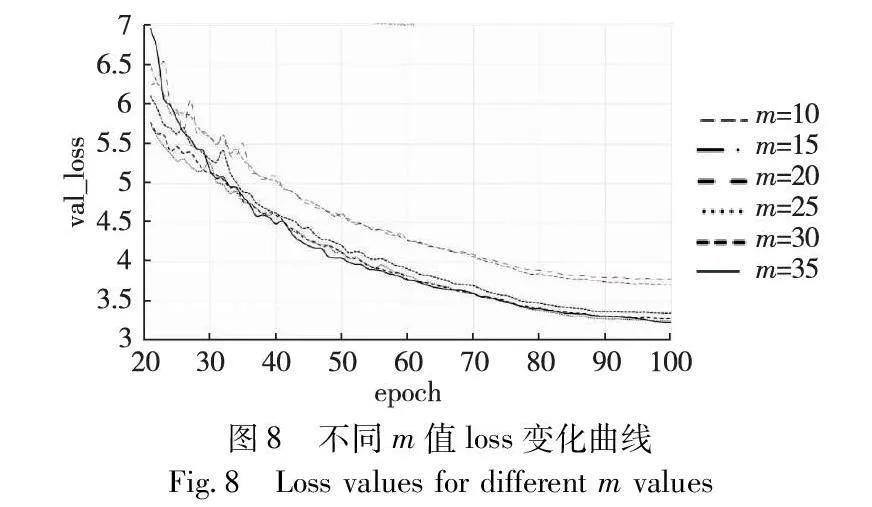

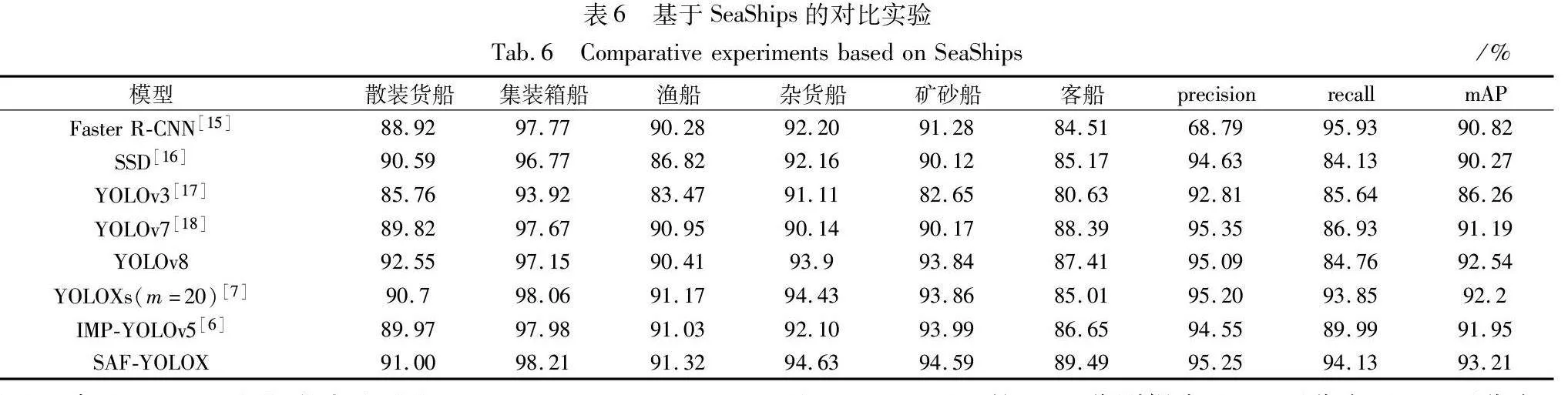

因simOTA匹配策略中的m值是固定的,本文提出收斂感知分配策略對m動態取值,以適應不同的網絡復雜度。基于SeaShips數據集,利用simOTA對m分別取10、15、20、25、30,以及采用收斂感知分配策略dynamic_m分別進行實驗。圖7是不同m值下epoch在70~100的mAP變化折線,圖8是m的不同取值在驗證集的損失折線。從實驗結果看出,不同m值下網絡的收斂整體趨勢一致,但是收斂程度以及收斂快慢有明顯區別。通過對比發現,本文提出的收斂感知分配策略,在mAP上與m=20最好情況相比提高了0.21百分點,許多類別的預測準確率都能達到最好水平,而且從mAP變化折線以及損失變化折線可以看出,本文提出的收斂感知分配策略收斂速度較快,說明其對提高訓練速度以及精度具有一定作用,并且可以有效減少調參這一工作。

2.3 不同數據集對比實驗結果分析

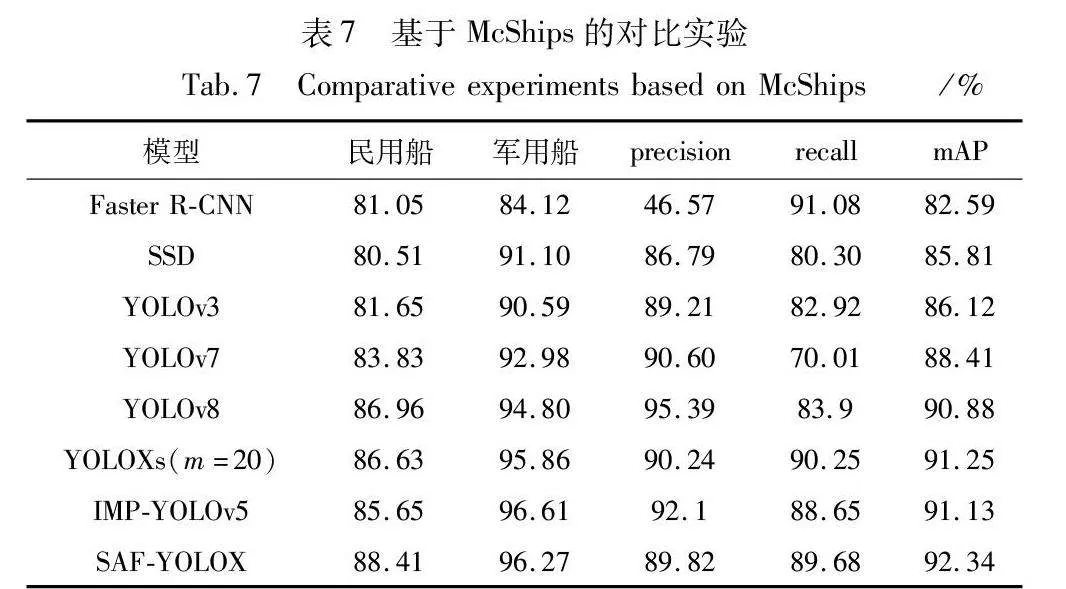

為了證明本文方法的有效性,將其與Faster-RCNN[15]、SSD[16]、YOLOv3[17]、YOLOv7[18]、YOLOv8、YOLOXs、IMP-YOLOv5七種經典目標檢測方法在數據集SeaShips和McShips上進行實驗對比。

Faster R-CNN為經典區域建議雙階段檢測方法,通過區域建議網絡生成候選框再進行船舶分類和邊界框回歸。SSD、YOLOv3、YOLOv7、YOLOv8、YOLOXs為經典單階段檢測算法,SSD通過在多尺度特征層上進行目標檢測,有效提高了小尺寸目標的檢測精度;YOLOv3和YOLOv7通過引入錨框機制,進一步提高目標回歸率;YOLOXs和YOLOv8使用無錨框機制,提高模型運算速度的同時保持檢測精度。其中,YOLOX模型選取m值的最優結果m=20進行實驗對比,IMP-YOLOv5[6]結合不同感受野與注意力機制來融合目標全局特征信息,對小目標檢測進行增強。SAF-YOLOX為本文算法。

2.3.1 基于SeaShips數據集實驗對比

如表6所示,SAF-YOLOX在數據集SeaShips上的mAP達到了93.21%,優于其他七種方法。與雙階段Faster R-CNN對比,SAF-YOLOX雖然召回率低于其1.8百分點,但是在準確率上有明顯提升,在precision和mAP上分別提高了26.46百分點和2.39百分點。與單階段基于錨框機制的檢測方法如SSD、YOLOv3、YOLOv7、YOLOv8相比,SAF-YOLOX在mAP上分別提高2.94百分點、6.95百分點、2.02百分點和0.67百分點;與具有最優m值的YOLOXs方法相比,SAF-YOLOX在mAP上提高1.01百分點。在所有類別上均能取得最好的檢測準確度,說明基于感受野的角度,通過適應目標大小、長寬比例的感受野獲取更準確的特征具有可行性。此外,與IMP-YOLOv5[6]相比,SAF-YOLOX檢測性能更優。綜上所述,本文方法可以有效處理SeaShips數據集中各種尺度船舶的檢測問題,有效提高船舶檢測精度,可以應用于實際場景。

2.3.2 基于McShips數據集實驗對比

不同方法在McShips數據集的對比實驗結果如表7所示。

本文方法得到最高的mAP,達到92.34%。與雙階段Faster R-CNN對比,SAF-YOLOX保證與其相當的召回率條件下,在precision和aVUa5TpE3bUANz4wXjzAuFUxfoVSDAIXACNVska1MwY=mAP上分別提高了43.25百分點和9.75百分點。與經典單階段檢測方法(SSD、YOLOv3、YOLOv7、YOLOv8)相比,SAF-YOLOX的mAP分別提高6.53百分點、6.22百分點、3.93百分點和1.46百分點。與具有最優m值的YOLOXs方法相比,SAF-YOLOX檢測精度提高1.09百分點,對于樣本尺度大小、形狀等變化較大的民用船,檢測精度提高了1.78百分點,進一步說明了本文思路的可行性。此外,與IMP-YOLOv5相比,SAF-YOLOX同樣具有優勢。綜上所述,本文方法可以有效處理McShips數據集中民用船和軍用船的檢測問題,有效提高了模型的泛化能力。

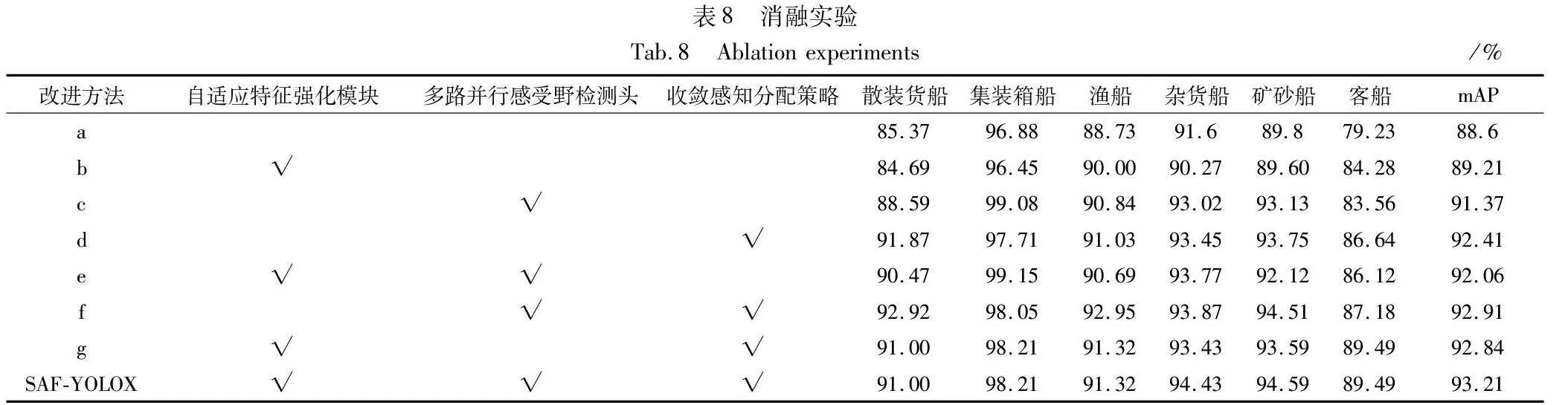

2.4 消融實驗

為了驗證本文的自適應特征強化模塊、多路并行感受野檢測頭、收斂感知分配策略的作用,在SeaShips數據集上設計消融實驗,如表8所示。其中 “√” 表示選擇該模塊。

采用基礎YOLOXs模型(簡稱方法a)的mAP為88.6%,與方法a相比,引入了自適應特征強化模塊后,mAP提高了0.61百分點;引入了多路并行感受野檢測頭,mAP提高了2.77百分點;引入了收斂感知分配策略,mAP提高了2.81百分點。由此說明三種改進方法都促進了模型檢測性能的提升。

為進一步驗證模塊的互相促進作用,對包含不同模塊的方法進行對比實驗,結果表明,組合不同模塊的方法的其性能優于只包含其中一個模塊的方法,驗證了SAF-YOLOX中的各模塊互相促進能提升多尺度船舶檢測性能。其中,包含自適應特征增強、多路并行感受野檢測頭和收斂感知分配策略的本文方法表現最好,與方法a相比,mAP提高了4.61百分點,說明利用多路并行感受野檢測頭能夠較好地提升多尺度目標檢測的效果,并且自適應特征強化模塊和收斂感知分配策略能夠進一步促進多路并行感受野檢測頭發揮作用。

在McShips數據集進行消融實驗同樣也驗證了SAF-YOLOX的有效性。綜上所述,本文方法考慮目標真實的大小、長寬比例信息,從感受野角度出發,設計的具有大小、長寬比例感知多路并行感受野的檢測頭對處理多尺度的目標檢測問題具有一定作用,多路并行感受野的檢測頭通過非離散卷積核獲得更加準確的感受野,提取更加合適的目標特征,提高了多尺度船舶的檢測精度;并且,考慮網絡復雜程度以及網絡收斂程度的收斂感知分配策略,可以更合理地確定正樣本的數量,減少一定的調參工作。

2.5 定性分析

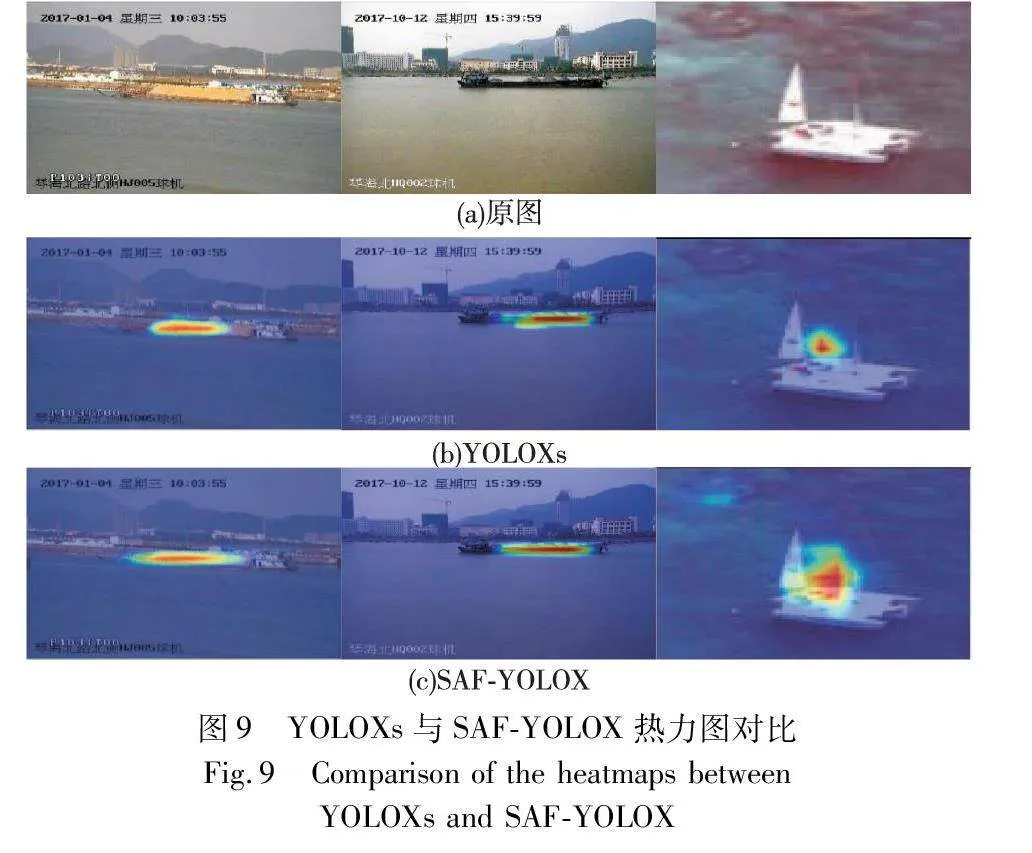

2.5.1 特征熱力圖對比

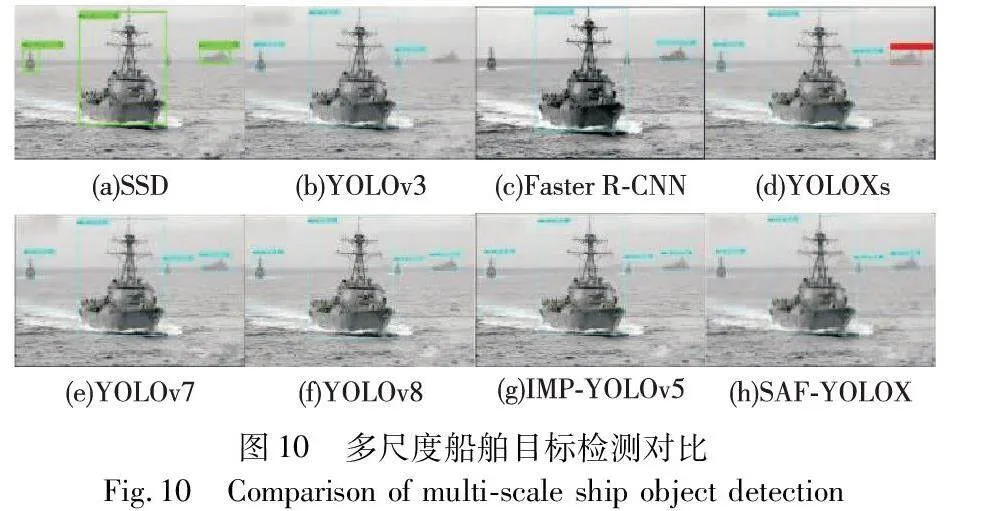

特征熱力圖中有溫度的區域表示模型對目標的關注區域,特征熱力圖9中(a)是原始圖片,(b)則是YOLOXs檢測的特征熱力圖,(c)為SAF-YOLOX檢測的特征熱力圖,其中圖(a)最右邊圖片的分辨率是70×80,其他圖片的分辨率是1080×1920。從圖9可以看出SAF-YOLOX檢測的特征熱力圖范圍更廣,形狀規則性更強,更適應于物體本身的形狀特征。說明SAF-YOLOX提取的特征更多,能更好地進行目標預測,SAF-YOLOX可以提取到更好的目標特征,對于大目標可以提取目標更多的前景信息,對于分辨率差的圖片中的小目標能夠提取更多的目標特征進行預測。

2.5.2 不同場景目標檢測對比

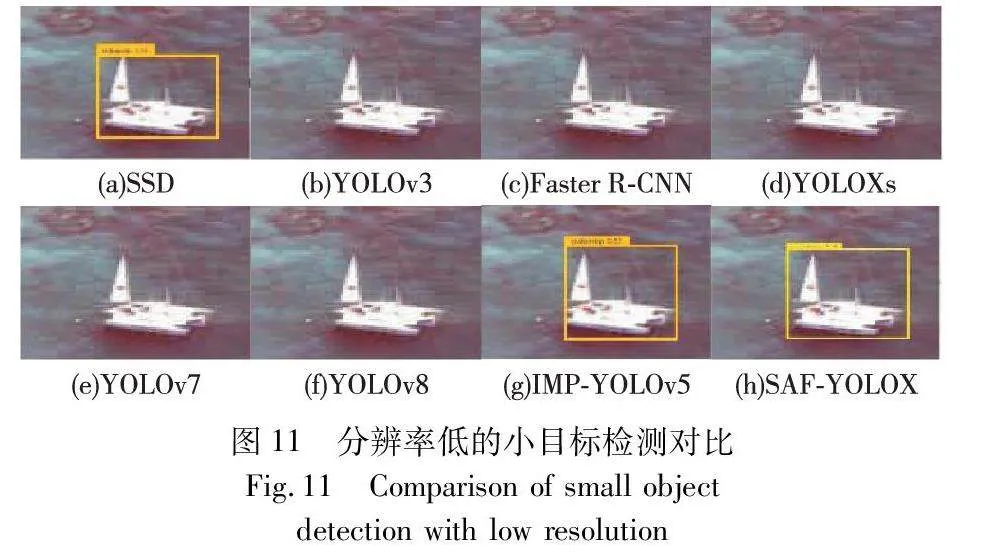

圖10、11為不同檢測方法在不同場景下檢測船舶的結果。在多尺度船舶的場景(圖10),SAF-YOLOX既檢測出大尺寸船舶,又成功分類和定位出小尺寸的船舶,對多尺度船舶目標的感知能力較強。兩階段檢測模型的Faster R-CNN和一階段檢測模型中的SSD、YOLOv3均存在漏檢的情況。雖然YOLOXs、YOLOv7、YOLOv8在檢測大尺度的船舶目標時置信度較高,但是對于小目標的檢測置信度和定位不好,YOLOv7、YOLOv8在小目標預測準確度方面低于SAF-YOLOX,且YOLOXs存在誤檢,并且SAF-YOLOX與IMP-YOLOv5相比在小中目標的檢測上置信度高于該算法。綜上所述,本文模型在存在圖像分辨力較差的小目標、多尺度復雜場景中均比其他模型檢測效果更佳,可以較好地處理船舶行駛中各種復雜場景,具有更強的準確性和魯棒性。

在船舶圖片分辨率較低的小目標場景(圖11)中,對于一階段檢測算法,具有anchor框的YOLOv3、YOLOv7存在漏檢情況,不具有anchor框的YOLOXs、YOLOv8同樣出現漏檢情況,兩階段Faster R-CNN算法也不能正常檢測出船舶目標;從圖11(a)和(g)的對比可以看出,雖然SSD和IMP-YOLOv5能檢測出船舶,但是置信度低于SAF-YOLOX,由此證明本文引入自適應特征強化模塊以及具有目標大小、長寬比例適應的感受野,對分辨率較低場景的目標具有較好的分類和定位能力。

3 結束語

為了解決多尺度船舶目標檢測問題,使得模型檢測在同類別和不同類別船舶目標的多尺度場景下都能有較好的提升,本文考慮船舶目標大小、長寬比例問題,以及不同尺度特征直接融合可能引入的大量冗余信息、沖突信息,先利用特征強化,獲得包含更多目標的前景信息,弱化冗余信息、沖突信息以及背景信息的特征圖;再從感受野的角度出發,依照目標的大小、長寬比例信息,設計與其適應的感受野,對不同的特征圖采用多路并行感受野的檢測頭,獲取更準確的特征進行預測。為了獲得更準確的感受野,本文提出非離散卷積核,實現非整數的感受野;并且本文在SimOTA分配策略的基礎上,考慮網絡預測頭的復雜程度,以及網絡的收斂程度等問題,提出收斂感知分配策略。通過在SeaShips和McShips數據集上的定量和定性對比實驗,證明本文模型在同類別和不同類別多尺度變化場景下都具有良好的準確性和魯棒性。在未來工作中,進一步將模型進行知識蒸餾,輕量化模型,以及可以從有效感受野的角度進一步優化對于目標的特征提取,以達到更優的應用效果。

參考文獻:

[1]Araujo A,Wade N,Jack S. Computing receptive fields of convolutio-nal neural networks[J]. Distill,2019,4(11): e21.

[2]Liu Songtao,Huang Di. Receptive field block net for accurate and fast object detection[C]// Proc of the 15th European Conference on Computer Vision. Berlin: Springer-Verlag,2018: 385-400.

[3]Zhao Hengshuang,Shi Jianping,Qi Xiaojuan,et al. Pyramid scene parsing network[C]// Proc of IEEE Conference on Computer Vision and Pattern Recognition. Piscataway,NJ: IEEE Press,2017: 6230-6239.

[4]Dai Jifeng,Qi Haozhi,Xiong Yuwen,et al. Deformable convolutional networks[C]// Proc of IEEE International Conference on Computer Vision. Piscataway,NJ: IEEE Press,2017: 764-773.

[5]彭晏飛,趙濤,陳炎康,等. 基于上下文信息與特征細化的無人機小目標檢測算法[J]. 計算機工程與應用,2024,60(5): 183-190. (Peng Yanfei,Zhao Tao,Chen Yankang,et al. UAV small object detection algorithm based on context information and feature refinement[J]. Computer Engineering and Applications,2024,60(5): 183-190.)

[6]李坤亞,歐鷗,劉廣濱,等. 改進YOLOv5的遙感圖像目標檢測算法[J]. 計算機工程與應用,2023,59(9): 207-214. (Li Kunya,Ou Ou,Liu Guangbin,et al. Target detection algorithm of remote sensing image based on improved YOLOv5[J]. Computer Engineering and Applications,2023,59(9): 207-214.)

[7]Ge Zheng,Liu Songtao,Wang Feng,et al. YOLOX: exceeding YOLO series in 2021[EB/OL]. (2021-08-06). https://arxiv.org/abs/2107.08430.

[8]毛琳,李雪萌,楊大偉,等. 金字塔頻率特征融合目標檢測網絡[J]. 計算機輔助設計與圖形學學報,2021,33(2): 207-214. (Mao Lin,Li Xuemeng,Yang Dawei,et al. Pyramid frequency feature fusion object detection networks[J]. Journal of Computer-Aided Design & Computer Graphics,2021,33(2): 207-214.)

[9]Lin T Y,Dollár P,Girshick R,et al. Feature pyramid networks for object detection[C]// Proc of IEEE Conference on Computer Vision and Pattern Recognition. Piscataway,NJ: IEEE Press,2017: 2117-2125.

[10]Ribeiro M,Singh S,Guestrin C. Anchors: high-precision model-agnostic explanations[C]// Proc of the 32nd AAAI Conference on Artificial Intelligence and the 30th Innovative Applications of Artificial Intelligence Conference and the 8th AAAI Symposium on Educational Advances in Artificial Intelligence. Palo Alto,CA: AAAI Press,2018: article No.187.

[11]Yuan Chunhui,Yang Haitao. Research on K-value selection method of K-means clustering algorithm[J]. Multidisciplinary Scientific Journal,2019, 2(2): 226-235.

[12]Zheng Ge,Liu Songtao,Wang Feng,et al. OTA: optimal transport assignment for object detection[C]// Proc of IEEE/CVF Conference on Computer Vision and Pattern Recognition. Piscataway,NJ: IEEE Press,2021: 303-312.

[13]Shao Zhenfeng,Wu Wenjing,Wang Zhongyuan,et al. SeaShips: a large-scale precisely annotated dataset for ship detection[J]. IEEE Trans on Multimedia,2018, 20(10): 2593-2604.

[14]Zheng Yitong,Zhang Shun. McShips: a large-scale ship dataset for detection and fine-grained categorization in the wild[C]// Proc of IEEE International Conference on Multimedia and Expo. Piscataway,NJ: IEEE Press, 2020: 1-6.

[15]Ren Shaoqing,He Kaiming,Girshick R,et al. Faster R-CNN: towards real-time object detection with region proposal networks[J]. IEEE Trans on Pattern Analysis and Machine Intelligence,2017,39(6): 1137-1149.

[16]Liu Wei,Dragomir A,Dumitru E,et al. SSD: single shot multibox detector[C]// Proc of European Conference on Computer Vision. Cham: Springer,2016: 21-37.

[17]Redmon J,Farhadi A. YOLOv3: an incremental improvement[EB/OL]. (2018-04-08). https://arxiv.org/abs/1804.02767.

[18]Wang C Y,Bochkovskiy A,Liao H Y M. YOLOv7: trainable bag-of-freebies sets new state-of-the-art for real-time object detectors[C]// Proc of IEEE/CVF Conference on Computer Vision and Pattern Re-cognition. Piscataway,NJ: IEEE Press,2023: 7464-7475.