基于卷積神經網絡的圖像識別

羅嘉杰 施佳林

摘 ? 要:目前,卷積神經網絡在圖像識別和分類領域取得了良好的效果,但網絡結構和參數(shù)的選擇對圖像識別和分類的效果與效率影響很大。為了提高卷積網絡的圖像分類性能,本文結合理論分析和對比實驗,對卷積神經網絡模型進行了詳細的理論分析,并且本文設計了一個具有8層卷積層的深度卷積網絡,并結合批量歸一化處理,在CIFAR-10數(shù)據(jù)集上進行了相關的分類實驗,得到了88.1%的分類精度,相比于傳統(tǒng)的分類設計有效地改善了卷積神經網絡的圖像識別分類效果。

關鍵詞:卷積神經網絡 ?圖像識別 ?圖像分類 ?LeNet-5模型

中圖分類號:TP311 ? ? ? ? ? ? ? ? ? ? ? ? ? ? ? ? 文獻標識碼:A ? ? ? ? ? ? ? ? ? ? ? ?文章編號:1674-098X(2019)08(c)-0130-02

卷積神經網絡是一種具有卷積結構的神經網絡,它能夠減少網絡參數(shù)的數(shù)量,并減輕模型的過度擬合問題。為了確保一定程度的平移,縮放和失真不變性,在卷積神經網絡中設計了局部感受域,共享權重以及空間或時間下采樣,對于此提出了一種用于字符識別的卷積神經網絡LeNet-5。LeNet-5由卷積層,下采樣層和完全連接層組成。

1 ?LeNet-5網絡模型結構

卷積神經網絡與其他神經網絡模型的最大區(qū)別在于卷積神經網絡將卷積層連接到神經網絡的輸入層之前,該卷積層成為卷積神經網絡的數(shù)據(jù)輸入,而作為經典模型的LeNet-5網絡,是由嚴樂村開發(fā)的用于手寫字符識別的經典卷積神經網絡模型。

LeNet-5的體系結構有7層,其中有3個卷積層。第一卷積層由6個特征圖組成,故C1包含156可訓練參數(shù)((6個5X5內核加上6偏值)來創(chuàng)建122304(156*(28*28)-122,304)個連接。在C1層上,F(xiàn)M的大小為28×28。C3層共有1516個可訓練參數(shù)以及151600個連接。Lecun設計了這些連接最大化C3的功能數(shù)量,同時減少了權重數(shù)量,在最后的卷積層C5包含120個FM,輸出尺寸為1X1。

2 ?模型設計

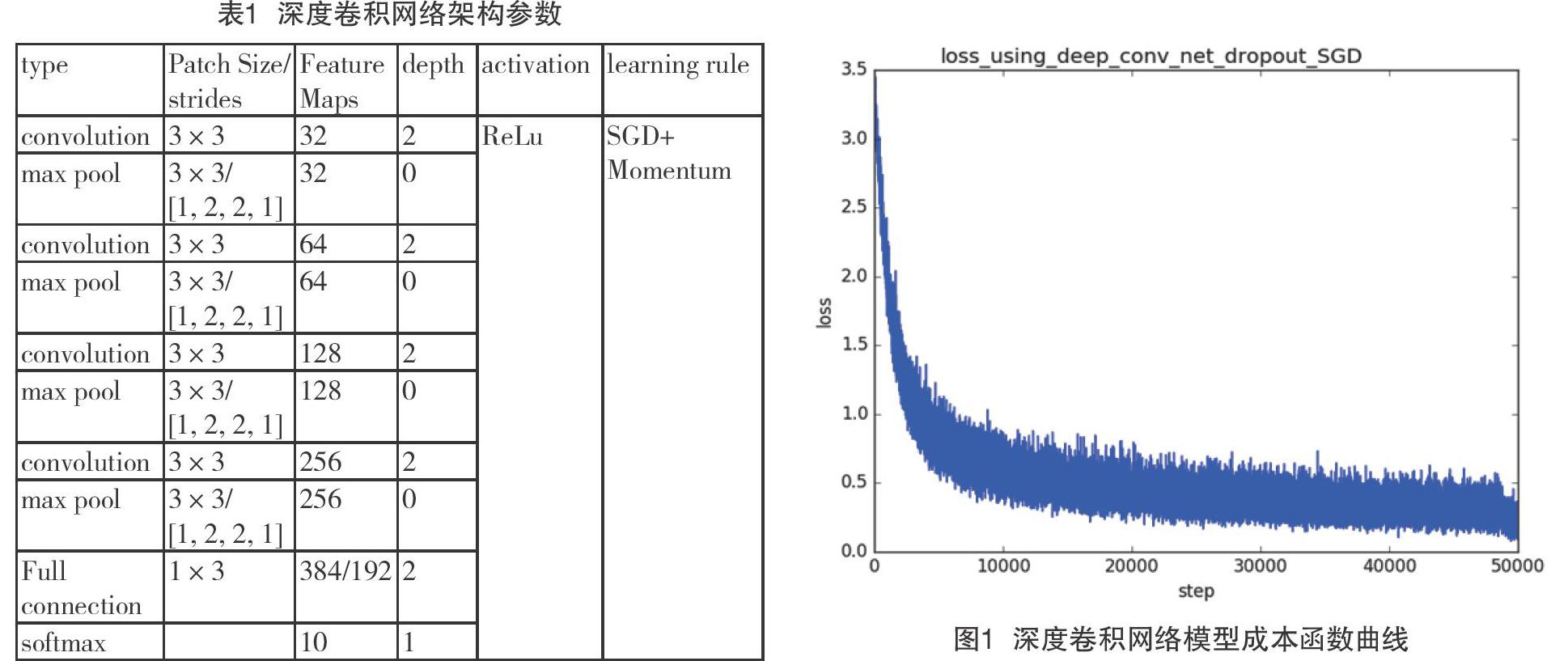

CIFAR-10數(shù)據(jù)集含有6萬張的自然圖像,共分為10種類型,由Alex Krizhevsky,Vinod Nair和Geoffrey Hinton收集而來。包含50,000張訓練圖片,10,000張測試圖片,數(shù)據(jù)集中的數(shù)據(jù)存在于一個數(shù)組中(按行存儲,每行代表一個圖像),前1024位是R值,中間1024位是G值,最后1024位是B值。在本文中,實驗數(shù)據(jù)集被簡單地剪切和白化,并且像素值被發(fā)送到神經網絡用于訓練,本文結合CIFAR-10數(shù)據(jù)集,設計了一個深度卷積網絡模型,模型的架構參數(shù)如表1所示。

3 ?實驗分析

將最大迭代次數(shù)設置為50,000次,使用SGD+ Momentum學習算法初始化學習速率,Epoch學習速率每125次衰減為前一次的0.1倍,其他參數(shù)保持基本參數(shù)不變,相應的成本函數(shù)曲線如圖1所示。

在模型訓練50000次迭代后,使得成本函數(shù)穩(wěn)定大約在0.18左右,最低為0.10,最后的分類精度可達88.1%。可以看出,本文的圖像識別分類精度優(yōu)于目前大部分研究中得到的分類精度。

4 ?結語

眾所周知,目前將卷積神經網絡應用于圖像分類實驗已經取得了良好的效果,但是網絡結構和參數(shù)的選擇一直是分類效果提升的瓶頸,為了更好地將卷積神經網絡應用于圖像分類中,本文針對CIFAR-10圖像數(shù)據(jù)集,設計了一個具有8層卷積層的深度卷積網絡,并結合批量歸一化,在CIFAR-10數(shù)據(jù)集上得到了88.1%的分類精度,比CIFAR-10官網上公布的大部分研究的分類精度要高,有效地改善了卷積神經網絡的圖像識別分類效果,因此可以將本文的實驗成果應用于醫(yī)學圖像的鑒定、交通圖像的識別等領域,對國民生活和經濟發(fā)展提供技術支持。

參考文獻

[1] Alex Krizhevsky, Ilya Sutskever, Geoff Hinton. Imagenet classification with deep con-volutional neural networks[J]. Advances in Neural Information Processing Systems,2012(25):1106-1114.

[2] Ioffe S, Szegedy C. Batch Normalization: Accelerating Deep Network Training by Reducing Internal Covariate Shift[J]. Computer Science, 2015(33): 45-49.

[3] Simon M, Rodner E, Denzler J. ImageNet pre-trained models with batch normalization[J].2016(12): 115-120.