基于商品評論主題模型的隱含狄利克雷分布研究

周 梁,方興龍

(1.安徽工程大學 計算機與信息學院,安徽 蕪湖 241000;2.安徽工程大學 生物與化學工程學院,安徽 蕪湖 241000)

網絡發展到了2.0階段以后,用戶的日常購物行為由實體店拓展到了線上網店。中國電子商務研究中心發布的《2018年(上)中國網絡零售市場數據監測報告》顯示:2018年上半年國內網絡零售市場交易規模達40 810億元,同比增長 30.1%[1]。隨著電子商務發展,大量與用戶所購商品相關的內容(比如商品質量、服務水平、物流狀況等)即大量商品評論信息隨之產生。如何將眾多的非結構化的評論提煉加工,生成用戶和商家共同關心的有價值信息,成為商品評論文本情感分析的工作重點。

1 概述

商品情感分析是對商品評論信息進行分析和處理,處理過程分為以下幾步:①中文分詞。目前常用的中文分詞工具有:哈爾濱工程大學的LTP語言技術平臺;中科院漢語語法分析系統ICTCLAS[2];清華開發的具有中文分詞和詞性標注的中文詞法分析工具包THULAC;可用于python中文分詞組件結巴分詞[3]。②去除常用詞、低頻詞及使用頻率高但無意義的詞。比如:“在這價位的車油耗水平還是滿意”轉變成“價位 油耗 滿意”。③文檔特征詞選取。常用方法如詞袋模型[4]及TF-IDF[5]。④情感信息抽取并建立文檔空間向量模型,也就是文本分類算法,因為無監督學習方法從而避免了人工標注的耗時、成本昂貴的問題,所以目前廣泛使用。主要包括情感分析(Vector Space Model,VSM)[6]算法、(Latent Semantic Analysis,LSA)[7]算法、概率潛在語義分析模(Probabilistic Latent Semantic Analysis,PLSA)[8]算法等,VSM算法將文本轉換成高維向量,從而計算任意兩個向量的近似程度,但該種方法沒有考慮到詞與詞之間的語義聯系;LSA算法[7]可以通過詞-文檔矩陣進行奇異值分解,將文檔投影到潛在語義空間中,但該算法具有奇異空間計算量過大的問題,通過點積和余弦相似度計算文檔與原文檔相似性的方法不適用于不同領域文章相似度的計算。比如“灌水”和“網貼”兩詞,可能出現在兩篇IT方面的文本中,但詞項不匹配,故兩詞相似度很低,但“灌水”一個出現在IT文章,一個出現在工程類文章,則被看做相似。PLSA算法在LSA基礎上結合了數學概率模型,該算法包括文檔d的概率,潛在語義Z的概率和生成術語概率三個方面,該算法雖然將文檔、語義和詞項映射到同一個語義空間,合理解釋了“一詞多義”現象,但不足在于隨著文檔線性增長,其輸出結果分布矩陣和主題分布矩陣是唯一的,故該算法迭代的潛在語義概率無法重新生成一片新文檔,處理文檔方式不靈活。Blei[9]等提出了潛在狄里克雷分配模型(Latent Dirichlet allocation LDA),該模型設定每篇文檔由隱含的多個主題組合構成,主題的結合分布由Dirichlet分布隨機產生,每個隱含主題描述為詞匯集的分布,即構成文檔、潛在語義、術語三層貝葉斯模型。這樣多個詞語可以映射到同一主題,一個詞語也可以屬于不同主題,解決了多詞一義和一詞多義的問題。LDA模型屬于全概率生成模型,適合處理大規模語料庫。近幾年,針對LDA模型又有多人提出改進其算法[10-11]。如孫艷[12]提出的USTU模型,在原有的LDA基礎上添加情感模型,即假設所有詞由一種情感產生,建立“文檔-情感-句子”關系,同時對詞進行主題標簽采樣,建立“文檔-主題-詞”關系,但是句子中出現兩種情感傾向時無法做出進一步判斷。歐陽繼紅[13]在原有Joint Sentiment-topic Model(Reverse-JST)模型基礎上提出改進的MG-R-Jst模型,同時闡述了Reverse-JST可以通過不同主題粒度下主題與情感的分布關系,但僅考慮單詞局部情感/主題分布,因而缺少穩定性,而MG-R-Jst模型則考慮兩個粒度上的情感/主題分布—文檔級和局部,以期提升分類效果和穩定性,但其隱含的變量眾多,需頻繁利用Gibbs采樣對其參數進行估計;武慶圓[14]等提出用戶特征與文本主題的情感之間存在一定聯系,并構建包含用戶特征主題的UMSTM模型,但未能就用戶特征包含的內容及其如何提高后期預測效果做進一步闡釋。

2 問題描述

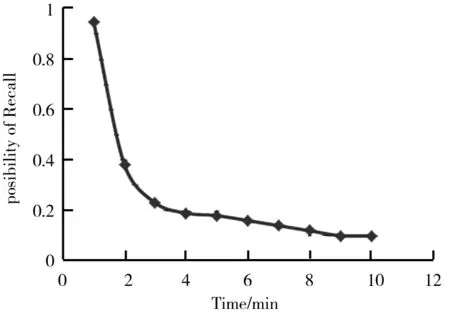

在購物過程中,消費者根據他們對于商品及服務的主觀判斷做出購買決策,而購物后的“知覺評論”反過來又會影響其他消費者的消費決策。所以,對于消費者的“知覺評論”的分析和挖掘會遠遠大于商品本身的特性。另一方面,對于商家來說,不會僅僅關心商品的總評價度,而是想更大程度了解產品的細節評論,所以單純從產品“好評率”或“差評率”來評價商品質量會造成分析粒度過粗的問題。因此“情感分布”要包含用戶評論文本和曾經購買或瀏覽信息,以及曾經與商家的互評信息。另外,用戶對商品的評論還與用戶的興趣有關,而興趣隨時間變化而變化,如新產品上市,由于其新穎款式、新元素及新技術的引入,用戶關注度會提高,而隨著產品問世時間推移,用戶興趣度會降低,甚至遺忘,所以需要構建用戶興趣與“時間”序列的數據模型。

3 “顯式評論”與“隱式評論”

商家推薦系統是基于用戶的歷史行為,分析、挖掘用戶的行為偏好,從而提供個性化商家推薦。評分是用戶綜合考察多方面因素給出的整體評價。其中,商家獲得用戶興趣最直接的方式中——“顯式評分”就是用戶曾經購買商品的評分,評分總量反映了商品或服務的熱度。比如電影在線評論數量和最終票房呈正比關系,所以評論“極性”會存在一定局限性;有些低評分不是用戶對此類商品不感興趣,而是商品服務質量問題,也就是歷史評分存在的“觀點”和“情緒感知”分析粒度過粗的問題。特別是電商評論的差評中,要進一步分析差評原因及用戶的觀點究竟是什么。同時,為了更好解決協同過濾推薦算法中普遍存在的數據稀疏性問題,研究引入“隱式評論”,即將用戶喜好加入評論范疇。因為在實際生活中,有些商品的分類是基于人們對某一類商品的現實需求的,比如,用戶如果喜歡載重不大的小型汽車,就會在緊湊型車型中尋找自己喜好的商品。通過統計分析MovieLens用戶評分數據[15]發現,每位用戶對不同類型電影的評分數差異很大,但用戶喜好的電影類型較集中,尤其是單個用戶更為明顯,通過對某類電影所有的評分求和,再求平均值,可以直觀地看出某位用戶對各種類型的喜好程度。

4 時間序列評論機理

圖1 遺忘曲線圖

5 模型建立

5.1 用戶情感分布模型

考慮到用戶對產品的興趣度對產品的影響,將用戶評分內容劃分為兩部分:顯評分(基于用戶歷史評分行為)和隱評分(基于用戶偏好信息)

(1)

參照Koren[17-18]提出的矩陣分解方法,有:

(2)

其中,Ui是用戶特征向量;Vj是物品特征向量。用戶特征向量和物品特征向量分別服從均值為0的高斯分布Ui

(3)

(4)

5.2 用戶評論-主題矩陣模型

隱評分模型引入主題時間tur在用戶-主題的分布概率,設產品發布時間為tur,評論文本集Wu={Wu1,Wu2,…,Wuq}中第m個文本Wum的時間標記為tum,則用戶記憶值

mv(Wum,tum)=e-λ(tur-tum),

(5)

式中,λ是時間參數,默認大于0,時間參數越大,記憶值下降越快。那么用戶的評論-主題矩陣可用相應記憶值標記。

可得主題時間tuk在用戶-主題分布概率R(tuk)

(6)

由式(1)、式(2)、式(6),可推導出式(7)

(7)

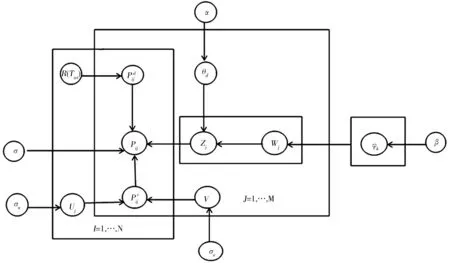

6 UIB-LDA模型的建立

在原有LDA基礎之上引入了用戶顯評價和隱評價,從而構建了User Interesting Based-LDA(UIB-LDA)模型如圖2所示。UIB-LDA模型的各符號說明如表1所示。

圖2 UIB-LDA模型

7 測試對比研究

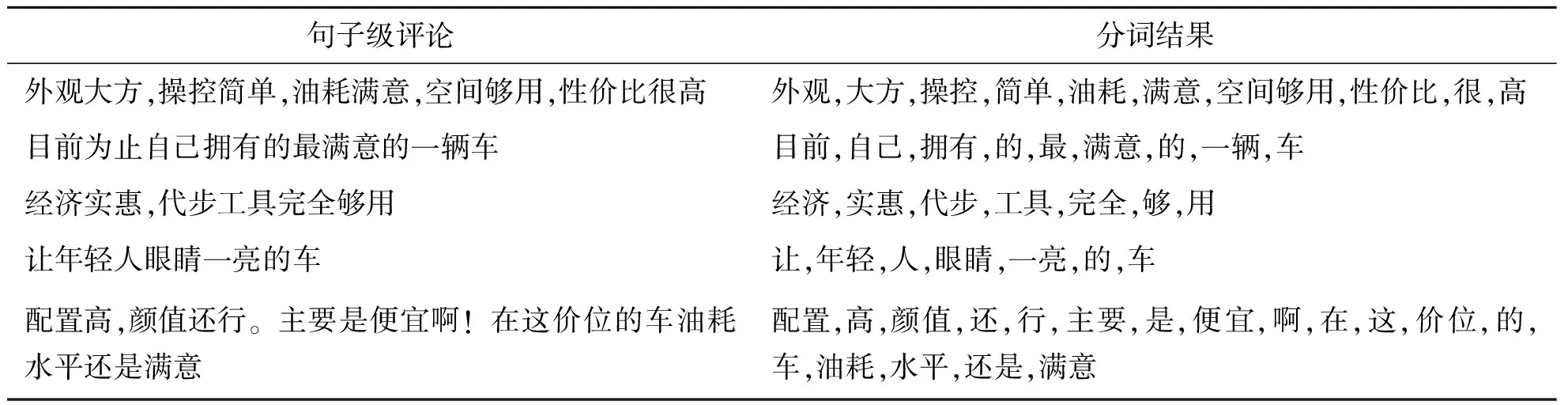

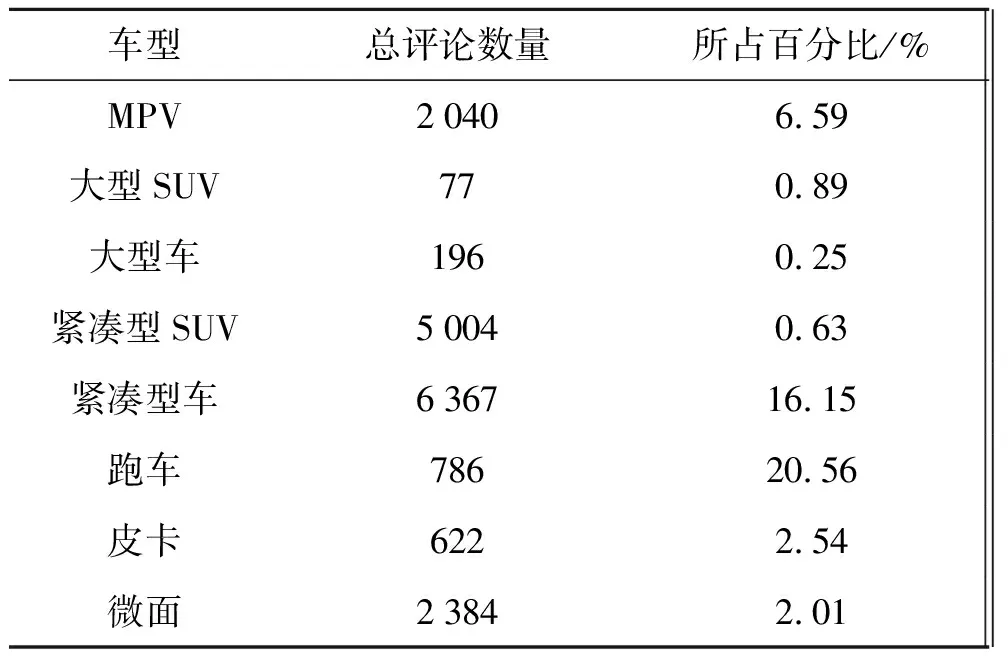

檢驗使用的數據集采集自“汽車之家”購買及用戶評價數據,利用基于python語言的Scrapy框架編寫爬蟲,應用python的Celery庫實現分布式消息隊列。本次以關鍵字“汽車之家”采集購買及評價報告的數據,時間跨度為2014~2017年,共計4年。接著進行數據清洗并采用python的jieba分詞庫對商品評論數據進行中文分詞,分詞結果如表2所示(其中已過濾標點及特殊字符),檢驗中使用中文停用詞去除停用詞。同時,從評論數據數量發現,當汽車價格超過80萬時,在線評論數量明顯減少,這正符合經濟學的價格和需求呈負向關系的論證;另外對于汽車價格低于6萬的商品評論數量也相對較少,分析原因中考慮消費者在選擇汽車這種商品時的態度較為慎重,觀念中普遍存在價格代表價值的意識。因此本次選擇評論數據,會剔除價格大于80萬及價格低于6萬的汽車商品評論數據。經過篩選,共過得30 975條在線評論數據,其在線評論數量與百分比如表3所示。

(8)

式中,Wi為測試中的單詞;Ni是單詞總數量。

表2 汽車評論分詞結果

表3汽車類型數量及百分比

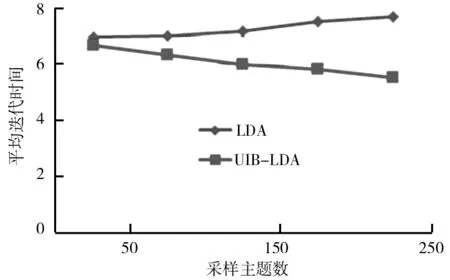

LDA和UIB-LDA模型迭代次數與主題數對比如圖3所示。由圖3可以看出,在迭代次數相同情況下,采樣時的平均迭代時間隨著主題數目的增長而增長。與LDA相比,UIB-LDA模型的迭代次數隨主題數增加增長速度明顯低于LDA模型。這是因為LDA模型采樣時,需要對所有主題進行采樣,UIB-LDA模型只需要對文檔對應標記的主題和背景(全局)主題進行采樣。

圖3 LDA和UIB-LDA模型迭代次數與主題數對比

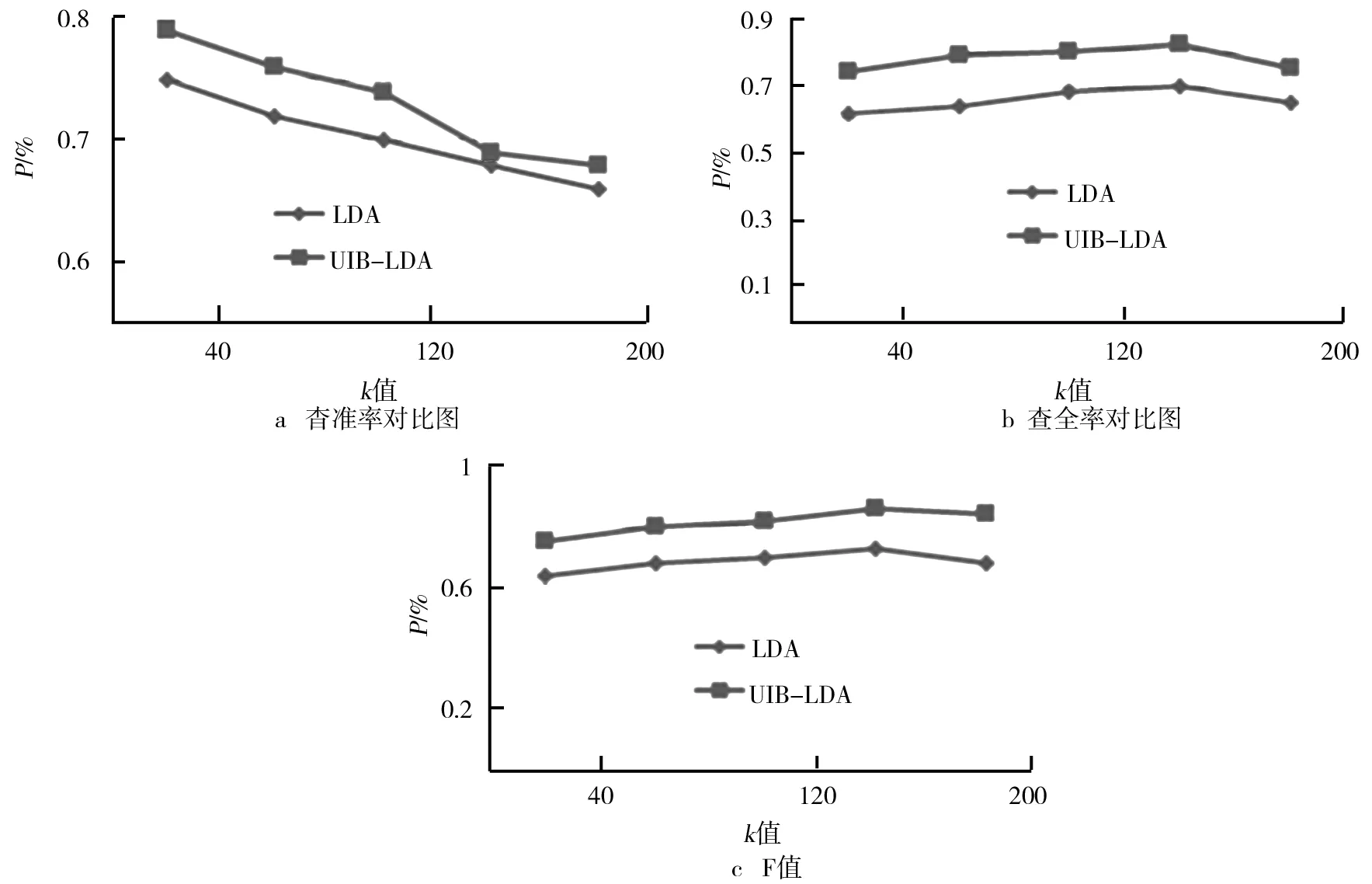

另外,本次實驗還用了用的評價準則的查準率(Precision)和查全率(Recall)。查準率是挖掘出的正確評論信息占總有效評論信息的比例;查全率指挖掘出的正確評論信息占總評論信息的比例。查全率與查準率是反向相關的,正確評論的個數減少會導致查準率增高及查全率降低。因此,實驗選取準確率和召回率的綜合評價指標F值進行驗證。相應計算公式如式(9)、式(10)、式(11)所示:

Precision:

(9)

Recall:

(10)

綜合評價指標:

(11)

驗證結果如圖4所示。研究選取了UIB-LDA模型與LDA模型進行對比,測試樣本數目k以樣本數目40~200測試其查全率、查準率,并用F值。從圖4可以看出,由于UIB-LDA模型不是針對所有的主題進行采樣,所以與普通LDA模型相比,其查準率和查全率均優于后者。但測試過程中也發現,隨著采樣數量的增長并超過一定數量時(比如超過160),查全率及F值會呈現下降的趨勢,由此可以得出采樣數量控制在40~160之間較理想。

圖4 情感分類效果對比圖

8 總結

研究主要是以汽車購買評論作為數據研究背景,在原有LDA模型基礎之上,針對用戶的“知覺評論”對用戶購買行為的影響,將用戶評論商品的信息及其與商家互評的信息納入情感分布,同時關注到用戶興趣度隨時間推移呈現下降趨勢的規律,構建了UIB-LDA模型。通過實驗驗證,發現當采用數量取值控制在一定范圍內時,該模型平均迭代時間較低,查全率、查準率以及綜合評價指標均優于LDA。將UIB-LDA模型應用于短文本話題且意見領袖的微博文本是今后研究方向。