基于級聯(lián)深度神經網絡的抑郁癥識別

江 筱 邵珠宏,3* 尚媛園,2 丁 輝,2

1(首都師范大學信息工程學院 北京 100048)2(北京成像技術高精尖創(chuàng)新中心 北京 100048)3(電子系統(tǒng)可靠性技術北京市重點實驗室 北京 100048)

0 引 言

抑郁癥是世界范圍內最常見的精神疾病之一,其主要特點是情緒低落持續(xù)時間長,嚴重影響個人的日常生活和工作。據(jù)報道,重度抑郁癥(MDD)是導致殘疾的主要原因[1]。根據(jù)世界衛(wèi)生組織(WHO)的一項調查,抑郁癥是全球第四大致殘原因,并將在2020年成為頭號致殘原因[2]。

目前,對抑郁癥的篩查和診斷主要是根據(jù)患者在臨床訪談中的自我報告。在臨床訪談中,由一名經過專門培訓且經驗豐富的精神衛(wèi)生專業(yè)人員利用《精神障礙診斷與統(tǒng)計手冊》(DSM-IV)中規(guī)定的標準[3],來評估患者是否患有抑郁癥以及嚴重程度。除此之外,臨床實踐中的貝克抑郁量表(Beck Depression Inventory,BDI)[4]等自我報告量表也可作為診斷依據(jù)。貝克抑郁癥量表中包含21個問題,每一個答案的分值為0~3,總分數(shù)范圍為0~63。根據(jù)BDI-II[4],總分小于13分為“無”抑郁,14~19分為“輕度”抑郁,20~28分為“中度”抑郁,總分大于29分為“重度”抑郁。

研究表明,在人類的非語言行為中,人臉面部區(qū)域表情包含了大部分信息[5],利用人臉面部信息進行臨床心理健康分析的研究引起了廣泛關注[7]。隨著情感感知和深度學習等技術的進步[6],用計算機輔助抑郁癥自動識別將有利于客觀的診斷。

音頻/視覺情感挑戰(zhàn)(AVEC2013)[8]和AVEC2014[9]的抑郁癥識別競賽關注的是對抑郁癥自動預測方法的研究,預測患者貝克抑郁癥量表II(BDI-II)分值。

在AVEC2013抑郁癥識別中,首先對人臉圖像做檢測與對齊的預處理,然后提取局部相位量化(LPQ)特征,最后采用支持向量回歸(SVR)來預測抑郁得分。Cummins等[10]在他們的抑郁癥識別系統(tǒng)中,對時間興趣點(SITPs)和梯度直方圖金字塔(PHOG)做了對比,實驗表明,梯度直方圖金字塔方法取得了較好的效果。Meng等[11]利用基于動態(tài)特征圖(MMH)來描述視頻的運動信息,然后提取邊緣方向直方圖(EOH)和局部二值模式(LBP)特征,最后利用最小二乘法(PLS)進行回歸分析。Wen等[12]首先研究了從面部區(qū)域子空間中提取的三個正交平面的動態(tài)描述子TOP-LPQ特征,利用sparse編碼計算行為模式字典,最后應用判別映射和決策融合來提高診斷精度。

在AVEC2014抑郁癥識別中,首先提取局部動態(tài)外觀描述符(LGBP-TOP),然后采用支持向量回歸預測得分。Kaya等[13]通過典型相關分析(CCA)和Moore-Penrose廣義逆(MPGI)引入了一個區(qū)域線性回歸集合。為了提高抑郁預測性能,Zhu等[14]提出了一種雙流框架,分別命名為外觀DCNN和動態(tài)DCNN。Kang等[15]引入了一種基于視頻數(shù)據(jù)的深度轉換學習(DTL)方法用于抑郁癥的識別,該方法可以捕獲抑郁癥數(shù)據(jù)的非線性映射。Pampouchidou 等[16]通過使用來自Gabor抑制濾波數(shù)據(jù)的運動歷史圖像(MHI)的變體來代替原始圖像,研究了抑郁癥的分類評估。但以上方法只關注人臉全局信息,沒有考慮到局部特征對抑郁癥識別精度的影響。本文結合了全局特征和局部特征以及深度神經網絡實現(xiàn)了對抑郁癥自動識別,實現(xiàn)了全局信息和局部信息的融合互補。實驗結果表明,該方法具有較好的綜合性能,大大提高了人臉圖像預測抑郁癥BDI-II分值的精確度。同時,本文采用了級聯(lián)深度神經網絡提取圖像特征,加強了面部重點區(qū)域對抑郁癥識別的影響,表達能力與針對性更強,對抑郁癥的識別效果比一般的CNN神經網絡算法[14-15]效果好。

1 抑郁癥識別算法

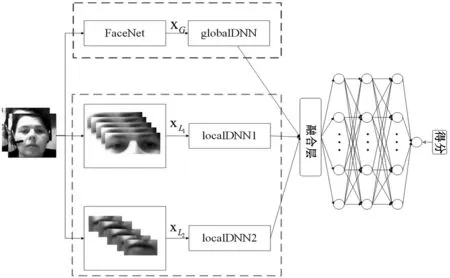

為了充分利用圖像的全局信息和人臉區(qū)域的局部信息,使兩種信息達到互補的效果,本文提取全局特征、眼部局部特征和嘴部局部特征后分別輸入gloablDNN、localDNN1和localDNN2,經過深度變換后在融合層拼接,最后輸入到DNN網絡預測抑郁癥評分。算法流程圖如圖1所示。

圖1 抑郁癥識別算法流程圖

1.1 全局部分

在全局部分中,全局特征由FaceNet[17]提取。FaceNet是一個已經在包含453 453幅人臉圖像的數(shù)據(jù)庫上預訓練好的提取人臉特征的網絡。把從FaceNet中提取出的全局特征輸入globalDNN以獲得一個更緊致的特征表達。

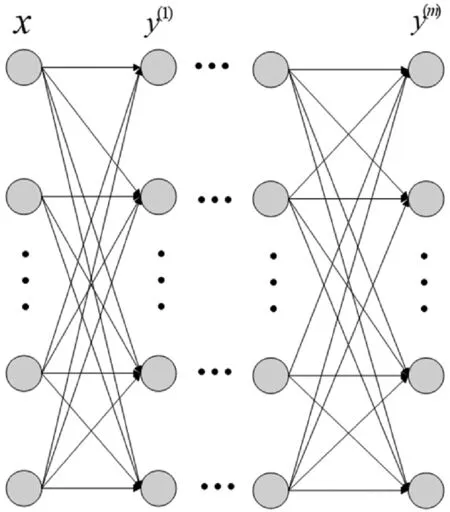

DNN結構如圖2所示。

圖2 DNN的結構

假設DNN共有N層,第一層的輸出表示為:

y(1)=f(W(1)x+b(1))

(1)

式中:W(1)是權重矩陣,b(1)是偏移矩陣,f是非線性激活函數(shù),輸入y(1)同時是第二層的輸入。在DNN模型中的第m層的輸出表示為:

y(m)=f(W(m)y(m-1)+b(m))

(2)

1.2 局部部分

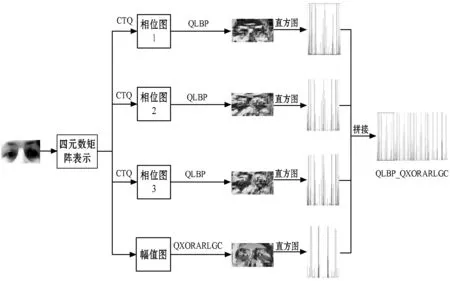

在局部特征部分,本文結合了局部二值編碼和異或非對稱區(qū)域局部梯度編碼,對人臉圖像中的眼睛和嘴巴區(qū)域提取手工特征,分別將特征輸入局部網絡進行處理。基于彩色圖像的四元數(shù)處理和分析方法得到了廣泛的研究,其目標是將彩色圖像的各個通道作為整體進行編碼,如四元數(shù)貝塞爾傅里葉矩[18]、四元數(shù)局部排序二值模式[19]、核四元數(shù)主成分分析[20]、四元數(shù)中值濾波轉換矢量[21]。

fe(x,y)代表圖像塊的眼睛區(qū)域,可以表示為四元數(shù)矩陣:

fq(x,y)=ife,R(x,y)+jfe,G(x,y)+kfe,B(x,y)

(3)

式中:fe,R(x,y) 、fe,G(x,y) 、fe,B(x,y) 分別是彩色圖像fe(x,y)的紅、綠、藍三個通道。 為了獲得相位 L1,首先將式(3)進行Clifford變換,即用fq(x,y)乘以純單位四元數(shù)p, 即可得到完全四元數(shù)矩陣:

(4)

(5)

式中:{α1α2α3}表示權重向量。LBP算子在一個3×3的圖像塊中計算,圖像塊Sm的中心點的值計算為:

(6)

(7)

根據(jù)運算法則,經過clifford變換不改變幅值,因此,可以用任意一個clifford變換的結果來計算幅值。異或非對稱區(qū)域局部梯度編碼考慮到中心像素值與鄰近像素之間的強度關系對局部區(qū)域的紋理特征進行編碼。

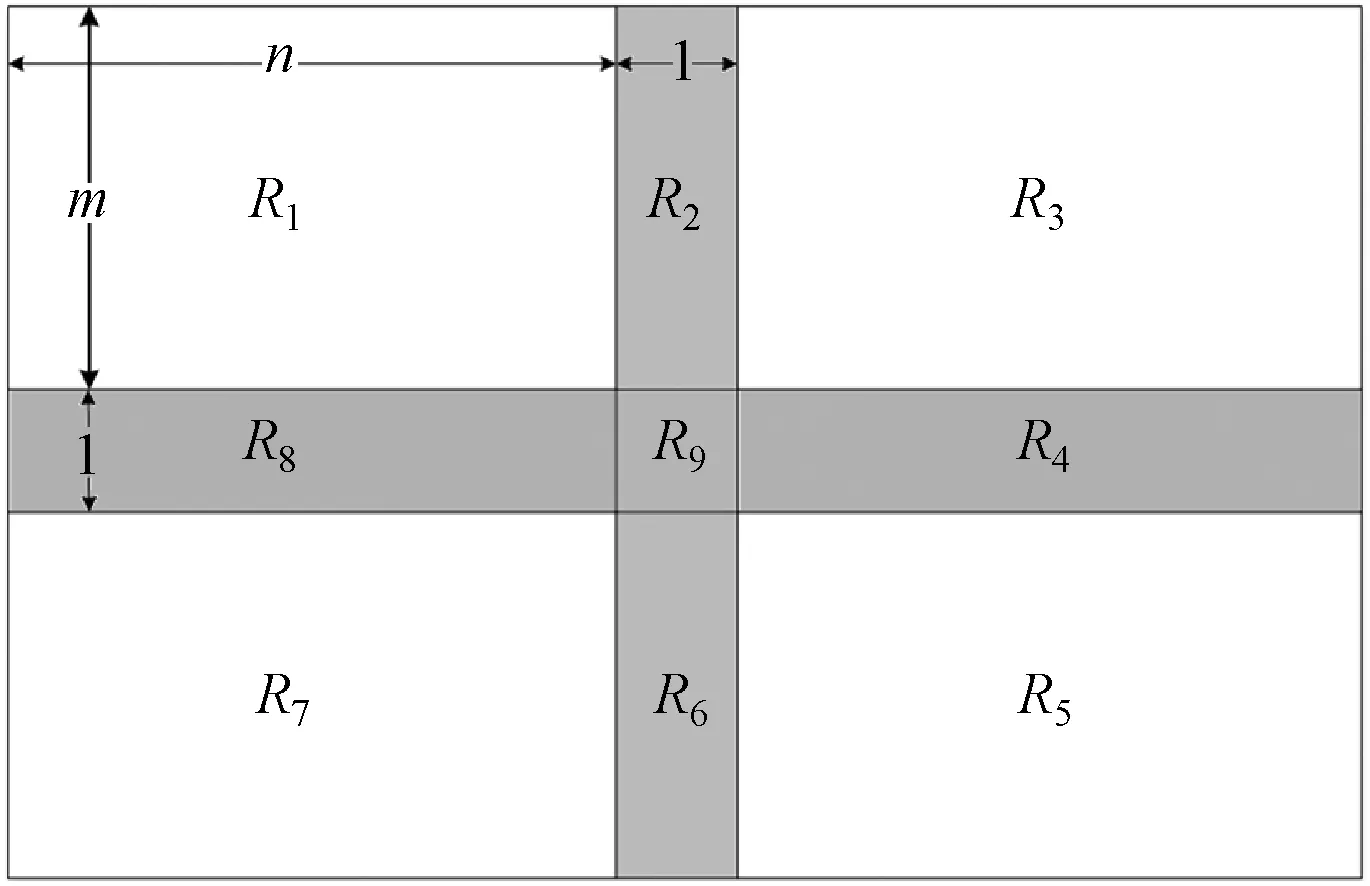

選擇圖像塊大小為(2m+1)×(2n+1),把圖像塊分成如圖3所示的9個子塊,Rt表示子塊的中心像素值,編碼方式為:

P0:h(R1-R3),P1:h(R8-R4)

P2:h(R7-R5),P3:h(R1-R7)

P4:h(R2-R6),P5:h(R3-R5)

P6:h(R1-R5),P7:h(R3-R7)

(8)

圖3 AR-LGC的子塊

當作用于中心像素點的鄰域窗口大小不一樣時,可以得到兩個不同的二值序列PA和PB,則異或非對稱區(qū)域局部梯度編碼為:

(9)

圖4顯示了從眼睛區(qū)域提取特征的流程,對嘴巴區(qū)域提取特征的操作類似,這種編碼方法基于中心像素和周圍鄰域之間的灰度關系,結合了來自水平、垂直和對角方向的不同尺度的信息。

圖4 眼睛區(qū)域局部特征提取流程圖

1.3 網絡級聯(lián)

將全局特征、眼部局部特征和嘴部局部特征分別輸入globalDNN、localDNN1和localDNN2,在融合層將輸出拼接在一起。混合特征向量ymix表示為:

(10)

(11)

2 實 驗

為了驗證所提出方法的有效性,本文在AVEC 2013和AVEC2014抑郁癥競賽數(shù)據(jù)集上進行實驗。

2.1 抑郁癥數(shù)據(jù)集

AVEC2013和AVEC2014抑郁癥數(shù)據(jù)集都是語音-視覺抑郁語言庫(AVid-Corpus)的子集,用于探究抑郁癥的嚴重程度。AVEC2013包含在自然條件下采集的82個人的150個視頻。這些視頻記錄了被試者完成給定任務的人機交互過程。視頻的長度在20~50分鐘不等,平均是25分鐘。受試者的年齡從18~63歲不等。這些視頻隨機分為測試集、和訓練集,比例為1∶1[14],且每個集合中抑郁分值樣本分布均衡。訓練集用來訓練深度模型,測試集用來測試模型識別抑郁癥的效果。抑郁癥的嚴重程度可根據(jù)貝克量表進行評估。AVEC2013數(shù)據(jù)庫中的一些被試者如圖5(a)所示,他們在錄制時可以自由移動,包括說話、移動頭部和變換表情等。AVEC2014包含來自AViD-Corpus12個任務中的其中兩個,分別被稱之為Freedom和Northwind。

(a) AVEC2013

本文采用了第一個任務中的視頻。同樣地,訓練集用來訓練深度模型,測試集用來測試模型識別抑郁癥的效果。AVEC2014數(shù)據(jù)庫中的一些被試者樣本如圖5(b)所示。

2.2 實驗設置

為了減少視頻中視頻幀冗余量,本文依據(jù)經驗值每十幀取一幀,在每個數(shù)據(jù)集上個提取了15 000幀圖像。并用Dlib進行關鍵點檢測和人臉五官定位,將檢測后的圖像裁剪為256×256大小,用于實驗。對于全局DNN的輸入,本文選取的是Facenet的映射層輸出特征向量xG,其維度是128維。globalDNN有四個全連接層,每層設置為128、56、16、1個輸出。對于局部特征的提取,參考四元數(shù)為q1= 0.992i+0.085 7j+0.090 7k、q2=0.091 2i+0.990 8j+0.099 9k、q3=0.085 2i+0.085 5j+0.992 7k。權重分別為{0.4,0.5,0.6}。在異或非對稱區(qū)域局部梯度編碼的提取過程中,其中一個鄰域大小被固定為3×3,另外一個鄰域從{5×5, 7×7, 9×9, 11×11}中取值。從眼睛區(qū)域提取特征為xL1,維度為2 048維,從嘴巴區(qū)域提取出的特征為xL2,1 024維。將localDNN1設置為5層,并且每一層的輸出分別為2 048、1 024、512、128、1。localDNN2設置為四層,每一層的神經元個數(shù)為1 024、512、128、1。在訓練過程中,使用的優(yōu)化器是Adam,學習率決定了找到網絡最優(yōu)參數(shù)的速度快慢,如果學習率太大,很可能會跳過網絡的最優(yōu)參數(shù),反之如果學習率過小,可能導致算法長時間無法收斂。實驗比較了不同的學習率對損失函數(shù)和對抑郁癥預測的影響,結果表明,當初始學習率學習率被設置為10e-2,時,RMSE和MAE的值最小,檢測性能最好。迭代次數(shù)為30 000,Batch size從{30,40,50}中取值。對于每一個測試視頻,對視頻中提取的每個幀的預測值取平均來計算預測的抑郁癥評分。選擇兩個客觀標準,均值絕對誤差(MAE)和根均方誤差(RMSE)來測量總體性能,計算如下:

(12)

(13)

2.3 結果與分析

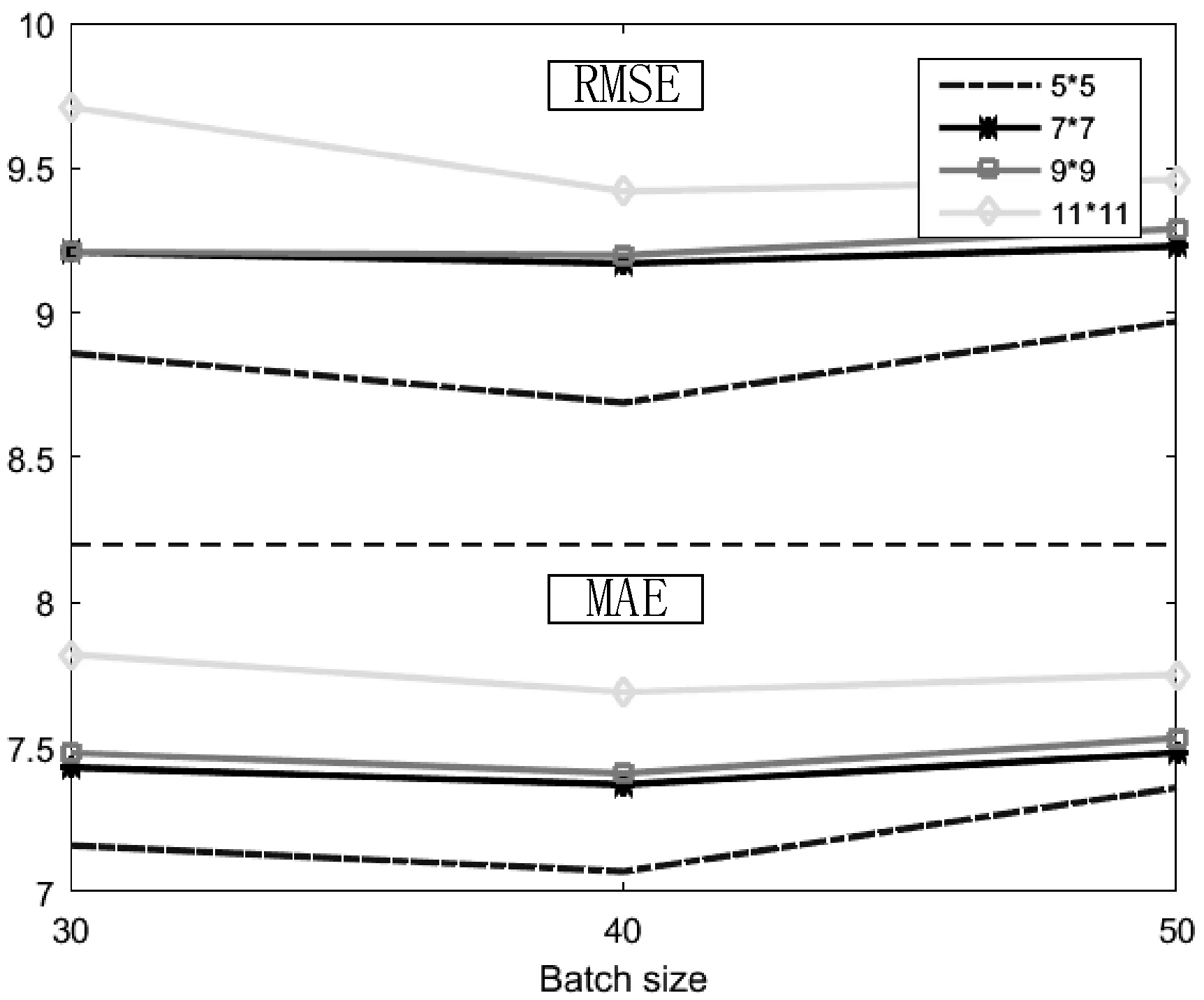

首先進行實驗以選擇最佳的鄰域和訓練批次大小,圖6和圖7是MAE和RMSE隨著鄰域和訓練批次大小的變化而變化的曲線圖。可觀察到兩個指標在垂直方向上變化顯著,這表明鄰域大小對抑郁評分的影響更大。對于兩個數(shù)據(jù)庫,異或非對稱區(qū)域局部梯度編碼的最佳鄰域大小設置為5×5。

圖7 不同鄰域大小和Batch size在AVEC2014的抑郁癥識別結

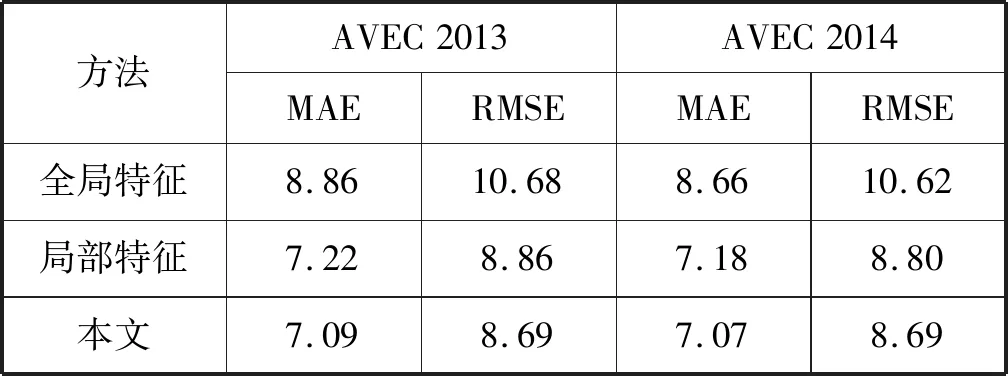

接下來的實驗評估使用全局和局部特征進行抑郁癥識別的性能,表1列出了在兩個數(shù)據(jù)庫上的MAE和RMSE值。

表1 使用全局和局部特征的抑郁癥識別結果

由表1可以看出,使用全局特征或局部特征的MAE和RMSE值大于使用多特征的MAE和RMSE值。這主要是因為局部區(qū)域尤其是眼部傳達了更為突出的信息,這也與臨床醫(yī)生的經驗是一致的。

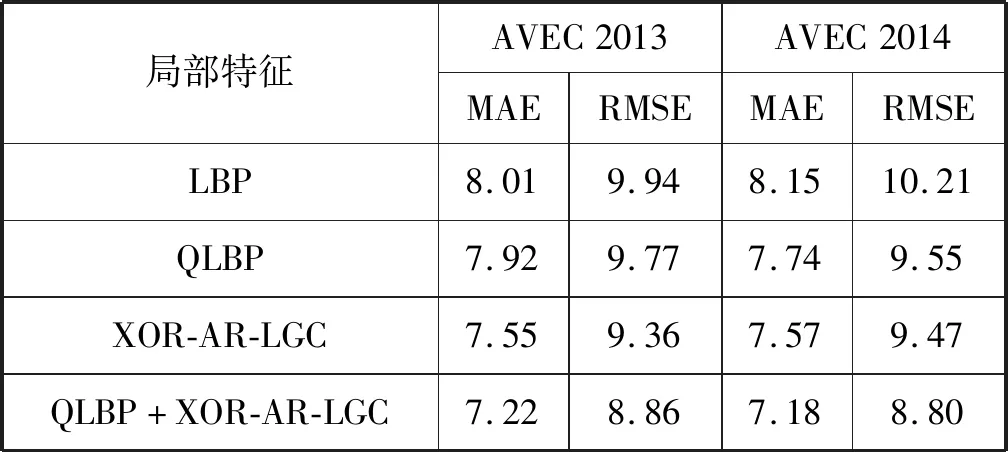

為了證明所提出方法中使用的局部特征的優(yōu)勢,表2給出了使用不同局部特征的抑郁癥識別結果。

表2 使用不同的局部特征的抑郁癥識別結果

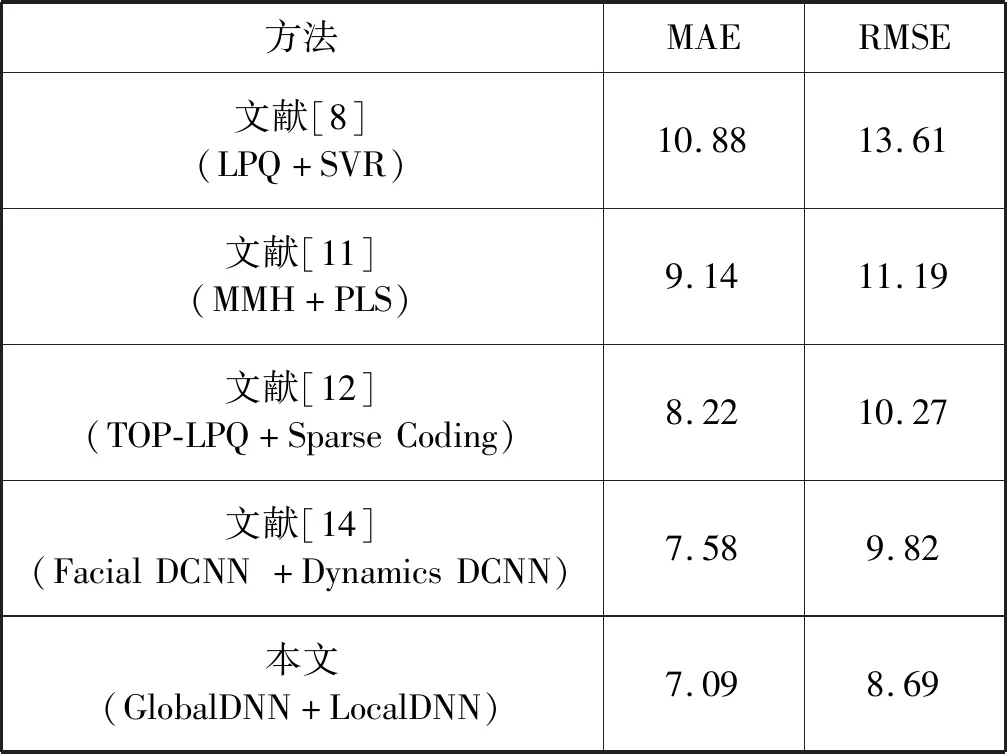

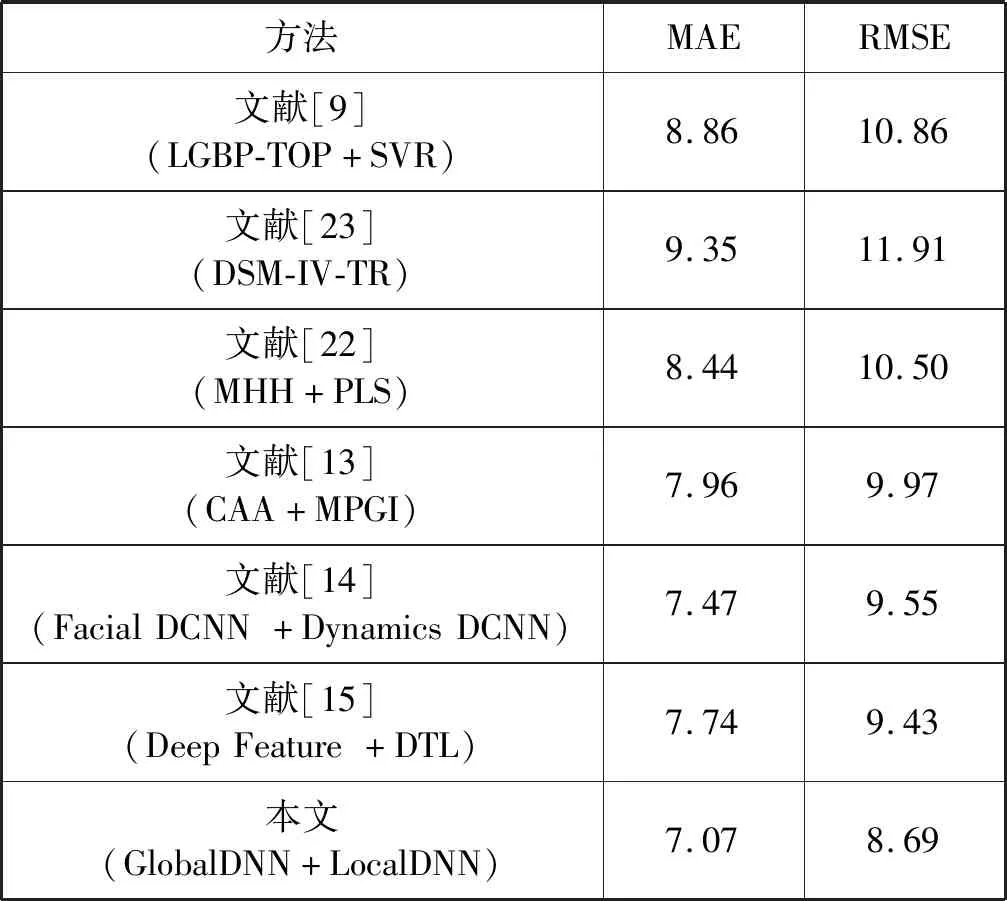

由表2可以看出,四元數(shù)局部二值編碼優(yōu)于傳統(tǒng)的局部二值編碼,這是由于充分利用了顏色信息。將四元數(shù)局部二值編碼與異或非對稱區(qū)域局部梯度編碼結合作為混合特征,即同時考慮相位和幅度信息,可以獲得更好的性能。除此之外,本文結合了全局特征和局部特征以及深度神經網絡實現(xiàn)了對抑郁癥自動識別,進而實現(xiàn)了全局信息和局部信息的融合互補。與其他現(xiàn)有方法的性能做對比,具體結果如表3和表4所示。可以看出,本文所提出的級聯(lián)DNN方法在抑郁癥識別任務中具有最小的MAE和RMSE值。

表3 與在AVEC2013的其他識別方法的比較

表4 與在AVEC2014的其他識別方法的比較

3 結 語

為了促進在臨床診斷中抑郁癥的自動識別和監(jiān)測,本文研究了一種基于級聯(lián)深層神經網絡和多特征的抑郁癥識別方法。多特征包括全局特征和局部特征,全局特征使用FaceNet提取之后送入DNN網絡,QLBP-XOR-AR-LGC特征從眼睛和嘴巴區(qū)域提取之后分別送入localDNN1和localDNN2。最后將三個DNN輸出的特征向量在融合層拼接,送入最后一個DNN網絡以預測抑郁評分。全局特征和局部特征通過級聯(lián)深層神經網絡有效實現(xiàn)了互補從而獲得了良好的性能。本文在AEVC2013和AVEC2014兩個常用數(shù)據(jù)庫上進行的實驗驗證了該方法的可行性和有效性。今后,我們將結合多模態(tài)融合的要求,進一步提高抑郁癥識別性能。