結合遷移學習模型的卷積神經網絡算法研究

邱寧佳,王曉霞,王 鵬,周思丞,王艷春

長春理工大學 計算機科學技術學院,長春130022

1 引言

近年來,卷積神經網絡(CNN)逐漸被學者們應用到構建分類模型中。為提高分類的精度,Johnson R 等在CNN 卷積層中引入詞袋轉換進行文本分類[1]。周錦峰等通過堆疊多個卷積層,提取不同窗口的局部語義特征來進行分類[2]。鈕成明等利用Word2Vec 和針對長短時記憶網絡改進的循環神經網絡的方法對中文微博情感進行分類[3]。Liao S 等通過對比基于SVM 和樸素貝葉斯算法的傳統分類方法對twitter 數據進行情感分類[4],驗證了CNN具有更好的準確性。Gamb?ck B等應用神經網絡模型[5]對Twitter仇恨語音文本進行訓練,并通過實驗驗證基于word2vec 嵌入的模型表現最佳。Dos Santos C等[6]使用從字符到句子級別的信息來執行短文本的情感分析。王吉俐等[7]通過引入注意力機制得到文本類別的特征向量矩陣后,運用卷積神經網絡模型完成文本的分類。

由于傳統機器學習方法假設訓練集和數據集都處于統一特征空間并分布一致,而在實際應用中,這種假設不太可能成立,因此學者們引入了遷移學習的思想。鄭遠攀等在圖像識別領域有效使用了遷移學習技術識別小樣本數據[8]。王立偉等在高光譜圖像分類中將深層殘差網絡運用到特征提取器中解決了樣本空間特征利用不足的問題[9]。Uguroglu S等提出了一種新的遷移學習方法來識別兩個數據集之間的變量和不變特征[10],以此提高算法的準確性。Oquab M等利用有限數量的訓練數據將CNN在大規模標注的數據集訓練得到的圖像表示有效地遷移到其他視覺識別任務中[11]。張智在圖像分類模型構建中結合遷移學習與深度學習的思想[12]來達到提高模型精度的同時節約訓練成本的目的。Tang Y等使用基于CNN的遷移學習方法來研究歷史文字識別問題,解決了標記訓練樣本不足的問題[13]。邢恩旭等在少量目標樣本訓練集中使用基于遷移學習的雙層生成式對抗網絡模型[14]訓練出更好的模型。么素素等提出了一種基于級聯結構的集成遷移學習算法解決數據絕對不平衡的問題[15]。徐旭東等提出了一種基于遷移學習和CNN的控制圖識別方法,通過比對BP神經網絡提高了控制圖識別準確率[16]。Ravishankar H 等通過遷移學習算法在ImageNet圖像上訓練以執行圖像分類,并通過調整遷移程度來提高圖像檢測分類性能[17]。周清清等利用遷移學習方法對H7N9微博主觀語料文本進行情感分類[18],驗證了其分類效果優于非遷移學習方法。

但傳統CNN需要大量有監督的訓練樣本才能獲得較高的分類精度,而實際上數據集很難滿足獨立同分布的條件,且數據標注成本較高。為了解決以上問題,本文提出了一種基于模型遷移的卷積神經網絡(trCNN)算法。設定源域數據集為帶標注的文本分類數據集,目標數據集為人工標注的少量微博評論數據集。首先為了使數據集更好地符合遷移學習的要求,利用主成分分析法(PCA)算法和自編碼機模型對源域數據集和目標數據集進行降維處理。其次利用源域數據集中大量帶標注的數據集構建源域神經網絡模型,同時設定模型遷移規則,并部分源域模型遷移至目標域任務。最后使用少量帶標注的目標域數據集對遷移模型進行訓練微調其神經網絡參數,完成遷移模型的構建。本文實驗結果表明,基于模型遷移的卷積神經網絡具有較高的分類精度。

2 源域與目標域數據集分析

為了滿足在低維度特征空間下源域與目標域數據集具有相似的特征分布,下面對源域與目標域數據集進行特征降維處理。

2.1 源域數據集特征降維

PCA算法能夠實現無監督降維且計算速度較快,故針對本文源域數據量大的情況,采用PCA 算法挑選出主要特征,對數據集進行無監督降維處理,使得數據降維后產生更小但保持數據完整性的新數據集,有效提高了數據分析效率。

PCA 算法首先選取方差最大的方向作為新的坐標軸方向,然后重復選擇與新坐標軸正交且方差最大的方向(重復次數為原始數據的特征維數)。

設原始數據樣本集為X={x1,x2,…,xm},xi∈Rn,其中m 代表樣本數,n 代表特征維度。為了避免數據均值對坐標變換的影響,本文先對數據集進行處理,將每個特征值減去該維特征的平均值,對第i 個樣例的第j 個特征,計算公式為:

u 為第j 個特征的期望。設協方差矩陣為n×n 大小的方陣,具有n 個特征向量,計算出協方差的特征向量及對應的特征值。將特征向量按照特征值的大小按列排放,組成矩陣u={u1,u2,…,un},設定閾值p,k 為選擇的特征維度,n 為全部的特征維度當滿足:

由此得到降維后的源域樣本集X={x1,x2,…,xm},xi∈Rk,完成源域數據集的降維工作。

2.2 目標域數據集特征降維

自編碼機模型在數據降維過程中可以通過正則化項得到數據集的稀疏編碼形式,本文選用了自編碼機模型對目標域進行降維,將源數據集降維后的特征信息作為稀疏正則化因子,來指導目標域數據集降維,以此盡可能地保留與源域數據較為相似的特征,并完成對目標域的降維工作。

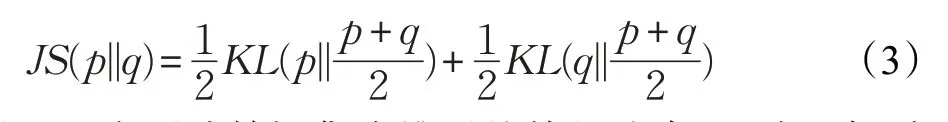

本文使用源域數據集和目標數據集的數據分布相似程度作為正則化項,但因其在原始維度下的數據分布可能無法重疊,此時的KL 散度無法計算出數據分布的差異。因此,為了得到目標域數據的稀疏特征表達,使用最小化源域與目標域數據集的分布差異的JS散度作為稀疏正則項,以此來提高模型在數據分布差異較大時的敏感性,JS散度的計算公式如下:

其中,p 為源域數據集降維后的特征分布,q 為目標域數據集降維后的特征分布。故得到自編碼機的損失函數公式如式(4):

其中,β 為調節因子,用來調節稀疏化的強度,并通過梯度下降算法完成自編碼機降維模型的收斂。最終經過多個編碼層后得到目標域數據低維度的特征表達形式。

3 改進卷積神經網絡的遷移學習

3.1 trCNN模型構建

由于卷積神經網絡具有共享隱藏層矩陣和層次化特征提取的特點,故本文選擇了深度學習中的卷積神經網絡作為遷移模型,并在此基礎上提出了trCNN 模型。模型構建過程如下:

第一步,利用源域數據集訓練一個用于文本分類任務的源域模型。設P 為源域數據Us的特征分布,Q 為目標域Ut的概率密度分布,con_pooling={con_pooling1,con_pooling2,…,con_poolingn} 為源域模型的卷積池化層。卷積神經網絡對上層的特征繼續進行卷積池化操作,設n 為卷積池化層的深度,M 為提取后的特征矩陣,由此可得特征矩陣為Mn:

第二步,將源域模型中用于提取一般性句子特征結構的卷積池化層遷移至目標域模型,并使用目標域的特征信息對遷移來的源域隱層進行微調。將源域和目標域數據集通過卷積池化層后,得到源域特征分布序列P={p1,p2,…,pn} 和目標域Q={q1,q2,…,qn} 特征分布序列,設定數據分布相似度閾值為ρ,對于當前卷積池化層k,通過計算源域和目標域特征分布的JS散度來判定其提取的特征是否相似,當特征分布相似度JS(P||Q)大于閾值ρ 時,遷移得到的卷積池化層對于目標域數據能提取到相似的特征矩陣,可以遷移到目標域模型中,反之則不能遷移至目標域模型中。

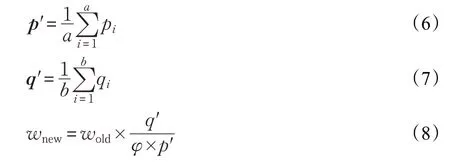

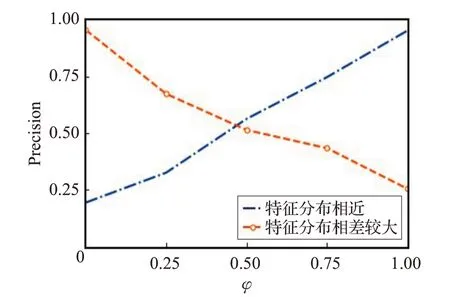

第三步,增加少量用于高層特征提取的隨機初始化隱藏層,完成遷移模型trCNN的構建任務。源域與目標域數據集由于數據量不同而存在的數據集特征分布不同的問題,在隱藏層的遷移中可能會存在誤差,為了減少誤差,本文設計了一種調節因子φ 來對遷移的隱藏層權重矩陣進行細粒度調節。設a 為源域模型特征矩陣數量,p′為源域模型特征期望矩陣。b 為目標域模型特征矩陣數量,q′為目標域模型特征期望矩陣,隱藏層卷積核權重矩陣w 計算公式如下:

當源域與目標域特征分布相近時,φ 值較大,得到較小的遷移隱藏層權重,源域對目標域的特征影響較大;當源域與目標域特征分布差異較大時,φ 值較小,得到較大的遷移隱藏層權重,源域對目標域的特征影響較小。通過細粒度調節因子φ 優化源模型隱層權重擬合目標域的特征分布,得到源域模型對應后的遷移模型參數矩陣,即完成模型遷移工作,最終通過補全深層特征提取的隱藏層,完成整個遷移模型的構建。

補全后的trCNN 模型為了預防訓練數據過度擬合問題,使用Dropout 方法在訓練時隨機選出隱藏層的神經元將其刪除,被刪除的神經元不再進行信號傳遞,從而有效地避免了過擬合問題。同時模型在不需要增加訓練集數量的情況下,減少了訓練迭代次數,提高了泛化能力。

3.2 遷移卷積神經網絡模型構建

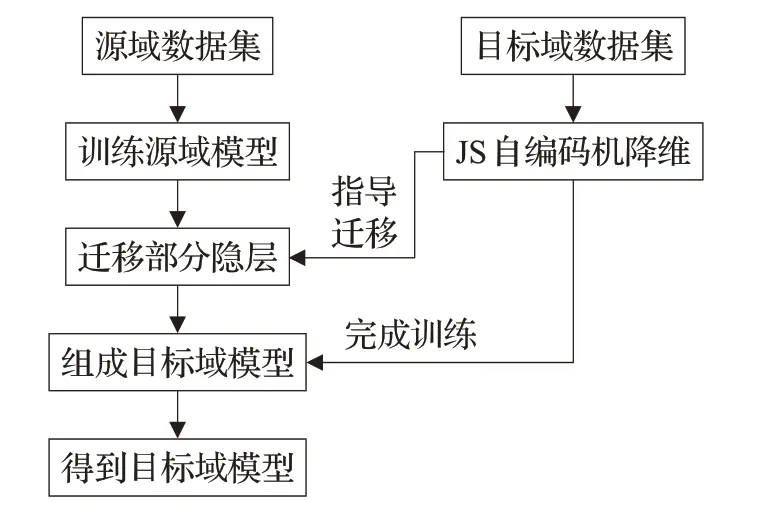

通過結合數據集特征降維與改進的trCNN算法,得到了遷移卷積神經網絡模型,其完整的遷移模型算法流程圖如圖1所示。

圖1 卷積神經網絡模型遷移流程圖

首先,本文采用了無監督的PCA 算法對源域數據集進行降維,得到其主要特征,以此降低了源域數據和目標域數據之間的差距。同時對目標域數據集使用帶有兩個領域數據分布差異JS散度作為稀疏正則項的自編碼機模型進行半監督降維,在低維度下盡可能地減少由于分布不同而導致模型負遷移的可能性。

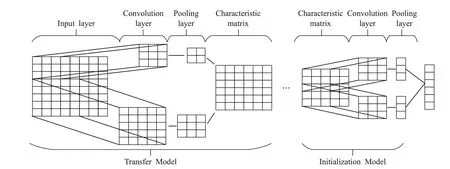

其次,使用源域數據對卷積神經網絡進行訓練,利用JS散度將能夠提取相似特征的卷積池化層進行模型遷移,并通過公式(9)進行細粒度調整遷移模型的隱層權重矩陣,使其更適合目標域數據。將遷移的隱藏層結合初始化的卷積池化層來提取高層特征,形成完整的目標域卷積模型。模型如圖2所示。

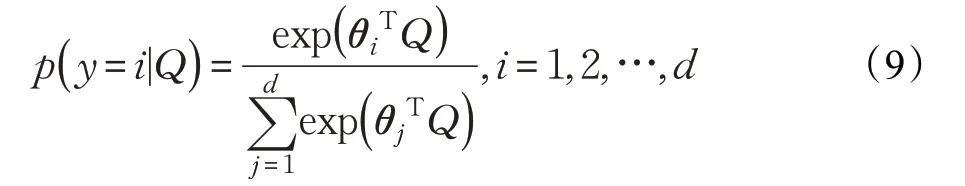

最后,將隨機初始化的隱藏層添加到遷移模型中進行高層語義特征提取工作。由于層數較少,本文使用目標域中少量的有監督樣本對遷移模型進行訓練,從而完成整個模型的構建。設定目標域模型的SoftMax 函數為樣本屬于各個情感類別的概率分布計算公式:

圖2 trCNN模型結構圖

當數據量較少的時候,全樣本梯度下降算法消耗的訓練時間較短,但能較快且穩定地將遷移模型收斂到誤差閾值范圍內。因此本文使用了少量的目標域數據集對遷移模型進行訓練,并采用全樣本梯度下降算法完成遷移模型的訓練的工作,以此來達到對遷移得到的隱藏層進行微調,同時能夠訓練隨機初始化的高層特征提取隱藏層的目的。從而來完成對trCNN 模型從源域到目標域的遷移工作。由于本文利用了本文分類數據集來構建用于提取句子中一般性結構信息的隱藏層,并將隱藏層遷移至目標域模型中,因此極大地降低了卷積神經網絡對于訓練集數量的需求。同時,因為遷移的隱藏層結構提取的是一般性句子結構信息,因此能夠有效地放置卷積神經網絡僅對于某種訓練數據集的過度擬合,增加了模型的泛化能力。

4 實驗與結果分析

4.1 實驗數據

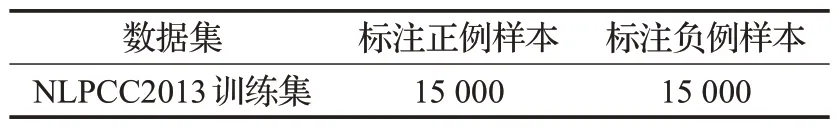

本文采用微博API 提供的數據集與帶有標注信息的NLPCC2013 數據集作為訓練語料庫,其中將NLPCC2013 數據集作為源域數據集,并用來訓練源域的分類模型,數據集正負例樣本分布如表1所示。

表1 源域數據集

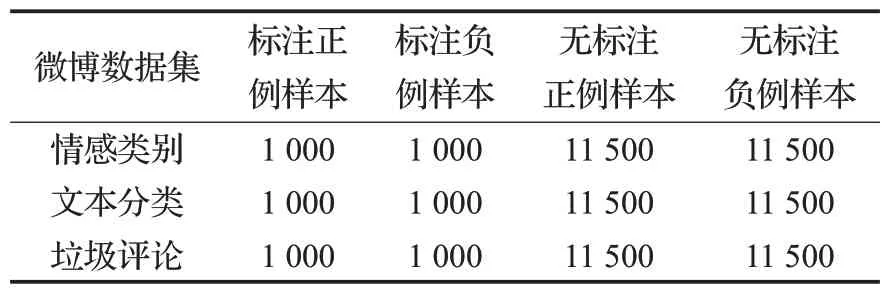

微博數據包含情感分類、文本分類、垃圾評論分類三種文本數據。同時選擇少量等比例的正反數據集進行人工標注,作為遷移后的訓練數據,其余數據則作為遷移模型的測試集,對模型有效性進行驗證,詳細設置如表2。

表2 目標域數據集

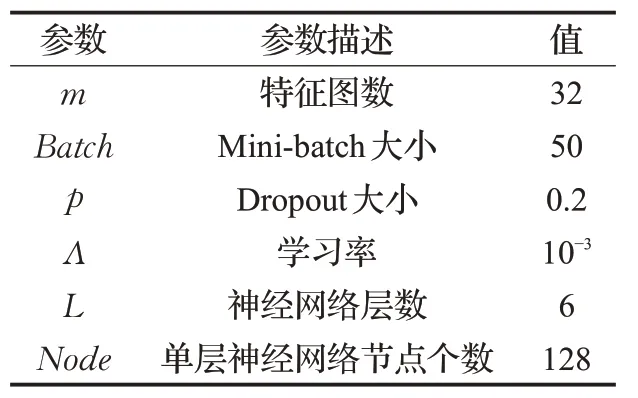

4.2 實驗參數設置

本文在實驗中采用多態模式的卷積核對輸入的語義合成向量進行卷積操作,使用最大池化操作對特征進行降維。設置模型特征圖數m 為32,Mini-batch梯度下降數為50,隨機失活數p 為0.2,學習率Λ 為10?3,神經網絡層數L 為6層,單層神經網絡節點為128個。如表3所示。

表3 模型參數設置

4.3 實驗結果分析

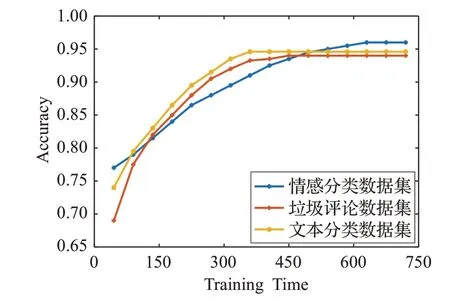

實驗1 遷移模型算法可行性分析

本文使用了NLPCC2013源域數據集訓練一個源域模型,首先將模型中可遷移隱藏層遷移至目標域模型中,然后使用帶標注目標域數據集完成目標域模型訓練工作。設定模型迭代周期為1 000次。數據集分別選擇表2 三種數據集中1 000 條帶標注樣本來訓練遷移模型,設定收斂閾值p >90%。實驗結果如圖3。

圖3 遷移模型在不同數據集下可行性分析

由圖可知,對于已完成遷移的目標域模型,將其放入處于初始化狀態的高層特征提取的卷積池化層,其分類正確率可達到75.2%,由此說明遷移來的隱藏層對于目標域數據集能夠完成底層的特征提取工作。隨著迭代次數的增加,目標域數據集開始訓練遷移模型,其分類精度明顯上升,在350次迭代時模型分類精度最高達到94%左右。當模型在迭代450次時,在三個領域數據集上的誤差均小于閾值,可以認為模型完成了收斂。由此可以得出,trCNN 的模型可以較好地完成遷移任務,從而降低了標注成本。

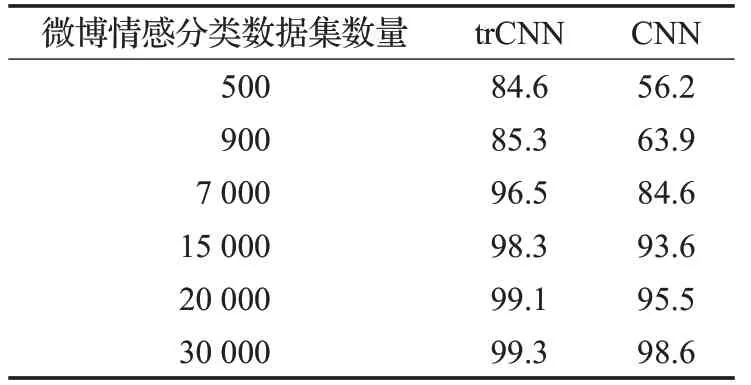

實驗2 遷移模型消耗帶標注樣本數量驗證

為了更直觀地展現模型在降低人工標注中的優勢,本文選用了非遷移的CNN模型作為對照組。設定實驗迭代次數為5 000 次,數據集為表2 的微博情感分類數據,通過逐漸增加帶標注的數據來判斷其在測試集下的正確率,實驗結果如表4。

表4 不同樣本數量下模型正確率%

由表4可知,微博情感分類數據集為500條時,CNN的模型的分類正確率比trCNN的模型低了近30%,當數據集樣本增加至900 條時,trCNN 的模型正確率已經達到了85.3%,而CNN 的模型正確率僅63.9%,此時可以認為trCNN已經完成了訓練工作,并且取得了優異的分類成績。實驗繼續增加訓練樣本至7 000條時,CNN的模型分類才達到84.6%,相對于trCNN模型,增加了87%的訓練樣本。此后再增加訓練樣本,兩種模型都已經趨近于收斂狀態,可以認為已經完成了訓練工作。同時由于源域數據自帶標注信息的公共文本數據集,預訓練得到的模型可以用于多種目標域中。因此,改進的trCNN模型不僅可以降低大量人工訓練的標注成本,還能降低訓練的運算成本。

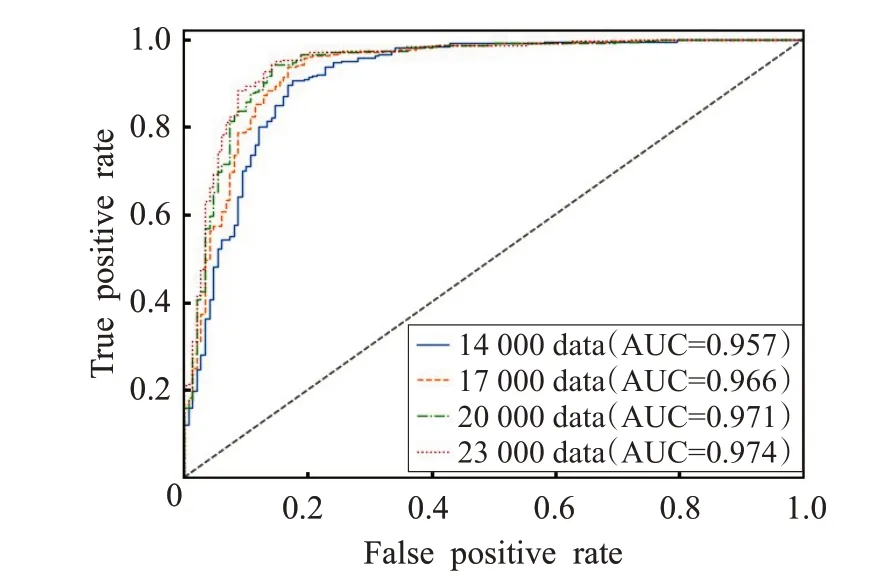

使用表2 中的垃圾評論數據集作為測試集進一步驗證訓練完成后的模型的分類效果,實驗通過增加測試集數據驗證目標域數據量對實驗結果的影響,設定AUC為實驗結果評價指標,AUC值越大,說明模型分類效果越好。實驗結果如圖4所示。

圖4 trCNN模型分類精度ROC曲線

可以看出,當測試集數據量由14 000 增至23 000時,AUC 的值由0.957 增至0.974,實驗達到一定的迭代次數后,模型分類性能能夠在保持較高準確度程度下趨于平穩。隨著測試集數量的增加,垃圾評論數據集精度損失減小。因此可以得出,遷移后的神經網絡模型具有較好的分類效果。

實驗3 目標域特征降維對遷移性能的影響

本文使用多層自編碼機對目標域數據集進行降維,設定源域數據集為nlpcc2013,目標域數據集為微博情感分類數據集,自編碼機采用5個隱藏層對輸入向量進行編碼,由此得到5種目標域數據集的低維度特征表現形式,將后一層的隱層信息看作前一層的降維結果,通過實驗,得到源域與目標域數據分布相似度和特征維度之間的關系如圖5所示。

圖5 降維對樣本集特征分布相似度影響

由圖5可以得出,降維后的源域數據與目標域數據相較于原始數據在數據分布上已經取得了較高的相似度。微博情感分類數據在未降維的情況下與源域數據的JS散度為48%,在經過5次特征降維后達到了86%。而垃圾評論數據集與文本分類數據集在無降維條件下,特征分布相似度僅為12%和19%,但經過5次降維后最終達到了72%和70%的結果。這說明特征降維能夠提高數據分布的相似度。同時,本文設計了實驗來驗證數據分布相似度對遷移模型分類效果的影響,實驗結果如表5所示。

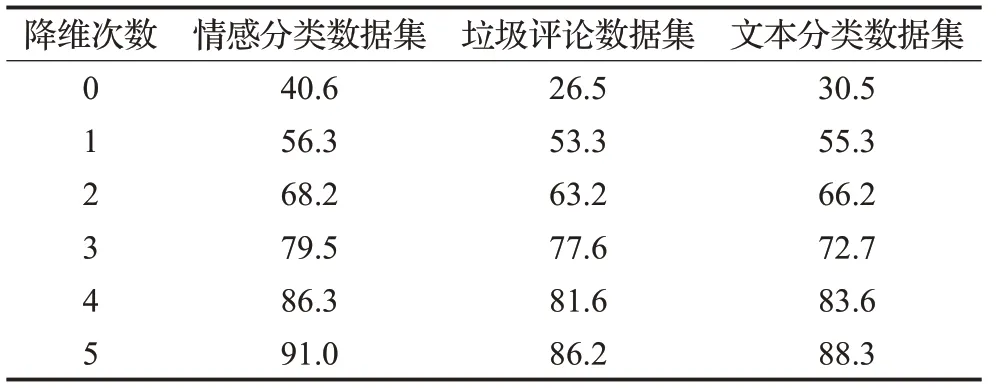

表5 樣本集降維對遷移模型性能影響 %

由表5 可以看出,在原始維度下,遷移模型的性能普遍較低,即使在特征分布較為相似的微博分類數據集上也僅僅只有40.6%的分類準確率。而隨著降維次數的增加,數據分布的相似度升高,三個數據集的分類準確率也逐步提升,在經過第5 次降維后,三個數據集分別取得91%,86.2%,88.3%分類準確率。由此可見當對數據進行降維后,目標域數據分別貼近于源域數據分布,得到的遷移模型能更好地貼近于目標域數據集,得到更高的分類精度,證明了遷移模型的可行性。

實驗4 調節因子對分類精度的影響

本文使用實驗3 中降維前后的垃圾評論數據集進行分類實驗,設計當源域與目標域數據集特征分布不同時,通過調節因子對遷移的隱藏層權重矩陣進行細粒度調節,得到不同的分類效果,以此來驗證調節因子對分類精度的影響。實驗結果如圖6所示。

圖6 調節因子φ 對分類精度的影響

由圖6 可知,當源域與目標域特征分布相差較大時,隨著φ 值的增加,垃圾評論數據集的分類效果逐漸下降;相反,當源域與目標域特征分布相近時,數據集的分類精度也隨著φ 值的上升而增加。由此證明了通過調節因子來對遷移的隱藏層權重矩陣進行細粒度調節,減小了源域與目標域之間特征分布不同時的誤差,從而提高遷移模型的分類準確度。

5 結束語

為提高訓練集與測試集分布不同時的分類精度,本文設計實驗對數據分布差異性進行分析,提出了trCNN模型。該模型首先利用PCA算法對源域數據集進行無監督降維,同時利用自編碼機模型對目標域數據集進行半監督降維,使源域數據集與目標域數據集具有較為相似的分布狀態。其次結合卷積神經網絡分布特征提取的特點,針對底層特征提取的卷積池化層進行遷移,并使用初始化高層特征提取器補全CNN 模型。最后,使用降維后的帶標注目標域數據集完成遷移模型的樣本訓練任務。本文設計實驗分別驗證了遷移模型的可行性,標注樣本消耗能力,trCNN 模型分類精度以及目標域降維對特征分布相似度的影響,通過實驗結果分析可知,本文提出的trCNN模型在訓練集與測試集分布不同時也具有較高的分類精度,且遷移后的神經網絡模型能夠在不損失較大模型精度的前提下降低標注成本。