面向AR輔助維修的3D物體識別技術

王維, 張丹, 胡曾一震, 左敦穩

(南京航空航天大學 機電學院, 江蘇 南京 210016)

0 引言

隨著機械設備的集成度和復雜度越來越高,其相應的維修和維護也變得越來越困難,傳統維修指導方式顯然無法滿足更高的要求,而基于增強現實技術的AR輔助維修成為一種令人期待的新型維修指導方式[1]。

如同大多數的AR應用一樣,3D物體識別和定位技術一直以來都是限制其發展的主要羈絆,較早的AR輔助維修大多是基于對二維標記或二維圖像的識別來實現信息增強的,如趙敏等人[2]采用靜態標識和動態標識相結合的方法,實現場景識別和信息增強;崔波等人[3]采用基于圖像匹配的算法,進行目標識別和信息增強;蘭佳等人[4]采用基于改進形狀描述符等特征的立體視覺識別算法,實現了弱紋理工件的識別和抓取。基于二維標記的識別不僅污染場景,而且與基于二維圖像的識別一樣無法感知目標物體的空間位姿,而目前解決這一問題的最佳方案之一是采用基于三維數據的物體識別技術,其中最為普遍的是基于點云的3D物體識別技術。

基于點云的3D物體識別不僅可以給出類別,最重要的是可以給出空間位姿,關鍵在于點云的配準。點云的配準可分為基于點云全局特征型和基于點云局部特征型,AR輔助維修對目標識別時間效率和位姿估計準確度的要求是首要的,因此該類研究基于前者。基于不同方法的識別差異主要在描述符上,其中的ESF[5]以及近年出現的GASD[6]和GOOD[7]是目前實時性和準確性較好的幾種全局描述符,而這三者中表現最好的是GOOD,即全局正交對象描述符,其描述符計算時間僅為1ms左右。

本文在GOOD描述符的基礎上進行深度改進,提出一種名為C-GOOD的全局描述符以及基于該描述符的3D物體識別與定位算法。主要工作有:1) 改進關鍵技術,形成新的描述符生成方法。包括引入帶距離權值的協方差矩陣,改進原有的局部參考系估計方法,以及在原有的GOOD描述符上加入紋理特征,形成新的描述符;2) 搭建基于蝸輪蝸桿減速器的實例驗證維修場景,驗證本文算法的實際可行性和具體識別效果。

1 識別算法框架

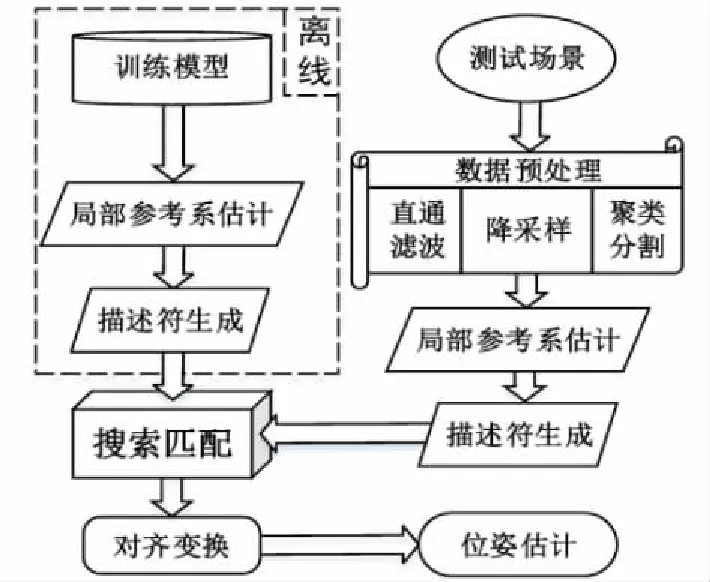

本文所提識別算法的整體框架如圖1所示,主要分為離線階段和在線階段。

圖1 3D物體識別算法整體框架

離線建庫階段,對所有訓練對象點云模型的多個視角估計局部參考系并生成描述符,建立模板庫。在線識別階段,首先對測試場景進行預處理得到聚類目標,然后進行局部參考系估計和描述符生成;之后進行匹配搜索;匹配成功后將相應模型視角變換到場景目標即可獲取場景目標初始位姿。

2 物體識別技術

2.1 局部參考系估計

在基于點云全局特征描述符的3D物體識別中,局部參考系是該類描述符具有唯一性、描述性和可重復性的基礎,對于目標的位姿估計也不可或缺。常規的估計方法以主元分析法為基礎,其關鍵在于構造歸一化協方差矩陣:

(1)

式中:pi為目標點云中的第i個三維點;n為目標點云中的總點數;pc為目標點云質心。

由于局部參考系的估計依賴三維數據點,且本文所提算法的應用場景存在目標點云局部缺失、邊緣突變、密度變化以及降采樣等情況,因此本文對原有參考系估計方法加以改進,根據目標點云中三維數據點到目標點云質心的距離,設定一個與距離有關的貢獻度權值,通過權值強化靠近質心三維數據點的作用、減弱遠離質心三維數據點的作用。于是對式(1)進行改進即可得到新的協方差矩陣:

(2)

式中:pi、i、n和pc與式(1)相同;D為目標點云中距質心最遠的三維點到質心的歐式距離;di為目標點云中第i個三維數據點到質心的歐式距離。

對式(2)的協方差矩陣MCN進行特征求解,可以得到一組特征向量[v1,v2,v3],該向量即代表初始局部參考系,但此時的局部參考系具有方向二義性,本文通過引入三維點的空間分布以消除此方向二義性,其具體過程主要有:

1) 目標點云與初始局部參考系對齊

目標點云對齊時的變換矩陣由初始局部參考系定義,即由向量[v1,v2,v3]定義,同時需要保證3個向量相互垂直。

2)統計x和y坐標軸正負區域內的點數

分別統計對齊后的目標點云中位于x和y坐標軸正負區域的數據點個數。以x軸為例的具體統計規則為:

(3)

3) 確定x和y坐標軸方向標志

依據對齊后的目標點云在x和y坐標軸方向上的分布情況定義坐標軸方向標志。以x坐標軸為例的具體定義為:

(4)

4) 確定z坐標軸方向標志

對于z坐標軸的方向標志,只需要依據x和y坐標軸的方向標志即可確定,因為局部參考系的3個坐標軸之間有右手定則限制,所以z坐標軸的方向標志定義為:

(5)

式中:Sx、Sy和Sz分別表示局部參考系3個坐標軸的方向標志,三者取值均為+1或者-1。

根據初始局部參考系以及3個坐標軸的方向標志Sx、Sy和Sz,就可以確定唯一的最終局部參考系坐標軸的方向,消除歧義,獲得唯一可重復的局部參考系。

2.2 描述符生成

針對全局正交對象描述符(GOOD)進行改進,通過添加紋理信息設計生成帶紋理全局正交對象描述符(C-GOOD),其形成過程主要包含主體形狀特征的生成、紋理信息的添加以及融合描述符的生成,具體分步細節為:

1) 局部參考系估計

此步驟在上一小節中已經說明。

2) 目標點云與最終局部參考系對齊

目標點云與局部參考系對齊時的變換矩陣由最終的唯一可重復局部參考系定義。

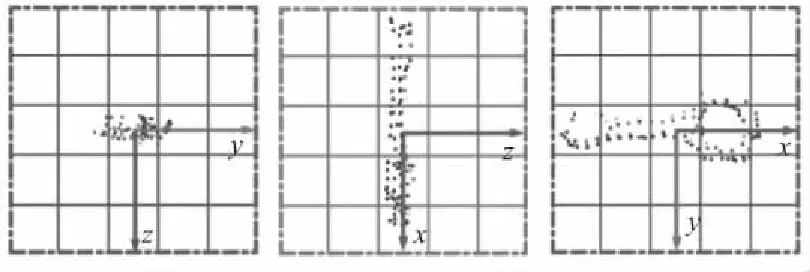

3) 確定3坐標軸方向投影描述符直方圖

統計正交投影特征時,首先需要確定投影區域的大小和維度,假定對齊后的目標點云其最大絕對坐標值為Cmax,則投影方格網陣的邊長設置為L=2Cmax+δ,而投影方格網陣維度N是本文描述符最為關鍵的參數,經過本文實驗探索,其設置為10時可以達到識別效率和正確率的綜合最佳,這里為了便于說明設置為5。活塞連桿在3坐標軸方向的方格網陣上投影效果如圖2所示。

圖2 活塞連桿點云沿3坐標軸方向上的投影

為了便于獲取投影方格網陣相應區域的位置編號,在投影后需將投影方格網陣整體偏移至第1象限,2個方向偏移量均設置為投影方格網陣邊長的一半。活塞連桿沿z軸方向上的投影及其統計時方格網陣的偏移過程如圖3所示。

圖3 活塞連桿沿z軸方向投影及投影方格網陣偏移

對于投影平面上的N維投影方格網陣,分別用row(∈{0,1,2,…,n-1})和col(∈{0,1,2,…,n-1})表示其區域方格所處的位置下標;對于投影點pi,用pa和pb表示其在對應投影平面上的兩個真實坐標,用prow和pcol表示其將要投向的區域方格在方格網陣中的位置下標,那么根據投影方格網陣的邊長L和維度N,即可計算出每一個投影點投向的區域方格位置橫縱下標:

(6)

將目標點云中的所有三維點都進行投影,并對每個區域方格進行點數統計,然后對投影矩陣進行歸一化處理即可得到點云形狀分布矩陣,將分布矩陣展開即為單個投影方向上的描述符直方圖。對目標點云分別沿x、y、z3個坐標軸方向進行投影,即可得到3個對應于3個正交坐標軸方向的描述符直方圖。

4) 形成主體形狀描述符直方圖

通過引入信息熵和方差對3)所得3個直方圖進行排序拼接,消除排序歧義。首先以信息熵為第1排序標準,選出信息熵最大的排在首位;然后以方差為第2排序標準,在剩下的兩直方圖中選出方差較小的排在第2位;最后一個直方圖排在末尾,由此便形成了一個具有3N2個區間的單一直方圖,稱為主體形狀描述符直方圖。

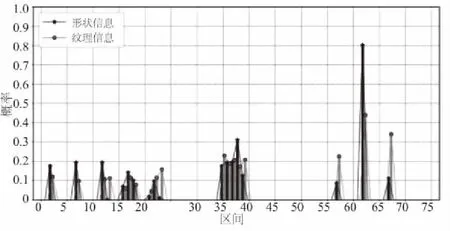

5) 添加紋理信息形成融合描述符

主體形狀描述符只包含形狀信息,不含紋理信息,因此其在物體識別上存在很大局限性。為了彌補不足、提高識別率和位姿估計準確度,本文在主體形狀描述符基礎上加入紋理信息,融合生成帶紋理全局正交對象描述符。

帶紋理全局正交對象描述符中紋理信息的添加,在主體形狀描述符的投影點數統計時同步進行,具體來講就是在統計主體形狀描述符的投影點時,對相應點整合后的顏色信息進行統計,并在單個投影方格區域內,求取所有投影點整合后顏色信息的均值計入對應方格中,并在統計完成后與統計點數同步進行歸一化處理。

對于每一個投影方向,紋理信息的加入方式和后續處理步驟都采用同樣的方法,而對于紋理信息直方圖的拼接只需與形狀直方圖保持同步即可。最后通過并聯組合的方式將生成的整體紋理信息直方圖和整體形狀信息直方圖合并,組合所得的形狀紋理并行直方圖即是最終的帶紋理正交對象描述符(C-GOOD)直方圖,其整體維度為2×3N2。圖4為活塞連桿的帶紋理正交對象描述符直方圖。

圖4 帶紋理正交對象描述符直方圖

2.3 識別定位

本文所述物體識別的實質過程實為描述符的搜索匹配過程。在具體的匹配過程中,本文采用皮爾森相關系數來度量直方圖描述符之間的相似性。當場景目標的點云描述符與訓練對象點云描述匹配成功,則認為場景目標正確識別。

識別成功后,目標物的初始位姿估計具體過程為:

(7)

式中:Ts和Tt分別為場景目標和訓練對象的局部參考系矩陣;Tc為場景目標初始位姿。根據式(7)即可得到較為準確的初始位姿,但是若要得到更加精確的位姿,則可在犧牲一定實時性的基礎上,使用ICP[8]調優算法來實現。

3 場景實例驗證

3.1 維修場景搭建

對于具體的維修場景,本文通過Kinect相機采集場景深度數據和彩色數據,并將深度圖和彩色圖進行融合,形成紋理點云對場景進行表達。本文以蝸輪蝸桿減速器的拆裝維修為基礎,搭建驗證本文3D物體識別算法的維修場景,如圖5(a)所示即為包含維修對象、采集設備以及處理設備的維修場景整體布置架構。

用于驗證本文3D物體識別算法的維修場景以蝸輪蝸桿減速器為主要目標,通過對各個維修階段相應場景中零部件的識別效果,來驗證本文算法在實際維修場景中的表現。蝸輪蝸桿減速器的維修拆裝場景如圖5(b)所示,總共包括減速器底座、蝸輪、蝸輪軸、軸承端蓋、套筒和減速器上蓋6個零部件以及1個活動扳手。

圖5 物體識別整體框架及維修場景紋理點云

3.2 實例識別驗證

對于蝸輪蝸桿減速器的拆裝維修,本文所提3D物體識別算法在具體識別的過程中,不僅可以給出目標的識別分類,同時會對目標的空間位姿進行估計。

對于零部件較多的某一維修場景,其識別過程中的兩幀結果如圖6所示。

圖6 維修場景的某兩幀場景點云識別結果

在所有的點云數據幀中,5個相對較大的目標物均能正確識別,只有相對較小的扳手和套筒因為實驗中采集的數據精度太低導致無法成功識別。目標識別成功即可估計初始位姿,該維修場景下所有場景幀中,識別成功目標的平均初始位姿估計結果和所有場景幀的平均描述符計算匹配耗時如表1所示。

經過對蝸輪蝸桿減速器拆裝維修場景的識別驗證,可以明顯看出本文所提算法在識別相對較大目標時效果顯著,只是對于過小目標則相對較差,這主要是因為深度采集傳感器的精度不足,無法獲得較小目標的精確形狀輪廓。同時在表1中不難發現,本文所提識別算法對單幀場景點云的識別耗時僅為33.6ms,基本達到AR輔助維修下實時識別目標物的要求,而且也給出了目標物的位置和姿態信息。

從總體來看,實例驗證維修場景中的大多數目標都得到了成功識別,整體識別過程滿足基本的實時性要求,并且給出了識別成功目標物的初始位姿。實例識別實驗結果表明,本文所提3D物體識別算法在實際維修場景中具備實際可行性和真實有效性。

4 結語

針對AR輔助維修信息增強對實際維修場景中,目標物識別正確性、位姿估計準確性以及識別過程實時性的需求,本文深入分析研究了目前最先進的點云全局特征3D物體描述符、全局正交對象描述符,在此基礎上改進并提出了附帶紋理信息的新型點云全局特征描述符及其3D物體識別算法。經過實驗分析和蝸輪蝸桿減速器拆裝維修場景的實例識別驗證,證明本文所提算法在AR輔助維修信息增強的目標識別應用中具備實際可行性、真實有效性,進一步助推了AR輔助維修技術的發展與應用。

表1 場景幀的描述符平均計算匹配耗時和目標平均位姿