基于優化隨機森林的肝臟病變識別應用研究

姚冰瑩 楊薇 陳堅強 牛婷婷

摘? 要:針對肝病早期的病理特征不夠明顯容易出現漏診的問題以及引入噪聲的肝臟CT圖像容易導致疾病的誤診,提出了一種基于優化的隨機森林的肝臟病變識別方法。首先通過PNet圖像增強網絡,實現噪聲偽影抑制和細節對比度提升。將增強后的肝臟CT圖像輸入基于SENet與ResNeXt-152結合雙通道重標定機制的網絡提取二維特征并突出重要特征,使用改進的類C3D網絡進行三維空間特征的提取,然后進行多維特征融合,實現肝臟CT圖像的高級語義特征的提取。最后使用隨機森林進行肝臟病變識別,使用3D斷層掃描肝臟CT圖像進行實驗,達到較好的病變識別效果。

關鍵詞:肝臟CT圖像;深度學習;高級語義特征;隨機森林;病變識別

中圖分類號:TP18;TP391.4? 文獻標識碼:A 文章編號:2096-4706(2021)18-0090-04

Abstract: Aiming at the problem that the early pathological features of liver disease are not obvious enough to cause missed diagnosis and the noise-introduced liver CT images easily lead to the misdiagnosis of diseases, a liver lesion recognition method based on optimized random forest is proposed. First, the PNet image enhancement network is used to achieve noise artifact suppression and detail contrast enhancement. The enhanced liver CT image is input into a network based on SENet and ResNeXt-152 and combined with a dual-channel recalibration mechanism to extract two-dimensional features and highlight important features, uses an improved C3D-like network to extract three-dimensional spatial features, and then perform multi-dimensional feature fusion. Realize the extraction of high-level semantic features of liver CT images. Finally, random forest is used to identify liver lesions, and 3D tomography liver CT images are used for experiments to achieve better lesion recognition results.

Keywords: liver CT image; deep learning; high-level semantic feature; random forest; lesion recognition

0? 引? 言

肝癌是當前世界上發病晚及死亡率較高的惡性疾病之一,并且全國各級醫院醫生的資質存在較大差異,同時在實際臨床應用中,由于肝臟病變的紋理結構及其分布模式復雜且難以區分,單純的人工讀片會導致誤診、漏診等問題。然而肝細胞癌的早期發現和早期病變的診斷和治療,可以極大地促進患者的治療和康復。近年來,隨著圖像處理、計算機可視化、模式識別等相關領域技術的發展,計算機輔助診斷逐漸成為未來輔助醫學診斷的發展趨勢,對于肝臟CT圖像病變檢測具有非常重要的意義。

肝臟CT圖像病變識別研究經歷了人工特征提取分類階段和深度學習提取高級語義特征分類階段。基于傳統人工提取紋理特征的算法是進行肝臟病灶早期識別的重要理論基礎之一。吳海濤等應用形態學開運算和填孔法提取肝臟區域,采用灰度直方圖,灰度共生矩陣作為肝臟兩類主要特征,使用改進特征選擇的隨機森林算法進行分類。Kirubakaran將Gabor變換的多尺度特征與局部二值模式算法得到的局部特征進行特征融合可將準確率提高到88.23%。這種方法雖然通過級聯的方式獲得了多尺度的特征信息,但沒有從根本上突破人工提取特征的局限性,傳統的手動特征提取方法僅限于低級紋理語義信息。Romero等人將提取的有效特征通過深度學習方法InceptionV3和ImageNet中訓練得到有效特征的權重,病變類型的準確率可以達到96%。該網絡的 Inception結構并行實現卷積和池化操作[4],以獲得圖像更多的潛在特征。但沒有區分特征的表達能力,因此當網絡層數增加時會出現網絡退化等問題。

相比之下通過深度學習提取的肝臟CT圖像的高級語義特征可以準確彌補人工提取特征缺乏表現力的缺陷,高級語義特征具有更好的抽象性和抗干擾性。牛婷婷等構建了一個基于注意力機制的雙通道重新校準模型,抑制無用特征并計算不同的特征通道權重,并將它們嵌入到Inception_ResNet_V2網絡結構中。其次,我們在二維和三維卷積神經網絡的基礎上設計了全連接層,然后添加特征融合層來獲取不同維度的深層語義信息。最后,使用預訓練模型初始化網絡結構并將融合的特征輸入到XGBoost分類器中進行分類預測已經達到了較好的預測結果。

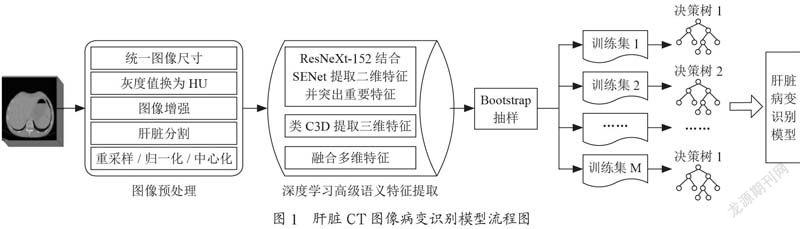

1? 肝臟CT圖像病變識別模型

本文針對3D斷層掃描肝臟CT圖像病變識別模型進行研究,肝臟CT圖像病變識別模型應分為以下幾個階段:3D斷層掃描肝臟CT圖像的預處理;肝臟、肝臟腫瘤分割;深度學習提取的肝臟CT圖像的高級語義特征[1];隨機森林集成學習算法進行肝臟CT圖像病變分類。建立肝臟CT圖像病變識別模型,整體流程如圖1所示。

2? 3D肝臟CT圖像的預處理

3D斷層掃描肝臟CT圖像是三維圖像,CT圖像無法直接分辨肝臟,不同的組織器官對應不同的放射劑量HU(Hounsfield Unit)。肝臟的放射劑量是+40到+60。首先使用pydicom庫讀取所有斷層掃描圖像。接著將肝臟CT圖像灰度值轉換為 HU:首先去除灰度值為-2 000的像素,CT掃描邊界之外的灰度值固定為-2 000(dicom和mhd都是這個值);第一步是設定這些值為0(即空氣值);變換到HU單元,乘以rescale比率并加上intercept。然后,進行重采樣每一次CT掃描時,掃描的尺寸和間距可能不同,可以使用同構采樣;常用的處理方法是從整個數據集中以固定的同構分辨率重新采樣[1],將所有的東西采樣為1 mm×1 mm× 1 mm像素。然后將數據進行歸一化,中心化,最后以nii格式保存。

3? 肝臟、肝臟腫瘤分割

由于肝臟腫瘤的形狀、大小、位置各異,并且病變區域與正常肝臟、肝臟與相鄰器官之間的界限在肝臟CT圖像中比較模糊,因此實現AI自動分割肝臟病灶存在非常大的難度。2019年在全球LiTS(Liver Tumor Segmentation Challenge)大賽中,TencentX團隊提出了的自動分割肝臟和肝臟病灶算法,首先進行數據標準化的預處理以降低圖像差異;在肝臟分割模塊,設計了2.5D全卷積神經網絡并借鑒空洞卷積模塊挖掘肝臟的結構化信息;在肝臟腫瘤分割模塊,設計了新型的輔助損失函數,使得網絡有效挖掘肝臟腫瘤的空間信息,最后通過模型融合等處理,保證算法的精準性及可靠性。

4? 肝臟CT圖像的高級語義特征提取

由雙卷積池化單元和非線性操作組成類C3D三維網絡結構,用于提取肝臟CT圖像的三維語義特征;ResNeXt-152與SENet網絡構成雙通道重校準機制網絡結構,用于提取肝臟CT圖像的二維語義特征并突出重要特征,最后,利用預訓練模型初始化網絡結構,將融合的多維度特征輸入到隨機森林分類器中進行分類預測[6],基于深度學習的高語義特征提取結構如2圖所示。

C3D包括卷積,池化,分類等,可用于提取3D肝臟CT圖像的3D特征,可基于VGGNet的結構設計一個類C3D的網絡架構SC3D,網絡架構包含十個3D卷積層、五個激活函數、五個3D最大池化層、和兩個全連接層。首先,將卷積層與激活函數結合起來,產生更多的非線性操作,更好地匹配圖像特征。然后,在每兩個卷積層之后增加一個池化層,形成一個固定的雙卷積池化單元,在時間和空間維度上都進行采樣,使得參數數量更小,網絡結構更加精簡。接下來使用MaxPooling技術進行池化操作,保證特征不變性和降維操作,池化模型更容易收斂。最后,插入兩個全連接層和flattening函數,針對卷積層到全連接層的過渡以及多維輸入的一維化。每個雙卷積池化單元后面都附有一個Dropout操作,以防止模型參數引起的過擬合現象。輸入大小是9×224×224個疊加圖像的數組,其中9是提取的連續肝臟切片,224×224是每個肝臟切片圖像的高度和寬度,卷積核大小固定為3×3×3。經過卷積層的非線性變換,生成3D張量,完成空間特征的提取。

特征重校準機制是一種作用于特征通道的注意力機制,為卷積通道分配不同的權重來區分特征重要性。SENet可以通過ResNeXt-152網絡根據損失值突出特征差異,增大有效的feature map權重,減少效果小或者無效的feature map權重,以此方式訓練模型達到更好的識別結果。模型的輸入為雙通道,引入最大池化層并保留特征圖中最顯著的特征信息,融合多個通道得到的不同特征,得到最終的通道權重。兩個BatchNormalization結構和一個全連接層。這不僅是為了實現模型的快速收斂,降低過擬合現象、梯度消失問題的概率,而且使學習到的特征更容易擬合肝臟圖像。優化后的結構,在輸出特征中包含更多層的肝臟區域信息,擴大了不同特征之間的差異,削弱了無效特征的干擾。雙通道重校準機制結構如圖3所示。

在計算機視覺領域,特征融合是一種將不同視角的特征組合起來進行信息獲取和補償的常用策略。為了構建特征融合層,本文在卷積神經網絡之后設計了一個統一維度的全連接層,并進行相同層的融合,以方便不同層次的對象信息的有效利用。也采用特征矩陣拼接的方法,在水平方向增強特征信息,得到最終的特征融合結果,輸入到隨機森林分類器進行分類預測。

5? 隨機森林集成分類器

隨機森林(RF)是一種統計學習理論,采用bootstrap抽樣法從訓練集T中有放回的隨機抽取出M個樣本集S,作為樣本Bagging,從全部K個特征中隨機抽取一個特征子集(通常選取),從特征子集中選擇最優分裂特征為樣本Bagging建樹。使用樣本Bagging中的M棵決策樹預測測試數據分類結果,并統計分類結果,選擇投票數最多的類別作為最終的分類類別。隨機森林的分類結果公式為[2]:

H(x)為隨機森林組合分類器模型,hi為Bagging中單個決策樹模型,Y表示類別標簽。I(·)表示性函數[2]。通常使用OOB估計來衡量隨機森林算法的泛化誤差,因此,OOB估計可作為算法分類性能的指標。隨機森林算法的泛化誤差定義為[2]:

當子決策樹數量達到一定還繼續增大時,泛化誤差會無限趨近于一個上界。其中,邊緣函數mg(X,Y)為分類器平均正確分類數與平均錯誤分類數之差,mg(X,Y)越大,表示算法模型越好[2]。

scikit-learn中隨機森林類庫是RandomForestClassifier,隨機森林需要調參的參數包括兩部分:Bagging框架的參數和CART決策樹的參數[3]。Bagging框架的參數包括:

(1)n_estimators:最大決策樹的個數,太小欠擬合,太大過擬合,默認值100。

(2)oob_score:是否使用袋外樣本來評估模型的泛化能力[3],默認false,應設置為true。

(3)criterion:CART樹做特征評價標準,選擇絕對值差MAE。

CART決策樹的參數包括:

(1)max_features:最大特征數選擇log2,最多考慮log2N個特征。

(2)max_depth:決策樹最大深度,10~100之間。

(3)min_samples_split:節點繼續劃分所需最小樣本數,默認是2。

(4)min_samples_leaf:葉子節點最少樣本數,低于此值兄弟節點將一起被剪枝,默認1。

(5)min_weight_fraction_leaf:葉子節點最小的樣本權重,低于此值兄弟節點將一起被剪枝,默認0。

(6)max_leaf_nodes:限制最大葉子節點數,防止過擬合,默認是”None”。

(7)min_impurity_split:節點劃分最小不純度,此值限制決策樹的增長,若低于此值,此節點不在生成葉子節點,默認值1e-7。

基于隨機森林的肝臟CT病變識別模型分類性能的指標常用混淆矩陣的準確率、精確度、召回率、F值來描述,其中,TP和TN分別為正確分類的正類和反類樣本數,FN和FP分別為錯誤分類的反類和正類的樣本數。精確度為預測為正類的樣本數中正確分類的正類樣本所占比率。

召回率表示在所有正類樣本數中正確分類的正類樣本數占的比率。

F值對精確度和召回率進行了加權平均,是召回率和精確度的相對權重。

6? 實驗

實驗可采用基于深度學習的 Keras2.2.4框架,數據集可使用2019年“大數據醫療——肝癌影像AI診斷”競賽題所取的數據集共有7 398個肝臟序列,圖像格式為Dicom文件格式,可將3/4為訓練集,1/4為測試集,統一圖像尺寸為224×224像素。分類模型網絡中批處理大小為32,訓練次數為100,并使用SGD優化器,設置學習率設為0.000 1,動量設為0.9,Dropout節點隱藏率設為0.5,交叉熵作為肝臟分類的損失函數,并根據損失值更新網絡參數。分類器隨機森林n_estimators設置100,oob_score設置為true,max_features設置為log2,max_depth不限制。同時把準確率和F1值作為評價指標對分類結果進行評估,測試的結果如表1所示。

從上表中可見ResNeXt-152+SENet+類C3D方式提取的肝臟CT圖像多維高語義特征,并突出重要特征分類時的決策權重,具有較好的分類識別效果,證明了本文中分類方法的有效性。

7? 結? 論

本文對3D斷層掃描肝臟CT圖像病變識別模型進行研究,通過深度學習提取的肝臟CT圖像的高級語義特征,包括通過類C3D網絡完成空間特征的提取,SENet和ResNeXt- 152網絡結合來區分特征重要性,使用隨機森林進行肝臟病變識別,可達到較好的分類識別效果。

參考文獻:

[1] 谷宇.基于深度卷積神經網絡的CT影像肺結節檢測技術研究 [D].上海:上海大學,2019.

[2] 武海濤.肝臟CT圖像病變檢測與識別應用研究 [D].杭州:浙江大學,2016.

[3] 劉曉虹.肝臟CT圖像特征提取與識別的研究及系統實現 [D].鎮江:江蘇大學,2019.

[4] 傅言.基于圖像分析的中醫面診及在肝病上的研究 [D].哈爾濱:哈爾濱工業大學,2007.

[5] 劉天宇.基于深度監督網絡的肝臟及肝臟腫瘤CT影像自動分割算法研究 [D].蘭州:蘭州財經大學,2020.

[6] 牛婷婷.基于顯著性算法的肝臟影像圖像分類 [D].武漢:武漢科技大學,2021.

作者簡介:姚冰瑩(1988.02—),女,漢族,湖北荊州人,高級工程師,講師,碩士研究生,研究方向:模式識別、云計算、Web系統。