基于注意力機(jī)制的圖神經(jīng)網(wǎng)絡(luò)的電商知識圖譜推薦

毛建新 楊艷麗 肖鵬 聶巖磊 孫貞 王愛東 范亞國

摘要:目前基于電商的推薦算法的缺陷在于預(yù)測結(jié)果難以解釋,用戶節(jié)點和商品節(jié)點的信息沒有得到充分利用。事實上,用戶和商品具有的屬性信息并不是孤立存在的,我們考慮將其視為知識圖譜節(jié)點,融合圖譜信息,提出了一種融合了注意力機(jī)制的的圖卷積神經(jīng)網(wǎng)絡(luò)推薦算法。首先構(gòu)建包含商品和屬性的大規(guī)模電商領(lǐng)域知識圖譜,對數(shù)據(jù)進(jìn)行預(yù)處理,在這個基礎(chǔ)上采樣商品鄰域節(jié)點,采取注意力機(jī)制的卷積算法,將重要的屬性信息融合到商品向量中去,并使用采取了負(fù)采樣策略的交叉熵?fù)p失函數(shù)。相比傳統(tǒng)的推薦算法,圖卷積的感知域能有效建模商品的高維距離,提取圖譜節(jié)點的鄰域信息并獲取給定節(jié)點的表示,利用好圖譜上的關(guān)聯(lián)信息能捕捉到潛在的用戶愛好,為預(yù)測結(jié)果提供合理的解釋。我們的模型在真實的推薦數(shù)據(jù)集上與最優(yōu)的基準(zhǔn)模型進(jìn)行對比實驗,實驗結(jié)果證明了其有效性和合理性。

關(guān)鍵詞:電商知識圖譜;圖卷積網(wǎng)絡(luò);推薦系統(tǒng);可解釋性

引言

海量商品數(shù)據(jù)的推薦在電商系統(tǒng)中是一項復(fù)雜的任務(wù),商品數(shù)據(jù)的積累使得信息的篩選變得十分困難,用戶難以在短時間里從龐大的商品庫中找到最適合的商品,而個性化推薦算法的運用就是為了解決這個問題。推薦算法能從用戶行為和商品數(shù)據(jù)中挖掘到有用的信息,幫助用戶更精準(zhǔn)地找到自己需要的商品。推薦算法還能學(xué)習(xí)記錄到用戶的歷史行為,作為推薦數(shù)據(jù)的補(bǔ)充。

目前在電商推薦系統(tǒng)中,協(xié)同過濾是一種經(jīng)典的技術(shù),其思想可以理解為相似的用戶往往青睞同一種類型的商品,具體而言是將用戶和商品以id為基礎(chǔ)進(jìn)行向量化,再通過用戶的行為進(jìn)行相關(guān)相似度的計算,這能較大地提升預(yù)測的準(zhǔn)確性。然而,基于協(xié)同過濾的算法不能很好地解決推薦算法的冷啟動和用戶商品交互的稀疏性問題,為了解決這些問題,人們提出了協(xié)同過濾的改進(jìn)算法,采用了新的思路。基于這一點,知識圖譜的推薦系統(tǒng)]有了很大的發(fā)展,Zhang等人 提出了CKE框架,試圖使用多模態(tài)向量嵌入模型學(xué)習(xí)包括交互和物品信息的編碼,充分融合物品的多個屬性特征,來提高算法的準(zhǔn)確性,缺點是沒有對算法的可解釋性和冷啟動做出貢獻(xiàn),Wang等人提出了RippleNet模型,把用戶視為信息擴(kuò)展的中心,用戶對商品的評分可以被看作是圖譜中的一條路徑,把實體和商品節(jié)點的信息作為知識信息加入,向外層擴(kuò)展并計算相似度,預(yù)測的時候融合各層分?jǐn)?shù)得到最終結(jié)果,但缺點是系統(tǒng)的冷啟動問題仍不能得到有效解決。

基于知識圖譜的推薦算法需要有效建模來自知識圖譜的高維結(jié)構(gòu)信息和語義信息,圖神經(jīng)網(wǎng)絡(luò)是一種將現(xiàn)有神經(jīng)網(wǎng)絡(luò)應(yīng)用到圖數(shù)據(jù)處理的方法,能夠有效地建模結(jié)構(gòu)化數(shù)據(jù),其中圖卷積網(wǎng)絡(luò)(graph convolutional networks)算法能在非歐幾何的空間上進(jìn)行卷積操作,可以聚合鄰域節(jié)點的信息來更新給定實體的表示,這樣的優(yōu)勢使得它能夠用來有效提取圖空間的特征,節(jié)點鄰域蘊(yùn)含有價值的信息,但同時具有很多噪聲節(jié)點,而注意力機(jī)制能夠?qū)?jié)點的重要性進(jìn)行加權(quán),因此,本文提出在知識圖譜上應(yīng)用一種基于圖卷積網(wǎng)絡(luò)和注意力機(jī)制的方法優(yōu)化推薦策略,我們采取了固定大小鄰域作為卷積感知域的采樣方式,并使用三種不同的聚合策略。該算法的主要工作如下:

1、以有向圖的方式構(gòu)建了推薦商品知識圖譜,建模了用戶商品節(jié)點和屬性的關(guān)系

2、提出在卷積感知域中融合注意力機(jī)制的推薦算法KGACN(knowledge graph based graph attention and convolutional network),將用戶商品交互信息和商品屬性進(jìn)行融合,充分利用節(jié)點鄰域的信息,提高了預(yù)測的性能。

3、在真實數(shù)據(jù)集上進(jìn)行了對比實驗,根據(jù)F1,AUC等指標(biāo)以及可解釋性分析,證明了該算法的有效性。

1相關(guān)工作

1.1知識圖譜

知識圖譜最早在2012被谷歌提出,最早被應(yīng)用于提升搜索引擎性能,,通過引入知識信息提高用戶搜索的質(zhì)量。知識圖譜的發(fā)展基于人們的一個認(rèn)識,即可以使用圖來表示數(shù)據(jù),也可以使用圖的方式來強(qiáng)化數(shù)據(jù)應(yīng)用,其在工業(yè)界的發(fā)展,逐漸引起了學(xué)術(shù)界的重視。在這之前的人們一直在探索有效的數(shù)據(jù)驅(qū)動和應(yīng)用方法,讓機(jī)器能直接理解使用數(shù)據(jù)。而知識圖譜的本質(zhì)作為一種語義網(wǎng)絡(luò),由各種代表實體和概念的節(jié)點以及代表不同節(jié)點之間關(guān)系的邊組成,其構(gòu)建來自于非結(jié)構(gòu)化、結(jié)構(gòu)化的知識,在多個來源構(gòu)成的大規(guī)模知識體系的構(gòu)建、存儲和推理應(yīng)用場景中都有用武之地。基于圖結(jié)構(gòu)存儲的數(shù)據(jù)形式,能形象地來表達(dá)真實世界中各種事物的關(guān)系。

在電商采購領(lǐng)域中,知識圖譜有著大量的真實應(yīng)用場景,每天都有大量的商品信息的更新,知識圖譜提供一種全新的存儲和管理模式,同時由于語義網(wǎng)絡(luò)的連接,能豐富商品自身的信息,加強(qiáng)商品信息的表達(dá)。一個完整的知識圖譜由各種三元組(h,r,t)構(gòu)成,三元組的頭尾節(jié)點h,t代表圖譜中的實體,關(guān)系r是知識圖譜中的邊。

1.2圖神經(jīng)網(wǎng)絡(luò)

傳統(tǒng)的深度神經(jīng)網(wǎng)絡(luò)如CNN,RNN在解決歐式空間的數(shù)據(jù)取得了很好的效果,但是針對圖結(jié)構(gòu)數(shù)據(jù)的建模卻需要一種新的方法去解決,圖G的定義可以用(V,E)來表示,其中V代表其中的圖上的節(jié)點,E代表節(jié)點之間的聯(lián)系,圖神經(jīng)網(wǎng)絡(luò)作為一種直接作用到圖結(jié)構(gòu)上的神經(jīng)網(wǎng)絡(luò),可以學(xué)習(xí)到圖結(jié)構(gòu)的特征,獲取圖節(jié)點的嵌入表示,應(yīng)用到下游任務(wù)如鏈接預(yù)測和節(jié)點分類等任務(wù)中可以有效地緩解系統(tǒng)的冷啟動問題并提升預(yù)測和排序效果。圖卷積網(wǎng)絡(luò)相比復(fù)雜的深度學(xué)習(xí)模型具有更加清晰的信息傳導(dǎo)特性。

1.3注意力機(jī)制

注意力機(jī)制和人認(rèn)識事物的原理有異曲同工之妙,基本思想是人大腦思考的資源是有限的,大腦增強(qiáng)資源利用率的的方法并不是主動濾過噪聲信息,而是會優(yōu)先將注意力分配到重要的事物之上,來提升信息處理的效率。注意力機(jī)制最早被應(yīng)用于機(jī)器翻譯領(lǐng)域,后來在自然語言處理領(lǐng)域和其他神經(jīng)網(wǎng)絡(luò)模型中得到了廣泛應(yīng)用。我們在具體實踐中可以把注意力機(jī)制理解一種為對向量進(jìn)行加權(quán)求和的方式。多數(shù)都是采取一種統(tǒng)一的運算框架來計算注意力分?jǐn)?shù)。

假設(shè)有三個輸入向量,分別是值向量Value:∈R和查詢向量query ∈R,鍵向量Key∈R,首先計算查詢向量和鍵向量之間的相似度分?jǐn)?shù)Sim

將分?jǐn)?shù)傳入softmax層,計算每一位對應(yīng)的權(quán)重,一方面可以進(jìn)行歸一化,另一方面可以通過softmax的機(jī)制增加對重要的信息賦予的權(quán)重。

得到權(quán)重系數(shù)后,對值向量進(jìn)行加權(quán)求和,

注意力機(jī)制可以對知識圖譜上節(jié)點的鄰域節(jié)點給予不同程度的關(guān)注。

2基于圖注意力卷積神經(jīng)網(wǎng)絡(luò)的知識圖譜推薦算法

2.1 問題建模

基于電商場景的知識圖譜推薦場景可以如下方式描述:已知擁有大小為M的用戶集合U{u,u,u,u,….,u},數(shù)量大小為N的商品集合V{v,v,v,v,…,v},用戶和商品交互矩陣為Y? 其中Y[i][j]=1代表以用戶ui選擇了商品v,在用戶和商品數(shù)據(jù)基礎(chǔ)上,我們構(gòu)建了以商品知識圖譜K,該圖譜由一系列三元組構(gòu)成,商品具有品類、品牌等關(guān)系和屬性,頭尾節(jié)點對應(yīng)商品sku及其各項屬性值,關(guān)系對應(yīng)商品的屬性,用戶交互可表示為(user,choose,item)的形式,同樣可以通過三元組的形式添加在知識圖譜中。

給定用戶商品交互矩陣Y和知識圖譜Kg,我們的目標(biāo)是預(yù)測任意用戶u是否對一個商品v具有潛在的喜好,假定該商品在之前從未被用戶接觸過。即本文提出的算法目標(biāo)是學(xué)習(xí)一個預(yù)測函數(shù):

其中p是用戶u喜愛商品v的概率分?jǐn)?shù),args為模型參數(shù)

2.2網(wǎng)絡(luò)設(shè)計

模型由三個模塊組成,第一是圖的構(gòu)建,根據(jù)原始數(shù)據(jù)構(gòu)建用戶商品的鄰接圖,第二是使用融合注意力機(jī)制的圖卷積網(wǎng)絡(luò)生成節(jié)點的表示,注意力機(jī)制能將固定數(shù)量的鄰域節(jié)點特征進(jìn)行加權(quán)融合,挖掘出和用戶喜好密切相關(guān)的屬性信息。

2.3 基于圖卷積神經(jīng)網(wǎng)絡(luò)的圖譜推薦系統(tǒng)

2.3.1、構(gòu)建圖譜

首先構(gòu)建以商品和商品屬性的知識圖譜,并檢查商品屬性是否符合要求。

2.3.2、預(yù)處理層

對原始數(shù)據(jù)進(jìn)行預(yù)處理,包括對商品和用戶結(jié)點分配標(biāo)識符,并構(gòu)造id唯一的字典,同時提取商品中屬性,我們將屬性同樣視作具有獨一id的結(jié)點,將商品屬性和商品,用戶屬性和用戶作為三元組的頭尾結(jié)點導(dǎo)入到圖譜中。在構(gòu)造好的圖譜里,包括用戶到商品再到商品屬性的路徑和結(jié)點鄰域信息,這些信息將作為后續(xù)的模型輸入。

2.3.3、嵌入層:

嵌入層的作用在于提煉用戶、商品對應(yīng)的特征,首先要根據(jù)構(gòu)建相關(guān)字典獲取統(tǒng)計信息,以詞袋向量或獨熱向量等方式構(gòu)建預(yù)編碼的高維度向量,接著通過嵌入層轉(zhuǎn)換為低維稠密向量,每個結(jié)點的嵌入向量蘊(yùn)含了該節(jié)點的特征,將該嵌入層向量輸入到其他隱藏層后,輸入模型進(jìn)行帶有注意力機(jī)制的卷積操作。

2.3.4、注意力卷積層:

考慮到實際圖譜中不同節(jié)點的鄰域差別很大,以致于引入太多不匹配的節(jié)點會對計算過程產(chǎn)生了非常大的噪音和干擾,所以我們采取固定數(shù)量的采樣策略,對一階鄰域節(jié)點進(jìn)行卷積操作,并通過注意力機(jī)制賦予結(jié)點不同的權(quán)重。

2.3.5、節(jié)點聚合函數(shù)

在進(jìn)行歸一化之前我們執(zhí)行三種不同三種聚合策略:

1、節(jié)點特征和其鄰域特征相加(KGACN-sum)

2、節(jié)點特征和其鄰域特征進(jìn)行拼接(KGACN-concat)

3、只保留節(jié)點鄰域特征(KGACN-neighbor)

2.3.6、損失函數(shù)

我們認(rèn)為正例和負(fù)例樣本都有價值,因此采取了負(fù)采樣的訓(xùn)練策略,并添加L2正則項,損失函數(shù)定義如下:

其中CE是交叉熵?fù)p失函數(shù),u為用戶,N為負(fù)樣本綜述,P為一個負(fù)樣本集合。

3實驗分析

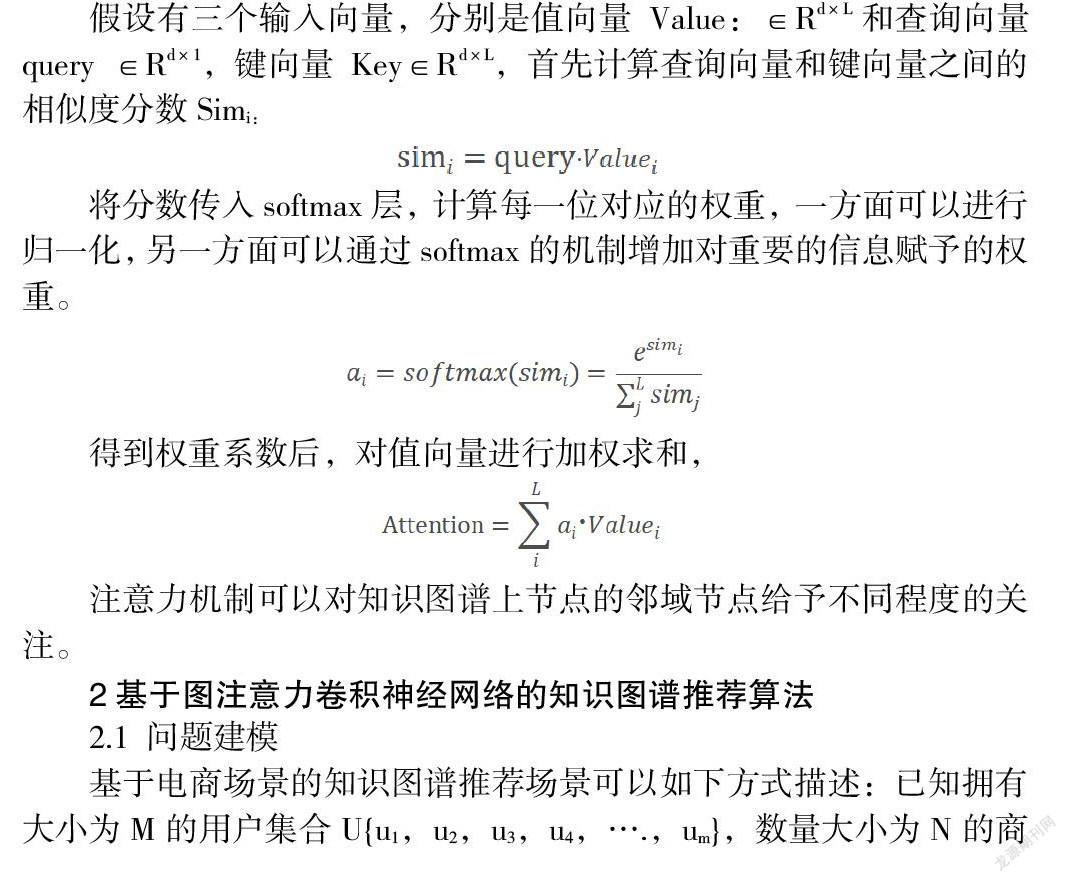

3.1數(shù)據(jù)集與評測分析

我們構(gòu)建了電商場景下的推薦數(shù)據(jù)集Caigou-recommend,其中共涉及大約二十萬用戶和一百余萬的商品數(shù)據(jù)。與之對比的公開數(shù)據(jù)集MoviesLens是一個廣泛使用的電影推薦領(lǐng)域的基準(zhǔn)數(shù)據(jù)集,總共包含超過兩千萬電影網(wǎng)站的評分,最大的數(shù)據(jù)集使用約14萬用戶的數(shù)據(jù),并覆蓋了27,000部電影。另外一個數(shù)據(jù)集LastFM是一個在線音樂推薦數(shù)據(jù)集,包含兩千用戶和近四千首音樂。

和公開數(shù)據(jù)集相比,電商推薦數(shù)據(jù)有一個特點,即具有更低的評價密度,電商推薦場景下用戶對商品的交互行為包括瀏覽點擊收藏和購買,對商品的關(guān)注僅限于特定商品和類型,因此交互具有稀疏性,評價密度較低。

評價密度可以理解為每個用戶評價商品的數(shù)量的平均數(shù),假設(shè)每個用戶對每個商品都進(jìn)行了評價,那么評價密度將是最高的百分之百。如果沒有任何用戶對商品進(jìn)行過評價,則評價密度為0%。

3.2評價指標(biāo)

我們的實驗采用了兩個指標(biāo)。

F1:一種衡量分類任務(wù)的指標(biāo),指精確率和召回率的調(diào)和平均值,

其中精確率p是指在測試集中所有被預(yù)測為正類的數(shù)據(jù)中實際為正類且被預(yù)測為正類的數(shù)據(jù)所占的比例,召回率r是指在測試集中所有實際為正類的數(shù)據(jù)中實際為正類且被預(yù)測為正類的數(shù)據(jù)所占的比例。在推薦算法評估中,f1值越高,預(yù)測效果越好。

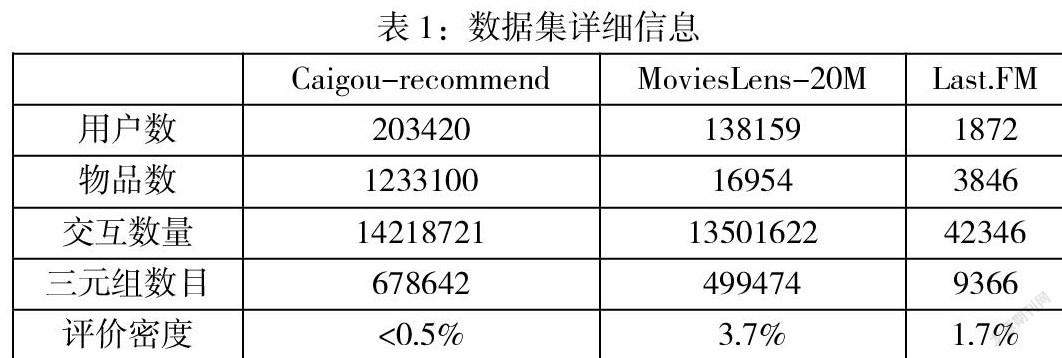

AUC:也是一種衡量二分類模型性能的指標(biāo),首先要知道接收者特征操作曲線(roc曲線),roc曲線的橫坐標(biāo)是模型的偽陽性率,縱坐標(biāo)是模型的真陽性率,通過改變模型判定為正例的閾值,我們可以獲得一組點的坐標(biāo),從而畫出roc曲線,由原理可知,roc曲線越接近左上角則模型在較高真陽性率的同時能保持低的偽陽性率,因此,roc曲線方面積即AUC,代表著模型對正負(fù)樣本的區(qū)分能力,auc越高,模型預(yù)測效果越好。

3.3對比模型

SVD:一種基于矩陣分解的技術(shù),在推薦系統(tǒng)中主要是在協(xié)同過濾的時候利用SVD分解將數(shù)據(jù)映射到低維空間,在計算相似度的時候能消去噪聲,減少計算量。

LIbFM:基本思想來自于經(jīng)典的SVD矩陣分解,將SVD模型擴(kuò)展到了多特征的情況,通過特征交叉的方式解決了數(shù)據(jù)稀疏場景下的組合特征問題,

LibFM-TransE:通過知識嵌入模型TransE加強(qiáng)了知識表示,提升了LibFM的性能。

CKE:在協(xié)同過濾的基礎(chǔ)上提出一種聯(lián)合多源知識信息的聯(lián)合框架,能學(xué)習(xí)到用戶和商品的嵌入向量,額外信息的利用能有效緩解協(xié)同過濾中數(shù)據(jù)的稀疏問題。

RippleNet:也是一種基于圖譜的推薦方法,考慮到用戶偏好的傳播路徑,以用戶點擊過的實體為中心擴(kuò)散,形成某種在圖譜上傳播的漣漪,最終呈現(xiàn)出用戶重點關(guān)注的區(qū)域分布,圖譜中實體傳播到另外一個實體的元路徑能反映用戶對多跳實體的潛在偏好。

3.4參數(shù)設(shè)置

我們的超參數(shù)設(shè)置如下。對于SVD模型,我們的學(xué)習(xí)率lr=0.5,嵌入向量維度D=16,對于兩種LibFM,lr=0.1,D=16,其中transe對應(yīng)的向量維度d=32,對于CKE模型,嵌入向量維度D=32,學(xué)習(xí)率lr=0.5,對于Ripplenet模型,D=8,多跳路徑長度H=2,學(xué)習(xí)率lr=0..01,其他超參數(shù)和原始模型代碼保持一致。對于KGACN 模型,D=16,鄰域采樣大小K=4,學(xué)習(xí)率lr=0.01。

3.5實驗結(jié)果與分析

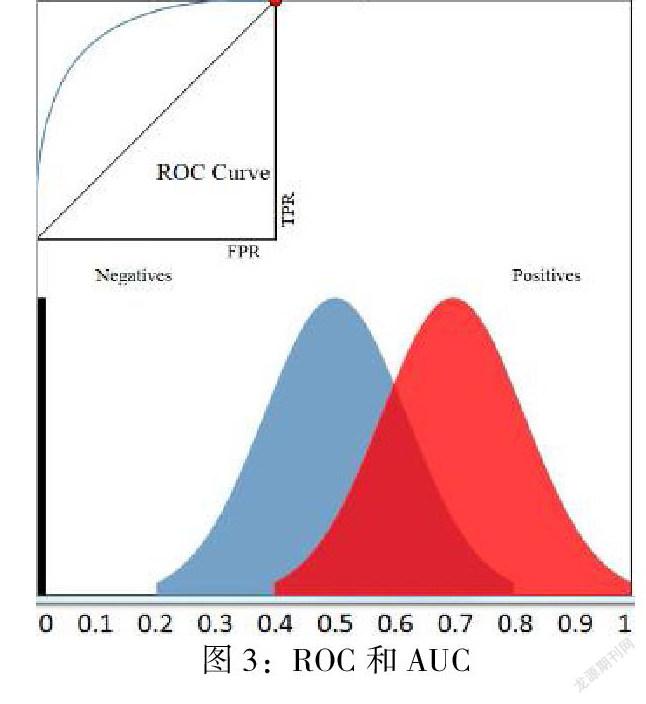

3.5.1不同模型對比效果

根據(jù)實驗結(jié)果我們注意到,基于圖譜的SVD和LibFM模型雖然只是基礎(chǔ)模型,但是表現(xiàn)要比同等的CKE模型取得更好的效果,這意味著CKE模型并不能充分利用到知識圖譜的信息。

LibFM+TransE模型比LibFM表現(xiàn)更好,這證明知識圖譜信息的引入,使得模型可以在圖譜上做表示訓(xùn)練,將有助于推薦性能的提升。

和其他基本模型相比Ripplenet表現(xiàn)有較大提升,該模型同樣利用到了圖譜中的多跳鄰域結(jié)構(gòu),因此能夠有效建模對推薦算法來說很重要的鄰接距離信息。

KGACN模型的表現(xiàn)超過前面的對比模型,這是因為模型不僅應(yīng)用了鄰域信息,同時考慮到鄰域信息提取的影響,對固定數(shù)量的商品鄰域結(jié)點進(jìn)行采樣減少了模型計算的復(fù)雜度和噪聲干擾,同時注意力機(jī)制也更有益于捕獲對用戶來說重要的偏好。此外,在三種聚合方式中,采取拼接的辦法聚合鄰域信息具有最好的效果。

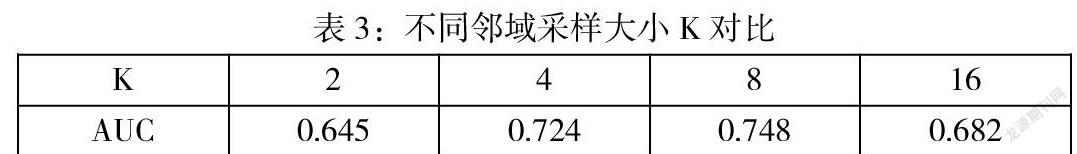

3.5.2鄰域采樣大小對比

我們發(fā)現(xiàn)在KGACN模型在K=8的時候表現(xiàn)最好,這是因為太小的采樣面積使得模型不能學(xué)習(xí)到充分的鄰域信息,而太大的采樣面積會引入太多噪聲,影響模型效果

3.5.3 嵌入向量維度大小對比

我們也針對不同的嵌入層維度做了對比測試,實驗發(fā)現(xiàn)在D=32的時候模型的表現(xiàn)最好,因為一般來說嵌入層向量維度大小代表著模型將能學(xué)習(xí)到的信息深度,越大自然能學(xué)習(xí)到關(guān)于商品和用戶的越多信息,然而太大的嵌入層會使得模型過擬合。

3.5.4可解釋性分析

基于知識圖譜的推薦系統(tǒng)彌補(bǔ)了協(xié)同過濾方法的不足,通過引入知識內(nèi)容豐富了模型的信息,知識圖譜中從用戶節(jié)點到商品節(jié)點的元路徑提高了模型的可解釋性。

4總結(jié):

本文提出了基于知識圖譜的注意力卷積圖神經(jīng)網(wǎng)絡(luò)算法KGACN。卷積圖神經(jīng)網(wǎng)絡(luò)能夠在知識圖譜上融合節(jié)點鄰域的信息,學(xué)習(xí)到更佳的實體表示,而注意力機(jī)制能分辨不同節(jié)點所體現(xiàn)出來的權(quán)重,賦予模型過濾不重要信息的能力。此外,知識圖譜的節(jié)點之間具有大量的聯(lián)系,在建立了商品到商品,商品到屬性的關(guān)系之后,有助于提升推薦算法的呈現(xiàn)給用戶的結(jié)果的多樣性。

本文主要以商品端為中心來提升推薦算法的效果,后續(xù)將考慮從用戶端信息入手,同時研究更有效的知識圖譜信息融合算法,以更進(jìn)一步地挖掘出框架的潛能。

參考文獻(xiàn)

[1]Jin Huang,Wayne Xin Zhao,Hongjian Dou,Ji-Rong Wen,and Edward Y Chang.2018. Improving Sequential Recommendation with Knowledge-Enhanced Memory Networks. In the 41st International ACM SIGIR Conference on Research &

[2]Development in Information Retrieval. ACM,505–514.Thomas N Kipf and Max Welling. 2017. Semi-supervised classification with graph convolutional networks. In the 5th International Conference on LearningRepresentations.

[3]Hongwei Wang,Jia Wang,Miao Zhao,Jiannong Cao,and Minyi Guo. 2017. Joint Topic-Semantic-aware Social Recommendation for Online Voting. In Proceedings of the 2017 ACM on Conference on Information and Knowledge Management. ACM,347–356.

[4]HongweiWang,F(xiàn)uzheng Zhang,Min Hou,Xing Xie,Minyi Guo,and Qi Liu. 2018 SHINE:signed heterogeneous information network embedding for sentiment link prediction. In Proceedings of the 11th ACM International Conference on Web Search and Data Mining. ACM,592–600.

[5]Yehuda Koren. 2008. Factorization meets the neighborhood:a multifaceted collaborative filtering model. In Proceedings of the 14th ACM SIGKDD International Conference on Knowledge Discovery and Data Mining. ACM,426–434.

[6]Petar Velickovic,Guillem Cucurull,Arantxa Casanova,Adriana Romero,Pietro Lio,and Yoshua Bengio. 2018. Graph attention networks. In Proceedings of the 6th International Conferences on Learning Representations.

[7]Antoine Bordes,Nicolas Usunier,Alberto Garcia-Duran,Jason Weston,and Oksana Yakhnenko. 2013. Translating embeddings for modeling multi-relational data. In Advances in Neural Information Processing Systems. 2787–2795.

[8]Fuzheng Zhang,Nicholas Jing Yuan,Defu Lian,Xing Xie,and Wei-Ying Ma.2016. Collaborative knowledge base embedding for recommender systems. In Proceedings of the 22nd ACM SIGKDD International Conference on Knowledge Discovery and Data Mining. ACM,353–362.

[9]Hongwei Wang,F(xiàn)uzheng Zhang,Jialin Wang,Miao Zhao,Wenjie Li,Xing Xie,and Minyi Guo. 2018. RippleNet:Propagating User Preferences on the Knowledge Graph for Recommender Systems. In Proceedings of the 27th ACM International Conference on Information and Knowledge Management. ACM.

[10]Petar Velickovic,Guillem Cucurull,Arantxa Casanova,Adriana Romero,Pietro Lio,and Yoshua Bengio. 2018. Graph attention networks. In Proceedings of the 6th International Conferences on Learning Representations.