AI手語主播的技術(shù)可供性:代償性機制下認知重構(gòu)的發(fā)展版圖

喻國明?傅海鑫

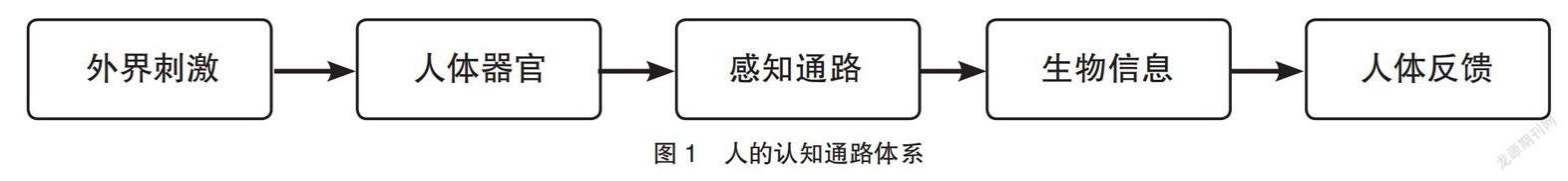

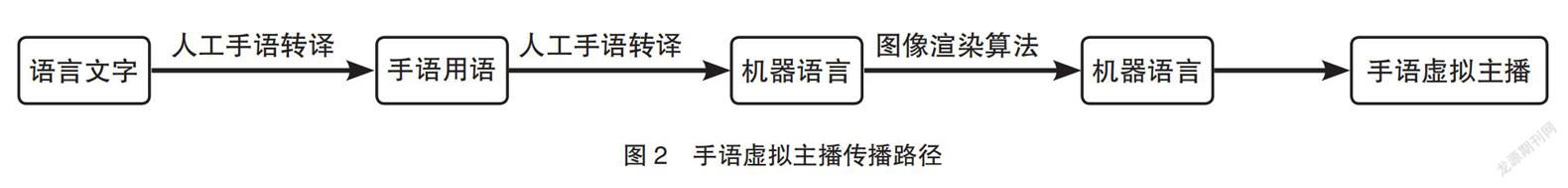

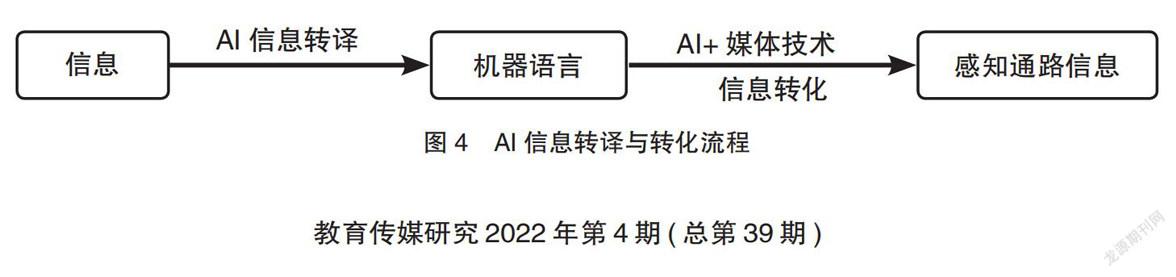

【內(nèi)容摘要】本文以聽覺障礙在AI技術(shù)的框架內(nèi)的解決方案為例,探討了未來傳媒發(fā)展的“聚合”邏輯。首先,探討了AI手語主播的技術(shù)可供性,闡釋了人的多感官認知系統(tǒng)與認知障礙的彌補代償機制下認知重構(gòu)的發(fā)展版圖;其次,考察了AI手語主播的技術(shù)迭代的演進邏輯,并論證了AI手語直播在聽覺認知彌合的未來發(fā)展中的升級版圖。指出,傳統(tǒng)媒介對個體的賦權(quán)總是以分割感官為前提的,個體很難在媒介世界中獲得如同真實個體般的全感官體驗,無法實現(xiàn)人的“感覺總體”回歸 。但是在全要素整合的AI互聯(lián)網(wǎng)系統(tǒng)中,人類將在媒介中得到全感官復制的體驗,感受到 “鏡像”般的數(shù)字孿生世界。

【關(guān)鍵詞】媒介;無障礙信息傳播;技術(shù)可供性;AI手語主播

傳播場域如今面臨巨大變局,唯有洞見傳播的核心概念“媒介”之內(nèi)核,厘清媒介技術(shù)演化的中心邏輯,才能準確定位傳播的其他問題。

在麥克盧漢的“延伸觀”及萊文森的“補償觀”中,均顯示了媒介觀中最核心的觀點,即認可媒介的人本主義,強調(diào)媒介演進的邏輯起點是人類本身。如彼得斯所言,媒介技術(shù)的發(fā)明與應用之動力來源都是人類對自我與他人、私人與公共、內(nèi)心思想與外在語詞之間的“交流”的渴望。①以人類視角反觀媒介演進史,可以發(fā)現(xiàn)它實際是一段人類實踐半徑不斷擴大的歷史。②把握人類自由度的拓展之勢,即是把握了媒介技術(shù)演進的內(nèi)在規(guī)律。這其中當然也包括媒介技術(shù)的進化史,實際上也是一部對于人的感官通路障礙不斷打通的歷史。……