基于Faster-RCNN的古籍圖像文字檢測研究*

謝恩澤 吳 政 倪 劼

0 引言

我國是歷史悠久的文化古國,現存古籍文獻浩瀚如海,而圖書館作為古籍文獻重要收藏單位,利用數字化方式開展古籍文獻保護,是其重要的工作職責。在十四五時期,國家也對古籍數字化工作提出了更高的要求,明確要加快數字化發展,加強古籍保護利用研究[1]。然而,若要推動古籍數字化工作走向更高的臺階,古籍圖像文字檢測與識別是其中最重要的內容之一。其中,古籍圖像文字檢測是識別的基礎,利用信息技術手段,快速、高效實現古籍圖像單個文字檢測,這對古籍數字化工作具有重要意義。

很長一段時間以來,我國學者們都是利用傳統圖像處理技術實現古籍圖像中的文字檢測。例如,吳國新等人提出根據文字特征,利用投影法實現古籍中的東巴文檢測[2]。蘇向東依據圖像水平投影對古籍蒙文進行列切分,然后根據最大連通域實現圖像中的字切分[3]。張國鋒通過運用傳統圖像處理基礎中的投影法和連通域法,對貴州地區水書古籍文獻實現了文字切分[4]。李小璐采用圖像二值化、數學形態學處理、邊緣檢測和連通域分析相結合的方式,實現了西夏古籍圖像中的文字分割[5]。黃娟根據古籍中的文字特點,設計了一種不規則自適應局部檢索區域的圖像檢索算法,實現了古籍圖像中的漢字提取[6]。倪劼則是根據古籍文獻漢字呈現的特征,借鑒流水模式的思路,提出一種基于傳統圖像處理技術的古籍文獻漢字切分新方式,并命名為流水算法[7]。齊艷媚等人針對古籍漢字中的復雜性,引入猶豫模糊集理論,提出了一種古籍漢字圖像檢索模型[8]。諸如利用傳統圖像算法雖然能夠解決一般情況下的古籍文字檢測,但每一種傳統圖像算法,都需要依賴人工設計的提取器,這要求設計者具有較高的專業知識,算法還需要經歷一個復雜的調參過程,并且大多數算法都是針對某一項特定場景的應用,造成算法的泛化能力及魯棒性不強。

隨著深度卷積神經網絡在圖像處理方面取得顯著的進展,近年來利用深度學習技術實現圖像目標檢測受到了廣泛關注。深度學習的目標檢測算法主要分為One-Stage和Two-Stage兩類,以YOLO為代表的One-Stage算法直接通過主干網絡給出類別和位置信息,具有較快的檢測速度,但是相對Two-Stage算法,目標檢測精度略低,且更適合圖像中的大目標檢測,主要應用于視頻圖像檢測。而Two-Stage更適合靜態圖像的處理,Faster-RCNN便是其中性能最為優秀的算法之一,自問世以來就引起很多行業研究人員的重視。例如,艾曼通過自建數據集,實現了基于Faster-RCNN算法的汽車車牌檢測[9]。雷磊等人利用Faster-RCNN模型對患者進行腫瘤目標識別及分類,實現了肝細胞肝癌與肝內膽管細胞癌的影像識別及分類模型應用[10]。魏業文等人提出一種改進的Faster-RCNN算法,并對模型進行參數調優,提高了輸電線路智能巡檢中的識別精度與響應速度[11]。祝文韜等人在Faster-RCNN算法基礎上,提出了一種基于雙線性插值的改進方案,實現了飛機目標檢測,并提高了精度和準確率[12]。王志遠等人先通過圖像處理技術,再利用Faster-RCNN模型,成功實現了農業種植中蘋果葉部圖像的三種病害檢測[13]。

綜上所述,可以看到當前很多行業已大量運用Faster-RCNN算法實現目標檢測的智能化處理,但這在公共圖書館還未引起足夠重視,尤其是在古籍數字化工作中,還沒有被廣泛應用。因此,本文擬根據采集到的古籍圖像進行人工樣本標注,構建古籍圖像文字數據集,并嘗試通過運用Faster-RCNN算法對這些數據集進行訓練,并對實驗結果展開測試和驗證,以實現古籍圖像文字的精準檢測。

1 Faster-RCNN算法及其結構

Faster-RCNN是在RCNN和Fast-RCNN基礎上,利用RPN(Region proposal network)網絡替代傳統的Selective Search算法,使得效率有了很大的提升。RPN的本質是基于滑窗的無類別目標檢測器。作為Faster-RCNN最重要的部分,RPN階段創新性的提出了anchor概念,通過不同的anchor尺寸,實現了目標檢測中的多尺度方法,使得候選框的生成更加的科學,并且大幅提升了候選框生成的效率和準確性。

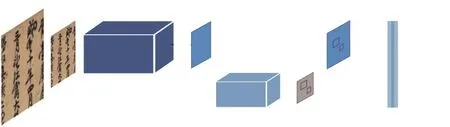

可以將Faster-RCNN看做是RPN和Fast-RCNN兩個部分的結合,這將使得目標檢測中的特征圖提取、感興趣區域、目標分類、目標定位融合到深度神經網絡中,并且由GPU來完成全部運算,真正實現端到端的目標檢測。因為在整個過程中,先要產生候選區域,再對候選區域進行分類以及位置精修,所以Faster-RCNN是一種典型的Two-Stage檢測算法,結構如圖1所示。

圖1 Faster-RCNN結構

由圖1可以看出,Faster-RCNN的整個過程如下:首先,將輸入圖片壓縮后送入骨干網絡,通過卷積層提取圖片的特征,即feature maps;其次,特征圖經過區域提名網絡,即RPN網絡,輸出多個候選區域;第三,與Fast-RCNN相同,輸入輸出感興趣池化層,即ROI pooling;最后,通過展平全連接層對目標進行分類和確定精確位置。

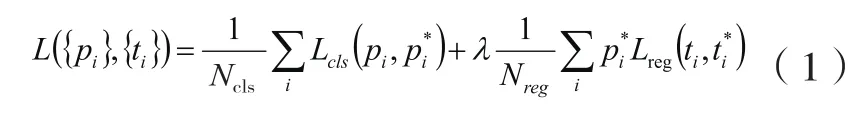

由于Faster-RCNN由RPN和Fast-RCNN兩部分組成,所以損失函數也包括RPN的損失和Fast-RCNN的損失,并且兩部分都包括分類損失和回歸損失,四個損失相加就是最后的總體損失,即總體Loss值,用于反向傳播更新參數,具體如公式(1)所示。

從公式(1)中可以看到,“+”號左邊部分為分類損失,右邊部分為回歸損失。

2 研究對象選定思考

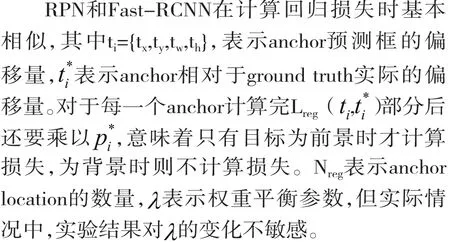

本次是以南京圖書館所藏《胥臺麋鹿記》作為研究對象,該文獻作為近代研究太平天國時期重要文史資料,具有很高的歷史價值。通過人工拍攝方式獲取古籍文獻圖像,拍攝時采用固定角度,在古籍文獻正上方50厘米處高度架設拍攝器材,最終獲取圖片樣本26張,采集圖片分辨率為1326 *2382像素,具體樣本見圖2所示。由圖2可以看出,該文獻為手抄版本,頁面整體保存情況良好,有輕微的的破損、污漬現象。文獻為古籍傳統豎式排列,每頁十多列約500字,頁面中文字密度較大,且存在涂改、印章等情況,以此作為古籍圖像文字檢測研究,具有一定的參考價值。

圖2 研究樣本

首先,頁面狀態復雜。從古籍文獻本身質量來看,由于保存年代較久,受到多種因素影響,文獻本身質量并不會像現代印刷品,頁面會出現污漬、破損、殘缺等現象。其次,從古籍內容的排列方式來看,由于沒有統一的書寫和印刷標準,內容排列方式也多種多樣。第三,從古籍的版本類型來看,有刻本、抄本、拓本、字帖等,其中在手寫抄本頁面中,文字會存在更多的連筆、字體粘連、交錯、重疊等情況。最后,很多古籍文獻中還會有印章、題跋、涂抹、修改的情況出現。這些都使得古籍文獻頁面呈現復雜狀態,為最終文字檢測造成很大難度。

其次,檢測目標密集。與其他圖像目標檢測有所不同,古籍圖像文字呈現密集狀態。在一張古籍文獻圖像中,可能存在幾十到幾百個文字目標,檢測的目標較多,且目標較小。本文試圖通過優化的Faster-RCNN算法檢測圖像中的文字。卷積神經網絡在處理目標檢測任務時,能夠很好的使復雜問題簡單化,將大量圖像信息降維成少量的信息再做處理。正常情況下,這樣的降維不會對結果產生較大影響。然而,在進行古籍圖像文字檢測時,與一般圖像目標檢測任務有很大不同。一張圖像中可能存在大量的目標,并且每個目標占據的像素很少,在卷積神經網絡對圖像信息進行降維后,每個文字所占的像素就會更低,使得目標邊緣信息模糊,導致檢測難度較大。

最后,缺少公共數據集。因Faster-RCNN是一種有監督學習的算法,需要將樣本進行標注,通過對標注樣本訓練,才可以得到一個最優模型。與無監督學習算法不同,Faster-RCNN可以更好的衡量算法的精確度,而缺點就是需要有大量的標注數據進行訓練。目前,圖像目標檢測領域有很多可以使用的公用數據集,如COCO、ImageNet、PASCAL VOC等,但這些數據集一般來說是對普通常見目標進行檢測,如人、動物、植物、汽車等,并且目標為普通大小尺寸,并不會出現目標過大或者過小的情況。而古籍圖像文字檢測,由于其文獻特殊性,并不會有公用數據集出現,因此需要自己構建相關數據集,用于數據訓練和檢測。由于本次實驗內容是檢測古籍圖像中的文字目標,所以最終數據集僅需要做二分類標注。數據集樣本的數量大小將會對最終的結果產生影響,為了提升檢測精度,自建數據集時還要考慮到樣本多樣性。

3 對Faster-RCNN算法調優與訓練

Faster-RCNN骨干網絡的主要作用是提取輸入圖像的特征圖。隨著網絡結構的不斷加深,下采樣卷積核的感受野會同時增加,可以采集到更加豐富的圖像局部信息。Faster-RCNN采用Vgg16作為骨干網絡,Vgg16因其深度只有16層,運行速度很快,但是精度并不理想。本文嘗試檢測古籍圖像中的文字,使得對速度要求并不是十分敏感,但是對精度要求較高,通過綜合權衡現有常見的骨干網絡,最終將選擇結構更深的ResNet101作為骨干網絡,在此網絡架構上對參數進行調整優化,并且通過實驗對Vgg16和ResNet101的結果進行比較研究,以使訓練達到預期效果。

3.1 調整anchor參數

在Faster-RCNN原算法的RPN部分,使用了三種尺寸(128,256,512),三種寬高比(0.5,1,2),因此共產生9種anchor。由于古籍圖像中的文字與公共數據集中給出的檢測目標不同,為了得到更好的文字檢測結果,需要對anchor的參數進行調整,以便能夠適應圖像中的小目標、多目標。根據對獲取古籍圖像中的文字進行分析,將最終anchor大小修改為(8,16,32),寬高比修改為(0.4,1,2.5)。

3.2 多尺寸融合訓練

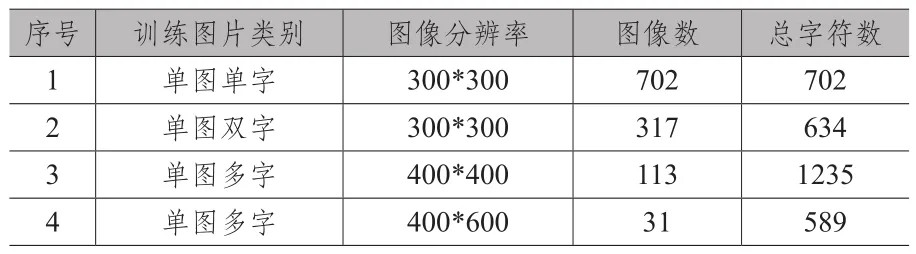

本次實驗通過人工標注的方式,開展古籍圖像文字檢測訓練,具體如表1所示。

表1 訓練數據詳細列表

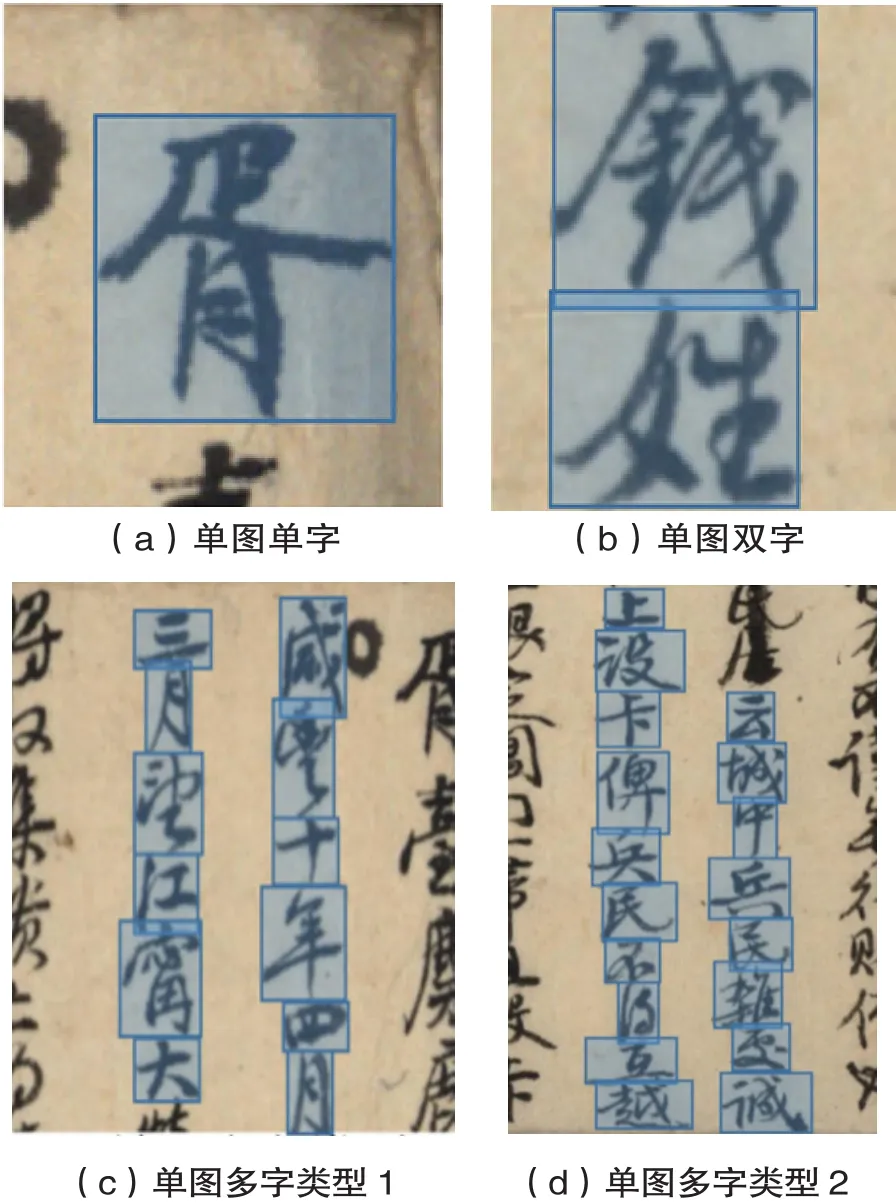

訓練數據集采用不同分辨率、不同標注集的方法,這是為了在深度學習過程中,通過樣本多樣性加強對不同類型圖像能有較強的檢測能力,從而提升檢測精度。最終標注訓練圖片1163張,總訓練字符數量3160個。訓練圖片類別如圖3(a)—圖3(d)所示。

圖3 訓練圖片類別

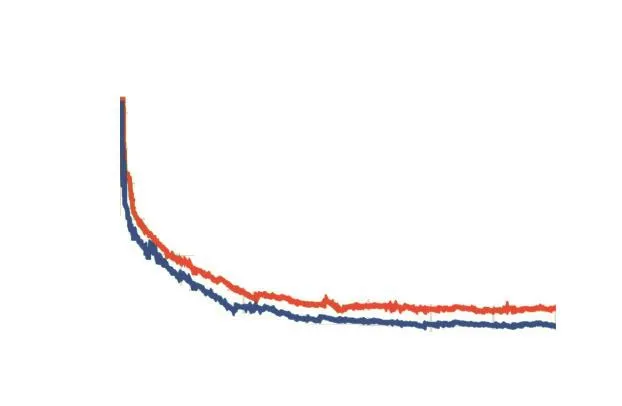

為了比較不同骨干網絡的檢測結果,本次使用Vgg16和ResNet101骨干網絡分別對樣本進行訓練,迭代次數均為70 000次,最終總體Loss值如圖4所示。圖中橙色曲線表示Vgg16,藍色曲線表示ResNet101,x軸表示訓練迭代次數,y軸表示Loss值。從圖中可以看出,兩種骨干網絡隨著訓練次數的增加,都呈現了逐步收斂現象,最終Loss值都能達到一個比較理想的狀態,ResNet101由于網絡層次更深,表現優于Vgg16。

圖4 訓練損失曲線比較

4 古籍圖像文字實驗檢測效果

本文采用Tensorflow2.0作為實驗的基礎框架,通過優化后的Faster-RCNN算法開展古籍圖像文字檢測。實驗環境操作系統為Ubuntu 16.04,CPU為Intel Core i7-8700,GPU為RTX1080Ti,Python版本為Python3.7,內存為16 G。

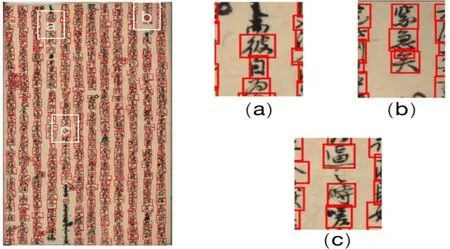

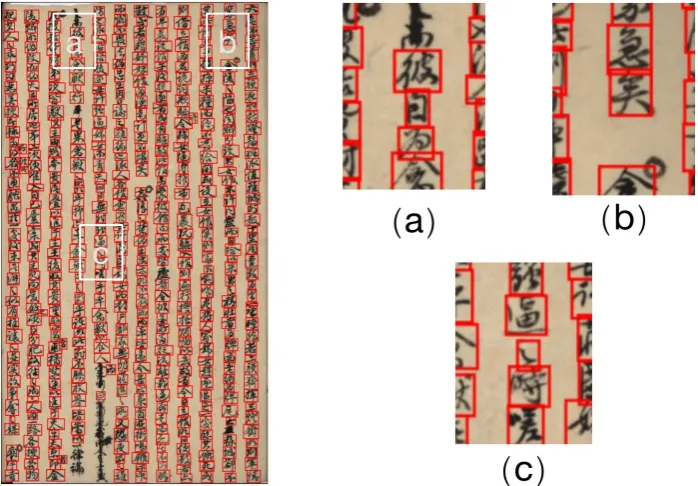

實驗結果采用標框方式,標注檢測到的文字目標。為了比較不同骨干網絡的檢測效果,分別對Vgg16和ResNet101兩種骨干網絡進行實驗,最終古籍圖像文字檢測效果如圖5和圖6所示。

圖5 使用Vgg16骨干網絡檢測結果(a)正確檢測 (b)過檢測 (c)漏檢測

圖6 使用ResNet101骨干網絡檢測結果(a)正確檢測 (b)正確檢測 (c)正確檢測

從優化后的Faster-RCNN算法在利用Vgg16骨干網絡進行古籍圖像文字檢測效果看,其中圖5(a)準確檢測到了其中的文字,上半部涂改部分則被準確的忽略掉。圖5(b)顯示存在過檢測現象,“矣”字的上半部分被單獨又檢測為新的文字。圖5(c)顯示存在漏檢測現象,其中“之”字并沒有被檢測出來。

從優化后的Faster-RCNN算法在利用ResNet 101骨干網絡進行古籍圖像文字檢測效果看,我們以相同位置作為比較,從圖6(a)、圖6(b)、圖6(c)三個位置來看,使用了ResNet101骨干網絡后,這些區域均能被準確檢測出來。

5 古籍圖像文字檢測效果評估

為評價優化后的Faster-RCNN算法在古籍圖像文字檢測中的效果,本文將采用分類任務評價方式進行評估。分類任務的常用評價指標包括精確率(Precision)、召回率(Recall)、f值(F1 Score),其公式如下。

公式(2)中的p為文字檢測精確率,這里表示最終檢測到的文字當中,結果為正樣本的比例,其中TP表示正確檢測數,FP為過檢數。

公式(3)中的r為召回率,這里表示對所有樣本進行實驗后,實際檢測為正樣本所占比例,其中TP表示正確檢測數,FN為漏檢數。

公式(4)中的f為精確率與召回率的綜合評價值,在這里表示檢測樣本數據整體調和均值。

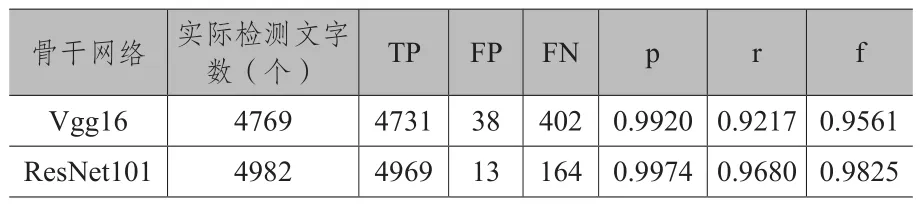

本次選擇《胥臺麋鹿記》中12頁圖像文獻、共5133字作為實驗測試,并對優化后的Faster-RCNN采用Vgg16和ResNet101進行比較,具體樣本測試結果如表2所示。

表2 樣本數據檢測結果

從表2中可以看出,使用Vgg16實際共檢測出4769字,樣本檢測數小于實際樣本字數,過檢文字為38個,漏檢文字為402個。根據結果分析,雖然對Faster-RCNN進行了一定的優化,受到版面因素影響,仍出現較多錯檢文字,在采用Vgg16作為骨干時出現過檢、漏檢主要有兩種原因:一是筆畫較少的文字,由于在圖像中所占像素非常少,導致未能被檢測出來,如“之”“一”等;二是文獻中的文字存在復寫情況,使得在實驗中被算法誤判為文字涂抹,導致未能正確檢測出來。而使用ResNet101作為骨干網絡時,實際共檢測出4982字,過檢文字為13個,漏檢文字為164個。通過對比來看,使用更深的網絡結構可以減少過檢、漏檢情況出現,但其中仍有錯檢現象,主要還是存在于小目標文字以及涂改文字中。最終實驗結果,骨干網絡使用Vgg16時,樣本總體檢測精確率為99.20%,召回率為92.17%,f值為95.61%;骨干網絡使用ResNet101時,樣本總體檢測精確率為99.74%,召回率為96.80%,f值為98.25%。

6 結語

本文基于Faster-RCNN算法,對其中的anchor參數進行優化,較好地適應了古籍圖像文字檢測。經過試驗發現,采用網絡結構層次更深的ResNet101作為骨干網絡,在優化后的Faster-RCNN算法中檢測古籍圖像文字精準度更高。本文優化古籍文字檢測算法檢測精準度仍有提升空間,還需要調整參數,提升文字檢測率,同時需要加大樣本訓練量,以提升算法的泛化適應能力。Faster-RCNN算法是圖像目標檢測領域中的佼佼者,其實施難度小、目標檢測效果好,適合在圖書館自動化業務中推廣普及,相信隨著更多優秀算法被應用,古籍數字化的工作會不斷取得更大進步。