基于無人機多光譜遙感的棉花生長參數和產量估算

趙勝利 王國賓 胡連檳 徐海鈺 鞏道財 蘭玉彬

摘要:及時準確地監測棉花長勢和產量是精準農業栽培管理的關鍵。無人機(UAV)平臺能夠快速獲取高時空分辨率的遙感數據,在作物生長參數和產量估算方面顯示出巨大的潛力。以山東省濱州市棉花為研究對象,利用安裝在無人機上的多光譜相機獲取遙感影像,分別提取各波段反射率,篩選出8種植被指數,采用多元線性回歸(MLR)、隨機森林(RF)、人工神經網絡(BPNN)3種方法分別構建棉花的株高、葉綠素相對含量、單株產量的估計模型并進行驗證。結果表明,基于BPNN的預測模型精度明顯優于MLR和RF模型,盛花期與成熟期棉花株高估計模型驗證集的R2分別為0.842和0.670;葉綠素相對含量估算模型驗證集的R2分別為0.725和0.765;產量估算模型驗證集的R2分別為0.860和0.846。為無人機遙感在作物生長參數與產量估算領域中的應用提供理論依據,為進一步優化農業生產管理、科學決策提供參考。

關鍵詞:棉花;無人機遙感;植被指數;株高;葉綠素相對含量;產量

中圖分類號:S562: S127

文獻標識碼:A

文章編號:20955553 (2024) 02022708

收稿日期:2023年6月27日 ?修回日期:2023年9月15日

基金項目:山東省引進頂尖人才“一事一議”專項經費資助項目(魯政辦字[2018]27號);淄博市重點研發計劃(2019ZBXC200)

第一作者:趙勝利,女,1998年生,河南長葛人,碩士研究生;研究方向為農業工程。Email: 21403010286@sdut.edu.cn

通訊作者:蘭玉彬,男,1961年生,吉林農安人,博士,教授,博導;研究方向為精準農業航空。Email: ylan@sdut.edu.cn

Estimation of cotton growth parameters and yield based on UAV

multispectral remote sensing

Zhao Shengli1, 2, 3, Wang Guobin1, 2, 3, Hu Lianbin1, 2, 3, Xu Haiyu1, 2, 3, Gong Daocai1, 2, 3, Lan Yubin1, 2, 3

(1. College of Agricultural Engineering and Food Science, Shandong University of Technology, Zibo, 255049, China;

2. Shandong Agricultural Aviation Intelligent Equipment Engineering Technology Research Center, Zibo, 255049, China;

3. Research Institute of Ecological Unmanned Farm, Shandong University of Technology, Zibo, 255049, China)

Abstract:

Timely and accurate monitoring of cotton growth and yield is the key to precision farming management. Unmanned Aerial Vehicle (UAV) platforms enable rapid acquisition of remote sensing data with high spatiotemporal resolution, showing great potential in crop growth parameters and yield estimation. Taking cotton in Binzhou City of Shandong Province as the research object, remote sensing images were obtained by using the multispectral camera installed on the UAV , and the reflectance of each band was extracted respectively, and 8 vegetation indices were screened out, and three methods such as multiple linear regression (MLR), random forest(RF) and artificial neural network (BPNN) were used to construct estimation models of cotton plant height, relative chlorophyll content and yield per plant respectively, and verified them. The results showed that the accuracy of the inversion model at the mature stage was generally higher than that at the full flowering stage. The R2 of the validation set for cotton plant height estimation in the peak flowering and mature stages were 0.842 and 0.670, respectively. The R2 values for the validation set of the chlorophyll relative content estimation model were 0.725 and 0.765, respectively. The R2 values for the validation set of the yield estimation model were 0.860 and 0.846, respectively. These results provide theoretical basis for the application of UAV remote sensing in crop growth parameters and yield estimation, and also provide a practical reference for further optimization of agricultural production management, scientific decisionmaking and policy formulation.

Keywords:

cotton; UAV remote sensing; vegetation index; plant height; SPAD; yield

0 引言

棉花是世界上重要的經濟作物,為紡織業貢獻了35%的纖維,其副產品包括棉籽油和棉籽粉,在食品和紡織工業等各個領域發揮著關鍵作用[12]。在中國,棉花是主要的經濟作物,種植面積約為耕地總面積的三分之一[3]。因此,對棉花的生長狀況和產量進行準確監測具有重要的學術和經濟意義。

株高和葉綠素相對含量SPAD是作物冠層結構的重要參數,其對作物的生長動態和生物物理過程產生著重要影響,同時在作物生長模型與決策支持系統中也具有關鍵作用[4]。準確獲取作物的株高和葉綠素相對含量對于作物生長監測、產量預測和田間水肥管理至關重要。目前,獲取作物株高和葉綠素相對含量的方法主要包括直接測量法和間接測量法。雖然直接測量法精確度較高,但破壞性采樣會,且耗時費力,因此存在一定局限性。相較之下,間接測量法通過將作物光譜信息與實測數據相結合,并通過模型估算作物生長指標,具有快速、高效等優勢。在近年來,無人機多光譜遙感作為一項重要工具,成為精準農業研究和獲取作物冠層參數的重要手段。劉濤等[5]采用不同光譜指數建立不同高度下SPAD的三種關系模型,結果表明基于人工神經網絡構建的小麥冠層SPAD預測模型反演精度最高;Muharam等[6]對株高、冠幅和地被覆蓋度進行了相關性分析。相關分析表明,在3個植物氮指標中,葉片氮對植物參數最敏感,對株高的影響較大。閆成川等[7]研究了干旱脅迫對棉花SPAD與產量的影響,并通過對結果聚類分析將干旱程度分級,實現了快速評價棉花抗旱性的效果。Li等[8]提出并評估了一種新的估算葉片葉綠素a+b含量和等效水厚度混合方法,該方法有效提高了模型估計準確率。孟沌超等[9]獲取棉花的主要生育期可見光影像,建立植被指數、紋理特征與氮素、葉綠素含量的回歸模型,結果表明:采用PLS植被指數與紋理特征模型為較優選擇。

作物產量與人民經濟收入、生活水平息息相關,準確及時地估算作物產量對農業生產具有重要意義[10]。傳統的棉花產量測量方法是按單位面積計算棉鈴數,這種方法是耗時和勞動密集型的,不適合大面積測試[11]。雖然衛星遙感技術也被用于多尺度平臺的產量估算[12]。然而,由于受傳感器能力和云層覆蓋的影響,空間和時間分辨率不足,衛星圖像對于田間觀測可能效果不夠理想。因此,無人機低空遙感技術的快速發展為高時間與高空間分辨率的快捷精確地進行野外數據采集提供了前所未有的機遇。

目前研究者們大多使用無人機搭載紅—綠—藍(RGB)相機[13]、多光譜相機[14]、高光譜相機[15]和激光雷達[16]來估算作物產量。多光譜相機因其操作靈活、成本低廉而備受關注,它能夠輸出帶有灰度值、顏色的圖像[1718]。Wahab等[12]證明了從多光譜圖像中提取的新指標GNDVI在用于衡量復雜農業系統中的作物活力和預測玉米產量方面是有效的。Xu等[4]建立了基于時間序列無人機遙感數據的棉花產量估算模型。實現了利用U-Net語義分割網絡對高分辨率可見光圖像中的棉鈴開口像素進行識別提取,從而提高了棉花產量估算精度。Shi等[19]提出了一種能直觀地表示棉花產量和棉鈴特征的指標,主要通過提取棉鈴指數,獲得了支持向量機、隨機森林等五種常用模型,結果表明:紅綠藍(RGB)和近紅外紅(NIR)歸一化(由RGB和近紅外帶組成的歸一化形式指數)效果最好。

盡管目前已有許多關于棉花SPAD、株高等指標的遙感長勢監測研究[2024],但在利用機器學習方法進行棉花長勢監測與單株產量估算的研究方面,探索較少。同時,利用無人機多光譜數據預測棉花產量的研究也相對有限。因此,本文旨在以山東省濱州市棉花為研究對象,應用無人機多光譜遙感技術,采用多元線性回歸、隨機森林和人工神經網絡三種機器學習方法,構建棉花的株高、葉綠素相對含量和單株產量的估計模型,并進行驗證。以探究其在棉花株高和葉綠素含量反演方面的應用潛力,為作物產量的實時預測提供理論依據,并探討無人機多光譜遙感技術在作物長勢監測方面的應用效果。

1 材料與方法

1.1 研究區域和試驗設計

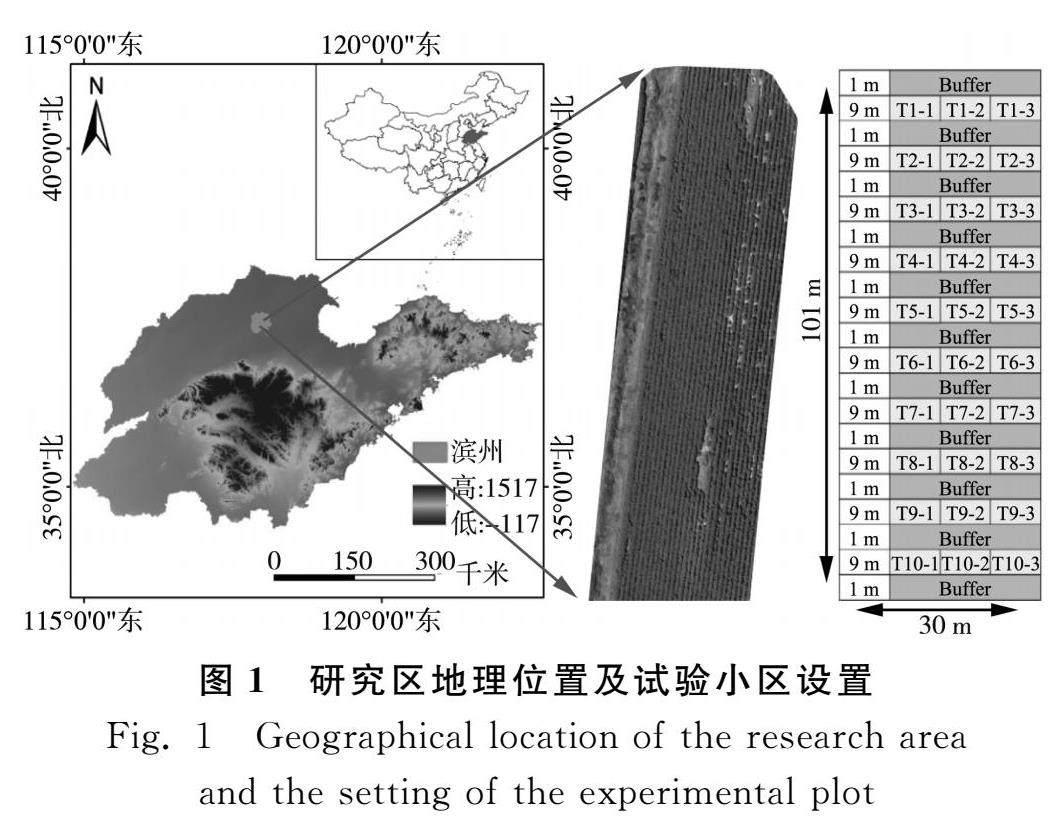

本文于2022年7—9月在山東省濱州市秦皇臺鄉(山東濱州棉花科技小院)進行田間試驗,該地北緯37.22°,東經118.02°,海拔約11 m,一年只種植一季棉花育種材料。試驗田屬暖溫帶大陸性季風氣候,半濕潤地區,冬季寒冷干燥,夏季炎熱多雨。年平均氣溫約為12.3 ℃,年降雨量626 mm左右,其中夏季降雨量較大,占全年的60%~70%,其他月份降雨較少。

試驗棉花魯研棉37于2022年4月28日采用隨機區組設計播種。行距0.76 m,株距0.16 m,種植密度為90 000株/hm2。試驗田栽培管理措施與一般大田管理措施相同。本試驗在試驗田內均勻布設3個地面控制點(Ground Control Point),GCP由紅色噴漆作為標志(避免GCP在獲取不同時期無人機遙感影像時發生空間位置的移動)。利用智能RTK系統測量控制點的三維空間地理位置,以便進行幾何校正和圖像配準。試驗田長100 m,寬30 m,平均分為30個小區,每個小區9 m×10 m,如圖1所示。

1.2 地面數據采集

本文收集株高H、葉綠素相對含量SPAD作為地面真實數據。株高、葉綠素相對含量采集時間為無人機飛行任務之后。H值即從地面到冠層頂部的距離。棉花育種材料H值的觀測方法為:在每個小區按照五點采樣法隨機選取5株棉花,用塔尺測量其H值,測量時保持塔尺垂直于地面,取平均得到該小區的測量值。采用SPAD-502 Plus產量儀對30個小區進行SPAD測量,SPAD-502 Plus通過測量葉子對兩個波長段里的吸收率,來評估當前葉子中的葉綠素相對含量。SPAD測量時為保證測量準確度,分別在棉花植株的上中下3個部位各隨機選取一片棉葉測量三次取平均作為該部位測量值,3個部位的平均值作為該株的測量值。每小區測量5株具有代表性的棉花,平均值作為該小區SPAD值。收獲時,于每個小區中按五點取樣法取3個2 m×2 m的樣方,采摘每株的成鈴并記錄每個樣方的棉鈴個數。為避免棉花中水分的影響,烘干稱重的成鈴重量記為w。棉鈴分類標準:直徑大于2 cm的棉鈴為成玲,直徑小于2 cm的棉鈴為幼鈴,鈴殼開裂3 mm以上的棉鈴為絮鈴,爛鈴不計。籽棉產量計算公式如式(1)所示。

y=0.9mρw

(1)

m=(a+b+1/3×c)/k

(2)

式中:

Y——棉花產量,kg/hm2;

m——平均單株成鈴數,個/株;

ρ——收獲密度,株/hm2;

w——單鈴重,kg/個;

a——成鈴數,個;

b——絮鈴數,個;

c——幼鈴數,個;

k——總株數,株。

1.3 無人機多光譜圖像采集與處理

采用消費級無人機大疆精靈4 RTK多光譜版對測試區域進行多光譜圖像采集。相機由6個1/2.9英寸CMOS組成,包括1個用于可見光成像的彩色傳感器和5個用于多光譜成像的單色傳感器。單個傳感器的有效像素為208萬(總像素212萬)。在飛行任務中,為了保證多光譜圖像的質量,減少圖像拼接的誤差,在DJI GS Pro中設置正向和側面重疊均80%,飛行時間和高度分別為10:00~14:00和30 m。選取盛花期(2021年7月26日)、成熟期(9月28日)2個關鍵生育期進行的2次飛行任務,評估基于多光譜圖像的產量估算的準確性。大疆精靈4RTK能通過內置的全球導航衛星系統(GNSS)模塊記錄圖像的位置信息。此外,利用差分GNSS以毫米精度記錄野外3個地面控制點(GCP)的坐標。采用Pix4D mapper 4.4.12軟件對無人機多光譜圖像進行拼接。在圖像拼接過程中,將無人機多光譜圖像導入軟件,軟件能夠自動讀取相機配置信息和定位系統數據,然后進行輻射校準。最后,Pix4Dmapper生成數字地表模型(DSM)、數字正射影像(DOM),并用ENVI5.3進行幾何校正和圖像配準。

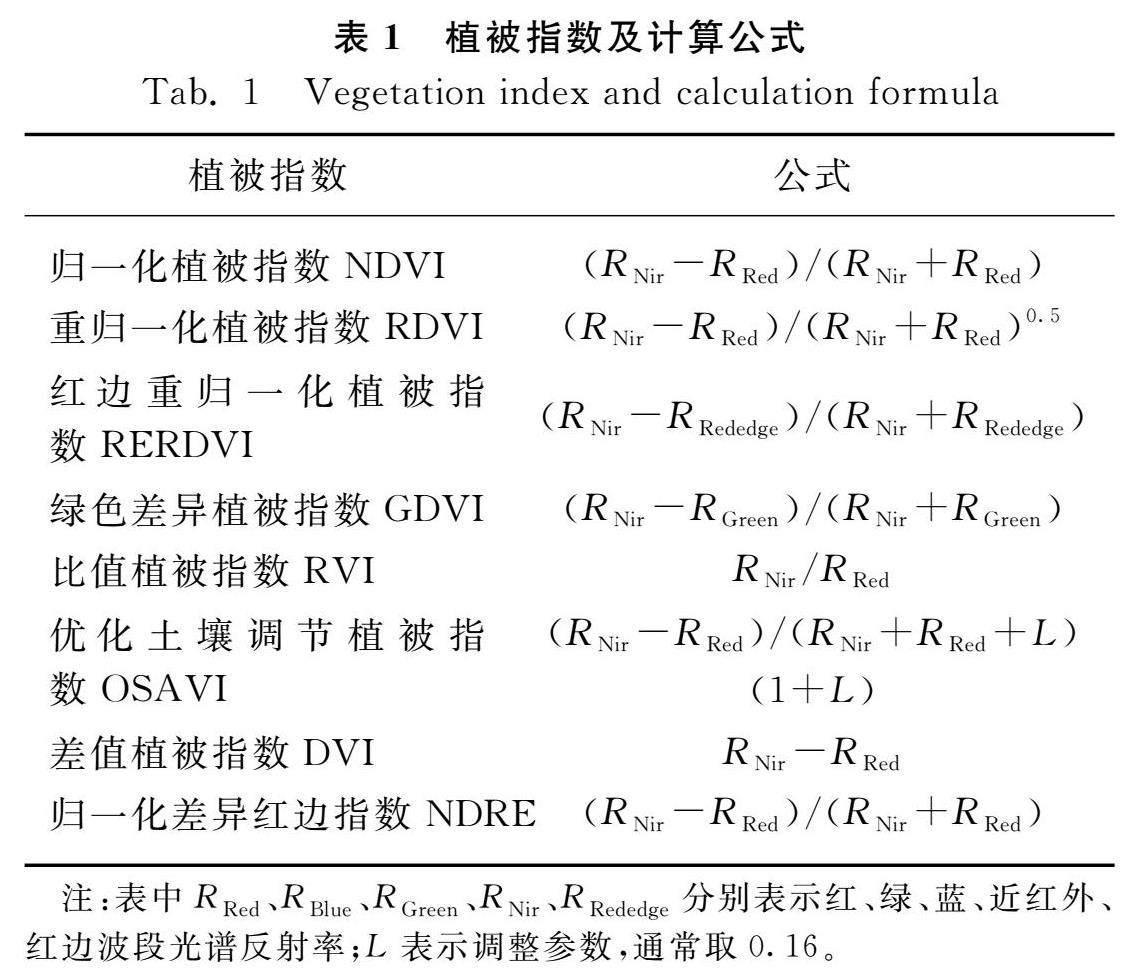

1.4 無人機多光譜圖像的植被指數提取

為篩選出適合棉花無人機遙感估產的植被指數,本文基于無人機多光譜影像紅、綠、藍、紅外、近紅外波段的光譜信息,從65種植被指數中選取了8種與產量相關性較高的植被指數,計算植被指數[2532]的公式如表1所示。采用ENVI 5.3中的波段計算工具提取植被指數。構建感興趣區域(Region of Interest,ROI)提取每個小區的植被指數,并選擇每個小區的平均反射率進行后續的數據處理。

1.5 模型構建

為篩選出適合棉花無人機遙感估產的植被指數,本文首先基于提取的8種植被指數,分別使用偏最小二乘回歸模型、多元逐步回歸模型、隨機森林算法模型和BP神經網絡模型,分析植被指數與株高、葉綠素相對含量、產量的相關性。然后探究植被指數構建產量估算模型、SPAD估算模型的可行性。偏最小二乘回歸是一種多元回歸建模方法,將典型相關分析、多元線性回歸以及主成分分析等技術優勢相結合,能夠有效解決較少樣本量而預測變量存在共線性方面的問題[2627]。多元逐步回歸是多元線性回歸的繼承與發展,通過一個個的輸入參數,逐個檢驗并剔除顯著性低的變量,從而篩選出相關性高的因子[2829]。隨機森林(Random Forest, RF)是一種用于分類或回歸的機器學習算法,具有魯棒性高、學習能力強等特點。BP神經網絡具有強大的非線性擬合能力,對構建植被指數與單株產量之間的定量關系發揮重要作用。本文使用包含8個輸入層,2個隱藏層,學習率為0.01的人工神經網絡模型估算棉花株高、SPAD和產量。

1.6 模型性能評價

在盛花期、成熟期分別采集的150個株高、葉綠素含量樣本數據,對數據進行排序,分層抽樣法選擇110個樣本構建產量估測模型,40個樣本進行驗證。采用均方根誤差RMSE、決定系數R2和歸一化均方根誤差NRMSE三個指標來評價模型的產量估計性能,R2越接近1,RMSE越小,說明模型預測精度越高。計算方法如式(3)~式(5)所示。

R2=1-∑ni=1(yi-y^)2

∑ni=1(yi-y)2

(3)

RMSE=1n∑ni=1(yi-y^)

(4)

NRMSE=RMSEy

(5)

式中:

n——樣本總數;

yi——實測值;

y^——估計值;

y——實測值的平均值。

2 結果與分析

2.1 葉綠素相對含量、株高、產量

盛花期、成熟期棉花植株株高與葉綠素相對含量的基本信息如表2、表3所示。數據顯示不同生長階段的棉花葉綠素含量、株高存在較小差異,可能是由于盛花期至成熟期間產量已相對穩定,不排除另有其他環境因素的變化,使得觀察到的差異較小。圖4為測產樣點棉花單鈴重的頻數分布圖,曲線為依據樣本均值、方差繪制的正態分布曲線。棉花產量實測數據顯示,棉花單株產量集中于90~150 g。

2.2 植被指數與葉綠素相對含量、株高相關性分析

利用建模數據集中實測的SPAD、株高分別與8種植被指數進行相關性分析,計算結果如表4所示。

從表4可以看出,SPAD與8種植被指數的相關系數在0.528~0.792之間,其中SPAD與GDVI相關系數最強,相關系數達到0.792;NDRE與株高之間為負相關關系,其余7種植被指數均與株高呈正相關關系。與棉花株高具有最好的相關性的植被指數為GDVI,相關系數為0.738。因此,選擇表4中的8種植被指數對于構建棉花的生長參數及產量的反演模型具有一定可行性。

2.3 棉花各植被指數與產量的相關系數

8種植被指數與產量的相關性分析結果如表5所示,其中GDVI在盛花期與產量相關性最佳,相關系數為0.755;而在成熟期DVI是與產量相關性最佳的植被指數,相關系數為0.718。

2.4 棉花無人機多光譜遙感生長參數及估產模型

為提高模型預測精度,本文以8種植被指數作為估算模型的輸入,采用多元逐步線性回歸法、人工神經網絡和隨機森林法構建不同生育期棉花葉綠素含量、株高、產量之間的經驗統計模型。

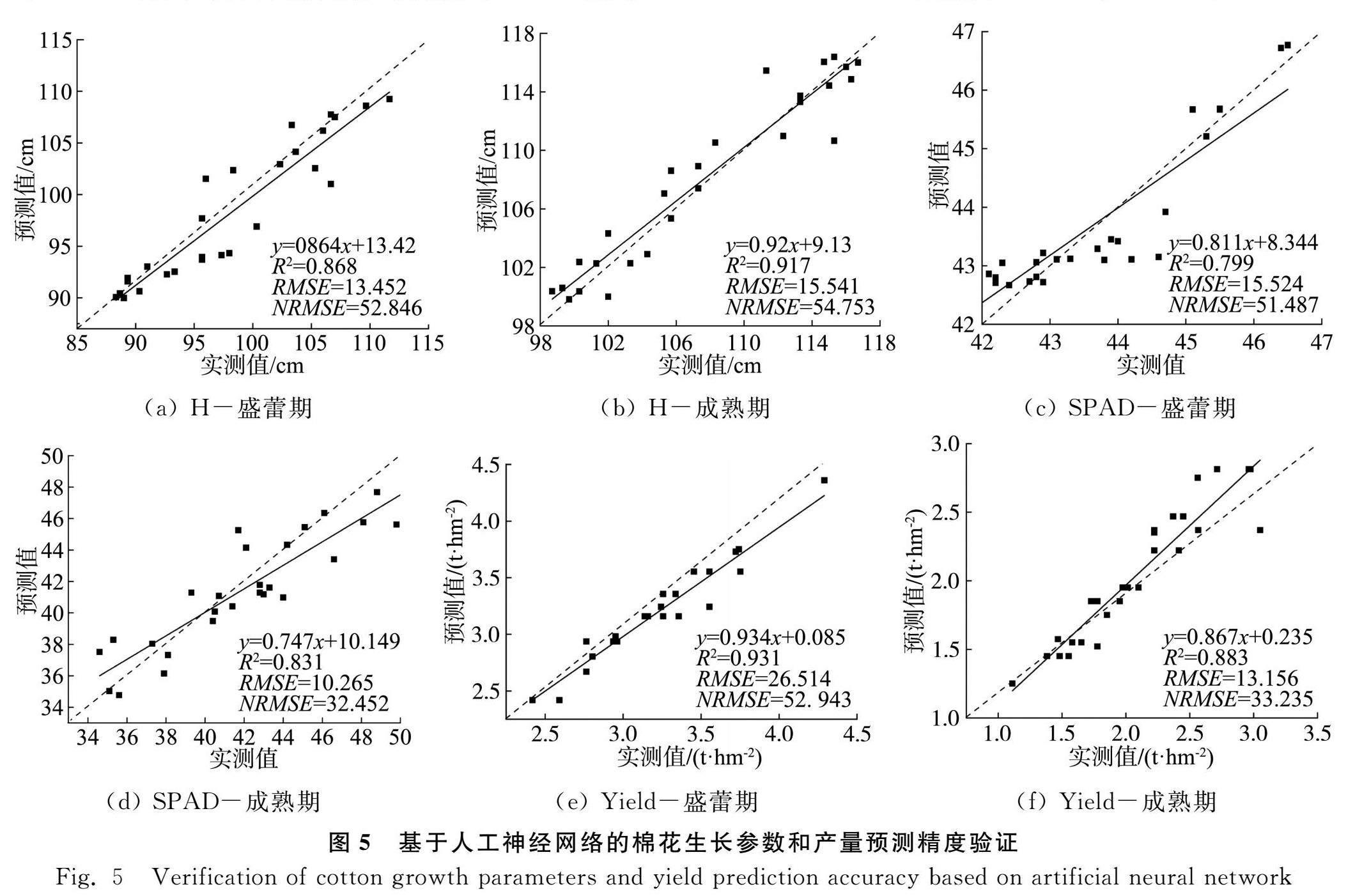

如表6所示,基于MLR構建的盛花期和成熟期棉花株高估算模型的R2分別為0.709和0.722,RMSE分別為17.882和14.174,NRMSE分別為62.372和74.600;基于RF構建的盛花期和成熟期棉花株高估算模型的R2分別為0.721和0.753,RMSE分別為22.412和18.536,NRMSE分別為64.741和71.415;基于BPNN構建的盛花期和成熟期棉花株高估算模型的R2分別為0.790和0.884,RMSE分別為19.435和12.119,NRMSE分別為67.736和63.784。

基于MLR構建的盛花期和成熟期棉花SPAD估算模型的R2分別為0.342和0.596,RMSE分別為7.817和13.914,NRMSE分別為86.856和76.451;基于RF構建的盛花期和成熟期棉花SPAD估算模型的R2分別為0.574和0.642,RMSE分別為12.813和19.438,NRMSE分別為23.635和72.569;基于BPNN構建的盛花期和成熟期棉花SPAD估算模型的R2分別為0.860和0.883,RMSE分別為1.728和12.202,NRMSE分別為19.222和67.044。

基于MLR構建的盛花期和成熟期棉花產量估算模型的R2分別為0.828和0.854,RMSE分別為23.716和15.364,NRMSE分別為47.432和17.071;基于RF構建的盛花期和成熟期棉花產量估算模型的R2分別為0.866和0.872,RMSE分別為28.479和17.462,NRMSE分別為55.145和36.47;基于BPNN構建的盛花期和成熟期棉花產量估算模型的R2分別為0.890和0.956,RMSE分別為27.459和24.113,NRMSE分別為54.921和34.457。

2.5 基于無人機遙感的棉花2個生育期植被指數估測產量精度驗證

本文使用BP神經網絡模型對8個植被指數和實測數據進行建模,并進行驗證。基于田間試驗共獲取花蕾期和成熟期各150組SPAD和株高樣本、150組產量樣本,對所有樣本進行從小到大排序,在這些樣本中隨機選取110組樣本作為建模集,剩余40組樣本作為驗證集。以表1中的植被指數作為自變量,以棉花株高作為因變量,采用BPNN構建棉花盛花期、成熟期株高估算模型,從R2、RMSE、NRMSE3個方面綜合評定模型精度,不同建模方法對于棉花株高的預測結果如圖5所示。結果表明:基于BPNN構建的棉花盛花期與成熟期株高估算模型驗證集的R2分別為0.842和0.670,RMSE分別為14.438和16.537,NRMSE分別為67.736和58.784;同理,基于BPNN構建的棉花盛花期與成熟期SPAD估算模型驗證集R2分別為0.725和0.765,RMSE分別為4.317和11.379,NRMSE分別為59.856和34.451;基于BPNN構建的棉花盛花期與成熟期產量估算模型驗證集R2分別為0.860和0.846,RMSE分別為27.459和14.157,NRMSE分別為54.922和34.453。

(a) H-盛蕾期

(b) H-成熟期

(c) SPAD-盛蕾期

(d) SPAD-成熟期

(e) Yield-盛蕾期

(f) Yield-成熟期

3 討論

目前無人機遙感影像與植被指數結合的相關研究在農業領域應用日益廣泛。本文旨在通過無人機多光譜遙感技術反演棉花的株高和葉綠素含量,并分析其與產量的關聯,從而為作物生長參數的監測和農作物產量的預測提供可靠數據支持。研究結果表明,植被指數GDVI與株高、SPAD和產量的相關性均較好,這可能是由于GDVI對植被的光合活動和葉綠素含量變化較敏感。葉綠素作為植物光合作用的關鍵,與植物健康狀況密切相關,因此葉綠素含量與株高、SPAD和產量之間存在高相關性,GDVI的變化可實時監測棉花長勢。同時,隨著生育期的變化,多個植被指數與產量的相關性呈減小趨勢,且成熟期的生長參數和產量預測精度較高。這可能是因為成熟期是棉花生長狀態最佳的時期,其株高、SPAD等指標達到峰值;而在盛花期,由于棉花仍處于營養生長階段,葉綠素含量水平較低,且開花需要大量能量供給,使得多光譜相機難以捕捉該過程的特征。

此外,不同建模方法對預測模型的精度產生較大影響。本文對8種植被指數采用多元線性回歸、隨機森林和人工神經網絡3種方法構建了株高、SPAD和產量的估算模型。結果顯示,基于BPNN模型的估測精度優于其他模型方法,這與劉濤[5]、羅小波[30]等的研究結果類似。BPNN模型具有強大的非線性建模能力、學習能力和泛化能力,能對復雜函數進行有效擬合,提高了模型的精度。然而,MLR模型存在多重共線性和對異常值和離群點敏感等不足,可能影響模型的擬合效果。RF模型雖通過多個決策樹的投票來做出預測,但學習過程較為簡單,不如BPNN那樣能進行權重調整和優化。因此,BPNN模型可作為棉花株高、SPAD和產量建模的首選方法。

當前基于多光譜遙感的作物生長參數和產量估算仍面臨一些問題,如時間、空間異質性使得模型通用性較差,且不同作物、不同環境條件下構建的模型精度差異較大。此外,本文樣本量較少,后續可以增加更多樣本數據進行建模,以探究預測精度是否有明顯提升。

4 結論

本文以山東省濱州市棉花為研究對象,利用無人機獲取了棉花不同時期的多光譜影像,并采用多元線性回歸、隨機森林、人工神經網絡三種方法分別構建了棉花的株高、葉綠素相對含量、產量的估計模型。同時還深入探討了不同機器學習方法對棉花長勢參數與產量估算精度的影響,旨在為更加精準、快速地獲取棉花生長參數與產量預測提供理論參考。

1) ?通過相關性分析,篩選出與株高、葉綠素相對含量和產量的相關性均較好的植被指數為GDVI,相關系數分別為0.792和0.738,因此,通過GDVI的變化能實時監測棉花長勢。

2) ?基于BPNN模型構建的棉花生長參數與產量預測模型的精度高于MLR與RF模型。基于BPNN構建的棉花盛花期與成熟期株高估算模型驗證集的R2分別為0.842和0.670;基于BPNN構建的棉花盛花期與成熟期SPAD估算模型驗證集R2分別為0.725和0.765。

3) ?在成熟期,基于BPNN模型構建的棉花生長參數和產量預測精度更高,株高、葉綠素相對含量和產量的預測模型R2分別為0.884、0.883、0.956;RMSE分別為12.119、12.202、24.113;故在成熟期使用BPNN模型能準確估算棉花產量。

參 考 文 獻

[1]劉文靜, 范永勝, 董彥琪, 等. 我國棉花生產現狀分析及建議[J]. 中國種業, 2022(1): 21-25.

Liu Wenjing, Fan Yongsheng, Dong Yanqi, et al. Analysis and suggestions on the current situation of cotton production in China [J]. China Seed Industry, 2022(1): 21-25.

[2]苑嚴偉, 白圣賀, 牛康, 等. 棉花種植機械化關鍵技術與裝備研究進展[J]. 農業工程學報, 2023, 39(6): 1-11.

Yuan Yanwei, Bai Shenghe, Niu Kang, et al. Research progress in the key technologies and equipment for cotton planting mechanization [J]. Transactions of the Chinese Society of Agricultural Engineering, 2023, 39(6): 1-11.

[3]Wang G, Lan Y, Qi H, et al. Field evaluation of an unmanned aerial vehicle (UAV) sprayer: Effect of spray volume on deposition and the control of pests and disease in wheat [J]. Pest Management Science, 2019, 75(6): 1546-1555.

[4]Xu W, Chen P, Zhan Y, et al. Cotton yield estimation model based on machine learning using time series UAV remote sensing data [J]. International Journal of Applied Earth Observation and Geoinformation, 2021, 104.

[5]劉濤, 張寰, 王志業, 等. 利用無人機多光譜估算小麥葉面積指數和葉綠素含量[J]. 農業工程學報, 2021, 37(19): 65-72.

Liu Tao, Zhang Huan, Wang Zhiye, et al. Estimation of the leaf area index and chlorophyll content of wheat using UAV multispectrum images [J]. Transactions of the Chinese Society of Agricultural Engineering, 2021, 37(19): 65-72.

[6]Muharam F, Bronson K, Maas S, et al. Interrelationships of cotton plant height, canopy width, ground cover and plant nitrogen status indicators [J]. Field Crops Research, 2014, 169: 58-69.

[7]閆成川, 曲延英, 陳全家, 等. 基于無人機多光譜影像的棉花SPAD值及葉片含水量估測[J]. 農業工程學報, 2023, 39(2): 61-67.

Yan Chengchuan, Qu Yanying, Chen Quanjia, et al. Estimation of cotton SPAD value and leaf water content based on UAV multispectral images [J]. Transactions of the Chinese Society of Agricultural Engineering, 2023, 39(2): 61-67.

[8]Li J, Wijewardane N K, Ge Y, et al. Improved chlorophyll and water content estimations at leaf level with a hybrid radiative transfer and machine learning model [J]. Computers and Electronics in Agriculture, 2023, 206: 107669.

[9]孟沌超, 趙靜, 蘭玉彬, 等. 基于無人機可見光影像的玉米冠層SPAD反演模型研究[J]. 農業機械學報, 2020, 51(S2): 366-374.

Meng Dunchao, Zhao Jing, Lan Yubin, et al. SPAD inversion model of corn canopy based on UAV visible light image [J]. Transactions of the Chinese Society for Agricultural Machinery, 2020, 51(S2): 366-374.

[10]Ferencz C, Bognar P, Lichtenberger J, et al. Crop yield estimation by satellite remote sensing [J]. International Journal of Remote Sensing, 2004, 25(20): 4113-4149.

[11]張靜, 郭思夢, 韓迎春, 等. 基于無人機RGB圖像的棉花產量估算[J]. 中國農業科技導報, 2022, 24(11): 112-120.

Zhang Jing, Guo Simeng, Han Yingchun, et al. Estimation of cotton yield based on unmanned aerial vehicle RGB images [J]. Journal of Agricultural Science and Technology, 2022, 24(11): 112-120.

[12]Wahab I, Hall O, Jirstrm M. Remote sensing of yields: Application of UAV imageryderived NDVI for estimating maize vigor and yields in complex farming systems in subsaharan africa [J]. Drones, 2018, 2(3): 28.

[13]Sumesh K, Ninsawat S, Somard J. Integration of RGBbased vegetation index, crop surface model and objectbased image analysis approach for sugarcane yield estimation using unmanned aerial vehicle [J]. Computers and Electronics in Agriculture, 2021, 180: 105903.

[14]Laliberte A S, Goforth M A, Steele C M, et al. Multispectral remote sensing from unmanned aircraft: Image processing workflows and applications for rangeland environments [J]. Remote Sensing, 2011, 3(11): 2529-2551.

[15]馮海寬, 陶惠林, 趙鈺, 等. 利用無人機高光譜估算冬小麥葉綠素含量[J]. 麥類作物學報, 2022, 42(11):3575-3580.

Feng Haikuan, Tao Huilin, Zhao Yu, et al. Estimation of chlorophyll content in winter wheat based on UAV hyperspectral [J]. Spectroscopy and Spectral Analysis, 2022, 42(11): 3575-3580.

[16]Almeida C T d, Galvo L S, Arago L E d O C e, et al. Combining LiDAR and hyperspectral data for aboveground biomass modeling in the Brazilian Amazon using different regression algorithms [J]. Remote Sensing of Environment, 2019, 232.

[17]Du X, Wan L, Cen H, et al. Multitemporal monitoring of leaf area index of rice under different nitrogen treatments using UAV images [J]. International Journal of Precision Agricultural Aviation, 2020, 3(1).

[18]Ahmed O S, Shemrock A, Chabot D, et al. Hierarchical land cover and vegetation classification using multispectral data acquired from an unmanned aerial vehicle [J]. International journal of remote sensing, 2017, 38(8-10): 2037-2052.

[19]Shi G, Du X, Du M, et al. Cotton yield estimation using the remotely sensed cotton boll index from UAV images [J]. Drones, 2022, 6(9): 254.

[20]Yang Q, Shi L, Han J, et al. Deep convolutional neural networks for rice grain yield estimation at the ripening stage using UAVbased remotely sensed images [J]. Field Crops Research, 2019, 235: 142-153.

[21]Chen P, Douzals J P, Lan Y, et al. Characteristics of unmanned aerial spraying systems and related spray drift: A review [J]. Frontiers in Plant Science, 2022: 2726.

[22]邵國敏, 王亞杰, 韓文霆. 基于無人機多光譜遙感的夏玉米葉面積指數估算方法[J]. 智慧農業(中英文), 2020, 2(3): 118-128.

Shao Guomin, Wang Yajie, Han Wenting, et al. Estimation method of leaf area index for summer maize using UAVbased multispectral remote sensing [J]. Smart Agriculture, 2020, 2(3): 118-128.

[23]張恒瑞, 段喜明, 魏征, 等. 基于無人機多光譜遙感的華北地區夏玉米LAI監測[J]. 山西農業科學, 2021, 49(5): 608-614.

Zhang Hengrui, Duan Ximing, Wei Zheng, et al. Study on LAI monitoring of summer corn in north China based on UAV multispectral remote sensing [J]. Journal of Shanxi Agricultural Sciences, 2021, 49(5): 608-614.

[24]魏青, 張寶忠, 魏征, 等. 基于無人機多光譜遙感的冬小麥冠層葉綠素含量估測研究[J]. 麥類作物學報, 2020, 40(3): 365-372.

Wei Qing, Zhang Baozhong, Wei Zheng, et al. Estimation of canopy chlorophyll content in winter wheat by UAV multispectral remote sensing [J]. Journal of Triticeae Crops, 2020, 40(3): 365-372.

[25]陳俊英, 陳碩博, 張智韜, 等. 無人機多光譜遙感反演盛花期棉花光合參數研究[J]. 農業機械學報, 2018, 49(10): 230-239.

Chen Junying, Chen Shuobo, Zhang Zhitao, et al. Investigation on photosynthetic parameters of cotton during budding period by multispectral remote sensing of unmanned aerial vehicle [J]. Transactions of the Chinese Society for Agricultural Machinery, 2018, 49(10): 230-239.

[26]Su J, Liu C, Coombes M, et al. Wheat yellow rust monitoring by learning from multispectral UAV aerial imagery [J]. Computers and Electronics in Agriculture, 2018, 155: 157-166.

[27]Gao C, Ji X, He Q, et al. Monitoring of wheat fusarium head blight on spectral and textural analysis of UAV multispectral imagery [J]. Agriculture, 2023, 13(2): 293.

[28]Shu Meiyan, Dong Qizhou, Fei Shuaipeng, et al. Improved estimation of canopy water status in maize using UAV-based digital and hyperspectral images [J]. Computers and Electronics in Agriculture, 2022, 197: 106982.

[29]Hassan M A, Yang M, Rasheed A, et al. A rapid monitoring of NDVI across the wheat growth cycle for grain yield prediction using a multispectral UAV platform [J]. Plant Science, 2019, 282: 95-103.

[30]羅小波, 謝天授, 董圣賢. 基于無人機多光譜影像的柑橘冠層葉綠素含量反演[J]. 農業機械學報, 2023, 54(4): 198-205.

Luo Xiaobo, Xie Tianshou, Dong Shengxian. Estimation of citrus canopy chlorophyll based on UAV multispectral images [J]. Transactions of the Chinese Society for Agricultural Machinery, 2023, 54(4): 198-205.