基于Vision Transformer的小麥病害圖像識別算法

白玉鵬 馮毅琨 李國厚 趙明富 周浩宇 侯志松

摘要:小麥白粉病、赤霉病和銹病是危害小麥產量的三大病害。為提高小麥病害圖像的識別準確率,構建一種基于Vision Transformer的小麥病害圖像識別算法。首先,通過田間拍攝的方式收集包含小麥白粉病、赤霉病和銹病3種病害在內的小麥病害圖像,并對原始圖像進行預處理,建立小麥病害圖像識別數據集;然后,基于改進的Vision Transformer構建小麥病害圖像識別算法,分析不同遷移學習方式和數據增強對模型識別效果的影響。試驗可知,全參數遷移學習和數據增強能明顯提高Vision Transformer模型的收斂速度和識別精度。最后,在相同時間條件下,對比Vision Transformer、AlexNet和VGG16算法在相同數據集上的表現。試驗結果表明,Vision Transformer模型對3種小麥病害圖像的平均識別準確率為96.81%,相較于AlexNet和VGG16模型識別準確率分別提高6.68%和4.94%。

關鍵詞:小麥病害;Vision Transformer;遷移學習;圖像識別;數據增強

中圖分類號:TP18: S512.1

文獻標識碼:A

文章編號:20955553 (2024) 02026708

收稿日期:2022年5月12日 ?修回日期:2022年7月22日

基金項目:國家自然科學基金(11871196);河南省科技攻關項目(232102111125)

第一作者:白玉鵬,男,1996年生,河南駐馬店人,碩士研究生;研究方向為圖像處理與農業信息化。Email: yupengbai@126.com

通訊作者:侯志松,男,1979年生,河南安陽人,碩士,副教授;研究方向為智能信息處理與最優化算法。Email: houzhs@126.com

Algorithm of wheat disease image identification based on Vision Transformer

Bai Yupeng1, Feng Yikun2, Li Guohou1, Zhao Mingfu1, Zhou Haoyu3, Hou Zhisong1, 4

(1. School of Information Engineering, Henan Institute of Science and Technology, Xinxiang, 453000, China;

2. School of Software and Applied Science and Technology, Zhengzhou University, Zhengzhou, 450000, China;

3. School of Food Science, Henan Institute of Science and Technology, Xinxiang, 453000, China;

4. School of Computer Science and Technology, Xidian University, Xian, 710000, China)

Abstract:

Wheat powdery mildew, head blight, and rust are the three major diseases that harm wheat yield. In order to improve the recognition accuracy of wheat disease images, a wheat disease image recognition algorithm based on Vision Transformer was proposed. Firstly, the images of wheat diseases, including wheat powdery mildew, scab, and rust, were collected by field shooting, and the original images were preprocessed to establish the wheat disease image recognition data set. Then, the wheat disease image recognition algorithm was constructed based on the improved Vision Transformer, analyzing the influence of different transfer learning methods and data enhancement on the model identification effect. The experiments showed ?that full parameter transfer learning and data enhancement could significantly improve the convergence speed and identification accuracy of the Vision Transformer model. Finally, the performance of Vision Transformer, AlexNet and VGG 16 algorithms on the same dataset was compared under the same time condition. The experimental results showed that the average recognition accuracy of the Vision Transformer model for the three wheat disease images was 96.81%, which was 6.68% and 4.94% higher than that of ?AlexNet and VGG 16 models, respectively.

Keywords:

wheat disease; Vision Transformer; transfer learning; image recognition; data augmentation

0 引言

農作物病害是農業生產中嚴重的生物災害,我國平均每年農作物病害爆發的耕種面積高達3.5×109 km2,給我國農業生產帶來了難以估計的經濟損失[1]。小麥作為我國重要的糧食作物,遭受病害后將導致產量和質量急劇下降,嚴重影響我國糧食安全[2]。小麥發病初期及時對病害診斷并進行精準防治,能夠最大限度地減少經濟損失,提高小麥產量。傳統的農作物病害識別方法主要依賴于農業專家的經驗和人工檢測,這種方法效率低下、耗時耗力,且難以覆蓋大面積的農田,已不能夠滿足當前環境下對病害快速準確診斷的需求。

隨著深度學習技術的不斷發展,利用計算機視覺對農作物病害進行快速識別與診斷逐漸成為取代傳統人工診斷作物病害的一種重要方法[3]。深度學習技術可分為傳統的機器學習算法和深度學習算法兩大類。傳統的機器學習算法主要包括支持向量機(Support Vector Machine, SVM)[4]、K近鄰算法(Knearest Neighbor, KNN)、決策樹(Decision Tree, DT)、K均值聚類算法等。國內外學者對此展開了廣泛的研究,Wang等[5]用KNN算法對小麥霉變程度進行分析,取得了較好的識別效果;Feng等[6]利用支持向量機(SVM)和邏輯回歸(LR)算法,結合光譜成像技術用于水稻病害檢測,識別準確率達93%。然而,傳統的機器學習算法在處理農作物病害識別問題時,往往受到過擬合、數據不平衡和魯棒性差等問題的影響,導致識別效果不盡如人意。近年來,深度學習算法憑借其強大的特征表達能力和無需人工提取特征的優點,在計算機視覺領域中逐漸占據了主導地位,其中在圖像識別方面應用廣泛且實踐效果最好的應屬卷積神經網絡(CNN)[7]。許多學者將AlexNet[8]、VGGNet[9]、GoogleNet[10]等經典的CNN模型用于作物病害識別,取得了較好的識別效果。與此同時,隨著計算機算力的提升,涌現出越來越多的基于深度學習的作物病害識別模型,模型識別精度也在不斷地提高[1113]。盡管卷積神經網絡(CNN)在農作物病害識別領域取得了顯著的成果,但其在處理大規模圖像數據時,仍然面臨著計算復雜度高、訓練時間長等問題[14]。卷積操作缺乏對圖像本身的全局理解,無法建立特征之間的依賴關系,不能充分地利用上下文信息。此外,卷積的權重是固定的,并不能動態地適應輸入的變化[15]。因此,研究人員嘗試將自然語言處理領域中的Transformer模型遷移到計算機視覺任務。相比卷積神經網絡,Transformer的自注意力機制不受局部相互作用的限制,既能挖掘長距離的依賴關系又能并行計算,可以根據不同的任務目標學習最合適的歸納偏置[16]。其中,Dosovitskiy等[17]將原始的Transformer模型應用于圖像分類任務,提出了一種完全基于自注意力機制結構的ViT(Vision Transformer)模型,在諸多視覺任務中取得了良好的效果。

本文基于Vision Transformer模型,采用遷移學習的方法對采集到的4種小麥圖像(白粉病、赤霉病、銹病、健康)進行識別和分類,構建基于Vision Transformer的農作物病害識別模型,對模型進行優化;探究遷移學習和數據增強對ViT模型性能的影響;通過與其他深度學習模型,如AlexNet、VGG16進行對比試驗,比較Vision Transformer模型相較于傳統卷積神經網絡在小麥病害識別任務中差異,為實際生產中小麥病害的精準識別提供理論依據。

1 材料和方法

1.1 構建小麥病害數據集

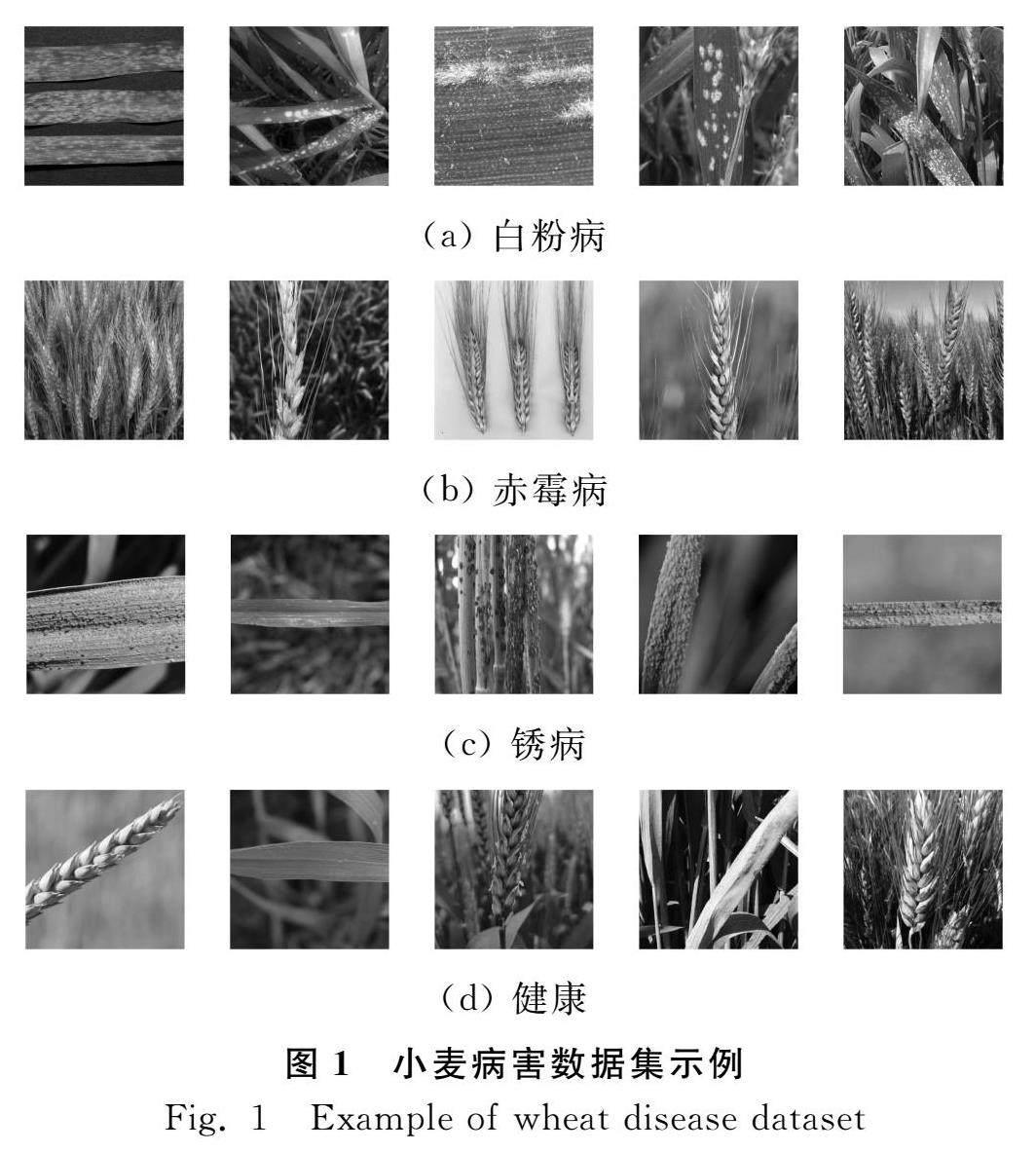

利用Scrapy[18]爬蟲框架從百度、Google和Yahoo三個網站收集感染赤霉病、白粉病、銹病的小麥圖像和健康小麥圖像。由于爬取的小麥病害圖像大多數質量不高,信息比較雜亂且重復圖片較多,人工先選出圖片分辨率大小在1 920像素×1 080像素以上、病害特征明顯的4 000張無重復高清圖片作為原始圖像。然后,將采集到的原始圖像隨機裁剪成像素大小為900×900、600×600和300×300,從中篩選出每種小麥圖像2 000張,共計8 000張圖片。最后,將圖像尺寸統一調整為224像素×224像素,構建小麥病害數據集WDD(Wheat Disease Dataset, WDD),圖1為數據集部分圖片。

(a) 白粉病

(b) 赤霉病

(c) 銹病

(d) 健康

本文數據集已公開至GitHub(https://github.com/houzhs/wdid)。

1.2 Vision Transformer算法

1.2.1 Vision Transformer

Transformer是Google在2017年提出的一種自然語言處理(Natural Language Processing,NLP)經典模型[19]。Transformer模型采用了自注意力機制,這種機制使得模型能夠在處理圖像時全局理解圖像,建立特征之間的依賴關系,并充分利用上下文信息使得模型可以并行化訓練。2018年發布的Image Transformer模型將Transformer應用于圖像分類任務,但該模型依然采用了卷積操作,并未充分發揮Transformer的自注意力機制優勢[20]。直到2020年,Dosovitskiy等提出了ViT(Vision Transformer)模型,首次將原始的Transformer模型應用于圖像分類任務。ViT模型為了將圖像轉化成Transformer結構可以處理的序列數據,引入了圖像塊(patch)的概念。通過線性投影變換和位置編碼,將圖像塊轉化為序列數據,輸入到Transformer中,同時在輸入的序列數據之前添加一個分類標志位(class),以更好地表示全局信息。Transformer中的每一層,自注意力機制能夠捕捉圖像特征之間的依賴關系,并利用上下文信息進行全局理解。將Transformer的輸出經過全連接層和Softmax層,得到圖像的分類結果。此外,ViT模型通常在大型數據集上預訓練,進而針對較小的下游任務進行微調。Vision Transformer模型的整體框架如圖2所示。

Vision Transformer有“ViTBase”“ViTLarge”和“ViTHuge”三個版本,分別具有不同編碼器的層數、隱藏層特征大小、全連接層節點個數、多頭自注意力頭數以及不同的參數規模和性能。Vision Transformer模型不同版本之間的差異如表1所示。

Vision Transformer模型算法流程如下:(1)給定一張圖片X∈R3n×3n,分割該圖片為9個patch,分別為x1,…,x9∈Rn2;將分割后的9個patch拉平,得出x1,…,x9∈Rn2。(2)利用矩陣W∈Rl×n2將拉平后的向量xi∈Rn2,i∈{1,…,9}經過線性變換得到圖像編碼向量zi∈Rl,i∈{1,…,9},具體的計算如式(1)所示。(3)將圖像編碼向量zi,i∈{1,…,9}和類別編碼向量z0分別與對應的位置編碼進行加和得到輸入編碼向量,如式(2)所示。(4)將輸入編碼向量輸入到Vision Transformer Encoder中得到對應的輸出oi∈Rl,i∈{1,…,9}。(5)將類別編碼向量o0輸入全連接神經網絡中MLP中得到類別預測向量y^∈Rc,并與真實類別向量y∈Rc計算交叉熵損失,得到損失值loss,利用優化算法更新模型的權重參數。

zi=W·xi,i∈{1,…,9}

(1)

zi+pi∈Rl,i∈{1,…,9}

(2)

1.2.2 模型搭建

本文采用參數量相對較小的ViTBase模型,該模型編碼器的層數為12,隱藏層維度大小為768,多頭自注意力層使用的自注意力頭的數量為12,其基本結構如圖3所示。ViTBase模型輸入的RGB圖像為224像素×224像素,圖像首先會被一個特殊的卷積層切割為196個像素大小為16×16的圖像塊(patch),卷積層的卷積核大小為16×16,步長為16;然后在圖像塊(patch)上加入類別標簽和位置信息,輸入到Transformer Encoder層中進行全局特征的學習,并采用殘差結構和Dropout層來消除網絡堆疊帶來的梯度消失、爆炸和網絡退化等問題;最后將訓練好的類別標簽進行切片處理作為模型的輸出,輸入到Softmax層根據提取的特征對小麥病害圖像進行識別。

1.2.3 算法優化

為了提高模型的性能,在不改變ViT模型輸入圖像尺寸的基礎上,對Patch Embedding層進行結構優化,首先對原始圖像進行一次下采樣和上采樣提取局部特征,然后將提取的特征圖輸入到ViT模型中進行全局特征的學習,改進前后的Patch Embedding層結構如圖4所示。同時為了降低模型的參數量,在盡可能不損失模型性能的前提下將MLP Block層中第一個全連接層輸出向量的維度由原來的3 072降為1 536,修改后MLP Block層的參數量降低了50%。

(a) 修改前結構

(b) 修改后結構

2 模型訓練

2.1 參數設置

從小麥病害數據集中隨機選取80%的圖片作為訓練集,10%的圖片作為驗證集,剩余10%的圖片作為測試集,用于模型的訓練及測試。模型訓練時,初始學習率(Learning rate)設置為0.000 1,批訓練樣本數(Batch size)設置為16;迭代次數(Epoch)設置為200,每次迭代前隨機打亂訓練集;優化器選擇隨機梯度下降(Stochastic Gradient Descent, SGD)算法[21]。

2.2 模型評價指標

采用平均識別準確率Accuracy對模型進行評價。

Accuracy=1ns∑nsi=1niini×100%

(3)

式中:

ns——樣本類別數量,本文中為4;

ni——第i類樣本數量;

nii——第i類樣本預測正確的數量。

本文取模型200次迭代中驗證集平均識別準確率最高的模型作為最佳模型,并將其應用于測試集進行性能評估。

2.3 試驗環境

試驗使用PyCharm2021.3.3開發環境和Pytorch深度學習框架,操作系統為Ubuntu18.04.2 LTS,處理器為英特爾Xeon E5-2640,服務器搭載2塊Nvidia Tesla K40C圖形處理器,單片GPU內存為12 GB。

3 結果與分析

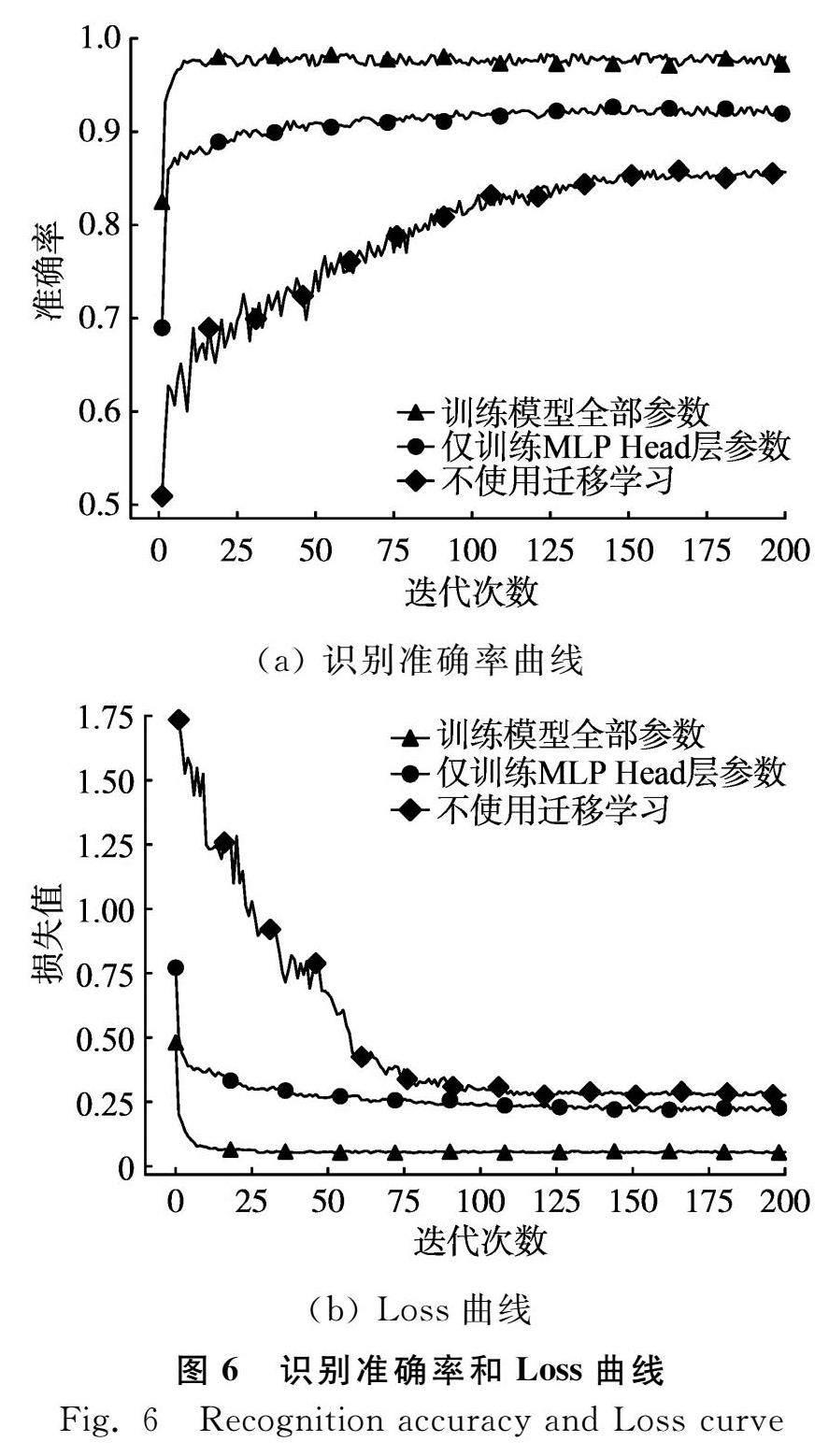

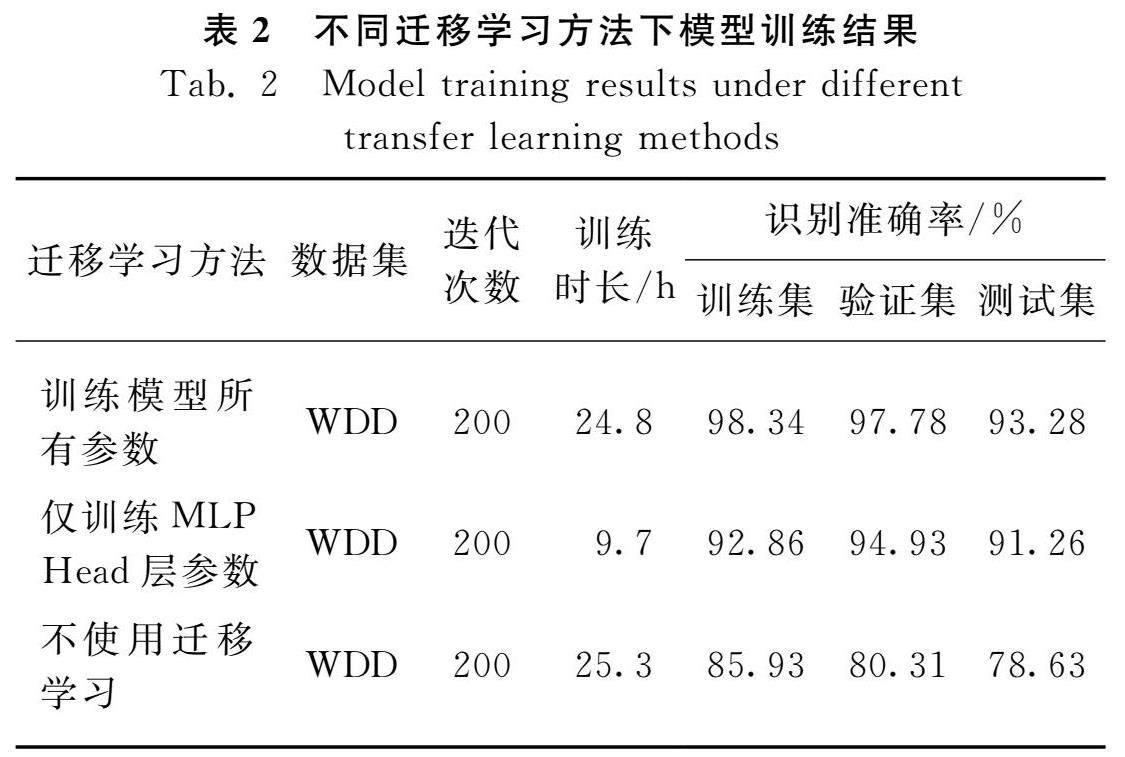

3.1 遷移學習對模型性能的影響

利用遷移學習的思想,將在ImageNet-21k上訓練好的ViTBase模型權重遷移到本次試驗中,遷移學習過程如圖5所示。本文采用訓練模型所有參數和僅訓練模型分類器(MLP Head層)參數兩種遷移學習方式對小麥病害數據集WDD進行特征學習,探討遷移學習對模型性能的影響。不同遷移學習方式下ViT模型在訓練集上的識別準確率和Loss曲線如圖6所示。

(a) 識別準確率曲線

(b) Loss曲線

由表2可知,與不使用遷移學習相比,無論采用何種遷移學習方法對模型進行訓練,ViT模型在訓練集、驗證集和測試集上的識別準確率均有明顯提升。其中,采用訓練模型所有參數的遷移學習方法,模型在測試集上的最高識別準確率為93.28%;采用僅訓練模型分類器參數的遷移學習方法,模型在測試集上的最高識別準確率為91.26%;而不使用遷移學習進行模型訓練時,模型在測試集上的最高識別準確率僅為78.63%。通過觀察圖6中不同遷移學習方法下訓練集上模型識別準確率和Loss曲線可以看出,采用訓練模型所有參數的遷移學習式模型收斂速度最快。

綜上可知,在基于Vision Transformer進行小麥病害識別任務中,使用遷移學習能夠顯著提升模型識別準確率,使模型快速收斂,其中采用訓練模型所有參數的遷移學習方法效果最好。

3.2 數據增強對模型性能的影響

由于田間小麥病害識別準確率會受到背景環境、拍攝角度等多種因素的影響,而本文所構建的小麥病害數據集樣本量較小,不能充分模擬田間復雜的環境,這也可能是導致試驗3.1節中的模型在測試集上的識別準確率明顯低于訓練集和驗證集的原因之一。因此,本試驗采用水平翻轉、隨機角度旋轉和對比度增強3種數據增強的方式對原始數據集進行擴充,探討樣本量大小對模型性能的影響,如圖7所示。擴充后的小麥病害數據集命名為LWDD(Large Wheat Disease Dataset, LWDD),其中包含32 000張小麥病害圖像。根據試驗3.1節結果可知,采用訓練模型所有參數的遷移學習方法在小麥病害識別任務上的訓練效果較好。因此,本次試驗同樣采用這種遷移學習的方式分別在WDD和LWDD數據集上進行ViT模型訓練,試驗結果如表3所示。

(a) 原圖

(b) 水平翻轉

(c) 隨機角度旋轉

(d) 對比度增強

由表3可知,相同的試驗條件下,通過對比數據增強前后ViT模型在訓練集和測試集上的識別準確率,可以發現,數據集擴充后,模型在訓練集、驗證集和測試集上的各項識別精度分別提高了1.12%、2.19%和3.67%。同時,從圖8可以看出,模型在樣本量較大的數據集上進行訓練時,模型收斂更快,并且模型在驗證集上的識別準確率波動的幅度更小,說明在大數據集上訓練時模型更穩定,模型的泛化能力更強。

綜上所述,通過增加數據集的樣本量,能夠有效地提高ViT模型性能,解決因田間復雜的環境、拍攝角度等因素造成模型在測試集上表現不佳的問題,提高模型的泛化能力。后續可以進一步對數據集進行擴充,以提升模型性能。

3.3 不同模型識別精度對比

通過對比本文構建的ViT模型和AlexNet、VGG16兩種經典CNN模型在數據增強后小麥病害數據集LWDD上的訓練結果,探究適合小麥病害識別的深度學習算法。模型訓練過程中,對3種算法模型均采用訓練模型所有參數的遷移學習方式進行訓練,各模型在訓練集上識別準確率曲線如圖9所示。

由圖9可知,相同的試驗條件下,3個網絡模型中ViT模型在訓練集上表現最好,ViT模型在訓練集上識別準確率明顯高于AlexNet和VGG16,并且ViT模型的收斂速度最快。通過觀察表4中的數據可以發現,ViT模型在測試集上的平均識別準確率達到了96.81%,比AlexNet和VGG16分別高出6.68%和4.94%。同時,由表5可以看出,ViT模型對3種小麥病害均取得了較高的識別準確率,其中對小麥赤霉病的識別準確率最高。

圖10是不同模型在測試集上的混淆矩陣對比,混淆矩陣中X軸和Y軸對應著健康、白粉病、銹病和赤霉病4種小麥圖像類別標簽。其中,X軸代表圖像的真實標簽,Y軸代表網絡的預測標簽,當預測標簽與真實標簽一一對應時,圖中顏色越深,證明網絡識別相應標簽的效果越好。利用混淆矩陣可以明顯看出模型預測結果和實際結果之間的誤差。結果表明,ViT模型在小麥病害識別任務中有更好的識別效果。通過分析以上性能指標,可以發現在小麥病害識別任務中,相較于傳統的卷積神經網絡模型,Vision Transformer模型在識別準確率和收斂速度方面優勢明顯。

(a) ViT

(b) AlexNet

(c) VGG16

4 結論

小麥白粉病、赤霉病和銹病是我國小麥生產上的三大主要病害,本文通過采集這3種小麥病害圖片,構建了小麥病害識別數據集,并基于Vision Transformer和遷移學習對小麥病害圖像識別算法展開研究。本研究共設置了3組試驗,其中采用全參數遷移學習和數據增強訓練Vision Transformer模型識別效果最好。通過對各組試驗數據進行分析,得出以下結論。

1) ?將在ImageNet-21k上訓練好的模型權重遷移到Vision Transformer模型上,能夠顯著地提升模型的識別準確率。訓練過程中使用不同的遷移學習方法對模型性能的提升有所差異,其中使用訓練模型全部參數的遷移學習方法取得的識別效果最佳;而采用僅訓練分類器參數的遷移學習方法對模型進行訓練,雖然在識別準確率上略低于訓練模型全部參數的遷移學習方法,但是訓練時間得以大幅縮短;不使用遷移學習的訓練效果最差。

2) ?Vision Transformer模型在數據增強后的數據集上取得的訓練效果更好,模型的泛化能力也更強。在小麥病害圖像識別任務中,擴大數據集的樣本量能夠有效提高模型的識別準確率。考慮到田間復雜環境和拍攝角度等因素可能會對模型識別精度造成影響,本文通過水平翻轉、隨機角度旋轉等數據增強的方式對原始數據集進行擴充,模型在擴充后的數據集上取得了非常好的訓練效果,在測試集上的識別準確率也由原來的93.28%提高到了96.81%。

3) ?在小麥病害識別任務中,相較于傳統的卷積神經網絡模型,本文采用的基于Vision Transformer和遷移學習的小麥病害圖像識別算法的識別準確率更高,在實際應用中更能滿足對作物病害精準、快速診斷的需求。

本文構建的基于Vision Transformer的小麥病害圖像識別算法,雖然在小麥病害識別任務中取得了良好的識別效果,但是Vision Transformer模型參數量較大,訓練時對硬件要求較高,下一步工作需要對模型進行壓縮和優化,在保證模型識別準確率的同時,盡可能地降低模型的參數量,提高模型的泛化能力。

參 考 文 獻

[1]姜玉英, 劉萬才, 黃沖, 等. 2020年全國農作物重大病蟲害發生趨勢預報[J]. 中國植保導刊, 2020, 40(2): 37-39, 53.

[2]史雪巖, 李紅寶, 王海光, 等. 我國小麥病蟲草害防治農藥減施增效技術研究進展[J]. 中國農業大學學報, 2022, 27(3): 53-62.

Shi Xueyan, Li Hongbao, Wang Haiguang, et al. Progresses of pesticide reduction techniques in wheat production and the synergistic effects on the prevention and control of wheat pests [J]. Journal of China Agricultural University, 2022, 27(3): 53-62.

[3]周長建, 宋佳, 向文勝. 基于人工智能的作物病害識別研究進展[J]. 植物保護學報, 2022, 49(1): 316-324.

Zhou Changjian, Song Jia, Xiang Wensheng.Research progresses in artificial intelligencebased crop disease identification [J]. Journal of Plant Protection, 2022, 49(1): 316-324.

[4]秦豐, 劉東霞, 孫炳達, 等. 基于深度學習和支持向量機的4種苜蓿葉部病害圖像識別[J]. 中國農業大學學報, 2017, 22(7): 123-133.

Qin Feng, Liu Dongxia, Sun Bingda, et al. Image recognition of four different alfalfa leaf diseases based on deep learning and support vector machine [J]. Journal of China Agricultural University, 2017, 22(7): 123-133.

[5]Wang J, Jiang H, Chen Q. Highprecision recognition of wheat mildew degree based on colorimetric sensor technique combined with multivariate analysis [J]. Microchemical Journal, 2021, 168: 106468.

[6]Feng L, Wu B, Zhu S, et al. Investigation on data fusion of multisource spectral data for rice leaf diseases identification using machine learning methods [J]. Frontiers in Plant Science, 2020, 11: 577063.

[7]周惠汝, 吳波明. 深度學習在作物病害圖像識別方面應用的研究進展[J]. 中國農業科技導報, 2021, 23(5): 61-68.

Zhou Huiru, Wu Boming. Advances in research on deep learning for crop disease image recognition [J]. Journal of Agricultural Science and Technology, 2021, 23(5): 61-68.

[8]Chen H C, Widodo A M, Wisnujati A, et al. AlexNet convolutional neural network for disease detection and classification of tomato leaf [J]. Electronics, 2022, 11(6): 951.

[9]Chen J, Chen J, Zhang D, et al. Using deep transfer learning for imagebased plant disease identification [J]. Computers and Electronics in Agriculture, 2020, 173: 105393.

[10]Li Y, Wang H, Dang L M, et al. Crop pest recognition in natural scenes using convolutional neural networks [J]. Computers and Electronics in Agriculture, 2020, 169: 105174.

[11]Rangarajan A K, Purushothaman R, Ramesh A. Tomato crop disease classification using pretrained deep learning algorithm [J]. Procedia Computer Science, 2018, 133: 1040-1047.

[12]侯志松, 冀金泉, 李國厚, 等. 集成學習與遷移學習的作物病害圖像識別算法[J]. 中國科技論文, 2021, 16(7): 708-714.

Hou Zhisong, Ji Jinquan, Li Guohou, et al. Crop disease image recognition algorithm based on ensemble learning and transfer learning [J]. China Sciencepaper, 2021, 16(7): 708-714.

[13]周宏威, 沈恒宇, 袁新佩, 等. 基于遷移學習的蘋果樹葉片病蟲害識別方法研究[J]. 中國農機化學報, 2021, 42(11): 151-158.

Zhou Hongwei, Shen Hengyu, Yuan Xinpei, et al. Research on identification method of apple leaf diseases based on transfer learning [J]. Journal of Chinese Agricultural Mechanization, 2021, 42(11): 151-158.

[14]張珂, 馮曉晗, 郭玉榮, 等. 圖像分類的深度卷積神經網絡模型綜述[J]. 中國圖象圖形學報, 2021, 26(10): 2305-2325.

Zhang Ke, Feng Xiaohan, Guo Yurong, et al. Overview of deep convolutional neural networks for image classification [J]. Journal of Image and Graphics, 2021, 26(10): 2305-2325.

[15]劉文婷, 盧新明. 基于計算機視覺的Transformer研究進展[J]. 計算機工程與應用, 2022, 58(6): 1-16.

Liu Wenting, Lu Xinming. Research progress of Transformer based on computer vision [J]. Computer Engineering and Applications, 2022, 58(6): 1-16.

[16]Vaswani A, Shazeer N, Parmar N, et al. Attention is all you need [J]. Advances in Neural Information Processing Systems, 2017, 30.

[17]Dosovitskiy A, Beyer L, Kolesnikov A, et al. An image is worth 16×16 words: Transformers for image recognition at scale [J]. arXiv preprint arXiv: 2010.11929, 2020.

[18]Ma X, Yan M. Design and implementation of craweper based on Scrapy [C]. Journal of Physics: Conference Series. IOP Publishing, 2021, 2033(1): 012204.

[19]張重生, 陳杰, 縱瑞星, 等. 基于Transformer的低質場景字符檢測算法[J]. 北京郵電大學學報, 2022, 45(2): 124-130.

Zhang Chongsheng, Chen Jie, Zong Ruixing, et al. Transformer based scene character detection over low quality images [J]. Journal of Beijing University of Posts and Telecommunications, 2022, 45(2): 124-130.

[20]Parmar N, Vaswani A, Uszkoreit J, et al. Image transformer [C]. International Conference on Machine Learning. PMLR, 2018: 4055-4064.

[21]Barani F, Savadi A, Yazdi H S. Convergence behavior of diffusion stochastic gradient descent algorithm [J]. Signal Processing, 2021, 183: 108014.