SAR圖像NSCT域顯著圖去噪變化檢測

慕彩紅, 吳生財, 劉 逸, 彭 鵬, 劉若辰

(1. 西安電子科技大學 智能感知與圖像理解教育部重點實驗室,陜西 西安 710071; 2. 西安電子科技大學 電子工程學院,陜西 西安 710071; 3. 西安電子科技大學 物理與光電工程學院,陜西 西安 710071)

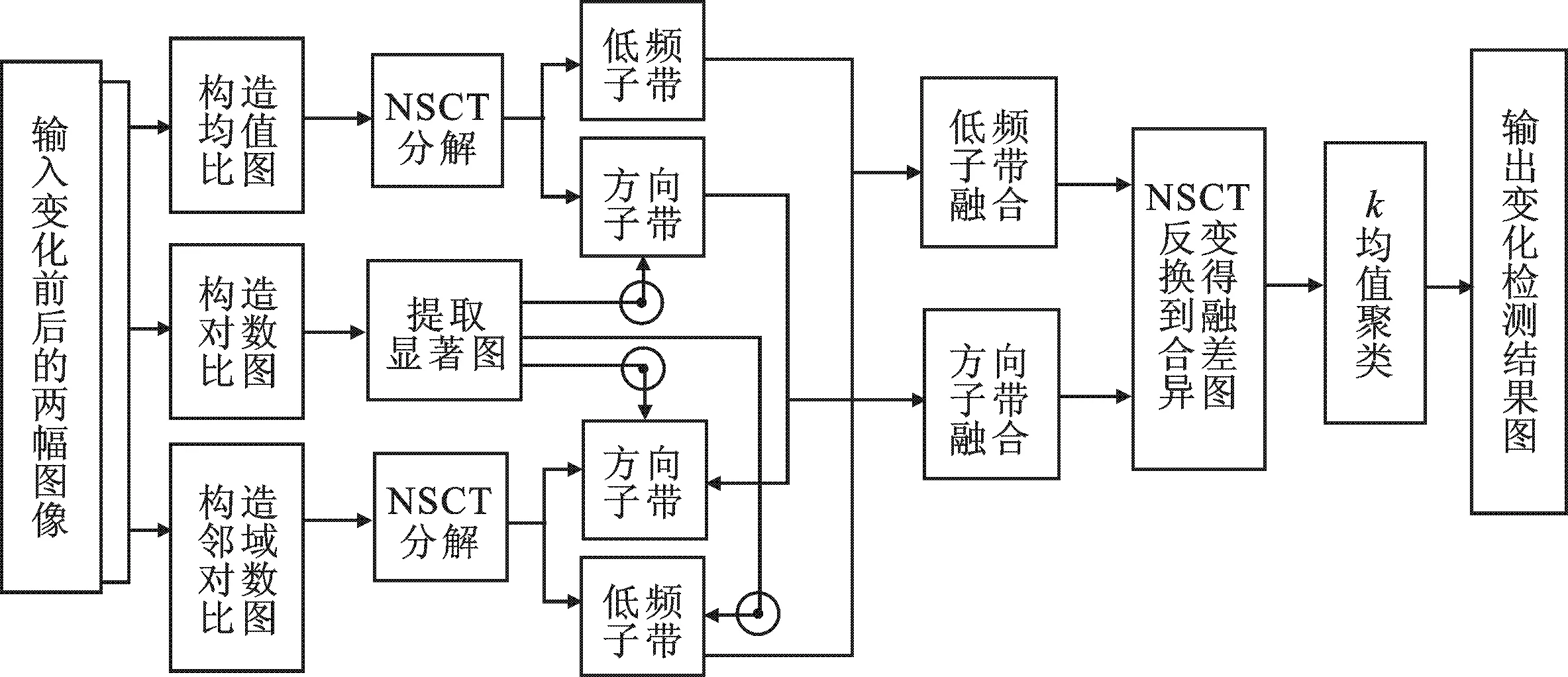

合成孔徑雷達(Synthetic Aperture Radar, SAR)因其全天候、全天時探測能力和強大的對地穿透的能力,已成為變化檢測的熱門信息源.SAR圖像變化檢測技術[1-4]在氣候變化、自然災害評估、戰場目標打擊效果評估和軍事偵察等領域有著廣闊的應用前景.隨著研究人員對SAR圖像變化檢測技術的深入研究,陸續提出了很多方法.通常情況下,根據是否利用先驗知識,可以將SAR圖像變化檢測方法分為有監督變化檢測和無監督變化檢測方法兩類,其中以無監督變化檢測方法較為常見.文獻[5]提出一種基于小波融合和主成分分析(Principal Component Analysis,PCA)-核模糊聚類的遙感圖像變化檢測方法,對光譜遙感圖像和SAR圖像均可取得良好的變化檢測效果; 文獻[6]將鄰域信息粒子群聚類用于SAR圖像變化檢測,充分利用了像素的鄰域信息,增強了抗噪性能,提高了變化檢測精度; 文獻[7]提出了一種基于顯著圖導向的SAR圖像變化檢測方法,將視覺感知技術應用到變化檢測領域,取得了不錯的效果.近年來,利用圖像顯著性進行SAR圖像變化檢測的方法引起了一些研究人員的興趣.所謂圖像的顯著性,就是模擬生物視覺關注機制的一種選擇性注意模型,當人觀察一幅圖片時總是第一時間無意識地將目光聚焦在一些具備顯著特征的區域,這一生物觀察機制可以很好地應用于圖像處理的許多領域.文獻[8]將顯著性提取的方法應用到探測高分辨衛星圖像中的感興趣區域,文獻[7]將顯著性信息應用到了SAR圖像變化檢測領域.但是完全以顯著信息為導向的變化檢測技術還是有其固有的缺點.圖像顯著性獲取的原理與人眼在關注圖像時把注意力集中在特征明顯區域的原理相類似,當圖像的鮮明特征區域相對集中時,就能提取到完整的顯著圖,當圖像的鮮明特征區域比較分散時,往往只會提取到鮮明特征最集中和最顯著的區域,而忽略偏遠和邊緣的一些區域,從而造成顯著信息的缺失.如果以這樣的顯著圖引導變化檢測,就會從源頭上漏檢部分像素,影響檢測精度.為解決上述問題,筆者采用圖像融合的策略,在非下采樣輪廓變換(NonSubsampled Contourlet Transform, NSCT)[9]域運用顯著圖信息對鄰域對數比圖的低頻子帶進行范圍限定,提高均值比圖低頻系數所占比例,以突出融合差異圖的變化區域; 對這兩幅差異圖的方向子帶則采用顯著圖進行選擇性的去噪,再采用局部能量最小原則進行融合,以抑制融合差異圖的背景區域; 最后對融合差異圖進行k均值聚類,得到檢測結果圖.該方法綜合利用了均值比圖的變化區域接近實際的特點和鄰域對數比圖的背景區域平滑的特點,且對NSCT分解后的低頻子帶和方向子帶運用顯著信息設計了有利于提高融合差異圖質量的融合策略,確保了變化區域的完整,為獲取精確的變化檢測結果圖打下了良好的基礎.圖1是文中方法的流程圖,圖形⊙表示引入顯著圖信息,從圖1中可以看出,在低頻子帶和方向子帶的融合過程中均引入了顯著圖信息.

圖1 文中方法的流程圖

1 顯著圖的提取

用已配準和校正的兩時刻SAR圖像I1和I2分別構造均值比差異圖[5]D1,對數比差異圖[5]D和鄰域對數比差異圖D2,其中鄰域對數比差異圖D2的構造方法如下: 首先對兩幅輸入圖像中以對應像素(i,j)為中心的 3×3 局部鄰域進行大小為3、標準偏差為5的高斯濾波,得到鄰域矩陣l1和l2;其次,計算局部鄰域內對應像素灰度值的對數比,得到局部鄰域對數比矩陣Zlog在像素(m,n)的值,其中,m,n是局部鄰域內的像素的橫縱坐標;接著,遍歷l1和l2鄰域內所有對應像素,得到局部鄰對數比矩陣Zlog,以Zlog的均值d2(i,j)作為鄰域對數比差異圖D2在像素(i,j)處的值.按上述步驟遍歷兩幅圖像所有對應像素,得到鄰域對數比差異圖D2= {d2(i,j)}.

下面介紹顯著圖的提取.利用上下文感知的顯著性檢測方法[10]從對數比值圖D中提取顯著圖.將對數比值圖D切分成多個塊,將以i像素為中心的塊xi與所有的其他塊xj在Lab顏色空間作對比,如果xi和xj之間的差距大,則說明是顯著性特征.dv(xi,xj)表示xi和xj之間的顏色距離,取值范圍為[0,1],即為兩圖像塊在Lab空間的歐幾里得顏色距離;dp(xi,xj)表示向量xi和xj之間的空間距離,取值范圍為[0,1],即為兩圖像塊的歐幾里得位置距離.一對圖像塊xi和xj之間的顏色距離越大,位置距離越小,則它們的差異值越大,得到顏色距離和空間距離以后,則兩個塊向量之間的非相似性FS可表示為

FS(xi,xj)=dv(xi,xj)/(1+cdp(xi,xj)),

(1)

其中,c=3.為了判斷精準,以任意像素i為中心的圖像塊xi需要與多個尺度的A個圖像塊去計算顯著值,背景區域在多個尺度上都是和其他塊相似的,所以在多個尺度上計算可以降低背景區域的顯著性.以任意像素i為中心的圖像塊xi在單尺度h上的顯著值為

(2)

按下式整合所有尺度h上的顯著值,并加入上下文修正,便得到該像素在對數比圖D中的顯著值,即

(3)

其中,H包括{100%, 80%, 50%, 30%}4個等級,M是等級數 (M=4);[·]表示把當前規模的圖像尺寸恢復到原圖像的尺寸大小;dfoci,h(i)表示在h尺度上像素i與離它最近的焦點像素之間的歐式距離,其值的取值范圍為[0,1]; 文中圖像塊數量A=64,圖像塊尺寸為 7×7,選取時有50%的像素重疊,遍歷所有像素便得到了對數比值圖D的顯著區域圖S= {Si},更多詳細內容見文獻[8].最后采用最大類間方差法[11]從顯著區域圖S中提取顯著圖Y,并將Y中顯著區的像素值轉化為1,非顯著區像素值轉化為0.當用顯著圖Y與任意圖像矩陣相乘后,顯著區內的像素保留原圖像像素的灰度值,顯著區外的像素值則全部為零,有判別性信息的顯著區被完好保存,而非顯著區中的噪聲則被過濾.

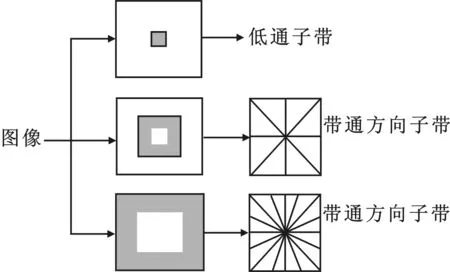

圖2 NSCT的結構示意圖

2 融合差異圖的構造及變化檢測

2.1 非下采樣輪廓變換

NSCT是一種利用迭代非下采樣濾波器組來實現一系列多分辨率、多方向和平移不變的頻域子圖像的算法,具有良好的多方向性、各向異性和平移不變性,能夠很好地保持圖像的奇異信息,細節保持能力強.其分解過程可表述為: 先利用非下采樣塔式濾波器組對圖像進行多尺度的分解,得到各種不同頻率的高頻子帶圖像和一個低頻子帶圖像,然后再利用非下采樣方向濾波器組對各高頻子帶圖像進行多方向分解,從而得到不同尺度、不同方向的子帶系數,如圖2所示.SAR圖像經NSCT分解后除低頻子帶中包含的少量噪聲外,絕大部分噪聲主要包含在方向子帶中,且分解級數越高,其方向子帶包含的細節信息和噪聲越多.

2.2 融合差異圖的構造

對均值比圖D1和鄰域對數比圖D2進行3級NSCT變換,分別產生1個低頻子帶和14個方向子帶.其中低頻子帶包含了圖像的輪廓信息,能夠充分體現出變化區域,鄰域對數比圖的變化區域與實際的變化不相符,而均值比圖的變化區域接近于實際情況,因此在低頻融合時就增加均值比圖的低頻子帶系數的比例,減少鄰域對數比圖的低頻子帶系數的比例,以確保融合差異圖的變化區域更接近于實際情況; 方向子帶包含的是圖像的細節信息和噪聲,由于不同的SAR圖像受噪聲污染的程度不同,引入濾波參數K來決定對哪幾層對應的方向子帶進行顯著圖去噪,設定當K=1 時,對第3層的8個方向子帶去噪;K=2 時,對第2層和第3層的12個方向子帶進行去噪;K=3 時,對所有層的14個方向子帶進行去噪,每幅圖像經過3次試驗就可以得到K的最佳取值.

2.2.1低頻子帶融合

首先對均值比圖的低頻子帶系數進行高斯濾波以過濾低頻子帶中的噪聲鄰域對數比圖在構造過程中已進行了3次濾波,且所占比例小,因此不進行濾波.其次對鄰域對數比圖的低頻子帶按下式用顯著圖進行范圍限定:

D2, LY=D2,L⊙Y,

(4)

其中,D2, L表示鄰域對數比圖的低頻子帶系數,Y為顯著圖,⊙為矩陣對應元素相乘運算,D2, LY為經顯著圖限定后的鄰域對數比圖的低頻子帶系數,該系數在顯著區內為鄰域對數比圖的低頻子帶的系數值,非顯著區的系數值均變成0.然后按下式對低頻子帶系數進行融合:

DL=0.5D1, L+0.5D2, LY,

(5)

其中,D1, L為均值比圖的低頻子帶系數,DL為融合后的低頻子帶系數,該系數在顯著區外為均值比圖的低頻子帶系數,在顯著區域內為融合系數.均值比圖的低頻子帶系數占有比例多,利于突出變化區域的信息.

2.2.2方向子帶融合

圖像經NSCT分解后的方向子帶包含的是圖像的細節信息和噪聲,其中第3層的8個方向子帶包含的細節和噪聲信息最多,前2層相對較少.首先,按濾波參數K對兩幅差異圖的方向子帶進行顯著圖去噪以濾除方向子帶的非顯著區域中的噪聲.其表達式為

(6)

其中,D(1,2), H, r, n表示均值比圖D1或鄰域對數比圖D2中第r層的第n個方向子帶系數.當濾波參數K的取值為{1, 2, 3}時,就對K所對應分解層數的方向子帶系數進行顯著圖去噪.

其次,按局部能量最小原則對均值比圖D1和鄰域對數比圖D2的方向子帶系數D1, H, r, n和D2, H, r, n進行融合.采用局部能量最小原則可以合并來自兩幅差異圖方向子帶的同質區域,起到抑制背景信息和去噪的作用.使融合差異圖的背景區域保持平滑局部能量最小原則的表達式為

(7)

其中,r={1,2,3},表示分解的層數;n={1, 2, 3,…,13, 14};DH,r,n(i,j)表示融合后的方向子帶系數在像素(ij)處的值;D1,H,r,n(i,j)和D2,H,r,n(i,j)分別表示均值比圖D1和鄰域對數比圖D2在第r層的第n個方向子帶系數在像素(ij)處的值;E1,r,n(i,j)和E2,r,n(i,j)分別表示兩幅差異圖在第r層的第n個方向子帶系數中以像素(i,j)為中心的局部能量系數值,按下式計算:

(8)

其中,Nij表示以像素(i,j)為中心的3×3局部鄰域窗口的大小,D(1,2), H, r, n(B)表示均值比圖D1和鄰域對數比圖D2中第r層第n個方向子帶系數在鄰域窗口Nij內的第B個元素的值.

2.2.3NSCT反變換和k均值聚類

對融合后的1個低頻子帶DL和3個分解層的14個方向子帶DH, r, n進行NSCT反變換后,得到融合差異圖Xd,該圖兼顧了均值比圖的變化區域接近實際情況的特點和鄰域對數比圖的背景區域(非變化區域)相對平滑的特點,且抗噪能力好.最后采用k均值聚類方法對融合差異圖Xd進行兩分類,輸出變化檢測結果圖.

3 對比實驗結果分析與有效性驗證

3.1 實驗數據集介紹

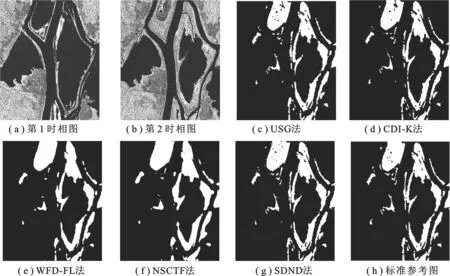

第1個數據集是分別于1999年4月和1999年5月獲得的伯爾尼地區兩時相SAR圖像,尺寸均為 301× 301,像素灰度級為256,圖3(a)是洪水侵襲前的圖像,圖3(b)是洪水侵襲后的圖像,圖3(h)是標準檢測結果圖,包括 1 269 個變化像素點.第2個數據集是星載SAR傳感器分別于1997年5月和1997年8月拍攝的渥太華地區的兩時相SAR圖像,尺寸均為 290× 250,灰度級為256,圖4(a)是洪水侵襲前的圖像,圖4(b)是洪水侵襲后的圖像,圖4(h)為標準檢測結果圖,包括 16 049 個變化像素點.筆者用漏檢數誤檢數總錯誤數和Kappa系數共4個定量分析指標[12]來評價檢測結果.

圖3 伯爾尼地區SAR圖像數據集變化檢測結果

圖4 渥太華地區SAR圖像數據集變化檢測結果

3.2 對比實驗結果和分析

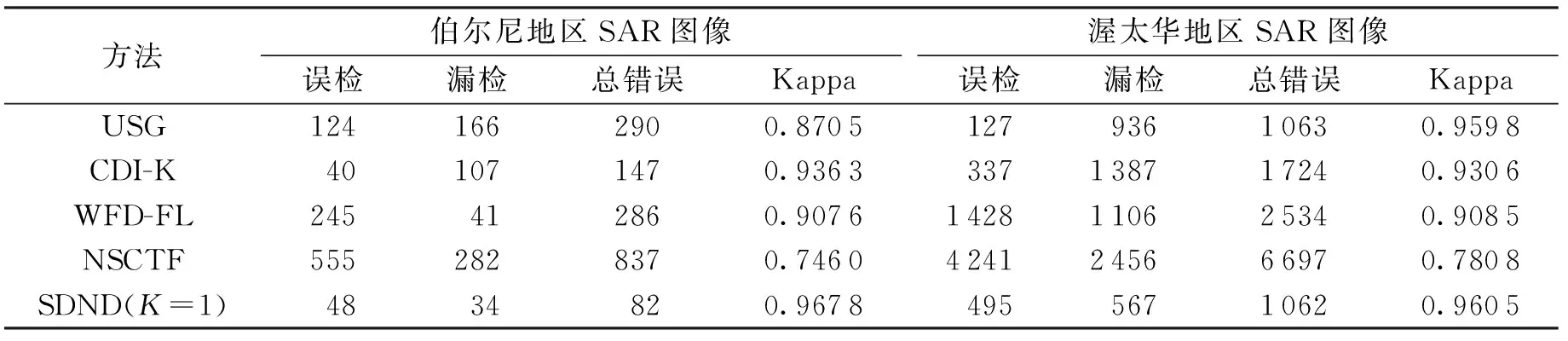

用文中方法NSCT域顯著圖去噪(Saliency map Denoising in Non subsampled contourlet transform Domain,SDND)與文獻[7]提出的“Unsupervised saliency-guided SAR image change detection”(USG)和“Using Combined Difference Image and K-means Clustering for SAR Image Change Detection[13]”(CDI-K),文獻[14]提出的“Wavelet Fusion on Ratio Images for Change Detection in SAR Images”(WFD-FL)以及文獻[15]提出的“混合的SAR圖像變化檢測算法[15]”(NSCTF)在兩個數據集上進行對比實驗,其實驗結果如表1、圖3和圖4所示.

表1 文中方法與現有方法的變化檢測結果比較

從圖3、圖4和表1可以得出如下結論,文中方法在2個SAR圖像數據集上的所檢測結果圖在直觀效果上與標準檢測圖最接近,USG法和CDI-K法的漏檢像素數多變化區域不完整; WFD-FL法和NSCT法的檢測結果圖在直觀效果上都存在邊緣區域和細節信息不清晰,特別是NSCTF方法的檢測結果圖基本看不出變化區域的邊緣和細節,只能看清變化區域的輪廓,與標準檢測圖差距很大.文中方法的漏檢數與誤檢數相對均衡,總錯誤數和Kappa系數均優于4種現有的對比方法,主要原因: 一是文中方法采用融合策略,綜合利用了均值比圖的變化區域接近實際的特點和鄰域對數比圖的背景區域相對來說平滑的特點; 二是采用NSCT變換構造融合差異圖,利于增強去噪效果和細節結構的保持能力; 三是構造融合差異圖的過程中對低頻子帶系數所占有的比例用顯著圖進行分配調整以突出變化區域,對方向子帶中的噪聲用顯著圖進行過濾并采用局部能量最小原則進行融合以抑制背景信息,從而使融合后的差異圖既接近于實際變化情況,又具備很強的抗噪能力,有利于提高變化檢測精度.

4 結 束 語

文中提出了一種在NSCT域結合顯著圖信息構造融合差異圖的SAR圖像變化檢測方法.首先分別構造均值比、對數比和鄰域對數比差異圖,并用對數比圖獲取顯著圖; 然后對均值比圖和鄰域對數比圖進行3級NSCT分解,低頻融合時對鄰域對數比圖的低頻子帶用顯著圖進行范圍限定,以突出融合差異圖的變化區域; 高頻融合時對兩幅差異圖的方向子帶進行選擇性的顯著圖限定去噪,再采用局部能量最小的原則進行融合,以抑制融合差異圖的背景區域; 最后經過NSCT反變換,得到融合差異圖并進行k均值聚類,輸出檢測結果圖.實驗證明,文中方法抗噪能力強,邊緣細節保持好,檢測精度高.

參考文獻:

[1] VU V T, PETTERSSON M I, MACHADO R, et al. False Alarm Reduction in Wavelength-resolution SAR Change Detection Using Adaptive Noise Canceler[J]. IEEE Transactions on Geoscience and Remote Sensing, 2017, 55(1): 591-599.

[2]LI H, GONG M, WANG Q, et al. A Multiobjective Fuzzy Clustering Method for Change Detection in SAR Images[J]. Applied Soft Computing Journal, 2016, 46: 767-777.

[3]GONG M G, ZHAO J, LIU J, et al. Change Detection in Synthetic Aperture Radar Images Based on Deep Neural Networks[J]. IEEE Transactions on Neural Networks and Learning Systems, 2016, 27(1): 125-138.

[4]MU C H, LI C, LIU Y, et al. Change Detection in SAR Images Based on the Salient Map Guidance and an Accelerated Genetic Algorithm[C]//Proceedings of the 2017 IEEE Congress on Evolutionary Computation. Piscataway: IEEE, 2017: 1150-1157.

[5]慕彩紅, 霍利利, 劉逸, 等. 基于小波融合和PCA-核模糊聚類的遙感圖像變化檢測[J]. 電子學報, 2015, 43(7): 1375-1381.

MU Caihong, HUO Lili, LIU Yi, et al. Change Detection for Remote Sensing Images Based on Wavelet Fusion and PCA-kernel Fuzzy Clustering[J]. Acta Electronica Sinica, 2015, 43(7): 1375-1381.

[6]劉逸, 慕彩紅, 劉敬. 結合鄰域信息粒子群聚類用于SAR圖像變化檢測[J]. 西安電子科技大學學報, 2015, 42(1): 187-193.

LIU Yi, MU Caihong, LIU Jing. Change Detection for SAR Images Based on the Particle Swarm Clustering Algorithm Using Neighborhood in Formation[J]. Journal of Xidian University, 2015, 42(1): 187-193.

[7]ZHENG Y G, JIAO L C, LIU H Y, et al. Unsupervised Saliency-guided SAR Image Change Detection[J]. Pattern Recognition, 2017, 61: 309-326.

[8]ZHANG F, DU B, ZHANG L. Saliency-guided Unsupervised Feature Learning for Scene Classification[J]. IEEE Transactions on Geoscience and Remote Sensing, 2015, 53(4): 2175-2184.

[9]da CUNHA A L, ZHOU J, DO M N. The Nonsubsampled Contourlet Transform: Theory, Design, and Applications[J]. IEEE Transactions on Image Processing, 2006, 15(10): 3089-3101.

[10]GOFERMAN S, ZELNIK-MANOR L, TAL A. Context-aware Saliency Detection[J]. IEEE Transactions on Pattern Analysis and Machine Intelligence, 2012, 34(10): 1915-1926.

[11]OTSU N. A Threshold Selection Method from Gray-level Histograms[J]. IEEE Transactions on System, Man and Cybemetics, 1979, 9(1): 62-66.

[12]付明柏. 基于UDWT與Snake模型的多時相SAR圖像變化檢測方法[J]. 計算機應用與軟件, 2014, 31(4): 254-257.

FU Mingbai. Multitemporal SAR Images Change Detection Method Based on UDWT and Snake Models[J]. Computer Applications and Software, 2014, 31(4): 254-257.

[13]ZHENG Y G, ZHANG X, HOU B, et al. Using Combined Difference Image and,k-means Clustering for SAR Image Change Detection[J]. IEEE Geoscience and Remote Sensing Letters, 2013, 11(3): 691-695.

[14]MA J J, GONG M, ZHOU Z. Wavelet Fusion on Ratio Images for Change Detection in SAR Images[J]. IEEE Geoscience and Remote Sensing Letters, 2012, 9(6): 1122-1126.

[15]李玲玲, 賈振紅, 覃錫忠, 等. 混合的SAR圖像變化檢測算法[J]. 計算機工程與設計, 2015, 36(5): 1256-1259.

LI Lingling, JIA Zhenhong, QIN Xizhong, et al. Hybrid SAR Image Change Detection Algorithm[J]. Computer Engineering and Design, 2015, 36( 5): 1256-1259.