面向對象和多分類器的棉花出苗信息快速提取方法

閆春雨,趙靜,蘭玉彬,魯力群,楊東建,溫昱婷

(1.山東理工大學 農業工程與食品科學學院,山東 淄博 255049;2.山東理工大學 國際精準農業航空應用技術研究中心,山東 淄博 255049;3.山東理工大學 交通與車輛工程學院,山東 淄博 255049)

棉花作為中國重要的經濟作物之一,在國民經濟中有著舉足輕重的地位,與其他大宗農產品相比有一定的收益優勢[1]。作物的出苗期是其生長的初始物候期,也是其關鍵物候期之一[2]。棉田中若出現棉苗弱小或缺苗斷壟會嚴重影響棉花的品質與產量。苗期管理是棉花經營管理的核心,快速提取棉花出苗信息可為苗期管理提供指導。傳統獲取棉花出苗信息的主要手段是靠實地調研測量,以人的主觀判斷與個人經驗為主,對于大面積的棉田來說耗時費力、判別準確率與精確性較低。

無人機具有機動靈活、響應快、高分辨率、更新速度快等優勢。遙感技術具有獲取信息快、覆蓋面積大、獲取成本相對低等優勢。無人機遙感技術作為新的信息獲取手段已越來越多地用于農作物氮含量、植被覆蓋度和作物產量等信息的獲取[3]。精準農業的迅速發展要求更準確、快速、低成本地獲取各種作物生長信息。李明等[4]利用多尺度分割對水稻種植面積進行提取,與目視解譯結果相比面積誤差小于3.5%。雷亞平等[5]利用HIS閾值法對無人機獲取的低空棉田數字圖像進行棉苗識別,精度超過90%。魏文麗等[6]利用NDVI均值及均方差對研究區玉米出苗情況進行提取,總體積精度達80%。董梅等[7]利用面向對象方法對無人機拍攝的煙草遙感影像進行種植面提取和監測,為大區域的煙草種植面積監測提供了參考。面向對象的無人機遙感影像在棉花苗情信息方面的提取研究鮮有報道。本研究利用無人機拍攝的棉苗正射圖像,通過面向對象的分類思想,采用機器學習分類器快速提取棉花苗期出苗信息,提取結果可為苗期管理提供及時的參考。

1 材料與方法

1.1 研究區概況

研究區地處冀魯豫三省交界處(如圖1所示),屬黃河下游沖積平原。試驗小區地勢平坦,土地肥沃,土質以沙壤為主,屬典型的溫帶大陸性季風氣候,年平均降水量為600 mm左右,年平均日照時數2 629.7 h,年平均氣溫為12.8 ℃,年無霜期平均206 d,非常適宜棉花生長,為黃淮流域棉花生態區的典型代表。

圖1 研究區位置與研究區分布Fig.1 Location and distribution of research area

1.2 數據獲取與處理

本研究數據于2019年5月20日在山東棉花研究中心(臨清棉花試驗站)采集。數據獲取的設備為深圳市大疆創新科技有限公司生產的Mavic 2無人機,該無人機將可見光相機與三軸增穩云臺設計于一體,保證了高質量圖像的獲取。無人機重量為907 g、展開尺寸322 mm×242 mm×84 mm、最長飛行時間31 min(無風環境25 km/h勻速飛行)、最遠續航里程18 km(無風環境);相機使用的傳感器為1英寸CMOS、有效像素2 000萬,最大照片尺寸5 472×3 648。拍攝時無人機飛行高度為30 m,航向重疊率與旁向重疊率均為85%。拍攝時間為當天的12:00-14:00,天氣晴朗,相機曝光模式為自動。

本研究借助Pix4Dmapper軟件對無人機獲取的高清影像進行拼接處理。將帶有POS數據的原始影像與地面控制點數據導入,便可自動完成空三測量,生成DSM、DOM,拼接過程中可以使用GPU加速處理。航拍前在無人機飛行區域內設置50 cm×50 cm幾何參考板(如圖2所示),幾何參考板由兩塊黑色布和兩塊白色布十字相間粘貼而成,幾何參考板在棉花整個生長周期內是保持固定不變的。幾何參考板的中心點為地面控制點,為后期影像拼接時提供參考,用以提高影像拼接精度,降低相機的系統誤差。

圖2 幾何參考板Fig.2 Geometric reference board

2 研究方法

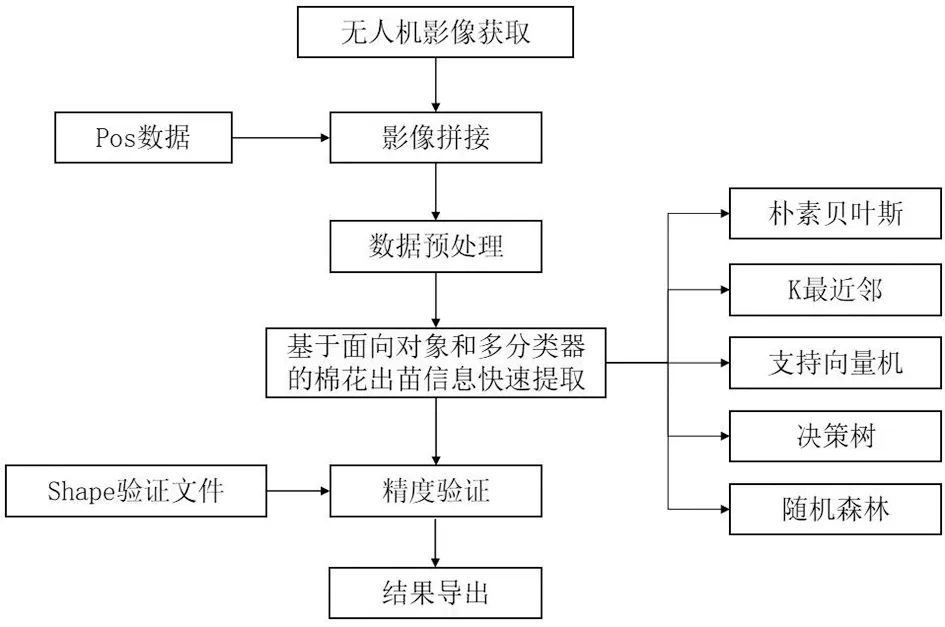

無人機拍攝的影像具有空間分辨率高和色彩鮮明的特點,高分辨率影像能夠更清晰地表達地物拓補關系、紋理和形狀等特征[8]。在高分辨率影像的分類中,面向對象的分類方法有著廣泛的應用。本研究使用的是只有紅、綠、藍3個通道的JPEG圖像,只采用基于單個像元光譜信息對地物進行分類會造成分類精度不高,對遙感圖像處理帶來不利影響。通過面向對象的分類方法,不僅利用單一像素的光譜信息,而且能充分利用遙感影像的形狀、大小、紋理以及上下文聯系等特征,可以更好地提取遙感影像中的有效信息,進而提高分類的精度[9]。在本研究中通過采用基于面向對象的分類方法,將棉花、地膜和土壤進行分類。因為分類中包含棉花,所以在三種地物信息分類完成的同時也就完成了棉花出苗信息的提取。數據處理軟件使用eCognition Essentials,分割算法采用多尺度分類算法,技術路線如圖3所示。

圖3 技術路線Fig.3 Technical route

2.1 面向對象分類的思路

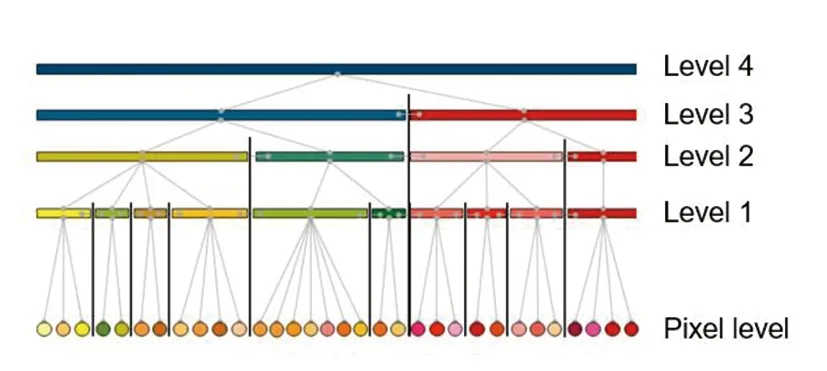

面向對象的遙感影像分析技術在地理信息科學與遙感領域取得了突出的成績,尤其是對高分辨率遙感影像的處理效果更佳。多尺度分割的目的是把遙感影像分割成影像對象,若干個滿足一定同質標準的基本像元單元組成了具有多邊形區域的影像對象。利用eCognition Essentials軟件進行面向對象分類分析,首先在經任一尺度分割后生成初始影像對象,該軟件能夠生成多個層,并把這幾個層進行組織形成等級結構,生成的第一個對象層的下限是像素層,上限是整幅影像。后續新產生的影像對象層,可以放在已有層的上層、中間層或下層。在這個具有拓補關系的網絡結構中,每一個對象都知道自己的子對象、父對象和相鄰對象。比如,子對象的邊界是由父對象決定的,子對象的總和決定了父對象的區域大小。對象層的層次結構展示的不同尺度的影像對象信息,對象層次結構如圖4所示。

圖4 影像對象層次結構Fig.4 Image object hierarchy

2.2 多尺度分割

影像分割質量的好壞直接影響后期分析處理的結果。影像分割是基于對象影像分析的關鍵和基礎,后續的影像分析對分割出的影像對象有嚴格的要求,使分割出來的對象同時具備非連續性和相似性兩大特征,非連續性是指影像對象區域邊界處特征不連續,相似性是指影像對象內的所有像素都基于色彩、紋理、灰度等滿足某種相似性準則[10-12]。eCogniton Essential軟件能夠進行任意分辨率的區域合并算法,因此需要設置合理的分割尺度參數來控制合并算法的閾限,從而滿足提取不同尺度地物的需要。

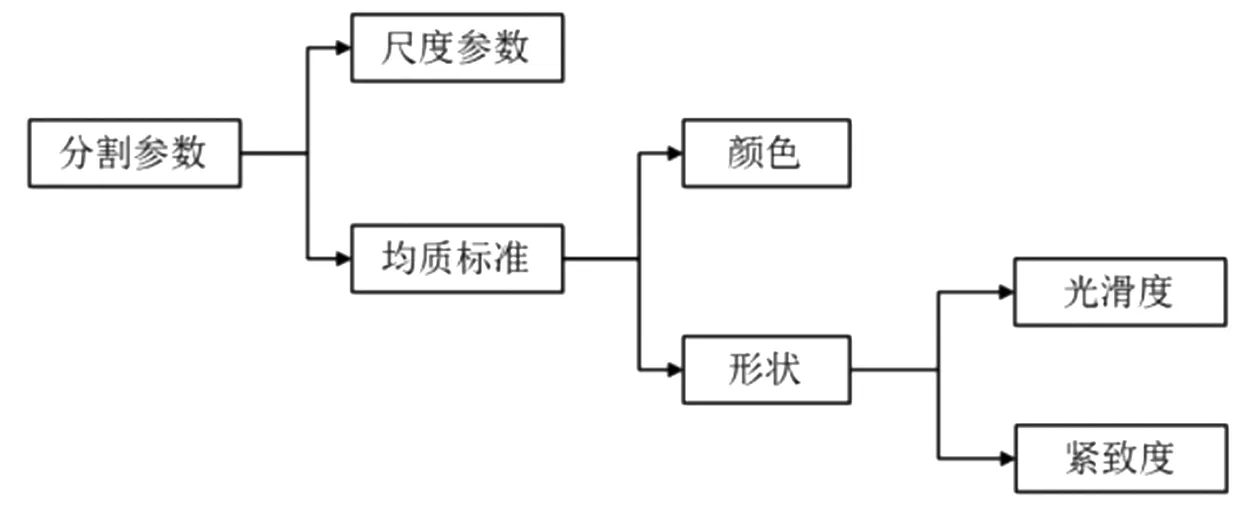

對于遙感影像的分類、信息提取等操作來說,前期的影像分割是極其重要的。如果只是單一提取棉花這一類別,則不能最大可能地排除錯分(棉花類別被錯分到土壤類別或地膜類別)和漏分(土壤、地膜中應該為棉花類別卻沒有分到棉花類別中),所以本研究中分類對象為土壤、地膜與棉花三類。常用的分割算法有四叉樹分割、多尺度分割、多閾值分割等。本研究采用多尺度分割算法,分割算法的主要參數包含分割尺度、形狀因子和緊密度等[13]。具體為形狀與顏色權重相加為1,形狀特征包含緊密度與光滑度,兩者權重相加也為1。在選擇分割尺度時可根據目視解譯結果進行調整。分割參數設置如圖5所示。

圖5 分割參數設置Fig.5 Segmentation parameter settings

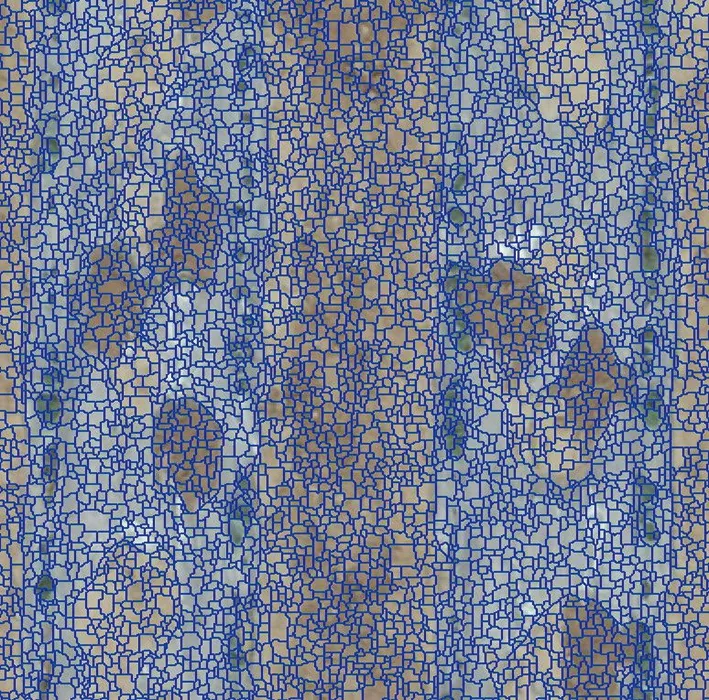

在eCogniton Essential軟件分割設置中選擇基于對象的區域生長分割算法。由于出苗放苗后的棉苗較小,分割尺度采用5比較合適。除分割尺度外,還需設置形狀、顏色因子、緊致度、光滑度因子,來保證分割的結果不至于太破碎。在清晰分割出棉苗的同時,還要使地膜、土壤對象與棉苗對象形狀差異盡可能地大。經過多次嘗試與可視化調節,最終顏色/形狀設置為0.9,光滑度/緊致度設置為0.9。分割結果如圖6所示。

圖6 分割結果Fig.6 Segmentation results

2.3 機器學習模型

機器學習是從已知的實例中自動發現規律,來對未知實例建立預測模型。機器學習分類器,既可用于像素級分類,也可用于影像對象分類。相對基于像素的訓練,基于對象的機器學習分類方法需要更少的訓練樣本,一個樣本對象可以包含很多的典型的像素樣本。本研究采用樸素貝葉斯(NB)、K最鄰近分類(K-NN)、支持向量機(SVM)、決策樹(CART)和隨機森林(RF)。

3 結果與分析

3.1 精度驗證

對遙感信息提取完成之后,分類結果的好壞影響著分類結果的可信性與可利用性,通常使用精度評價來評判遙感影像分類結果的好壞。分類的精度是用分類結果與地面實測值、數據等,比較與實地的吻合程度。遙感信息提取的過程中,精度評價是非常重要的一個步驟,是對整個信息提取的評價。

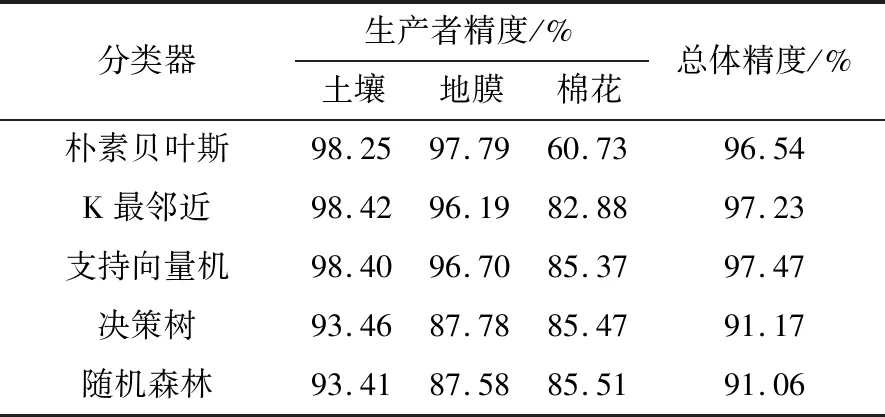

在以總體分類精度為主的前提下,用戶精度和生產者精度兩者均越高則分類結果越好,綜合三種分類精度評價來確定最佳分類器。本研究中精度驗證采用目視解譯分類結果與五種機器學習分類器的分類結果進行驗證,用戶精度和生產者精度都是研究中進行定量評價的重要指標。由表1和表2中可以得出總體分類精度較高的三種分類器分別為支持向量機、K最鄰近和樸素貝葉斯。在表1中,樸素貝葉斯分類器對三種類別的生產者分類精度都非常高,但因生產者精度實際上是一種分類結果制圖的衡量方法,他僅可以說明分類結果滿足參考分類的程度,卻不能給出一個分類a的像素確實是屬于a的可能性。這時候可以使用用戶精度來進一步確定估計的可能性。在表2中可以看到樸素貝葉斯分類器分類的結果中,棉花這一類精度是非常低的,綜合表1和表2可以確定樸素貝葉斯分類器不是最佳分類器。在剩余的兩個分類器分類結果的比較中,可以得出支持向量機分類器是面向對象分類提取棉花出苗信息的最佳分類器。

表1 五種分類器生產者精度對比Tab.1 Comparison of producer precision of five classifiers

表2 五種分類器用戶精度對比Tab.2 Comparison of precision of five classifiers

3.2 總體苗情分析

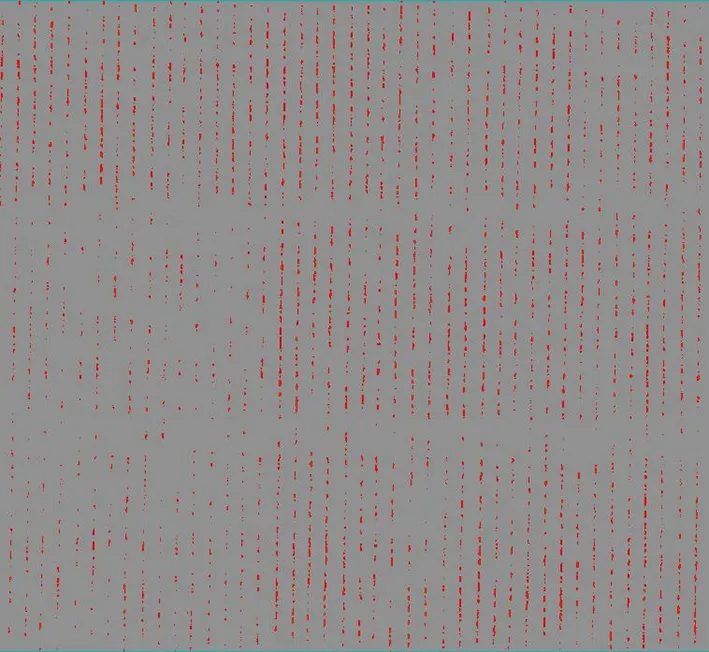

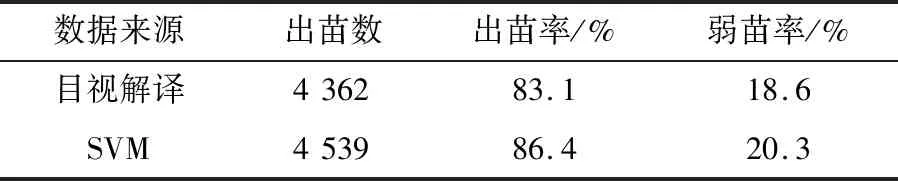

利用本文提出的方法對研究區無人機影像(圖7)進行自動分類,將最佳分類器分類結果中的棉花類別進行提取導出(圖8),按實際種植面積折算出研究區地塊的平均種植株數為5 250 株。在提取的棉花類別中,面積小于2 cm2的對象算為弱苗。本研究最佳分類器-支持向量機識別出棉花的出苗數、弱苗數分別為4 539株、921株,目視解譯的出苗數、弱苗數分別為4 362株、812株,最佳分類器識別與目視解譯出苗數與弱苗數一致性都較好。從表3中可以看出支持向量機與目視解譯的出苗率一致性比較好。本研究的快速提取體現在對大范圍的棉田內某一研究小區進行分割、分類、提取出苗信息之后,可以將分類參數及規則進行移植到其他棉田區域,完成整個棉田范圍的棉花出苗信息快速提取。

圖7 無人機拍攝的大田棉苗原圖Fig.7 Original picture of field cotton seedling taken by UAV

圖8 面向對象分割分類棉苗結果圖Fig.8 Results of object-oriented segmentation and classification of cotton seedlings

表3 SVM與目視解譯提取苗情比較Tab.3 Comparison between SVM and visual interpretation to extract seedling situation

4 結論

與傳統的棉花出苗信息提取相比,無人機遙感具有數據獲取靈活方便、提取精度高、成本較低等優勢,對大范圍的棉花出苗信息提取具有十分大的潛力。本研究基于高分辨率可見光無人機影像,通過面向對象的分類思路,選取合適的閾值進行多尺度分割,采用常用的機器學習分類器進行分類,提取棉花出苗信息,并通過對比分析得出以下結論:

1)采用基于面向對象的分類思想,提取高分辨率無人機影像中棉花出苗信息,五種分類器總體精度都比較高,表明無人機遙感技術在提取棉花出苗信息方面是可行的。

2)通過五種分類器分類結果對比可知,支持向量機分類器無論在用戶精度方面還是在生產者精度方面,都具有很高的分類精度。可以將最優分類分割參數應用到整個棉花種植區域,完成棉花出苗信息提取。