基于深度稀疏表示的超分辨率圖像重建

施華 李燕 陳譯

【摘要】? ? 探討傳統的稀疏表示算法模型,結合深度神經網絡方法,從稀疏求解、數據字典、深度學習框架的角度對基于深度稀疏表示的超分辨圖像重建進行研究。實驗針對單通道和多通道圖像的進行尺度超分辨率重建,以及針對像素值損毀圖像從進行幅值超分辨率重建,在主觀可視化和客觀指標上均取得了較好的重建效果。

【關鍵詞】? ? 稀疏表示? ? 深度學習? ? 圖像修復? ? 超分辨率重建

引言:

基于稀疏表示的圖像重建是計算機視覺領域的難點與熱點問題。傳統的稀疏表示[1-2]依賴于壓縮傳感理論,它對采樣信號帶寬不作要求,而是采用稀疏性約束。隨著深度學習的興起,SRCNN算法[3]的出現,開啟了深度學習在超分辨率圖像重建中的應用。它是一個低分辨和高分辨之間端到端的非線性映射關系的學習算法,在重建效率方面遠勝于傳統重建方法。在此基礎上VDSR算法[4]被提出,它使用非常深的神經網絡模型來進行模型預測,結合殘差學習來進行超分,對深度學習在圖像超分辨率重建領域產生了較大影響。借鑒稀疏表示算法在數據重構中的泛化能力,基于稀疏表示的深度學習被提出[5],成為深度學習在圖像超分辨重建中的典型應用。國內研究者在基于深度稀疏的圖像超分辨重建領域也開展了相關的研究。文獻[6]將深度稀疏重建應用于小樣本的人臉識別;文獻[7]將深度稀疏重建應用于視頻中的3D人體姿態估計;這些方法大都在具體應用場景,從稀疏表示的約束與求解、深度學習算法的適應性等兩個角度進行探討。本文將傳統的稀疏表示方法融入深度卷積神經網絡中,針對單通道灰度圖尺度重建、多通道彩色圖尺度重建和損毀圖像幅值重建軍等三方面探討圖像的修復重建工作。

一、基于深度稀疏表示的圖像重建算法

(一)噪聲信號下的稀疏問題求解

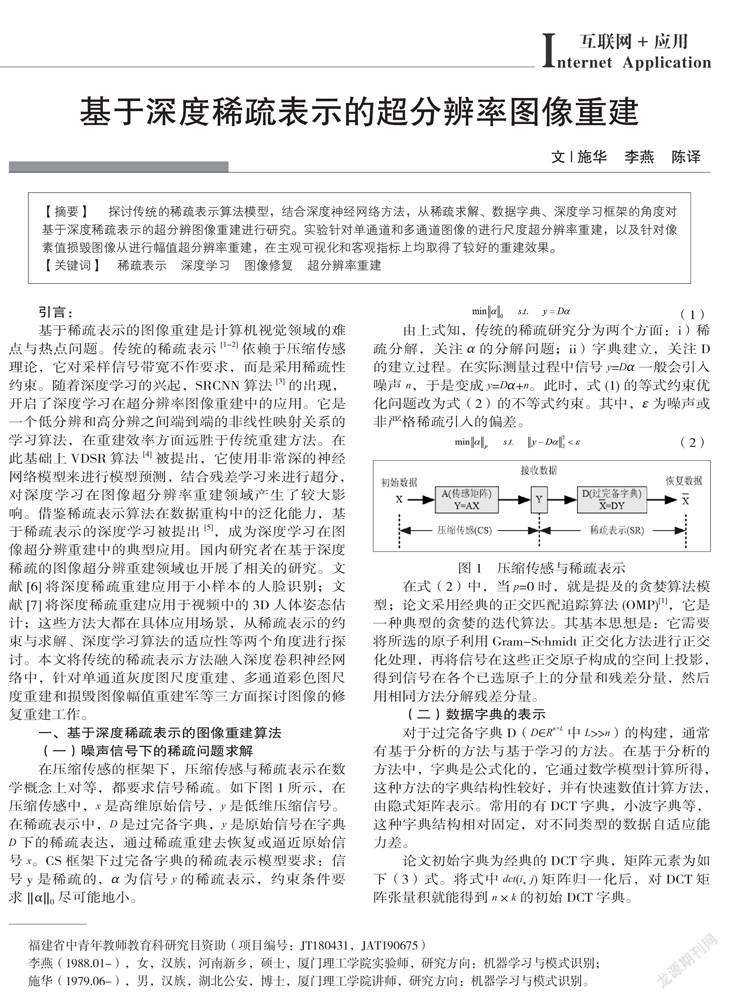

在壓縮傳感的框架下,壓縮傳感與稀疏表示在數學概念上對等,都要求信號稀疏。如下圖1所示,在壓縮傳感中,x是高維原始信號,y是低維壓縮信號。在稀疏表示中,D是過完備字典,y是原始信號在字典D下的稀疏表達,通過稀疏重建去恢復或逼近原始信號x。CS框架下過完備字典的稀疏表示模型要求:信號y是稀疏的,α為信號y的稀疏表示,約束條件要求‖α‖0盡可能地小。

由上式知,傳統的稀疏研究分為兩個方面:i)稀疏分解,關注α的分解問題;ii)字典建立,關注D的建立過程。在實際測量過程中信號y=Dα一般會引入噪聲n,于是變成y=Dα+n。此時,式(1)的等式約束優化問題改為式(2)的不等式約束。其中,ε為噪聲或非嚴格稀疏引入的偏差。

在式(2)中,當p=0時,就是提及的貪婪算法模型;論文采用經典的正交匹配追蹤算法(OMP)[1],它是一種典型的貪婪的迭代算法。其基本思想是:它需要將所選的原子利用Gram-Schmidt正交化方法進行正交化處理,再將信號在這些正交原子構成的空間上投影,得到信號在各個已選原子上的分量和殘差分量,然后用相同方法分解殘差分量。

(二)數據字典的表示

對于過完備字典D(D∈R中L>>n)的構建,通常有基于分析的方法與基于學習的方法。在基于分析的方法中,字典是公式化的,它通過數學模型計算所得,這種方法的字典結構性較好,并有快速數值計算方法,由隱式矩陣表示。常用的有DCT字典,小波字典等,這種字典結構相對固定,對不同類型的數據自適應能力差。

論文初始字典為經典的DCT字典,矩陣元素為如下(3)式。將式中dct(i, j)矩陣歸一化后,對DCT矩陣張量積就能得到n×k的初始DCT字典。

基于學習的方法是從一些樣本中通過機器學習推理而來,也稱學習字典,它的優化問題可以采用如下式(4)稀疏性約束。在訓練學習字典時,需要對數據字典進行初始化(如采用DCT字典),該方法對于原圖像的效果重建效果更好,但需要一個學習過程。

(三)深度稀疏表示算法

在深度卷積神經網絡(CNN)的特征空間對圖像特征進行提取和修改,設計的深度特征遷移模型包含三個部分:1.編碼器;2.解碼器;3.特征遷移模塊。

在圖像底層特征表示中,無論是采用圖像原始的像素還是圖像的局部特征描述,其數據往往都處于高維空間,且數據形式上通常都不是稀疏的。論文探討的圖像稀疏特征學習模型即是在圖像局部特征提取的基礎上,采用SR模型,對圖像局部特征描述子進行稀疏編碼,再經過特征池化等操作,使得圖像內容最終由一個高維的稀疏向量來表示。其流程如圖2所示。

二、實驗設計與結果分析

(一) 數據字典的設計

論文采用傳統的K-SVD算法[8]解決稀疏系數與學習字典的生成問題。實驗中探討了DCT、全局和自適應字典三種方法,如圖3所示。其中,DCT字典采用公式(3)、(4)生成。全局字典從與自身圖像無關的數據庫選取適量圖像通過K-SVD的字典更新訓練得到。實驗從LabelMe圖像庫中隨機取出15000張圖像,得到接近200000個圖像塊,經過訓練得到了全局化的字典,如下圖3(b)所示;這種字典包含的特征來自眾多不同的場景,從而在一定程度上保證了數據的多樣性。圖3(c)的自適應字典是在初始字典基礎上,利用待處理圖像lena本身進行字典訓練,這種方式恢復效果更好,圖像細節更豐富,但局限于特定圖像重建。

(二)單通道灰度圖像的超分辨率重建

表1中的源圖從與Gonzalez等[9]的著作相配套的網站上下載。對比從SSIM 結構相似性和PSNR峰值信噪比兩個方面進行3×3的圖像重建,結果如表1所示。實驗是基于全局字典的深度稀疏重建,并與最近鄰插值法、基于K-VSD的全局字典法進行比較。通過大量測試數據的對比,最近鄰插值法的結果相對差一些,但其優勢在于速度比較快;基于經典的稀疏表示重建算法強于最近鄰插值法;而論文所提出的基于全局字典的深度稀疏算法從統計結果看優于其他兩類算法。

(三)基于多通道的圖像重建

對于RGB三通道彩色圖像,直觀的理解就是針對三通道分別處理。但這個方法會引起了一定的問題。圖像變成了三通道,相較于灰度圖像在信息量上增加3倍,采用相同大小的字典不足以充分表達RGB三通道的色彩多樣性。論文通過增加字典的尺度,并引入 文獻[10]中的通道間的約束度量方法。

假設y和x兩個圖像塊是(R,G,B)的列向量,則定義如下式(5)的內積來衡量它們間的關聯:

實驗中進行的是2×2的圖像重建。如果不建立圖像三通道的關聯,會產生一定的色彩偏差,而建立關聯的圖像則更真實。

(四) 基于深度稀疏的損毀圖像重建

實驗針對損毀圖像的修復進行探討,不是從尺度上進行LR到HR的重建,而是從數據丟失的角度進行探討。實驗中進行了大量的數據測試,圖5是標準的castle圖的修復效果。

圖5(a)是源圖像;圖5(b)是在RGB三通道中隨機丟失了80%像素值,在實現上直接將該像素值置為0,當同一坐標處RGB值同時為0時,即為絕對的黑點。損毀后的圖片存在著大量這樣的黑點。 圖5(c)是采用深度稀疏后的修復效果圖,主觀可視化上基本還原了目標的本來面貌。

三、結束語

隨著人工智能與大數據應用不斷拓展,社會生活對高分辨率影像的需求與日俱增。采用硬件方式提升分辨率存在成本昂貴和技術瓶頸等問題,而軟件的低成本和低門檻的特點會有著廣闊的應用前景。此外,超分辨率重建問題也是計算領域典型的欠定問題,存在數學理論共性;該問題的探討有著一定的理論意義。后續隨著傳感壓縮理論的不斷完善與深度學習方法的更新推進,圖像超分辨率重建將會逐步由現有的3×3和4×4尺度擴展到更高尺度的計算。

作者單位:施華? ? 李燕? ? 陳譯? ? 廈門理工學院光電與通信工程學院

參? 考? 文? 獻

[1] S. Mallat, Z. Zhang. Matching pursuits with time-frequency dictionaries[J]. IEEE Transactions on Signal Processing. 1993, 41(12):3397-3415.

[2] D. L. Donoho. Compressed sensing[J]. IEEE Transactions on Information Theory. 2006, 52(4):1289-1306.

[3] Dong C, Loy C C, He K, et al. Image super-resolution using deep convolutional networks[J]. IEEE transactions on pattern analysis and machine intelligence, 2015, 38(2): 295-307.

[4] J.Kim, J.K.Lee, K.M.Lee. Accurate Image Super-Resolution Using Very Deep Convolutional Networks[C]. 2016, CVPR

[5] S.Simone, C.Danilo, H.Amir; U.Aurelio. Group sparse regularization for deep neural networks[J]. Neurocomputing. 2017, 7:81-89.

[6] 馬曉,張番棟,封舉富. 基于深度學習特征的稀疏表示的人臉識別方法[J]. 智能系統學報. 2016,11(03):279-286.

[7] 王偉楠,張榮,郭立君. 結合稀疏表示和深度學習的視頻中3D人體姿態估計[J]. 中國圖象圖形學報. 2020,25(03):456-467.

[8] M. Aharon, M.Elad, A.Bruckstein. K-SVD: An algorithm for designing overcomplete dictionaries for sparse representation[J]. IEEE Transaction on Image Processing. 2006, 54(11):4311-4322.

[9] R. C. Gonzalez, R. E. Woods. Digital image processing(影印版)[M]. 北京: 電子工業出版社, 2016.

[10] J.Mairal, M.Elad and G.Sapiro. Sparse Representation for color image restoration[J]. IEEE Transactions on Image Processing. 2008,17(1): 53-69.