文本生成圖像中語義-空間特征增強算法

賀小峰,毛 琳,楊大偉

(大連民族大學 機電工程學院,遼寧 大連 116605)

文本生成圖像是利用所給文本中語義信息生成與文本內(nèi)容對應(yīng)圖像,在圖像生成過程中,圖像特征與語義特征經(jīng)生成器多次迭代循環(huán)進行特征融合。由于圖像生成過程中經(jīng)過多次特征傳遞,上下文參考信息丟失從而影響融合效果,生成圖像清晰度、多樣性和生成圖像與原始圖像間相似度有待提高。

在基于語義圖像處理研究中,文本生成圖像更多地借鑒主流深度學習方法。隨著生成對抗網(wǎng)絡(luò)(Generative Adversarial Networks,GAN)的快速發(fā)展[1],基于GAN的文本生成圖像研究成為目前最熱門的方法。Zhang等[2]提出疊加對抗網(wǎng)絡(luò)(Stacked GAN,StackGAN),該網(wǎng)絡(luò)使用兩階段GAN生成圖像:第一階段GAN根據(jù)文本生成原始形狀和顏色,生成第一階段低分辨率圖像;第二階段以第一階段為輸入,生成高分辨率圖像并糾正第一階段中的錯誤。之后,在StackGAN-v2中提出使用由樹狀結(jié)構(gòu)的多個生成器和鑒別器生成高分辨率圖像[3],但該網(wǎng)絡(luò)生成圖像質(zhì)量不高,沒有充分利用文本信息對生成圖像進行矯正。在此基礎(chǔ)上Xu等[4]提出注意力機制生成對抗網(wǎng)絡(luò)(Attentional GAN,AttnGAN),在StackGAN-v2的思想上引入長短時記憶網(wǎng)絡(luò)(Long Short-Term Memory,LSTM)的文本解碼器[5],使得語句和單詞可以映射到語義空間,使用注意力模型將語義信息與圖像特征相融合,從而生成與文本描述信息近似的圖像,但使用多生成器結(jié)構(gòu)會缺乏跨生成器間特征傳遞,特征融合質(zhì)量下降,并且該網(wǎng)絡(luò)結(jié)構(gòu)訓練數(shù)據(jù)過大,訓練效率較低。

在近期的文本生成圖像研究中,單生成器和單鑒別器結(jié)構(gòu)成為新研究趨勢。該結(jié)構(gòu)是在單生成器中進行特征融合,從而生成由低分辨率到高分辨率的圖像[6-8]。在Tao等[7]提出的深度融合對抗網(wǎng)絡(luò)(Deep Fusion GANs,DF-GAN)中,設(shè)計一種深度文本圖像融合塊,該模塊在生成器生成圖像時加深圖像特征與文本信息的融合過程,同時DF-GAN中還設(shè)計一種匹配感知梯度,用于合成更真實、語義更加一致的圖像。以DF-GAN為基礎(chǔ),Hu等[8]提出語義-空間生成對抗網(wǎng)絡(luò)(Semantic-Spatial Aware GAN,SSA-GAN),設(shè)計語義-空間卷積網(wǎng)絡(luò)使得卷積特征融合時提取更加充分。但單生成器結(jié)構(gòu)在多級特征融合中只使用上級特征信息,從而導致特征多樣性不強,特征融合結(jié)果不佳。

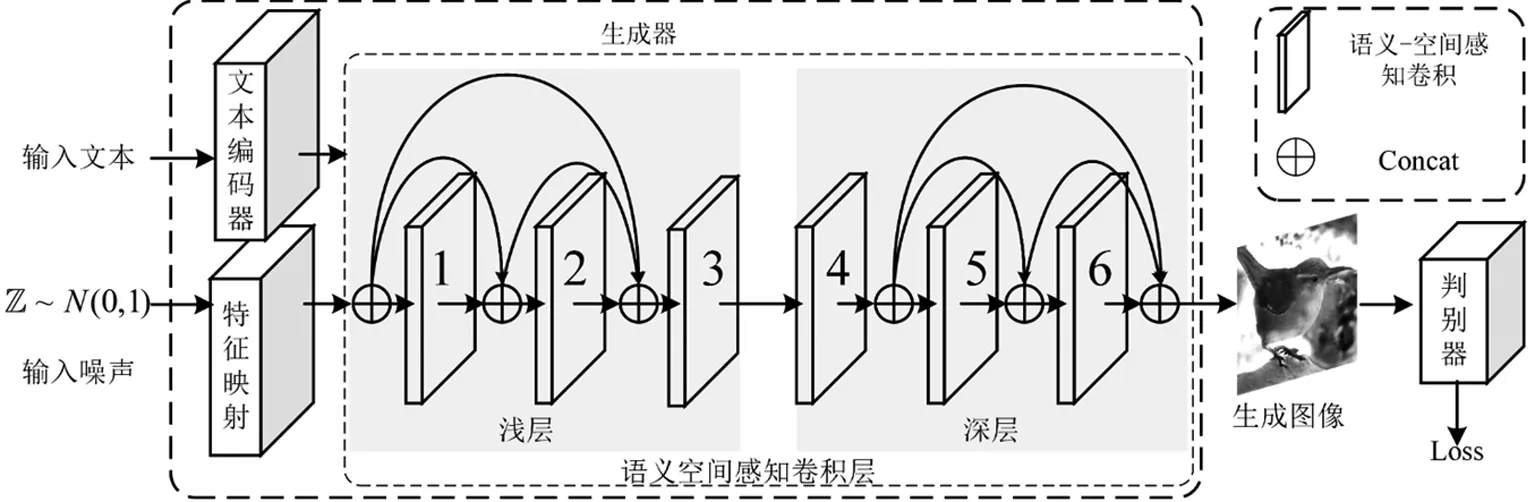

針對文本生成圖像生成器中多特征傳遞豐富性與特征融合不充分問題,本文提出語義-空間特征增強生成對抗網(wǎng)絡(luò)(Semantic-spatial Feature Enhancement GAN,SFE-GAN)。該網(wǎng)絡(luò)借鑒密集連接網(wǎng)絡(luò)(Densely Connected Convolutional Networks,DensNet)特征增強思想[9],在不同層級中分別引入密集連接結(jié)構(gòu),對跨層間的特征融合進行加強并提高特征豐富性,增強語義信息對生成圖像的約束性,采用分段式結(jié)構(gòu)連接加強特征傳遞中的穩(wěn)定性,改善生成圖像過程中特征融合不充分和語義與圖像不匹配的問題,從而提高生成圖像質(zhì)量。

1 SFE-GAN算法

1.1 語義-空間卷積特征融合問題分析

現(xiàn)有文本生成圖像網(wǎng)絡(luò)SSA-GAN中,輸入符合正態(tài)分布的噪聲z∈100并通過特征映射后重塑為像素特征f∈4×4×512;輸入文本經(jīng)文本編碼器提取語義特征,其中包括語句特征向量e∈256和單詞特征矩陣將兩種特征輸入語義-空間感知卷積進行上采樣與特征融合。

定義1:Si(a*b)代表對像素特征a與語義特征b通過語義-空間感知卷積進行特征融合操作。生成圖像特征公式:

(1)

式中:F為生成圖像特征;z為輸入噪聲;P為特征映射操作;b為輸入文本信息;T為文本編碼器提取輸入文本中語義特征并映射到語義空間。輸入特征與輸出特征之間的傳遞方式為循環(huán)前向傳遞,所以在上采樣和特征融合過程中缺少跨層間特征信息,使得在特征融合時缺少當前層與其余層間聯(lián)系。

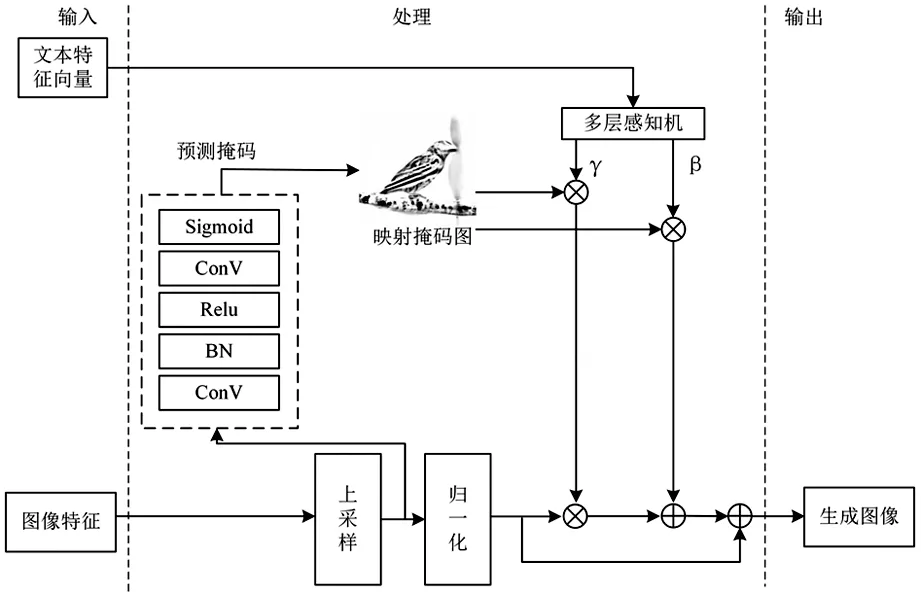

語義-空間感知卷積的作用是使語義信息指導圖像生成過程,從而更有效地利用語義空間中的語義信息與輸入圖像特征融合。但在語義-空間感知卷積的連續(xù)特征傳遞中缺少跨層間特征傳遞,因此生成圖像質(zhì)量下降。語義-空間感知卷積如圖1。

圖1 語義-空間感知卷積

語義-空間感知卷積中映射掩碼圖受語義特征約束,語義特征引導圖像生成,在語義-空間感知卷積中掩碼圖特征ki∈hi×wi與語義特征γ和β融合,特征融合公式:

(2)

在公式(2)中可以明顯看出,掩碼圖特征為輸出融合特征的重要參數(shù),對語義-空間感知卷積的輸入圖像特征加強以提高輸入特征的多樣性。因為多特征的傳遞與融合是保證生成圖像準確性與高質(zhì)量的關(guān)鍵,故在特征傳遞過程中引入密集連接網(wǎng)絡(luò)如圖2。

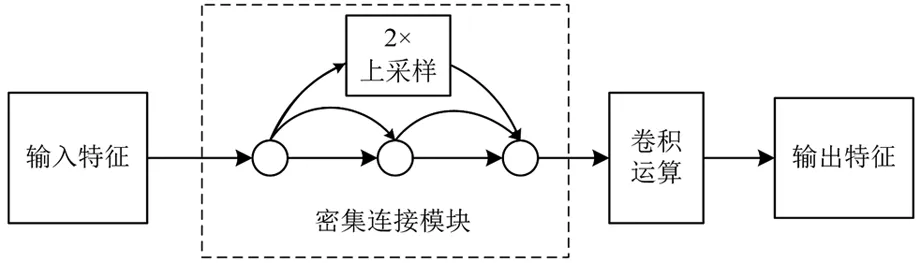

圖2 密集連接網(wǎng)絡(luò)

在圖像生成過程中各級特征對生成圖像有著不同程度的影響,傳遞過程中只輸入上層單級特征會導致多特征傳遞豐富性不足和圖像特征與語義特征融合不充分。為融合不同尺度特征,在密集連接模塊中引入最近鄰插值上采樣塊,將形狀為H×W×C的輸入特征圖,通過上采樣得到形狀為2H×2W×C的輸出特征圖。密集連接網(wǎng)絡(luò)可充分提取不同分辨率圖像中的特征,增加網(wǎng)絡(luò)寬度,增強多尺度特征傳遞,使圖像特征在上采樣過程中和語義特征融合得更加充分。因此在特征融合過程中加入多級信息,加強輸入特征多樣性,可以使特征融合質(zhì)量提升。

輸入特征經(jīng)密集連接網(wǎng)絡(luò)后的輸出特征可表示為

xi=Conv([x0,x1,…,xi-1])。

(3)

式中:xi為輸出特征;Conv為使用卷積運算調(diào)整特征圖的通道數(shù);[x0,x1,…,xi-1]為各層輸出特征進行Concat特征合并。

1.2 SFE-GAN實現(xiàn)

SFE-GAN為保證生成圖像的清晰度、多樣性和生成圖像與圖像文本描述的相似性,充分融合不同層間多尺度特征信息,通過以下3個步驟構(gòu)建SFE-GAN。

(1)在生成器訓練過程中,使用雙向LSTM構(gòu)成的文本編碼器,提取輸入文本中的單詞與語句特征向量;采用InceptionV3模型[10]圖像特征提取器,提取訓練輸入圖像特征,特征提取公式:

Ew×n,e=Ls(Tinput);

(4)

Pi=Iv3(Pinput)。

(5)

式中:Ew×n為單詞特征矩陣;e為語句特征向量;Ls為雙向LSTM文本編碼器;Tinput為輸入文本信息;Pi為圖像特征;Iv3為InceptionV3模型的圖像特征提取器;Pinput為輸入圖像。

(2)在生成圖像過程中,低分辨率圖像生成過程側(cè)重于圖像結(jié)構(gòu)和布局,高分辨率圖像生成過程側(cè)重于圖像細節(jié)和隨機變化[11]。因此將語義-空間卷積層分為淺層和深層,其中淺層為低分辨率生成圖像層,深層為高分辨率生成圖像層(1~3層為淺層,4~6層為深層)。

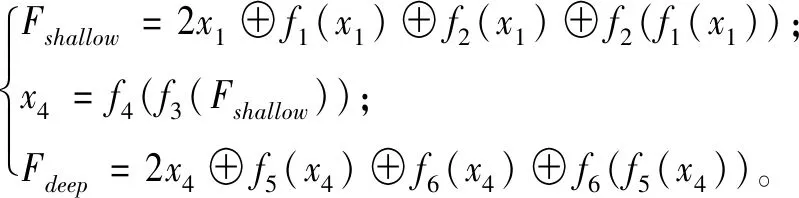

(3)在深淺層中分別加入密集連接構(gòu)成深淺層密集連接結(jié)構(gòu),淺層和深層分別進行特征融合,加強特征提取,保證特征融合過程的充分性。在加強生成圖像結(jié)構(gòu)和布局的同時,強化生成圖像細節(jié)。特征融合公式:

(6)

式中:Fshallow和Fdeep分別為淺層和深層輸出圖像特征;xi為各層級輸入圖像特征;f為各語義-空間感知卷積中特征融合運算;⊕為Concat特征合并運算。密集連接采用分段連接結(jié)構(gòu),目的是將淺層中融合得到的特征信息更穩(wěn)定地傳遞到深層中,從而加強深層輸入特征信息,強化語義特征與圖像特征融合,使得生成圖像與文本描述更加相似。SFE-GAN結(jié)構(gòu)如圖3。

本文采用的損失函數(shù):

LG=LG1+λLDASMS;

(7)

LGi=-Ex~Pg[D(G(z),e)];

(8)

V(D,G)=Ex~pdata(x)[logD(x)]+Ez~pz(z)[log(1-D(G(Z)))]。

(9)

式中:LG為生成器損失函數(shù);LG1為SFE-GAN損失函數(shù);LDASMS[4]為深度多注意力模型損失函數(shù)(Deep Attentional Multimodal Similarity Model,DAMSM),該模型可對訓練進行約束;λ為DASMS損失權(quán)重;E為期望值;x為來自生成器中模型分布Pg;e為語義特征向量;V(D,G)為生成器與判別器進行對抗訓練,使其在訓練過程中不斷優(yōu)化,直到生成質(zhì)量最優(yōu)圖像。

圖3 SFE-GAN結(jié)構(gòu)

2 實驗及結(jié)果分析

2.1 實驗環(huán)境與數(shù)據(jù)集

網(wǎng)絡(luò)運行系統(tǒng)為Ubuntu 16.04,顯卡配置為NVIDIA GeForce 1080Ti。編程語言Python,深度學習框架使用Pytorch 1.7.0。實驗數(shù)據(jù)集為CUB 200-2011(Caltech-UCSD Birds 200-2011),該數(shù)據(jù)集有11 788張鳥類圖像,包含200類鳥類子類,每只鳥具有10句文字描述,其中訓練集有8 855張圖像,測試集有2 933張圖像[12]。

在CUB數(shù)據(jù)集下,將批尺寸設(shè)置為8,生成器和判別器學習率分別設(shè)置為0.000 1和0.000 4,迭代次數(shù)為600,引入Adam優(yōu)化器對訓練進行優(yōu)化[13],其余參數(shù)與原網(wǎng)絡(luò)保持一致。

2.2 評價指標

為保證網(wǎng)絡(luò)的有效性,生成模型使用Inception評分(Inception Source,IS)和Fréchet Inception距離(Fréchet Inception Distance,F(xiàn)ID)作為評價指標。其中,IS指標由Barratt等[14]提出,目的是將生成圖像輸入Inception V3模型中,根據(jù)生成數(shù)值判斷生成圖像的清晰度和多樣性,IS評分越高代表生成圖像的清晰度和多樣性越高,生成的模型質(zhì)量越好。IS計算公式:

IS=exp(Ex~pgDKL(p(y|x)||p(y)))。

(10)

式中:x為生成器生成圖像;p(y|x)為生成圖像在各類別中的概率分布;p(y)為概率分布向量;DKL為對p(y|x)和p(y)計算KL的散度。

FID指標由Heusel等[15]提出,目的是計算真實圖像與生成圖像間特征向量的距離。將生成圖像輸入Inception V3模型中計算相似度,F(xiàn)ID評分越小代表生成圖像與輸入圖像相似度越高,生成圖片的多樣性越好。FID計算公式:

(11)

式中:μr、μg分別為真實圖像和生成圖像的特征均值;Tr為矩陣的跡;νr、νg分別為真實圖像和生成圖像的特征協(xié)方差矩陣。

2.3 實驗結(jié)果與分析

選取訓練集中的圖像和對應(yīng)的全部文本描述作為訓練圖像和文本,選取測試集中的文本描述作為測試文本,輸入噪聲選取符合正態(tài)分布的噪聲。在相同硬件環(huán)境和參數(shù)設(shè)置條件下進行對比試驗,使用兩種模型分別生成30 000張圖像,通過IS和FID指標對生成圖像進行測試,實驗結(jié)果對比見表1。

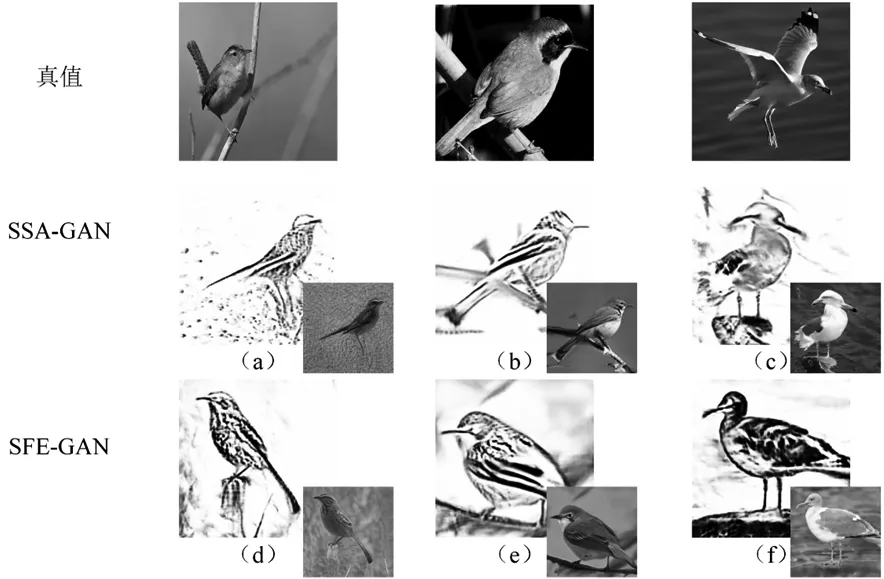

實驗結(jié)果表明,SFE-GAN的IS和FID評分分別為5.00和20.46,高于改進前原始算法SSA-GAN的4.81和20.73,分別提升4.0%和1.3%。輸入文本和輸入圖像經(jīng)SFE-GAN處理,多特征傳遞與特征融合加強。SSA-GAN與SFE-GAN進行特征融合可視化對比如圖4。

圖4 特征融合可視化對比圖

使用相同的輸入文本對兩種網(wǎng)絡(luò)的圖像特征與語義特征融合進行對比。從圖4a、圖4b和圖4c中可以發(fā)現(xiàn)原網(wǎng)絡(luò)生成的圖像映射掩碼圖的“喙部”“尾部”“頭部”和“眼部”等有明顯錯誤,原網(wǎng)絡(luò)的圖像掩碼圖經(jīng)語義信息校正后生成輸出圖像,由于原網(wǎng)絡(luò)的多特征傳遞不充分,導致特征融合結(jié)果較差,影響生成圖像質(zhì)量。SFE-GAN網(wǎng)絡(luò)生成的映射掩碼圖4d、圖4e和圖4f修正了原網(wǎng)絡(luò)映射掩碼圖中的錯誤,并且生成與輸入文本匹配的正確圖像,因此可以得出SFE-GAN明顯改善SSA-GAN中特征融合與多特征傳遞不充分的問題,原網(wǎng)絡(luò)與SFE-GAN網(wǎng)絡(luò)的文本生成圖像可視化結(jié)果對比如圖5。

圖5 SSA-GAN與SFE-GAN文本生成圖像對比

總體上,SSA-GAN中輸入文本對生成圖像的約束作用不佳,進而導致生成圖像與輸入語義內(nèi)容不匹配。采用SFE-GAN后,特征豐富性得到提高,圖像特征與語義特征的融合得到增強,生成圖像充分利用所給語義信息,提升了生成圖像的清晰度、圖像細節(jié)和生成圖像與原始圖像間的相似度。SFE-GAN針對輸入文本特征信息能夠清晰地生成與其對應(yīng)的特征部位,但SSA-GAN生成的“鳥喙”“鳥尾”和“顏色”等內(nèi)容不佳且生成圖像不清晰;同時SFE-GAN還提升了生成圖像背景的清晰度,使得生成圖像減少背景信息對內(nèi)容的影響。本文提出的SFE-GAN可以充分利用語義特征對生成圖形進行約束,從而提升生成圖像的質(zhì)量。

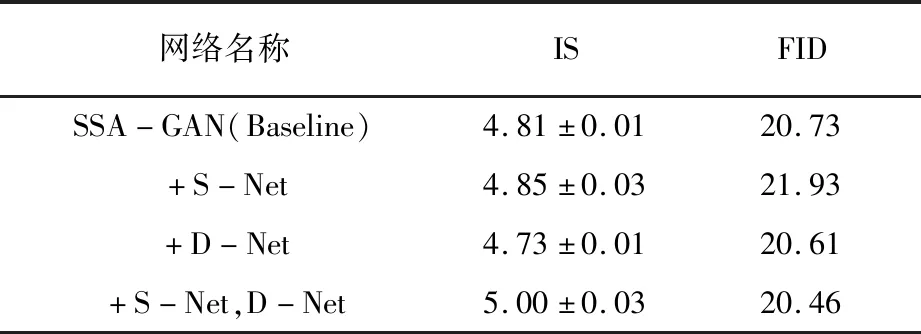

2.4 消融實驗

為驗證SFE-GAN網(wǎng)絡(luò)結(jié)構(gòu)的有效性,針對所提出的網(wǎng)絡(luò)模型進行消融實驗,采用CUB數(shù)據(jù)集和FID、IS評價指標。基于SSA-GAN(參考圖3),淺層密集網(wǎng)絡(luò)S-Net(Shallow dense network)在1、2層引入兩層密集連接網(wǎng)絡(luò),深層密集網(wǎng)絡(luò)D-Net(Deep dense network)在5、6層引入兩層密集連接網(wǎng)絡(luò)。改進網(wǎng)絡(luò)消融實驗對比見表2。引入深淺層分段密集連接結(jié)構(gòu)后,IS和FID可得到較好的提升。

表2 改進網(wǎng)絡(luò)消融實驗對比

3 結(jié) 語

本文針對文本生成圖像網(wǎng)絡(luò)中多特征傳遞與特征融合不充分的問題,提出語義-空間特征增強生成對抗網(wǎng)絡(luò)SFE-GAN,通過密集連接結(jié)構(gòu)增強跨層特征傳遞與融合,分段連接使得特征融合過程更加充分,充分利用語義特征與圖像特征,從而提高生成圖像的清晰度、多樣性和與原始圖像間的相似度。SFE-GAN為提升特征豐富性和加強特征融合提供一種新思路,使文本生成圖像網(wǎng)絡(luò)更好地應(yīng)用于視頻和圖像交互領(lǐng)域。后續(xù)工作中,將進一步改善生成圖像過程中特征多樣性與特征融合的問題,提升生成圖像質(zhì)量。