改進YOLO5Face 的小鼠行為實時分析方法研究

胡春海,姜 昊,劉 斌

(燕山大學 河北省測試計量技術及儀器重點實驗室,河北 秦皇島 066004)

0 引言

動物行為學的發展已經深刻地改變了人類的思維方式,它不僅探索了動物的學習、認知過程,而且還深刻地影響著心理學、教育學等領域[1-2]。動物的行為不僅僅是一種表達情感的方式,而且更多地反映了它們的內在特征,它們的行為受到基因、環境等多種因素的影響,并且反映出它們的整體性格。通過對動物的行為學研究,我們可以深入了解它們的自然狀態,并且可以通過在特殊的環境中觀察它們的行為,來探索它們的神經系統、心理機制以及對藥物的反應[3]。實驗動物行為分析在神經生理學、行為藥理學等神經科學領域能夠反映實驗動物整體狀態[4]。小鼠和人類同為哺乳動物,基因組與人類非常相似,相似度高達98%。一些特定的行為信息可以對人類醫學研究有所幫助,為其他生物學研究提供重要的參考和依據[5-6]。自新冠肺炎疫情爆發后,無論國際還是國內檢測試劑及抗體疫苗研制都依賴于動物實驗[7]。以小白鼠為實驗對象,將計算機視覺技術、視頻分析技術和行為識別相結合,實現小鼠探索過程中動作識別和檢測,可以更好地幫助研究人員理解和分析動物行為,對促進相關學科的發展具有重要意義[8]。

隨著人工觀察、傳感檢測和視頻跟蹤技術的發展,動物行為分析方法取得了巨大的進步。機器學習與計算機視覺在實驗動物行為分析領域發展迅速,在一定程度上實現了自動化與定量化。近年來,利用先進的數字圖像處理技術,可以實時追蹤和預測動物的行為,從而更好地掌握它們的運動軌跡、運動距離、速度等信息,這已經成為一種先進的研究方法。然而,這種方法僅僅局限于通過觀察動物的運動參數來間接分析它們的行為特征,忽略了它們本身的體態變化。事實上,行為是由體態和體態的變化(包括位置)組成的,而體態可以反映出更多的心理因素。因此,準確地識別動物的體態,并對它們的行為進行詳細描述,已經成為動物行為學,尤其是嚙齒目動物行為研究的一個重要方向。本研究利用實驗小鼠運動中不同動作的行為特征特點,從體態和運動兩個方面描述小鼠的行為。

基于視頻記錄行為的圖像分析是最常見也是最廣泛的使用方法[9-12],但是由于缺乏實時的行為特征變量分析和反饋調節,大多數小鼠研究仍然存在一定的局限性[13]。盡管實驗人員可以通過離線視頻來觀察小鼠的行為,但他們仍然必須不斷檢測和評估其各種行為特征,以便及早發現問題,并及時采取有效的措施來改善研究結果。現有的小鼠行為實時分析方法具有一些問題,比如需要依賴于強大的GPU 才能達到實時性[14],不適用于大多數動物行為實驗場景;或者是特征提取過程滿足實時性但是再加上行為識別后就不滿足實時性。還有的小鼠行為實時分析方法難以識別小鼠身體各個部位[15-16],只能將小鼠看作質心或者識別出身體局部進行處理,對小鼠體態特征的構造和行為特征細化是不利的。

本研究針對實時性問題提出一種改進YOLO5Face 的小鼠行為實時分析方法。首先通過改進的深度學習關鍵點檢測網絡實時獲得小鼠身上的四個關鍵點,然后通過實時檢測到的關鍵點坐標提取體態特征與運動特征,最后放入機器學習實時分類模型進行行為分類。

1 小鼠關鍵點實時檢測

1.1 YOLO5Face 介紹

YOLO5Face[17]的優勢分以下兩點論述。

1) YOLO5Face 模型架構

YOLO5Face 的模型架構如圖 1 所示。YOLO5Face 相對YOLOv5 具體改動為:

圖1 YOLO5Face 的模型架構Fig.1 The model architecture of YOLO5Face

a)Stem 模塊替代了YOLOv5 網絡中原有的Focus 模塊,在性能沒有下降的同時,提高了網絡的泛化能力,降低了計算復雜度。

b)YOLO5Face 網絡對SPP 模塊進行更新,使用更小的kernel。將原YOLOv5 用的(5,9,13)的SPP kernel 改成(3,5,7)的SPP kernel,使網絡更適合人臉檢測而且提高了檢測精度。

c)YOLO5Face 網絡在原YOLOv5 的基礎上添加了一個stride=64 的P6 輸出塊,P6 輸出塊的特征圖大小為10×10,可以提高對大人臉的檢測性能。之前的人臉檢測模型的重點基本放在檢測小人臉上,YOLO5Face 通過提高對大人臉的檢測效果從而提升整個網絡模型的檢測性能。

d)YOLO5Face 網絡提出在人臉檢測問題中,一些目標檢測的數據增廣方法不太適合使用,比如上下翻轉和Mosaic 數據增廣。不使用上下翻轉時,模型檢測性能可以提高。不使用Mosaic 數據增廣時,對小人臉的檢測性能變好,但是對中尺度和大尺度人臉來說檢測性能一般。導致這種情況發生的原因,可能是由于WiderFace 數據集中的小人臉數據相對較多,不使用Mosaic 數據增廣提高了對小人臉的檢測性能從而提高了整體的檢測性能。另外隨機裁剪有助于提高性能。

e)YOLO5Face 的可移植性比較強,從服務器到嵌入式或者移動設備可以根據需要設計不同深度和寬度的網絡模型。

2) Wing-Loss

YOLO5Face 是在YOLOv5 的基礎上進行改進的。YOLOv5 只是一種基于深度學習的實時目標檢測模型,不具備關鍵點檢測功能。YOLO5Face在YOLOv5 網絡的基礎上添加了5 個人臉關鍵點回歸的代碼,對于關鍵點回歸問題使用的損失函數是Wing-loss,其計算公式為

Wing-loss 是一個分段復合損失函數,在訓練剛開始誤差比較大的時候用L1 損失,在訓練的后期誤差相對比較小的時候,用一個具有偏移量的對數函數。這5 個人臉關鍵點回歸損失稱為lossL,在YOLOv5 原本的損失函數lossO中加上lossL,構成總的損失函數loss(s),

其中,λL是關鍵點回歸損失函數的權重因子。

1.2 改進YOLO5Face

本研究的關鍵點檢測算法之所以建立在YOLO5Face 之上,是因為YOLO5Face 關鍵點檢測模型相對以往的基于熱力圖回歸的關鍵點檢測模型更加輕量化,計算量更小,滿足本研究要求的實時性要求和精度要求。不選擇更新的YOLOv6/7/8 是因為它們只有目標檢測功能沒有關鍵點檢測功能,YOLO5Face 是既有目標檢測又有關鍵點檢測。本研究通過改進YOLO5Face 提出一種可以適用于動物行為學實驗中的小鼠關鍵點檢測方法,主要工作有以下幾點:

1) 新增了一個更小的檢測頭來檢測更小尺度的物體。

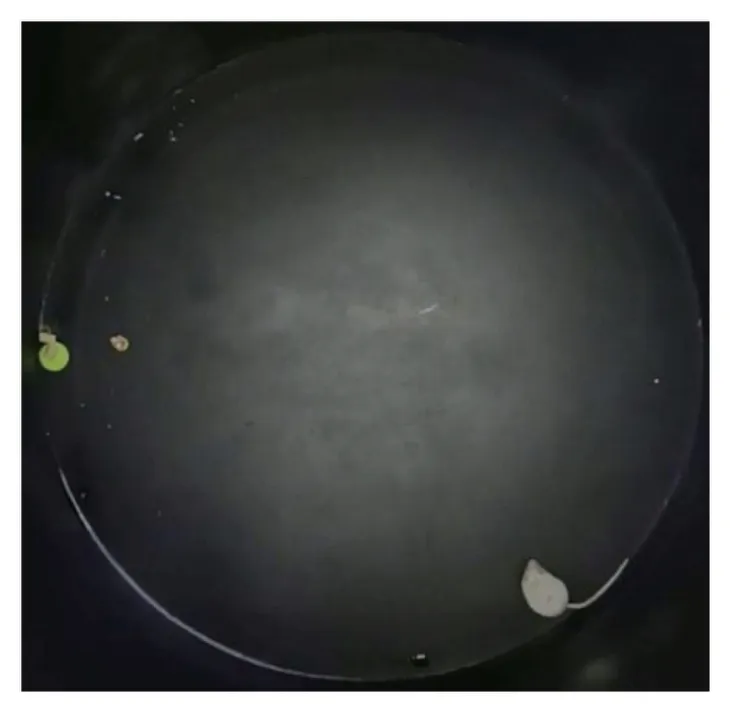

原YOLO5Face 中設定的4 個檢測頭,分別對應的特征圖大小是80×80、40×40、20×20、10×10。其中特征圖大小為10×10 的檢測頭是YOLO5Face相對于YOLOv5 添加的用來提高大目標的檢測性能。而對于曠場實驗場景,小鼠相對于整個曠場是一個小目標,如圖2 所示。故去掉特征圖大小為10×10 的檢測大目標的檢測頭,添加一個特征圖大小為160×160 的檢測小目標的檢測頭,用來提高小目標的檢測準確率,網絡結構如圖3 所示。

圖2 曠場實驗圖像Fig.2 Open field experiment image

圖3 改進的YOLO5Face 的模型架構Fig.3 Improved model architecture for YOLO5Face

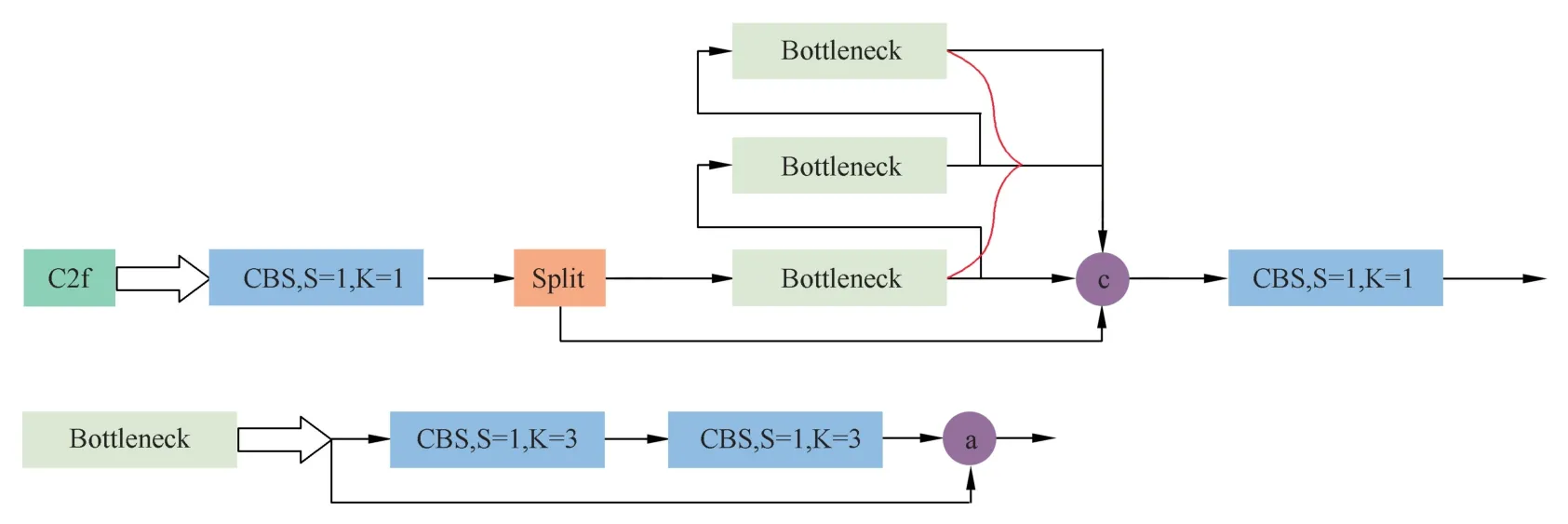

2) 主干網絡中加入YOLOv8 的C2f 模塊[18]。

C2f 模塊參考了C3 模塊以及ELAN 的思想進行設計,如圖4 所示,讓模型獲得了更加豐富的梯度流信息,大大縮短了訓練時間,而且提高了關鍵點檢測精度。

圖4 C2f 模塊結構圖Fig.4 The structure of the C2f module

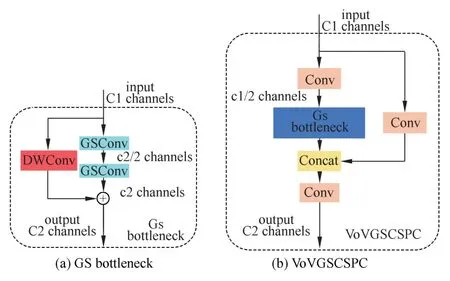

3) 采用GSConv 和Slim-neck 技術,可以降低模型的復雜度,同時提升精度[19]。

為了同時兼顧精度和檢測幀率,采用標準卷積、深度可分離卷積和shuffle 混合卷積進行組合構建為一個新的卷積層:GSConv(結構如圖5 所示)。該方法使卷積計算的輸出盡可能接近SC,降低了計算量。對于輕量級模型,在搭建網絡結構的時候可以直接用GSConv 層替換原始的卷積層,無需額外操作即可獲得顯著的精度增益。GSConv 可以加快模型預測的速度。

圖5 GSConv 模塊結構Fig.5 The structure of the GSConv module

GSbottleneck 是由兩個GSConv 模塊和一個DWConv 模塊組成,輸入分為兩個部分,一個部分導入兩個GSConv 模塊,另一個部分輸入一個DWConv 模塊,最后將這兩部分的輸出加起來,如圖6(a)所示。VoVGSCSPC(跨級部分網絡)模塊是在GSbottleneck 的基礎上使用一次性聚合方法設計而成的,如圖6(b)所示。

圖6 VoVGSCSPC 模塊結構Fig.6 The structure of the VoVGSCSPC module

1.3 小鼠關鍵點檢測數據集

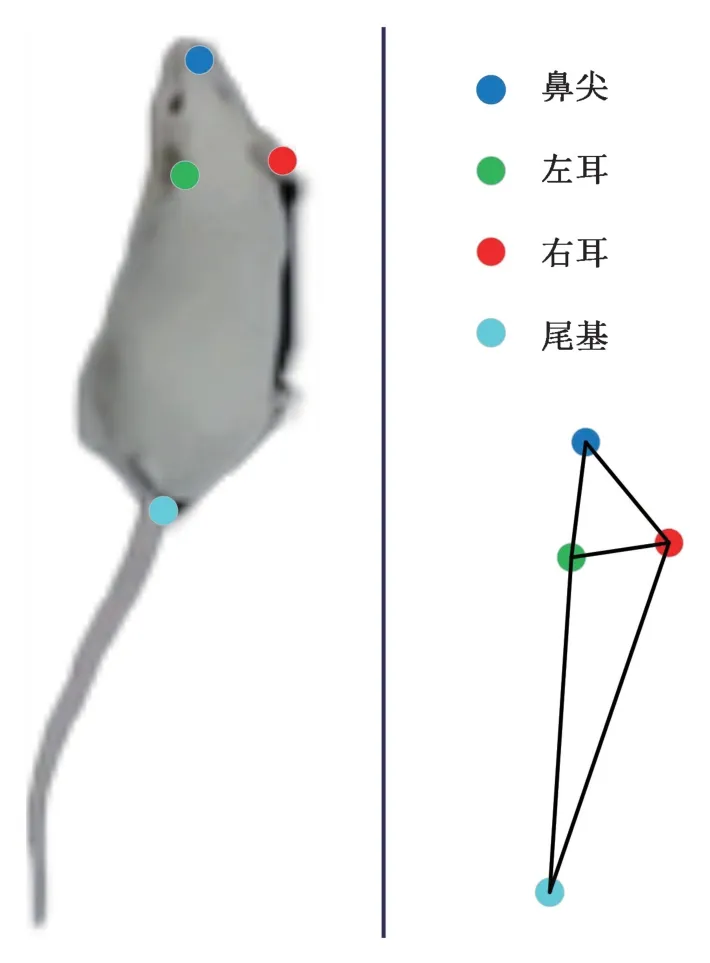

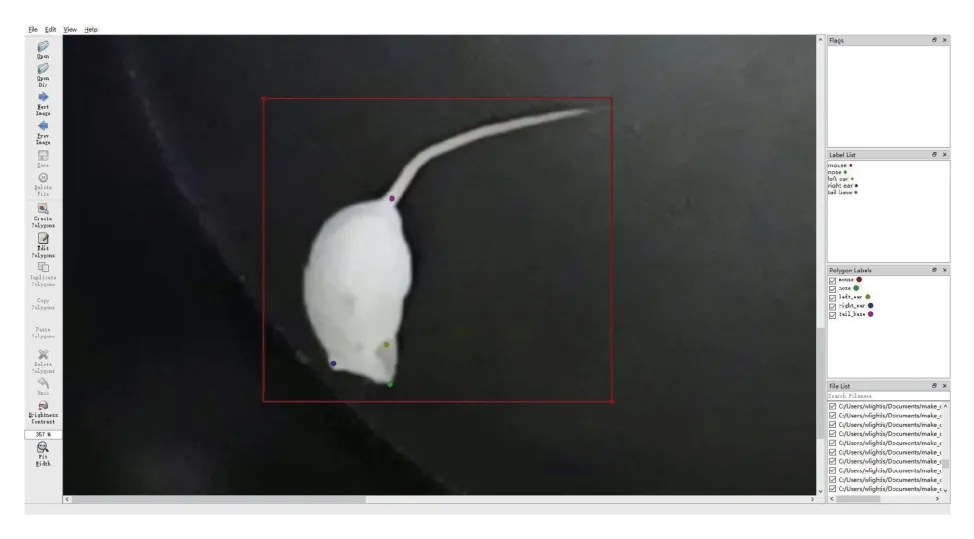

通過分析小鼠行為的動作特點,并結合曠場實驗[20]中運動參數和行為參數測量的需要,確定以小鼠的鼻尖、左耳、右耳和尾根作為關鍵點并構造姿態骨架,如圖7 所示。小鼠關鍵點檢測數據集的構建,通過對實驗場景平臺(如圖8 所示)獲取的視頻進行處理,將視頻打成圖片,使用labelme進行標注(如圖9 所示),依次標注包圍小鼠的框、鼻尖、左耳、右耳、尾基。之所以要標注框,是因為使用的關鍵點檢測算法YOLO5Face 是基于YOLOv5 算法的,YOLOv5 的數據集是需要標注目標框的。最后制作好的數據集包含1 000 張圖片,800 張訓練,100 張驗證,100 張測試。YOLO5Face原代碼預測的關鍵點數量是5 個,本研究中只用到4 個關鍵點,所以需要對YOLO5Face 代碼進行修改,使其預測4 個關鍵點坐標。

圖7 小鼠關鍵點骨架圖Fig.7 Skeleton diagram of mouse key points

圖8 實驗場景平臺Fig.8 Experimental platform

圖9 Labelme 標注數據集Fig.9 The dataset annotated by Labelme

1.4 關鍵點檢測評價標準

為了客觀合理評價改進的YOLO5face 模型在小鼠關鍵點檢測任務上的性能,本文采用PCK(Percentage of Correct Keypoints)作為小鼠關鍵點檢測準確度的評價標準。PCK[21]定義為正確估計出關鍵點的比例,計算檢測的小鼠關鍵點與其對應的真值間的歸一化距離小于設定閾值的比例。PCK 指標計算公式為

式中,i表示小鼠關鍵點的標簽序列號,k表示第k個閾值,Tk表示人工設定的閾值,Tk∈[0:0.01:0.5],p表示小鼠圖像序號,dpi表示第p幅圖像中標簽序列號為i的姿態關鍵點預測值與人工標注真值的像素距離,為數據集中第p幅圖像的尺度因子。小鼠兩只耳朵的位置相對穩定,不會因為姿態的不同出現較大的變化,適合作為尺度因子。所以本文采用每幅圖中檢測的左耳坐標到右耳坐標的歐式長度作為歸一化參考距離。δ表示如果條件成立則為1,否則為0。是對所有關鍵點計算取平均:

另外使用幀速和模型大小對模型進行評價,幀速表示模型每秒能處理多少幀圖像,即模型實時幀率,單位是f/s;模型大小指保存的模型大小,單位是MB。幀速越高表示模型實時性能越好,模型大小越小表示模型越輕量化。

1.5 消融實驗

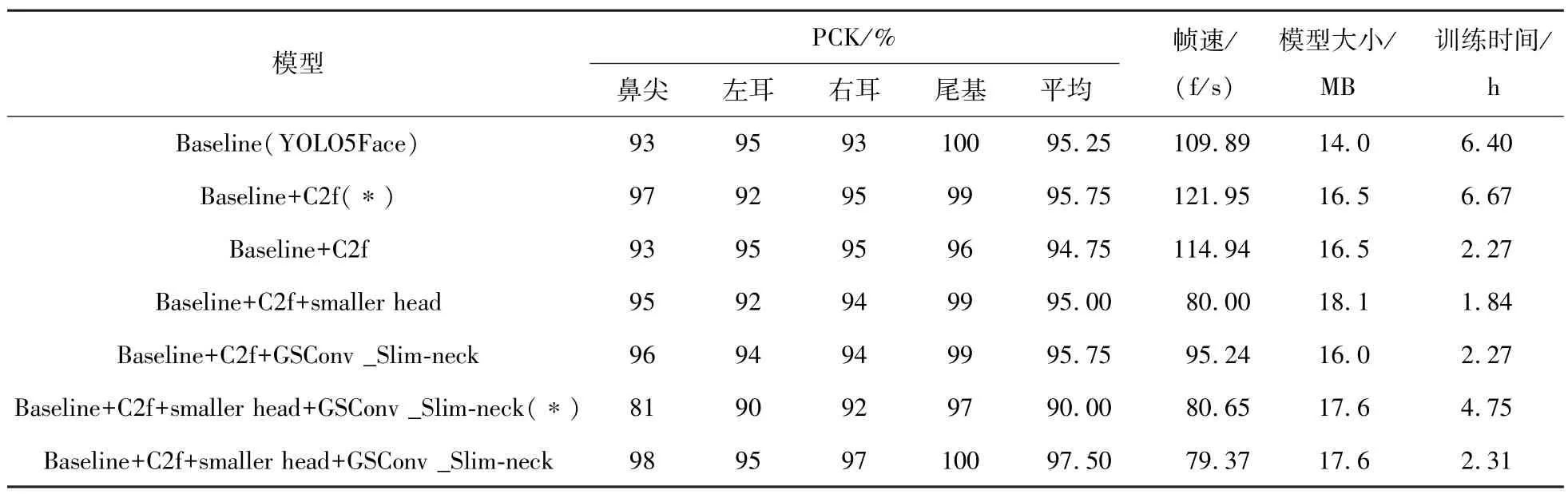

為了驗證上述添加的改進模塊對關鍵點檢測精度的有效性,進行消融實驗結果如表1 所示。消融實驗得出結論:同時加入C2f、smaller head 和GSConv_Slim-neck,訓練得到最佳模型,測試集精度相對于Baseline 提高了2.25%,從95.25%提升到97.5%。注:表中同名但是末尾帶有(?)的模型,表示訓練了更長時間。

表1 消融實驗結果Tab.1 Ablation results

1.6 不同模型間的實驗結果與分析

為了保持實驗結果的客觀一致性,實驗環境統一使用如下配置:CPU:Intel Core i7-12700H 2.70 GHz;GPU:NVIDIA GeForce RTX 3080 Ti;內存:16G;操作系統:Windows 11。

在獲得最佳的權重之后,與基于深度學習的動物姿態估計方法DeepLabCut[22]進行實驗結果對比,結果如表2 所示。從PCK 指標、幀速和模型大小三方面進行評價。結論:本文模型在精度上相對于 DeepLabCut 有 2% 的提升, 幀速是DeepLabCut 的3 倍,模型大小是DeepLabCut 的1/5。本文算法在實時關鍵點檢測問題上已經完全勝任。

表2 不同模型的比較結果Tab.2 The results of the comparison of different models

2 小鼠行為實時識別

2.1 小鼠行為識別數據集

本文的小鼠行為識別數據集由經驗豐富的觀察員進行數據標注,行為是一個過程,由一系列連續幀組成,包括行為的開始、中間和結束過程,單獨一張圖片是很難判斷這是什么行為,所以在數據標注時一個行為的所有過程都要被標注。結合曠場實驗中的具體要求,本文將小鼠行為分為梳洗、直立、靜止和行走四種,每類行為標注500 張,其中訓練集和測試集的比例是7 ∶3,數據集一共2 000 張,訓練集1 400 張,測試集600 張。

根據研究[23],動物行為學指標可以劃分為兩大類:運動特征和體態特征。通過結合多種行為學指標來識別小鼠的行為,可以更加準確、全面地評估其行為特征,因此本研究將同時考慮這兩類行為指標。

運動特征是反映小鼠行走等行為的顯著指標。本文的小鼠關鍵點檢測模型能同時檢測到小鼠身體的4 個關鍵點分別為鼻尖、左耳、右耳和尾基,另外取左耳關鍵點和右耳關鍵點連線中心點作為第5 個點。小鼠的運動特征就是分別計算這5 個點的幀間運動距離。幀間運動特征反映了上下幀之間小鼠行為的連續性。以往,基于運動參數的行為學指標假設小鼠被視為一個質點,并以其身體區域的質心來描述它的位置。本文中使用5 個關鍵點坐標,即是將小鼠的身體部位看作多個目標,每個目標的運動距離都作為一個運動特征,這樣做的目的是細分小鼠的運動特征,在一些只有身體部分區域發生變化的行為發生時(比如直立行為,尾基基本沒有運動距離,但是鼻尖有大幅度的運動距離)能夠作為一個顯著特征進行行為識別。運動距離指的是小鼠在連續兩幀間移動的距離,計算方法如下:

體態特征是根據小鼠骨架模型(如圖7 所示)來計算的。鼻尖、左耳、右耳及尾基4 個關鍵點構成四點骨架,骨架的每一條邊作為一個向量,圖中共有5 個向量。計算所有向量的長度、兩兩之間的夾角以及圍成的四邊形面積作為體態特征。

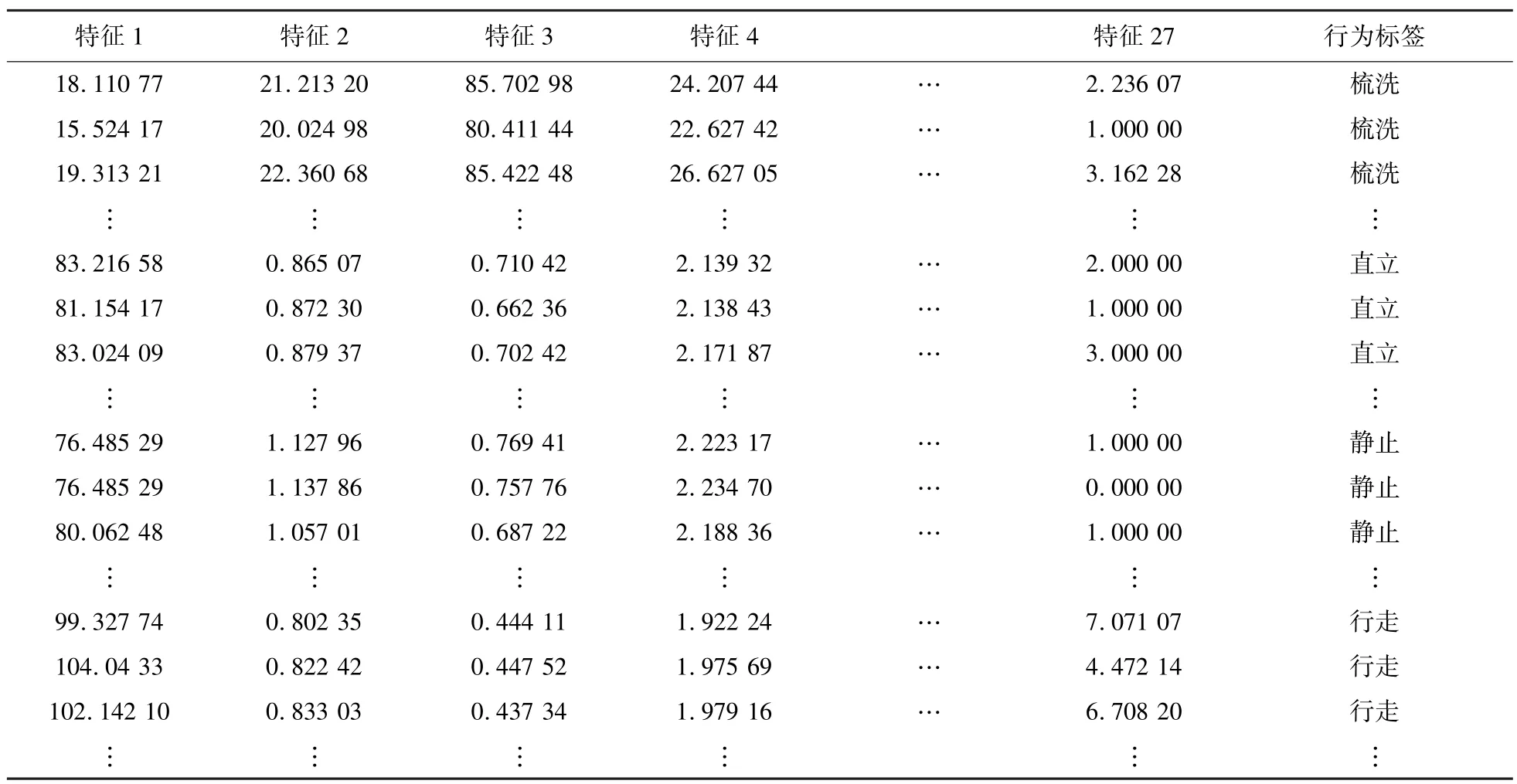

總結:數據以視頻序列輸入小鼠關鍵點檢測模型進行預測小鼠關鍵點在圖像中的位置,利用關鍵點檢測模型輸出小鼠關鍵點的坐標進行計算行為運動特征和體態特征共27 個特征建立行為識別數據集(特征1 到特征27 分別表示根據小鼠骨架計算的距離、角度、面積以及幀間位移特征)。共2 000 個數據展示其中一部分,最后一列是標簽,如表3 所示。

表3 行為識別數據集(部分)Tab.3 Behavior recognition dataset (part)

2.2 行為分類模型

2.2.1 SVM 模型

SVM[24]是一種二分類模型,它通過尋找特征空間中間隔最大的分離超平面來實現對數據的有效二分類。加了核函數之后,SVM 變成一個非線性模型。因為本文要構造一個實時模型,而SVM模型計算量小,故決定在此基礎上設計一個實時分類模型。

2.2.2 SVM 實時分類

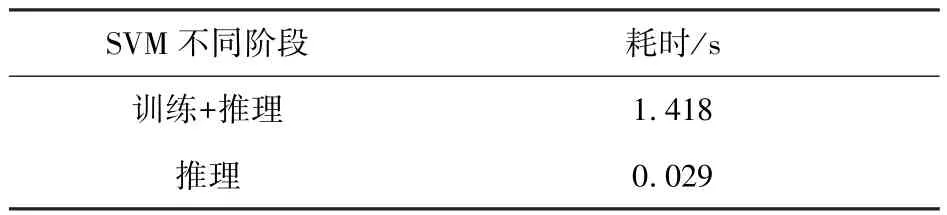

為了實現實時性,將SVM 訓練和測試的代碼分開。SVM 運行時間如表4 所示。訓練加測試的總時間是1.418 s,約等于0.705 f/s。這個結果遠遠達不到實時性,因為這還僅僅是行為分類的幀數,如果再加上小鼠關鍵點檢測需要的時間,總幀數連0.705 f/s 都達不到。但是從結果中看到SVM 訓練完成得到權重之后,跑測試集的時間只有0.029 s,約等于34.72 f/s,這個幀率完全滿足實時性。

表4 SVM 運行時間Tab.4 SVM run time

故使用SVM 進行行為識別的時候進行如下設計:調用SVM 時,先進行判斷,如果沒有已經訓練好的權重不存在,就進行訓練然后將權重保存下來,然后去預測;后面再調用SVM 時每次進行判斷,如果已經存在訓練好的權重,加載此權重去預測,省去每次都要訓練的時間。

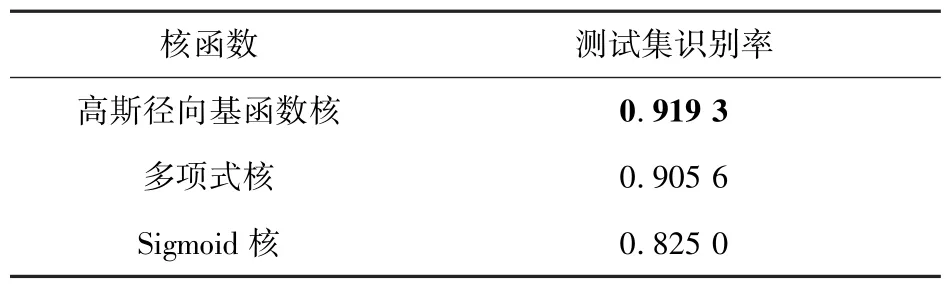

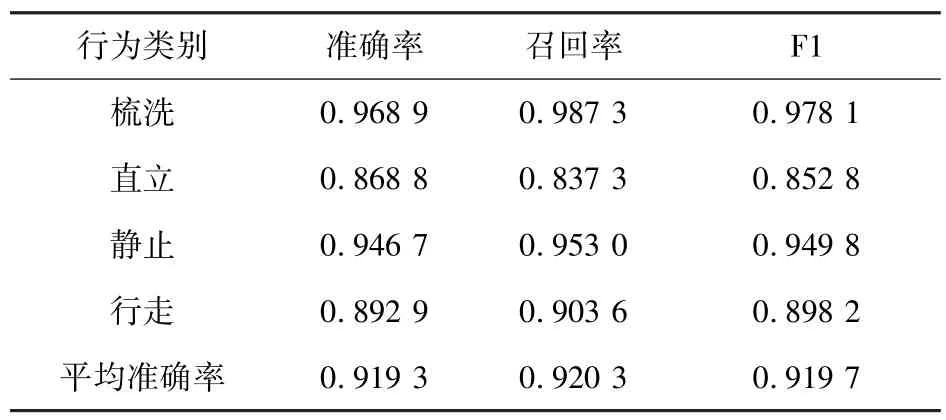

在本文自建的小鼠行為識別數據集上SVM的測試結果(如表5)可看出,核函數選擇為高斯徑向基函數時,SVM 分類模型識別率最高,因此核函數選擇為RBF 進行下一步操作。測試集平均精度為91.93%,梳洗、直立、靜止以及行走行為的測試集精度分別為96.89%、86.88%、94.67%、89.29%,如表6 所示。

表5 不同核函數SVM 訓練模型識別率Tab.5 Recognition rate of SVM training models with different kernel functions

表6 SVM 分類結果Tab.6 SVM classification result

2.2.3 機器學習算法對比實驗結果及分析

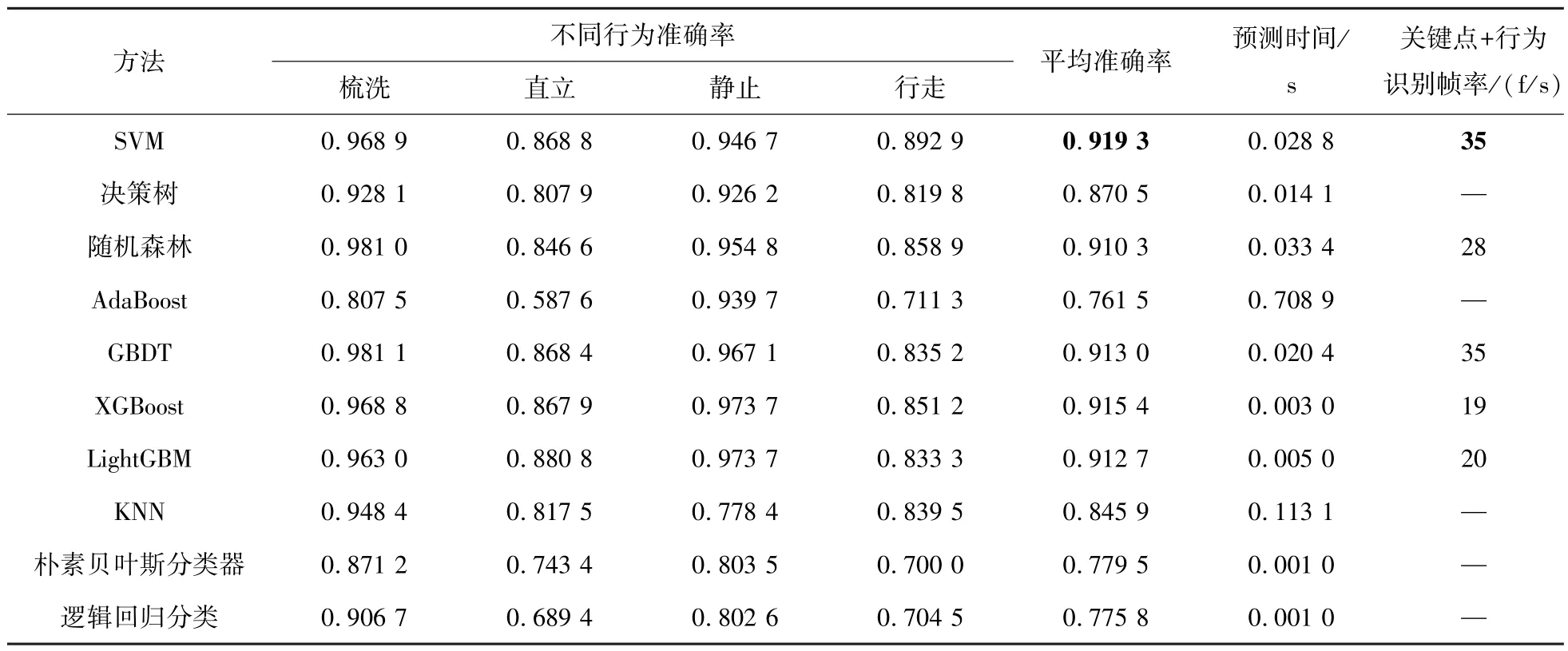

機器學習常用的分類算法除了SVM 還包括決策樹、隨機森林、樸素貝葉斯分類器、KNN、邏輯回歸分類、集成算法(AdaBoost、GBDT、XGBoost、LightGBM)。下面用這9 種機器學習算法在本文自建的小鼠行為識別數據集上進行對比實驗,分類結果如表7 所示。

表7 行為識別實驗的對比實驗結果Tab.7 Comparison of experimental results of behavior recognition experiments

從平均準確率來看,SVM、隨機森林、GBDT、XGBoost、LightGBM 基本在同一水平,準確率比較高,其他的算法精度比較低。從預測時間來看,上述幾個算法中LightGBM 只有0.005 s,相當于200 f/s; XGBoost 更是只有0.003 s, 相當于333 f/s。單從這個結果上來看,如果將小鼠行為實時識別模型中的行為分類算法使用這兩個算法中的一個,實時性就能大幅度提高。于是本文使用XGBoost 和LightGBM 算法都搭建了小鼠行為實時識別模型,使用XGBoost 的模型幀速只有19 f/s,使用LightGBM 的模型幀速只有20 f/s,均達不到SVM 的35 f/s。這里特意說明,使用XGBoost、LightGBM 進行小鼠行為實時識別的時候,都是將訓練和測試過程分開的,如果檢測到已經訓練好的權重,就直接加載進行模型推理。XGBoost、LightGBM 只能跑到19 f/s、20 f/s 的原因應該是模型比較復雜,加載的慢,雖然推理的快,但是加載慢同樣會使整體實時性下降。接下來將平均準確率比較高的幾個算法都以同樣的測試方法放進小鼠行為實時識別模型,測得隨機森林是28 f/s,GBDT 是35 f/s。SVM 和GBDT 在幀率都是35 f/s 的前提下,SVM 的準確率以0.63%的微弱優勢勝過GBDT。綜上所述,在本研究實驗場景下SVM 的性能超過其他機器學習算法,所以小鼠行為實時識別模型基于SVM 搭建。

2.3 小鼠行為實時識別流程

小鼠行為實時識別就是將小鼠關鍵點檢測模型與基于SVM 的小鼠行為實時識別模型拼接在一起,行為識別流程圖如圖10 所示。攝像頭實時獲得小鼠圖像,關鍵點檢測模型實時獲得小鼠的鼻尖、左耳、右耳和尾基的坐標,并保留上一幀的這4 個點的坐標(第一幀幀間運動距離為0)。然后利用當前幀和上一幀的坐標計算運動特征和體態特征共27 個特征。SVM 根據小鼠行為識別數據集已經訓練好的權重,只運行推理過程,對獲得的特征進行實時分類,完成小鼠行為實時識別流程。

圖10 行為識別流程圖Fig.10 Behavior recognition process

完成的小鼠實時行為識別截圖如圖11 所示,左上角顯示的“Pred”指的是預測的當前幀的行為,“FPS”指的是實時幀率,下面的數字“18.34”指的是兩耳中心點相對于上一幀的運動距離。

圖11 小鼠實時行為識別Fig.11 Mouse real-time behavior recognition

3 結論

針對當前大部分動物行為分析方法由于計算量大、模型復雜導致不能做到實時分析的問題,本文提出了一種改進YOLO5Face 的小鼠行為實時分析方法。本文提出的方法分為兩個步驟:小鼠關鍵點實時檢測和小鼠行為實時識別。針對小鼠關鍵點實時檢測,在深度學習網絡YOLO5Face 的基礎上改進,新增了一個更小的檢測頭、加入C2f 模塊以及引入GSConv 和Slim-neck,改進后的模型測試集精度達到了97.5%,推理速度為79 f/s,精度和實時幀率均高于DeepLabCut 模型的性能。針對小鼠行為實時識別:在本文改進的關鍵點檢測模型的基礎上,將體態特征與運動特征相結合構建小鼠行為識別數據集,使用訓練和推理過程分開的機器學習算法SVM 進行實時行為分類,對梳洗、直立、靜止、行走四種基本行為的平均識別準確率達到了91.93%。將關鍵點檢測代碼與行為識別代碼拼接之后,整個模型運行的實時幀率可以達到35 f/s。