面向復(fù)雜場景的森林防火監(jiān)測技術(shù)研究

摘 要:為解決森林防火工作中監(jiān)測預(yù)警不及時、不準確的問題,基于YOLOv8 模型提出了一種面向復(fù)雜場景的監(jiān)測技術(shù),實現(xiàn)了森林火情的快速準確監(jiān)測。在Backbone 部分引入動態(tài)蛇形卷積(Dynamic Snake Convolution,DySConv)模塊和全局注意力機制(Global Attention Mechanism,GAM)模塊,顯著增強了模型的特征提取能力,提升了煙火特征的表現(xiàn)力。采用WIoU(Wise Intersection over Union)損失函數(shù),增強網(wǎng)絡(luò)對普通質(zhì)量錨框的關(guān)注度,從而提供更準確的目標檢測評估。通過將DyHead 模塊集成到檢測頭中,增強了檢測頭的尺寸、空間和任務(wù)感知能力,優(yōu)化了整體性能。為了對模型性能進行嚴格評估,設(shè)計了消融實驗和主流模型對比實驗,結(jié)果表明,提出的方法是有效的,該方法的權(quán)重大小為14. 4 MB,平均精度均值(mean Average Precision,mAP)@ . 5:. 95 達到80. 3% 。相較于YOLOv8,mAP@ 5:. 95 提高了8. 7% 。該模型可為遠程火情監(jiān)控與預(yù)警提供技術(shù)支持,在森林防火工作中具備實用價值和現(xiàn)實意義。

關(guān)鍵詞:森林火情;深度學習;目標檢測;YOLOv8

中圖分類號:TP399 文獻標志碼:A 開放科學(資源服務(wù))標識碼(OSID):

文章編號:1003-3114(2024)04-0779-10

0 引言

火災(zāi)事故的發(fā)生對人類生命和財產(chǎn)造成不可估量的損害,也對社會生態(tài)環(huán)境構(gòu)成巨大威脅。然而,森林火災(zāi)作為災(zāi)難性事件,可能導(dǎo)致森林破壞和空氣污染,從而加劇全球氣候變化[1-2]。因此,及早預(yù)警和快速抑制森林火情是必不可少的[3]。

目前,計算機視覺、機器學習快速發(fā)展,圖像檢測技術(shù)為識別火災(zāi)場景提供了巨大的機會[4]。現(xiàn)有的火情檢測研究可以分為兩大類:傳統(tǒng)方法和基于深度學習的方法[5]。傳統(tǒng)方法大多數(shù)手動提取顏色、運動、形狀和紋理等特征[6]來識別目標區(qū)域,在火災(zāi)檢測領(lǐng)域做出了一定貢獻,但仍存在計算時間長、主觀性較強等問題。

與上述傳統(tǒng)方法相比,基于深度學習的方法檢測火焰和煙霧對象是一種更優(yōu)的方案[5]。采用神經(jīng)網(wǎng)絡(luò)來自動學習火災(zāi)圖像特征,具有高效的檢測性能,在火災(zāi)檢測相關(guān)研究中已取得了顯著成果。Zhang 等[7]通過卷積神經(jīng)網(wǎng)絡(luò)(Convolution NeuralNetwork,CNN)模型對小波分析生成的煙霧候選區(qū)域進行濾波,定位圖片中火焰和煙霧的位置,在變電站場景下的火災(zāi)檢測中取得了較好的效果。Zhan等[8]采用改進SSD(Singal Shot multibox Detector)算法提高了火災(zāi)檢測中對低分辨率圖像和小物體的檢測性能。在一些研究中通過Faster RCNN 算法檢測出圖像中的火災(zāi)、非火災(zāi)區(qū)域,然后通過格拉斯曼流形分析或長短期記憶對邊界框內(nèi)的特征進行匯總分類[9-10],最終做出的火災(zāi)決策也較為準確。YOLO作為經(jīng)典目標檢測算法之一,以快速檢測著稱,在火災(zāi)檢測應(yīng)用中,更是表現(xiàn)出了優(yōu)異的性能。在識別船舶火災(zāi)應(yīng)用中,改進YOLOv4-tiny 算法在精度和召回率等評價指標上都勝于SSD 算法[11];在森林火災(zāi)探測應(yīng)用中,基于改進YOLOv5 模型,大幅度提高了小目標的森林火災(zāi)檢測的平均精度均值(meanAverage Precision,mAP),使整個模型對森林火災(zāi)場景極具魯棒性[12]。綜上所述YOLO 算法在目標檢測問題中是行之有效的方法。

從近期森林火災(zāi)領(lǐng)域的研究來看,實現(xiàn)森林火情準確探測,并真正具備實際應(yīng)用價值仍然是一個艱巨的挑戰(zhàn)。Qian 等[2]提出了一種集成方法,實現(xiàn)了既能識別大目標又能識別小目標的火焰檢測。但未對森林火災(zāi)場景中的煙霧進行識別。Xiao 等[13]提出一種基于YOLOv7 的輕量級小目標檢測模型,該模型在參數(shù)數(shù)量上達到了27. 5 M,但對于實際應(yīng)用的便攜式監(jiān)控部署,仍有改進的空間。因此,在森林火情檢測領(lǐng)域仍然迫切需要一個既能全面的考慮森林火情場景,又具有較為準確的監(jiān)測精度的方法,來滿足實際森林防火應(yīng)用需求。

本文選用YOLO 系列的YOLOv8 作為基準模型,并進行了改進,有效改善森林火災(zāi)場景下煙霧和火焰目標識別精度低,漏檢高的問題,最終模型權(quán)重大小僅有14. 4 MB,可滿足實際應(yīng)用部署。

1 數(shù)據(jù)準備

1. 1 數(shù)據(jù)獲取

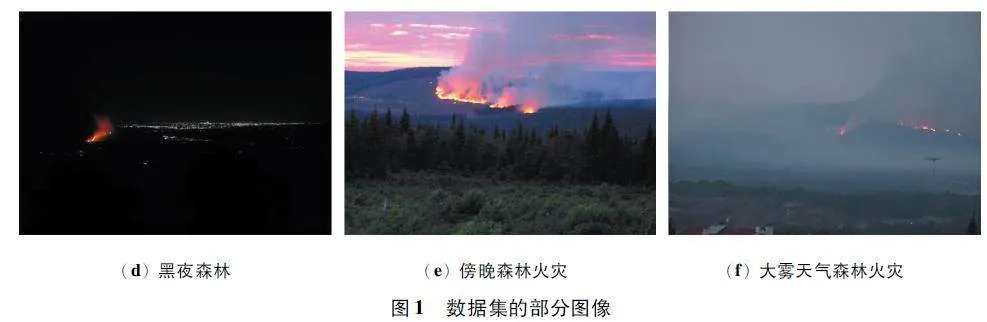

目前,適用本研究的公開數(shù)據(jù)集并不廣泛。大多數(shù)火災(zāi)公開數(shù)據(jù)集場景較單一,且質(zhì)量不高。因此,本文手動搜集了一系列森林火災(zāi)圖像樣本,形成本研究的數(shù)據(jù)集。數(shù)據(jù)集共有6 388 張圖像,這些圖像來自不同的現(xiàn)實環(huán)境,如白天、黑夜、大霧、近端拍攝、監(jiān)控和航拍等。這些豐富的場景給本文火情檢測任務(wù)帶來了重大挑戰(zhàn)。例如黑夜的燈光、層積的烏云和大霧天氣等在鏡頭下會對目標產(chǎn)生極強的干擾,但這也將有助于本文建立強大的模型。圖1展示了數(shù)據(jù)集的部分圖像。

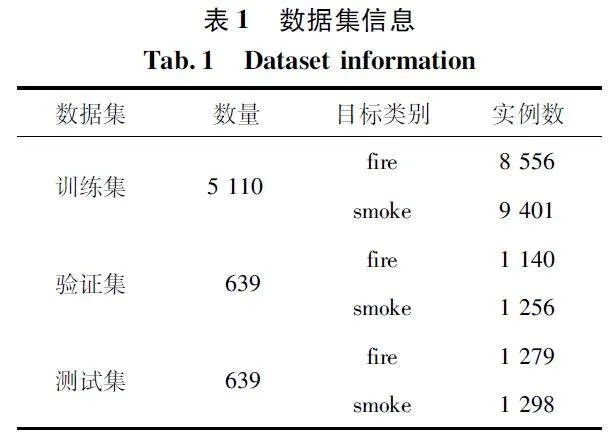

本文將森林火情監(jiān)測目標分為兩類:火焰(fire)和煙霧(smoke),并將數(shù)據(jù)集分成訓(xùn)練集、驗證集和測試集,比例為8 ∶1 ∶1。采用LabelImg 標記工具對6 388 張圖像中的火焰和煙霧進行標注,具體數(shù)據(jù)信息如表1 所示。

1. 2 數(shù)據(jù)增強

在模型訓(xùn)練過程中,對訓(xùn)練樣本進行數(shù)據(jù)增強,會使模型具有更好的泛化性能。Mosaic 數(shù)據(jù)增強最早是在YOLOv4 的文章中提出的,其思路就是將4 張圖片進行隨機裁剪,再拼接到一張圖上作為訓(xùn)練數(shù)據(jù)。這樣做的好處是,豐富了一張圖上的煙火目標信息,且4 張圖片拼接在一起變相地提高了單次訓(xùn)練樣本數(shù)(batch_size),減少了對大batch_size的依賴。圖2 展示了在使用本文模型對森林火災(zāi)數(shù)據(jù)集進行訓(xùn)練時候的Mosaic 數(shù)據(jù)增強圖像。

在本研究中,通過Mosaic 數(shù)據(jù)增強相當于變相擴充了數(shù)據(jù)集內(nèi)小目標的火焰和煙霧數(shù)量。除此之外,也使得模型能夠?qū)W習到不同場景下火焰和煙霧目標的各種姿態(tài)。

2 改進YOLOv8n 網(wǎng)絡(luò)架構(gòu)設(shè)計

YOLOv8n 是YOLOv8 算法中的輕量級參數(shù)結(jié)構(gòu)。它的網(wǎng)絡(luò)結(jié)構(gòu)包括骨干(Backbone)、頸部(Neck)和預(yù)測輸出頭(Head)三部分。骨干網(wǎng)絡(luò)從輸入圖像中提取不同尺度的特征。頸部網(wǎng)絡(luò)的作用是融合不同層次的特征圖,這里采用路徑聚合網(wǎng)絡(luò)- 特征金字塔網(wǎng)絡(luò)(Path Aggregation Network-Feature Pyramid Network,PAN-FPN)方法形成高效傳播,通過特征金字塔結(jié)構(gòu)生成新的特征表示。頭部負責預(yù)測輸出,利用3 組不同尺度的預(yù)測特征來檢測圖像內(nèi)容。

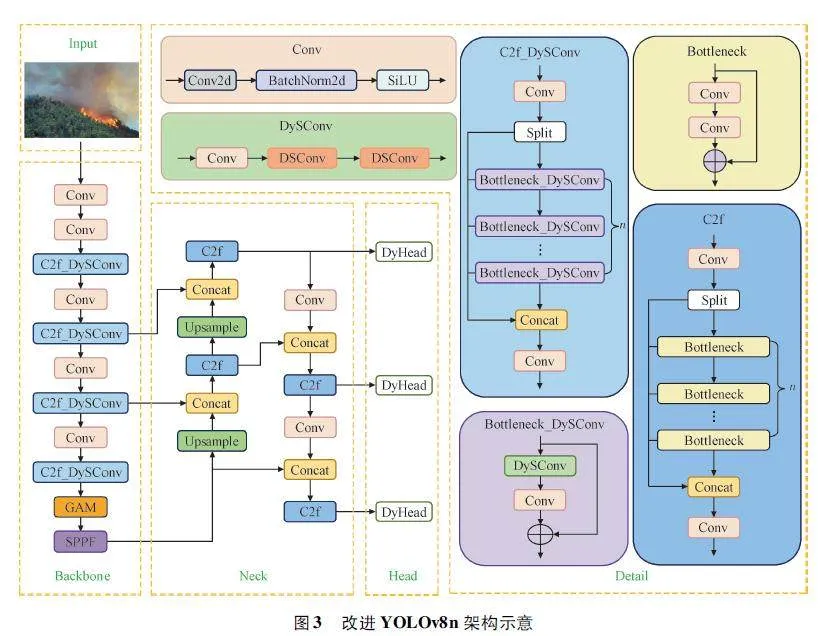

依據(jù)火災(zāi)檢測任務(wù)需求,本研究以YOLOv8n 為基準模型,在骨干網(wǎng)絡(luò)中引入了動態(tài)蛇形卷積模塊(Dynamic Snake Convolution,DySConv),并添加了全局注意力機制(Global Attention Mechanism,GAM)。將損失函數(shù)修改為WIoU,檢測頭更換為DyHead。圖3 為改進后的YOLOv8n 架構(gòu)示意。

2. 1 骨干的改進

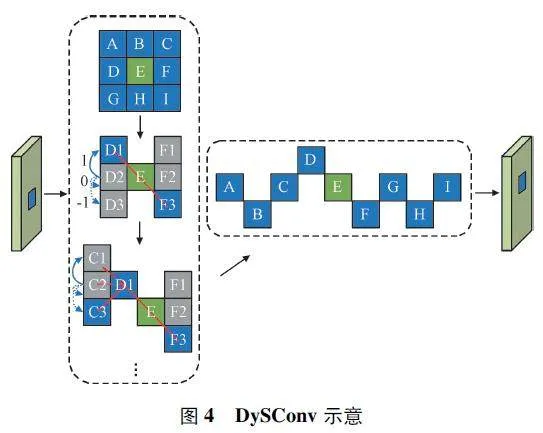

由于火焰和煙霧在圖像中的形態(tài)、顏色和大小不同,原始YOLOv8n 使用普通卷積操作,在特征提取時沒有適應(yīng)圖形幾何變形時對不同位置區(qū)域的感受野尺寸的變化[14],有一定的局限性。為緩解這一問題,在Backbone 的C2f 模塊中引入了DySConv。DySConv[15]是一種新穎的卷積方法,于2023 年被提出用于管狀結(jié)構(gòu)特征。它的靈感來源于蛇的運動方式,具體地說,DySConv 將連續(xù)性約束加入到了卷積核中,每一個卷積位置都由其前一個位置作為基準,自由選擇擺動方向,保證了感受野的連續(xù)性,也對位置變化具有良好的適應(yīng)能力。在采樣時可更貼近火焰和煙霧的形狀和尺寸。將其應(yīng)用在本研究任務(wù)中,有利于從圖像獲取煙火占比細小的結(jié)構(gòu)特征,加強模型的提取能力,從而提高模型檢測性能,圖4 為DySConv 示意。

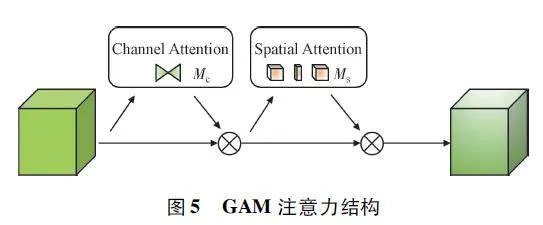

引入GAM[14]來學習煙火類別無關(guān)的全局通道水平和空間水平的注意特征圖,以保留更詳細的微小信息,抑制無關(guān)的噪聲信息。其中包含了通道注意力(Channel Attention)模塊和空間注意力(SpatialAttention)模塊兩個子模塊,這兩個模塊分別沿通道和空間兩個獨立的維度依次進行注意力,在減少信息彌散的同時放大跨維度特征的交互作用。GAM注意力結(jié)構(gòu)如圖5 所示。其中,Mc 和Ms 分別為通道注意力特征圖和空間注意力特征圖;C為矩陣乘法。

2. 2 頭部的改進

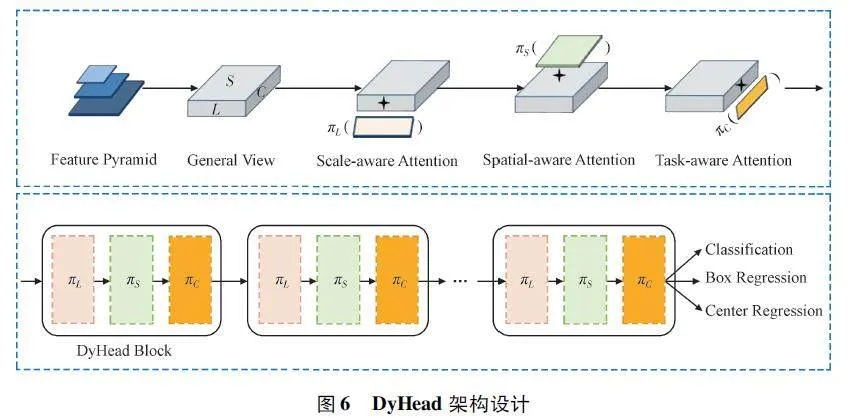

DyHead[16]是一種新穎的動態(tài)頭部框架,將目標檢測頭與注意力機制相結(jié)合,旨在提高目標檢測任務(wù)中的定位和分類性能。本文使用的火災(zāi)數(shù)據(jù)集背景復(fù)雜且環(huán)境多變,包括多種形態(tài)的火焰與煙霧,DyHead 這種具備多維感知能力的檢測頭,更加貼合本文火災(zāi)檢測任務(wù)。其通過有效結(jié)合跨特征層的多種自注意力機制,實現(xiàn)集成尺度感知、空間感知和任務(wù)感知的目標檢測頭[17],顯著提高了目標檢測頭的表達能力。DyHead 的架構(gòu)設(shè)計如圖6 所示。

πL 是尺度感知注意力,πS 是空間位置感知注意力,πC 是任務(wù)感知注意力。在圖6 的DyHead 架構(gòu)設(shè)計中,特征圖被轉(zhuǎn)換為三維張量,其中L 表示層數(shù),C 表示通道數(shù),S 表示特征圖的高度和寬度,并依次采用3 種注意力機制來增強檢測性能。3 種注意力的疊加形成了一個DyHead Block,本文使用的真正檢測頭是由4 個DyHead Block 串行堆疊而成的。

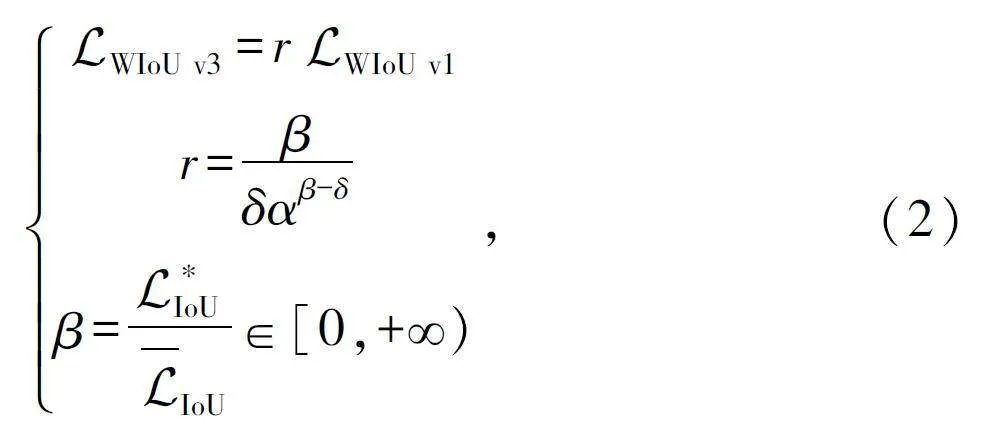

2. 3 損失函數(shù)的改進

在YOLOv8n 網(wǎng)絡(luò)模型中,采用分布焦點損耗(Distribution Focal Loss,DFL)和CIoU(Complete In-tersection over Union)計算邊界框的回歸損失。CIoU將邊界框的縱橫比作為懲罰項加入到邊界框損失函數(shù)中[18],雖可以加快收斂過程,但對于長寬比例差異較大的物體,判定能力較弱。除此之外,CIoU 還未考慮難易樣本的平衡問題。因此,將CIoU 損失函數(shù)優(yōu)化為WIoU 損失函數(shù)[19],該函數(shù)有3 個版本。

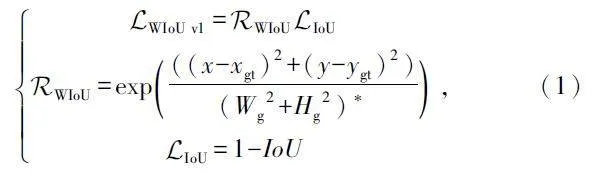

WIoU v1 是基于注意力的邊界框回歸損失,減少了幾何度量的懲罰,WIoU v1 的表達式為:

式中:x、y 分別為預(yù)測框中心點的橫縱坐標值,xgt、ygt 分別為實際目標框的中心點橫縱坐標值,Wg、Hg 分別為最小邊界框的寬度和高度。

WIoU v2 設(shè)計了一種針對交叉熵的單調(diào)聚焦機制,能有效降低簡單示例對損失值的貢獻。

WIoU v3 引入了動態(tài)非單調(diào)聚焦機制,WIoU v3的表達式為:

式中:δ、α 為超參數(shù),β 為預(yù)測框的異常度,r 為非單調(diào)聚焦系數(shù),C*IoU 為單調(diào)聚焦系數(shù)。

由于WIoU v3 具有動態(tài)非單調(diào)調(diào)頻的明智梯度增益分配策略,為較小異常值的錨框分配小的梯度增益,使模型更關(guān)注普通質(zhì)量的錨框,能有效屏蔽低質(zhì)量樣本的影響。在本文的檢測任務(wù)中,WIoU v3可以更好的衡量煙火類目標邊框的準確性,提高模型的檢測性能。

2. 4 訓(xùn)練設(shè)備和評價指標

2. 4. 1 實驗環(huán)境

本文所使用的實驗配置環(huán)境為:CPU 配置13thGen Intel (R) Core (TM)i9-13900KF;GPU 配置NVIDIA GeForce RTX 4090 24 GB 顯存;操作系統(tǒng)Windows 11;深度學習框架Pytorch2. 0. 1,Python 3. 9;調(diào)用GPU 進行訓(xùn)練,訓(xùn)練300 輪(Epoch)。采用余弦退火衰減策略使學習率產(chǎn)生周期性變化,使得模型能夠穩(wěn)定地收斂,減少訓(xùn)練過程中的震蕩現(xiàn)象。

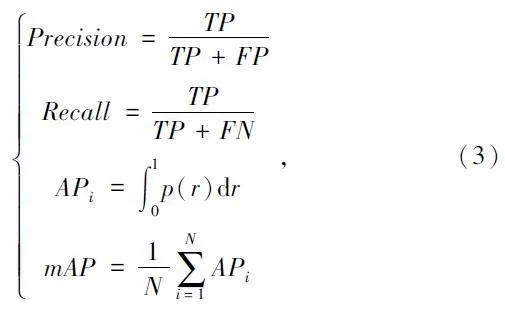

2. 4. 2 模型評估指標

本文使用精確度(Precision)、召回率(Recall)和mAP 作為檢測模型性能的評價指標,表達式為:

式中:TP 為像中正確檢測煙火目標的數(shù)量,FP 為圖像中檢測錯誤與目標分類錯誤的數(shù)量,FN 為圖像中漏檢的數(shù)量;N 為煙火目標類別的總數(shù),Precision用來評估煙火類目標的預(yù)測是否正確,即在所有預(yù)測樣本中,準確預(yù)測的概率;Recall 對所有煙火類目標的評估和預(yù)測,反映了正確預(yù)測在所有實際正樣本中的比例;APi 為第i 個類別的平均精度,具體為第i 類目標的PR 曲線與坐標軸圍成的面積,反應(yīng)了目標檢測精度的性能;mAP 可衡量目標檢測中的整體檢測精度。

此外,本研究使用模型尺寸作為參考指標,模型越小,表示模型消耗的內(nèi)存越低。

3 實驗結(jié)果分析

為了對比分析本研究改進后的模型性能,在模型訓(xùn)練參數(shù)一致的情況下設(shè)計了兩組試驗:消融試驗、主流模型性能對比試驗。選取不同環(huán)境下的森林火情圖像數(shù)據(jù)進行測試,從不同維度對模型的檢測效果進行分析。

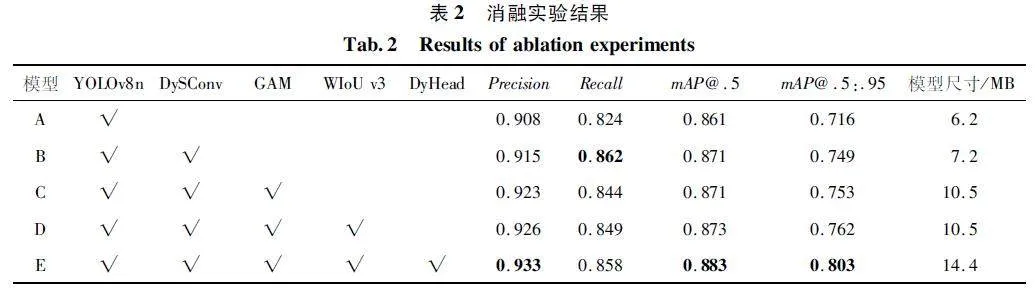

3. 1 消融實驗對比

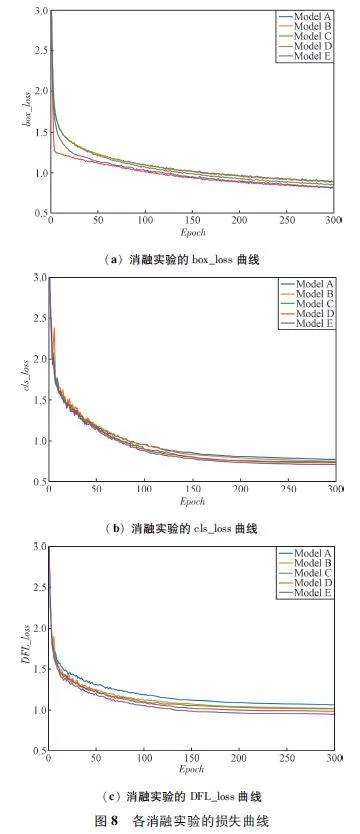

本文設(shè)計了5 組消融實驗,以評估不同改進點對提高模型性能的有效性。這5 個實驗包括基準模型A、使用DySConv 的YOLOv8n 模型B、在B 基礎(chǔ)上加入GAM 的模型C、將模型C 中損失函數(shù)修改為WIoUv3 的模型D、結(jié)合了上述所有改進的模型E。表2 列出了各消融模型的評價指標,最佳指標用粗體顯示。

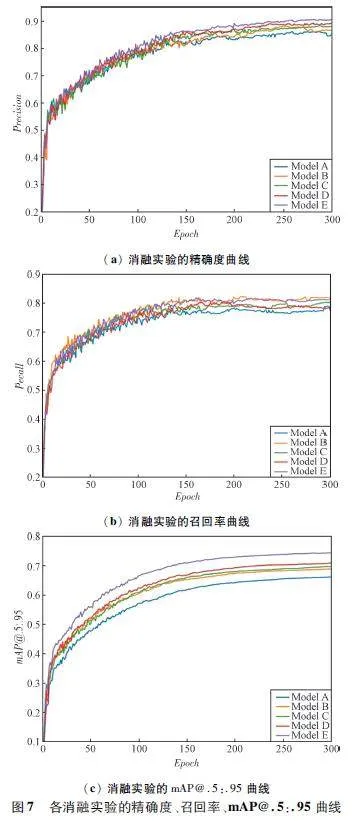

從表2 可以看出,本文提出的改進策略是有效的,使模型性能評價指標有所提升。基準模型A 在本任務(wù)中表現(xiàn)不理想,它各項評價指標值最低。與模型A 相比,模型B 的檢測精度和mAP@ . 5 略高,召回率和mAP@ . 5:. 95 提升較明顯。模型B 在整體消融實驗中的召回率最高,意味著DyHead 的加入有效提升了模型對煙火目標的提取能力,降低了森林火災(zāi)檢測中的漏檢問題。模型B 相比,模型C 犧牲了一些召回率,但它的檢測精度達到了92. 3% 。損失函數(shù)的修改使模型D 脫穎而出,各項指標進一步提高。在模型E 中,DyHead 模塊的加入導(dǎo)致模型尺寸增加了3. 9 MB,但它使mAP@ . 5:. 95 的值大幅提升,測試集的mAP@ . 5:. 95 從76. 2% 增加到80. 3%,檢測精度達到了93. 3%。相較于基準模型召回率、mAP@ . 5 和mAP@ . 5:. 95 分別提高了3. 4%、2. 2%和8. 7%,表現(xiàn)出了最佳的檢測性能。盡管一些改進點的增加導(dǎo)致模型尺寸變大,但變大的幅度在可接受的范圍內(nèi),能滿足實際應(yīng)用。因此,選用模型E作為本研究任務(wù)的檢測模型。圖7(a)~ 圖7(b)展示了5 個模型的Precision、Recall 曲線。可以看出,模型E 的曲線在呈現(xiàn)上升趨勢的過程中,曲線波動幅度較小,并且持續(xù)維持在最上方。在表2 中模型C 的各項評價指標較模型B 的提升并不大,但圖7(a)中模型C 的曲線較模型B 平穩(wěn)許多,這也驗證了GAM 的加入對模型性能的提升是有意義的。圖7(c)展示了5 個模型的mAP@ . 5:. 95 曲線,模型E的mAP@ . 5:. 95 值穩(wěn)穩(wěn)高于其他模型,這也表示模型E 在本文任務(wù)中具有最佳的準確性和穩(wěn)定性。

YOLOv8 損失包括分類損失、回歸損失。回歸損失分兩部分,第一部分采用CIoU Loss 來評價預(yù)測框和目標框之間的差異,對于模型D 和模型E 來說,這部分采用WIoU 損失;第二部分就是分布焦點損失。圖8 中曲線的一致性突出了本文模型的穩(wěn)定性能,由圖可知,本文模型的WIoU 損失收斂較快,意味著相較于未加入WIoU 損失函數(shù)的模型A、模型B 和模型C,該模型在檢測過程中能夠更快、更好的找到最優(yōu)解。

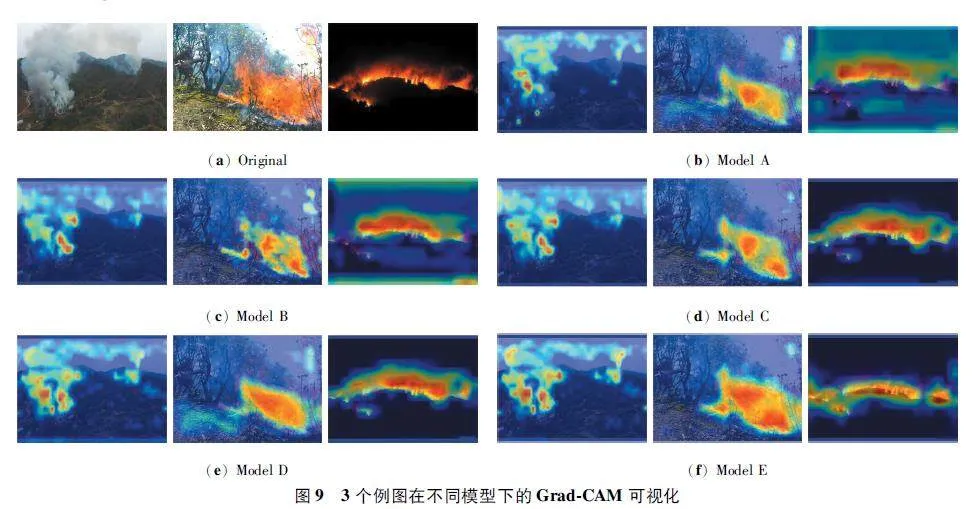

使用梯度加權(quán)類激活映射(Grad-CAM)這種視覺解釋方法,來突出顯示火災(zāi)圖像上感興趣的區(qū)域,更加直觀地解釋了5 個消融模型的檢測[20]。如圖9所示,紅色部分是圖像中實際影響模型決策的主要區(qū)域,這也為選用本文模型建立了合理的解釋。觀察發(fā)現(xiàn),本文模型的可視化分析影響決策區(qū)域較大,且更細致。

3. 2 不同模型檢測性能的比較

將本文模型與火災(zāi)檢測中常用的目標檢測算法進行對比,從表3 可以推斷,本文模型具有最高召回率和mAP 值,mAP@ . 5 達到了88. 3%,mAP@ . 5:. 95達到了80. 3% 。然而,在相同的實驗環(huán)境下,FasterR-CNN(70. 1% )、SSD(65. 4% )、YOLOv3(74. 3% )、YOLOv4-tiny (69. 9%)、YOLOv5s (74. 2%)、YOLOv6(74. 5%)、YOLOv7(71. 1%)和YOLOv7-tiny(67. 5%)在mAP@ .5:.95 方面表現(xiàn)出顯著差異。本文模型大小為14. 4 MB,雖然不及YOLOv4-tiny、YOLOv6 和YOLOv7-tiny 但相差不大,且在其他評價指標上具備極大優(yōu)勢。Faster R-CNN、YOLOv3 和YOLOv7 都不符合輕量部署需求。由此可見,本文模型在模型大小和檢測精度之間取得了較好的平衡。既提高了森林火情檢測效果,又可以滿足遠程監(jiān)控防火系統(tǒng)的便攜部署。

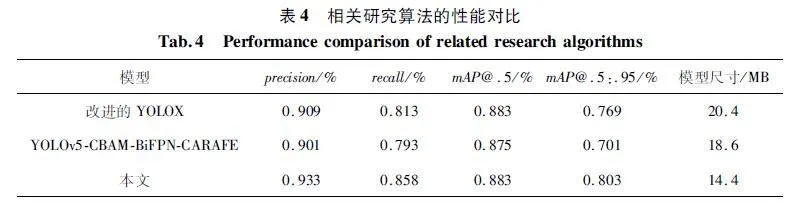

在相關(guān)研究中,除了直接使用上述檢測算法外,也對一些模型進行了改進。本文選用邱思遠等[21]提出的改進YOLOX 模型,何盼霞等[22]提出的YOLOv5-CBAMBiFPN-CARAFE 模型進行比較。基于本文構(gòu)建的火災(zāi)數(shù)據(jù)集進行模型訓(xùn)練,實驗結(jié)果如表4 所示,綜合比較所有評價指標,本文模型均優(yōu)于二者,且模型大小更勝一籌。因此,本文模型在森林火災(zāi)場景下檢測效果優(yōu)異,具有實際參考價值。

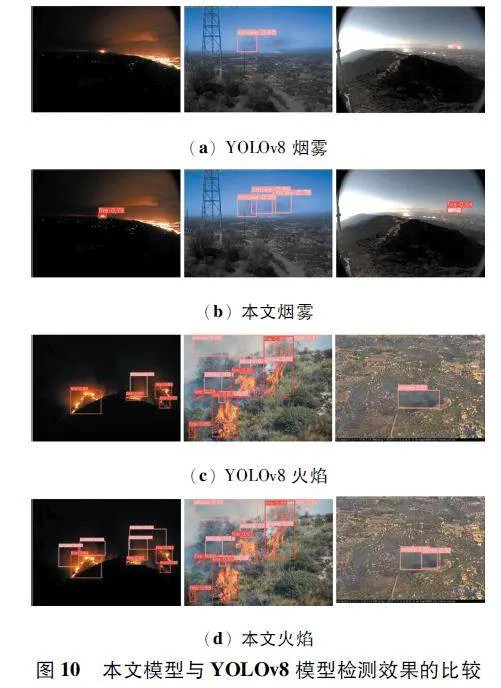

3. 3 改進算法性能展示

為展示本文算法的檢測結(jié)果,從測試子集中隨機選擇了不同情況下的森林火災(zāi)圖像進行比較,檢測結(jié)果如圖10 所示。

由圖10 可以看出,很明顯原始YOLOv8 模型出現(xiàn)了火焰、煙霧漏檢等現(xiàn)象。之所以出現(xiàn)這種現(xiàn)象可能是因為檢測背景過于復(fù)雜,且目標特征不明顯,給模型檢測造成了極大困難。相比而言,本文模型可以較準確地檢測復(fù)雜場景中的煙霧和火焰,例如遠處的微小火焰、難以判斷的煙霧,并且返回定位框架更為準確。這些檢測圖片清楚地展示了本文模型在森林火情環(huán)境中具有優(yōu)越的檢測能力。但通過觀察發(fā)現(xiàn),它仍然會出現(xiàn)一些漏檢問題,需要進一步優(yōu)化來滿足實際森林火情檢測需求。

4 結(jié)束語

本文手動收集了不同現(xiàn)實場景下的森林火情圖像,建立了豐富的森林火情數(shù)據(jù)集,可為防火檢測領(lǐng)域的研究提供數(shù)據(jù)支持。為了增強YOLOv8 檢測微小煙火目標的能力,將DySConv 模塊和GAM 注意力融入模型的Backbone 中,提高了算法的特征提取和表示能力。此外,WIoU v3 損失函數(shù)和DyHead 的加入提供了更精準的損失評估和檢測效果。實驗結(jié)果表明,本文方法的檢測精度為93. 3% 、召回率值為85. 8% ,與原來的YOLOv8 算法相比mAP@ . 5:.95 提高了8. 7% ,在火災(zāi)檢測中表現(xiàn)出更可靠的性能。與常用目標檢測算法相比,本文模型在所有評價指標上取得了平衡,且模型尺寸為14. 4 MB,可滿足實際火情檢測的需求。綜上所述,該模型在森林火情探測中具有較大的應(yīng)用潛力,可以考慮與遠程防火監(jiān)控設(shè)備結(jié)合使用。

但本文模型仍存在缺陷:檢測過程中面對監(jiān)控畫面下強光照射的物體反光時,會出現(xiàn)火情檢測失敗的現(xiàn)象,導(dǎo)致模型的檢測效果不穩(wěn)定,應(yīng)用到實際中還存在弊端。因此,在未來工作中嘗試將圖像濾波及其他處理方法整合到檢測技術(shù)中,提高檢測問題中的圖像質(zhì)量,解決強光反射下火災(zāi)識別失敗問題。細致考慮實際應(yīng)用場景,全面提高模型的魯棒性能,助力實現(xiàn)森林防火的準確監(jiān)測。

參考文獻

[1] KHARUK V I,PONOMAREV E I,IVANOVA G A,et al.Wildfires in the Siberian Taiga [J]. Ambio,2021,50:1953-1974.

[2] QIAN J C,BAI D,JIAO W G,et al. A Highprecision Ensemble Model for Forest Fire Detection in Large and SmallTargets[J]. Forests,2023,14(10):2089.

[3] SIERRA D,MONTANARO W,KUO L,et al. EnhancingFire Detection Through CNN and Transfer Learning:AComprehensive Research Study Corresponding Author[J]. Journal of Engineering and Applied Sciences Technology,2023,5(5):1-6.

[4] GEETHA S,ABHISHEK C S,AKSHAYANAT C S. Machine Vision Based Fire Detection Techniques:A Survey[J]. Fire Technology,2021,57:591-623.

[5] HOU F,RUI X,CHEN Y,et al. Flame and SmokeSemantic Dataset:Indoor Fire Detection with DeepSemantic Segmentation Model [J]. Electronics,2023,12(18):3778.

[6] DARAJAT A N,STHEVANIE F,RAMADHANI K N. FireDetection on Video Using Multifeature Fusion andSupport Vector Machine [C]∥2023 11th InternationalConference on Information and Communication Technology(ICoICT). Melaka:IEEE,2023:600-605.

[7] ZHANG X,WANG W G,LI X R,et al. Flame and SmokeDetection in Substation Based on Wavelet Analysis andConvolution Neural Network [C]∥ICIAI’19:Proceedingsof the 2019 3rd International Conference on Innovation inArtificial Intelligence. Suzhou:ACM,2019:248-252.

[8] ZHAN H W,PEI X Y,ZHANG T H,et al. Research onFlame Detection Method Based on Improved SSDAlgorithm[J]. Journal of Intelligent & Fuzzy Systems:Applications in Engineering and Technology,2023,45(4):6501-6512.

[9] BARMPOUTIS P,DIMITROPOULOS K,KAZA K,et al.Fire Detection from Images Using Faster RCNN and Multidimensional Texture Analysis[C]∥2019 IEEE International Conference on Acoustics,Speech and Signal Processing (ICASSP). Brighton:IEEE,2019:8301-8305.

[10]KIM B,LEE J. A Videobased Fire Detection Using DeepLearning Models[J]. Applied Sciences,2019,9(14):2862.

[11]WU H F,HU Y L,WANG W J,et al. Ship Fire DetectionBased on an Improved YOLO Algorithm with aLightweight Convolutional Neural Network Model [J].Sensors,2022,22(19):7420.

[12]XUE Z Y,LIN H F,WANG F. A Small Target Forest FireDetection Model Based on YOLOv5 Improvement [J].Forests,2022,13(8):1332.

[13]XIAO Z,WAN F,LEI G B,et al. FLYOLOv7:A Lightweight Small Object Detection Algorithm in Forest FireDetection[J]. Forests,2023,14(9):1812.

[14]LIU Y C,SHAO Z R,HOFFMANN N. Global AttentionMechanism:Retain Information to Enhance Channelspatial Interactions[EB/ OL]. (2021 -12 - 10)[2024 -01-22]. https:∥arxiv. org/ abs/2112. 05561.

[15]QI Y L,HE Y T,QI X M,et al. Dynamic Snake Convolution Based on Topological Geometric Constraints forTubular Structure Segmentation [C]∥2023 IEEE/ CVFInternational Conference on Computer Vision (ICCV).Paris:IEEE,2023:6047-6056.

[16]DAI X Y,CHEN Y P,XIAO B,et al. Dynamic Head:Unifying Object Detection Heads with Attentions[C]∥2021IEEE/ CVF Conference on Computer Vision and PatternRecognition (CVPR). Nashville:IEEE,2021:7369-7378.

[17]梁興碧. 駕駛環(huán)境感知算法研究[J]. 科學技術(shù)創(chuàng)新,2022(25):45-48.

[18]周順勇,劉學,朱豪,等. 基于改進YOLOv5s 的脆桃缺陷檢測[J]. 國外電子測量技術(shù),2023,42(10):139-146.

[19]TONG Z J,CHEN Y H,XU Z W,et al. WiseIoU:Bounding Box Regression Loss with Dynamic FocusingMechanism[EB/ OL]. (2023-04-08)[2024-01-22].https:∥arxiv. org/ abs/2301. 10051.

[20]SELVARAJU R R,COGSWELL M,DAS A,et al. Gradcam:Visual Explanations from Deep Networks viaGradientbased Localization[C]∥2017 IEEE InternationalConference on Computer Vision (ICCV). Venice:IEEE,2017:618-626.

[21]邱思遠,王孝蘭,張偉偉,等. 基于YOLOX 的森林火災(zāi)早期預(yù)警研究[J]. 農(nóng)業(yè)裝備與車輛工程,2023,61(11):106-110.

[22]何盼霞,張梅,齊至家. 基于改進YOLOv5 的森林火災(zāi)檢測算法研究[J]. 蘭州工業(yè)學院學報,2023,30(4):73-78.

作者簡介:

曹麗英 女,(1978—),博士,教授,碩士生導(dǎo)師。主要研究方向:計算機視覺、圖像處理與深度學習、智慧農(nóng)業(yè)與遙感圖像處理。

楊玉竹 女,(2000—),碩士研究生。主要研究方向:計算機視覺、圖像處理與深度學習。

李樹龍 男,(2000—),碩士研究生。主要研究方向:計算機視覺、圖像處理與深度學習。

孫 淼 男,(2000—),碩士研究生。主要研究方向:計算機視覺、圖像處理與深度學習。

(*通信作者)陳桂芬 女,(1956—),博士,二級教授,博士生導(dǎo)師。主要研究方向:智能系統(tǒng)、數(shù)據(jù)挖掘、智慧農(nóng)業(yè)等計算機應(yīng)用理論與技術(shù)。

基金項目:國家自然科學基金(U19A2061);吉林省科技廳中青年科技創(chuàng)新創(chuàng)業(yè)卓越人才(團隊)項目(創(chuàng)新類)(20220508133RC);吉林省科技發(fā)展計劃項目(20210404020NC)